Périphériques technologiques

Périphériques technologiques

IA

IA

L'équipe Fudan NLP a publié un aperçu de 80 pages des agents modèles à grande échelle, fournissant un aperçu de l'état actuel et de l'avenir des agents IA dans un seul article.

L'équipe Fudan NLP a publié un aperçu de 80 pages des agents modèles à grande échelle, fournissant un aperçu de l'état actuel et de l'avenir des agents IA dans un seul article.

L'équipe Fudan NLP a publié un aperçu de 80 pages des agents modèles à grande échelle, fournissant un aperçu de l'état actuel et de l'avenir des agents IA dans un seul article.

- Lien papier : https://arxiv.org/pdf/2309.07864.pdf

- Liste papier des agents basés sur LLM : https://github.com/WooooDyy/LLM-Agent-Paper- Les membres de l'équipe List

Depuis longtemps, les chercheurs recherchent une

Depuis, la conception d'agents est devenue un sujet d'intérêt pour la communauté de l'intelligence artificielle. Cependant, les travaux antérieurs se sont principalement concentrés sur l’amélioration de capacités spécifiques des agents, comme le raisonnement symbolique ou la maîtrise de tâches spécifiques (échecs, Go, etc.). Ces études se concentrent davantage sur la conception d'algorithmes et les stratégies de formation, tout en ignorant le développement des capacités générales inhérentes au modèle, telles que la mémoire des connaissances, la planification à long terme, la généralisation efficace et l'interaction efficace. Il s'avère que

L'émergence de grands modèles de langage (LLM) laisse espérer le développement ultérieur d'agents intelligents. Si le parcours de développement de la PNL à l'AGI est divisé en cinq niveaux : corpus, Internet, perception, incarnation et attributs sociaux, alors les modèles de langage à grande échelle actuels ont atteint le deuxième niveau, avec la saisie et la sortie de texte à l'échelle d'Internet. Sur cette base, si les agents basés sur LLM disposent d'un espace de perception et d'un espace d'action, ils atteindront les troisième et quatrième niveaux. De plus, lorsque plusieurs agents interagissent et coopèrent pour résoudre des tâches plus complexes ou refléter des comportements sociaux dans le monde réel, ils ont le potentiel d’atteindre le cinquième niveau : la société des agents.

一 L'imagination de l'auteur d'une société harmonieuse composée d'agents intelligents peut également y participer. La scène est tirée du Sea Lantern Festival dans « Genshin Impact ».

La naissance d'un Agent

Terminal de contrôle (Cerveau), terminal de perception (Perception) et terminal d'action (Action).

- Contrôle

- : Généralement composé de LLM, il est le noyau des agents intelligents. Il peut non seulement stocker de la mémoire et des connaissances, mais également assumer des fonctions indispensables telles que le traitement de l'information et la prise de décision. Il peut présenter le processus de raisonnement et de planification et bien gérer des tâches inconnues, reflétant la généralisation et la transférabilité des agents intelligents.

- : Élargissez l'espace de perception des agents intelligents à partir du texte pur pour inclure des champs multimodaux tels que le texte, la vision et l'audition, permettant à l'agent d'obtenir et d'utiliser plus efficacement les informations de l'environnement environnant.

- : En plus de la sortie de texte régulière, l'agent a également la possibilité d'incarner et d'utiliser des outils, lui permettant de mieux s'adapter aux changements environnementaux, d'interagir avec l'environnement grâce au feedback, et même de façonner l'environnement. .

- Compréhension de l'implication : en plus du contenu exprimé intuitivement, le langage peut également transmettre des informations telles que les intentions et les préférences du locuteur. L’implication est que cela aide les agents à communiquer et à coopérer plus efficacement, et les grands modèles ont déjà montré leur potentiel à cet égard.

- Connaissances :

- Résumé : Résumer la mémoire pour améliorer la capacité de l'agent à extraire les détails clés de la mémoire.

- Mémoire compressée (Compression) : En compressant la mémoire à l'aide de vecteurs ou de structures de données appropriées, l'efficacité de la récupération de la mémoire peut être améliorée.

- De plus, la méthode de récupération de la mémoire est également très importante. Ce n'est qu'en récupérant le contenu approprié que l'agent peut accéder aux informations les plus pertinentes et les plus précises.

- Réflexion sur le plan : après avoir élaboré un plan, vous pouvez y réfléchir et évaluer ses forces et ses faiblesses. Ce type de réflexion repose généralement sur trois aspects : utiliser des mécanismes de rétroaction internes ; obtenir des commentaires de l'interaction avec les humains et obtenir des commentaires de l'environnement ;

- Transférabilité et généralisation :

Convertir l'entrée visuelle en description textuelle correspondante (sous-titrage d'image) : elle peut être directement comprise par les LLM et a une grande interprétabilité. Encodage et représentation des informations visuelles : Le module de perception est composé d'un modèle visuel de base + paradigme LLM, et le modèle comprend le contenu des différentes modalités à travers des opérations d'alignement, qui peuvent être entraînées de bout en bout.

L'observation peut aider l'agent intelligent à localiser sa propre position dans l'environnement, à percevoir des objets et des objets, et obtenir d'autres informations environnementales ; La manipulation consiste à effectuer certaines tâches spécifiques de saisie, de poussée et d'autres tâches opérationnelles La navigation nécessite que l'agent intelligent change de position en fonction de l'objectif de la tâche et mette à jour son statut en fonction de l'objectif de la tâche. aux informations environnementales.

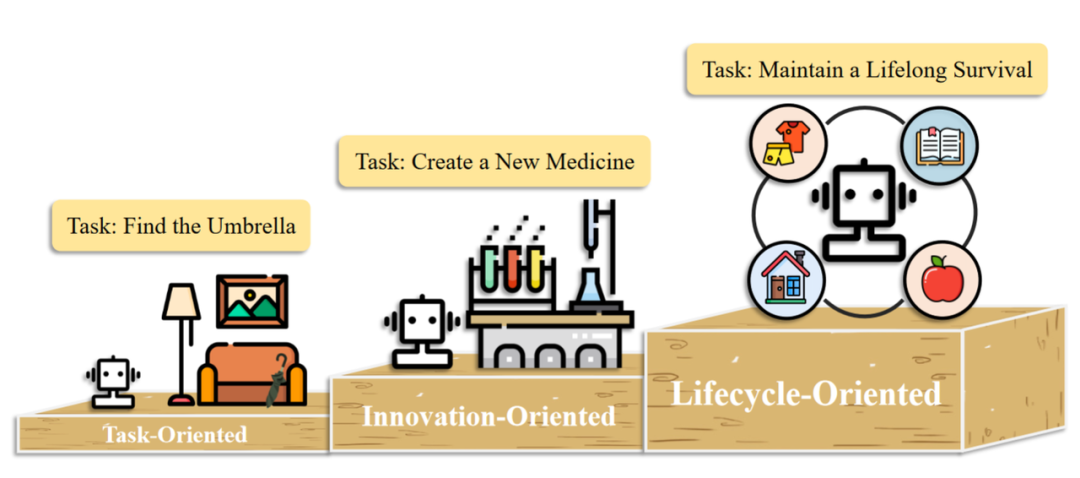

- orienté vers les tâches

- , les agents aident les utilisateurs humains à gérer les tâches quotidiennes de base. Ils doivent avoir une compréhension de base du commandement, la décomposition des tâches et la capacité d’interagir avec l’environnement. Plus précisément, selon les types de tâches existants, l'application réelle des agents peut être divisée en environnements de réseau simulés et scénarios de vie simulés.

Dans le déploiement de orientés vers l'innovation - , les agents peuvent démontrer le potentiel d'une enquête indépendante dans des domaines scientifiques de pointe. Bien que la complexité inhérente et le manque de données de formation dans des domaines spécialisés entravent la construction d'agents intelligents, de nombreux travaux progressent déjà dans des domaines tels que la chimie, les matériaux, l'informatique, etc.

Dans un déploiement orienté cycle de vie - , les agents ont la capacité d'explorer, d'acquérir et d'utiliser de nouvelles compétences en continu dans un monde ouvert, et de survivre longtemps. Dans cette section, les auteurs prennent comme exemple le jeu "Minecraft". Étant donné que le défi de survie dans le jeu peut être considéré comme un microcosme du monde réel, de nombreux chercheurs l’ont utilisé comme plate-forme unique pour développer et tester les capacités globales des agents.

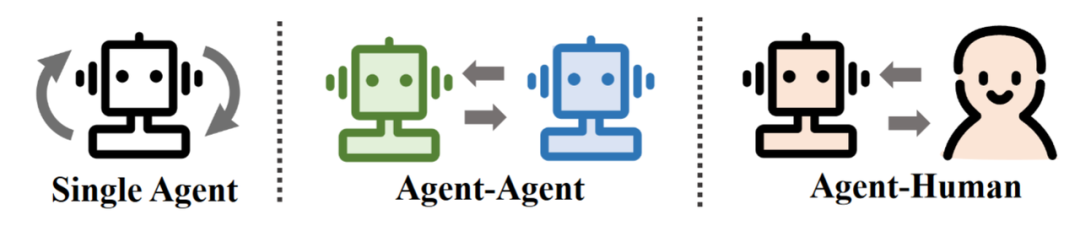

Scénario multi-agents

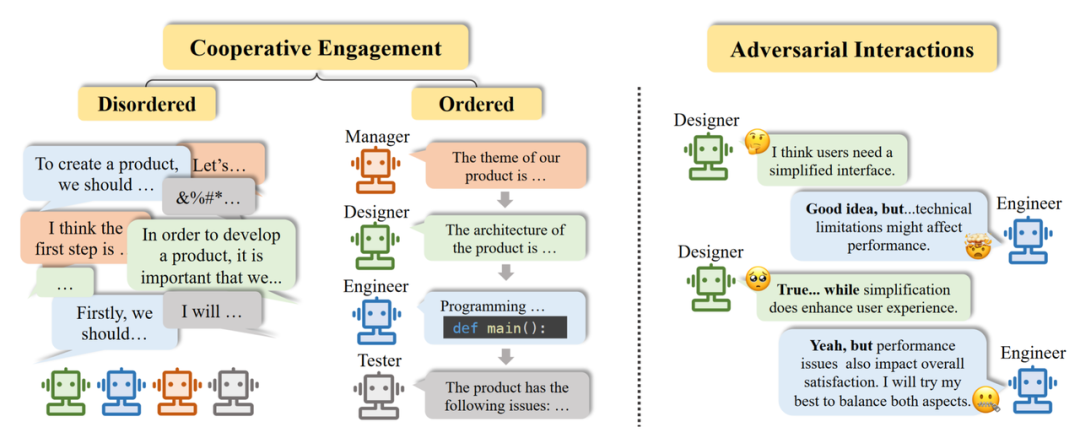

Interaction coopérative :

- Lorsque tous les agents suivent certaines règles, comme exprimer leurs opinions une par une sous la forme d'une chaîne de montage, l'ensemble du processus de coopération est ordonné, ce qu'on appelle une coopération ordonnée.

- Interaction contradictoire :

Scénario d'interaction homme-machine

- Mode Instructeur-Exécuteur

- : Les humains agissent en tant qu'instructeurs, donnant des instructions et des commentaires ; les agents agissent en tant qu'exécuteurs, s'ajustant et optimisant progressivement en fonction des instructions. Ce modèle a été largement utilisé dans les domaines de l’éducation, de la médecine, des affaires et autres.

- Certaines études ont observé que les agents peuvent faire preuve d'empathie dans la communication avec les humains ou participer à l'exécution de tâches sur un pied d'égalité. Les agents intelligents présentent un potentiel d’application dans la vie quotidienne et devraient être intégrés dans la société humaine à l’avenir.

Agent Society : De la personnalité à la socialité

Dans ce cadre, nous pouvons voir :

- Partie gauche :

- Au niveau individuel, les agents présentent une variété de comportements intériorisés tels que la planification, le raisonnement et la réflexion. De plus, les agents présentent des traits de personnalité intrinsèques qui couvrent les dimensions cognitives, émotionnelles et personnelles.

- Un agent unique peut former un groupe avec d'autres agents individuels pour présenter conjointement des comportements de groupe tels que la coopération, tels que la coopération collaborative.

- L'environnement peut prendre la forme d'un environnement bac à sable virtuel ou d'un monde physique réel. Les éléments de l'environnement comprennent les acteurs humains et diverses ressources disponibles. Pour un seul agent, d’autres agents font également partie de l’environnement.

- Les agents participent activement à l'ensemble du processus d'interaction en détectant l'environnement externe et en prenant des mesures.

Le comportement social et la personnalité des agents

L'article examine la performance des agents dans la société du point de vue du comportement externe et de la personnalité interne : : D'un point de vue social, le comportement peut être divisé en deux niveaux : individuel et collectif :

- Personnalité :

Y compris la cognition, l'émotion et la personnalité. Tout comme les humains développent progressivement leurs traits à travers le processus de socialisation, les agents font également preuve de ce qu'on appelle une « intelligence semblable à celle de l'humain », qui est la formation progressive de la personnalité par l'interaction avec des groupes et des environnements.

- Représentation du personnage : Afin de comprendre et d'analyser les caractéristiques de la personnalité des LLM, les chercheurs ont utilisé des méthodes d'évaluation matures, telles que les tests Big Five Personality et MBTI, pour explorer la diversité et la complexité de la personnalité.

- Simuler l'environnement opérationnel de la société

Étant donné que les LLM reposent principalement sur le langage comme format d'entrée et de sortie, les environnements basés sur du texte sont les plus naturels pour les agents. plateforme d'exploitation. Les phénomènes et interactions sociales sont décrits par des mots, et l'environnement textuel fournit des connaissances sémantiques et contextuelles. Les agents existent dans de tels mondes textuels et s’appuient sur des ressources textuelles pour percevoir, raisonner et agir.

- Environnement Physique Réel :

Un environnement physique est un environnement tangible composé d'objets et d'espaces réels dans lesquels les agents observent et agissent. Cet environnement introduit de riches apports sensoriels (visuels, auditifs et spatiaux). Contrairement aux environnements virtuels, les espaces physiques imposent davantage d’exigences au comportement des agents. Autrement dit, l'agent doit être adaptable à l'environnement physique et générer un contrôle de mouvement exécutable. L'auteur a donné un exemple pour expliquer la complexité de l'environnement physique : imaginez un agent intelligent actionnant un bras robotique dans une usine. Lors du fonctionnement du bras robotique, un contrôle précis de la force est nécessaire pour éviter d'endommager des objets de différents matériaux. ; de plus, l'agent Il est nécessaire de naviguer dans l'espace physique de travail et d'ajuster la trajectoire de mouvement dans le temps pour éviter les obstacles et optimiser la trajectoire de mouvement du bras robotique. Ces exigences augmentent la complexité et le défi des agents dans l'environnement physique. Simulation, lancez-vous ! Dans l'article, les auteurs estiment qu'une société simulée doit être ouverte, persistante, situationnelle et organisée. L'ouverture permet aux agents d'entrer et de sortir de la société simulée de manière autonome ; la persistance signifie que la société a une trajectoire cohérente qui se développe au fil du temps ; la contextualité met l'accent sur l'existence et le fonctionnement des sujets dans un environnement spécifique ; comme les règles et les restrictions. En ce qui concerne l'importance de la société simulée, la ville des agents génératifs de l'université de Stanford fournit un exemple frappant pour tout le monde : la société des agents peut être utilisée pour explorer les limites des capacités d'intelligence de groupe, par exemple, les agents ont organisé conjointement une fête pour la Saint-Valentin. ; Il peut également être utilisé pour accélérer la recherche en sciences sociales, comme l'observation des phénomènes de communication en simulant les réseaux sociaux. En outre, il existe également des études visant à explorer les valeurs derrière les agents en simulant des scénarios de prise de décision éthique, et à aider à la prise de décision en simulant l'impact des politiques sur la société. En outre, l'auteur souligne que ces simulations peuvent également comporter certains risques, notamment : des phénomènes sociaux néfastes et des préjugés ; Questions ouvertes prospectives À la fin de l'article, l'auteur aborde également quelques questions ouvertes prospectives pour inciter les lecteurs à réfléchir à : Intelligent agents et grands modèles de langage Comment nos recherches peuvent-elles se promouvoir mutuellement et se développer ensemble ? Les grands modèles ont montré un fort potentiel en termes de capacités de compréhension du langage, de prise de décision et de généralisation, et sont devenus un rôle clé dans le processus de construction d'agents. Les progrès des agents ont également mis en avant des exigences plus élevées pour les grands modèles. Quels défis et inquiétudes les agents basés sur LLM apporteront-ils ? La question de savoir si des agents intelligents peuvent réellement être mis en pratique nécessite une évaluation de sécurité rigoureuse pour éviter de nuire au monde réel. L'auteur résume d'autres menaces potentielles, telles que : les abus illégaux, le risque de chômage, l'impact sur le bien-être humain, etc. Quels opportunités et défis le passage à l’échelle apportera-t-il ? Dans une société simulée, augmenter le nombre d'individus peut améliorer considérablement la crédibilité et l'authenticité de la simulation. Cependant, à mesure que le nombre d'agents augmente, les problèmes de communication et de diffusion des messages deviendront très complexes, et la distorsion de l'information, les malentendus ou les hallucinations réduiront considérablement l'efficacité de l'ensemble du système de simulation. Le débat sur Internet pour savoir si l'agent basé sur LLM est la voie appropriée vers l'AGI. Certains chercheurs pensent que les grands modèles représentés par GPT-4 ont été formés sur un corpus suffisant et que les agents construits sur cette base ont le potentiel de devenir la clé pour ouvrir la porte à l'AGI. Mais d’autres chercheurs pensent que la modélisation linguistique auto-régressive ne montre pas une réelle intelligence car elle ne fait que réagir. Une méthode de modélisation plus complète, comme le World Model, peut conduire à l'AGI. L'évolution de l'intelligence en essaim. L’intelligence en essaim est un processus consistant à recueillir les opinions de nombreuses personnes et à les convertir en décisions. Mais la véritable « intelligence » sera-t-elle produite par la simple augmentation du nombre d’agents ? De plus, comment coordonner les agents individuels pour permettre à une société d’agents intelligents de surmonter la « pensée de groupe » et les biais cognitifs personnels ? Agent en tant que service (AaaS). Étant donné que les agents basés sur LLM sont plus complexes que le grand modèle lui-même et qu'il est plus difficile pour les petites et moyennes entreprises ou les particuliers de les créer localement, les fournisseurs de cloud peuvent envisager de mettre en œuvre des agents intelligents sous forme de services, c'est-à-dire des agents intelligents. en tant que service. Comme d’autres services cloud, l’AaaS a le potentiel d’offrir aux utilisateurs une grande flexibilité et un libre-service à la demande.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

L'auteur de ControlNet a encore un succès ! L'ensemble du processus de génération d'une peinture à partir d'une image, gagnant 1,4k étoiles en deux jours

Jul 17, 2024 am 01:56 AM

L'auteur de ControlNet a encore un succès ! L'ensemble du processus de génération d'une peinture à partir d'une image, gagnant 1,4k étoiles en deux jours

Jul 17, 2024 am 01:56 AM

Il s'agit également d'une vidéo Tusheng, mais PaintsUndo a emprunté une voie différente. L'auteur de ControlNet, LvminZhang, a recommencé à vivre ! Cette fois, je vise le domaine de la peinture. Le nouveau projet PaintsUndo a reçu 1,4kstar (toujours en hausse folle) peu de temps après son lancement. Adresse du projet : https://github.com/lllyasviel/Paints-UNDO Grâce à ce projet, l'utilisateur saisit une image statique et PaintsUndo peut automatiquement vous aider à générer une vidéo de l'ensemble du processus de peinture, du brouillon de ligne au suivi du produit fini. . Pendant le processus de dessin, les changements de lignes sont étonnants. Le résultat vidéo final est très similaire à l’image originale : jetons un coup d’œil à un dessin complet.

Du RLHF au DPO en passant par TDPO, les algorithmes d'alignement des grands modèles sont déjà « au niveau des jetons »

Jun 24, 2024 pm 03:04 PM

Du RLHF au DPO en passant par TDPO, les algorithmes d'alignement des grands modèles sont déjà « au niveau des jetons »

Jun 24, 2024 pm 03:04 PM

La colonne AIxiv est une colonne où ce site publie du contenu académique et technique. Au cours des dernières années, la rubrique AIxiv de ce site a reçu plus de 2 000 rapports, couvrant les meilleurs laboratoires des principales universités et entreprises du monde entier, favorisant efficacement les échanges et la diffusion académiques. Si vous souhaitez partager un excellent travail, n'hésitez pas à contribuer ou à nous contacter pour un rapport. Courriel de soumission : liyazhou@jiqizhixin.com ; zhaoyunfeng@jiqizhixin.com Dans le processus de développement de l'intelligence artificielle, le contrôle et le guidage des grands modèles de langage (LLM) ont toujours été l'un des principaux défis, visant à garantir que ces modèles sont à la fois puissant et sûr au service de la société humaine. Les premiers efforts se sont concentrés sur les méthodes d’apprentissage par renforcement par feedback humain (RL

En tête de liste des ingénieurs logiciels d'IA open source, la solution sans agent de l'UIUC résout facilement les problèmes de programmation réels du banc SWE.

Jul 17, 2024 pm 10:02 PM

En tête de liste des ingénieurs logiciels d'IA open source, la solution sans agent de l'UIUC résout facilement les problèmes de programmation réels du banc SWE.

Jul 17, 2024 pm 10:02 PM

La colonne AIxiv est une colonne où ce site publie du contenu académique et technique. Au cours des dernières années, la rubrique AIxiv de ce site a reçu plus de 2 000 rapports, couvrant les meilleurs laboratoires des principales universités et entreprises du monde entier, favorisant efficacement les échanges et la diffusion académiques. Si vous souhaitez partager un excellent travail, n'hésitez pas à contribuer ou à nous contacter pour un rapport. Courriel de soumission : liyazhou@jiqizhixin.com ; zhaoyunfeng@jiqizhixin.com Les auteurs de cet article font tous partie de l'équipe de l'enseignant Zhang Lingming de l'Université de l'Illinois à Urbana-Champaign (UIUC), notamment : Steven Code repair ; doctorant en quatrième année, chercheur

Travail posthume de l'équipe OpenAI Super Alignment : deux grands modèles jouent à un jeu et le résultat devient plus compréhensible

Jul 19, 2024 am 01:29 AM

Travail posthume de l'équipe OpenAI Super Alignment : deux grands modèles jouent à un jeu et le résultat devient plus compréhensible

Jul 19, 2024 am 01:29 AM

Si la réponse donnée par le modèle d’IA est incompréhensible du tout, oseriez-vous l’utiliser ? À mesure que les systèmes d’apprentissage automatique sont utilisés dans des domaines de plus en plus importants, il devient de plus en plus important de démontrer pourquoi nous pouvons faire confiance à leurs résultats, et quand ne pas leur faire confiance. Une façon possible de gagner confiance dans le résultat d'un système complexe est d'exiger que le système produise une interprétation de son résultat qui soit lisible par un humain ou un autre système de confiance, c'est-à-dire entièrement compréhensible au point que toute erreur possible puisse être trouvé. Par exemple, pour renforcer la confiance dans le système judiciaire, nous exigeons que les tribunaux fournissent des avis écrits clairs et lisibles qui expliquent et soutiennent leurs décisions. Pour les grands modèles de langage, nous pouvons également adopter une approche similaire. Cependant, lorsque vous adoptez cette approche, assurez-vous que le modèle de langage génère

La formation Axiom permet au LLM d'apprendre le raisonnement causal : le modèle à 67 millions de paramètres est comparable au niveau de mille milliards de paramètres GPT-4.

Jul 17, 2024 am 10:14 AM

La formation Axiom permet au LLM d'apprendre le raisonnement causal : le modèle à 67 millions de paramètres est comparable au niveau de mille milliards de paramètres GPT-4.

Jul 17, 2024 am 10:14 AM

Montrez la chaîne causale à LLM et il pourra apprendre les axiomes. L'IA aide déjà les mathématiciens et les scientifiques à mener des recherches. Par exemple, le célèbre mathématicien Terence Tao a partagé à plusieurs reprises son expérience de recherche et d'exploration à l'aide d'outils d'IA tels que GPT. Pour que l’IA soit compétitive dans ces domaines, des capacités de raisonnement causal solides et fiables sont essentielles. La recherche présentée dans cet article a révélé qu'un modèle Transformer formé sur la démonstration de l'axiome de transitivité causale sur de petits graphes peut se généraliser à l'axiome de transitivité sur de grands graphes. En d’autres termes, si le Transformateur apprend à effectuer un raisonnement causal simple, il peut être utilisé pour un raisonnement causal plus complexe. Le cadre de formation axiomatique proposé par l'équipe est un nouveau paradigme pour l'apprentissage du raisonnement causal basé sur des données passives, avec uniquement des démonstrations.

Les articles arXiv peuvent être publiés sous forme de 'barrage', la plateforme de discussion alphaXiv de Stanford est en ligne, LeCun l'aime

Aug 01, 2024 pm 05:18 PM

Les articles arXiv peuvent être publiés sous forme de 'barrage', la plateforme de discussion alphaXiv de Stanford est en ligne, LeCun l'aime

Aug 01, 2024 pm 05:18 PM

acclamations! Qu’est-ce que ça fait lorsqu’une discussion sur papier se résume à des mots ? Récemment, des étudiants de l'Université de Stanford ont créé alphaXiv, un forum de discussion ouvert pour les articles arXiv qui permet de publier des questions et des commentaires directement sur n'importe quel article arXiv. Lien du site Web : https://alphaxiv.org/ En fait, il n'est pas nécessaire de visiter spécifiquement ce site Web. Il suffit de remplacer arXiv dans n'importe quelle URL par alphaXiv pour ouvrir directement l'article correspondant sur le forum alphaXiv : vous pouvez localiser avec précision les paragraphes dans. l'article, Phrase : dans la zone de discussion sur la droite, les utilisateurs peuvent poser des questions à l'auteur sur les idées et les détails de l'article. Par exemple, ils peuvent également commenter le contenu de l'article, tels que : "Donné à".

Une avancée significative dans l'hypothèse de Riemann ! Tao Zhexuan recommande fortement les nouveaux articles du MIT et d'Oxford, et le lauréat de la médaille Fields, âgé de 37 ans, a participé

Aug 05, 2024 pm 03:32 PM

Une avancée significative dans l'hypothèse de Riemann ! Tao Zhexuan recommande fortement les nouveaux articles du MIT et d'Oxford, et le lauréat de la médaille Fields, âgé de 37 ans, a participé

Aug 05, 2024 pm 03:32 PM

Récemment, l’hypothèse de Riemann, connue comme l’un des sept problèmes majeurs du millénaire, a réalisé une nouvelle avancée. L'hypothèse de Riemann est un problème mathématique non résolu très important, lié aux propriétés précises de la distribution des nombres premiers (les nombres premiers sont les nombres qui ne sont divisibles que par 1 et par eux-mêmes, et jouent un rôle fondamental dans la théorie des nombres). Dans la littérature mathématique actuelle, il existe plus d'un millier de propositions mathématiques basées sur l'établissement de l'hypothèse de Riemann (ou sa forme généralisée). En d’autres termes, une fois que l’hypothèse de Riemann et sa forme généralisée seront prouvées, ces plus d’un millier de propositions seront établies sous forme de théorèmes, qui auront un impact profond sur le domaine des mathématiques et si l’hypothèse de Riemann s’avère fausse, alors parmi eux ; ces propositions qui en font partie perdront également de leur efficacité. Une nouvelle percée vient du professeur de mathématiques du MIT, Larry Guth, et de l'Université d'Oxford

LLM n'est vraiment pas bon pour la prédiction de séries chronologiques. Il n'utilise même pas sa capacité de raisonnement.

Jul 15, 2024 pm 03:59 PM

LLM n'est vraiment pas bon pour la prédiction de séries chronologiques. Il n'utilise même pas sa capacité de raisonnement.

Jul 15, 2024 pm 03:59 PM

Les modèles linguistiques peuvent-ils vraiment être utilisés pour la prédiction de séries chronologiques ? Selon la loi des gros titres de Betteridge (tout titre d'actualité se terminant par un point d'interrogation peut recevoir une réponse « non »), la réponse devrait être non. Le fait semble être vrai : un LLM aussi puissant ne peut pas bien gérer les données de séries chronologiques. Les séries chronologiques, c'est-à-dire les séries chronologiques, comme leur nom l'indique, font référence à un ensemble de séquences de points de données disposées par ordre temporel. L'analyse des séries chronologiques est essentielle dans de nombreux domaines, notamment la prévision de la propagation des maladies, l'analyse du commerce de détail, la santé et la finance. Dans le domaine de l'analyse des séries chronologiques, de nombreux chercheurs ont récemment étudié comment utiliser les grands modèles linguistiques (LLM) pour classer, prédire et détecter les anomalies dans les séries chronologiques. Ces articles supposent que les modèles de langage capables de gérer les dépendances séquentielles dans le texte peuvent également se généraliser aux séries chronologiques.