Périphériques technologiques

Périphériques technologiques

IA

IA

Problème de changement d'échelle de cible dans la technologie de détection de cible

Problème de changement d'échelle de cible dans la technologie de détection de cible

Problème de changement d'échelle de cible dans la technologie de détection de cible

Le problème du changement d'échelle de cible dans la technologie de détection de cible nécessite des exemples de code spécifiques

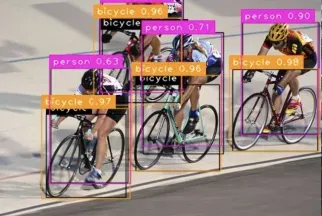

Ces dernières années, le développement de la technologie de détection de cible dans le domaine de la vision par ordinateur a fait d'énormes percées. Cependant, le problème du changement d’échelle des cibles a toujours constitué un défi important qui pèse sur les algorithmes de détection de cibles. Le changement d'échelle de la cible signifie que la taille de la cible dans l'image n'est pas cohérente avec sa taille dans l'ensemble d'entraînement, ce qui aura un impact important sur la précision et la stabilité de la détection de la cible. Cet article présentera les causes, les effets et les solutions au problème de changement d'échelle cible, et donnera des exemples de code spécifiques.

Tout d’abord, la principale cause du problème de changement d’échelle cible est la diversité d’échelle des objets dans le monde réel. L'échelle d'une même cible changera selon les scènes et les angles de vision. Par exemple, la taille d'une personne changera considérablement selon les distances. Les algorithmes de détection de cibles sont généralement formés sur des ensembles de données limités et ne peuvent pas couvrir tous les changements d'échelle possibles. Par conséquent, lorsque l’échelle de la cible change, il est souvent difficile pour l’algorithme de détecter avec précision la cible.

Le problème du changement d'échelle de cible a un impact très évident sur la détection des cibles. D'une part, les changements dans l'échelle de la cible entraîneront des changements dans les caractéristiques de la cible, ce qui rendra difficile pour le modèle entraîné de lui faire correspondre avec précision. D’un autre côté, les changements d’échelle de la cible entraîneront également des changements dans l’apparence de la cible, introduisant ainsi des signaux de bruit et réduisant la précision et la stabilité de la détection. Par conséquent, résoudre le problème des changements d’échelle des cibles est crucial pour améliorer les performances des algorithmes de détection de cibles.

Les chercheurs ont proposé une série de solutions au problème des changements d'échelle cible. L’une des méthodes couramment utilisées consiste à utiliser des détecteurs multi-échelles. Cette méthode détecte les images à différentes échelles et peut mieux s'adapter aux changements d'échelle cible. Plus précisément, le détecteur multi-échelle génère une série d'images de différentes échelles en mettant à l'échelle ou en recadrant l'image d'entrée, et effectue une détection d'objet sur ces images. Cette méthode peut améliorer efficacement le problème des changements d'échelle cible et améliorer la précision de la détection.

Ce qui suit est un exemple de code qui montre comment utiliser un détecteur multi-échelle pour résoudre le problème des changements d'échelle cible :

import cv2

import numpy as np

# 加载图像

image = cv2.imread("image.jpg")

# 定义尺度因子

scales = [0.5, 1.0, 1.5]

# 创建检测器

detector = cv2.CascadeClassifier("haarcascade_frontalface_default.xml")

# 多尺度检测

for scale in scales:

# 尺度变换

resized_image = cv2.resize(image, None, fx=scale, fy=scale, interpolation=cv2.INTER_LINEAR)

# 目标检测

faces = detector.detectMultiScale(resized_image, scaleFactor=1.1, minNeighbors=5, minSize=(30, 30))

# 绘制检测结果

for (x, y, w, h) in faces:

cv2.rectangle(resized_image, (x, y), (x + w, y + h), (0, 255, 0), 2)

# 显示图像

cv2.imshow("Multi-scale Detection", resized_image)

cv2.waitKey(0)Dans le code ci-dessus, l'image est d'abord chargée puis un ensemble de facteurs d'échelle sont définis, dans cet exemple, nous avons sélectionné trois facteurs d'échelle. Ensuite, en mettant l'image à l'échelle, des images de différentes échelles sont générées. Ensuite, le classificateur en cascade d'OpenCV CascadeClassifier est utilisé pour la détection d'objets et les résultats de la détection sont tracés sur l'image. Enfin, l'image résultante est affichée et attend la saisie au clavier de l'utilisateur.

En utilisant des détecteurs multi-échelles, nous pouvons résoudre efficacement le problème des changements d'échelle des cibles et améliorer les performances de détection des cibles. Bien entendu, outre les détecteurs multi-échelles, il existe d’autres méthodes et techniques qui peuvent être utilisées pour résoudre le problème des changements d’échelle des cibles. Espérons que cet exemple de code sera utile pour comprendre et appliquer le problème de changement d’échelle cible.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Le papier Stable Diffusion 3 est enfin publié, et les détails architecturaux sont révélés. Cela aidera-t-il à reproduire Sora ?

Mar 06, 2024 pm 05:34 PM

Le papier Stable Diffusion 3 est enfin publié, et les détails architecturaux sont révélés. Cela aidera-t-il à reproduire Sora ?

Mar 06, 2024 pm 05:34 PM

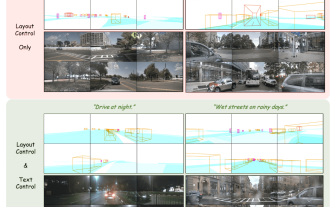

L'article de StableDiffusion3 est enfin là ! Ce modèle est sorti il y a deux semaines et utilise la même architecture DiT (DiffusionTransformer) que Sora. Il a fait beaucoup de bruit dès sa sortie. Par rapport à la version précédente, la qualité des images générées par StableDiffusion3 a été considérablement améliorée. Il prend désormais en charge les invites multithèmes, et l'effet d'écriture de texte a également été amélioré et les caractères tronqués n'apparaissent plus. StabilityAI a souligné que StableDiffusion3 est une série de modèles avec des tailles de paramètres allant de 800M à 8B. Cette plage de paramètres signifie que le modèle peut être exécuté directement sur de nombreux appareils portables, réduisant ainsi considérablement l'utilisation de l'IA.

Avez-vous vraiment maîtrisé la conversion des systèmes de coordonnées ? Des enjeux multi-capteurs indispensables à la conduite autonome

Oct 12, 2023 am 11:21 AM

Avez-vous vraiment maîtrisé la conversion des systèmes de coordonnées ? Des enjeux multi-capteurs indispensables à la conduite autonome

Oct 12, 2023 am 11:21 AM

Le premier article pilote et clé présente principalement plusieurs systèmes de coordonnées couramment utilisés dans la technologie de conduite autonome, et comment compléter la corrélation et la conversion entre eux, et enfin construire un modèle d'environnement unifié. L'objectif ici est de comprendre la conversion du véhicule en corps rigide de caméra (paramètres externes), la conversion de caméra en image (paramètres internes) et la conversion d'image en unité de pixel. La conversion de 3D en 2D aura une distorsion, une traduction, etc. Points clés : Le système de coordonnées du véhicule et le système de coordonnées du corps de la caméra doivent être réécrits : le système de coordonnées planes et le système de coordonnées des pixels Difficulté : la distorsion de l'image doit être prise en compte. La dé-distorsion et l'ajout de distorsion sont compensés sur le plan de l'image. 2. Introduction Il existe quatre systèmes de vision au total : système de coordonnées du plan de pixels (u, v), système de coordonnées d'image (x, y), système de coordonnées de caméra () et système de coordonnées mondiales (). Il existe une relation entre chaque système de coordonnées,

Cet article vous suffit pour en savoir plus sur la conduite autonome et la prédiction de trajectoire !

Feb 28, 2024 pm 07:20 PM

Cet article vous suffit pour en savoir plus sur la conduite autonome et la prédiction de trajectoire !

Feb 28, 2024 pm 07:20 PM

La prédiction de trajectoire joue un rôle important dans la conduite autonome. La prédiction de trajectoire de conduite autonome fait référence à la prédiction de la trajectoire de conduite future du véhicule en analysant diverses données pendant le processus de conduite du véhicule. En tant que module central de la conduite autonome, la qualité de la prédiction de trajectoire est cruciale pour le contrôle de la planification en aval. La tâche de prédiction de trajectoire dispose d'une riche pile technologique et nécessite une connaissance de la perception dynamique/statique de la conduite autonome, des cartes de haute précision, des lignes de voie, des compétences en architecture de réseau neuronal (CNN&GNN&Transformer), etc. Il est très difficile de démarrer ! De nombreux fans espèrent se lancer dans la prédiction de trajectoire le plus tôt possible et éviter les pièges. Aujourd'hui, je vais faire le point sur quelques problèmes courants et des méthodes d'apprentissage introductives pour la prédiction de trajectoire ! Connaissances introductives 1. Existe-t-il un ordre d'entrée pour les épreuves de prévisualisation ? R : Regardez d’abord l’enquête, p

Annotation de cadre de délimitation redondant multi-grille pour une détection précise des objets

Jun 01, 2024 pm 09:46 PM

Annotation de cadre de délimitation redondant multi-grille pour une détection précise des objets

Jun 01, 2024 pm 09:46 PM

1. Introduction Actuellement, les principaux détecteurs d'objets sont des réseaux à deux étages ou à un étage basés sur le réseau de classificateurs de base réutilisé du Deep CNN. YOLOv3 est l'un de ces détecteurs à un étage de pointe bien connus qui reçoit une image d'entrée et la divise en une matrice de grille de taille égale. Les cellules de grille avec des centres cibles sont chargées de détecter des cibles spécifiques. Ce que je partage aujourd'hui est une nouvelle méthode mathématique qui alloue plusieurs grilles à chaque cible pour obtenir une prédiction précise et précise du cadre de délimitation. Les chercheurs ont également proposé une amélioration efficace des données par copier-coller hors ligne pour la détection des cibles. La méthode nouvellement proposée surpasse considérablement certains détecteurs d’objets de pointe actuels et promet de meilleures performances. 2. Le réseau de détection de cibles en arrière-plan est conçu pour utiliser

Nouveau SOTA pour la détection de cibles : YOLOv9 sort et la nouvelle architecture redonne vie à la convolution traditionnelle

Feb 23, 2024 pm 12:49 PM

Nouveau SOTA pour la détection de cibles : YOLOv9 sort et la nouvelle architecture redonne vie à la convolution traditionnelle

Feb 23, 2024 pm 12:49 PM

Dans le domaine de la détection de cibles, YOLOv9 continue de progresser dans le processus de mise en œuvre en adoptant de nouvelles architectures et méthodes, il améliore efficacement l'utilisation des paramètres de la convolution traditionnelle, ce qui rend ses performances bien supérieures à celles des produits de la génération précédente. Plus d'un an après la sortie officielle de YOLOv8 en janvier 2023, YOLOv9 est enfin là ! Depuis que Joseph Redmon, Ali Farhadi et d’autres ont proposé le modèle YOLO de première génération en 2015, les chercheurs dans le domaine de la détection de cibles l’ont mis à jour et itéré à plusieurs reprises. YOLO est un système de prédiction basé sur des informations globales d'images et les performances de son modèle sont continuellement améliorées. En améliorant continuellement les algorithmes et les technologies, les chercheurs ont obtenu des résultats remarquables, rendant YOLO de plus en plus puissant dans les tâches de détection de cibles.

DualBEV : dépassant largement BEVFormer et BEVDet4D, ouvrez le livre !

Mar 21, 2024 pm 05:21 PM

DualBEV : dépassant largement BEVFormer et BEVDet4D, ouvrez le livre !

Mar 21, 2024 pm 05:21 PM

Cet article explore le problème de la détection précise d'objets sous différents angles de vue (tels que la perspective et la vue à vol d'oiseau) dans la conduite autonome, en particulier comment transformer efficacement les caractéristiques de l'espace en perspective (PV) en vue à vol d'oiseau (BEV). implémenté via le module Visual Transformation (VT). Les méthodes existantes sont globalement divisées en deux stratégies : la conversion 2D en 3D et la conversion 3D en 2D. Les méthodes 2D vers 3D améliorent les caractéristiques 2D denses en prédisant les probabilités de profondeur, mais l'incertitude inhérente aux prévisions de profondeur, en particulier dans les régions éloignées, peut introduire des inexactitudes. Alors que les méthodes 3D vers 2D utilisent généralement des requêtes 3D pour échantillonner des fonctionnalités 2D et apprendre les poids d'attention de la correspondance entre les fonctionnalités 3D et 2D via un transformateur, ce qui augmente le temps de calcul et de déploiement.

Le premier modèle mondial de génération de vidéos de scènes de conduite autonomes multi-vues DrivingDiffusion : nouvelles idées pour les données et la simulation BEV

Oct 23, 2023 am 11:13 AM

Le premier modèle mondial de génération de vidéos de scènes de conduite autonomes multi-vues DrivingDiffusion : nouvelles idées pour les données et la simulation BEV

Oct 23, 2023 am 11:13 AM

Quelques réflexions personnelles de l'auteur Dans le domaine de la conduite autonome, avec le développement de sous-tâches/solutions de bout en bout basées sur BEV, les données d'entraînement multi-vues de haute qualité et la construction de scènes de simulation correspondantes sont devenues de plus en plus importantes. En réponse aux problèmes des tâches actuelles, la « haute qualité » peut être divisée en trois aspects : des scénarios à longue traîne dans différentes dimensions : comme les véhicules à courte portée dans les données sur les obstacles et les angles de cap précis lors du découpage des voitures, et les données sur les lignes de voie. . Scènes telles que des courbes avec des courbures différentes ou des rampes/fusions/fusions difficiles à capturer. Celles-ci reposent souvent sur de grandes quantités de données collectées et sur des stratégies complexes d’exploration de données, qui sont coûteuses. Valeur réelle 3D - image hautement cohérente : l'acquisition actuelle des données BEV est souvent affectée par des erreurs d'installation/calibrage du capteur, des cartes de haute précision et l'algorithme de reconstruction lui-même. cela m'a amené à

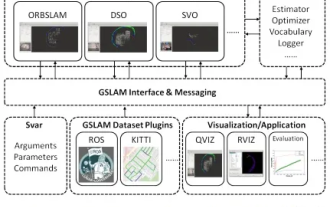

GSLAM | Une architecture générale et un benchmark

Oct 20, 2023 am 11:37 AM

GSLAM | Une architecture générale et un benchmark

Oct 20, 2023 am 11:37 AM

J'ai soudainement découvert un article vieux de 19 ans GSLAM : A General SLAM Framework and Benchmark open source code : https://github.com/zdzhaoyong/GSLAM Accédez directement au texte intégral et ressentez la qualité de ce travail ~ 1 Technologie SLAM abstraite a remporté de nombreux succès récemment et a attiré de nombreuses entreprises de haute technologie. Cependant, la question de savoir comment s'interfacer avec les algorithmes existants ou émergents pour effectuer efficacement des analyses comparatives en termes de vitesse, de robustesse et de portabilité reste une question. Dans cet article, une nouvelle plateforme SLAM appelée GSLAM est proposée, qui fournit non seulement des capacités d'évaluation, mais fournit également aux chercheurs un moyen utile de développer rapidement leurs propres systèmes SLAM.