Périphériques technologiques

Périphériques technologiques

IA

IA

Problème de perte de qualité d'image dans la technologie anti-rebond d'image

Problème de perte de qualité d'image dans la technologie anti-rebond d'image

Problème de perte de qualité d'image dans la technologie anti-rebond d'image

Problème de perte de qualité d'image dans la technologie anti-rebond d'image, des exemples de code spécifiques sont nécessaires

Résumé : La technologie anti-rebond d'image est une méthode utilisée pour réduire le bruit et la gigue dans les images, mais cela peut être possible pendant le processus anti-rebond d'image. une perte de qualité d’image. Cet article explorera le problème de la perte de qualité d'image dans la technologie anti-rebond d'image et fournira des exemples de code spécifiques.

1. Introduction

Avec la popularité des appareils photo numériques et des smartphones, les gens sont de plus en plus capables de prendre facilement des photos de haute qualité. Cependant, des tremblements et du bruit peuvent apparaître sur les photos en raison de facteurs tels qu'un tremblement de la main ou un mouvement de l'appareil photo pendant la prise de vue. Pour améliorer la qualité de l’image, les chercheurs ont développé diverses techniques anti-rebond d’image.

2. Présentation de la technologie de désagitation d'image

La technologie de désagitation d'image améliore principalement la qualité de l'image en éliminant ou en réduisant la gigue et le bruit dans les images. Les techniques courantes anti-rebond d'image comprennent les méthodes basées sur des filtres, les méthodes basées sur l'égalisation et les méthodes basées sur les capteurs.

3. Analyse du problème de perte de qualité d'image

Bien que la technologie de désagitation d'image puisse réduire efficacement la gigue et le bruit, elle peut entraîner une perte de qualité d'image pendant le processus de traitement. Les principales raisons incluent les aspects suivants :

- Perte d'informations : pendant le processus de suppression de la gigue et du bruit, certaines informations détaillées de l'image peuvent être floues ou perdues, entraînant une diminution de la qualité de l'image.

- Distorsion des couleurs : certaines technologies anti-rebond d'image modifieront la distribution des couleurs de l'image, provoquant une distorsion des couleurs de l'image et affectant les effets visuels.

- Introduction d'artefacts : certaines techniques anti-rebond d'image peuvent introduire des artefacts, c'est-à-dire que certaines zones avec des contours clairs et sombres incohérents ou peu clairs apparaissent dans l'image.

4. Solution au problème de la perte de qualité d'image

Afin de résoudre le problème de perte de qualité d'image dans la technologie anti-rebond d'image, nous pouvons utiliser les méthodes suivantes :

- Ajustement des paramètres : selon l'algorithme anti-rebond d'image spécifique, Ajustez raisonnablement les paramètres de l'algorithme pour équilibrer l'effet anti-rebond et la qualité de l'image. Par exemple, pour les algorithmes anti-rebond basés sur le filtrage, la taille et la force du filtre peuvent être ajustées pour obtenir de meilleurs résultats.

- Traitement multi-échelles : divisez l'image en plusieurs échelles et effectuez différents traitements anti-rebond sur chaque échelle. Ensuite, la fusion est effectuée au cas par cas pour conserver les informations détaillées et la qualité globale de l'image.

- Présentation des informations préalables : l'utilisation des informations préalables de l'image, telles que les caractéristiques de structure et de texture de l'image, permet de réduire la perte de qualité de l'image. Le processus anti-rebond peut être guidé en introduisant des informations préalables pour conserver les détails et la clarté de l'image.

5. Exemples de code spécifiques

Ce qui suit est un exemple simple qui démontre l'utilisation de la bibliothèque OpenCV pour implémenter une technologie anti-rebond basée sur le filtrage dans un environnement Python et pour réduire la perte de qualité d'image grâce à l'ajustement des paramètres et à l'utilisation multi-échelle. traitement :

import cv2

def image_denoising(image, filter_size, filter_strength):

# 使用均值滤波器进行去抖,参数为滤波器尺寸和强度

denoised_image = cv2.blur(image, (filter_size, filter_size))

return denoised_image

# 加载原始图像

image = cv2.imread('input.jpg')

# 调整参数进行去抖处理

denoised_image = image_denoising(image, 5, 10)

# 显示原始图像和处理后的图像

cv2.imshow('Original Image', image)

cv2.imshow('Denoised Image', denoised_image)

cv2.waitKey(0)

cv2.destroyAllWindows()Dans le code ci-dessus, le paramètre image_denoising函数使用了均值滤波器进行去抖处理。通过调整filter_size和filter_strength peut obtenir un contrôle équilibré sur l'effet anti-rebond de l'image et la qualité de l'image.

6. Conclusion

La technologie anti-rebond d'image joue un rôle important dans l'amélioration de la qualité de l'image. Cependant, lors de l’utilisation de la technologie anti-rebond d’image, nous devons également prêter attention au problème de la perte de qualité d’image. Ajuster correctement les paramètres de l'algorithme, en utilisant des méthodes telles que le traitement multi-échelle et l'introduction d'informations préalables, peut réduire la perte de qualité de l'image et obtenir de meilleurs effets anti-rebond.

Références :

[1] Zhang, L., Zhang, L. et Du, R. (2003). Déflouage d'images : méthodes, implémentations et applications.

[2] Buades, A., Coll , B. et Morel, J. M. (2005). Un algorithme non local pour le débruitage d'image. Dans la conférence de la IEEE Computer Society sur la vision par ordinateur et la reconnaissance de formes (CVPR'05) (Vol. 2, pp. 60-65).

[3] Tomasi, C. et Manduchi, R. (1998). Filtrage bilatéral pour les images grises et couleur. Dans Conférence internationale sur la vision par ordinateur (pp. 839-846).

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Le papier Stable Diffusion 3 est enfin publié, et les détails architecturaux sont révélés. Cela aidera-t-il à reproduire Sora ?

Mar 06, 2024 pm 05:34 PM

Le papier Stable Diffusion 3 est enfin publié, et les détails architecturaux sont révélés. Cela aidera-t-il à reproduire Sora ?

Mar 06, 2024 pm 05:34 PM

L'article de StableDiffusion3 est enfin là ! Ce modèle est sorti il y a deux semaines et utilise la même architecture DiT (DiffusionTransformer) que Sora. Il a fait beaucoup de bruit dès sa sortie. Par rapport à la version précédente, la qualité des images générées par StableDiffusion3 a été considérablement améliorée. Il prend désormais en charge les invites multithèmes, et l'effet d'écriture de texte a également été amélioré et les caractères tronqués n'apparaissent plus. StabilityAI a souligné que StableDiffusion3 est une série de modèles avec des tailles de paramètres allant de 800M à 8B. Cette plage de paramètres signifie que le modèle peut être exécuté directement sur de nombreux appareils portables, réduisant ainsi considérablement l'utilisation de l'IA.

Cet article vous suffit pour en savoir plus sur la conduite autonome et la prédiction de trajectoire !

Feb 28, 2024 pm 07:20 PM

Cet article vous suffit pour en savoir plus sur la conduite autonome et la prédiction de trajectoire !

Feb 28, 2024 pm 07:20 PM

La prédiction de trajectoire joue un rôle important dans la conduite autonome. La prédiction de trajectoire de conduite autonome fait référence à la prédiction de la trajectoire de conduite future du véhicule en analysant diverses données pendant le processus de conduite du véhicule. En tant que module central de la conduite autonome, la qualité de la prédiction de trajectoire est cruciale pour le contrôle de la planification en aval. La tâche de prédiction de trajectoire dispose d'une riche pile technologique et nécessite une connaissance de la perception dynamique/statique de la conduite autonome, des cartes de haute précision, des lignes de voie, des compétences en architecture de réseau neuronal (CNN&GNN&Transformer), etc. Il est très difficile de démarrer ! De nombreux fans espèrent se lancer dans la prédiction de trajectoire le plus tôt possible et éviter les pièges. Aujourd'hui, je vais faire le point sur quelques problèmes courants et des méthodes d'apprentissage introductives pour la prédiction de trajectoire ! Connaissances introductives 1. Existe-t-il un ordre d'entrée pour les épreuves de prévisualisation ? R : Regardez d’abord l’enquête, p

DualBEV : dépassant largement BEVFormer et BEVDet4D, ouvrez le livre !

Mar 21, 2024 pm 05:21 PM

DualBEV : dépassant largement BEVFormer et BEVDet4D, ouvrez le livre !

Mar 21, 2024 pm 05:21 PM

Cet article explore le problème de la détection précise d'objets sous différents angles de vue (tels que la perspective et la vue à vol d'oiseau) dans la conduite autonome, en particulier comment transformer efficacement les caractéristiques de l'espace en perspective (PV) en vue à vol d'oiseau (BEV). implémenté via le module Visual Transformation (VT). Les méthodes existantes sont globalement divisées en deux stratégies : la conversion 2D en 3D et la conversion 3D en 2D. Les méthodes 2D vers 3D améliorent les caractéristiques 2D denses en prédisant les probabilités de profondeur, mais l'incertitude inhérente aux prévisions de profondeur, en particulier dans les régions éloignées, peut introduire des inexactitudes. Alors que les méthodes 3D vers 2D utilisent généralement des requêtes 3D pour échantillonner des fonctionnalités 2D et apprendre les poids d'attention de la correspondance entre les fonctionnalités 3D et 2D via un transformateur, ce qui augmente le temps de calcul et de déploiement.

'Minecraft' se transforme en une ville IA et les habitants des PNJ jouent comme de vraies personnes

Jan 02, 2024 pm 06:25 PM

'Minecraft' se transforme en une ville IA et les habitants des PNJ jouent comme de vraies personnes

Jan 02, 2024 pm 06:25 PM

Veuillez noter que cet homme carré fronça les sourcils, pensant à l'identité des « invités non invités » devant lui. Il s’est avéré qu’elle se trouvait dans une situation dangereuse, et une fois qu’elle s’en est rendu compte, elle a rapidement commencé une recherche mentale pour trouver une stratégie pour résoudre le problème. Finalement, elle a décidé de fuir les lieux, de demander de l'aide le plus rapidement possible et d'agir immédiatement. En même temps, la personne de l'autre côté pensait la même chose qu'elle... Il y avait une telle scène dans "Minecraft" où tous les personnages étaient contrôlés par l'intelligence artificielle. Chacun d’eux a un cadre identitaire unique. Par exemple, la jeune fille mentionnée précédemment est une coursière de 17 ans mais intelligente et courageuse. Ils ont la capacité de se souvenir, de penser et de vivre comme des humains dans cette petite ville de Minecraft. Ce qui les anime est une toute nouvelle,

Comment éditer des photos sur iPhone avec iOS 17

Nov 30, 2023 pm 11:39 PM

Comment éditer des photos sur iPhone avec iOS 17

Nov 30, 2023 pm 11:39 PM

La photographie mobile a fondamentalement changé la façon dont nous capturons et partageons les moments de la vie. L’avènement des smartphones, notamment de l’iPhone, a joué un rôle clé dans cette évolution. Connu pour sa technologie d'appareil photo avancée et ses fonctionnalités d'édition conviviales, l'iPhone est devenu le premier choix des photographes amateurs et expérimentés. Le lancement d’iOS 17 marque une étape importante dans ce voyage. La dernière mise à jour d'Apple apporte un ensemble amélioré de fonctionnalités de retouche photo, offrant aux utilisateurs une boîte à outils plus puissante pour transformer leurs instantanés quotidiens en images visuellement attrayantes et artistiquement riches. Ce développement technologique simplifie non seulement le processus photographique, mais ouvre également de nouvelles voies d'expression créative, permettant aux utilisateurs d'injecter sans effort une touche professionnelle à leurs photos.

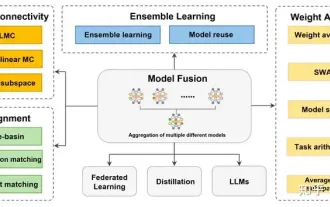

Revoir! Fusion profonde de modèles (LLM/modèle de base/apprentissage fédéré/mise au point, etc.)

Apr 18, 2024 pm 09:43 PM

Revoir! Fusion profonde de modèles (LLM/modèle de base/apprentissage fédéré/mise au point, etc.)

Apr 18, 2024 pm 09:43 PM

Le 23 septembre, l'article « DeepModelFusion:ASurvey » a été publié par l'Université nationale de technologie de la défense, JD.com et l'Institut de technologie de Pékin. La fusion/fusion de modèles profonds est une technologie émergente qui combine les paramètres ou les prédictions de plusieurs modèles d'apprentissage profond en un seul modèle. Il combine les capacités de différents modèles pour compenser les biais et les erreurs des modèles individuels pour de meilleures performances. La fusion profonde de modèles sur des modèles d'apprentissage profond à grande échelle (tels que le LLM et les modèles de base) est confrontée à certains défis, notamment un coût de calcul élevé, un espace de paramètres de grande dimension, l'interférence entre différents modèles hétérogènes, etc. Cet article divise les méthodes de fusion de modèles profonds existantes en quatre catégories : (1) « Connexion de modèles », qui relie les solutions dans l'espace de poids via un chemin de réduction des pertes pour obtenir une meilleure fusion de modèles initiale.

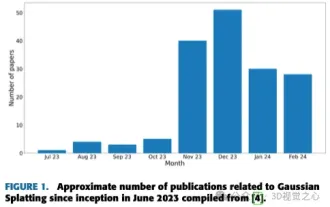

Plus qu'une simple gaussienne 3D ! Dernier aperçu des techniques de reconstruction 3D de pointe

Jun 02, 2024 pm 06:57 PM

Plus qu'une simple gaussienne 3D ! Dernier aperçu des techniques de reconstruction 3D de pointe

Jun 02, 2024 pm 06:57 PM

Écrit ci-dessus & La compréhension personnelle de l'auteur est que la reconstruction 3D basée sur l'image est une tâche difficile qui implique de déduire la forme 3D d'un objet ou d'une scène à partir d'un ensemble d'images d'entrée. Les méthodes basées sur l’apprentissage ont attiré l’attention pour leur capacité à estimer directement des formes 3D. Cet article de synthèse se concentre sur les techniques de reconstruction 3D de pointe, notamment la génération de nouvelles vues inédites. Un aperçu des développements récents dans les méthodes d'éclaboussure gaussienne est fourni, y compris les types d'entrée, les structures de modèle, les représentations de sortie et les stratégies de formation. Les défis non résolus et les orientations futures sont également discutés. Compte tenu des progrès rapides dans ce domaine et des nombreuses opportunités d’améliorer les méthodes de reconstruction 3D, un examen approfondi de l’algorithme semble crucial. Par conséquent, cette étude fournit un aperçu complet des progrès récents en matière de diffusion gaussienne. (Faites glisser votre pouce vers le haut

Comment créer une image disharmonieuse et réactionnaire ?

Feb 19, 2024 pm 09:18 PM

Comment créer une image disharmonieuse et réactionnaire ?

Feb 19, 2024 pm 09:18 PM

Discord permet aux utilisateurs de créer des images réactives qui peuvent être utilisées même s'ils n'en sont pas le créateur. Cet article explique comment créer et utiliser ces images de réaction dans Discord. Ce guide s'adresse à tous ceux qui souhaitent ajouter un peu de créativité à leur jeu Discord. Qu'est-ce qu'une image passive ? Les images réactives sont des images qui peuvent répondre aux signaux audio en temps réel lorsqu'il y a une entrée sonore, l'image aura les effets dynamiques correspondants. Cette technologie peut être utilisée dans une variété de scénarios, tels que la conversion vocale en temps réel en effets visuels lors de réunions, ou pour des expériences de réalité virtuelle améliorées. Ces images de réaction peuvent être produites et ajoutées au système de différentes manières, offrant ainsi aux utilisateurs une expérience interactive plus riche et immersive. Comment créer une image réactive disharmonieuse Voici deux façons de créer une image réactive discordante. Faire et ajouter