Périphériques technologiques

Périphériques technologiques

IA

IA

Problèmes d'évolutivité avec les modèles d'apprentissage automatique

Problèmes d'évolutivité avec les modèles d'apprentissage automatique

Problèmes d'évolutivité avec les modèles d'apprentissage automatique

Le problème d'évolutivité des modèles d'apprentissage automatique nécessite des exemples de code spécifiques

Résumé :

Avec l'échelle croissante des données et la complexité croissante des besoins des entreprises, les modèles d'apprentissage automatique traditionnels sont souvent incapables de répondre aux besoins de données à grande échelle traitement et réponse rapide aux demandes. Par conséquent, la manière d’améliorer l’évolutivité des modèles d’apprentissage automatique est devenue une direction de recherche importante. Cet article présentera le problème d'évolutivité des modèles d'apprentissage automatique et donnera des exemples de code spécifiques.

- Introduction

L'évolutivité d'un modèle d'apprentissage automatique fait référence à la capacité du modèle à maintenir une vitesse d'exécution et une précision efficaces face à des données à grande échelle et à des scénarios de concurrence élevée. Les modèles d'apprentissage automatique traditionnels doivent souvent parcourir l'intégralité de l'ensemble de données à des fins de formation et d'inférence, ce qui peut entraîner un gaspillage de ressources informatiques et une diminution de la vitesse de traitement dans les scénarios de données à grande échelle. Par conséquent, l’amélioration de l’évolutivité des modèles d’apprentissage automatique est un sujet de recherche actuel. - Formation de modèles basée sur l'informatique distribuée

Afin de résoudre le problème de la formation de données à grande échelle, des méthodes de calcul distribuées peuvent être utilisées pour améliorer la vitesse de formation du modèle. Les exemples de code spécifiques sont les suivants :

import tensorflow as tf

from tensorflow import keras

from tensorflow.keras import layers

# 定义一个分布式的数据集

strategy = tf.distribute.experimental.MultiWorkerMirroredStrategy()

# 创建模型

model = keras.Sequential([

layers.Dense(64, activation='relu'),

layers.Dense(64, activation='relu'),

layers.Dense(10, activation='softmax')

])

# 编译模型

model.compile(optimizer='adam',

loss=tf.keras.losses.SparseCategoricalCrossentropy(from_logits=True),

metrics=['accuracy'])

# 使用分布式计算进行训练

with strategy.scope():

model.fit(train_dataset, epochs=10, validation_data=val_dataset)Les exemples de code ci-dessus utilisent le cadre informatique distribué de TensorFlow pour entraîner le modèle. En distribuant les données d'entraînement à plusieurs nœuds informatiques pour le calcul, la vitesse d'entraînement peut être considérablement améliorée.

- Accélération d'inférence basée sur la compression du modèle

Dans la phase d'inférence du modèle, afin d'améliorer la vitesse de réponse du modèle, la méthode de compression du modèle peut être utilisée pour réduire le nombre de paramètres et la quantité de calcul du modèle. Les méthodes courantes de compression de modèle incluent l’élagage, la quantification et la distillation. Voici un exemple de code basé sur l'élagage :

import tensorflow as tf

from tensorflow import keras

from tensorflow.keras import layers

# 创建模型

model = keras.Sequential([

layers.Dense(64, activation='relu'),

layers.Dense(64, activation='relu'),

layers.Dense(10, activation='softmax')

])

# 编译模型

model.compile(optimizer='adam',

loss=tf.keras.losses.SparseCategoricalCrossentropy(from_logits=True),

metrics=['accuracy'])

# 训练模型

model.fit(train_dataset, epochs=10, validation_data=val_dataset)

# 剪枝模型

pruned_model = tfmot.sparsity.keras.prune_low_magnitude(model)

# 推理模型

pruned_model.predict(test_dataset)L'exemple de code ci-dessus utilise la méthode d'élagage de TensorFlow Model Optimization Toolkit pour réduire le nombre de paramètres et la quantité de calcul du modèle. Effectuer une inférence via le modèle élagué peut considérablement améliorer la vitesse de réponse du modèle.

Conclusion :

Cet article présente le problème d'évolutivité des modèles d'apprentissage automatique à travers des exemples de code spécifiques, et donne des exemples de code sous deux aspects : le calcul distribué et la compression de modèles. L'amélioration de l'évolutivité des modèles d'apprentissage automatique est d'une grande importance pour gérer des données à grande échelle et des scénarios à forte concurrence. J'espère que le contenu de cet article sera utile aux lecteurs.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

J'ai essayé le codage d'ambiance avec Cursor Ai et c'est incroyable!

Mar 20, 2025 pm 03:34 PM

J'ai essayé le codage d'ambiance avec Cursor Ai et c'est incroyable!

Mar 20, 2025 pm 03:34 PM

Le codage des ambiances est de remodeler le monde du développement de logiciels en nous permettant de créer des applications en utilisant le langage naturel au lieu de lignes de code sans fin. Inspirée par des visionnaires comme Andrej Karpathy, cette approche innovante permet de dev

Top 5 Genai Lunets de février 2025: GPT-4.5, Grok-3 et plus!

Mar 22, 2025 am 10:58 AM

Top 5 Genai Lunets de février 2025: GPT-4.5, Grok-3 et plus!

Mar 22, 2025 am 10:58 AM

Février 2025 a été un autre mois qui change la donne pour une IA générative, nous apportant certaines des mises à niveau des modèles les plus attendues et de nouvelles fonctionnalités révolutionnaires. De Xai's Grok 3 et Anthropic's Claude 3.7 Sonnet, à Openai's G

Comment utiliser YOLO V12 pour la détection d'objets?

Mar 22, 2025 am 11:07 AM

Comment utiliser YOLO V12 pour la détection d'objets?

Mar 22, 2025 am 11:07 AM

Yolo (vous ne regardez qu'une seule fois) a été un cadre de détection d'objets en temps réel de premier plan, chaque itération améliorant les versions précédentes. La dernière version Yolo V12 introduit des progrès qui améliorent considérablement la précision

Meilleurs générateurs d'art AI (gratuit & amp; payé) pour des projets créatifs

Apr 02, 2025 pm 06:10 PM

Meilleurs générateurs d'art AI (gratuit & amp; payé) pour des projets créatifs

Apr 02, 2025 pm 06:10 PM

L'article passe en revue les meilleurs générateurs d'art AI, discutant de leurs fonctionnalités, de leur aptitude aux projets créatifs et de la valeur. Il met en évidence MidJourney comme la meilleure valeur pour les professionnels et recommande Dall-E 2 pour un art personnalisable de haute qualité.

Chatgpt 4 o est-il disponible?

Mar 28, 2025 pm 05:29 PM

Chatgpt 4 o est-il disponible?

Mar 28, 2025 pm 05:29 PM

Chatgpt 4 est actuellement disponible et largement utilisé, démontrant des améliorations significatives dans la compréhension du contexte et la génération de réponses cohérentes par rapport à ses prédécesseurs comme Chatgpt 3.5. Les développements futurs peuvent inclure un interg plus personnalisé

Meilleurs chatbots AI comparés (Chatgpt, Gemini, Claude & amp; plus)

Apr 02, 2025 pm 06:09 PM

Meilleurs chatbots AI comparés (Chatgpt, Gemini, Claude & amp; plus)

Apr 02, 2025 pm 06:09 PM

L'article compare les meilleurs chatbots d'IA comme Chatgpt, Gemini et Claude, en se concentrant sur leurs fonctionnalités uniques, leurs options de personnalisation et leurs performances dans le traitement et la fiabilité du langage naturel.

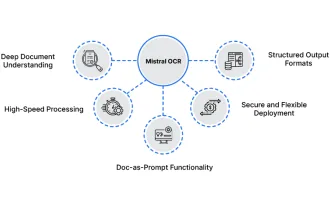

Comment utiliser Mistral OCR pour votre prochain modèle de chiffon

Mar 21, 2025 am 11:11 AM

Comment utiliser Mistral OCR pour votre prochain modèle de chiffon

Mar 21, 2025 am 11:11 AM

Mistral OCR: révolutionner la génération de la récupération avec une compréhension du document multimodal Les systèmes de génération (RAG) (RAG) de la récupération ont considérablement avancé les capacités d'IA, permettant à de vastes magasins de données pour une responsabilité plus éclairée

Assistants d'écriture de l'IA pour augmenter votre création de contenu

Apr 02, 2025 pm 06:11 PM

Assistants d'écriture de l'IA pour augmenter votre création de contenu

Apr 02, 2025 pm 06:11 PM

L'article traite des meilleurs assistants d'écriture d'IA comme Grammarly, Jasper, Copy.ai, WireSonic et Rytr, en se concentrant sur leurs fonctionnalités uniques pour la création de contenu. Il soutient que Jasper excelle dans l'optimisation du référencement, tandis que les outils d'IA aident à maintenir le ton