Périphériques technologiques

Périphériques technologiques

IA

IA

En joignant ses forces à celles des fabricants de puces en amont, ASUS promeut un nouvel écosystème de puces IA et mène l'innovation en matière de technologie de terminaux intelligents.

En joignant ses forces à celles des fabricants de puces en amont, ASUS promeut un nouvel écosystème de puces IA et mène l'innovation en matière de technologie de terminaux intelligents.

En joignant ses forces à celles des fabricants de puces en amont, ASUS promeut un nouvel écosystème de puces IA et mène l'innovation en matière de technologie de terminaux intelligents.

Récemment, lors de la « 7e conférence annuelle Insight 2024 China Enterprise Service », des fabricants renommés, des entreprises innovantes et des représentants d'utilisateurs typiques de l'industrie se sont réunis sur place pour discuter de la manière de saisir les nouvelles opportunités en matière d'intelligence artificielle et de répondre à la vague du numérique. demandes. Lors de la réunion, Shi Qifei, directeur commercial d'ASUS en Chine du Nord, a prononcé un discours intitulé « Renaissance de la puissance informatique, création d'un nouvel écosystème de puces IA ». Il pense qu'avec la popularité des grands modèles, les terminaux intelligents auront également de grands modèles « end-side », apportant un nouvel écosystème intelligent

Concernant les nouveaux produits d'IA et la nouvelle écologie, Shi Qifei a également déclaré qu'ASUS travaillerait avec des fabricants en amont tels qu'AMD pour explorer conjointement de nouvelles possibilités de la technologie des puces d'IA, et s'engageait à mieux fournir une puissance de calcul de base dans le futur grand environnement informatique et technologie de soutien. La révolution technologique de l'industrie pose des bases solides, protège et continue de promouvoir l'innovation et la mise à niveau des produits terminaux intelligents

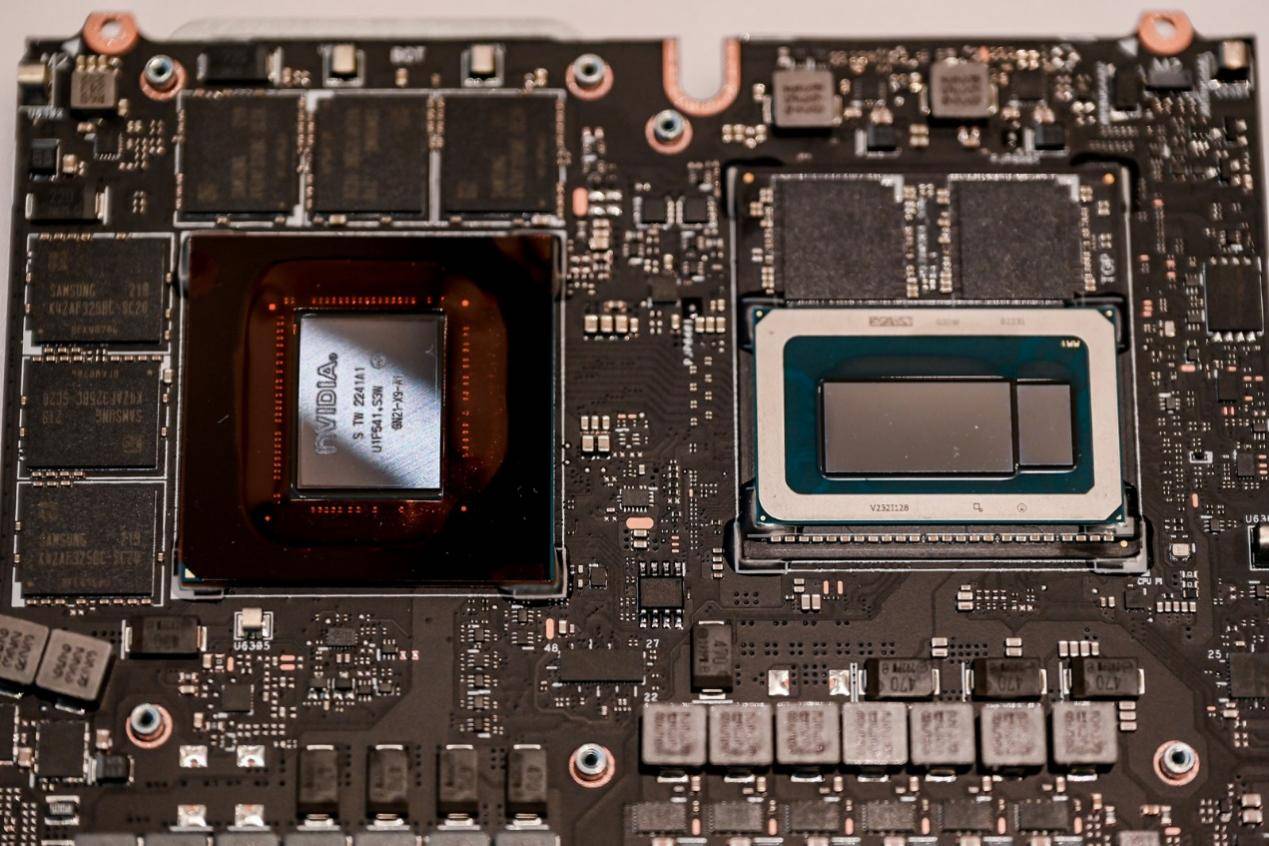

ASUS s'est engagé ces dernières années à redéfinir les produits finaux tels que les ordinateurs portables fins et légers grâce à des capacités technologiques innovantes. Parmi les nombreux nouveaux produits lancés cette année, l’un des plus accrocheurs est le portable fin et léger ASUS AI. Ce produit est équipé du processeur mobile AMD Ryzen 7 7940H et adopte une architecture trois-en-un de « CPU + GPU + moteur AI », devenant ainsi le premier produit à intégrer le moteur Ryzen AI dans un processeur X86. Le moteur Ryzen AI adopte l'architecture AMD XDNA, qui s'adapte naturellement aux algorithmes des réseaux neuronaux, le rendant plus flexible et efficace lors de l'inférence IA, et offre des performances plus élevées. À l'avenir, le moteur d'IA s'adaptera également à davantage d'applications d'IA, ouvrant la voie à une nouvelle ère d'IA pour les ordinateurs portables ASUS. Lors de cette conférence, l'ASUS Fearless 16 2023 équipé de ce processeur a remporté le « 2023 China Smart Terminal AI Innovation Pioneer Award ». Il s'agit simplement d'un microcosme de la coopération étroite d'ASUS avec les fabricants en amont pour fournir une puissante puissance de calcul IA pour les produits de terminaux intelligents. À l'avenir, davantage de terminaux intelligents ASUS seront équipés de l'IA, prendront en charge l'IA et utiliseront l'IA

En tant que pionnier innovant et leader dans le domaine des ordinateurs portables, l’exploration de nouveaux écosystèmes par ASUS va bien au-delà. Afin d'améliorer l'expérience visuelle des utilisateurs, ASUS a pris l'initiative de proposer la stratégie « ASUS Good Screen » dès 2021. Tous les ordinateurs portables fins et légers seront équipés d'écrans OLED Good pour offrir aux utilisateurs un plaisir visuel unique. L'année dernière, ASUS a remporté successivement les trois distinctions majeures de « N° 1 sur le marché des ordinateurs portables OLED", " N° 1 des ventes mondiales d'ordinateurs portables créatifs » et « N° 1 des ventes mondiales d'ordinateurs portables à double écran ». Avec l'avancement continu de la stratégie du bon écran, de plus en plus de consommateurs ont la possibilité de découvrir personnellement les incroyables performances de "ASUS Good Screen" en couleur visuelle

De plus, ASUS n'a jamais cessé de montrer sa puissance en matière d'innovation technologique en matière de performances, ce qui est plutôt évité dans les ordinateurs portables fins et légers. En 2023, ASUS et les fabricants en amont ont développé conjointement la technologie d'emballage « ASUS Ultra-High Speed System Module ». Sur cette base, le Lingyao X Ultra lancé a une consommation d'énergie allant jusqu'à 185 W. Ce niveau de consommation d'énergie n'a jamais été atteint. vu dans les ordinateurs portables fins et légers, même dans les ordinateurs portables de jeu hautes performances, cela n'est possible que dans les séries haut de gamme.

ASUS a réalisé des progrès importants dans la définition de l'écosystème intelligent de l'IA à l'avenir, ce qui en a jeté des bases solides. Il est prévu qu'en 2024, ASUS lance un certain nombre de nouveaux produits PC, notamment ProArt, Lingyao, Fearless et Adou. Ces produits seront équipés de nouveaux processeurs d’IA pour offrir aux utilisateurs une expérience intelligente d’IA meilleure et plus efficace. La coopération avec le fabricant en amont AMD favorisera davantage l'application de la technologie de l'IA dans divers domaines et scénarios. ASUS s'engage à proposer des terminaux intelligents plus colorés, intelligents et pratiques aux utilisateurs du monde entier, et à injecter plus de vitalité dans la mise en œuvre de l'IA dans les terminaux

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

Video Face Swap

Échangez les visages dans n'importe quelle vidéo sans effort grâce à notre outil d'échange de visage AI entièrement gratuit !

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Nouveau titre : lancement du NVIDIA H200 : capacité du HBM augmentée de 76 %, la puce IA la plus puissante qui améliore considérablement les performances des grands modèles de 90 %

Nov 14, 2023 pm 03:21 PM

Nouveau titre : lancement du NVIDIA H200 : capacité du HBM augmentée de 76 %, la puce IA la plus puissante qui améliore considérablement les performances des grands modèles de 90 %

Nov 14, 2023 pm 03:21 PM

Selon les informations du 14 novembre, Nvidia a officiellement lancé le nouveau GPU H200 lors de la conférence "Supercomputing23" le matin du 13, heure locale, et a mis à jour la gamme de produits GH200. Parmi eux, le H200 est toujours construit sur l'architecture Hopper H100 existante. Cependant, une mémoire à bande passante plus élevée (HBM3e) a été ajoutée pour mieux gérer les grands ensembles de données nécessaires au développement et à la mise en œuvre de l'intelligence artificielle, ce qui améliore de 60 à 90 % les performances globales d'exécution de grands modèles par rapport à la génération précédente H100. . Le GH200 mis à jour alimentera également la prochaine génération de supercalculateurs IA. En 2024, plus de 200 exaflops de puissance de calcul de l’IA seront en ligne. H200

Selon certaines rumeurs, MediaTek aurait remporté une grosse commande de Google pour des puces d'IA de serveur et fournirait des puces Serdes à haut débit.

Jun 19, 2023 pm 08:23 PM

Selon certaines rumeurs, MediaTek aurait remporté une grosse commande de Google pour des puces d'IA de serveur et fournirait des puces Serdes à haut débit.

Jun 19, 2023 pm 08:23 PM

Le 19 juin, selon les médias de Taiwan, en Chine, Google (Google) a contacté MediaTek pour coopérer afin de développer la dernière puce d'IA orientée serveur et prévoit de la confier au processus 5 nm de TSMC pour la fonderie, avec des plans pour production de masse au début de l’année prochaine. Selon le rapport, des sources ont révélé que cette coopération entre Google et MediaTek fournirait à MediaTek des solutions de sérialisation et de désérialisation (SerDes) et aiderait à intégrer le processeur tenseur (TPU) auto-développé par Google pour aider Google à créer les dernières puces Server AI qui seront plus puissantes. que les architectures CPU ou GPU. L’industrie souligne que de nombreux services actuels de Google sont liés à l’IA. Elle a investi dans la technologie d’apprentissage profond il y a de nombreuses années et a constaté que l’utilisation de GPU pour effectuer des calculs d’IA était très coûteuse. Google a donc décidé de le faire.

La prochaine grande nouveauté en matière d'IA : performances maximales de la puce NVIDIA B100 et du modèle OpenAI GPT-5

Nov 18, 2023 pm 03:39 PM

La prochaine grande nouveauté en matière d'IA : performances maximales de la puce NVIDIA B100 et du modèle OpenAI GPT-5

Nov 18, 2023 pm 03:39 PM

Après le lancement de la NVIDIA H200, connue comme la puce d'IA la plus puissante au monde, l'industrie a commencé à attendre avec impatience la puce B100, plus puissante de NVIDIA. Dans le même temps, OpenAI, la start-up d'IA la plus populaire cette année, a démarré. pour développer un modèle GPT-5 plus puissant et plus complexe. Guotai Junan a souligné dans le dernier rapport de recherche que les B100 et GPT5 aux performances illimitées devraient être commercialisés en 2024 et que les mises à niveau majeures pourraient générer une productivité sans précédent. L’agence s’est déclarée optimiste quant au fait que l’IA entrera dans une période de développement rapide et que sa visibilité se poursuivra jusqu’en 2024. Par rapport aux générations de produits précédentes, quelle est la puissance du B100 et du GPT-5 ? Nvidia et OpenAI ont déjà donné un aperçu : le B100 pourrait être plus de 4 fois plus rapide que le H100, et le GPT-5 pourrait atteindre un super

Kneron lance la dernière puce AI KL730 pour piloter l'application à grande échelle de solutions GPT légères

Aug 17, 2023 pm 01:37 PM

Kneron lance la dernière puce AI KL730 pour piloter l'application à grande échelle de solutions GPT légères

Aug 17, 2023 pm 01:37 PM

Les progrès en matière d'efficacité énergétique du KL730 ont résolu le plus gros goulot d'étranglement dans la mise en œuvre des modèles d'intelligence artificielle : le coût énergétique. Par rapport à l'industrie et aux puces Kneron précédentes, la puce KL730 a augmenté de 3 à 4 fois. Des modèles de langage GPT légers à grande échelle, tels que nanoGPT, et fournissent une puissance de calcul effective de 0,35 à 4 téra par seconde. La société d'IA Kneron a annoncé aujourd'hui la sortie de la puce KL730, qui intègre un NPU de qualité automobile et un traitement du signal d'image (ISP). pour apporter une IA sûre et à faible consommation d'énergie. Les capacités sont renforcées dans divers scénarios d'application tels que les serveurs de périphérie, les maisons intelligentes et les systèmes de conduite assistée automobile. Kneron, basé à San Diego, est connu pour ses unités de traitement neuronal (NPU) révolutionnaires, et sa dernière puce, la KL730, vise à atteindre

NVIDIA lance la nouvelle puce AI H200, performances améliorées de 90% ! La puissance informatique de la Chine réalise une percée indépendante !

Nov 14, 2023 pm 05:37 PM

NVIDIA lance la nouvelle puce AI H200, performances améliorées de 90% ! La puissance informatique de la Chine réalise une percée indépendante !

Nov 14, 2023 pm 05:37 PM

Alors que le monde est toujours obsédé par les puces NVIDIA H100 et les achète follement pour répondre à la demande croissante de puissance de calcul de l'IA, lundi, heure locale, NVIDIA a discrètement lancé sa dernière puce AI H200, qui est utilisée pour entraîner de grands modèles d'IA par rapport à d'autres. Les performances des produits de génération précédente H100 et H200 ont été améliorées d'environ 60 à 90 %. Le H200 est une version améliorée du Nvidia H100. Il est également basé sur l'architecture Hopper comme le H100. La mise à niveau principale comprend 141 Go de mémoire vidéo HBM3e, et la bande passante de la mémoire vidéo est passée de 3,35 To/s du H100 à 4,8. To/s. Selon le site officiel de Nvidia, la H200 est également la première puce de la société à utiliser la mémoire HBM3e. Cette mémoire est plus rapide et a une plus grande capacité, elle est donc plus adaptée aux grands langages.

Kneron annonce le lancement de sa dernière puce AI KL730

Aug 17, 2023 am 10:09 AM

Kneron annonce le lancement de sa dernière puce AI KL730

Aug 17, 2023 am 10:09 AM

Selon les mots originaux, il peut être réécrit comme suit : (Global TMT 16 août 2023) La société d'IA Kneron, dont le siège est à San Diego et connue pour ses unités de traitement neuronal (NPU) révolutionnaires, a annoncé la sortie de la puce KL730. La puce intègre un NPU de qualité automobile et un traitement du signal d'image (ISP) et fournit des capacités d'IA sûres et à faible consommation d'énergie pour divers scénarios d'application tels que les serveurs de périphérie, les maisons intelligentes et les systèmes de conduite assistée automobile. La puce KL730 a obtenu d'excellents résultats. termes d'efficacité énergétique. Une percée, par rapport aux puces Nerner précédentes, son efficacité énergétique a augmenté de 3 à 4 fois et est de 150 % à 200 % supérieure à celle des produits similaires dans les grandes industries. La puce a une puissance de calcul effective de 0,35 à 4 téra par seconde et peut prendre en charge le grand GPT léger le plus avancé.

Les puces IA sont en rupture de stock dans le monde !

May 30, 2023 pm 09:53 PM

Les puces IA sont en rupture de stock dans le monde !

May 30, 2023 pm 09:53 PM

Le PDG de Google compare la révolution de l’IA à l’utilisation du feu par l’humanité, mais désormais, le feu numérique qui alimente l’industrie – les puces IA – est difficile à trouver. La nouvelle génération de puces avancées qui pilotent les opérations d'IA sont presque toutes fabriquées par NVIDIA. Alors que ChatGPT sort du cercle, la demande du marché pour les puces de traitement graphique (GPU) NVIDIA dépasse de loin l'offre. "Parce qu'il y a une pénurie, la clé est votre cercle d'amis", a déclaré Sharon Zhou, co-fondatrice et PDG de Lamini, une startup qui aide les entreprises à construire des modèles d'IA tels que des chatbots. "C'est comme du papier toilette pendant l'épidémie". Ce genre de chose a limité la puissance de calcul que les fournisseurs de cloud comme Amazon et Microsoft peuvent offrir à des clients comme OpenAI, le créateur de ChatGPT.

Microsoft développe sa propre puce d'IA 'Athena'

Apr 25, 2023 pm 01:07 PM

Microsoft développe sa propre puce d'IA 'Athena'

Apr 25, 2023 pm 01:07 PM

Microsoft développe des puces optimisées pour l'IA afin de réduire le coût de formation des modèles d'IA génératifs, tels que ceux qui alimentent le chatbot OpenAIChatGPT. The Information a récemment cité deux personnes proches du dossier affirmant que Microsoft développait un nouveau chipset nommé « Athena » depuis au moins 2019. Les employés de Microsoft et d'OpenAI ont déjà accès aux nouvelles puces et les utilisent pour tester leurs performances sur de grands modèles de langage tels que GPT-4. La formation de grands modèles de langage nécessite l'ingestion et l'analyse de grandes quantités de données afin de créer un nouveau contenu de sortie pour l'IA afin d'imiter la conversation humaine. C'est une caractéristique des modèles d'IA génératifs. Ce processus en nécessite un grand nombre (de l'ordre de plusieurs dizaines). de milliers) de A