Équipe Dong Hao de l'Université de PékinNavigation incarnéeLes derniers résultats sont ici :

Pas besoin de cartographie ni de formation supplémentaires, il suffit de prononcer les instructions de navigation, telles que :

Avancez à travers la pièce et traversez la culotte suivie de la cuisine . Debout au bout de la cuisine

Nous pouvons contrôler le robot pour qu'il se déplace avec flexibilité.

Ici, le robot s'appuie sur communique activement avec "l'équipe d'experts" composée de grands modèlespour accomplir une série de tâches clés de navigation en langage visuel telles que l'analyse des instructions, la perception visuelle, l'estimation de l'achèvement et la décision. faire des tests.

La page d'accueil et les articles du projet sont actuellement en ligne, et le code sera bientôt publié :

La navigation en langage visuel implique une série de sous-tâches, notamment l'analyse des instructions, la perception visuelle, l'estimation de l'achèvement et les tests de décision.

Ces tâches clés nécessitent des connaissances dans différents domaines, elles sont interdépendantes et déterminent la capacité de navigation du robot.

Inspirée par le comportement de discussion d'experts dans la vie réelle, L'équipe de Dong Hao de l'Université de Pékin a proposé le système de navigation DiscussNav.

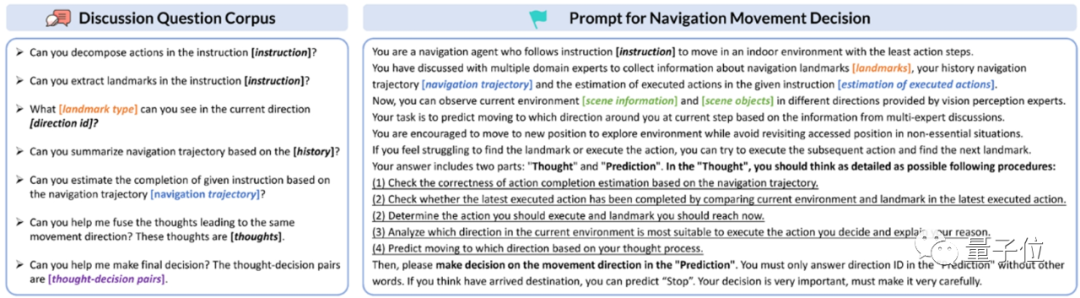

L'auteur attribue d'abord des rôles d'expert et des tâches spécifiques au LLM (Large Language Model) et MLM (Multimodal Large Model) de manière rapide, activant leurs connaissances et capacités du domaine, construisant ainsi une navigation visuelle avec différentes spécialités Expert équipe.

Ensuite, l'auteur a conçu un corpus de questions de discussion et un mécanisme de discussion, à la suite desquels le robot de navigation piloté par LLM peut lancer de manière proactive une série de discussions avec des experts en navigation visuelle.

Avant chaque déplacement, le robot de navigation discutera avec des experts pour comprendre les actions requises et les signes d'objet mentionnés dans les instructions humaines.

Ensuite, il a tendance à percevoir l'environnement environnant en fonction des types de signes d'objets, estime l'achèvement des instructions et prend des décisions préliminaires de mouvement.

Pendant le processus de prise de décision, le robot de navigation générera N résultats de prédiction indépendants en même temps basés sur la chaîne de pensée(chaîne de pensée) Lorsque ces résultats de prédiction sont incohérents, le. Le robot testera le processus de prise de décision. Faites appel à des experts pour examiner votre décision mobile finale.

Nous pouvons voir à partir de ce processus que par rapport aux méthodes traditionnelles, qui nécessitent une pré-formation supplémentaire, cette méthode guide le robot pour qu'il se déplace selon les instructions humaines en interagissant avec des experts en grands modèles, résolvant directement le problème de la rareté de la formation à la navigation du robot. données.

En allant plus loin, c'est précisément grâce à cette fonctionnalité qu'il atteint également des capacités sans échantillon. Tant que vous suivez le processus de discussion ci-dessus, vous pouvez suivre diverses instructions de navigation.

Voici les performances de DiscussionNav sur l'ensemble de données de navigation en langage visuel classique Room2Room.

Comme vous pouvez le constater, il est nettement supérieur à toutes les méthodes zéro tir, encore plus que les deux méthodes entraînées .

L'auteur a ensuite mené de véritables expériences de navigation dans des scènes intérieures sur le robot mobile Turtlebot4.

Grâce au langage puissant et aux capacités de généralisation visuelle des grands modèles inspirés par des jeux de rôle et des discussions d'experts, les performances de DiscussNav dans le monde réel sont nettement meilleures que la précédente méthode optimale de tir zéro et la méthode affinée pré-entraînée, montrant de bonnes Capacités de migration de la simulation vers la réalité.

Grâce à des expériences, l'auteur a en outre découvert que DiscussNav produisait 4 capacités puissantes :

1. Reconnaître les objets du monde ouvert, tels que « bras de robot sur une table blanche » et « ours en peluche sur une chaise ».

2. Identifiez les objets marquants de la navigation à grain fin, tels que « les plantes sur le comptoir de la cuisine » et les « cartons sur la table ».

3. Corrigez les informations erronées répondues par d'autres experts dans la discussion. Par exemple, l'expert en extraction de logo vérifiera et corrigera la séquence d'actions mal décomposée avant d'extraire le logo de navigation de la séquence d'actions de navigation.

4. Éliminez les décisions de mouvement incohérentes. Par exemple, les experts en tests de décision peuvent sélectionner la décision la plus raisonnable parmi plusieurs décisions de mouvement incohérentes prédites par DiscussNav en fonction des informations sur l'environnement actuel comme décision de mouvement finale.

L'auteur correspondant Dong Hao a proposé dans un rapport précédent qu'une exploration approfondie de la façon d'utiliser efficacement les données de simulation et les grands modèles pour acquérir des connaissances préalables à partir de données massives est l'incarnation future. direction du développement de la recherche sur le renseignement.

Actuellement limitée par l'échelle des données et le coût élevé de l'exploration des environnements réels, la recherche sur l'intelligence incorporée se concentrera toujours sur les expériences sur les plateformes de simulation et la formation aux données de simulation.

Les progrès récents dans les grands modèles offrent une nouvelle direction pour l'intelligence incarnée. Une exploration et une utilisation appropriées du bon sens linguistique et des a priori du monde physique dans les grands modèles favoriseront le développement de l'intelligence incarnée.

Adresse papier : https://arxiv.org/abs/2309.11382

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

qu'est-ce que le HDMI

qu'est-ce que le HDMI

Quelle devise est l'USD ?

Quelle devise est l'USD ?

Maximiser la page Web

Maximiser la page Web

Solution à l'erreur de syntaxe lors de l'exécution de Python

Solution à l'erreur de syntaxe lors de l'exécution de Python

CSS au-delà de l'affichage...

CSS au-delà de l'affichage...

Les étincelles Douyin peuvent-elles être rallumées si elles sont éteintes depuis plus de trois jours ?

Les étincelles Douyin peuvent-elles être rallumées si elles sont éteintes depuis plus de trois jours ?

Comment commenter le code en HTML

Comment commenter le code en HTML

Quelles sont les méthodes permettant à Docker d'entrer dans le conteneur ?

Quelles sont les méthodes permettant à Docker d'entrer dans le conteneur ?