Périphériques technologiques

Périphériques technologiques

IA

IA

Prétraitement des données pour la détection de cibles en vision par ordinateur

Prétraitement des données pour la détection de cibles en vision par ordinateur

Prétraitement des données pour la détection de cibles en vision par ordinateur

Cet article couvre les étapes de prétraitement effectuées sur les données d'image lors de la résolution de problèmes de détection d'objets en vision par ordinateur.

Tout d’abord, commençons par choisir les bonnes données pour la détection d’objets en vision par ordinateur. Lorsque vous choisissez les meilleures images pour la détection d'objets en vision par ordinateur, vous devez choisir celles qui offrent le plus de valeur pour la formation d'un modèle solide et précis. Lors du choix de la meilleure image, tenez compte de certains des facteurs suivants :

- Couverture de l'objet : choisissez les images qui ont une bonne couverture d'objet, c'est-à-dire que l'objet d'intérêt est bien représenté et visible dans l'image. Les images dans lesquelles les objets sont masqués, se chevauchent ou sont partiellement coupés peuvent fournir des données d'entraînement moins précieuses.

- Variation de l'objet : sélectionnez des images présentant des variations dans l'apparence de l'objet, la pose, l'échelle, les conditions d'éclairage et l'arrière-plan. Les images sélectionnées doivent couvrir une variété de scénarios pour garantir que le modèle se généralise bien.

- Qualité d’image : Préférez des images de bonne qualité et claires. Des images floues, bruyantes ou à faible résolution peuvent avoir un impact négatif sur la capacité d'un modèle à détecter avec précision les objets.

- Précision des annotations : vérifiez l'exactitude et la qualité des annotations dans les images. Les images avec des annotations précises et exactes du cadre de délimitation contribuent à de meilleurs résultats d’entraînement.

- Équilibre des catégories : garantit qu'il existe un équilibre des images entre les différentes catégories d'objets. Une représentation à peu près égale de chaque catégorie dans l'ensemble de données empêche le modèle de favoriser ou d'ignorer certaines catégories lors de la formation.

- Diversité des images : incluez des images provenant de différentes sources, angles, points de vue ou paramètres. Cette diversité aide le modèle à bien généraliser sur des données nouvelles et invisibles.

- Scènes difficiles : comprend des images contenant des objets avec des occlusions, des arrière-plans encombrés ou des objets à différentes distances. Ces images aident le modèle à apprendre à gérer les complexités du monde réel.

- Données représentatives : assurez-vous que les images sélectionnées représentent la distribution cible que le modèle est susceptible de rencontrer dans le monde réel. Les biais ou les lacunes dans l'ensemble de données peuvent entraîner des performances biaisées ou limitées du modèle entraîné.

- Évitez la redondance : supprimez les images très similaires ou en double de l'ensemble de données pour éviter d'introduire un biais ou une surreprésentation d'instances spécifiques.

- Contrôle qualité : effectuez des contrôles de qualité sur l'ensemble de données pour garantir que les images sélectionnées répondent aux normes requises et ne présentent aucune anomalie, erreur ou artefact.

Il est important de noter que le processus de sélection peut impliquer des décisions subjectives, en fonction des exigences spécifiques de votre tâche de détection d'objets et de l'ensemble de données disponibles. La prise en compte de ces facteurs vous aidera à créer des ensembles de données diversifiés, équilibrés et représentatifs pour la formation des modèles de détection d'objets.

Maintenant, explorons comment sélectionner les données de détection de cible à l'aide de Python ! Vous trouverez ci-dessous un exemple de script Python qui montre comment sélectionner les meilleures images d'un ensemble de données en fonction de certains critères (tels que la qualité de l'image, la couverture cible, etc.) pour résoudre les problèmes de détection en vision par ordinateur. Cet exemple suppose que vous disposez déjà d'un ensemble de données avec des annotations d'images et que vous souhaitez identifier les meilleures images en fonction de critères spécifiques (tels que la qualité de l'image, la couverture cible, etc.)

import cv2import osimport numpy as np# Function to calculate image quality score (example implementation)def calculate_image_quality(image):# Add your image quality calculation logic here# This could involve techniques such as blur detection, sharpness measurement, etc.# Return a quality score or metric for the given imagereturn 0.0# Function to calculate object coverage score (example implementation)def calculate_object_coverage(image, bounding_boxes):# Add your object coverage calculation logic here# This could involve measuring the percentage of image area covered by objects# Return a coverage score or metric for the given imagereturn 0.0# Directory containing the datasetdataset_dir = “path/to/your/dataset”# Iterate over the images in the datasetfor image_name in os.listdir(dataset_dir):image_path = os.path.join(dataset_dir, image_name)image = cv2.imread(image_path)# Example: Calculate image quality scorequality_score = calculate_image_quality(image)# Example: Calculate object coverage scorebounding_boxes = [] # Retrieve bounding boxes for the image (you need to implement this)coverage_score = calculate_object_coverage(image, bounding_boxes)# Decide on the selection criteria and thresholds# You can modify this based on your specific problem and criteriaif quality_score > 0.8 and coverage_score > 0.5:# This image meets the desired criteria, so you can perform further processing or save it as needed# For example, you can copy the image to another directory for further processing or analysisselected_image_path = os.path.join(“path/to/selected/images”, image_name)cv2.imwrite(selected_image_path, image)

Dans cet exemple, vous devez implémenter la fonction calculate_image_quality() et les fonctions calculate_object_coverage(). Ces fonctions doivent prendre une image en entrée et renvoyer respectivement les scores de qualité et de couverture.

Vous devez personnaliser la variable dataset_dir en fonction du répertoire où se trouve votre ensemble de données. Le script parcourra les images de l'ensemble de données, calculera les scores de qualité et de couverture pour chaque image et déterminera la meilleure image en fonction des critères que vous choisissez. Dans cet exemple, nous définissons l'image avec un score de qualité supérieur à 0,8 et un score de couverture supérieur à 0,5 comme la meilleure image. Vous pouvez modifier ces seuils en fonction de vos besoins spécifiques. N'oubliez pas d'adapter le script en fonction de votre problème de détection, du format d'annotation et des critères de sélection de la meilleure image

Ce script Python montre comment utiliser la vision par ordinateur pour prétraiter les données d'image afin de résoudre un problème de détection d'objet. Supposons que vous ayez un ensemble de données d'image similaire à Pascal VOC ou COCO et les annotations de boîte englobante correspondantes

import cv2import numpy as npimport os# Directory pathsdataset_dir = “path/to/your/dataset”output_dir = “path/to/preprocessed/data”# Create the output directory if it doesn’t existif not os.path.exists(output_dir):os.makedirs(output_dir)# Iterate over the images in the datasetfor image_name in os.listdir(dataset_dir):image_path = os.path.join(dataset_dir, image_name)annotation_path = os.path.join(dataset_dir, image_name.replace(“.jpg”, “.txt”))# Read the imageimage = cv2.imread(image_path)# Read the annotation file (assuming it contains bounding box coordinates)with open(annotation_path, “r”) as file:lines = file.readlines()bounding_boxes = []for line in lines:# Parse the bounding box coordinatesclass_id, x, y, width, height = map(float, line.split())# Example: Perform any necessary data preprocessing steps# Here, we can normalize the bounding box coordinates to values between 0 and 1normalized_x = x / image.shape[1]normalized_y = y / image.shape[0]normalized_width = width / image.shape[1]normalized_height = height / image.shape[0]# Store the normalized bounding box coordinatesbounding_boxes.append([class_id, normalized_x, normalized_y, normalized_width, normalized_height])# Example: Perform any additional preprocessing steps on the image# For instance, you can resize the image to a desired size or apply data augmentation techniques# Save the preprocessed imagepreprocessed_image_path = os.path.join(output_dir, image_name)cv2.imwrite(preprocessed_image_path, image)# Save the preprocessed annotation (in the same format as the original annotation file)preprocessed_annotation_path = os.path.join(output_dir, image_name.replace(“.jpg”, “.txt”))with open(preprocessed_annotation_path, “w”) as file:for bbox in bounding_boxes:class_id, x, y, width, height = bboxfile.write(f”{class_id} {x} {y} {width} {height}\n”)Dans ce script, vous devez personnaliser les variables dataset_dir et output_dir, pointant respectivement vers le répertoire où l'ensemble de données est stocké et où vous souhaitez enregistrer les données prétraitées Table des matières. Le script parcourt les images de l'ensemble de données et lit les fichiers d'annotation correspondants. Il suppose que le fichier d'annotation contient les coordonnées du cadre de délimitation (ID de catégorie, x, y, largeur et hauteur) de chaque objet.

Vous pouvez effectuer toutes les étapes de prétraitement des données nécessaires à l'intérieur de la boucle. Dans cet exemple, nous normalisons les coordonnées du cadre de délimitation à une valeur comprise entre 0 et 1. Vous pouvez également effectuer d'autres étapes de prétraitement, telles que redimensionner l'image à la taille souhaitée ou appliquer des techniques d'augmentation des données. Les images et annotations prétraitées seront enregistrées dans le répertoire de sortie avec le même nom de fichier que les fichiers d'origine. Veuillez adapter le script à votre format d'ensemble de données, à votre style d'annotation et à vos exigences de prétraitement spécifiques.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

La différence entre les algorithmes de détection de cible à une étape et à deux étapes

Jan 23, 2024 pm 01:48 PM

La différence entre les algorithmes de détection de cible à une étape et à deux étapes

Jan 23, 2024 pm 01:48 PM

La détection d'objets est une tâche importante dans le domaine de la vision par ordinateur, utilisée pour identifier des objets dans des images ou des vidéos et localiser leur emplacement. Cette tâche est généralement divisée en deux catégories d'algorithmes, à une étape et à deux étapes, qui diffèrent en termes de précision et de robustesse. Algorithme de détection de cible en une seule étape L'algorithme de détection de cible en une seule étape convertit la détection de cible en un problème de classification. Son avantage est qu'il est rapide et peut terminer la détection en une seule étape. Cependant, en raison d'une simplification excessive, la précision n'est généralement pas aussi bonne que celle de l'algorithme de détection d'objets en deux étapes. Les algorithmes courants de détection d'objets en une seule étape incluent YOLO, SSD et FasterR-CNN. Ces algorithmes prennent généralement l’image entière en entrée et exécutent un classificateur pour identifier l’objet cible. Contrairement aux algorithmes traditionnels de détection de cibles en deux étapes, ils n'ont pas besoin de définir des zones à l'avance, mais de prédire directement

Comment utiliser la technologie IA pour restaurer d'anciennes photos (avec exemples et analyse de code)

Jan 24, 2024 pm 09:57 PM

Comment utiliser la technologie IA pour restaurer d'anciennes photos (avec exemples et analyse de code)

Jan 24, 2024 pm 09:57 PM

La restauration de photos anciennes est une méthode d'utilisation de la technologie de l'intelligence artificielle pour réparer, améliorer et améliorer de vieilles photos. Grâce à des algorithmes de vision par ordinateur et d’apprentissage automatique, la technologie peut identifier et réparer automatiquement les dommages et les imperfections des anciennes photos, les rendant ainsi plus claires, plus naturelles et plus réalistes. Les principes techniques de la restauration de photos anciennes incluent principalement les aspects suivants : 1. Débruitage et amélioration de l'image Lors de la restauration de photos anciennes, elles doivent d'abord être débruitées et améliorées. Des algorithmes et des filtres de traitement d'image, tels que le filtrage moyen, le filtrage gaussien, le filtrage bilatéral, etc., peuvent être utilisés pour résoudre les problèmes de bruit et de taches de couleur, améliorant ainsi la qualité des photos. 2. Restauration et réparation d'images Les anciennes photos peuvent présenter certains défauts et dommages, tels que des rayures, des fissures, une décoloration, etc. Ces problèmes peuvent être résolus par des algorithmes de restauration et de réparation d’images

Application de la technologie de l'IA à la reconstruction d'images en super-résolution

Jan 23, 2024 am 08:06 AM

Application de la technologie de l'IA à la reconstruction d'images en super-résolution

Jan 23, 2024 am 08:06 AM

La reconstruction d'images en super-résolution est le processus de génération d'images haute résolution à partir d'images basse résolution à l'aide de techniques d'apprentissage en profondeur, telles que les réseaux neuronaux convolutifs (CNN) et les réseaux contradictoires génératifs (GAN). Le but de cette méthode est d'améliorer la qualité et les détails des images en convertissant des images basse résolution en images haute résolution. Cette technologie trouve de nombreuses applications dans de nombreux domaines, comme l’imagerie médicale, les caméras de surveillance, les images satellites, etc. Grâce à la reconstruction d’images en super-résolution, nous pouvons obtenir des images plus claires et plus détaillées, ce qui permet d’analyser et d’identifier plus précisément les cibles et les caractéristiques des images. Méthodes de reconstruction Les méthodes de reconstruction d'images en super-résolution peuvent généralement être divisées en deux catégories : les méthodes basées sur l'interpolation et les méthodes basées sur l'apprentissage profond. 1) Méthode basée sur l'interpolation Reconstruction d'images en super-résolution basée sur l'interpolation

Algorithme SIFT (Scale Invariant Features)

Jan 22, 2024 pm 05:09 PM

Algorithme SIFT (Scale Invariant Features)

Jan 22, 2024 pm 05:09 PM

L'algorithme SIFT (Scale Invariant Feature Transform) est un algorithme d'extraction de caractéristiques utilisé dans les domaines du traitement d'images et de la vision par ordinateur. Cet algorithme a été proposé en 1999 pour améliorer les performances de reconnaissance et de correspondance d'objets dans les systèmes de vision par ordinateur. L'algorithme SIFT est robuste et précis et est largement utilisé dans la reconnaissance d'images, la reconstruction tridimensionnelle, la détection de cibles, le suivi vidéo et d'autres domaines. Il obtient l'invariance d'échelle en détectant les points clés dans plusieurs espaces d'échelle et en extrayant des descripteurs de caractéristiques locales autour des points clés. Les principales étapes de l'algorithme SIFT comprennent la construction d'un espace d'échelle, la détection des points clés, le positionnement des points clés, l'attribution de directions et la génération de descripteurs de caractéristiques. Grâce à ces étapes, l’algorithme SIFT peut extraire des fonctionnalités robustes et uniques, permettant ainsi un traitement d’image efficace.

Une introduction aux méthodes d'annotation d'images et aux scénarios d'application courants

Jan 22, 2024 pm 07:57 PM

Une introduction aux méthodes d'annotation d'images et aux scénarios d'application courants

Jan 22, 2024 pm 07:57 PM

Dans les domaines de l'apprentissage automatique et de la vision par ordinateur, l'annotation d'images est le processus d'application d'annotations humaines à des ensembles de données d'images. Les méthodes d’annotation d’images peuvent être principalement divisées en deux catégories : l’annotation manuelle et l’annotation automatique. L'annotation manuelle signifie que les annotateurs humains annotent les images via des opérations manuelles. Cette méthode nécessite que les annotateurs humains possèdent des connaissances et une expérience professionnelles et soient capables d'identifier et d'annoter avec précision les objets, scènes ou caractéristiques cibles dans les images. L’avantage de l’annotation manuelle est que les résultats de l’annotation sont fiables et précis, mais l’inconvénient est qu’elle prend du temps et est coûteuse. L'annotation automatique fait référence à la méthode d'utilisation de programmes informatiques pour annoter automatiquement les images. Cette méthode utilise la technologie d'apprentissage automatique et de vision par ordinateur pour réaliser une annotation automatique par des modèles de formation. Les avantages de l’étiquetage automatique sont la rapidité et le faible coût, mais l’inconvénient est que les résultats de l’étiquetage peuvent ne pas être précis.

Interprétation du concept de suivi de cible en vision par ordinateur

Jan 24, 2024 pm 03:18 PM

Interprétation du concept de suivi de cible en vision par ordinateur

Jan 24, 2024 pm 03:18 PM

Le suivi d'objets est une tâche importante en vision par ordinateur et est largement utilisé dans la surveillance du trafic, la robotique, l'imagerie médicale, le suivi automatique des véhicules et d'autres domaines. Il utilise des méthodes d'apprentissage profond pour prédire ou estimer la position de l'objet cible dans chaque image consécutive de la vidéo après avoir déterminé la position initiale de l'objet cible. Le suivi d'objets a un large éventail d'applications dans la vie réelle et revêt une grande importance dans le domaine de la vision par ordinateur. Le suivi d'objets implique généralement le processus de détection d'objets. Voici un bref aperçu des étapes de suivi des objets : 1. Détection d'objets, où l'algorithme classe et détecte les objets en créant des cadres de délimitation autour d'eux. 2. Attribuez une identification (ID) unique à chaque objet. 3. Suivez le mouvement des objets détectés dans des images tout en stockant les informations pertinentes. Types de cibles de suivi de cible

Exemples d'applications pratiques de la combinaison de fonctionnalités peu profondes et de fonctionnalités profondes

Jan 22, 2024 pm 05:00 PM

Exemples d'applications pratiques de la combinaison de fonctionnalités peu profondes et de fonctionnalités profondes

Jan 22, 2024 pm 05:00 PM

L'apprentissage profond a connu un grand succès dans le domaine de la vision par ordinateur, et l'une des avancées importantes est l'utilisation de réseaux neuronaux convolutifs profonds (CNN) pour la classification d'images. Cependant, les CNN profonds nécessitent généralement de grandes quantités de données étiquetées et de ressources informatiques. Afin de réduire la demande en ressources informatiques et en données étiquetées, les chercheurs ont commencé à étudier comment fusionner des caractéristiques superficielles et des caractéristiques profondes pour améliorer les performances de classification des images. Cette méthode de fusion peut tirer parti de la grande efficacité de calcul des entités superficielles et de la forte capacité de représentation des entités profondes. En combinant les deux, les coûts de calcul et les exigences d’étiquetage des données peuvent être réduits tout en conservant une grande précision de classification. Cette méthode est particulièrement importante pour les scénarios d’application dans lesquels la quantité de données est faible ou les ressources informatiques limitées. Par une étude approfondie de la méthode de fusion des entités peu profondes et des entités profondes, nous pouvons approfondir

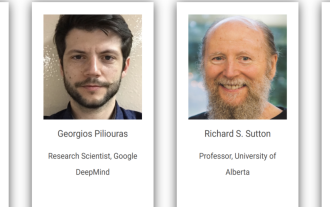

Conférence sur l'intelligence artificielle distribuée Appel à communications DAI 2024 : Agent Day, Richard Sutton, le père de l'apprentissage par renforcement, sera présent ! Yan Shuicheng, Sergey Levine et les scientifiques de DeepMind prononceront des discours d'ouverture

Aug 22, 2024 pm 08:02 PM

Conférence sur l'intelligence artificielle distribuée Appel à communications DAI 2024 : Agent Day, Richard Sutton, le père de l'apprentissage par renforcement, sera présent ! Yan Shuicheng, Sergey Levine et les scientifiques de DeepMind prononceront des discours d'ouverture

Aug 22, 2024 pm 08:02 PM

Introduction à la conférence Avec le développement rapide de la science et de la technologie, l'intelligence artificielle est devenue une force importante dans la promotion du progrès social. À notre époque, nous avons la chance d’être témoins et de participer à l’innovation et à l’application de l’intelligence artificielle distribuée (DAI). L’intelligence artificielle distribuée est une branche importante du domaine de l’intelligence artificielle, qui a attiré de plus en plus d’attention ces dernières années. Les agents basés sur de grands modèles de langage (LLM) ont soudainement émergé. En combinant les puissantes capacités de compréhension du langage et de génération des grands modèles, ils ont montré un grand potentiel en matière d'interaction en langage naturel, de raisonnement par connaissances, de planification de tâches, etc. AIAgent reprend le grand modèle de langage et est devenu un sujet brûlant dans le cercle actuel de l'IA. Au