Stability AI lance le modèle Stable Diffusion XL Turbo

IT House a rapporté le 30 novembre que Stability AI avait récemment lancé Stable Diffusion XL Turbo (SDXL Turbo), qui est une version améliorée du modèle SDXL précédent. On dit que SDXL Turbo utilise la « technologie de distillation par diffusion contradictoire » pour réduire les étapes d'itération de génération d'images des 50 étapes d'origine à 1 étape. On dit qu'« une seule étape d'itération est nécessaire pour générer des images de haute qualité ». »

Il est rapporté que la plus grande caractéristique du modèle Stable Diffusion XL Turbo est la « génération d'images en une seule itération » mentionnée ci-dessus, qui est censée être capable d'effectuer une « sortie texte-image instantanée » et d'assurer la qualité de les images.

Ce qui doit être réécrit est : l'une d'entre elles est appelée « technologie de distillation par diffusion contradictoire », qui est une technologie qui utilise le modèle de diffusion d'images à grande échelle existant comme « réseau d'enseignants » pour guider le processus de génération. Cette technologie combine la « technologie de distillation » et la « formation contradictoire », la « technologie de distillation » faisant référence à la condensation des connaissances d'un grand modèle dans un modèle plus petit afin de rationaliser le résultat du modèle. Et la formation contradictoire peut améliorer le modèle afin qu'il puisse mieux imiter le résultat du modèle d'enseignant

La technologie de distillation du modèle précédent était difficile à équilibrer efficacité et qualité car un échantillonnage rapide affaiblit généralement la qualité de sortie. Par conséquent, ce modèle Stable Diffusion XL Turbo est un moyen efficace de générer efficacement des images de haute qualité grâce à la « technologie de distillation par diffusion contradictoire ». .

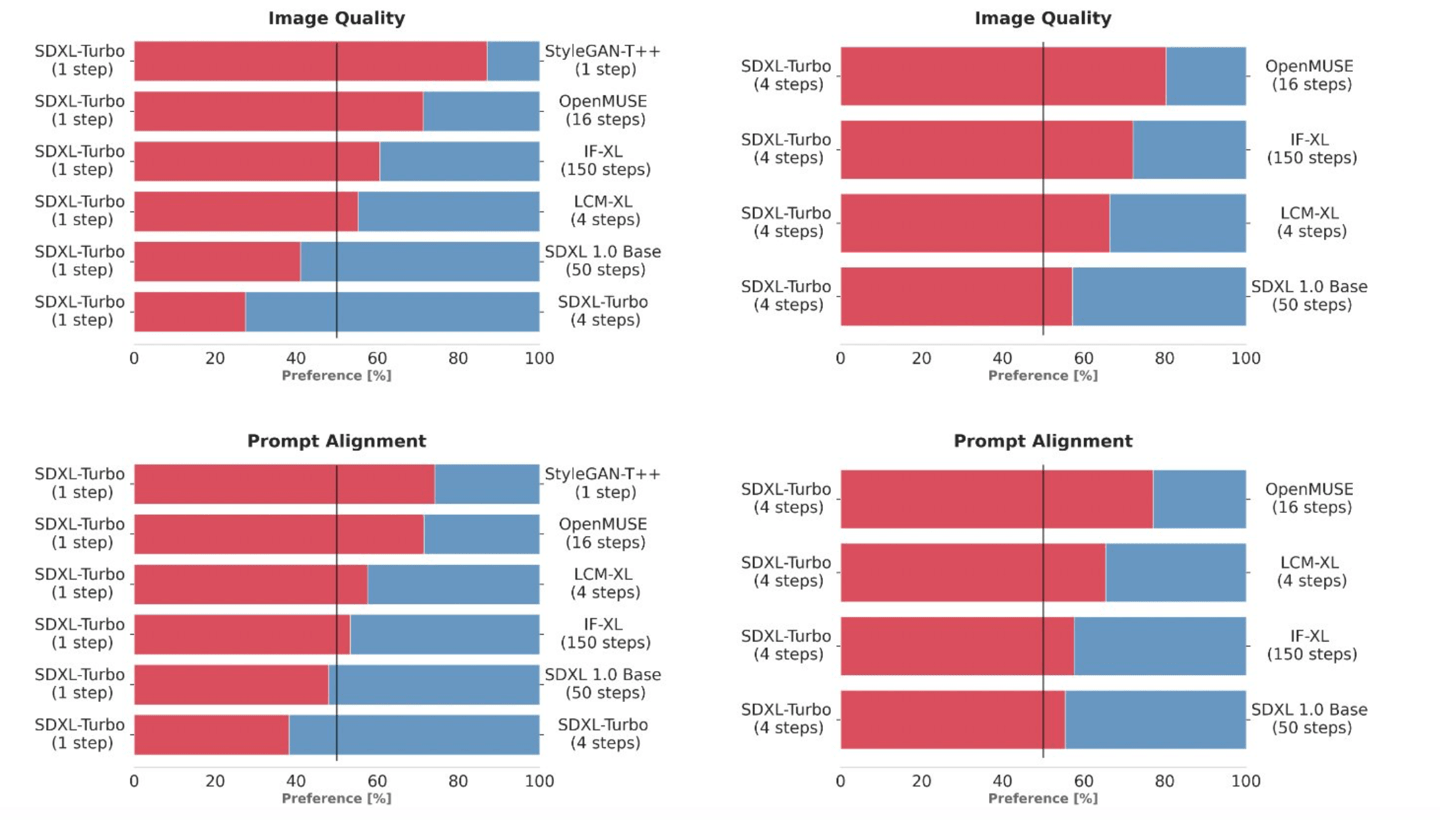

Comparé officiellement Stable Diffusion XL Turbo avec plusieurs variantes de modèles différentes, notamment StyleGAN-T++, OpenMUSE, IF-XL, SDXL et LCM-XL, et mené deux expériences, dont la première nécessitait des évaluateurs de modèles. Visualisez aléatoirement la sortie des deux modèles. et sélectionnez l'image de sortie qui correspond le mieux au mot d'invite. La deuxième expérience est à peu près la même que la première expérience. L'évaluation du modèle nécessite de sélectionner celle avec la meilleure qualité d'image dans le modèle.

▲ Photos du blog Stability AI

Les résultats expérimentaux montrent que Stable Diffusion XL Turbo peut réduire considérablement les besoins informatiques tout en conservant une excellente qualité de génération d'images. Ce modèle surpasse le LCM-XL en une seule itération contre 4 itérations. Le Stable Diffusion XL Turbo, qui a subi 4 itérations, peut facilement battre le Stable Diffusion XL dont la configuration nécessitait auparavant 50 itérations. Lorsque vous utilisez le GPU A100 pour le calcul d’images à une résolution de 512 x 512, cela ne prend que 207 millisecondes

IT House a remarqué que Stability AI a actuellement publié le code correspondant sur Hugging Face pour un usage personnel et non commercial. Les amis intéressés peuvent cliquer ici pour le visiter.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

J'ai essayé le codage d'ambiance avec Cursor Ai et c'est incroyable!

Mar 20, 2025 pm 03:34 PM

J'ai essayé le codage d'ambiance avec Cursor Ai et c'est incroyable!

Mar 20, 2025 pm 03:34 PM

Le codage des ambiances est de remodeler le monde du développement de logiciels en nous permettant de créer des applications en utilisant le langage naturel au lieu de lignes de code sans fin. Inspirée par des visionnaires comme Andrej Karpathy, cette approche innovante permet de dev

Top 5 Genai Lunets de février 2025: GPT-4.5, Grok-3 et plus!

Mar 22, 2025 am 10:58 AM

Top 5 Genai Lunets de février 2025: GPT-4.5, Grok-3 et plus!

Mar 22, 2025 am 10:58 AM

Février 2025 a été un autre mois qui change la donne pour une IA générative, nous apportant certaines des mises à niveau des modèles les plus attendues et de nouvelles fonctionnalités révolutionnaires. De Xai's Grok 3 et Anthropic's Claude 3.7 Sonnet, à Openai's G

Comment utiliser YOLO V12 pour la détection d'objets?

Mar 22, 2025 am 11:07 AM

Comment utiliser YOLO V12 pour la détection d'objets?

Mar 22, 2025 am 11:07 AM

Yolo (vous ne regardez qu'une seule fois) a été un cadre de détection d'objets en temps réel de premier plan, chaque itération améliorant les versions précédentes. La dernière version Yolo V12 introduit des progrès qui améliorent considérablement la précision

Chatgpt 4 o est-il disponible?

Mar 28, 2025 pm 05:29 PM

Chatgpt 4 o est-il disponible?

Mar 28, 2025 pm 05:29 PM

Chatgpt 4 est actuellement disponible et largement utilisé, démontrant des améliorations significatives dans la compréhension du contexte et la génération de réponses cohérentes par rapport à ses prédécesseurs comme Chatgpt 3.5. Les développements futurs peuvent inclure un interg plus personnalisé

Google & # 039; s Gencast: Prévision météorologique avec Mini démo Gencast

Mar 16, 2025 pm 01:46 PM

Google & # 039; s Gencast: Prévision météorologique avec Mini démo Gencast

Mar 16, 2025 pm 01:46 PM

Gencast de Google Deepmind: une IA révolutionnaire pour les prévisions météorologiques Les prévisions météorologiques ont subi une transformation spectaculaire, passant des observations rudimentaires aux prédictions sophistiquées alimentées par l'IA. Gencast de Google Deepmind, un terreau

Quelle IA est la meilleure que Chatgpt?

Mar 18, 2025 pm 06:05 PM

Quelle IA est la meilleure que Chatgpt?

Mar 18, 2025 pm 06:05 PM

L'article traite des modèles d'IA dépassant Chatgpt, comme Lamda, Llama et Grok, mettant en évidence leurs avantages en matière de précision, de compréhension et d'impact de l'industrie. (159 caractères)

Meilleurs générateurs d'art AI (gratuit & amp; payé) pour des projets créatifs

Apr 02, 2025 pm 06:10 PM

Meilleurs générateurs d'art AI (gratuit & amp; payé) pour des projets créatifs

Apr 02, 2025 pm 06:10 PM

L'article passe en revue les meilleurs générateurs d'art AI, discutant de leurs fonctionnalités, de leur aptitude aux projets créatifs et de la valeur. Il met en évidence MidJourney comme la meilleure valeur pour les professionnels et recommande Dall-E 2 pour un art personnalisable de haute qualité.

O1 vs GPT-4O: le nouveau modèle Openai est-il meilleur que GPT-4O?

Mar 16, 2025 am 11:47 AM

O1 vs GPT-4O: le nouveau modèle Openai est-il meilleur que GPT-4O?

Mar 16, 2025 am 11:47 AM

O1'S O1: Une vague de cadeaux de 12 jours commence par leur modèle le plus puissant à ce jour L'arrivée de décembre apporte un ralentissement mondial, les flocons de neige dans certaines parties du monde, mais Openai ne fait que commencer. Sam Altman et son équipe lancent un cadeau de don de 12 jours