Périphériques technologiques

Périphériques technologiques

IA

IA

Simulation de conduite avancée : reconstruction de scènes de conduite avec des données surround réalistes

Simulation de conduite avancée : reconstruction de scènes de conduite avec des données surround réalistes

Simulation de conduite avancée : reconstruction de scènes de conduite avec des données surround réalistes

Titre original : DrivingGaussian : Rendu de points gaussiens composites pour les scènes de conduite autonome dynamiques ambiantes

Veuillez cliquer ici pour consulter l'article : https://arxiv.org/pdf/2312.07920.pdf

Lien de code : https://pkuvdig . github.io/DrivingGaussian/

Affiliation de l'auteur : Peking University Google Research University of California, Merced

Idée de thèse :

Cet article propose DrivingGaussian, qui est une solution à haute efficacité et rentable pour les scénarios de conduite autonome dynamique . cadre. Pour les scènes complexes avec des objets en mouvement, cet article utilise d’abord des Gaussiennes 3D statiques incrémentielles pour modéliser séquentiellement et progressivement l’arrière-plan statique de la scène entière. Ensuite, cet article utilise un graphe gaussien dynamique composite pour traiter plusieurs objets en mouvement, reconstruire chaque objet individuellement et restaurer leur position précise et leur relation d'occlusion dans la scène. Cet article utilise en outre les priors LiDAR pour les éclaboussures gaussiennes afin de reconstruire la scène avec plus de détails et de maintenir une cohérence panoramique. DrivingGaussian surpasse les méthodes existantes en matière de reconstruction de scènes de conduite et permet une synthèse réaliste de vue panoramique avec une haute fidélité et une cohérence multi-caméras.

Principales contributions :

Selon cet article, DrivingGaussian est le premier framework à utiliser la technologie composite gaussienne splash pour la représentation et la modélisation dynamiques de scènes de conduite à grande échelle

Introduit deux nouveaux modules, dont le gaussien 3D statique incrémentiel et le dynamique composite Tracés gaussiens. Le premier reconstruit progressivement un arrière-plan statique, tandis que le second modélise plusieurs objets dynamiques à l'aide de cartes gaussiennes. Aidée par les a priori lidar, la méthode permet de récupérer une géométrie complète dans des scénarios de conduite à grande échelle

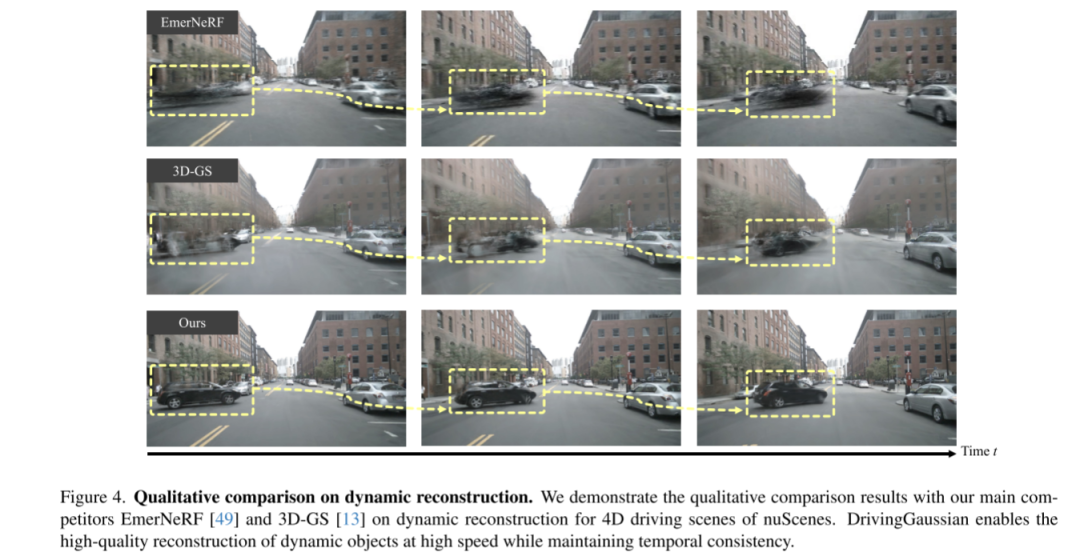

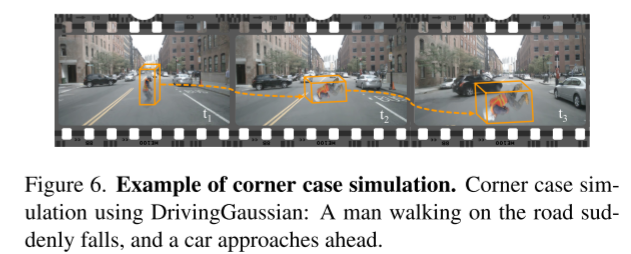

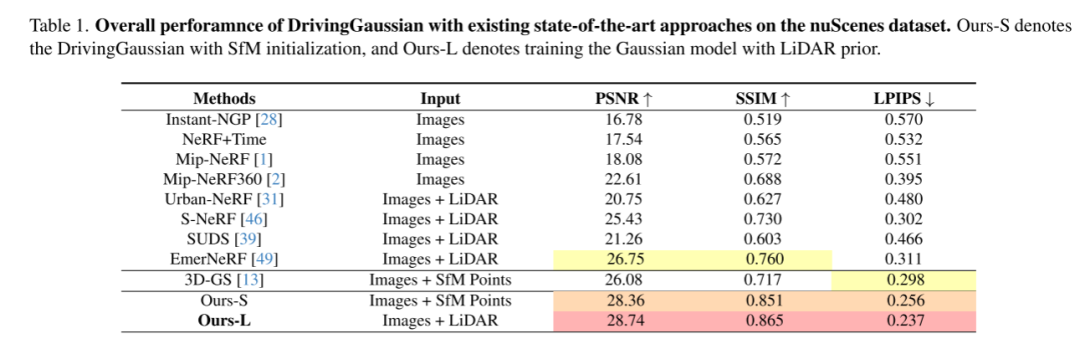

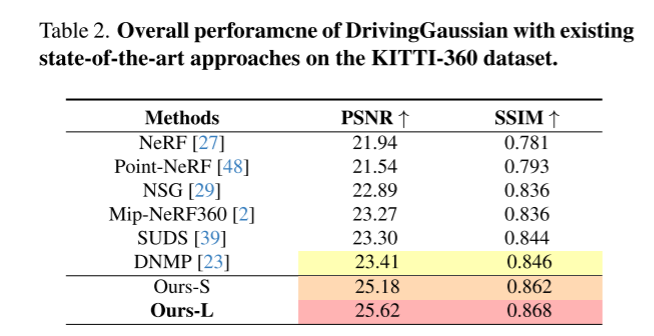

Des expériences complètes démontrent que DrivingGaussian surpasse les méthodes précédentes sur des références de conduite autonome difficiles et est capable de simuler diverses situations extrêmes pour les tâches en aval

Conception de réseau :

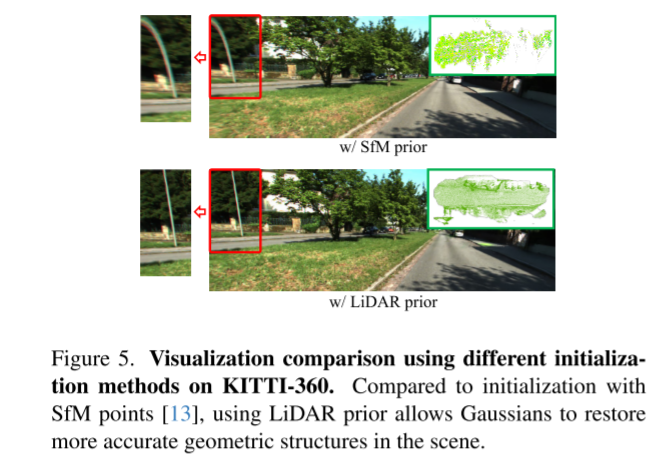

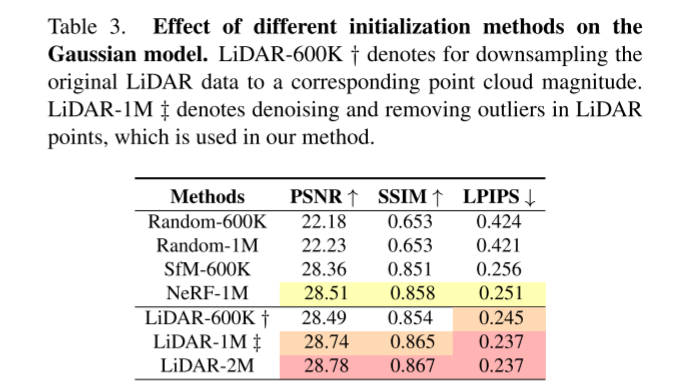

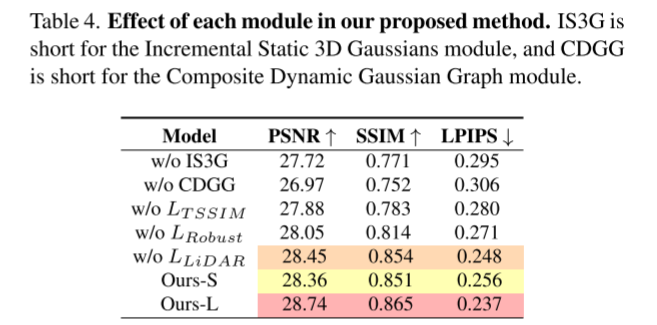

Cet article présente un nouveau cadre appelé DrivingGaussian pour représenter des scénarios de conduite autonome dynamique à vue panoramique. L'idée clé de ce framework est de modéliser hiérarchiquement des scénarios de conduite complexes à l'aide de données séquentielles provenant de plusieurs capteurs. En utilisant la technologie Composite Gaussian Splatting, la scène entière est décomposée en arrière-plans statiques et en objets dynamiques, et chaque partie est reconstruite séparément. Plus précisément, une scène synthétique est d'abord construite séquentiellement à partir de vues multi-caméras en utilisant une méthode gaussienne 3D statique incrémentielle. Ensuite, une carte gaussienne dynamique composite est utilisée pour reconstruire chaque objet en mouvement individuellement et les intégrer dynamiquement dans l'arrière-plan statique via la carte gaussienne. Sur cette base, le rendu global est effectué via Gaussian Splatting pour capturer les relations d'occlusion dans le monde réel, y compris les arrière-plans statiques et les objets dynamiques. De plus, cet article introduit également un a priori LiDAR dans la représentation GS, capable de récupérer des géométries plus précises et de maintenir une meilleure cohérence multi-vues par rapport aux nuages de points générés par initialisation aléatoire ou SfM

Un grand nombre d'expériences montrent que , notre méthode atteint des performances de pointe sur les ensembles de données publics de conduite autonome. Même sans lidar au préalable, notre méthode montre toujours de bonnes performances, démontrant sa polyvalence dans la reconstruction de scènes dynamiques à grande échelle. De plus, le cadre de cet article prend en charge la construction de scènes dynamiques et la simulation de cas extrêmes, ce qui permet de vérifier la sécurité et la robustesse du système de conduite autonome.

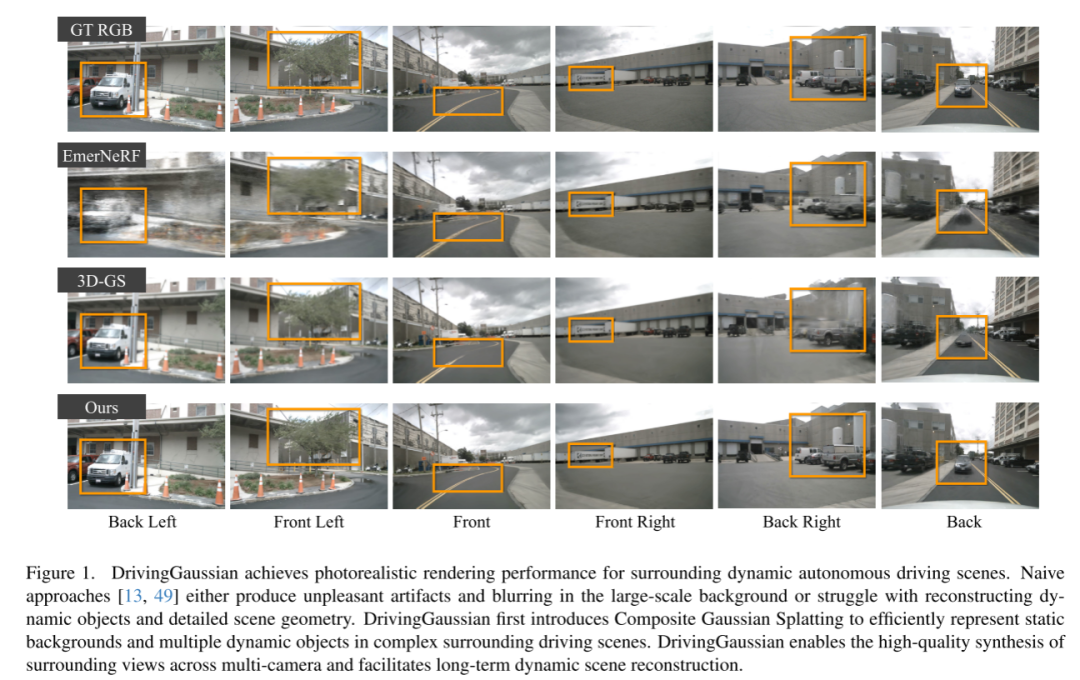

Figure 1. DrivingGaussian atteint des performances de rendu réalistes de scènes de conduite autonome dynamiques à vue panoramique. Les méthodes naïves [13, 49] produisent des artefacts désagréables et un flou dans les arrière-plans à grande échelle ou ont des difficultés à reconstruire des objets dynamiques et une géométrie détaillée de la scène. DrivingGaussian a introduit pour la première fois le Composite Gaussian Splatting pour représenter efficacement des arrière-plans statiques et plusieurs objets dynamiques dans des scènes de conduite complexes à vue panoramique. DrivingGaussian permet une synthèse de haute qualité de vues surround sur plusieurs caméras et facilite la reconstruction dynamique de scènes à long terme.

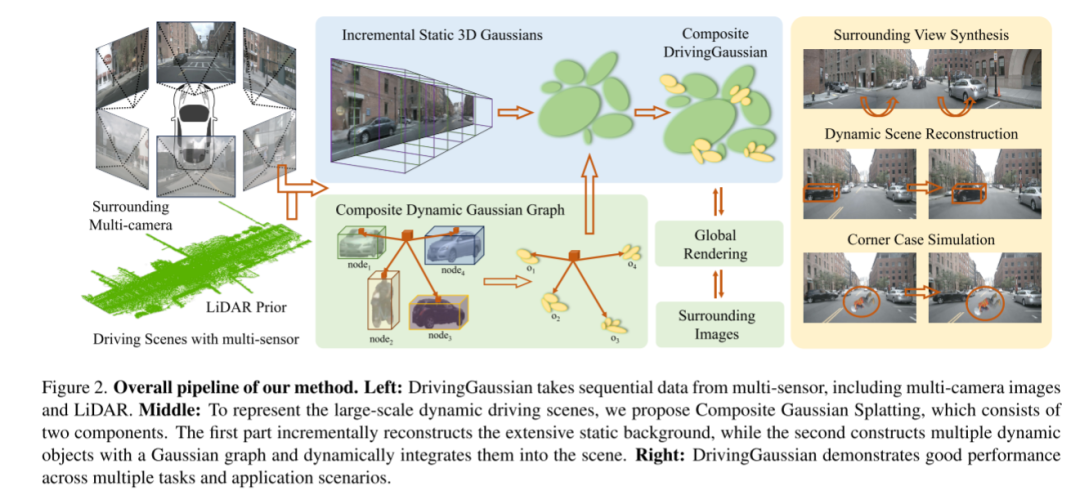

Figure 2. Le processus global de la méthode dans cet article. À gauche : DrivingGaussian acquiert des données continues provenant de plusieurs capteurs, notamment des images multi-caméras et LiDAR. Centre : Pour représenter des scénarios de conduite dynamique à grande échelle, cet article propose le Composite Gaussian Splatting, qui se compose de deux parties. La première partie reconstruit progressivement un large arrière-plan statique, tandis que la seconde partie utilise des cartes gaussiennes pour construire plusieurs objets dynamiques et les intégrer dynamiquement dans la scène. À droite : DrivingGaussian démontre de bonnes performances sur plusieurs tâches et scénarios d’application.

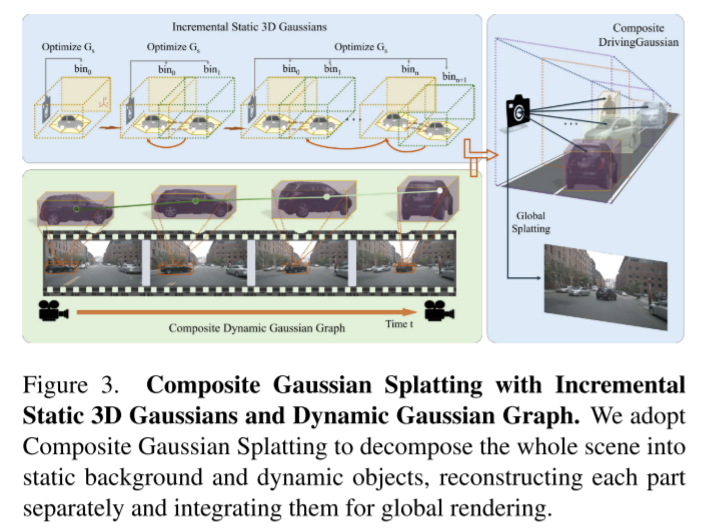

Figure 3. Splatting gaussien composite avec tracés gaussiens 3D statiques incrémentiels et gaussiens dynamiques. Cet article utilise le Composite Gaussian Splatting pour décomposer la scène entière en arrière-plans statiques et objets dynamiques, reconstruire chaque partie séparément et les intégrer pour un rendu global.

Résultats expérimentaux :

Résumé :

Cet article présente DrivingGaussian, une méthode basée sur le Composite Gaussian Splatting A proposé un nouveau cadre pour représenter des scénarios de conduite autonome dynamique à grande échelle. DrivingGaussian modélise progressivement un arrière-plan statique à l'aide de gaussiennes 3D statiques incrémentielles et capture plusieurs objets en mouvement à l'aide de cartes gaussiennes dynamiques composites. Cet article exploite davantage les priors LiDAR pour obtenir une géométrie précise et une cohérence multi-vues. DrivingGaussian atteint des performances de pointe sur deux ensembles de données de conduite autonome, permettant une synthèse de vue surround de haute qualité et une reconstruction dynamique de scènes

Citation :

Zhou, X., Lin, Z., Shan, X. , Wang, Y., Sun, D. et Yang, M. (2023). DrivingGaussian : éclaboussures gaussiennes composites pour les scènes de conduite autonomes dynamiques environnantes /abs/2312.07920

Lien original :https://. www.php.cn/link/a878dbebc902328b41dbf02aa87abb58

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Utilisez ddrescue pour récupérer des données sous Linux

Mar 20, 2024 pm 01:37 PM

Utilisez ddrescue pour récupérer des données sous Linux

Mar 20, 2024 pm 01:37 PM

DDREASE est un outil permettant de récupérer des données à partir de périphériques de fichiers ou de blocs tels que des disques durs, des SSD, des disques RAM, des CD, des DVD et des périphériques de stockage USB. Il copie les données d'un périphérique bloc à un autre, laissant derrière lui les blocs corrompus et ne déplaçant que les bons blocs. ddreasue est un puissant outil de récupération entièrement automatisé car il ne nécessite aucune interruption pendant les opérations de récupération. De plus, grâce au fichier map ddasue, il peut être arrêté et repris à tout moment. Les autres fonctionnalités clés de DDREASE sont les suivantes : Il n'écrase pas les données récupérées mais comble les lacunes en cas de récupération itérative. Cependant, il peut être tronqué si l'outil est invité à le faire explicitement. Récupérer les données de plusieurs fichiers ou blocs en un seul

Open source! Au-delà de ZoeDepth ! DepthFM : estimation rapide et précise de la profondeur monoculaire !

Apr 03, 2024 pm 12:04 PM

Open source! Au-delà de ZoeDepth ! DepthFM : estimation rapide et précise de la profondeur monoculaire !

Apr 03, 2024 pm 12:04 PM

0. À quoi sert cet article ? Nous proposons DepthFM : un modèle d'estimation de profondeur monoculaire génératif de pointe, polyvalent et rapide. En plus des tâches traditionnelles d'estimation de la profondeur, DepthFM démontre également des capacités de pointe dans les tâches en aval telles que l'inpainting en profondeur. DepthFM est efficace et peut synthétiser des cartes de profondeur en quelques étapes d'inférence. Lisons ce travail ensemble ~ 1. Titre des informations sur l'article : DepthFM : FastMonocularDepthEstimationwithFlowMatching Auteur : MingGui, JohannesS.Fischer, UlrichPrestel, PingchuanMa, Dmytr

Comment résoudre le problème de la longue traîne dans les scénarios de conduite autonome ?

Jun 02, 2024 pm 02:44 PM

Comment résoudre le problème de la longue traîne dans les scénarios de conduite autonome ?

Jun 02, 2024 pm 02:44 PM

Hier, lors de l'entretien, on m'a demandé si j'avais posé des questions à longue traîne, j'ai donc pensé faire un bref résumé. Le problème à longue traîne de la conduite autonome fait référence aux cas extrêmes dans les véhicules autonomes, c'est-à-dire à des scénarios possibles avec une faible probabilité d'occurrence. Le problème perçu de la longue traîne est l’une des principales raisons limitant actuellement le domaine de conception opérationnelle des véhicules autonomes intelligents à véhicule unique. L'architecture sous-jacente et la plupart des problèmes techniques de la conduite autonome ont été résolus, et les 5 % restants des problèmes à longue traîne sont progressivement devenus la clé pour restreindre le développement de la conduite autonome. Ces problèmes incluent une variété de scénarios fragmentés, de situations extrêmes et de comportements humains imprévisibles. La « longue traîne » des scénarios limites dans la conduite autonome fait référence aux cas limites dans les véhicules autonomes (VA). Les cas limites sont des scénarios possibles avec une faible probabilité d'occurrence. ces événements rares

Google est ravi : les performances de JAX surpassent Pytorch et TensorFlow ! Cela pourrait devenir le choix le plus rapide pour la formation à l'inférence GPU

Apr 01, 2024 pm 07:46 PM

Google est ravi : les performances de JAX surpassent Pytorch et TensorFlow ! Cela pourrait devenir le choix le plus rapide pour la formation à l'inférence GPU

Apr 01, 2024 pm 07:46 PM

Les performances de JAX, promu par Google, ont dépassé celles de Pytorch et TensorFlow lors de récents tests de référence, se classant au premier rang sur 7 indicateurs. Et le test n’a pas été fait sur le TPU présentant les meilleures performances JAX. Bien que parmi les développeurs, Pytorch soit toujours plus populaire que Tensorflow. Mais à l’avenir, des modèles plus volumineux seront peut-être formés et exécutés sur la base de la plate-forme JAX. Modèles Récemment, l'équipe Keras a comparé trois backends (TensorFlow, JAX, PyTorch) avec l'implémentation native de PyTorch et Keras2 avec TensorFlow. Premièrement, ils sélectionnent un ensemble de

Vitesse Internet lente des données cellulaires sur iPhone : correctifs

May 03, 2024 pm 09:01 PM

Vitesse Internet lente des données cellulaires sur iPhone : correctifs

May 03, 2024 pm 09:01 PM

Vous êtes confronté à un décalage et à une connexion de données mobile lente sur iPhone ? En règle générale, la puissance de l'Internet cellulaire sur votre téléphone dépend de plusieurs facteurs tels que la région, le type de réseau cellulaire, le type d'itinérance, etc. Vous pouvez prendre certaines mesures pour obtenir une connexion Internet cellulaire plus rapide et plus fiable. Correctif 1 – Forcer le redémarrage de l'iPhone Parfois, le redémarrage forcé de votre appareil réinitialise simplement beaucoup de choses, y compris la connexion cellulaire. Étape 1 – Appuyez simplement une fois sur la touche d’augmentation du volume et relâchez-la. Ensuite, appuyez sur la touche de réduction du volume et relâchez-la à nouveau. Étape 2 – La partie suivante du processus consiste à maintenir le bouton sur le côté droit. Laissez l'iPhone finir de redémarrer. Activez les données cellulaires et vérifiez la vitesse du réseau. Vérifiez à nouveau Correctif 2 – Changer le mode de données Bien que la 5G offre de meilleures vitesses de réseau, elle fonctionne mieux lorsque le signal est plus faible

La vitalité de la super intelligence s'éveille ! Mais avec l'arrivée de l'IA qui se met à jour automatiquement, les mères n'ont plus à se soucier des goulots d'étranglement des données.

Apr 29, 2024 pm 06:55 PM

La vitalité de la super intelligence s'éveille ! Mais avec l'arrivée de l'IA qui se met à jour automatiquement, les mères n'ont plus à se soucier des goulots d'étranglement des données.

Apr 29, 2024 pm 06:55 PM

Je pleure à mort. Le monde construit à la folie de grands modèles. Les données sur Internet ne suffisent pas du tout. Le modèle de formation ressemble à « The Hunger Games », et les chercheurs en IA du monde entier se demandent comment nourrir ces personnes avides de données. Ce problème est particulièrement important dans les tâches multimodales. À une époque où rien ne pouvait être fait, une équipe de start-up du département de l'Université Renmin de Chine a utilisé son propre nouveau modèle pour devenir la première en Chine à faire de « l'auto-alimentation des données générées par le modèle » une réalité. De plus, il s’agit d’une approche à deux volets, du côté compréhension et du côté génération, les deux côtés peuvent générer de nouvelles données multimodales de haute qualité et fournir un retour de données au modèle lui-même. Qu'est-ce qu'un modèle ? Awaker 1.0, un grand modèle multimodal qui vient d'apparaître sur le Forum Zhongguancun. Qui est l'équipe ? Moteur Sophon. Fondé par Gao Yizhao, doctorant à la Hillhouse School of Artificial Intelligence de l’Université Renmin.

NuScenes dernier SOTA SparseAD : les requêtes clairsemées contribuent à une conduite autonome efficace de bout en bout !

Apr 17, 2024 pm 06:22 PM

NuScenes dernier SOTA SparseAD : les requêtes clairsemées contribuent à une conduite autonome efficace de bout en bout !

Apr 17, 2024 pm 06:22 PM

Écrit à l'avant et point de départ Le paradigme de bout en bout utilise un cadre unifié pour réaliser plusieurs tâches dans les systèmes de conduite autonome. Malgré la simplicité et la clarté de ce paradigme, les performances des méthodes de conduite autonome de bout en bout sur les sous-tâches sont encore loin derrière les méthodes à tâche unique. Dans le même temps, les fonctionnalités de vue à vol d'oiseau (BEV) denses, largement utilisées dans les méthodes de bout en bout précédentes, rendent difficile l'adaptation à davantage de modalités ou de tâches. Un paradigme de conduite autonome de bout en bout (SparseAD) centré sur la recherche clairsemée est proposé ici, dans lequel la recherche clairsemée représente entièrement l'ensemble du scénario de conduite, y compris l'espace, le temps et les tâches, sans aucune représentation BEV dense. Plus précisément, une architecture clairsemée unifiée est conçue pour la connaissance des tâches, notamment la détection, le suivi et la cartographie en ligne. De plus, lourd

L'US Air Force présente son premier avion de combat IA de grande envergure ! Le ministre a personnellement effectué l'essai routier sans intervenir pendant tout le processus, et 100 000 lignes de code ont été testées 21 fois.

May 07, 2024 pm 05:00 PM

L'US Air Force présente son premier avion de combat IA de grande envergure ! Le ministre a personnellement effectué l'essai routier sans intervenir pendant tout le processus, et 100 000 lignes de code ont été testées 21 fois.

May 07, 2024 pm 05:00 PM

Récemment, le milieu militaire a été submergé par la nouvelle : les avions de combat militaires américains peuvent désormais mener des combats aériens entièrement automatiques grâce à l'IA. Oui, tout récemment, l’avion de combat IA de l’armée américaine a été rendu public pour la première fois, dévoilant ainsi son mystère. Le nom complet de ce chasseur est Variable Stability Simulator Test Aircraft (VISTA). Il a été personnellement piloté par le secrétaire de l'US Air Force pour simuler une bataille aérienne en tête-à-tête. Le 2 mai, le secrétaire de l'US Air Force, Frank Kendall, a décollé à bord d'un X-62AVISTA à la base aérienne d'Edwards. Notez que pendant le vol d'une heure, toutes les actions de vol ont été effectuées de manière autonome par l'IA ! Kendall a déclaré : "Au cours des dernières décennies, nous avons réfléchi au potentiel illimité du combat air-air autonome, mais cela a toujours semblé hors de portée." Mais maintenant,