Périphériques technologiques

Périphériques technologiques

IA

IA

Utiliser des photos synthétiques pour collecter des fonds et abuser de l'IA ne fera que nuire au secteur caritatif |

Utiliser des photos synthétiques pour collecter des fonds et abuser de l'IA ne fera que nuire au secteur caritatif |

Utiliser des photos synthétiques pour collecter des fonds et abuser de l'IA ne fera que nuire au secteur caritatif |

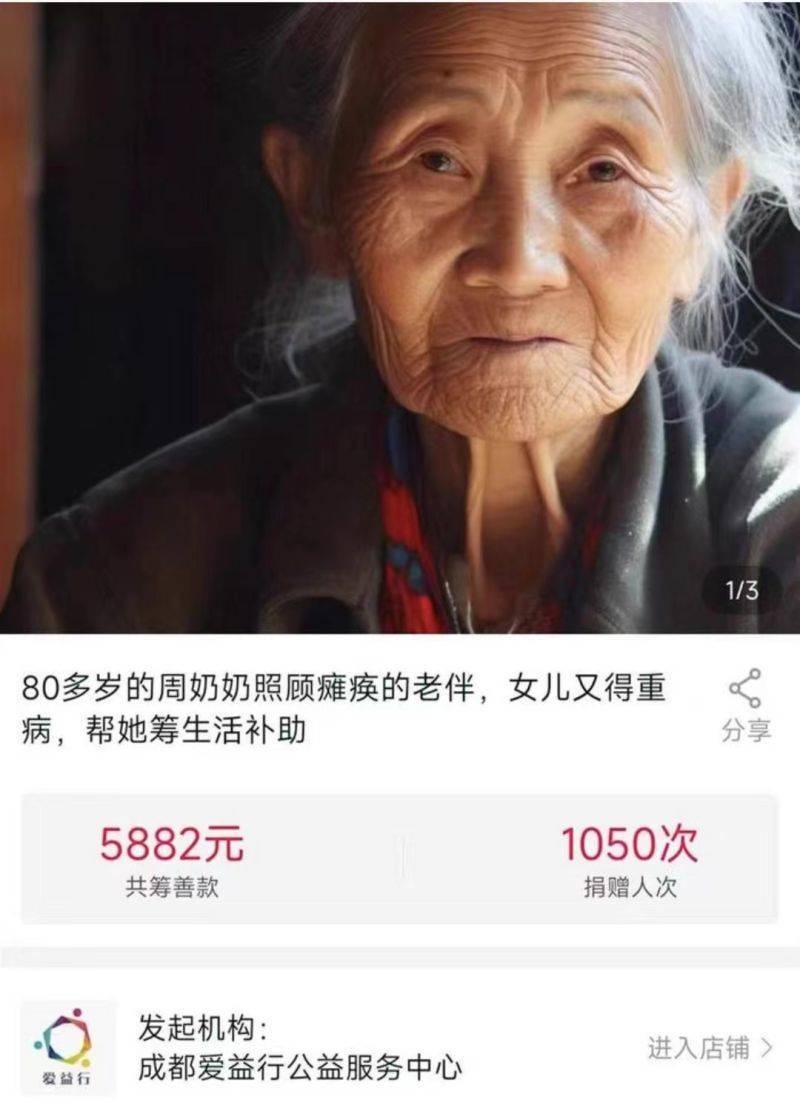

▲Images synthétisées par l'IA et pages de dons associées qui ont attiré l'attention. Photo/capture d'écran de la plateforme en ligne

Les applications de l’intelligence artificielle (IA) suscitent à nouveau la controverse.

Selon les médias, une organisation caritative de Chengdu a utilisé des photos synthétisées par la technologie de l'IA sur sa page de financement participatif en ligne. Après vérification par le service des affaires civiles, l'organisation a procédé aux rectifications correspondantes.

L'organisation caritative a affirmé dans une interview avec les médias avoir utilisé des photos composites pour protéger la vie privée des destinataires. Cependant, de nombreux détails dans les médias font qu’il est difficile de croire que cette explication soit vraie.

Il est à noter que l'utilisation de photos composites dans ce projet de collecte de fonds crée une relation d'adéquation avec le texte descriptif. Par exemple, une capture d'écran divulguée par les médias montre qu'il y a un texte de description clair et détaillé sous la photo composite, tel que « Grand-mère Zhou, qui a 80 ans, prend soin de son partenaire paralysé », etc.

Lorsque les photos ne sont pas étiquetées comme composites, la façon dont l'image et le texte sont combinés peut induire les lecteurs en erreur. Il ne s’agit pas seulement d’une utilisation inappropriée de photos composites, mais également d’une utilisation présumée de photos composites pour tromper les collecteurs de fonds.

En fait, afin de protéger la vie privée, le traitement technique de vraies photos est une option réalisable sans qu'il soit nécessaire de synthétiser de faux gros plans de personnes.

En conséquence, les explications profondément confuses et les implications trompeuses ont jeté davantage de doutes sur l'authenticité de la collecte de fonds.

En termes de motivation, améliorer l'efficacité de la communication est crucial pour de nombreuses collectes de fonds caritatives. En fait, de nombreuses réussites philanthropiques dépendent de la communication de masse.

Par exemple, le cas classique de la « fille aux grands yeux » dans l'histoire du bien-être public de mon pays a réussi à impressionner le public et a également réussi à attirer l'attention de la société sur la question de l'aide à l'éducation des filles.

Utiliser diverses technologies de communication pour accroître la visibilité des activités de collecte de fonds caritatives a toujours été l'objectif opérationnel principal de nombreuses organisations caritatives.

Si vous comparez des projets de collecte de fonds similaires d'autres organismes de protection sociale et plateformes de financement participatif, la qualité des photos générées par l'IA grâce à la formation d'imitation de photos en gros plan classiques est évidemment meilleure que les photos fournies par des gens ordinaires.

Les faibles coûts de production, associés à une qualité d'image supérieure et à l'effet de communication amélioré provoqué par la combinaison des deux, peuvent être la principale raison pour laquelle cette organisation caritative prend des risques et utilise des photos synthétiques contre l'authenticité de l'association.

Actuellement, l'utilisation de l'IA pour améliorer l'efficacité et la qualité de la production de contenu à grande échelle est devenue une solution applicative largement envisagée par de nombreux individus, entreprises et organisations ayant des besoins de communication.

Cependant, par rapport aux applications normales telles que les affiches commerciales et les vidéos de contenu, les applications caritatives de l'IA en tant qu'outil d'amélioration des effets de communication doivent encore être extrêmement prudentes, même dans la situation actuelle où des normes claires et un consensus social n'ont pas été formés. de cette technologie devrait être activement refusée.

C'est parce que l'authenticité est la bouée de sauvetage de l'industrie caritative. Dès qu’il y aura des défauts dans l’authenticité de la charité, cela suscitera non seulement des doutes du public, mais aura également un impact négatif sur la crédibilité globale de l’industrie caritative et même de la société.

La charité repose sur l'amour mutuel du public, et l'amour du public doit être basé sur l'authenticité, et ses exigences en matière d'authenticité sont bien plus élevées que celles des industries ordinaires.

La relation et les limites entre la technologie de l'IA et les fausses informations n'ont toujours pas été correctement résolues au niveau social. Par conséquent, le public a toujours été très préoccupé par le contenu généré par les nouvelles technologies telles que les photos composites.

En d’autres termes, lorsque les gens verront des articles, des photos et des vidéos produits par l’IA, ils auront instinctivement l’impression qu’ils sont irréels, voire « trompés ». Dans ces circonstances, appliquer la technologie de l’IA pour améliorer l’efficacité du secteur caritatif est sans aucun doute contre-productif.

Par conséquent, face aux nouvelles technologies controversées, la charité pourrait être plus lente à suivre. Avant que la société n’ait clairement divisé et stipulé le contenu de l’IA, il est préférable de ne pas utiliser l’IA pour produire du matériel associé.

S'il doit être utilisé, il doit être totalement ouvert et transparent pour éviter que les inquiétudes du public concernant la technologie de l'IA elle-même ne se transforment en doutes sur l'industrie caritative, nuisant ainsi aux intérêts sociaux et publics.

Écrit par Malvin (responsable des médias)

Editeur / He Rui

Relecture / Li Lijun

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

Qu'est-ce que le protocole de contexte modèle (MCP)?

Mar 03, 2025 pm 07:09 PM

Qu'est-ce que le protocole de contexte modèle (MCP)?

Mar 03, 2025 pm 07:09 PM

Le protocole de contexte du modèle (MCP): un connecteur universel pour l'IA et les données Nous connaissons tous le rôle de l'IA dans le codage quotidien. Replit, GitHub Copilot, Black Box AI et Cursor IDE ne sont que quelques exemples de la façon dont AI rationalise nos flux de travail. Mais imaginez

Construire un agent de vision local utilisant omniparser v2 et omnitool

Mar 03, 2025 pm 07:08 PM

Construire un agent de vision local utilisant omniparser v2 et omnitool

Mar 03, 2025 pm 07:08 PM

Omniparser V2 et Omnitool de Microsoft: révolutionner l'automatisation de l'interface graphique avec l'IA Imaginez l'IA qui ne comprend pas seulement mais interagit également avec votre interface Windows 11 comme un professionnel chevronné. Omniparser v2 et omnitool de Microsoft en font un re

J'ai essayé le codage d'ambiance avec Cursor Ai et c'est incroyable!

Mar 20, 2025 pm 03:34 PM

J'ai essayé le codage d'ambiance avec Cursor Ai et c'est incroyable!

Mar 20, 2025 pm 03:34 PM

Le codage des ambiances est de remodeler le monde du développement de logiciels en nous permettant de créer des applications en utilisant le langage naturel au lieu de lignes de code sans fin. Inspirée par des visionnaires comme Andrej Karpathy, cette approche innovante permet de dev

Guide de la piste ACT-ONE: Je me suis filmé pour le tester

Mar 03, 2025 am 09:42 AM

Guide de la piste ACT-ONE: Je me suis filmé pour le tester

Mar 03, 2025 am 09:42 AM

Ce billet de blog partage mon expérience de l'outil d'animation ACT-One de Test Testing Runway ML, couvrant à la fois son interface Web et son API Python. Bien que prometteurs, mes résultats étaient moins impressionnants que prévu. Vous voulez explorer une IA générative? Apprenez à utiliser les LLMS dans P

Replit Agent: un guide avec des exemples pratiques

Mar 04, 2025 am 10:52 AM

Replit Agent: un guide avec des exemples pratiques

Mar 04, 2025 am 10:52 AM

Révolutionment du développement des applications: une plongée profonde dans l'agent de repelit Vous en avez assez de lutter avec des environnements de développement complexes et des fichiers de configuration obscurs? Replit Agent vise à simplifier le processus de transformation des idées en applications fonctionnelles. Cet ai-p

Top 5 Genai Lunets de février 2025: GPT-4.5, Grok-3 et plus!

Mar 22, 2025 am 10:58 AM

Top 5 Genai Lunets de février 2025: GPT-4.5, Grok-3 et plus!

Mar 22, 2025 am 10:58 AM

Février 2025 a été un autre mois qui change la donne pour une IA générative, nous apportant certaines des mises à niveau des modèles les plus attendues et de nouvelles fonctionnalités révolutionnaires. De Xai's Grok 3 et Anthropic's Claude 3.7 Sonnet, à Openai's G

Comment utiliser YOLO V12 pour la détection d'objets?

Mar 22, 2025 am 11:07 AM

Comment utiliser YOLO V12 pour la détection d'objets?

Mar 22, 2025 am 11:07 AM

Yolo (vous ne regardez qu'une seule fois) a été un cadre de détection d'objets en temps réel de premier plan, chaque itération améliorant les versions précédentes. La dernière version Yolo V12 introduit des progrès qui améliorent considérablement la précision

Elon Musk et Sam Altman s'affrontent plus de 500 milliards de dollars Stargate Project

Mar 08, 2025 am 11:15 AM

Elon Musk et Sam Altman s'affrontent plus de 500 milliards de dollars Stargate Project

Mar 08, 2025 am 11:15 AM

Le projet de 500 milliards de dollars Stargate IA, soutenu par des géants de la technologie comme Openai, Softbank, Oracle et Nvidia, et soutenu par le gouvernement américain, vise à consolider la direction de l'IA américaine. Cette entreprise ambitieuse promet un avenir façonné par AI Advanceme