Périphériques technologiques

Périphériques technologiques

Industrie informatique

Industrie informatique

NVIDIA lance le service NVIDIA ACE et coopère avec miHoYo, Tencent, NetEase et d'autres sociétés de jeux pour développer l'activité humaine numérique de l'IA

NVIDIA lance le service NVIDIA ACE et coopère avec miHoYo, Tencent, NetEase et d'autres sociétés de jeux pour développer l'activité humaine numérique de l'IA

NVIDIA lance le service NVIDIA ACE et coopère avec miHoYo, Tencent, NetEase et d'autres sociétés de jeux pour développer l'activité humaine numérique de l'IA

Au CES 2024, NVIDIA a lancé une série de nouveaux produits, notamment le service NVIDIA ACE, qui permet aux développeurs d'appliquer les modèles d'IA générative les plus avancés aux personnages numériques virtuels dans les jeux et les applications pour offrir de meilleures expériences.

En termes simples, il s'agit d'une plate-forme technologique qui utilise l'IA générative pour créer des humains numériques virtuels et prend en charge l'exécution sur le cloud ou sur un PC local. Les partenaires actuels de NVIDIA ACE incluent Convai, Charisma.AI, Inworld, MiHoYo, NetEase Games, Palm Technology, Tencent Games, Ubisoft et UneeQ, etc.

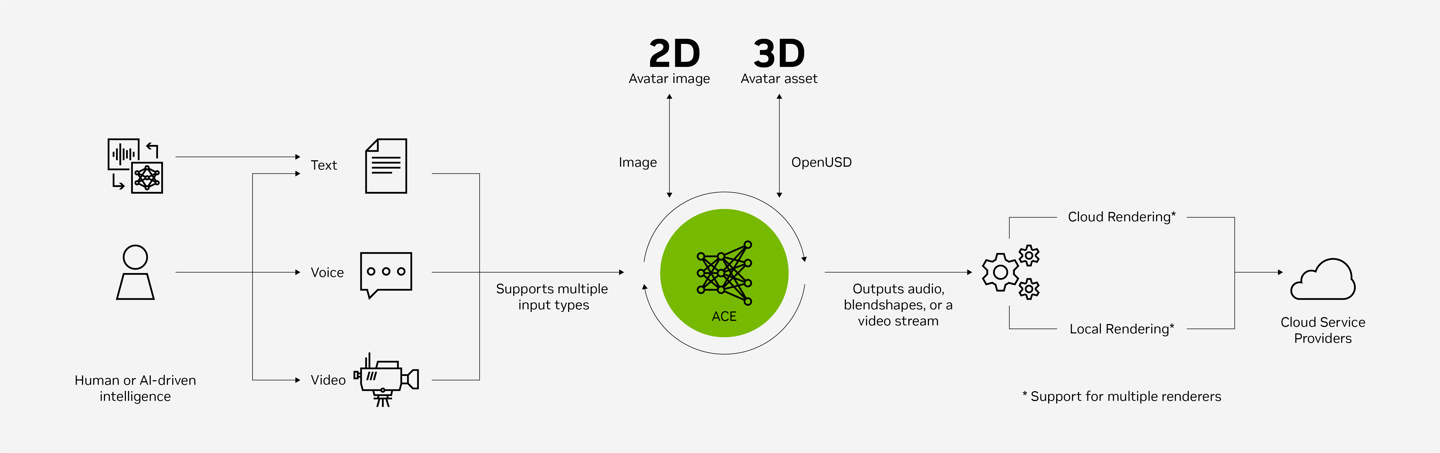

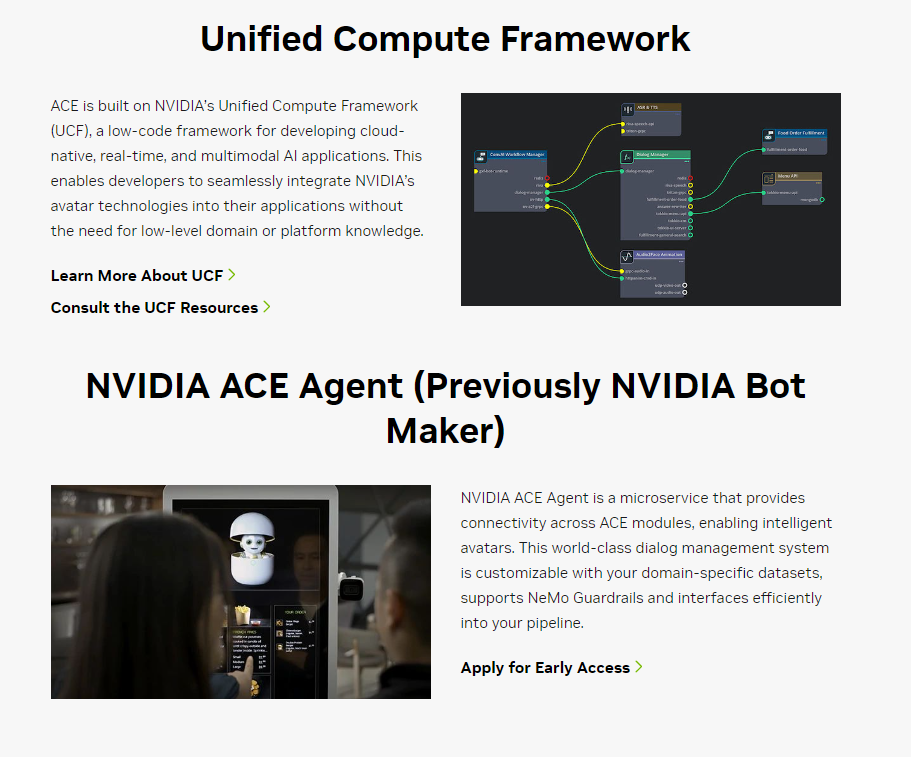

NVIDIA a déclaré qu'ACE est une API cloud composée de microservices personnalisés basés sur NVIDIA Unified Computing Framework, une plate-forme d'IA full-stack et la technologie NVIDIA RTX. Ces composants incluent des flux de travail d'IA spécifiques à un domaine et des outils low-code qui forment ensemble une suite complète de développement humain numérique.

Les développeurs peuvent exploiter les nouveaux microservices ACE, notamment des modèles d'IA tels que NVIDIA Audio2Face (A2F) et NVIDIA Riva Automatic Speech Recognition (ASR), pour créer des avatars numériques virtuels interactifs. Avec A2F, les sources sonores peuvent créer des animations faciales plus vives, tandis qu'avec ASR, les développeurs peuvent créer des applications vocales et de traduction multilingues personnalisées à utiliser avec des personnages numériques virtuels.

Ce site a également remarqué que NVIDIA a lancé les microservices de reconnaissance vocale automatique Audio2Face et Riva. Ces modèles offrent aux développeurs d'avatars interactifs la possibilité de les intégrer de manière transparente dans le processus de développement.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

L'application de grands modèles Tencent Yuanbao est en ligne ! Hunyuan est mis à niveau pour créer un assistant IA complet pouvant être transporté n'importe où

Jun 09, 2024 pm 10:38 PM

L'application de grands modèles Tencent Yuanbao est en ligne ! Hunyuan est mis à niveau pour créer un assistant IA complet pouvant être transporté n'importe où

Jun 09, 2024 pm 10:38 PM

Le 30 mai, Tencent a annoncé une mise à niveau complète de son modèle Hunyuan. L'application « Tencent Yuanbao » basée sur le modèle Hunyuan a été officiellement lancée et peut être téléchargée sur les magasins d'applications Apple et Android. Par rapport à la version de l'applet Hunyuan lors de la phase de test précédente, Tencent Yuanbao fournit des fonctionnalités de base telles que la recherche IA, le résumé IA et l'écriture IA pour les scénarios d'efficacité du travail ; pour les scénarios de la vie quotidienne, le gameplay de Yuanbao est également plus riche et fournit de multiples fonctionnalités d'application IA. , et de nouvelles méthodes de jeu telles que la création d'agents personnels sont ajoutées. « Tencent ne s'efforcera pas d'être le premier à créer un grand modèle. » Liu Yuhong, vice-président de Tencent Cloud et responsable du grand modèle Tencent Hunyuan, a déclaré : « Au cours de l'année écoulée, nous avons continué à promouvoir les capacités de Tencent. Grand modèle Tencent Hunyuan. Dans la technologie polonaise riche et massive dans des scénarios commerciaux tout en obtenant un aperçu des besoins réels des utilisateurs.

Le modèle de dialogue NVIDIA ChatQA a évolué vers la version 2.0, avec la longueur du contexte mentionnée à 128 Ko

Jul 26, 2024 am 08:40 AM

Le modèle de dialogue NVIDIA ChatQA a évolué vers la version 2.0, avec la longueur du contexte mentionnée à 128 Ko

Jul 26, 2024 am 08:40 AM

La communauté ouverte LLM est une époque où une centaine de fleurs fleurissent et s'affrontent. Vous pouvez voir Llama-3-70B-Instruct, QWen2-72B-Instruct, Nemotron-4-340B-Instruct, Mixtral-8x22BInstruct-v0.1 et bien d'autres. excellents interprètes. Cependant, par rapport aux grands modèles propriétaires représentés par le GPT-4-Turbo, les modèles ouverts présentent encore des lacunes importantes dans de nombreux domaines. En plus des modèles généraux, certains modèles ouverts spécialisés dans des domaines clés ont été développés, tels que DeepSeek-Coder-V2 pour la programmation et les mathématiques, et InternVL pour les tâches de langage visuel.

« AI Factory » favorisera la refonte de l'ensemble de la pile logicielle, et NVIDIA fournit des conteneurs Llama3 NIM que les utilisateurs peuvent déployer

Jun 08, 2024 pm 07:25 PM

« AI Factory » favorisera la refonte de l'ensemble de la pile logicielle, et NVIDIA fournit des conteneurs Llama3 NIM que les utilisateurs peuvent déployer

Jun 08, 2024 pm 07:25 PM

Selon les informations de ce site le 2 juin, lors du discours d'ouverture du Huang Renxun 2024 Taipei Computex, Huang Renxun a présenté que l'intelligence artificielle générative favoriserait la refonte de l'ensemble de la pile logicielle et a démontré ses microservices cloud natifs NIM (Nvidia Inference Microservices). . Nvidia estime que « l'usine IA » déclenchera une nouvelle révolution industrielle : en prenant comme exemple l'industrie du logiciel lancée par Microsoft, Huang Renxun estime que l'intelligence artificielle générative favorisera sa refonte complète. Pour faciliter le déploiement de services d'IA par les entreprises de toutes tailles, NVIDIA a lancé les microservices cloud natifs NIM (Nvidia Inference Microservices) en mars de cette année. NIM+ est une suite de microservices cloud natifs optimisés pour réduire les délais de commercialisation

NetEase a annoncé la suspension de 'Marvel Super War', qui était le premier jeu MOBA de Marvel !

Apr 18, 2024 am 10:50 AM

NetEase a annoncé la suspension de 'Marvel Super War', qui était le premier jeu MOBA de Marvel !

Apr 18, 2024 am 10:50 AM

"Marvel Super War" de NetEase a annoncé qu'il mettrait fin à ses opérations et fermerait le serveur de jeu à 15h00 le 17 juin 2024. L'entrée de téléchargement pour toutes les plateformes est désormais fermée, et le rechargement des jeux et l'enregistrement de nouveaux utilisateurs ont été arrêtés. En tant que premier jeu mobile MOBA de Marvel, ce jeu affiche de manière authentique les caractéristiques de combat des super-héros et restaure la grande vision du monde de l'univers Marvel. Dans le jeu, vous pourrez vous rassembler dans l'univers parallèle avec les Avengers, les X-Men, les Quatre Fantastiques et de nombreux super-héros et super-méchants, et rivaliser avec Iron Man, Captain America, Spider-Man, Loki, Thanos, Deadpool Attendez. pour que plus de 60 personnages classiques de Marvel combattent ensemble !

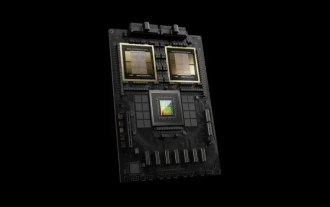

TrendForce : les produits de la plate-forme Blackwell de Nvidia permettent d'augmenter la capacité de production CoWoS de TSMC de 150 % cette année

Apr 17, 2024 pm 08:00 PM

TrendForce : les produits de la plate-forme Blackwell de Nvidia permettent d'augmenter la capacité de production CoWoS de TSMC de 150 % cette année

Apr 17, 2024 pm 08:00 PM

Selon les informations de ce site du 17 avril, TrendForce a récemment publié un rapport estimant que la demande pour les nouveaux produits de la plate-forme Blackwell de Nvidia est haussière et devrait entraîner une augmentation de la capacité totale de production d'emballages CoWoS de TSMC de plus de 150 % en 2024. Les nouveaux produits de la plate-forme Blackwell de NVIDIA comprennent des GPU de série B et des cartes accélératrices GB200 intégrant le propre processeur GraceArm de NVIDIA. TrendForce confirme que la chaîne d'approvisionnement est actuellement très optimiste quant au GB200. On estime que les livraisons en 2025 devraient dépasser le million d'unités, représentant 40 à 50 % des GPU haut de gamme de Nvidia. Nvidia prévoit de livrer des produits tels que le GB200 et le B100 au second semestre, mais le conditionnement des plaquettes en amont doit encore adopter des produits plus complexes.

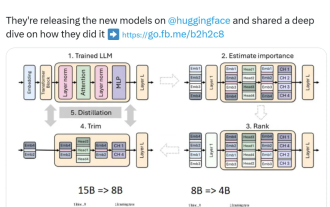

Nvidia joue avec l'élagage et la distillation : réduisant de moitié les paramètres de Llama 3.1 8B pour obtenir de meilleures performances avec la même taille

Aug 16, 2024 pm 04:42 PM

Nvidia joue avec l'élagage et la distillation : réduisant de moitié les paramètres de Llama 3.1 8B pour obtenir de meilleures performances avec la même taille

Aug 16, 2024 pm 04:42 PM

L’essor des petits modèles. Le mois dernier, Meta a publié la série de modèles Llama3.1, qui comprend le plus grand modèle Meta à ce jour, le modèle 405B, et deux modèles plus petits avec respectivement 70 milliards et 8 milliards de paramètres. Llama3.1 est considéré comme inaugurant une nouvelle ère de l'open source. Cependant, bien que les modèles de nouvelle génération soient puissants en termes de performances, ils nécessitent néanmoins une grande quantité de ressources informatiques lors de leur déploiement. Par conséquent, une autre tendance est apparue dans l’industrie, qui consiste à développer des petits modèles de langage (SLM) qui fonctionnent suffisamment bien dans de nombreuses tâches linguistiques et sont également très peu coûteux à déployer. Récemment, des recherches de NVIDIA ont montré qu'un élagage structuré combiné à une distillation des connaissances permet d'obtenir progressivement des modèles de langage plus petits à partir d'un modèle initialement plus grand. Lauréat du prix Turing, Meta Chief A

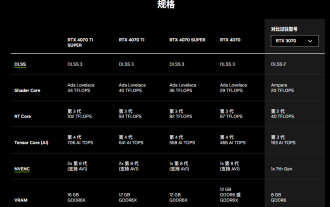

Conforme à la spécification NVIDIA SFF-Ready, ASUS lance les cartes graphiques Prime GeForce RTX série 40

Jun 15, 2024 pm 04:38 PM

Conforme à la spécification NVIDIA SFF-Ready, ASUS lance les cartes graphiques Prime GeForce RTX série 40

Jun 15, 2024 pm 04:38 PM

Selon les informations de ce site du 15 juin, Asus a récemment lancé la carte graphique GeForce RTX40 "Ada" de la série Prime. Sa taille est conforme à la dernière spécification SFF-Ready de Nvidia, qui exige que la taille de la carte graphique ne dépasse pas 304. mm x 151 mm x 50 mm (longueur x hauteur x épaisseur). La série Prime GeForceRTX40 lancée par ASUS comprend cette fois RTX4060Ti, RTX4070 et RTX4070SUPER, mais elle n'inclut actuellement pas RTX4070TiSUPER ou RTX4080SUPER. Cette série de cartes graphiques RTX40 adopte une conception de circuit imprimé commune avec des dimensions de 269 mm x 120 mm x 50 mm. Les principales différences entre les trois cartes graphiques sont.

Nvidia lance la version mémoire GDDR6 de la carte graphique GeForce RTX 4070, disponible à partir de septembre

Aug 21, 2024 am 07:31 AM

Nvidia lance la version mémoire GDDR6 de la carte graphique GeForce RTX 4070, disponible à partir de septembre

Aug 21, 2024 am 07:31 AM

Selon les informations de ce site du 20 août, plusieurs sources ont rapporté en juillet que les cartes graphiques Nvidia RTX4070 et supérieures seraient en pénurie en août en raison du manque de mémoire vidéo GDDR6X. Par la suite, des spéculations se sont répandues sur Internet concernant le lancement d'une version mémoire GDDR6 de la carte graphique RTX4070. Comme indiqué précédemment par ce site, Nvidia a publié aujourd'hui le pilote GameReady pour "Black Myth : Wukong" et "Star Wars : Outlaws". Parallèlement, le communiqué de presse mentionnait également la sortie de la version mémoire vidéo GDDR6 de la GeForce RTX4070. Nvidia a déclaré que les spécifications du nouveau RTX4070 autres que la mémoire vidéo resteront inchangées (bien sûr, il continuera également à maintenir le prix de 4 799 yuans), offrant des performances similaires à la version originale dans les jeux et les applications, et que des produits associés seront lancés. depuis