Périphériques technologiques

Périphériques technologiques

IA

IA

La stratégie innovante de « méta-astuce » de l'équipe Byte Fudan a amélioré les performances de compréhension des images du modèle de diffusion, atteignant un niveau sans précédent !

La stratégie innovante de « méta-astuce » de l'équipe Byte Fudan a amélioré les performances de compréhension des images du modèle de diffusion, atteignant un niveau sans précédent !

La stratégie innovante de « méta-astuce » de l'équipe Byte Fudan a amélioré les performances de compréhension des images du modèle de diffusion, atteignant un niveau sans précédent !

Le modèle de diffusion texte-image (T2I) excelle dans la génération d'images haute définition grâce à son pré-entraînement sur des paires image-texte à grande échelle.

Cela nous amène à une question naturelle : les modèles de diffusion peuvent-ils être utilisés pour résoudre des tâches de perception visuelle ?

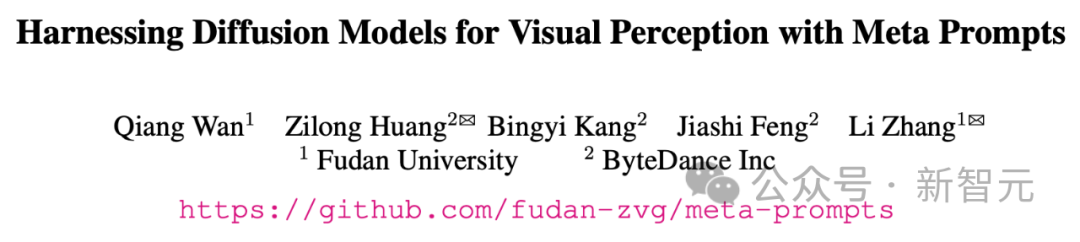

Récemment, des équipes de ByteDance et de l'Université de Fudan ont proposé un modèle de diffusion pour gérer les tâches visuelles.

Adresse papier : https://arxiv.org/abs/2312.14733

Projet open source : https://github.com/fudan-zvg/meta-prompts

La clé pour l'équipe Insight est l'introduction de méta-indices apprenables dans des modèles de diffusion pré-entraînés pour extraire des fonctionnalités adaptées à des tâches de perception spécifiques.

Introduction technique

L'équipe applique le modèle de diffusion texte-image comme extracteur de fonctionnalités aux tâches de perception visuelle.

Tout d'abord, l'image d'entrée est compressée par l'encodeur VQVAE, la résolution est réduite à 1/8 de la taille d'origine et une représentation des caractéristiques de l'espace latent est générée. Il est à noter que les paramètres du codeur VQVAE sont fixes et ne participent pas à la formation ultérieure.

L'étape suivante consiste à envoyer les données sans bruit supplémentaire à UNet pour l'extraction des fonctionnalités. Pour mieux s'adapter aux différentes tâches, UNet reçoit simultanément des intégrations de pas de temps modulés et plusieurs méta-repères pour générer des caractéristiques de forme cohérente.

Pendant tout le processus, afin d'améliorer l'expression des caractéristiques, cette méthode effectue des affinements répétés. Cela permet une meilleure fusion interactive des fonctionnalités de différentes couches au sein d'UNet. Dans le deuxième cycle, les paramètres d'UNet sont ajustés par des fonctionnalités de modulation temporelle spécifiques apprenables.

Enfin, les fonctionnalités multi-échelles générées par UNet sont entrées dans un décodeur spécialement conçu pour la tâche de vision cible.

Conception de méta-invites apprenables

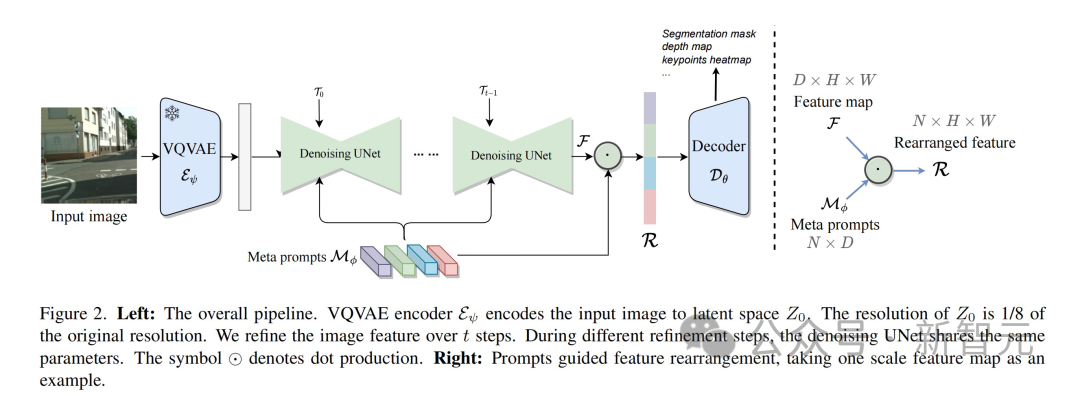

Le modèle de diffusion stable adopte l'architecture UNet pour intégrer des invites de texte dans les caractéristiques de l'image grâce à une attention croisée, réalisant ainsi un graphique vincentien. Cette intégration garantit que la génération d’images est contextuellement et sémantiquement précise.

Cependant, la diversité des tâches de perception visuelle va au-delà de cette catégorie, car la compréhension des images est confrontée à différents défis et manque souvent d'informations textuelles comme guide, ce qui rend les méthodes basées sur le texte parfois peu pratiques.

Pour relever ce défi, l'approche de l'équipe technique adopte une stratégie plus diversifiée : au lieu de s'appuyer sur des invites textuelles externes, nous concevons des méta-invites internes apprenables appelées méta-invites. Ces méta-invites sont intégrées dans les modèles de diffusion pour s'adapter. aux tâches de perception.

Les méta-invites sont exprimées sous la forme d'une matrice, qui représente le nombre de méta-invites et représente la dimension. Les modèles de diffusion perceptuelle avec des méta-invites évitent le besoin d'invites de texte externes, telles que des étiquettes de catégorie d'ensemble de données ou des titres d'images, et ne nécessitent pas d'encodeur de texte pré-entraîné pour générer les invites de texte finales.

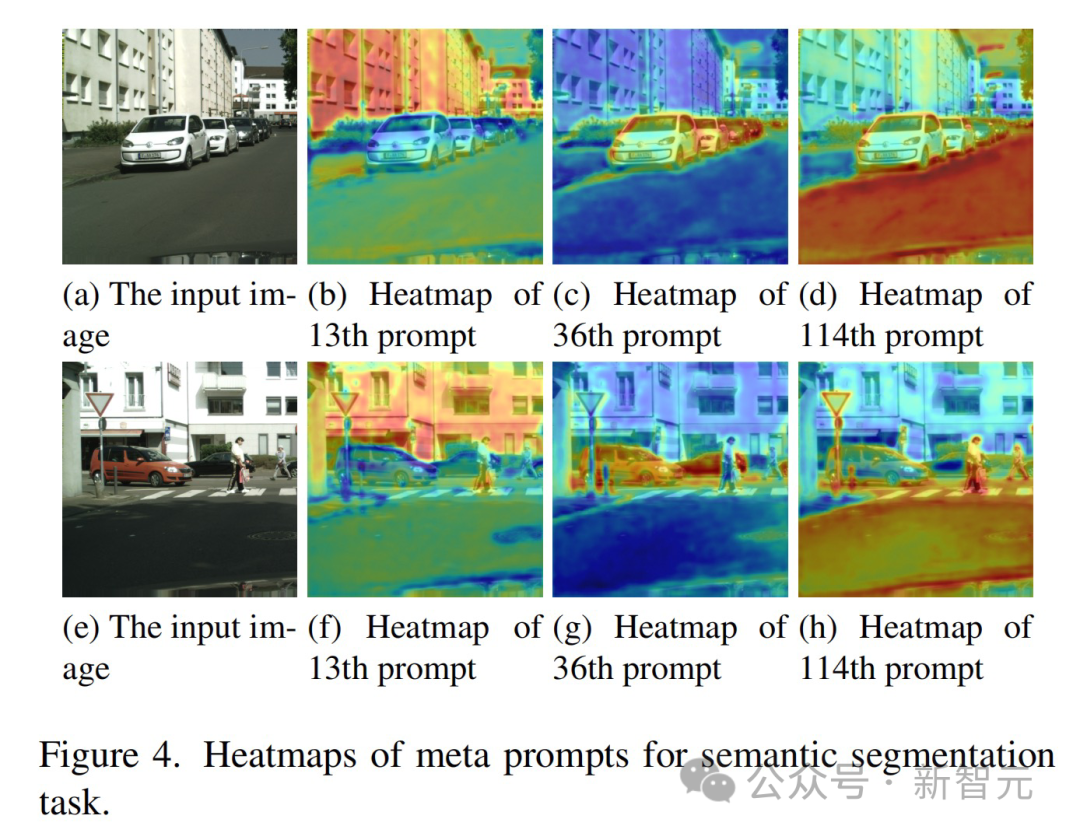

Les méta-invites peuvent être entraînées de bout en bout en fonction des tâches cibles et des ensembles de données afin d'établir des conditions d'adaptation spécialement personnalisées pour débruiter UNet. Ces méta-invites contiennent de riches informations sémantiques adaptées à des tâches spécifiques. Par exemple :

- Dans la tâche de segmentation sémantique, les méta-invites démontrent efficacement la capacité à identifier les catégories, et les mêmes méta-invites ont tendance à activer les fonctionnalités de la même catégorie.

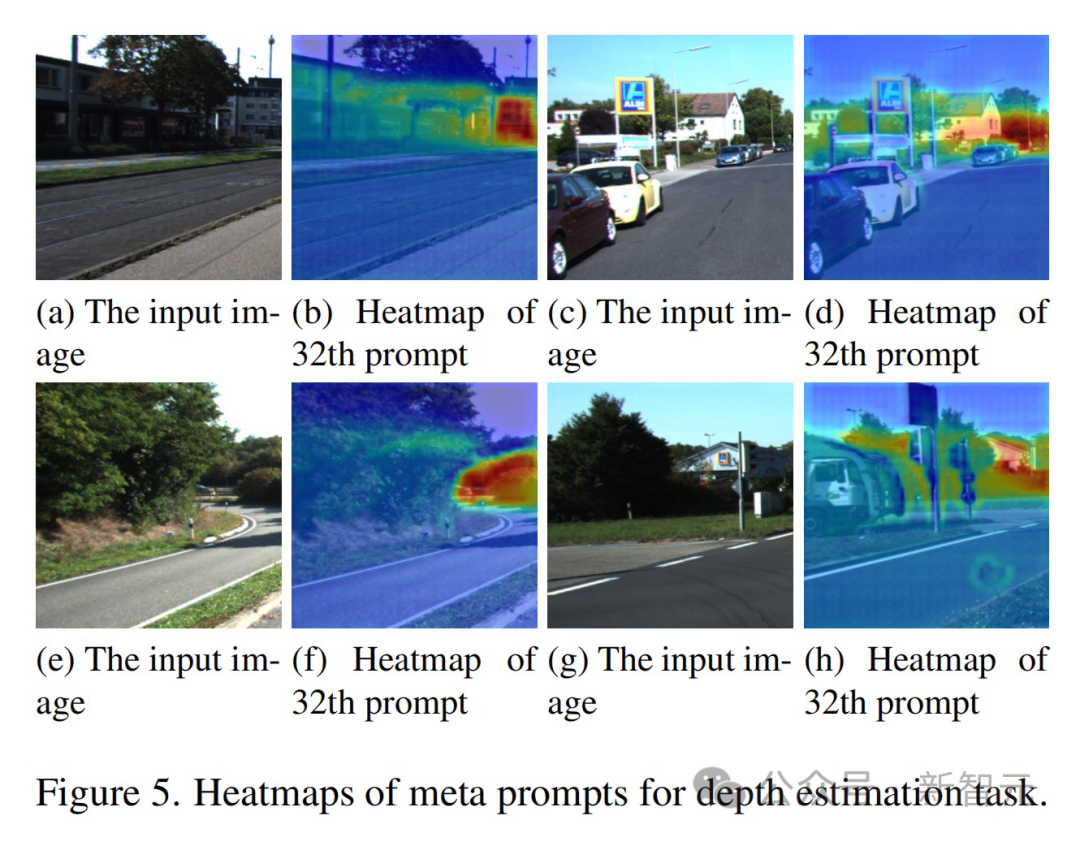

- Dans la tâche d'estimation de la profondeur, les méta-invites montrent la capacité de percevoir la profondeur, et la valeur d'activation change avec la profondeur, permettant aux invites de se concentrer sur des objets à la même distance.

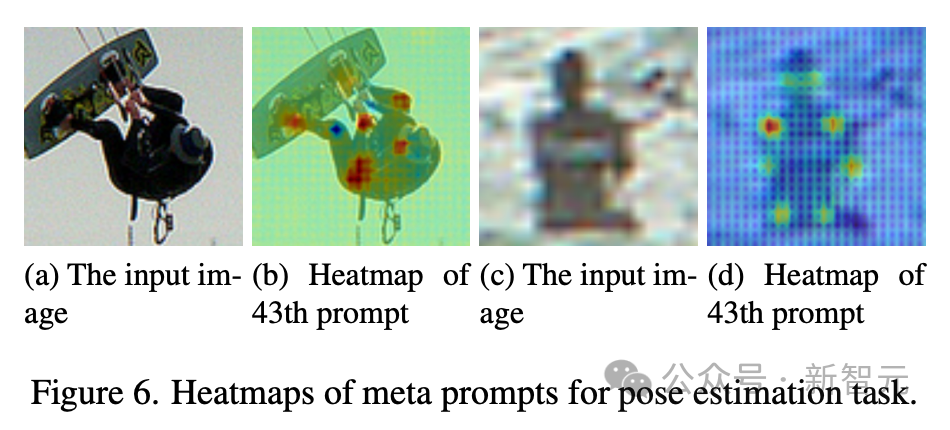

- Dans l'estimation de pose, les méta-invites présentent un ensemble différent de capacités, en particulier la perception des points clés, ce qui aide à la détection de pose humaine.

Ensemble, ces résultats qualitatifs mettent en évidence l'efficacité des méta-invites proposées par l'équipe technique pour activer les capacités liées à la tâche dans diverses tâches.

En tant qu'alternative aux invites textuelles, les méta-invites comblent bien le fossé entre les modèles de diffusion texte-image et les tâches de perception visuelle.

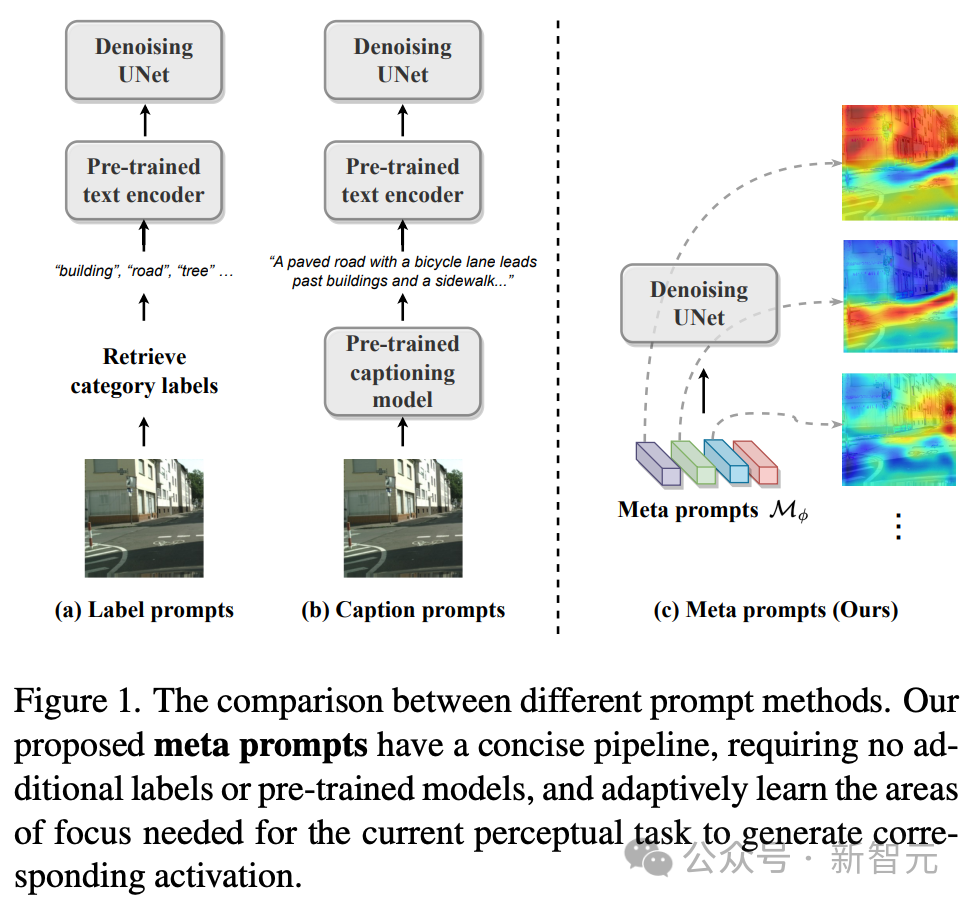

Réorganisation des fonctionnalités basée sur les méta-repères

Le modèle de diffusion, grâce à sa conception inhérente, génère des fonctionnalités multi-échelles dans le débruitage UNet, qui se concentrent sur des informations détaillées plus fines et de bas niveau à l'approche de la couche de sortie.

Bien que ces détails de bas niveau soient suffisants pour les tâches qui mettent l'accent sur la texture et la finesse, les tâches de perception visuelle nécessitent souvent de comprendre un contenu qui inclut à la fois des détails de bas niveau et une interprétation sémantique de haut niveau.

Par conséquent, non seulement il faut générer des fonctionnalités riches, mais il est également très important de déterminer quelle combinaison de ces fonctionnalités multi-échelles peut fournir la meilleure représentation de la tâche en cours.

C'est là qu'interviennent les méta-invites -

Ces invites préservent les connaissances contextuelles spécifiques à l'ensemble de données utilisé pendant la formation. Cette connaissance contextuelle permet aux méta-invites d'agir comme des filtres pour la recombinaison des fonctionnalités, guidant le processus de sélection des fonctionnalités et filtrant les fonctionnalités les plus pertinentes pour la tâche parmi les nombreuses fonctionnalités générées par UNet.

L'équipe utilise une approche de produit scalaire pour combiner la richesse des fonctionnalités multi-échelles d'UNet avec l'adaptabilité des tâches des méta-invites.

Considérez les fonctionnalités multi-échelles, chacune d'elles. et représentent la hauteur et la largeur de la carte des caractéristiques. Méta-invites. Les caractéristiques réorganisées à chaque échelle sont calculées comme suit :

Enfin, ces caractéristiques filtrées par des méta-invites sont ensuite entrées dans un décodeur spécifique à la tâche.

Raffinement récurrent basé sur des fonctionnalités de modulation temporelle apprenables

Dans le modèle de diffusion, le processus itératif d'ajout de bruit puis de débruitage en plusieurs étapes constitue le cadre de génération d'images.

Inspirée par ce mécanisme, l'équipe technique a conçu un processus de raffinement récurrent simple pour les tâches de perception visuelle : au lieu d'ajouter du bruit aux fonctionnalités de sortie, les fonctionnalités de sortie d'UNet sont directement entrées dans UNet en boucle.

Dans le même temps, afin de résoudre le problème incohérent selon lequel, lorsque le modèle passe dans la boucle, la distribution des caractéristiques d'entrée change mais les paramètres d'UNet restent inchangés, l'équipe technique a introduit des intégrations de pas de temps apprenables et uniques pour chaque boucle pour moduler les paramètres UNet.

Cela garantit que le réseau reste adaptable et réactif à la variabilité des caractéristiques d'entrée à différentes étapes, optimise le processus d'extraction de caractéristiques et améliore les performances du modèle dans les tâches de reconnaissance visuelle.

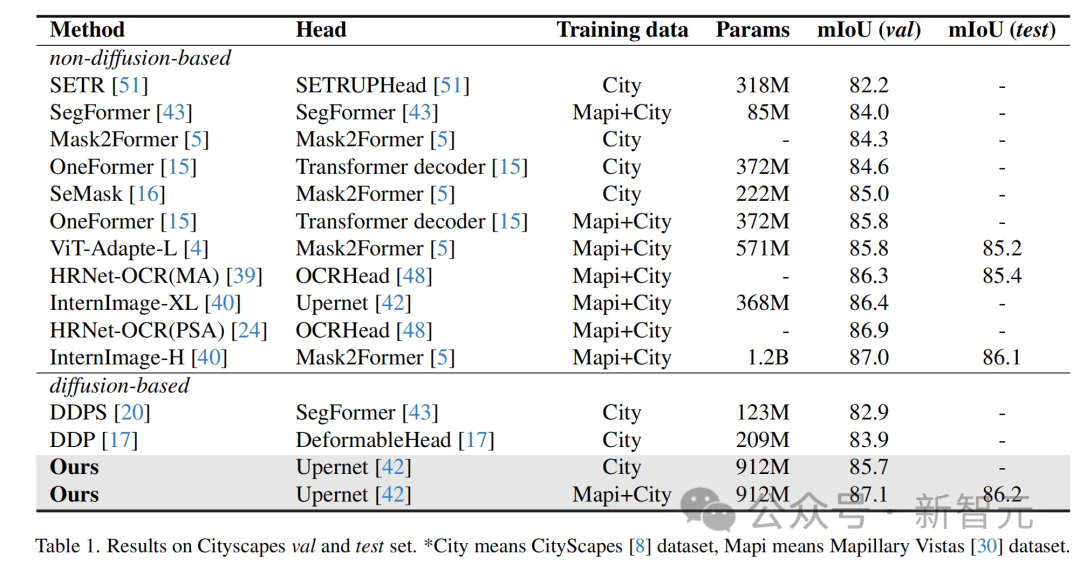

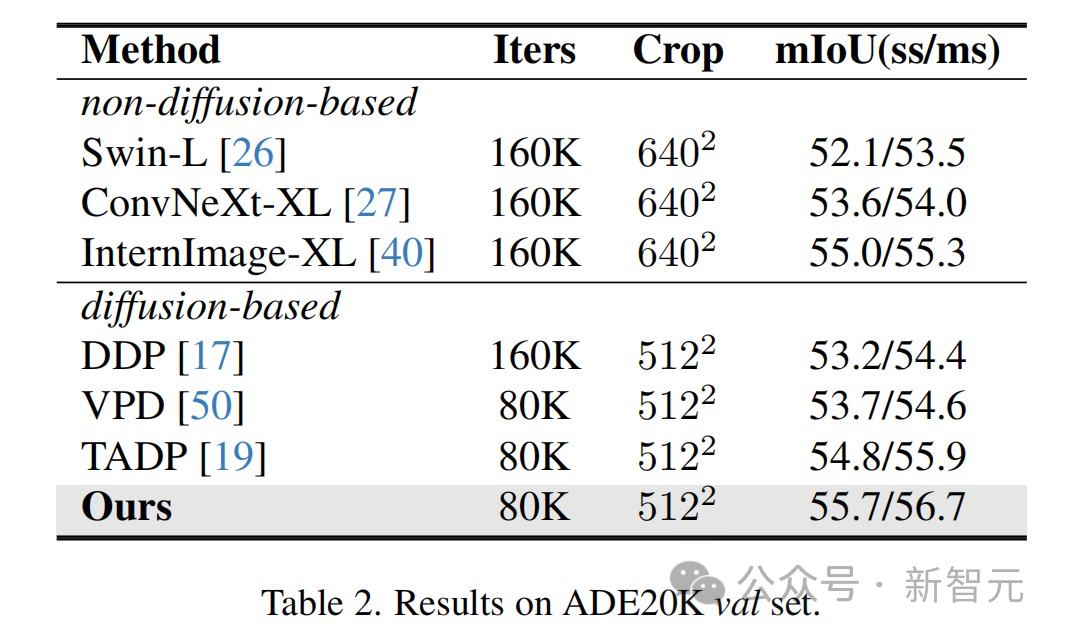

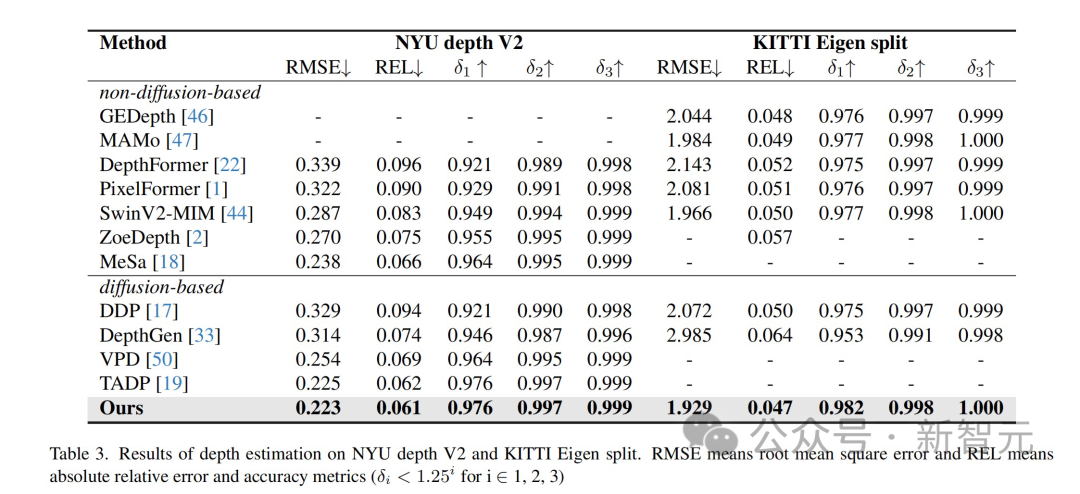

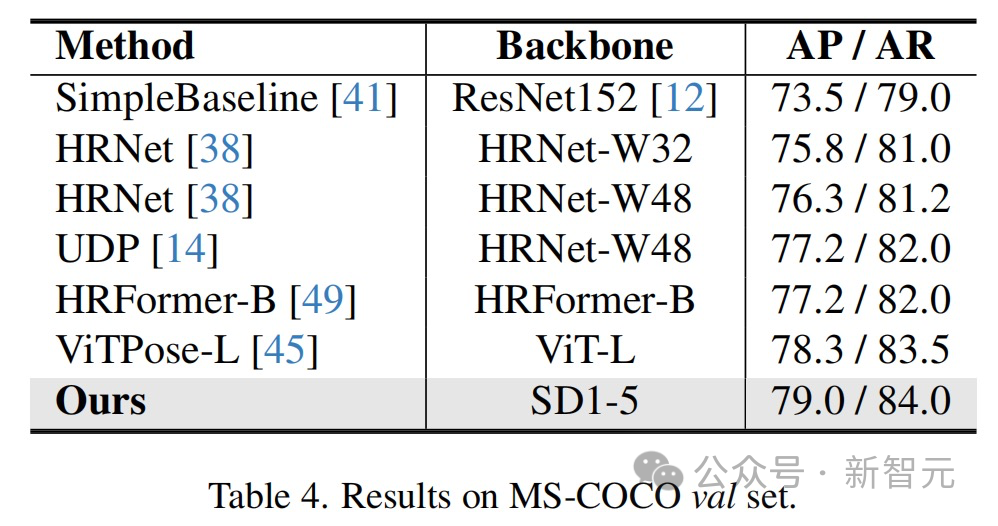

Les résultats montrent que cette méthode a obtenu des résultats optimaux sur plusieurs ensembles de données de tâches de perception.

Mise en œuvre et perspectives d'application

Les méthodes et technologies proposées dans cet article ont de larges perspectives d'application et peuvent promouvoir le développement technologique et l'innovation dans de multiples domaines :

- Améliorations des tâches de perception visuelle : Cette recherche peut améliorer les performances de diverses tâches de perception visuelle, telles que la segmentation d'images, l'estimation de la profondeur et l'estimation de la pose. Ces améliorations peuvent être appliquées à des domaines tels que la conduite autonome, l’analyse d’images médicales et les systèmes de vision robotisée.

- Modèles de vision par ordinateur améliorés : La technologie proposée peut rendre les modèles de vision par ordinateur plus précis et plus efficaces dans le traitement de scènes complexes, notamment en l'absence de descriptions textuelles explicites. Ceci est particulièrement important pour des applications telles que la compréhension du contenu des images.

- Applications interdisciplinaires : Les méthodes et les résultats de cette étude peuvent inspirer des recherches et des applications interdisciplinaires, comme dans la création artistique, la réalité virtuelle et la réalité augmentée, pour améliorer la qualité et l'interactivité des images et des vidéos. .

- Perspectives à long terme : Avec les progrès de la technologie, ces méthodes pourraient être encore améliorées, apportant une technologie de génération d'images et de compréhension de contenu plus avancée.

Présentation de l'équipe

L'équipe de création intelligente est le centre technologique d'IA et multimédia de ByteDance, couvrant la vision par ordinateur, le montage audio et vidéo, le traitement des effets spéciaux et d'autres domaines techniques, en s'appuyant sur les riches scénarios commerciaux, les ressources d'infrastructure et les techniques de l'entreprise. collaboration L'atmosphère réalise une boucle fermée de produits-systèmes d'ingénierie-algorithmes de pointe, visant à fournir aux activités internes de l'entreprise une compréhension de contenu, une création de contenu, une expérience interactive et des capacités de consommation ainsi que des solutions industrielles de pointe sous diverses formes.

Actuellement, l'équipe de création intelligente a ouvert ses capacités techniques et ses services aux entreprises via Volcano Engine, une plateforme de services cloud appartenant à ByteDance. D'autres postes liés aux algorithmes de grands modèles sont ouverts, veuillez cliquer sur 「Lire le texte original」 pour voir.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Open source! Au-delà de ZoeDepth ! DepthFM : estimation rapide et précise de la profondeur monoculaire !

Apr 03, 2024 pm 12:04 PM

Open source! Au-delà de ZoeDepth ! DepthFM : estimation rapide et précise de la profondeur monoculaire !

Apr 03, 2024 pm 12:04 PM

0. À quoi sert cet article ? Nous proposons DepthFM : un modèle d'estimation de profondeur monoculaire génératif de pointe, polyvalent et rapide. En plus des tâches traditionnelles d'estimation de la profondeur, DepthFM démontre également des capacités de pointe dans les tâches en aval telles que l'inpainting en profondeur. DepthFM est efficace et peut synthétiser des cartes de profondeur en quelques étapes d'inférence. Lisons ce travail ensemble ~ 1. Titre des informations sur l'article : DepthFM : FastMonocularDepthEstimationwithFlowMatching Auteur : MingGui, JohannesS.Fischer, UlrichPrestel, PingchuanMa, Dmytr

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Imaginez un modèle d'intelligence artificielle qui non seulement a la capacité de surpasser l'informatique traditionnelle, mais qui permet également d'obtenir des performances plus efficaces à moindre coût. Ce n'est pas de la science-fiction, DeepSeek-V2[1], le modèle MoE open source le plus puissant au monde est ici. DeepSeek-V2 est un puissant mélange de modèle de langage d'experts (MoE) présentant les caractéristiques d'une formation économique et d'une inférence efficace. Il est constitué de 236B paramètres, dont 21B servent à activer chaque marqueur. Par rapport à DeepSeek67B, DeepSeek-V2 offre des performances plus élevées, tout en économisant 42,5 % des coûts de formation, en réduisant le cache KV de 93,3 % et en augmentant le débit de génération maximal à 5,76 fois. DeepSeek est une entreprise explorant l'intelligence artificielle générale

L'IA bouleverse la recherche mathématique ! Le lauréat de la médaille Fields et mathématicien sino-américain a dirigé 11 articles les mieux classés | Aimé par Terence Tao

Apr 09, 2024 am 11:52 AM

L'IA bouleverse la recherche mathématique ! Le lauréat de la médaille Fields et mathématicien sino-américain a dirigé 11 articles les mieux classés | Aimé par Terence Tao

Apr 09, 2024 am 11:52 AM

L’IA change effectivement les mathématiques. Récemment, Tao Zhexuan, qui a prêté une attention particulière à cette question, a transmis le dernier numéro du « Bulletin de l'American Mathematical Society » (Bulletin de l'American Mathematical Society). En se concentrant sur le thème « Les machines changeront-elles les mathématiques ? », de nombreux mathématiciens ont exprimé leurs opinions. L'ensemble du processus a été plein d'étincelles, intense et passionnant. L'auteur dispose d'une équipe solide, comprenant Akshay Venkatesh, lauréat de la médaille Fields, le mathématicien chinois Zheng Lejun, l'informaticien de l'Université de New York Ernest Davis et de nombreux autres universitaires bien connus du secteur. Le monde de l’IA a radicalement changé. Vous savez, bon nombre de ces articles ont été soumis il y a un an.

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas entre officiellement dans l’ère des robots électriques ! Hier, l'Atlas hydraulique s'est retiré "en larmes" de la scène de l'histoire. Aujourd'hui, Boston Dynamics a annoncé que l'Atlas électrique était au travail. Il semble que dans le domaine des robots humanoïdes commerciaux, Boston Dynamics soit déterminé à concurrencer Tesla. Après la sortie de la nouvelle vidéo, elle a déjà été visionnée par plus d’un million de personnes en seulement dix heures. Les personnes âgées partent et de nouveaux rôles apparaissent. C'est une nécessité historique. Il ne fait aucun doute que cette année est l’année explosive des robots humanoïdes. Les internautes ont commenté : Les progrès des robots ont fait ressembler la cérémonie d'ouverture de cette année à des êtres humains, et le degré de liberté est bien plus grand que celui des humains. Mais n'est-ce vraiment pas un film d'horreur ? Au début de la vidéo, Atlas est allongé calmement sur le sol, apparemment sur le dos. Ce qui suit est à couper le souffle

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

Plus tôt ce mois-ci, des chercheurs du MIT et d'autres institutions ont proposé une alternative très prometteuse au MLP – KAN. KAN surpasse MLP en termes de précision et d’interprétabilité. Et il peut surpasser le MLP fonctionnant avec un plus grand nombre de paramètres avec un très petit nombre de paramètres. Par exemple, les auteurs ont déclaré avoir utilisé KAN pour reproduire les résultats de DeepMind avec un réseau plus petit et un degré d'automatisation plus élevé. Plus précisément, le MLP de DeepMind compte environ 300 000 paramètres, tandis que le KAN n'en compte qu'environ 200. KAN a une base mathématique solide comme MLP est basé sur le théorème d'approximation universelle, tandis que KAN est basé sur le théorème de représentation de Kolmogorov-Arnold. Comme le montre la figure ci-dessous, KAN a

La vitalité de la super intelligence s'éveille ! Mais avec l'arrivée de l'IA qui se met à jour automatiquement, les mères n'ont plus à se soucier des goulots d'étranglement des données.

Apr 29, 2024 pm 06:55 PM

La vitalité de la super intelligence s'éveille ! Mais avec l'arrivée de l'IA qui se met à jour automatiquement, les mères n'ont plus à se soucier des goulots d'étranglement des données.

Apr 29, 2024 pm 06:55 PM

Je pleure à mort. Le monde construit à la folie de grands modèles. Les données sur Internet ne suffisent pas du tout. Le modèle de formation ressemble à « The Hunger Games », et les chercheurs en IA du monde entier se demandent comment nourrir ces personnes avides de données. Ce problème est particulièrement important dans les tâches multimodales. À une époque où rien ne pouvait être fait, une équipe de start-up du département de l'Université Renmin de Chine a utilisé son propre nouveau modèle pour devenir la première en Chine à faire de « l'auto-alimentation des données générées par le modèle » une réalité. De plus, il s’agit d’une approche à deux volets, du côté compréhension et du côté génération, les deux côtés peuvent générer de nouvelles données multimodales de haute qualité et fournir un retour de données au modèle lui-même. Qu'est-ce qu'un modèle ? Awaker 1.0, un grand modèle multimodal qui vient d'apparaître sur le Forum Zhongguancun. Qui est l'équipe ? Moteur Sophon. Fondé par Gao Yizhao, doctorant à la Hillhouse School of Artificial Intelligence de l’Université Renmin.

La version Kuaishou de Sora 'Ke Ling' est ouverte aux tests : génère plus de 120 s de vidéo, comprend mieux la physique et peut modéliser avec précision des mouvements complexes

Jun 11, 2024 am 09:51 AM

La version Kuaishou de Sora 'Ke Ling' est ouverte aux tests : génère plus de 120 s de vidéo, comprend mieux la physique et peut modéliser avec précision des mouvements complexes

Jun 11, 2024 am 09:51 AM

Quoi? Zootopie est-elle concrétisée par l’IA domestique ? Avec la vidéo est exposé un nouveau modèle de génération vidéo domestique à grande échelle appelé « Keling ». Sora utilise une voie technique similaire et combine un certain nombre d'innovations technologiques auto-développées pour produire des vidéos qui comportent non seulement des mouvements larges et raisonnables, mais qui simulent également les caractéristiques du monde physique et possèdent de fortes capacités de combinaison conceptuelle et d'imagination. Selon les données, Keling prend en charge la génération de vidéos ultra-longues allant jusqu'à 2 minutes à 30 ips, avec des résolutions allant jusqu'à 1080p, et prend en charge plusieurs formats d'image. Un autre point important est que Keling n'est pas une démo ou une démonstration de résultats vidéo publiée par le laboratoire, mais une application au niveau produit lancée par Kuaishou, un acteur leader dans le domaine de la vidéo courte. De plus, l'objectif principal est d'être pragmatique, de ne pas faire de chèques en blanc et de se mettre en ligne dès sa sortie. Le grand modèle de Ke Ling est déjà sorti à Kuaiying.

Les robots Tesla travaillent dans les usines, Musk : Le degré de liberté des mains atteindra 22 cette année !

May 06, 2024 pm 04:13 PM

Les robots Tesla travaillent dans les usines, Musk : Le degré de liberté des mains atteindra 22 cette année !

May 06, 2024 pm 04:13 PM

La dernière vidéo du robot Optimus de Tesla est sortie, et il peut déjà fonctionner en usine. À vitesse normale, il trie les batteries (les batteries 4680 de Tesla) comme ceci : Le responsable a également publié à quoi cela ressemble à une vitesse 20 fois supérieure - sur un petit "poste de travail", en sélectionnant et en sélectionnant et en sélectionnant : Cette fois, il est publié L'un des points forts de la vidéo est qu'Optimus réalise ce travail en usine, de manière totalement autonome, sans intervention humaine tout au long du processus. Et du point de vue d'Optimus, il peut également récupérer et placer la batterie tordue, en se concentrant sur la correction automatique des erreurs : concernant la main d'Optimus, le scientifique de NVIDIA Jim Fan a donné une évaluation élevée : la main d'Optimus est l'un des robots à cinq doigts du monde. le plus adroit. Ses mains ne sont pas seulement tactiles