Modèles et algorithmes basés sur un codage clairsemé

La représentation clairsemée est une méthode de représentation des données et de réduction de dimensionnalité, et est largement utilisée dans des domaines tels que la vision par ordinateur, le traitement du langage naturel et le traitement du signal. Cet article présentera des modèles et des algorithmes basés sur une représentation clairsemée, y compris le codage clairsemé, l'apprentissage de dictionnaire et les auto-encodeurs clairsemés. Grâce à une représentation clairsemée, nous pouvons capturer efficacement les caractéristiques importantes des données et réaliser un traitement et une analyse efficaces des données. Le principe de la représentation clairsemée est d'obtenir une compression des données et une réduction de la dimensionnalité en minimisant le coefficient de représentation clairsemée des données. Le codage clairsemé et l'apprentissage du dictionnaire sont des méthodes couramment utilisées dans la représentation clairsemée. Ils peuvent

1. Codage clairsemé

Le codage clairsemé est une méthode qui utilise la transformation linéaire pour représenter les données d'origine comme une combinaison linéaire d'un ensemble de données clairsemées. coefficients. Supposons qu’il existe un ensemble de vecteurs x et que nous voulons représenter x avec une combinaison linéaire d’un ensemble de vecteurs de base D, c’est-à-dire x=Dz, où z est le vecteur de coefficients. Afin de rendre z aussi clairsemé que possible, nous pouvons introduire un terme de régularisation L1, qui minimise la norme L1 de z. Ce problème d'optimisation peut être exprimé sous la forme suivante :

min||x-Dz||^2+λ||z||_1

Ce problème peut être résolu en utilisant des méthodes de résolution itératives telles que la descente de coordonnées ou méthode de descente de gradient, où ||.|| représente la norme vectorielle et λ est le paramètre de régularisation.

2. Apprentissage par dictionnaire

L'apprentissage par dictionnaire est une méthode d'apprentissage non supervisée qui vise à représenter des données en apprenant un ensemble de vecteurs de base. Différent du codage clairsemé, l’apprentissage par dictionnaire nécessite non seulement que le vecteur de coefficients z soit clairsemé, mais nécessite également que le dictionnaire D lui-même ait une certaine parcimonie. Le problème de l'apprentissage du dictionnaire peut être exprimé comme le problème d'optimisation suivant :

min||X-DZ||^2+λ||Z||_1+γ||D||_1

où X est la matrice de données, Z est la matrice des coefficients, λ et γ sont des paramètres de régularisation. Ce problème peut être résolu en utilisant la méthode du multiplicateur de direction alternée, c'est-à-dire en mettant à jour alternativement le dictionnaire D et la matrice de coefficients Z. Parmi eux, l'algorithme K-SVD peut être utilisé pour mettre à jour le dictionnaire D, qui optimise le dictionnaire D en mettant à jour de manière itérative chaque vecteur de base tout en maintenant la parcimonie de la matrice de coefficients Z.

3. Sparse Autoencoder

Sparse Autoencoder est une méthode basée sur un réseau neuronal qui utilise des auto-encodeurs pour apprendre des représentations clairsemées de données. L'auto-encodeur se compose d'un encodeur et d'un décodeur, où l'encodeur mappe les données d'entrée x à un vecteur caché h, et le décodeur mappe le vecteur caché h aux données reconstruites x'. L'auto-encodeur clairsemé ajoute une contrainte de parcimonie à l'encodeur, qui consiste à minimiser la norme L1 du vecteur caché h, provoquant ainsi que le vecteur caché h devienne clairsemé. Plus précisément, le problème d'optimisation de l'auto-encodeur clairsemé peut être exprimé comme suit :

min||x-x'||^2+λ||h||_1

où x' est les données reconstruites, λ est le paramètre de régularisation. Ce problème peut être résolu à l'aide de l'algorithme de rétropropagation, dans lequel des contraintes de parcimonie peuvent être ajoutées au codeur en ajoutant un terme de pénalité clairsemé.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

La différence entre les algorithmes de détection de cible à une étape et à deux étapes

Jan 23, 2024 pm 01:48 PM

La différence entre les algorithmes de détection de cible à une étape et à deux étapes

Jan 23, 2024 pm 01:48 PM

La détection d'objets est une tâche importante dans le domaine de la vision par ordinateur, utilisée pour identifier des objets dans des images ou des vidéos et localiser leur emplacement. Cette tâche est généralement divisée en deux catégories d'algorithmes, à une étape et à deux étapes, qui diffèrent en termes de précision et de robustesse. Algorithme de détection de cible en une seule étape L'algorithme de détection de cible en une seule étape convertit la détection de cible en un problème de classification. Son avantage est qu'il est rapide et peut terminer la détection en une seule étape. Cependant, en raison d'une simplification excessive, la précision n'est généralement pas aussi bonne que celle de l'algorithme de détection d'objets en deux étapes. Les algorithmes courants de détection d'objets en une seule étape incluent YOLO, SSD et FasterR-CNN. Ces algorithmes prennent généralement l’image entière en entrée et exécutent un classificateur pour identifier l’objet cible. Contrairement aux algorithmes traditionnels de détection de cibles en deux étapes, ils n'ont pas besoin de définir des zones à l'avance, mais de prédire directement

Comment utiliser la technologie IA pour restaurer d'anciennes photos (avec exemples et analyse de code)

Jan 24, 2024 pm 09:57 PM

Comment utiliser la technologie IA pour restaurer d'anciennes photos (avec exemples et analyse de code)

Jan 24, 2024 pm 09:57 PM

La restauration de photos anciennes est une méthode d'utilisation de la technologie de l'intelligence artificielle pour réparer, améliorer et améliorer de vieilles photos. Grâce à des algorithmes de vision par ordinateur et d’apprentissage automatique, la technologie peut identifier et réparer automatiquement les dommages et les imperfections des anciennes photos, les rendant ainsi plus claires, plus naturelles et plus réalistes. Les principes techniques de la restauration de photos anciennes incluent principalement les aspects suivants : 1. Débruitage et amélioration de l'image Lors de la restauration de photos anciennes, elles doivent d'abord être débruitées et améliorées. Des algorithmes et des filtres de traitement d'image, tels que le filtrage moyen, le filtrage gaussien, le filtrage bilatéral, etc., peuvent être utilisés pour résoudre les problèmes de bruit et de taches de couleur, améliorant ainsi la qualité des photos. 2. Restauration et réparation d'images Les anciennes photos peuvent présenter certains défauts et dommages, tels que des rayures, des fissures, une décoloration, etc. Ces problèmes peuvent être résolus par des algorithmes de restauration et de réparation d’images

Application de la technologie de l'IA à la reconstruction d'images en super-résolution

Jan 23, 2024 am 08:06 AM

Application de la technologie de l'IA à la reconstruction d'images en super-résolution

Jan 23, 2024 am 08:06 AM

La reconstruction d'images en super-résolution est le processus de génération d'images haute résolution à partir d'images basse résolution à l'aide de techniques d'apprentissage en profondeur, telles que les réseaux neuronaux convolutifs (CNN) et les réseaux contradictoires génératifs (GAN). Le but de cette méthode est d'améliorer la qualité et les détails des images en convertissant des images basse résolution en images haute résolution. Cette technologie trouve de nombreuses applications dans de nombreux domaines, comme l’imagerie médicale, les caméras de surveillance, les images satellites, etc. Grâce à la reconstruction d’images en super-résolution, nous pouvons obtenir des images plus claires et plus détaillées, ce qui permet d’analyser et d’identifier plus précisément les cibles et les caractéristiques des images. Méthodes de reconstruction Les méthodes de reconstruction d'images en super-résolution peuvent généralement être divisées en deux catégories : les méthodes basées sur l'interpolation et les méthodes basées sur l'apprentissage profond. 1) Méthode basée sur l'interpolation Reconstruction d'images en super-résolution basée sur l'interpolation

Algorithme SIFT (Scale Invariant Features)

Jan 22, 2024 pm 05:09 PM

Algorithme SIFT (Scale Invariant Features)

Jan 22, 2024 pm 05:09 PM

L'algorithme SIFT (Scale Invariant Feature Transform) est un algorithme d'extraction de caractéristiques utilisé dans les domaines du traitement d'images et de la vision par ordinateur. Cet algorithme a été proposé en 1999 pour améliorer les performances de reconnaissance et de correspondance d'objets dans les systèmes de vision par ordinateur. L'algorithme SIFT est robuste et précis et est largement utilisé dans la reconnaissance d'images, la reconstruction tridimensionnelle, la détection de cibles, le suivi vidéo et d'autres domaines. Il obtient l'invariance d'échelle en détectant les points clés dans plusieurs espaces d'échelle et en extrayant des descripteurs de caractéristiques locales autour des points clés. Les principales étapes de l'algorithme SIFT comprennent la construction d'un espace d'échelle, la détection des points clés, le positionnement des points clés, l'attribution de directions et la génération de descripteurs de caractéristiques. Grâce à ces étapes, l’algorithme SIFT peut extraire des fonctionnalités robustes et uniques, permettant ainsi un traitement d’image efficace.

Une introduction aux méthodes d'annotation d'images et aux scénarios d'application courants

Jan 22, 2024 pm 07:57 PM

Une introduction aux méthodes d'annotation d'images et aux scénarios d'application courants

Jan 22, 2024 pm 07:57 PM

Dans les domaines de l'apprentissage automatique et de la vision par ordinateur, l'annotation d'images est le processus d'application d'annotations humaines à des ensembles de données d'images. Les méthodes d’annotation d’images peuvent être principalement divisées en deux catégories : l’annotation manuelle et l’annotation automatique. L'annotation manuelle signifie que les annotateurs humains annotent les images via des opérations manuelles. Cette méthode nécessite que les annotateurs humains possèdent des connaissances et une expérience professionnelles et soient capables d'identifier et d'annoter avec précision les objets, scènes ou caractéristiques cibles dans les images. L’avantage de l’annotation manuelle est que les résultats de l’annotation sont fiables et précis, mais l’inconvénient est qu’elle prend du temps et est coûteuse. L'annotation automatique fait référence à la méthode d'utilisation de programmes informatiques pour annoter automatiquement les images. Cette méthode utilise la technologie d'apprentissage automatique et de vision par ordinateur pour réaliser une annotation automatique par des modèles de formation. Les avantages de l’étiquetage automatique sont la rapidité et le faible coût, mais l’inconvénient est que les résultats de l’étiquetage peuvent ne pas être précis.

Interprétation du concept de suivi de cible en vision par ordinateur

Jan 24, 2024 pm 03:18 PM

Interprétation du concept de suivi de cible en vision par ordinateur

Jan 24, 2024 pm 03:18 PM

Le suivi d'objets est une tâche importante en vision par ordinateur et est largement utilisé dans la surveillance du trafic, la robotique, l'imagerie médicale, le suivi automatique des véhicules et d'autres domaines. Il utilise des méthodes d'apprentissage profond pour prédire ou estimer la position de l'objet cible dans chaque image consécutive de la vidéo après avoir déterminé la position initiale de l'objet cible. Le suivi d'objets a un large éventail d'applications dans la vie réelle et revêt une grande importance dans le domaine de la vision par ordinateur. Le suivi d'objets implique généralement le processus de détection d'objets. Voici un bref aperçu des étapes de suivi des objets : 1. Détection d'objets, où l'algorithme classe et détecte les objets en créant des cadres de délimitation autour d'eux. 2. Attribuez une identification (ID) unique à chaque objet. 3. Suivez le mouvement des objets détectés dans des images tout en stockant les informations pertinentes. Types de cibles de suivi de cible

Exemples d'applications pratiques de la combinaison de fonctionnalités peu profondes et de fonctionnalités profondes

Jan 22, 2024 pm 05:00 PM

Exemples d'applications pratiques de la combinaison de fonctionnalités peu profondes et de fonctionnalités profondes

Jan 22, 2024 pm 05:00 PM

L'apprentissage profond a connu un grand succès dans le domaine de la vision par ordinateur, et l'une des avancées importantes est l'utilisation de réseaux neuronaux convolutifs profonds (CNN) pour la classification d'images. Cependant, les CNN profonds nécessitent généralement de grandes quantités de données étiquetées et de ressources informatiques. Afin de réduire la demande en ressources informatiques et en données étiquetées, les chercheurs ont commencé à étudier comment fusionner des caractéristiques superficielles et des caractéristiques profondes pour améliorer les performances de classification des images. Cette méthode de fusion peut tirer parti de la grande efficacité de calcul des entités superficielles et de la forte capacité de représentation des entités profondes. En combinant les deux, les coûts de calcul et les exigences d’étiquetage des données peuvent être réduits tout en conservant une grande précision de classification. Cette méthode est particulièrement importante pour les scénarios d’application dans lesquels la quantité de données est faible ou les ressources informatiques limitées. Par une étude approfondie de la méthode de fusion des entités peu profondes et des entités profondes, nous pouvons approfondir

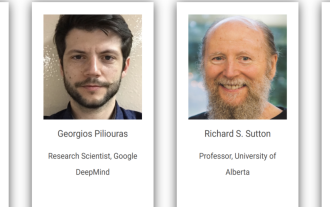

Conférence sur l'intelligence artificielle distribuée Appel à communications DAI 2024 : Agent Day, Richard Sutton, le père de l'apprentissage par renforcement, sera présent ! Yan Shuicheng, Sergey Levine et les scientifiques de DeepMind prononceront des discours d'ouverture

Aug 22, 2024 pm 08:02 PM

Conférence sur l'intelligence artificielle distribuée Appel à communications DAI 2024 : Agent Day, Richard Sutton, le père de l'apprentissage par renforcement, sera présent ! Yan Shuicheng, Sergey Levine et les scientifiques de DeepMind prononceront des discours d'ouverture

Aug 22, 2024 pm 08:02 PM

Introduction à la conférence Avec le développement rapide de la science et de la technologie, l'intelligence artificielle est devenue une force importante dans la promotion du progrès social. À notre époque, nous avons la chance d’être témoins et de participer à l’innovation et à l’application de l’intelligence artificielle distribuée (DAI). L’intelligence artificielle distribuée est une branche importante du domaine de l’intelligence artificielle, qui a attiré de plus en plus d’attention ces dernières années. Les agents basés sur de grands modèles de langage (LLM) ont soudainement émergé. En combinant les puissantes capacités de compréhension du langage et de génération des grands modèles, ils ont montré un grand potentiel en matière d'interaction en langage naturel, de raisonnement par connaissances, de planification de tâches, etc. AIAgent reprend le grand modèle de langage et est devenu un sujet brûlant dans le cercle actuel de l'IA. Au