Périphériques technologiques

Périphériques technologiques

IA

IA

Le MoE et Mamba collaborent pour adapter les modèles d'espace d'état à des milliards de paramètres

Le MoE et Mamba collaborent pour adapter les modèles d'espace d'état à des milliards de paramètres

Le MoE et Mamba collaborent pour adapter les modèles d'espace d'état à des milliards de paramètres

State Space Model (SSM) est une technologie qui a beaucoup attiré l'attention et est considérée comme une alternative à Transformer. Par rapport à Transformer, SSM peut réaliser un raisonnement temporel linéaire lors du traitement de tâches contextuelles longues, et dispose d'une formation parallèle et d'excellentes performances. En particulier, Mamba, qui est basé sur une conception SSM sélective et sensible au matériel, a montré des performances exceptionnelles et est devenu l'une des alternatives puissantes à l'architecture Transformer basée sur l'attention.

Récemment, les chercheurs explorent également la combinaison de SSM et Mamba avec d'autres méthodes pour créer des architectures plus puissantes. Par exemple, Machine Heart a rapporté un jour que « Mamba peut remplacer Transformer, mais ils peuvent également être utilisés en combinaison ».

Récemment, une équipe de recherche polonaise a découvert que si le SSM est combiné avec un système expert hybride (MoE/Mixture of Experts), le SSM peut atteindre une expansion à grande échelle. MoE est une technologie couramment utilisée pour étendre Transformer. Par exemple, le récent modèle Mixtral utilise cette technologie. Veuillez vous référer à l'article Heart of the Machine.

Le résultat de recherche donné par cette équipe de recherche polonaise est MoE-Mamba, un modèle qui combine Mamba et une couche experte hybride.

Adresse papier : https://arxiv.org/pdf/2401.04081.pdf

MoE-Mamba peut améliorer l'efficacité du SSM et du MoE en même temps. Et l’équipe a également constaté que le MoE-Mamba se comportait de manière prévisible lorsque le nombre d’experts variait.

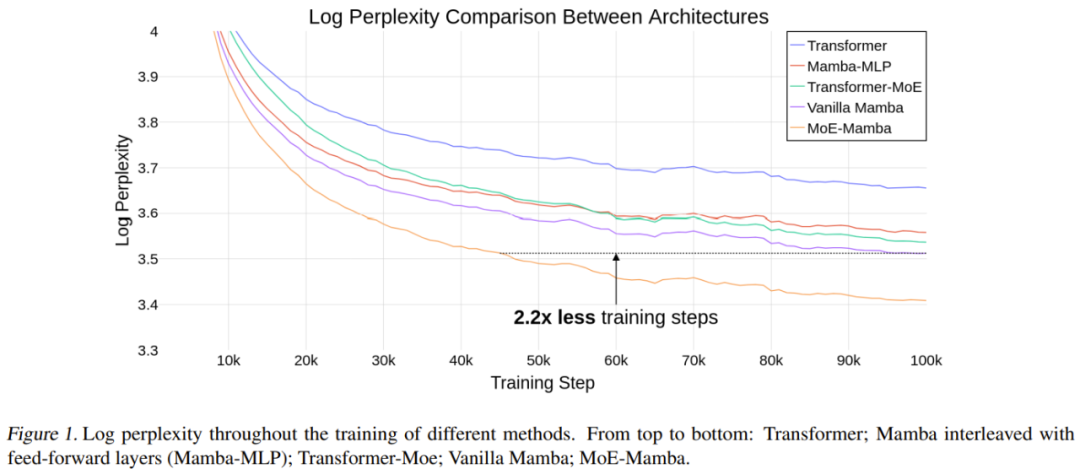

L'équipe a mené des démonstrations expérimentales et les résultats ont montré que par rapport à Mamba, MoE-Mamba nécessitait 2,2 fois moins d'étapes de formation avec les mêmes exigences de performances, démontrant les performances de la nouvelle méthode par rapport aux avantages potentiels de Transformer et Transformer-MoE. Ces résultats préliminaires laissent également entrevoir une direction de recherche prometteuse : le SSM pourrait être extensible à des dizaines de milliards de paramètres.

Recherche connexe

State Space Model

State Space Model (SSM) est un type d'architecture utilisé pour la modélisation de séquences. Les idées de ces modèles proviennent du domaine de la cybernétique et peuvent être considérées comme une combinaison de RNN et de CNN. Bien qu’ils présentent des avantages considérables, ils présentent également certains problèmes qui les empêchent de devenir l’architecture dominante pour les tâches de modélisation linguistique. Cependant, de récentes percées en recherche ont permis au SSM profond de s'adapter à des milliards de paramètres tout en conservant l'efficacité informatique et de solides performances.

Mamba

Mamba est un modèle construit sur SSM, qui peut atteindre une vitesse d'inférence temporelle linéaire (pour la longueur du contexte), et il réalise également un processus de formation efficace grâce à une conception sensible au matériel. Mamba utilise une approche d'analyse parallèle efficace qui atténue l'impact de la séquentialité des boucles, tandis que les opérations GPU fusionnées éliminent le besoin d'implémenter un état étendu. Les états intermédiaires nécessaires à la rétropropagation ne sont pas enregistrés mais sont recalculés lors du passage en arrière, réduisant ainsi les besoins en mémoire. L'avantage de Mamba sur le mécanisme d'attention est particulièrement significatif dans la phase d'inférence car non seulement il réduit la complexité de calcul, mais aussi l'utilisation de la mémoire ne dépend pas de la longueur du contexte.

Mamba peut résoudre le compromis fondamental entre l'efficience et l'efficacité des modèles de séquence, ce qui met en évidence l'importance de la compression d'état. Un modèle efficace doit nécessiter un petit état, et l'état requis par un modèle efficace doit contenir toutes les informations clés du contexte. Contrairement à d'autres SSM qui nécessitent une invariance temporelle et d'entrée, Mamba introduit un mécanisme de sélection qui contrôle la manière dont les informations se propagent le long de la dimension de la séquence. Ce choix de conception a été inspiré par une compréhension intuitive de tâches de synthèse de premier ordre telles que la réplication sélective et l'induction, permettant au modèle de discerner et de conserver les informations critiques tout en filtrant les informations non pertinentes.

Des recherches ont montré que Mamba a la capacité d'utiliser efficacement des contextes plus longs (jusqu'à 1 million de jetons), et à mesure que la longueur du contexte augmente, la perplexité préalable à l'entraînement s'améliorera également. Le modèle Mamba est composé de blocs Mamba empilés et a obtenu de très bons résultats dans de nombreux domaines différents tels que la PNL, la génomique, l'audio, etc. Ses performances sont comparables et dépassent le modèle Transformer existant. Par conséquent, Mamba est devenu un modèle candidat solide pour le modèle général de modélisation de séquence. Veuillez vous référer à "Un débit cinq fois supérieur, des performances complètes entourent Transformer : la nouvelle architecture Mamba fait exploser le cercle de l'IA". Les techniques d'experts mixtes (MoE) peuvent augmenter considérablement le nombre de paramètres du modèle sans affecter les FLOP requis pour l'inférence et la formation du modèle. MoE a été proposé pour la première fois par Jacobs et al. en 1991 et a commencé à être utilisé pour les tâches de PNL en 2017 par Shazeer et al.

MoE a un avantage : les activations sont très rares - pour chaque token traité, seule une petite partie des paramètres du modèle est utilisée. En raison de ses exigences informatiques, la couche avant du Transformer est devenue une cible standard pour plusieurs techniques MoE.

La communauté des chercheurs a proposé diverses méthodes pour résoudre le problème central du MoE, qui est le processus d'attribution de jetons aux experts, également connu sous le nom de processus de routage. Il existe actuellement deux algorithmes de routage de base : Token Choice et Expert Choice. Le premier achemine chaque jeton vers un certain nombre (K) d'experts, tandis que le second achemine un nombre fixe de jetons vers chaque expert.Fedus et al. ont proposé Switch dans l'article de 2022 "Switch transformers: Scaling to trillionparameter models with simple and efficient sparsity", qui est une architecture Token Choice qui achemine chaque jeton vers un seul expert ( K=1), et ils ont utilisé cette méthode pour étendre avec succès la taille des paramètres de Transformer à 1,6 billion. Cette équipe polonaise a également utilisé cette conception du MoE dans ses expériences.

Récemment, MoE a également commencé à entrer dans la communauté open source, comme OpenMoE.

Adresse du projet : https://github.com/XueFuzhao/OpenMoE

Il convient particulièrement de mentionner que le Mixtral 8×7B open source de Mistral a des performances comparables à LLaMa 2 70B, tout en nécessitant des calculs d'inférence. Le budget est seulement environ un sixième de cette dernière.

Architecture du modèle

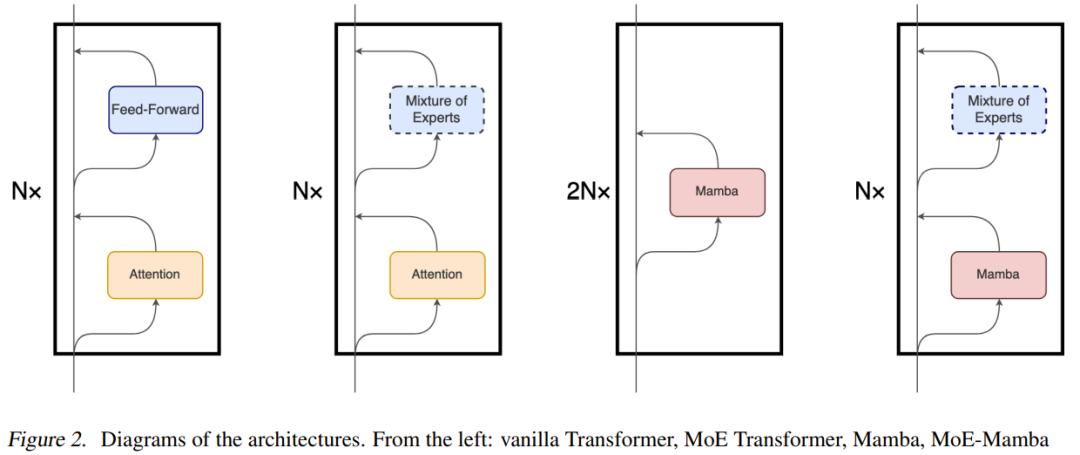

Bien que le principal mécanisme sous-jacent de Mamba soit assez différent du mécanisme d'attention utilisé dans Transformer, Mamba conserve la structure de haut niveau basée sur des modules du modèle Transformer. En utilisant ce paradigme, une ou plusieurs couches de modules identiques sont empilées les unes sur les autres et la sortie de chaque couche est ajoutée à un flux résiduel, voir Figure 2. La valeur finale de ce flux résiduel est ensuite utilisée pour prédire le prochain jeton pour la tâche de modélisation du langage.

MoE-Mamba profite de la compatibilité de ces deux architectures. Comme le montre la figure 2, dans MoE-Mamba, chaque couche Mamba d'intervalle est remplacée par une couche de rétroaction MoE basée sur Switch.

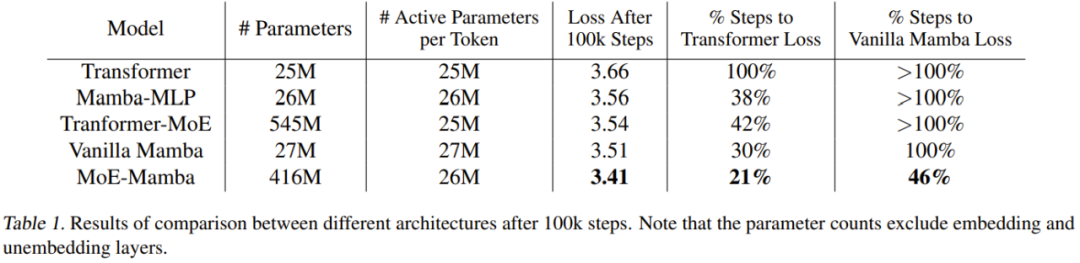

Cependant, l'équipe a également remarqué que cette conception est quelque peu similaire à la conception de "Mamba : modélisation de séquences temporelles linéaires avec des espaces d'états sélectifs" ; cette dernière empile alternativement des couches Mamba et des couches feedforward, mais le résultat est le même. Le modèle est légèrement inférieur au simple Mamba. Cette conception est désignée sous le nom de Mamba-MLP sur la figure 1.

MoE-Mamba sépare le traitement inconditionnel de chaque jeton effectué par la couche Mamba et le traitement conditionnel effectué par la couche MoE ; le traitement inconditionnel peut intégrer efficacement l'ensemble du contexte de la séquence dans une représentation interne, tandis que le traitement conditionnel Le traitement peut faire appel aux experts les plus pertinents pour chaque jeton. Cette idée d'alternance de traitement conditionnel et inconditionnel a été appliquée dans certains modèles basés sur MoE, mais ils alternent généralement les couches de base et de rétroaction MoE.

Configuration de la formation

L'équipe a comparé 5 configurations différentes : Basic Transformer, Mamba, Mamba-MLP, MoE et MoE-Mamba.

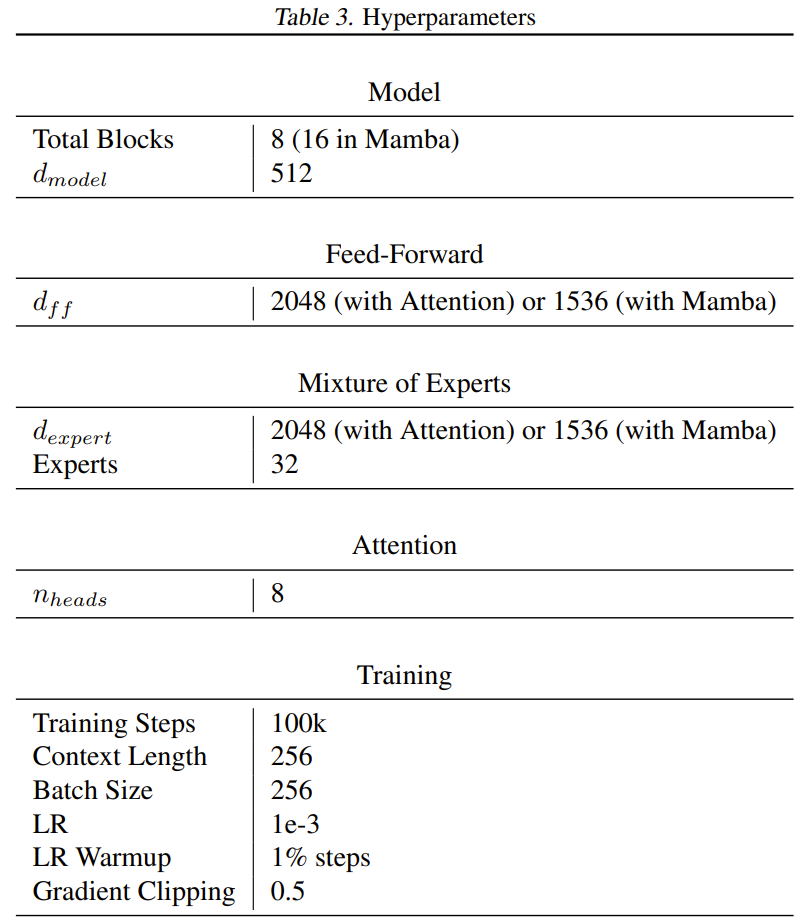

Dans la plupart des Transformers, la couche de rétroaction contient 8 dm² de paramètres, tandis que le papier Mamba rend Mamba plus petit (environ 6 dm²), de sorte que le nombre de paramètres de deux couches Mamba est le même qu'une couche de rétroaction et une couche d'attention. le même. Pour obtenir à peu près le même nombre de paramètres actifs par jeton dans Mamba et le nouveau modèle, l'équipe a réduit la taille de chaque couche avancée experte à 6 dm². À l'exception des couches d'intégration et de désintégration, tous les modèles utilisent environ 26 millions de paramètres par jeton. Le processus de formation utilise 6,5 milliards de jetons et le nombre d'étapes de formation est de 100 000.

L'ensemble de données utilisé pour la formation est l'ensemble de données anglais C4, et la tâche est de prédire le prochain jeton. Le texte est tokenisé à l'aide du tokenizer GPT2. Le tableau 3 donne la liste complète des hyperparamètres.

Résultats

Le tableau 1 donne les résultats de l'entraînement. MoE-Mamba fonctionne nettement mieux que le modèle Mamba classique.

Il est à noter que MoE-Mamba atteint le même niveau de résultats que le Mamba ordinaire dans seulement 46% des étapes d'entraînement. Étant donné que le taux d'apprentissage est ajusté pour le Mamba ordinaire, on peut s'attendre à ce que si le processus de formation est optimisé pour MoE-Mamba, MoE-Mamba fonctionnera mieux.

Étude sur l'ablation

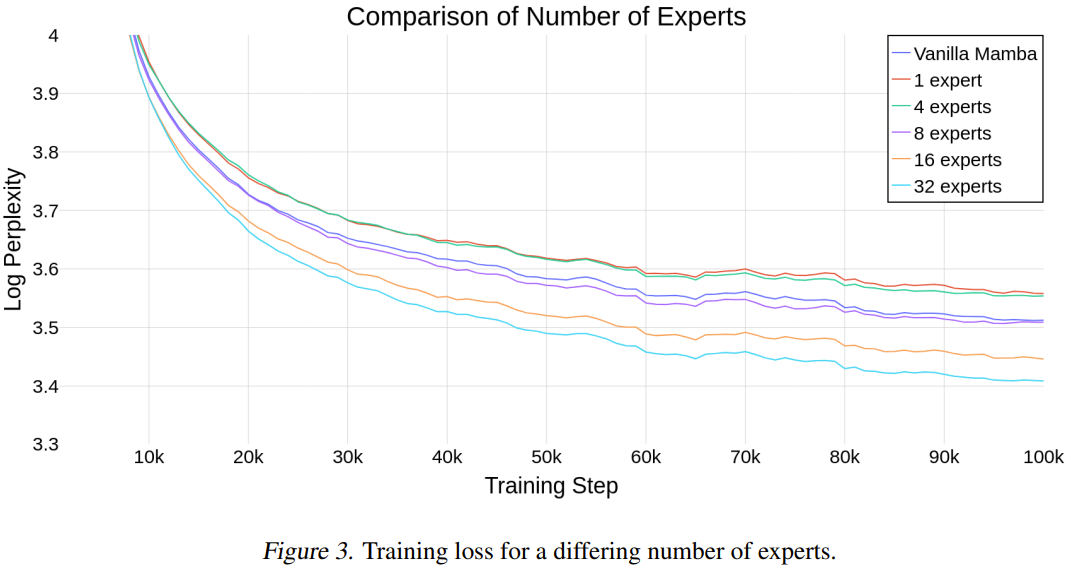

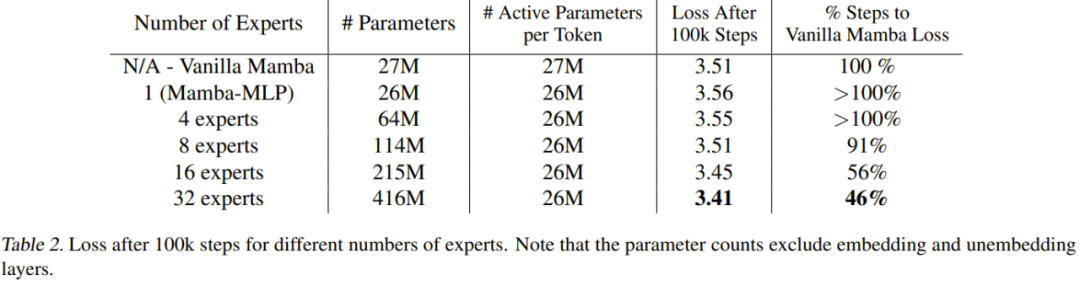

Pour évaluer si Mamba évolue bien à mesure que le nombre d'experts augmente, les chercheurs ont comparé des modèles utilisant différents nombres d'experts.

La figure 3 montre les étapes de la formation lors de l'utilisation de différents nombres d'experts.

Le tableau 2 donne les résultats après 100 000 pas.

Ces résultats montrent que la méthode nouvellement proposée s'adapte bien au nombre d'experts. Si le nombre d'experts est de 8 ou plus, les performances finales du nouveau modèle sont meilleures que celles du Mamba normal. Étant donné que Mamba-MLP est pire que Mamba classique, on peut s'attendre à ce que le MoE-Mamba utilisant un petit nombre d'experts obtienne de moins bons résultats que Mamba. La nouvelle méthode a donné les meilleurs résultats lorsque le nombre d’experts était de 32.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Open source! Au-delà de ZoeDepth ! DepthFM : estimation rapide et précise de la profondeur monoculaire !

Apr 03, 2024 pm 12:04 PM

Open source! Au-delà de ZoeDepth ! DepthFM : estimation rapide et précise de la profondeur monoculaire !

Apr 03, 2024 pm 12:04 PM

0. À quoi sert cet article ? Nous proposons DepthFM : un modèle d'estimation de profondeur monoculaire génératif de pointe, polyvalent et rapide. En plus des tâches traditionnelles d'estimation de la profondeur, DepthFM démontre également des capacités de pointe dans les tâches en aval telles que l'inpainting en profondeur. DepthFM est efficace et peut synthétiser des cartes de profondeur en quelques étapes d'inférence. Lisons ce travail ensemble ~ 1. Titre des informations sur l'article : DepthFM : FastMonocularDepthEstimationwithFlowMatching Auteur : MingGui, JohannesS.Fischer, UlrichPrestel, PingchuanMa, Dmytr

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Le modèle MoE open source le plus puissant au monde est ici, avec des capacités chinoises comparables à celles du GPT-4, et le prix ne représente que près d'un pour cent de celui du GPT-4-Turbo.

May 07, 2024 pm 04:13 PM

Imaginez un modèle d'intelligence artificielle qui non seulement a la capacité de surpasser l'informatique traditionnelle, mais qui permet également d'obtenir des performances plus efficaces à moindre coût. Ce n'est pas de la science-fiction, DeepSeek-V2[1], le modèle MoE open source le plus puissant au monde est ici. DeepSeek-V2 est un puissant mélange de modèle de langage d'experts (MoE) présentant les caractéristiques d'une formation économique et d'une inférence efficace. Il est constitué de 236B paramètres, dont 21B servent à activer chaque marqueur. Par rapport à DeepSeek67B, DeepSeek-V2 offre des performances plus élevées, tout en économisant 42,5 % des coûts de formation, en réduisant le cache KV de 93,3 % et en augmentant le débit de génération maximal à 5,76 fois. DeepSeek est une entreprise explorant l'intelligence artificielle générale

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

KAN, qui remplace MLP, a été étendu à la convolution par des projets open source

Jun 01, 2024 pm 10:03 PM

Plus tôt ce mois-ci, des chercheurs du MIT et d'autres institutions ont proposé une alternative très prometteuse au MLP – KAN. KAN surpasse MLP en termes de précision et d’interprétabilité. Et il peut surpasser le MLP fonctionnant avec un plus grand nombre de paramètres avec un très petit nombre de paramètres. Par exemple, les auteurs ont déclaré avoir utilisé KAN pour reproduire les résultats de DeepMind avec un réseau plus petit et un degré d'automatisation plus élevé. Plus précisément, le MLP de DeepMind compte environ 300 000 paramètres, tandis que le KAN n'en compte qu'environ 200. KAN a une base mathématique solide comme MLP est basé sur le théorème d'approximation universelle, tandis que KAN est basé sur le théorème de représentation de Kolmogorov-Arnold. Comme le montre la figure ci-dessous, KAN a

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas entre officiellement dans l’ère des robots électriques ! Hier, l'Atlas hydraulique s'est retiré "en larmes" de la scène de l'histoire. Aujourd'hui, Boston Dynamics a annoncé que l'Atlas électrique était au travail. Il semble que dans le domaine des robots humanoïdes commerciaux, Boston Dynamics soit déterminé à concurrencer Tesla. Après la sortie de la nouvelle vidéo, elle a déjà été visionnée par plus d’un million de personnes en seulement dix heures. Les personnes âgées partent et de nouveaux rôles apparaissent. C'est une nécessité historique. Il ne fait aucun doute que cette année est l’année explosive des robots humanoïdes. Les internautes ont commenté : Les progrès des robots ont fait ressembler la cérémonie d'ouverture de cette année à des êtres humains, et le degré de liberté est bien plus grand que celui des humains. Mais n'est-ce vraiment pas un film d'horreur ? Au début de la vidéo, Atlas est allongé calmement sur le sol, apparemment sur le dos. Ce qui suit est à couper le souffle

L'IA bouleverse la recherche mathématique ! Le lauréat de la médaille Fields et mathématicien sino-américain a dirigé 11 articles les mieux classés | Aimé par Terence Tao

Apr 09, 2024 am 11:52 AM

L'IA bouleverse la recherche mathématique ! Le lauréat de la médaille Fields et mathématicien sino-américain a dirigé 11 articles les mieux classés | Aimé par Terence Tao

Apr 09, 2024 am 11:52 AM

L’IA change effectivement les mathématiques. Récemment, Tao Zhexuan, qui a prêté une attention particulière à cette question, a transmis le dernier numéro du « Bulletin de l'American Mathematical Society » (Bulletin de l'American Mathematical Society). En se concentrant sur le thème « Les machines changeront-elles les mathématiques ? », de nombreux mathématiciens ont exprimé leurs opinions. L'ensemble du processus a été plein d'étincelles, intense et passionnant. L'auteur dispose d'une équipe solide, comprenant Akshay Venkatesh, lauréat de la médaille Fields, le mathématicien chinois Zheng Lejun, l'informaticien de l'Université de New York Ernest Davis et de nombreux autres universitaires bien connus du secteur. Le monde de l’IA a radicalement changé. Vous savez, bon nombre de ces articles ont été soumis il y a un an.

Vitesse Internet lente des données cellulaires sur iPhone : correctifs

May 03, 2024 pm 09:01 PM

Vitesse Internet lente des données cellulaires sur iPhone : correctifs

May 03, 2024 pm 09:01 PM

Vous êtes confronté à un décalage et à une connexion de données mobile lente sur iPhone ? En règle générale, la puissance de l'Internet cellulaire sur votre téléphone dépend de plusieurs facteurs tels que la région, le type de réseau cellulaire, le type d'itinérance, etc. Vous pouvez prendre certaines mesures pour obtenir une connexion Internet cellulaire plus rapide et plus fiable. Correctif 1 – Forcer le redémarrage de l'iPhone Parfois, le redémarrage forcé de votre appareil réinitialise simplement beaucoup de choses, y compris la connexion cellulaire. Étape 1 – Appuyez simplement une fois sur la touche d’augmentation du volume et relâchez-la. Ensuite, appuyez sur la touche de réduction du volume et relâchez-la à nouveau. Étape 2 – La partie suivante du processus consiste à maintenir le bouton sur le côté droit. Laissez l'iPhone finir de redémarrer. Activez les données cellulaires et vérifiez la vitesse du réseau. Vérifiez à nouveau Correctif 2 – Changer le mode de données Bien que la 5G offre de meilleures vitesses de réseau, elle fonctionne mieux lorsque le signal est plus faible

La vitalité de la super intelligence s'éveille ! Mais avec l'arrivée de l'IA qui se met à jour automatiquement, les mères n'ont plus à se soucier des goulots d'étranglement des données.

Apr 29, 2024 pm 06:55 PM

La vitalité de la super intelligence s'éveille ! Mais avec l'arrivée de l'IA qui se met à jour automatiquement, les mères n'ont plus à se soucier des goulots d'étranglement des données.

Apr 29, 2024 pm 06:55 PM

Je pleure à mort. Le monde construit à la folie de grands modèles. Les données sur Internet ne suffisent pas du tout. Le modèle de formation ressemble à « The Hunger Games », et les chercheurs en IA du monde entier se demandent comment nourrir ces personnes avides de données. Ce problème est particulièrement important dans les tâches multimodales. À une époque où rien ne pouvait être fait, une équipe de start-up du département de l'Université Renmin de Chine a utilisé son propre nouveau modèle pour devenir la première en Chine à faire de « l'auto-alimentation des données générées par le modèle » une réalité. De plus, il s’agit d’une approche à deux volets, du côté compréhension et du côté génération, les deux côtés peuvent générer de nouvelles données multimodales de haute qualité et fournir un retour de données au modèle lui-même. Qu'est-ce qu'un modèle ? Awaker 1.0, un grand modèle multimodal qui vient d'apparaître sur le Forum Zhongguancun. Qui est l'équipe ? Moteur Sophon. Fondé par Gao Yizhao, doctorant à la Hillhouse School of Artificial Intelligence de l’Université Renmin.

L'US Air Force présente son premier avion de combat IA de grande envergure ! Le ministre a personnellement effectué l'essai routier sans intervenir pendant tout le processus, et 100 000 lignes de code ont été testées 21 fois.

May 07, 2024 pm 05:00 PM

L'US Air Force présente son premier avion de combat IA de grande envergure ! Le ministre a personnellement effectué l'essai routier sans intervenir pendant tout le processus, et 100 000 lignes de code ont été testées 21 fois.

May 07, 2024 pm 05:00 PM

Récemment, le milieu militaire a été submergé par la nouvelle : les avions de combat militaires américains peuvent désormais mener des combats aériens entièrement automatiques grâce à l'IA. Oui, tout récemment, l’avion de combat IA de l’armée américaine a été rendu public pour la première fois, dévoilant ainsi son mystère. Le nom complet de ce chasseur est Variable Stability Simulator Test Aircraft (VISTA). Il a été personnellement piloté par le secrétaire de l'US Air Force pour simuler une bataille aérienne en tête-à-tête. Le 2 mai, le secrétaire de l'US Air Force, Frank Kendall, a décollé à bord d'un X-62AVISTA à la base aérienne d'Edwards. Notez que pendant le vol d'une heure, toutes les actions de vol ont été effectuées de manière autonome par l'IA ! Kendall a déclaré : "Au cours des dernières décennies, nous avons réfléchi au potentiel illimité du combat air-air autonome, mais cela a toujours semblé hors de portée." Mais maintenant,