Nouvelles du 8 février Par rapport à la prospérité de Microsoft, la configuration d'Apple dans le domaine de l'IA est beaucoup plus discrète, mais cela ne veut pas dire qu'Apple n'a réalisé aucune réussite dans ce domaine. Apple a récemment publié un nouveau modèle d'intelligence artificielle open source appelé « MGIE », qui peut éditer des images en fonction d'instructions en langage naturel.

Source de l'image : VentureBeat en collaboration avec Midjourney

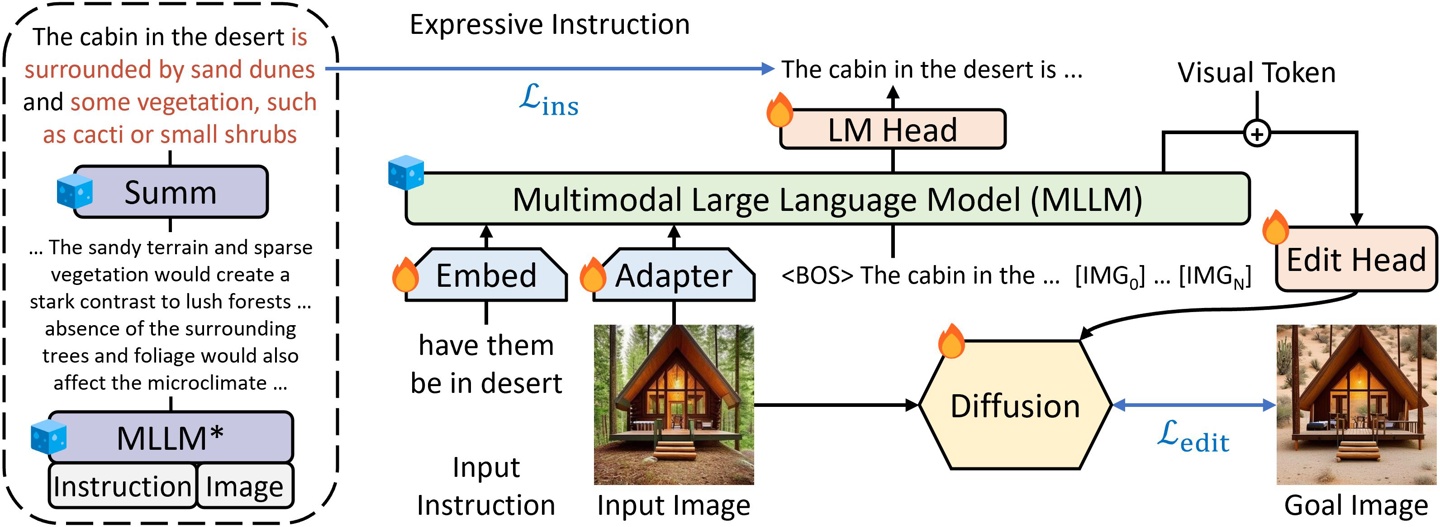

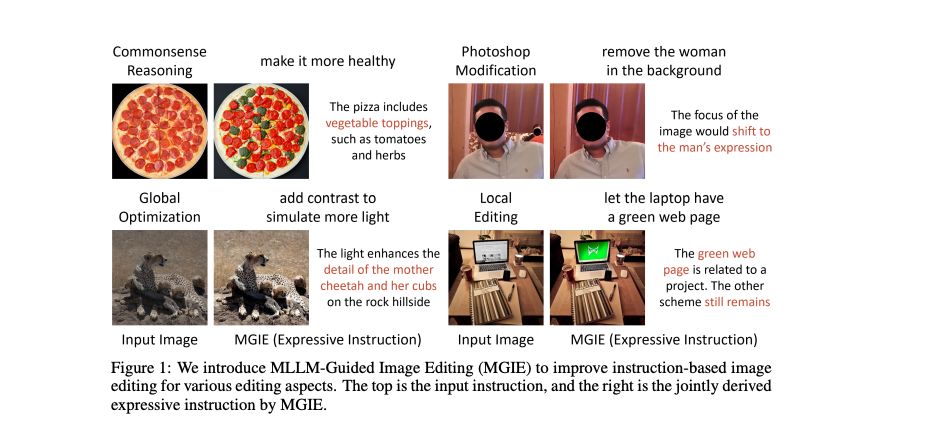

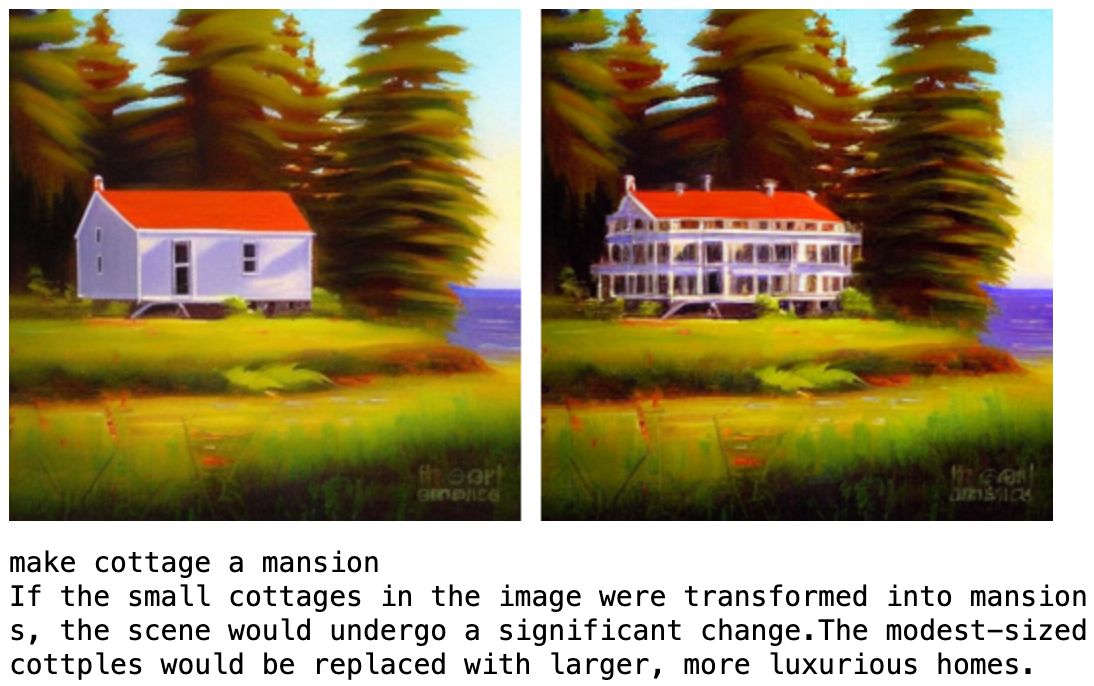

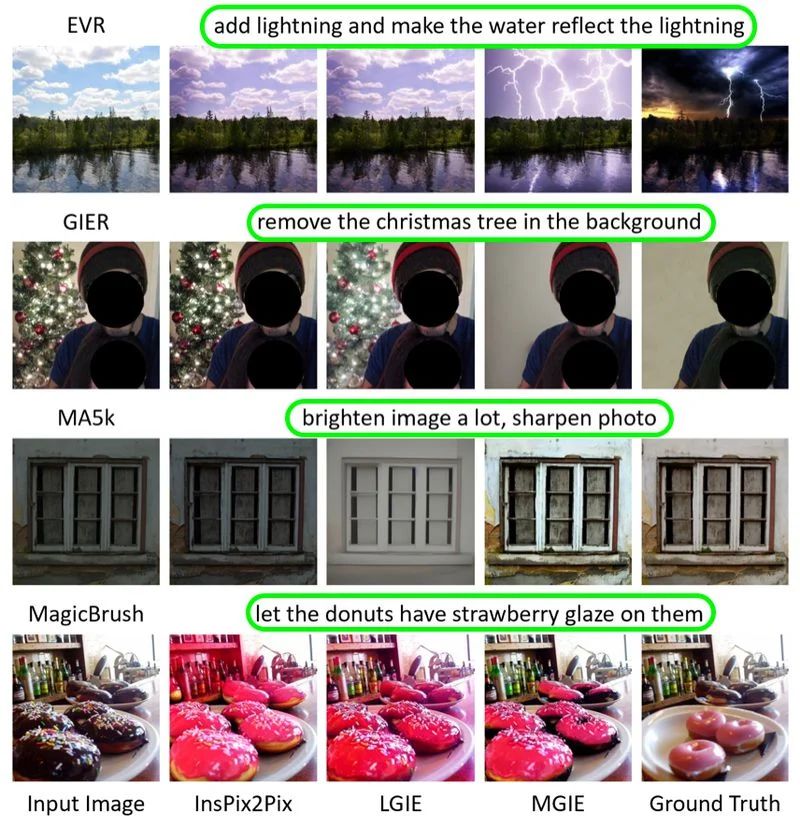

MGIE (MLLM-Guided Image Editing) est une technologie qui utilise des modèles multimodaux de grand langage (MLLM) pour interpréter les instructions de l'utilisateur et effectuer des opérations au niveau des pixels. Il peut comprendre les commandes en langage naturel de l'utilisateur et effectuer des modifications de type Photoshop, une optimisation globale des photos et une édition locale. Grâce à MGIE, les utilisateurs peuvent facilement effectuer diverses modifications sur des images sans être familiers avec un logiciel de traitement d'image complexe. Cette technologie simplifie le processus d'édition d'image tout en offrant une méthode d'édition plus intuitive et efficace.

Apple, en collaboration avec des chercheurs de l'Université de Californie à Santa Barbara, a annoncé les résultats de recherches liées au MGIE lors de la Conférence internationale 2024 sur les représentations d'apprentissage (ICLR). L'ICLR est l'une des conférences les plus importantes dans le domaine de la recherche sur l'intelligence artificielle.

Avant de présenter MGIE, ce site présentera brièvement le MLLM (Multimodal Language Learning Model). MLLM est un puissant modèle d'intelligence artificielle unique en ce sens qu'il peut traiter simultanément du texte et des images, améliorant ainsi les capacités d'édition d'images basées sur des instructions. MLLM a montré d'excellentes capacités en matière de compréhension intermodale et de génération de réponses perceptuelles visuelles, cependant, il n'a pas encore été largement utilisé dans les tâches d'édition d'images.

MGIE intègre les MLLM dans le processus d'édition d'images de deux manières : premièrement, il exploite les MLLM pour dériver des instructions précises et expressives à partir des entrées de l'utilisateur. Ces instructions sont concises et claires, fournissant des conseils clairs pour le processus d’édition.

Par exemple, en tapant "Rendre le ciel plus bleu", MGIE peut générer la commande "Augmenter la saturation de la zone du ciel de 20%".

Deuxièmement, il utilise MLLM pour générer des imaginations visuelles, c'est-à-dire des représentations latentes des modifications souhaitées. Cette représentation capture l’essence de l’édition et peut être utilisée pour guider les opérations au niveau des pixels. MGIE utilise un nouveau programme de formation de bout en bout qui optimise conjointement les modules de dérivation d'instructions, d'imagination visuelle et d'édition d'images.

MGIE peut gérer une variété de situations d'édition, depuis de simples ajustements de couleurs jusqu'à la manipulation d'objets complexes. Le modèle peut également effectuer des modifications globales et locales en fonction des préférences de l'utilisateur. Certaines des caractéristiques et fonctions de MGIE incluent :

MGIE est un projet open source sur GitHub. Les utilisateurs peuvent cliquer ici pour trouver le code, les données et les modèles pré-entraînés. Le projet fournit également un cahier de démonstration montrant comment utiliser MGIE pour effectuer diverses tâches d'édition.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Que signifie le réseau Apple LTE ?

Que signifie le réseau Apple LTE ?

Le rôle du mode Ne pas déranger d'Apple

Le rôle du mode Ne pas déranger d'Apple

Comment résoudre le problème selon lequel Apple ne peut pas télécharger plus de 200 fichiers

Comment résoudre le problème selon lequel Apple ne peut pas télécharger plus de 200 fichiers

qu'est-ce que le HTML

qu'est-ce que le HTML

De quelle marque est le téléphone mobile Nubia ?

De quelle marque est le téléphone mobile Nubia ?

Comment récupérer l'historique du navigateur sur un ordinateur

Comment récupérer l'historique du navigateur sur un ordinateur

Le port 8080 est occupé

Le port 8080 est occupé

Comment compresser des fichiers HTML en zip

Comment compresser des fichiers HTML en zip