Périphériques technologiques

Périphériques technologiques

IA

IA

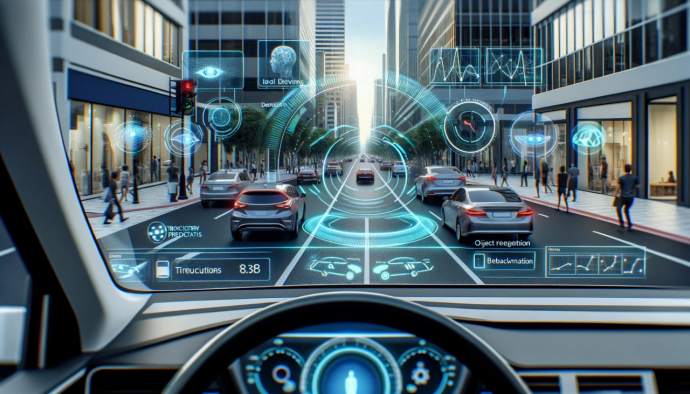

Le Défi international de conduite autonome 2024 démarre officiellement

Le Défi international de conduite autonome 2024 démarre officiellement

Le Défi international de conduite autonome 2024 démarre officiellement

- Nouveaux sujets de compétition : sept pistes, de nouveaux sujets de compétition, une couverture complète des sujets les plus récents et les plus brûlants dans des domaines connexes, explorant pleinement l'application des grands modèles dans les domaines verticaux de la conduite autonome et de l'intelligence incorporée.

- Prix en argent élevé : la cagnotte totale dépasse 120 000 dollars américains, et le prix en argent maximum sur une seule piste peut atteindre 27 000 dollars américains. Selon des statistiques incomplètes, le montant de la récompense est le plus élevé parmi les 100 forums du CVPR 2024.

- Concentrez-vous sur l'originalité : renforcez la recherche fondamentale et l'exploration, et adhérez aux quatre aspects. L'originalité et la valeur de la recherche scientifique sont utilisées comme principaux indicateurs de mesure, et les classements ne sont pas uniquement basés sur les performances. Un classement complet est réalisé en combinant des solutions originales et des indicateurs de performance.

Le 1er mars 2024, le Défi International de Conduite Autonome 2024 a été officiellement lancé. Ce défi est organisé par le Laboratoire d'intelligence artificielle de Shanghai et co-organisé par un certain nombre d'institutions nationales et étrangères. Un certain nombre d'experts et d'universitaires de renom dans le pays et à l'étranger forment le comité d'orientation et de récompense du concours. Ce concours vise à fournir une exploration approfondie des tâches et des défis auxquels sont confrontés les systèmes autonomes et à offrir une scène aux participants mondiaux pour présenter la technologie et l'innovation. Dans cette compétition, nous n'imposons pas trop de restrictions aux participants. Par exemple, plusieurs équipes de la même organisation sont autorisées à participer, tous les ensembles de données publics et poids de pré-entraînement peuvent être utilisés, et une équipe est autorisée à le faire. remporter plusieurs prix en même temps. Il y a sept pistes dans ce concours, et le gagnant a la possibilité de recevoir une récompense pouvant aller jusqu'à 27 000 dollars américains, et a également la possibilité d'être invité à soumettre des articles dans les meilleures revues internationales. Nous avons également préparé des directives de compétition détaillées et des modèles de référence pour chaque piste, accessibles en cliquant sur le lien correspondant à chaque piste.

Site officiel du concours :

https://opendrivelab.com/challenge2024

Événement principal :

Forum CVPR 2024 - Atelier sur les modèles de fondation pour les systèmes autonomes (Seattle, USA)

Événements connexes :

- Fin avril : La 3ème Conférence China 3D Vision (China3DV 2024)

- http://www.csig3dv.net/2024/competition.html

- Mi-juin : Événements hors ligne (Pékin/Shanghai)

Introduction au sujet du concours Conduite autonome de bout en bout

En raison de la taille limitée des ensembles de données précédents et des indicateurs incohérents en boucle ouverte et en boucle fermée, il est difficile d'effectuer une comparaison stratégies sensorimotrices utilisant des données réelles . Dans cette voie, des données à grande échelle seront utilisées pour combler le fossé entre les deux paradigmes d'évaluation, et grâce à la modélisation abstraite BEV dans une courte série temporelle, une évaluation efficace en boucle ouverte sera obtenue tout en s'alignant mieux sur l'évaluation en boucle fermée.

- Informations sur la piste : https://www.php.cn/link/492f948808daf55a3f9e7ddd3694f546#end_to_end_driving_at_scale

- Volume de données : environ 2T

- Serveur de test : https://huggingface.co/spaces/AGC2024-P/e2e- conduire -2024

Modèle mondial

En tant que représentation spatio-temporelle abstraite de la réalité, le modèle mondial peut prédire l'état futur sur la base de l'état actuel observé. L'apprentissage du modèle mondial favorisera la performance de la base. modèle à un nouveau niveau. Le modèle doit prédire le nuage de points à des instants futurs avec uniquement une entrée visuelle pour prouver sa capacité à prédire le monde.

- Informations sur la piste : https://www.php.cn/link/492f948808daf55a3f9e7ddd3694f546#predictive_world_model

- Volume de données : environ 2T

- Temps de formation de référence : sur des échantillons de données, 8 cartes A100, 3 jours

- Serveur de test : https://huggingface.co/spaces/AGC2024-P/predictive-world-model-2024

Grille d'occupation et estimation de mouvement

Les boîtes tridimensionnelles sont souvent insuffisantes pour décrire des objets généraux, inspirés des concepts robotiques , la représentation perceptuelle peut être décrite comme une prédiction de l'occupation d'un espace tridimensionnel rastérisé. Dans cette piste, les concurrents doivent non seulement fournir une représentation tramée de l'espace tridimensionnel, mais également prédire le mouvement de la grille.

- Informations sur le suivi : https://www.php.cn/link/492f948808daf55a3f9e7ddd3694f546#occupancy_and_flow

- Défi de conduite autonome @China3DV : https://huggingface.co/spaces/China3DV-S/occupancy-and-flow -2024

- Volume de données : environ 70 Go

- Durée de formation de référence : 8 cartes 3090, 2 jours

- Serveur de test : https://huggingface.co/spaces/AGC2024-S/occupancy-and-flow-2024

Positionnement visuel tridimensionnel multimodal incarné

Par rapport aux scènes de conduite, les systèmes de perception tridimensionnelle incarnés en intérieur sont confrontés à une entrée multimodale comprenant des instructions linguistiques, une compréhension sémantique plus complexe, des catégories et des orientations d'objets plus diverses, ainsi que des espaces et des besoins de perception très différents. Sur cette base, le concours a construit EmbodiedScan, une boîte à outils de perception tridimensionnelle multimodale pleine scène de première perspective. Le but de cette tâche est de détecter la catégorie de l'objet cible et sa boîte tridimensionnelle orientée à partir d'une description verbale d'un objet spécifique.

- Informations sur la piste : https://www.php.cn/link/492f948808daf55a3f9e7ddd3694f546#multiview_3d_visual_grounding

- Volume de données : environ 1,5T

- Temps de formation de référence : données d'échantillon 8 cartes A100 0,5 jours, données complètes 8 cartes A100 3 jours

- Serveur de test : https://huggingface.co/spaces/AGC2024/visual-grounding-2024

CARLA Self-Driving Challenge

Le CARLA Self-Driving Challenge nécessite que les véhicules parcourent un ensemble de pré -itinéraires définis. Les itinéraires de conduite des véhicules impliquent des situations complexes, telles que les autoroutes, les zones urbaines, les zones résidentielles et les environnements ruraux. Ils incluent également la lumière et les conditions météorologiques, telles que la lumière du soleil, le coucher du soleil, la nuit, la pluie et le brouillard, qui offrent la possibilité d'une évaluation en boucle fermée. systèmes de conduite autonome.

- Informations sur la piste : https://www.php.cn/link/492f948808daf55a3f9e7ddd3694f546#carla

- Serveur de test : https://eval.ai/web/challenges/challenge-page/2098/overview

Application du grand modèle de langage dans la conduite autonome

En introduisant des informations linguistiques, l'ensemble de données DriveLM connecte le grand modèle de langage au système de conduite autonome et prend enfin des décisions en introduisant la capacité de raisonnement du langage pour garantir la fiabilité de la planification. .interprétatif. En prenant des images multi-vues comme informations d'entrée, le modèle doit répondre à diverses questions liées à la conduite.

- Informations sur la piste : https://www.php.cn/link/492f948808daf55a3f9e7ddd3694f546#driving_with_lingual

- Volume de données : 4072 images dans l'ensemble d'entraînement, 799 images dans l'ensemble de test, environ 90 paires de questions et réponses par image

- Temps de formation de référence : 8 cartes V100, 1 jour

- Serveur de test : https://huggingface.co/spaces/AGC2024/driving-with-lingual-2024

Conduite sans images

Automatiquement sans carte HD Conduite une voiture nécessite un haut niveau de compréhension de la scène, et ce morceau vise à explorer les limites du raisonnement scénique. En prenant des images multi-vues et des cartes de définition standard comme informations d'entrée, le réseau neuronal doit non seulement produire les résultats de perception des voies et des éléments de circulation, mais également produire les relations topologiques entre les voies et entre les voies et les éléments de circulation.

- Informations de suivi : https://www.php.cn/link/492f948808daf55a3f9e7ddd3694f546 #mapless_driving

- Autonomous Driving Challenge @China3DV : https://huggingface.co/spaces/China3DV/mapless-driving-2024

- Volume de données : environ 200G

- Durée d'entraînement de référence : 8 cartes V100, 1 journée

- Serveur de test : https://huggingface.co/spaces/AGC2024/mapless-driving-2024

Le planning est le suivant

Toutes les heures sont celles de Pékin. Pour plus de détails, veuillez vous référer au site officiel du concours.

- À partir de maintenant - 1er juin 2024 : Inscription

- 1er mars 2024 : Le concours commence officiellement

- 25 mars 2024 : Le serveur de test est ouvert

- 1er juin 2024 : Test serveur fermé

- 18 juin 2024 : Résultats du concours annoncés

Comité d'orientation et de récompenses

Trier par noms de traits ; la liste est mise à jour en permanence.

Qiao Yu |

Laboratoire d'intelligence artificielle de Shanghai |

Scientifique principal, directeur adjoint |

Liu Qingshan |

Université de Nanjing Postes et Télécommunications |

Vice Principal |

Yang Xiaokang |

Université Jiaotong de Shanghai |

Doyen exécutif de l'Institut de recherche sur l'intelligence artificielle |

Li Shengbo |

Tsinghua Université |

Secrétaire du Comité du Parti du Vehicle College, talent national de haut niveau, professeur |

Zhang Yaqin |

Université Tsinghua |

Académicien étranger de l'Académie chinoise d'ingénierie, président de l'Institut de recherche sur l'industrie intelligente, professeur titulaire |

Chen Baoquan |

Université de Pékin |

Doyen adjoint de l'École d'intelligence, professeur émérite Boya |

|

Xia Huaxia |

Meituan Scientifique en chef, vice-président | Xue JianruUniversité Xi'an Jiaotong |

Professeur |

Cliquez sur "Lire le texte original" ou visitez le lien suivant pour en savoir plus | https://opendrivelab.com/challenge2024 |

| Groupe de communication WeChat | À propos de nous-> Rejoignez la communauté | Lien d'inscription

workshop-e2e-ad@googlegroups.com

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Le robot DeepMind joue au tennis de table, et son coup droit et son revers glissent dans les airs, battant complètement les débutants humains

Aug 09, 2024 pm 04:01 PM

Le robot DeepMind joue au tennis de table, et son coup droit et son revers glissent dans les airs, battant complètement les débutants humains

Aug 09, 2024 pm 04:01 PM

Mais peut-être qu’il ne pourra pas vaincre le vieil homme dans le parc ? Les Jeux Olympiques de Paris battent leur plein et le tennis de table suscite beaucoup d'intérêt. Dans le même temps, les robots ont également réalisé de nouvelles avancées dans le domaine du tennis de table. DeepMind vient tout juste de proposer le premier agent robot apprenant capable d'atteindre le niveau des joueurs amateurs humains de tennis de table de compétition. Adresse papier : https://arxiv.org/pdf/2408.03906 Quelle est la capacité du robot DeepMind à jouer au tennis de table ? Probablement à égalité avec les joueurs amateurs humains : tant en coup droit qu'en revers : l'adversaire utilise une variété de styles de jeu, et le robot peut également résister : recevoir des services avec des tours différents : Cependant, l'intensité du jeu ne semble pas aussi intense que le vieil homme dans le parc. Pour les robots, le tennis de table

La première griffe mécanique ! Yuanluobao est apparu à la World Robot Conference 2024 et a lancé le premier robot d'échecs pouvant entrer dans la maison

Aug 21, 2024 pm 07:33 PM

La première griffe mécanique ! Yuanluobao est apparu à la World Robot Conference 2024 et a lancé le premier robot d'échecs pouvant entrer dans la maison

Aug 21, 2024 pm 07:33 PM

Le 21 août, la Conférence mondiale sur les robots 2024 s'est tenue en grande pompe à Pékin. La marque de robots domestiques de SenseTime, "Yuanluobot SenseRobot", a dévoilé toute sa famille de produits et a récemment lancé le robot de jeu d'échecs Yuanluobot AI - Chess Professional Edition (ci-après dénommé "Yuanluobot SenseRobot"), devenant ainsi le premier robot d'échecs au monde pour le maison. En tant que troisième produit robot jouant aux échecs de Yuanluobo, le nouveau robot Guoxiang a subi un grand nombre de mises à niveau techniques spéciales et d'innovations en matière d'IA et de machines d'ingénierie. Pour la première fois, il a réalisé la capacité de ramasser des pièces d'échecs en trois dimensions. grâce à des griffes mécaniques sur un robot domestique et effectuer des fonctions homme-machine telles que jouer aux échecs, tout le monde joue aux échecs, réviser la notation, etc.

Claude aussi est devenu paresseux ! Internaute : apprenez à vous accorder des vacances

Sep 02, 2024 pm 01:56 PM

Claude aussi est devenu paresseux ! Internaute : apprenez à vous accorder des vacances

Sep 02, 2024 pm 01:56 PM

La rentrée scolaire est sur le point de commencer, et ce ne sont pas seulement les étudiants qui sont sur le point de commencer le nouveau semestre qui doivent prendre soin d’eux-mêmes, mais aussi les grands modèles d’IA. Il y a quelque temps, Reddit était rempli d'internautes se plaignant de la paresse de Claude. « Son niveau a beaucoup baissé, il fait souvent des pauses et même la sortie devient très courte. Au cours de la première semaine de sortie, il pouvait traduire un document complet de 4 pages à la fois, mais maintenant il ne peut même plus produire une demi-page. !" https://www.reddit.com/r/ClaudeAI/comments/1by8rw8/something_just_feels_wrong_with_claude_in_the/ dans un post intitulé "Totalement déçu par Claude", plein de

Lors de la World Robot Conference, ce robot domestique porteur de « l'espoir des futurs soins aux personnes âgées » a été entouré

Aug 22, 2024 pm 10:35 PM

Lors de la World Robot Conference, ce robot domestique porteur de « l'espoir des futurs soins aux personnes âgées » a été entouré

Aug 22, 2024 pm 10:35 PM

Lors de la World Robot Conference qui se tient à Pékin, l'exposition de robots humanoïdes est devenue le centre absolu de la scène. Sur le stand Stardust Intelligent, l'assistant robot IA S1 a réalisé trois performances majeures de dulcimer, d'arts martiaux et de calligraphie. un espace d'exposition, capable à la fois d'arts littéraires et martiaux, a attiré un grand nombre de publics professionnels et de médias. Le jeu élégant sur les cordes élastiques permet au S1 de démontrer un fonctionnement fin et un contrôle absolu avec vitesse, force et précision. CCTV News a réalisé un reportage spécial sur l'apprentissage par imitation et le contrôle intelligent derrière "Calligraphy". Le fondateur de la société, Lai Jie, a expliqué que derrière les mouvements soyeux, le côté matériel recherche le meilleur contrôle de la force et les indicateurs corporels les plus humains (vitesse, charge). etc.), mais du côté de l'IA, les données réelles de mouvement des personnes sont collectées, permettant au robot de devenir plus fort lorsqu'il rencontre une situation forte et d'apprendre à évoluer rapidement. Et agile

Annonce des prix ACL 2024 : l'un des meilleurs articles sur le déchiffrement Oracle par HuaTech, GloVe Time Test Award

Aug 15, 2024 pm 04:37 PM

Annonce des prix ACL 2024 : l'un des meilleurs articles sur le déchiffrement Oracle par HuaTech, GloVe Time Test Award

Aug 15, 2024 pm 04:37 PM

Les contributeurs ont beaucoup gagné de cette conférence ACL. L'ACL2024, d'une durée de six jours, se tient à Bangkok, en Thaïlande. ACL est la plus grande conférence internationale dans le domaine de la linguistique informatique et du traitement du langage naturel. Elle est organisée par l'Association internationale pour la linguistique informatique et a lieu chaque année. L'ACL s'est toujours classée première en termes d'influence académique dans le domaine de la PNL, et c'est également une conférence recommandée par le CCF-A. La conférence ACL de cette année est la 62e et a reçu plus de 400 travaux de pointe dans le domaine de la PNL. Hier après-midi, la conférence a annoncé le meilleur article et d'autres récompenses. Cette fois, il y a 7 Best Paper Awards (deux inédits), 1 Best Theme Paper Award et 35 Outstanding Paper Awards. La conférence a également décerné 3 Resource Paper Awards (ResourceAward) et Social Impact Award (

Hongmeng Smart Travel S9 et conférence de lancement de nouveaux produits avec scénario complet, un certain nombre de nouveaux produits à succès ont été lancés ensemble

Aug 08, 2024 am 07:02 AM

Hongmeng Smart Travel S9 et conférence de lancement de nouveaux produits avec scénario complet, un certain nombre de nouveaux produits à succès ont été lancés ensemble

Aug 08, 2024 am 07:02 AM

Cet après-midi, Hongmeng Zhixing a officiellement accueilli de nouvelles marques et de nouvelles voitures. Le 6 août, Huawei a organisé la conférence de lancement de nouveaux produits Hongmeng Smart Xingxing S9 et Huawei, réunissant la berline phare intelligente panoramique Xiangjie S9, le nouveau M7Pro et Huawei novaFlip, MatePad Pro 12,2 pouces, le nouveau MatePad Air, Huawei Bisheng With de nombreux nouveaux produits intelligents tous scénarios, notamment la série d'imprimantes laser X1, FreeBuds6i, WATCHFIT3 et l'écran intelligent S5Pro, des voyages intelligents, du bureau intelligent aux vêtements intelligents, Huawei continue de construire un écosystème intelligent complet pour offrir aux consommateurs une expérience intelligente du Internet de tout. Hongmeng Zhixing : Autonomisation approfondie pour promouvoir la modernisation de l'industrie automobile intelligente Huawei s'associe à ses partenaires de l'industrie automobile chinoise pour fournir

L'équipe de Li Feifei a proposé ReKep pour donner aux robots une intelligence spatiale et intégrer GPT-4o

Sep 03, 2024 pm 05:18 PM

L'équipe de Li Feifei a proposé ReKep pour donner aux robots une intelligence spatiale et intégrer GPT-4o

Sep 03, 2024 pm 05:18 PM

Intégration profonde de la vision et de l'apprentissage des robots. Lorsque deux mains de robot travaillent ensemble en douceur pour plier des vêtements, verser du thé et emballer des chaussures, associées au robot humanoïde 1X NEO qui a fait la une des journaux récemment, vous pouvez avoir le sentiment : nous semblons entrer dans l'ère des robots. En fait, ces mouvements soyeux sont le produit d’une technologie robotique avancée + d’une conception de cadre exquise + de grands modèles multimodaux. Nous savons que les robots utiles nécessitent souvent des interactions complexes et exquises avec l’environnement, et que l’environnement peut être représenté comme des contraintes dans les domaines spatial et temporel. Par exemple, si vous souhaitez qu'un robot verse du thé, le robot doit d'abord saisir la poignée de la théière et la maintenir verticalement sans renverser le thé, puis la déplacer doucement jusqu'à ce que l'embouchure de la théière soit alignée avec l'embouchure de la tasse. , puis inclinez la théière selon un certain angle. ce

L'IA utilisée | Le jeu fou Amway AI du président de Microsoft m'a torturé des milliers de fois

Aug 14, 2024 am 12:00 AM

L'IA utilisée | Le jeu fou Amway AI du président de Microsoft m'a torturé des milliers de fois

Aug 14, 2024 am 12:00 AM

Rédacteur du Machine Power Report : Yang Wen La vague d’intelligence artificielle représentée par les grands modèles et l’AIGC a discrètement changé notre façon de vivre et de travailler, mais la plupart des gens ne savent toujours pas comment l’utiliser. C'est pourquoi nous avons lancé la rubrique « AI in Use » pour présenter en détail comment utiliser l'IA à travers des cas d'utilisation de l'intelligence artificielle intuitifs, intéressants et concis et stimuler la réflexion de chacun. Nous invitons également les lecteurs à soumettre des cas d'utilisation innovants et pratiques. Oh mon Dieu, l'IA est vraiment devenue un génie. Récemment, la difficulté de distinguer l’authenticité des images générées par l’IA est devenue un sujet brûlant. (Pour plus de détails, veuillez consulter : IA utilisée | Devenez une beauté de l'IA en trois étapes et retrouvez votre forme originale par l'IA en une seconde) En plus de la populaire dame IA de Google sur Internet, divers générateurs de FLUX ont apparu sur les plateformes sociales