Tutoriel matériel

Tutoriel matériel

Examen du matériel

Examen du matériel

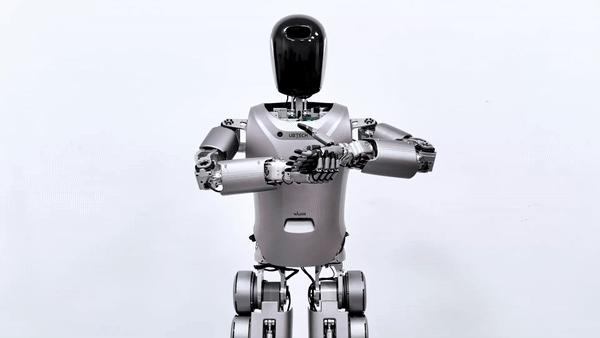

Après 2 mois, le robot humanoïde Walker S peut plier les vêtements

Après 2 mois, le robot humanoïde Walker S peut plier les vêtements

Après 2 mois, le robot humanoïde Walker S peut plier les vêtements

Rapport sur la puissance de la machine

Éditeur : Wu Xin

La version domestique du robot humanoïde + grand modèle s'est associée pour accomplir pour la première fois la tâche d'exploitation de matériaux flexibles complexes tels que plier des vêtements.

Avec le dévoilement de la figure 01, qui intègre le grand modèle multimodal OpenAI, les progrès connexes des pairs nationaux ont attiré l'attention.

Hier encore, UBTECH, le « premier stock de robots humanoïdes » de Chine, a publié la première démo du robot humanoïde Walker S après une intégration en profondeur du grand modèle de Baidu Wenxin, montrant quelques nouvelles fonctionnalités intéressantes.

Maintenant, avec la bénédiction des capacités des grands modèles de Baidu Wenxin, Walker S ressemble à ceci.

Comme la figure 01, Walker S ne bouge pas, mais se tient derrière un bureau pour accomplir une série de tâches. Il peut suivre les commandes humaines et plier les vêtements.

Après avoir terminé la tâche, vous pouvez également discuter avec elle. Par exemple, que dois-je porter avec ce haut noir ? Le robot se souvient encore que vous partez en voyage d'affaires et il est recommandé de l'associer à un pantalon sombre, plus adapté aux occasions formelles.

Il placera également divers interrupteurs sur la table dans l'assiette.

Même s'il est perturbé, par exemple si l'interrupteur placé est rejeté sur la table ou si la prise qui est sur le point d'être atteinte est retirée, Walker S peut ajuster l'état de fonctionnement en temps réel et terminer la tâche de placement en fonction du situation nouvelle.

En février, Walker S a déjà démontré ses capacités de perception multimodale et de contrôle de mouvement lors d'une formation pratique dans une usine de véhicules à énergies nouvelles.

Cette fois, grâce à une intégration approfondie avec le grand modèle Wenxin, les capacités cognitives et de contrôle de Walker S ont atteint un nouveau niveau. Il a non seulement acquis une compréhension avancée des intentions et des capacités de planification de tâches plus fines, mais a également complété une flexibilité complexe telle que. plier des vêtements pour la première fois. Tâches de manutention.

Le grand modèle Wenxin est le grand modèle d'amélioration des connaissances de niveau industriel de Wenxin, qui possède des capacités de compréhension et de génération sémantiques approfondies multimodales et multilingues, ainsi qu'un raisonnement des connaissances, une planification des tâches et d'autres capacités. En transférant ces capacités aux robots humanoïdes, le robot peut analyser et comprendre le matériau, la forme, les rides et d'autres attributs des vêtements comme les humains, et raisonner sur la meilleure manière et la meilleure séquence de pliage des vêtements en se basant sur l'expérience passée. Pendant le processus de pliage des vêtements, le robot analysera les changements d'état des vêtements en temps réel et ajustera sa stratégie d'action en conséquence.

Dans la tâche de tri des interférences d'objets, Walker S a également exploité pleinement les avantages synergiques du « grand modèle IA + robot ». Tout d'abord, le positionnement spatial et les informations sémantiques de l'objet sont obtenus grâce au modèle de perception multimodale côté appareil, puis les informations sont transmises au grand modèle pour un traitement intelligent. Ce dernier construit rapidement Walker S avec son excellente tâche. capacités de démantèlement et de raisonnement logique. Trouvez le chemin optimal de planification et d’exécution des tâches. Walker S associe cette solution au contrôle réel du bras robotique et des mains adroites, et termine finalement avec succès l'ensemble des tâches complexes.

Il s'agit également de la première démonstration de capacités similaires par des pairs nationaux. Son application innovante et sa difficulté de mise en œuvre sont également parmi les premiers échelons de l'industrie au niveau mondial. "Dans de nombreuses démonstrations, y compris la coopération de Figure avec OpenAI et notre coopération avec Baidu, la direction d'UBTECH peut désormais être réalisée de bout en bout", a déclaré la direction d'UBTECH à China Business News lors de la réunion d'évaluation des performances et de perspectives d'hier soir.

" Nous utilisons les grands modèles de Baidu pour démonter les tâches, comprendre le langage naturel et séquencer les arrangements logiques. En plus du grand modèle multimodal basé sur le client et construit sur la base de la formation de modèles open source l'année dernière, nous pensons que dans le futur Alors que la concurrence sur le marché des robots humanoïdes devient de plus en plus féroce, ce n'est qu'en combinant des forces puissantes que nous pourrons atteindre 1+1>2. » En expliquant cette coopération, la direction d'UBTECH a déclaré : « Tesla étrangère possède de grandes capacités de modèles, notamment OpenAI et NVIDIA. En le combinant avec Figure, nous pouvons voir que la coopération peut fournir un soutien technique solide pour la mise en œuvre de robots humanoïdes. "

Cependant, en comparant les vidéos d'OpenAI, nous avons constaté qu'il existe encore un écart entre le Walker S et Figure 01.

La chose la plus évidente est la rapidité d’action. De plus, en termes de contenu des instructions, les instructions reçues par Walker S sont généralement relativement claires et spécifiques, tandis que la figure 01 peut convertir des instructions plus abstraites en opérations spécifiques raisonnables et réalisables grâce à un raisonnement de bon sens.

De plus, la Figure 01 peut discuter tout en travaillant (expliquant notamment ses opérations), possède une capacité de mémoire à court terme et peut raisonnablement planifier les actions en cours en fonction du contenu des conversations précédentes.

Alors que la concurrence dans l'IA générative devient de plus en plus féroce et que l'orientation de la recherche s'étend des textes longs et de la multimodalité à l'intelligence incarnée, nous avons des raisons de croire que les futurs robots humanoïdes ne se limiteront plus à percevoir des données statiques, mais le seront capable Vous pouvez vous déplacer librement et interagir avec l'environnement dans le monde réel en trois dimensions. Cela marque également une avancée majeure dans l’IA, du simple apprentissage automatique à l’exécution de tâches complexes de type humain.

En fait, le secteur des robots humanoïdes a connu un élan extrêmement dynamique au cours des six derniers mois, avec des prototypes nationaux et étrangers fréquemment dévoilés et des startups finançant activement. En février, UBTECH a dévoilé une vidéo du Walker S testé dans l'usine de véhicules à énergie nouvelle de NIO. Le robot peut effectuer en douceur l'inspection des ceintures de sécurité, l'apposition du logo du véhicule et d'autres tâches. Le cours de l'action UBTECH a également grimpé de 200 % en deux jours début mars.

Cependant, les robots humanoïdes du monde entier en sont encore au stade pilote et il faudra encore du temps pour les développer. Après tout, il existe une grande différence entre une démonstration et une application réelle, et cette dernière doit prendre en compte de manière globale une série de facteurs tels que la fiabilité, la stabilité et le coût. UBTECH a déclaré que la combinaison de grands modèles d'IA et de robots humanoïdes améliorera considérablement le niveau d'intelligence et l'adaptabilité de ces derniers à des tâches multi-scénarios, et accélérera leur processus d'industrialisation. Le fondateur Zhou Jian a également déclaré publiquement qu'il espérait terminer le premier lot de robots humanoïdes dans l'usine d'ici la fin de cette année, réussir les tests et se préparer à l'épidémie massive de robots humanoïdes en 2025. De plus, d'ici la fin de cette année, UBTECH prévoit de lancer le robot humanoïde de première génération pour les soins émotionnels à domicile. Le robot sera équipé d'un grand modèle et pourra interagir avec les utilisateurs et former des souvenirs à court et à long terme.

Lien de référence

https://www.stcn.com/article/detail/1164967.html

LA FIN

Veuillez contacter ce compte public pour obtenir l'autorisation de réimpression

Contribuer ou rechercher des rapports : content@jiqizhixin.com

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

OUYI SITE WEB OUDITE OKX Lien d'entrée officielle

Mar 21, 2025 pm 06:15 PM

OUYI SITE WEB OUDITE OKX Lien d'entrée officielle

Mar 21, 2025 pm 06:15 PM

Avec la popularité croissante du trading des crypto-monnaies, il est crucial de choisir une plate-forme de trading sûre et fiable. En tant que la principale plate-forme de trading d'actifs numériques au monde, OUYI OKX est très favorisé pour ses produits de trading riches, riches, une bonne liquidité et une expérience utilisateur. Cependant, Internet regorge de fausses informations et de nombreux utilisateurs ont du mal à identifier le site officiel d'Ouyi OKX. Cet article vous guidera comment accéder en toute sécurité et rapidement à la plate-forme officielle OUYI OKX, éviter de saisir accidentellement des sites Web de phishing et d'assurer la sécurité de vos actifs numériques. Nous présenterons diverses méthodes telles que les moteurs de recherche, les sites Web tiers, les médias sociaux officiels et les applications officielles pour trouver des liens de portail officiels et fournir des conseils de sécurité importants pour vous aider à effectuer des transactions de crypto-monnaie sûres et fiables sur la plate-forme OKI OKX.

Le dernier portail d'inscription pour le site officiel d'Ouyi

Mar 21, 2025 pm 05:54 PM

Le dernier portail d'inscription pour le site officiel d'Ouyi

Mar 21, 2025 pm 05:54 PM

En tant que la principale plateforme de trading d'actifs numériques au monde, OUYI OKX attire de nombreux investisseurs avec ses riches produits de trading, ses fortes garanties de sécurité et sa expérience utilisateur pratique. Cependant, les risques de sécurité des réseaux deviennent de plus en plus graves et comment enregistrer en toute sécurité le compte officiel OUYI OKX est crucial. Cet article fournira le dernier portail d'enregistrement pour le site officiel OUYI OKX et expliquera en détail les étapes et les précautions pour une inscription sûre, y compris comment identifier le site officiel, définir un mot de passe solide, permettre la vérification à deux facteurs, etc., pour vous aider à démarrer votre voyage d'investissement dans les actifs numériques en toute sécurité. Veuillez noter qu'il existe des risques dans l'investissement des actifs numériques, veuillez prendre des décisions prudentes.

Que dois-je faire si le logiciel de sécurité de l'entreprise est en conflit avec les applications? Comment dépanner les logiciels de sécurité des teintes provoque l'ouverture des logiciels communs?

Apr 01, 2025 pm 10:48 PM

Que dois-je faire si le logiciel de sécurité de l'entreprise est en conflit avec les applications? Comment dépanner les logiciels de sécurité des teintes provoque l'ouverture des logiciels communs?

Apr 01, 2025 pm 10:48 PM

Problèmes de compatibilité et méthodes de dépannage pour les logiciels et applications de sécurité de l'entreprise. De nombreuses entreprises installeront des logiciels de sécurité afin d'assurer la sécurité intranet. Cependant, les logiciels de sécurité parfois ...

Adresse officielle d'Ouyi

Mar 21, 2025 pm 06:12 PM

Adresse officielle d'Ouyi

Mar 21, 2025 pm 06:12 PM

Avec la popularité croissante du trading de devises numériques, il est crucial de choisir une plate-forme de trading sûre et fiable. En tant que premier échange d'actifs numériques au monde, la sécurité d'Okx a attiré beaucoup l'attention. Cependant, de nombreux sites de phishing se font passer pour un responsable OKX, ce qui a fait faire face aux risques de sécurité des comptes et de pertes d'actifs. Cet article expliquera en détail comment identifier et accéder au site officiel et à l'entrée officielle de l'Okx Real Ouyi pour éviter les pièges à phishing et assurer la sécurité de vos actifs numériques. Grâce à divers canaux tels que la vérification officielle du site Web, le téléchargement officiel des applications, les réseaux sociaux officiels et la consultation officielle du service client, vous pouvez identifier et accéder efficacement à la plateforme officielle de l'OKX pour assurer la sécurité de vos transactions. Assurez-vous de vérifier soigneusement le nom de domaine, de vérifier le protocole HTTPS et d'améliorer la sensibilisation à la sécurité du réseau.

Top 10 des applications de trading de devises virtuelles officielles Top 10 des plates-formes de trading de devises virtuelles officielles pour les téléphones mobiles

Mar 19, 2025 pm 05:21 PM

Top 10 des applications de trading de devises virtuelles officielles Top 10 des plates-formes de trading de devises virtuelles officielles pour les téléphones mobiles

Mar 19, 2025 pm 05:21 PM

Top 10 des applications officielles de trading de devises virtuelles: 1. Okx, 2. Binance, 3. Gate.io, 4. Kraken, 5. Huobi, 6. Coinbase, 7. Kucoin, 8. Crypto.com, 9. Bitfinex, 10. Gemini. La sécurité, la liquidité, les frais de traitement, la sélection des devises, l'interface utilisateur et le support client doivent être pris en compte lors du choix d'une plate-forme.

Un résumé des dix principales applications de plateformes de trading de devises virtuelles, classement des dix principales plates-formes de trading de devises virtuelles 2025

Mar 19, 2025 pm 05:15 PM

Un résumé des dix principales applications de plateformes de trading de devises virtuelles, classement des dix principales plates-formes de trading de devises virtuelles 2025

Mar 19, 2025 pm 05:15 PM

Top 10 des applications de plate-forme de trading de devises virtuelles recommandées: 1. Okx, 2. Binance, 3. Gate.io, 4. Kraken, 5. Huobi, 6. Coinbase, 7. Kucoin, 8. Crypto.com, 9. BitFinex, 10. Gemini. La sécurité, la liquidité, les frais de traitement, la sélection des devises, l'interface utilisateur et le support client doivent être pris en compte lors du choix d'une plate-forme.

Comment optimiser la segmentation des mots jieba pour améliorer l'effet d'extraction des mots clés des commentaires pittoresques?

Apr 01, 2025 pm 06:24 PM

Comment optimiser la segmentation des mots jieba pour améliorer l'effet d'extraction des mots clés des commentaires pittoresques?

Apr 01, 2025 pm 06:24 PM

Comment optimiser la segmentation des mots jieba pour améliorer l'extraction de mots clés des commentaires pittoresques? Lorsque vous utilisez la segmentation des mots jieba pour traiter les données de commentaires pittoresques, si les résultats de la segmentation des mots sont ignorés ...

Comment implémenter le tri et ajouter des classements dans des tableaux bidimensionnels PHP?

Apr 01, 2025 am 07:00 AM

Comment implémenter le tri et ajouter des classements dans des tableaux bidimensionnels PHP?

Apr 01, 2025 am 07:00 AM

Explication détaillée du tri et de la mise en œuvre du tableau bidimensionnel PHP Cet article expliquera en détail comment trier un tableau bidimensionnel PHP et utiliser chaque sous-tableau en fonction des résultats de tri ...