Périphériques technologiques

Périphériques technologiques

IA

IA

Efficacité augmentée de 16 fois ! VRSO : annotation 3D d'objets statiques purement visuels, ouvrant la boucle fermée des données !

Efficacité augmentée de 16 fois ! VRSO : annotation 3D d'objets statiques purement visuels, ouvrant la boucle fermée des données !

Efficacité augmentée de 16 fois ! VRSO : annotation 3D d'objets statiques purement visuels, ouvrant la boucle fermée des données !

Mort de l'étiquetage

Détection d'objets statiques (SOD), y compris les feux de circulation, les panneaux de guidage et les cônes de signalisation, la plupart des algorithmes sont des réseaux neuronaux profonds basés sur des données et nécessitent une grande quantité de données d'entraînement. La pratique actuelle implique généralement l'annotation manuelle d'un grand nombre d'échantillons d'entraînement sur des données de nuages de points analysées par LiDAR pour corriger les cas à longue traîne.

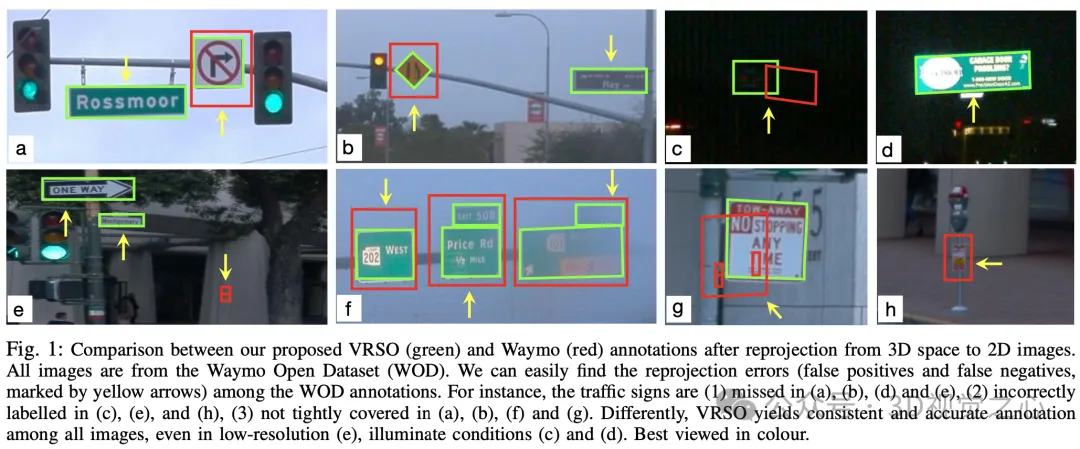

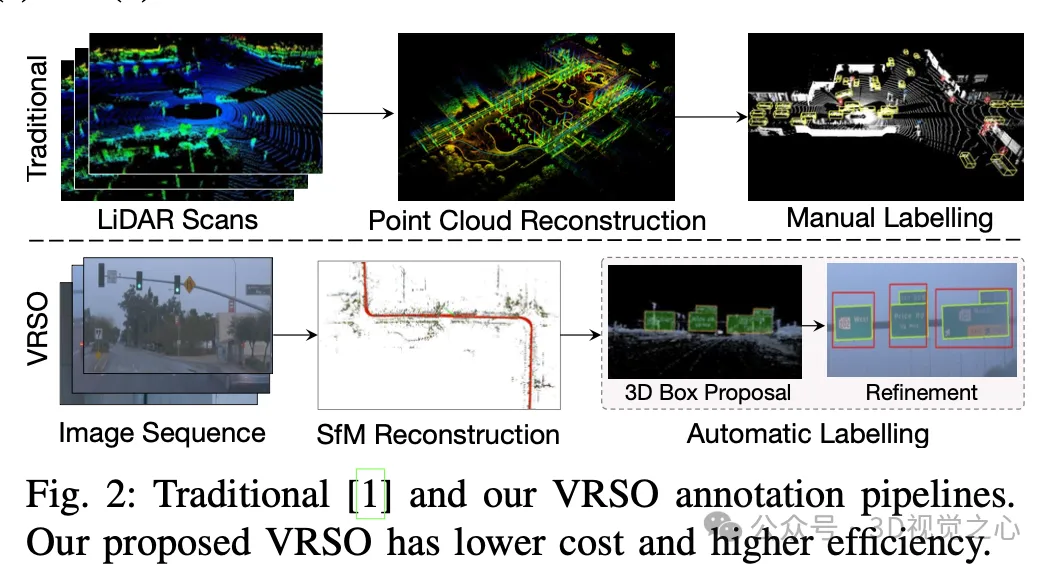

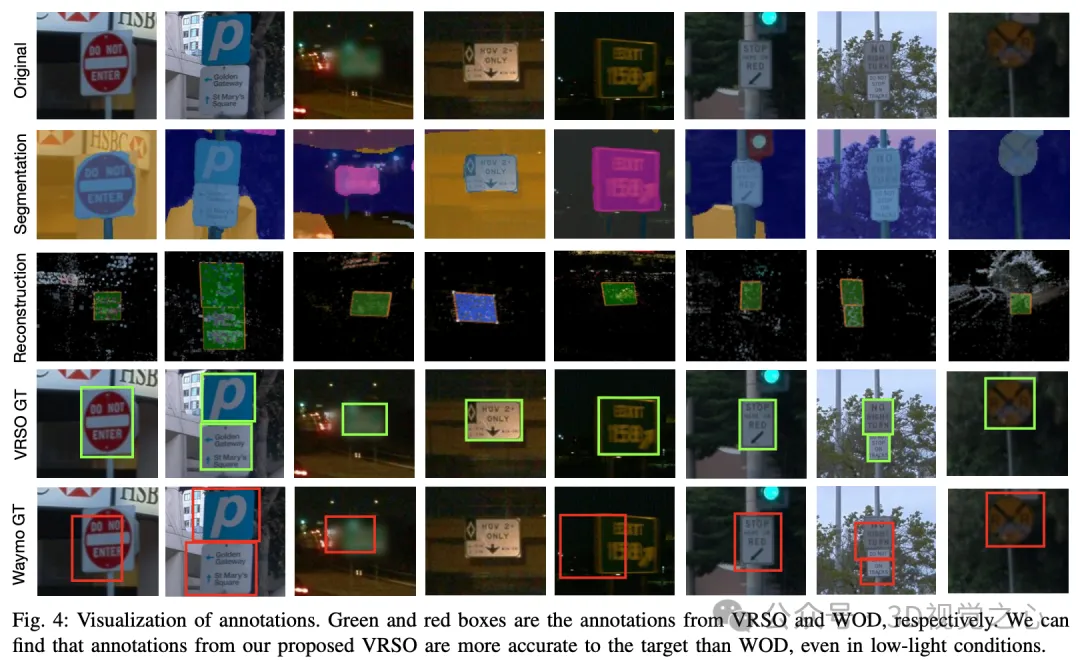

L'annotation manuelle est difficile à capturer la variabilité et la complexité des scènes réelles, et ne parvient souvent pas à prendre en compte les occultations, les différentes conditions d'éclairage et les divers angles de vision (flèches jaunes sur la figure 1). L'ensemble du processus comporte de longs liens, est extrêmement long, sujet aux erreurs et coûteux (Figure 2). Les entreprises recherchent donc actuellement des solutions d'étiquetage automatique, notamment basées sur la vision pure. Après tout, toutes les voitures ne disposent pas d'un lidar.

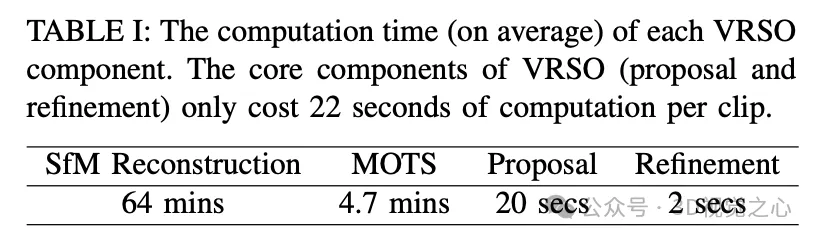

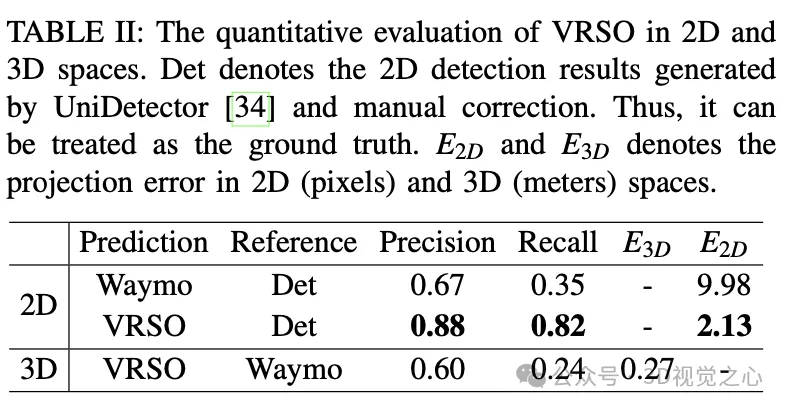

VRSO+ est un système d'annotation basé sur la vision pour l'annotation d'objets statiques. Il utilise principalement les informations des résultats de SFM, de détection d'objets 2D et de segmentation d'instance. L'effet global est le suivant :

- L'erreur de projection moyenne de l'annotation est de seulement. est de 2,6 pixels, soit environ un quart de l'annotation Waymo (10,6 pixels)

- Par rapport à l'annotation manuelle, la vitesse est augmentée d'environ 16 fois

Pour les objets statiques, VRSO extrait les points clés grâce à la segmentation des instances et aux contours pour résoudre le défi de l'intégration et la déduplication d'objets statiques de différents points de vue, ainsi que la difficulté de sous-observation due à des problèmes d'occlusion, améliorent la précision des annotations. À partir de la figure 1, par rapport aux résultats d'annotation manuelle de l'ensemble de données Waymo Open, VRSO démontre une robustesse et une précision géométrique supérieures.

(Vous avez tous vu ça, pourquoi ne pas glisser votre pouce vers le haut et cliquer sur la carte en haut pour me suivre, L'opération entière ne vous prendra que 1,328 secondes, puis enlèvera toutes les informations utiles dans l'avenir, au cas où cela serait utile~)

Comment briser la situation

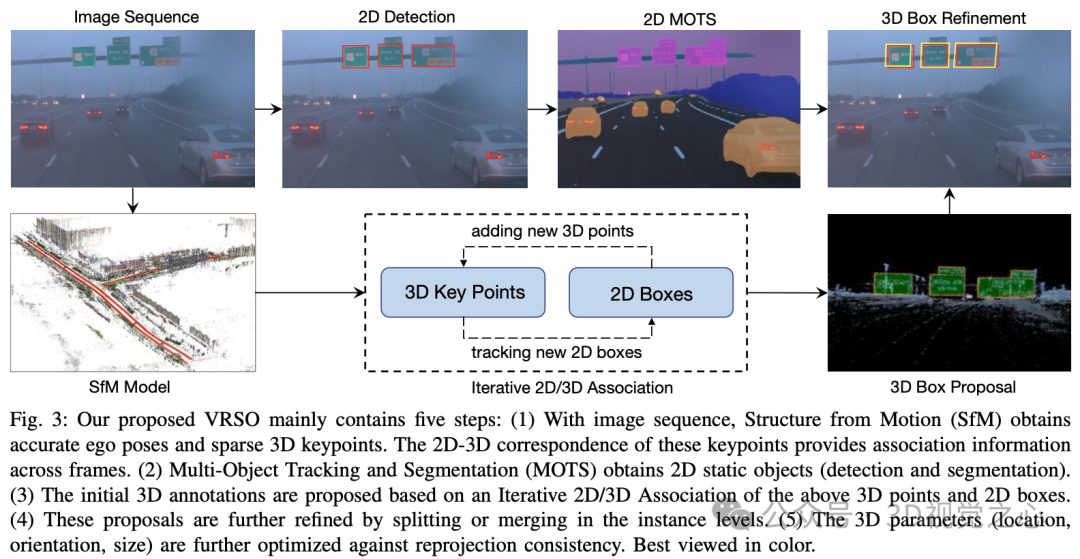

Le système VRSO est principalement divisé en deux parties : Reconstruction de scène et Annotation d'objet statique.

La partie reconstruction n'est pas au centre, elle est basée sur l'algorithme SFM pour restaurer la pose de l'image et les points clés 3D clairsemés.

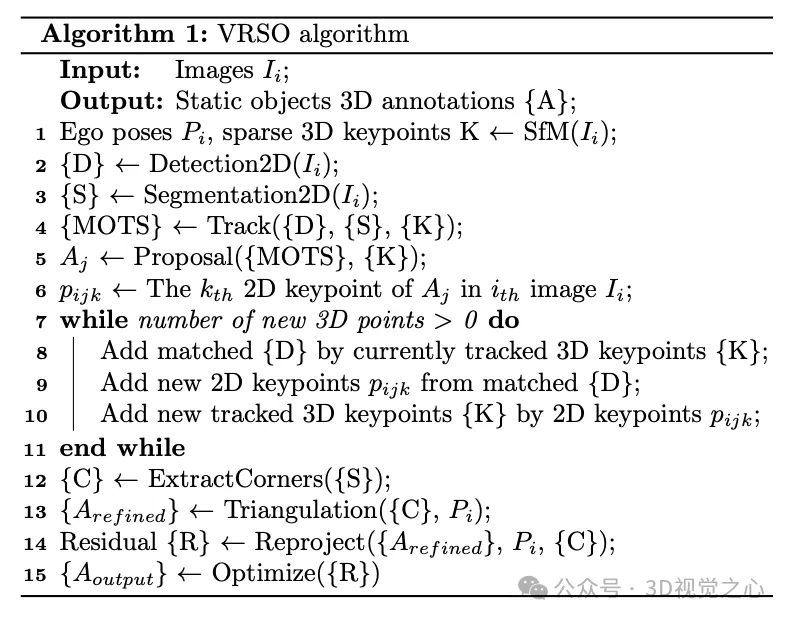

Algorithme d'annotation d'objets statiques, combiné à un pseudo-code, le processus général est le suivant (ce qui suit sera détaillé étape par étape) :

- Utilisation d'algorithmes de détection et de segmentation d'objets 2D prêts à l'emploi pour générer des candidats

- Utilisation du 3D-2D correspondance des points clés dans le modèle SFM Relations pour suivre les instances 2D à travers les images

- Introduction de la cohérence de reprojection pour optimiser les paramètres d'annotation 3D des objets statiques

1. Suivi des relations

- étape 1 : Extraire les limites 3D en fonction points clés du modèle SFM points 3D à l'intérieur de la boîte.

- étape 2 : Calculez les coordonnées de chaque point 3D sur la carte 2D en fonction de la relation de correspondance 2D-3D.

- étape 3 : Déterminez l'instance correspondante du point 3D sur la carte 2D actuelle en fonction des coordonnées de la carte 2D et des points d'angle de segmentation de l'instance.

- étape 4 : Déterminez la correspondance entre les observations 2D et les cadres de délimitation 3D pour chaque image 2D.

2.proposal génère

pour initialiser les paramètres de la boîte 3D (position, direction, taille) de l'objet statique pour l'ensemble du clip vidéo. Chaque point clé de SFM a une position 3D précise et une image 2D correspondante. Pour chaque instance 2D, les points caractéristiques du masque d'instance 2D sont extraits. Ensuite, un ensemble de points clés 3D correspondants peut être considéré comme candidat aux boîtes englobantes 3D.

Un panneau de signalisation est représenté comme un rectangle avec une orientation dans l'espace, qui possède 6 degrés de liberté, dont la translation (,,), l'orientation (θ) et la taille (largeur et hauteur). Compte tenu de sa profondeur, un feu tricolore possède 7 degrés de liberté. Les cônes de signalisation sont représentés de la même manière que les feux de circulation.

3.proposition affiner

- étape 1 : Extraire le contour de chaque objet statique de la segmentation d'instance 2D.

- étape 2 : Ajustez le cadre de délimitation orienté minimum (OBB) pour le contour du contour.

- étape 3 : Extrayez les sommets du cadre de délimitation minimum.

- étape 4 : Calculez la direction en fonction des sommets et des points centraux, et déterminez l'ordre des sommets.

- étape 5 : Le processus de segmentation et de fusion est effectué sur la base des résultats de la détection 2D et de la segmentation des instances.

- étape 6 : Détecter et rejeter les observations contenant des occlusions. L'extraction de sommets du masque de segmentation d'instance 2D nécessite que les quatre coins de chaque signe soient visibles. S'il y a des occlusions, des boîtes englobantes alignées sur l'axe (AABB) sont extraites de la segmentation de l'instance et le rapport de surface entre les AABB et les boîtes de détection 2D est calculé. S'il n'y a pas d'occlusions, ces deux méthodes de calcul de surface doivent être proches.

4. Triangulation

Obtenez la valeur initiale du sommet de l'objet statique dans des conditions 3D grâce à la triangulation.

En vérifiant le nombre de points clés dans les boîtes englobantes 3D obtenues par SFM et la segmentation des instances lors de la reconstruction de la scène, seules les instances dont le nombre de points clés dépasse le seuil sont considérées comme des observations stables et valides. Pour ces instances, la boîte englobante 2D correspondante est considérée comme une observation valide. Grâce à l'observation 2D de plusieurs images, les sommets du cadre de délimitation 2D sont triangulés pour obtenir les coordonnées du cadre de délimitation.

Pour les panneaux circulaires qui ne distinguent pas les sommets « inférieur gauche, supérieur gauche, supérieur droit, supérieur droit et inférieur droit » sur le masque, ces panneaux circulaires doivent être identifiés. En utilisant les résultats de détection 2D comme observations d'objets circulaires, des masques de segmentation d'instance 2D sont utilisés pour l'extraction de contours. Le point central et le rayon sont calculés via un algorithme d'ajustement des moindres carrés. Les paramètres du signe circulaire incluent le point central (,,), la direction (θ) et le rayon ().

5. Affinement du suivi

Correspondance des points de fonctionnalité de suivi basée sur SFM. Déterminez s'il convient de fusionner ces instances distinctes en fonction de la distance euclidienne des sommets du cadre de délimitation 3D et de la projection IoU du cadre de délimitation 2D. Une fois la fusion terminée, les points caractéristiques 3D au sein d'une instance peuvent être regroupés pour associer davantage de points caractéristiques 2D. L'association itérative 2D-3D est effectuée jusqu'à ce qu'aucun point caractéristique 2D ne puisse être ajouté.

6. Optimisation finale des paramètres

En prenant le signe rectangulaire comme exemple, les paramètres qui peuvent être optimisés incluent la position (,,), la direction (θ) et la taille (,), avec un total de six degrés. de liberté. Les principales étapes comprennent :

- Convertir six degrés de liberté en quatre points 3D et calculer la matrice de rotation.

- Projetez les quatre points 3D convertis sur l'image 2D.

- Calculez le résidu entre le résultat de la projection et le résultat du point de coin obtenu par segmentation d'instance.

- Utilisez Huber pour l'optimisation et la mise à jour des paramètres du cadre de délimitation

Effet d'annotation

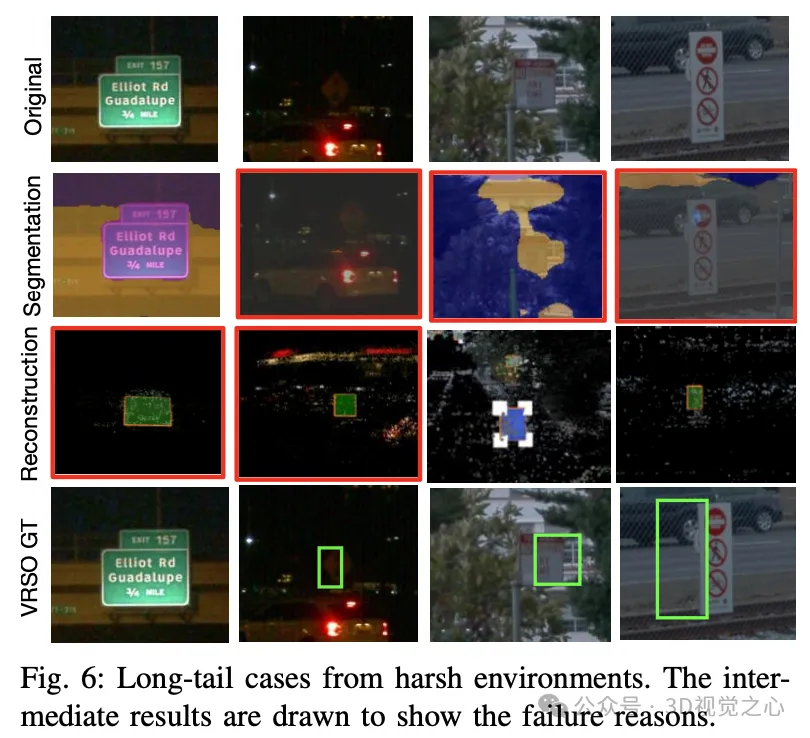

Il existe également des cas difficiles à longue traîne, tels qu'une résolution extrêmement basse et un éclairage insuffisant.

Pour résumer

Le cadre VRSO permet d'obtenir une annotation 3D de haute précision et cohérente d'objets statiques, intègre étroitement les algorithmes de détection, de segmentation et SFM, élimine l'intervention manuelle dans l'annotation de conduite intelligente et fournit des résultats comparables basés sur LiDAR. à l'annotation manuelle. Des évaluations qualitatives et quantitatives ont été menées avec l'ensemble de données ouvert Waymo largement reconnu : par rapport à l'annotation manuelle, la vitesse est augmentée d'environ 16 fois, tout en conservant la meilleure cohérence et précision.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Conception de combinaison de chasse, nouvelle berline phare de luxe intelligente : photo réelle de DENZA Z9GT

Apr 22, 2024 pm 02:10 PM

Conception de combinaison de chasse, nouvelle berline phare de luxe intelligente : photo réelle de DENZA Z9GT

Apr 22, 2024 pm 02:10 PM

Selon les informations du 22 avril, ce matin, le nouveau modèle phare de Denza, le Z9GT, a fait ses débuts. J'aimerais maintenant partager avec vous quelques photos réelles. Selon l'introduction officielle, la nouvelle voiture se positionne comme une berline phare de luxe intelligente, avec une longueur de 5 180 mm atteignant le niveau d'une berline de luxe de classe D. Le directeur du design mondial de BYD, Wolfgang Egger, a dirigé les efforts pour créer l'apparence. équipé de la technologie noire "e³", de multiples lidar et autres configurations, avec près de mille chevaux. En termes de design, la Denza Z9GT allie parfaitement les esthétiques orientales et occidentales, avec une face avant accrocheuse. Sur le côté de la carrosserie, la ligne décorative en forme de « Z » est exquise et lisse, et le centre de gravité de la carrosserie est relativement éloigné, créant une posture penchée vers l'arrière, très sportive. L'arrière du véhicule est rond et plein, et les feux arrière s'étendent du milieu vers les deux côtés, faisant écho aux ailes arrière électriques, apportant un haut degré de reconnaissance à l'ensemble du véhicule. valeur

Le Tank 300Hi4-T fait des débuts en force : la combinaison parfaite entre tout-terrain et intelligence

Apr 23, 2024 pm 06:16 PM

Le Tank 300Hi4-T fait des débuts en force : la combinaison parfaite entre tout-terrain et intelligence

Apr 23, 2024 pm 06:16 PM

Selon les informations du 23 avril, le très attendu Great Wall Tank 300Hi4-T a enfin officiellement atterri sur le marché. Ce modèle a attiré une grande attention en raison de sa configuration unique et de sa rareté limitée. Il est rapporté qu'une seule configuration du Tank 300Hi4-T est lancée cette fois, avec un prix de détail recommandé de 269 800 yuans, et seulement 3 000 unités sont disponibles à la vente. Du point de vue de la conception de l'apparence, le Tank 300Hi4-T présente une forte atmosphère tout-terrain. Il adopte un châssis tout-terrain professionnel avec une carrosserie non porteuse, ce qui montre que la stabilité et les capacités tout-terrain du véhicule sont améliorées. Dans la partie avant de la voiture, l'emblématique jeu de feux ronds complète la calandre horizontale à trois cadres, et la calandre chromée argentée donne au véhicule une apparence plus robuste et plus puissante. Les passages de roues et les rétroviseurs extérieurs de la même couleur que la carrosserie ajoutent au cachet de cette voiture.

Xiangjie S9 fait ses débuts au Salon de l'auto de Pékin, la première berline purement électrique de Huawei et BAIC Blue Valley est sur le point de faire ses débuts

Apr 23, 2024 pm 01:13 PM

Xiangjie S9 fait ses débuts au Salon de l'auto de Pékin, la première berline purement électrique de Huawei et BAIC Blue Valley est sur le point de faire ses débuts

Apr 23, 2024 pm 01:13 PM

Selon les derniers rapports du 23 avril, la très attendue berline purement électrique Enjoy S9 rencontrera le public pour la première fois au prochain Salon de l'auto de Pékin. Cette voiture est un chef-d'œuvre créé conjointement par BAIC Blue Valley et Huawei pour les deux géants de l'industrie. Elle se positionne sur le marché des moyennes et grandes berlines et devrait être vendue pour pas moins de 500 000 yuans. S9 a récemment terminé le processus de candidature correspondant auprès du ministère de l'Industrie et des Technologies de l'information, indiquant que son lancement officiel approche. À en juger par les informations exposées, la nouvelle voiture présente un design extérieur saisissant, utilisant un groupe d'éclairage LED moderne de type traversant, avec trois ensembles de sources lumineuses délicatement réparties dans le groupe de phares. Sa calandre fermée et son design accrocheur d'évent de dissipation de chaleur autour de l'avant créent ensemble un tempérament stable mais élégant. L'éditeur de données comprend et apprécie les lignes latérales élégantes du corps du S9.

La nouvelle génération de Great Wall Haval H6 et H9 sera dévoilée au Salon de l'auto de Pékin 2024

Apr 25, 2024 pm 07:07 PM

La nouvelle génération de Great Wall Haval H6 et H9 sera dévoilée au Salon de l'auto de Pékin 2024

Apr 25, 2024 pm 07:07 PM

Le 25 avril 2024, Great Wall Haval a fait une grande apparition au 18e Salon international de l'automobile de Pékin avec son Haval H6 de nouvelle génération, son Haval H9 de nouvelle génération, son Haval Raptor 2024 et d'autres modèles vedettes. China Haval jouit de la confiance du monde entier et la marque Haval accélère sa conquête du marché mondial. Lors de ce salon de l'automobile, Great Wall Haval a pour thème « China Haval, Trusted by the World », ce qui explique pleinement la solidité de la marque Haval. engagement envers les utilisateurs en tant qu'« expert mondial des SUV ». Great Wall Haval est profondément impliqué dans le domaine des SUV depuis 13 ans, motivé par l'innovation technologique, utilisant des capacités de produits de base et des services fiables pour fournir aux consommateurs des produits SUV de haute qualité. Du leadership en Chine à la mondialisation, Great Wall Haval continue de créer d'excellentes expériences de produits SUV, de répondre aux attentes et à la confiance d'un plus grand nombre d'utilisateurs et d'écrire la mondialisation des marques chinoises.

Les dernières nouvelles de l'Université d'Oxford ! Mickey : correspondance d'images 2D en 3D SOTA ! (CVPR\'24)

Apr 23, 2024 pm 01:20 PM

Les dernières nouvelles de l'Université d'Oxford ! Mickey : correspondance d'images 2D en 3D SOTA ! (CVPR\'24)

Apr 23, 2024 pm 01:20 PM

Lien du projet écrit devant : https://nianticlabs.github.io/mickey/ Étant donné deux images, la pose de la caméra entre elles peut être estimée en établissant la correspondance entre les images. En règle générale, ces correspondances sont 2D à 2D et nos poses estimées sont à échelle indéterminée. Certaines applications, telles que la réalité augmentée instantanée, à tout moment et en tout lieu, nécessitent une estimation de pose des métriques d'échelle, elles s'appuient donc sur des estimateurs de profondeur externes pour récupérer l'échelle. Cet article propose MicKey, un processus de correspondance de points clés capable de prédire les correspondances métriques dans l'espace d'une caméra 3D. En apprenant la correspondance des coordonnées 3D entre les images, nous sommes en mesure de déduire des métriques relatives.

Prenant en charge NOA pour les villes non illustrées, la marque Blue Mountain Smart Driving Edition de Great Wall Wei devrait être officiellement lancée en juin.

May 09, 2024 pm 09:10 PM

Prenant en charge NOA pour les villes non illustrées, la marque Blue Mountain Smart Driving Edition de Great Wall Wei devrait être officiellement lancée en juin.

May 09, 2024 pm 09:10 PM

Selon des informations publiées le 9 mai 2024, lors du Salon international de l'auto de Pékin de cette année, Wei Brand, une filiale de Great Wall Motors, a lancé un nouveau modèle, la Blue Mountain Smart Driving Edition, qui a attiré l'attention de nombreux visiteurs. Selon « Knowing Car Emperor's Vision », cette nouvelle voiture très attendue devrait atterrir officiellement sur le marché en juin de cette année. Le design de la Blue Mountain Smart Driving Edition continue de suivre l'apparence classique du Blue Mountain DHT-PHEV en vente, mais il a été considérablement amélioré en termes de perception de conduite intelligente. Ce qui attire le plus l'attention, c'est qu'un lidar de style tour de guet est installé sur le toit. Parallèlement, le véhicule est également équipé de radars à ondes millimétriques de 3 et de 12 radars à ultrasons, ainsi que de 11 caméras de perception visuelle haute définition. pour un total de 27 capteurs de conduite assistée améliorent considérablement les capacités de perception environnementale du véhicule. selon

La Denza Z9GT fera ses débuts au Salon de l'auto de Pékin 2024 et son prix à l'étranger pourrait dépasser le million de yuans

Apr 25, 2024 pm 07:52 PM

La Denza Z9GT fera ses débuts au Salon de l'auto de Pékin 2024 et son prix à l'étranger pourrait dépasser le million de yuans

Apr 25, 2024 pm 07:52 PM

Le 25 avril, le 18e Salon international de l'automobile de Pékin 2024 a officiellement débuté. Denza Motors a fait une apparition époustouflante dans le hall W4 avec la matrice de produits de luxe intelligents la plus puissante de l'histoire. Le stand était bondé de monde, ce qui en fait l'enregistrement le plus populaire. point à ce Salon de l'auto de Pékin ! Parmi eux, la Denza Z9GT fait ses débuts mondiaux. La nouvelle voiture se positionne comme une berline phare de luxe intelligente. C'est une autre œuvre phare de Wolfgang Egger, directeur du design du groupe BYD. Elle est également la première à utiliser la principale plate-forme technologique de rupture au monde. Yi Sanfang, ouvre la voie. La nouvelle tendance de l'électrification des voitures de luxe. Dirigée par Iger et dotée d'une technologie de rupture, la Denza Z9GT est au centre du salon de l'auto de cette année. En tant que premier modèle du nouveau concept de design de Denza « Élégance en mouvement », l'apparence de la Denza Z9GT est dirigée par Iger et est parfaitement conçue. .

Le LLM est terminé ! OmniDrive : Intégration de la perception 3D et de la planification du raisonnement (la dernière version de NVIDIA)

May 09, 2024 pm 04:55 PM

Le LLM est terminé ! OmniDrive : Intégration de la perception 3D et de la planification du raisonnement (la dernière version de NVIDIA)

May 09, 2024 pm 04:55 PM

Écrit ci-dessus et compréhension personnelle de l'auteur : cet article est dédié à la résolution des principaux défis des grands modèles de langage multimodaux (MLLM) actuels dans les applications de conduite autonome, c'est-à-dire le problème de l'extension des MLLM de la compréhension 2D à l'espace 3D. Cette expansion est particulièrement importante car les véhicules autonomes (VA) doivent prendre des décisions précises concernant les environnements 3D. La compréhension spatiale 3D est essentielle pour les véhicules utilitaires car elle a un impact direct sur la capacité du véhicule à prendre des décisions éclairées, à prédire les états futurs et à interagir en toute sécurité avec l’environnement. Les modèles de langage multimodaux actuels (tels que LLaVA-1.5) ne peuvent souvent gérer que des entrées d'images de résolution inférieure (par exemple) en raison des limitations de résolution de l'encodeur visuel et des limitations de la longueur de la séquence LLM. Cependant, les applications de conduite autonome nécessitent