Problème commun

Problème commun

Le cheminement vers la création de modèles linguistiques à grande échelle en 2024

Le cheminement vers la création de modèles linguistiques à grande échelle en 2024

Le cheminement vers la création de modèles linguistiques à grande échelle en 2024

2024 verra un bond en avant technologique dans les grands modèles de langage (LLM), alors que les chercheurs et les ingénieurs continuent de repousser les limites du traitement du langage naturel. Ces LLM riches en paramètres révolutionnent la façon dont nous interagissons avec les machines, permettant des conversations, une génération de code et un raisonnement plus complexes. Cependant, la création de ces géants n’est pas une tâche facile, car elle implique la complexité de la préparation des données, des techniques de formation avancées et une inférence évolutive. Cette revue approfondit les détails techniques nécessaires à la création de LLM, couvrant les avancées récentes depuis l'approvisionnement en données jusqu'aux innovations en matière de formation et aux stratégies d'alignement.

2024 s'annonce comme une ère marquante pour les grands modèles de langage (LLM), alors que les chercheurs et les ingénieurs repoussent les limites de ce qui est possible en matière de traitement du langage naturel. Ces réseaux neuronaux à grande échelle dotés de milliards, voire de milliards de paramètres, révolutionneront la façon dont nous interagissons avec les machines, permettant des conversations, une génération de code et un raisonnement multimodal plus naturels et plus ouverts.

Cependant, construire un LL.M d’une telle envergure n’est pas une mince affaire. Cela nécessite un pipeline soigneusement organisé, depuis la recherche et la préparation des données jusqu'aux techniques de formation avancées et à l'inférence évolutive. Dans cet article, nous approfondirons les complexités techniques impliquées dans la création de ces modèles de langage de pointe, en explorant les dernières innovations et défis de la pile.

Préparation des données

1. Sources de données

La base de tout LLM réside dans les données sur lesquelles il est formé, et les modèles modernes ingèrent des quantités stupéfiantes de texte (souvent plus d'un billion de jetons), ces textes proviennent du Web. robots d'exploration, référentiels de code, livres, etc. Les sources de données courantes incluent :

Corporamas Web fréquemment explorés

Référentiels de codes tels que GitHub et Software Heritage

Ensembles de données sélectionnés (domaine public ou protégé par le droit d'auteur) tels que Wikipédia et les livres

Données générées synthétiquement

2.

Obtenir simplement toutes les données disponibles n'est généralement pas optimal car cela peut introduire du bruit et des biais. Par conséquent, des techniques de filtrage de données minutieuses sont utilisées : Filtrage de qualité Filtrage heuristique basé sur les propriétés du document telles que la longueur et la langue Filtrage basé sur un classificateur utilisant des exemples de bonnes et de mauvaises données Perplexité du modèle de langage SeuilsSpécifiques au domaine filtrageVérifiez l'impact sur des sous-ensembles spécifiques au domaineDéveloppez des règles et des seuils personnalisésStratégie de sélectionSeuils durs déterministesÉchantillonnage aléatoire probabilisteDéduplication

Les grands corpus Web contiennent des chevauchements importants et des redondances. les documents peuvent amener le modèle à « mémoriser » trop de régions. Utilisez des algorithmes efficaces de détection de quasi-doublons tels que MinHash pour réduire ce biais de redondance.4. Tokenisation

Une fois que nous disposons d'un corpus de texte dédupliqué de haute qualité, nous devons le tokeniser : le convertir en une séquence de jetons que le réseau neuronal peut ingérer pendant l'entraînement. Le codage BPE omniprésent au niveau des octets est préféré et gère le code, la notation mathématique et d’autres contextes avec élégance. Un échantillonnage minutieux de l'ensemble des données est nécessaire pour éviter un surajustement du tokenizer lui-même.5. Évaluation de la qualité des données

Évaluer la qualité des données est une tâche difficile mais cruciale, surtout à une si grande échelle. Les techniques utilisées comprennent : Surveillance de références à signal élevé telles que Commonsense QA, HellaSwag et OpenBook QA pendant la formation de sous-ensembles Inspection manuelle des domaines/URL et inspection des exemples conservés/supprimés Outils de regroupement et de visualisation de données Aides à la formation Tokenizer pour analyser les jetons Formation1. Parallélisme des modèles

L'ampleur des LLM modernes (souvent trop volumineux pour tenir sur un seul GPU ou même une seule machine) nécessite des schémas de parallélisation avancés qui peuvent être combinés de différentes manières. Modèle réparti sur plusieurs appareils et machines : Parallélisme des données : répartir les lots sur plusieurs appareils Parallélisme tensoriel : diviser les poids et les activations du modèle entre les appareils Parallélisme du pipeline : traiter le modèle comme une séquence d'étapes et pipeliner entre les appareils Séquence parallélisme : divisez les séquences d'entrée individuelles pour évoluer davantage La combinaison de ces stratégies parallèles 4D peut s'adapter à des modèles avec des milliards de paramètres.2. Attention efficace

Le principal goulot d'étranglement informatique réside dans l'opération d'auto-attention au cœur de l'architecture Transformer. Des méthodes telles que Flash Attention et Factorized Kernels fournissent des implémentations d'attention hautement optimisées qui évitent d'implémenter inutilement la matrice d'attention complète.3. Formation stable

Atteindre une convergence stable à une échelle aussi extrême est un défi majeur. Les innovations dans ce domaine comprennent : Schémas d'initialisation améliorés Méthodes de transfert d'hyperparamètres telles que MuTransfer Plans de taux d'apprentissage optimisés tels que le recuit cosinusInnovation architecturale

Les percées récentes dans l'architecture des modèles ont considérablement amélioré les compétences du. LLM : Mixture-of-Experts (MoE) : chaque exemple active uniquement un sous-ensemble des paramètres du modèle, activé par le réseau de routage Mamba : une implémentation efficace d'une couche de mélange d'experts basée sur le hachageAlliance

Bien que la compétence soit cruciale, nous avons également besoin de LLM sûrs, authentiques, cohérents avec les valeurs et les conseils humains. C'est l'objectif de ce domaine émergent de l'alignement de l'intelligence artificielle :

Apprentissage par renforcement à partir de la rétroaction humaine (RLHF) : utiliser des signaux de récompense dérivés des préférences humaines pour la sortie du modèle afin d'affiner les méthodes telles que PPO, DPO, etc. activement exploré.

IA constitutionnelle : l'IA constitutionnelle code les règles et les instructions dans le modèle pendant le processus de formation, inculquant les comportements souhaités à partir de la base.

Inférence

Une fois notre LLM formé, nous devons l'optimiser pour une inférence efficace - en fournissant une sortie de modèle à l'utilisateur avec une latence minimale :

Quantisation : compresser les poids de grands modèles dans un format de faible précision, par exemple, int8 est moins cher à calculer et consomme beaucoup de mémoire ; les technologies couramment utilisées incluent GPTQ, GGML et NF4.

Décodage spéculatif : accélérez l'inférence en utilisant un petit modèle pour lancer un modèle plus grand, comme la méthode Medusa

Optimisation du système : la compilation juste à temps, la fusion du noyau et l'optimisation graphique CUDA peuvent encore augmenter la vitesse.

Conclusion

La création de modèles linguistiques à grande échelle en 2024 nécessite une architecture et une innovation minutieuses sur l'ensemble de la pile, de l'approvisionnement et du nettoyage des données aux systèmes de formation évolutifs et au déploiement efficace d'inférences. Nous n'avons évoqué que quelques-uns des points forts, mais le domaine évolue à un rythme incroyable, avec l'émergence constante de nouvelles technologies et de découvertes. Les défis liés à l’évaluation de la qualité des données, à la convergence stable à grande échelle, à la cohérence avec les valeurs humaines et à un déploiement robuste dans le monde réel restent des domaines ouverts. Mais le potentiel d’un LL.M. est énorme – restez à l’écoute alors que nous repoussons les limites de ce qui est possible avec l’IA linguistique en 2024 et au-delà !

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Comment exécuter le projet H5

Apr 06, 2025 pm 12:21 PM

Comment exécuter le projet H5

Apr 06, 2025 pm 12:21 PM

L'exécution du projet H5 nécessite les étapes suivantes: Installation des outils nécessaires tels que le serveur Web, Node.js, les outils de développement, etc. Créez un environnement de développement, créez des dossiers de projet, initialisez les projets et écrivez du code. Démarrez le serveur de développement et exécutez la commande à l'aide de la ligne de commande. Aperçu du projet dans votre navigateur et entrez l'URL du serveur de développement. Publier des projets, optimiser le code, déployer des projets et configurer la configuration du serveur Web.

Gitee Pages STATIQUE Le déploiement du site Web a échoué: comment dépanner et résoudre les erreurs de fichier unique 404?

Apr 04, 2025 pm 11:54 PM

Gitee Pages STATIQUE Le déploiement du site Web a échoué: comment dépanner et résoudre les erreurs de fichier unique 404?

Apr 04, 2025 pm 11:54 PM

GiteEpages STATIQUE Le déploiement du site Web a échoué: 404 Dépannage des erreurs et résolution lors de l'utilisation de Gitee ...

La production de pages H5 nécessite-t-elle une maintenance continue?

Apr 05, 2025 pm 11:27 PM

La production de pages H5 nécessite-t-elle une maintenance continue?

Apr 05, 2025 pm 11:27 PM

La page H5 doit être maintenue en continu, en raison de facteurs tels que les vulnérabilités du code, la compatibilité des navigateurs, l'optimisation des performances, les mises à jour de sécurité et les améliorations de l'expérience utilisateur. Des méthodes de maintenance efficaces comprennent l'établissement d'un système de test complet, à l'aide d'outils de contrôle de version, de surveiller régulièrement les performances de la page, de collecter les commentaires des utilisateurs et de formuler des plans de maintenance.

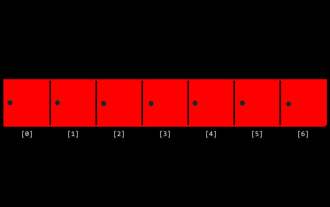

CS-semaine 3

Apr 04, 2025 am 06:06 AM

CS-semaine 3

Apr 04, 2025 am 06:06 AM

Les algorithmes sont l'ensemble des instructions pour résoudre les problèmes, et leur vitesse d'exécution et leur utilisation de la mémoire varient. En programmation, de nombreux algorithmes sont basés sur la recherche et le tri de données. Cet article présentera plusieurs algorithmes de récupération et de tri de données. La recherche linéaire suppose qu'il existe un tableau [20,500,10,5,100,1,50] et doit trouver le numéro 50. L'algorithme de recherche linéaire vérifie chaque élément du tableau un par un jusqu'à ce que la valeur cible soit trouvée ou que le tableau complet soit traversé. L'organigramme de l'algorithme est le suivant: Le pseudo-code pour la recherche linéaire est le suivant: Vérifiez chaque élément: Si la valeur cible est trouvée: return True return false C Implementation: # include # includeIntMain (void) {i

Comment convertir XML en Excel

Apr 03, 2025 am 08:54 AM

Comment convertir XML en Excel

Apr 03, 2025 am 08:54 AM

Il existe deux façons de convertir XML en Excel: utilisez des fonctionnalités Excel intégrées ou des outils tiers. Les outils tiers incluent XML pour Excel Converter, XML2Excel et XML Candy.

Comment construire rapidement une page de premier plan dans un projet React Vite à l'aide d'outils AI?

Apr 04, 2025 pm 01:45 PM

Comment construire rapidement une page de premier plan dans un projet React Vite à l'aide d'outils AI?

Apr 04, 2025 pm 01:45 PM

Comment construire rapidement une page frontale en développement back-end? En tant que développeur backend avec trois ou quatre ans d'expérience, il a maîtrisé le JavaScript de base, CSS et HTML ...

Pouvez-vous apprendre à faire des pages H5 par vous-même?

Apr 06, 2025 am 06:36 AM

Pouvez-vous apprendre à faire des pages H5 par vous-même?

Apr 06, 2025 am 06:36 AM

Il est possible de l'auto-étude de la production de pages H5, mais ce n'est pas un succès rapide. Il nécessite la maîtrise de HTML, CSS et JavaScript, impliquant la conception, le développement frontal et la logique d'interaction arrière. La pratique est la clé et apprenez en terminant des tutoriels, en examinant le matériel et en participant à des projets open source. L'optimisation des performances est également importante, nécessitant une optimisation des images, la réduction des demandes HTTP et l'utilisation de cadres appropriés. La route vers l'auto-apprentissage est longue et nécessite un apprentissage et une communication continus.

Comment optimiser les performances de la conversion XML en images?

Apr 02, 2025 pm 08:12 PM

Comment optimiser les performances de la conversion XML en images?

Apr 02, 2025 pm 08:12 PM

La conversion XML à l'image est divisée en deux étapes: analyser le XML pour extraire les informations d'image et générer des images. L'optimisation des performances peut être démarrée avec la sélection des méthodes d'analyse (telles que le sax), des bibliothèques graphiques (telles que PIL) et l'utilisation d'accélération multithreading / GPU. L'analyse de sax est plus adaptée à la gestion de grands XML. La bibliothèque PIL est simple et facile à utiliser mais a des performances limitées. L'utilisation complète de la lecture multithre et de l'accélération GPU peut considérablement améliorer les performances.