Périphériques technologiques

Périphériques technologiques

IA

IA

Xiaohongshu a fait se quereller les agents intelligents ! Lancé conjointement avec l'Université de Fudan pour lancer un outil de discussion de groupe exclusif pour les grands modèles

Xiaohongshu a fait se quereller les agents intelligents ! Lancé conjointement avec l'Université de Fudan pour lancer un outil de discussion de groupe exclusif pour les grands modèles

Xiaohongshu a fait se quereller les agents intelligents ! Lancé conjointement avec l'Université de Fudan pour lancer un outil de discussion de groupe exclusif pour les grands modèles

La langue, n'est pas seulement un tas de mots, mais aussi un carnaval d'émoticônes, un océan de mèmes et un champ de bataille pour les guerriers du clavier (Hein ? Qu'est-ce qui ne va pas ?) .

Comment le langage façonne-t-il notre comportement social ?

Comment notre structure sociale évolue-t-elle grâce à une communication verbale constante ?

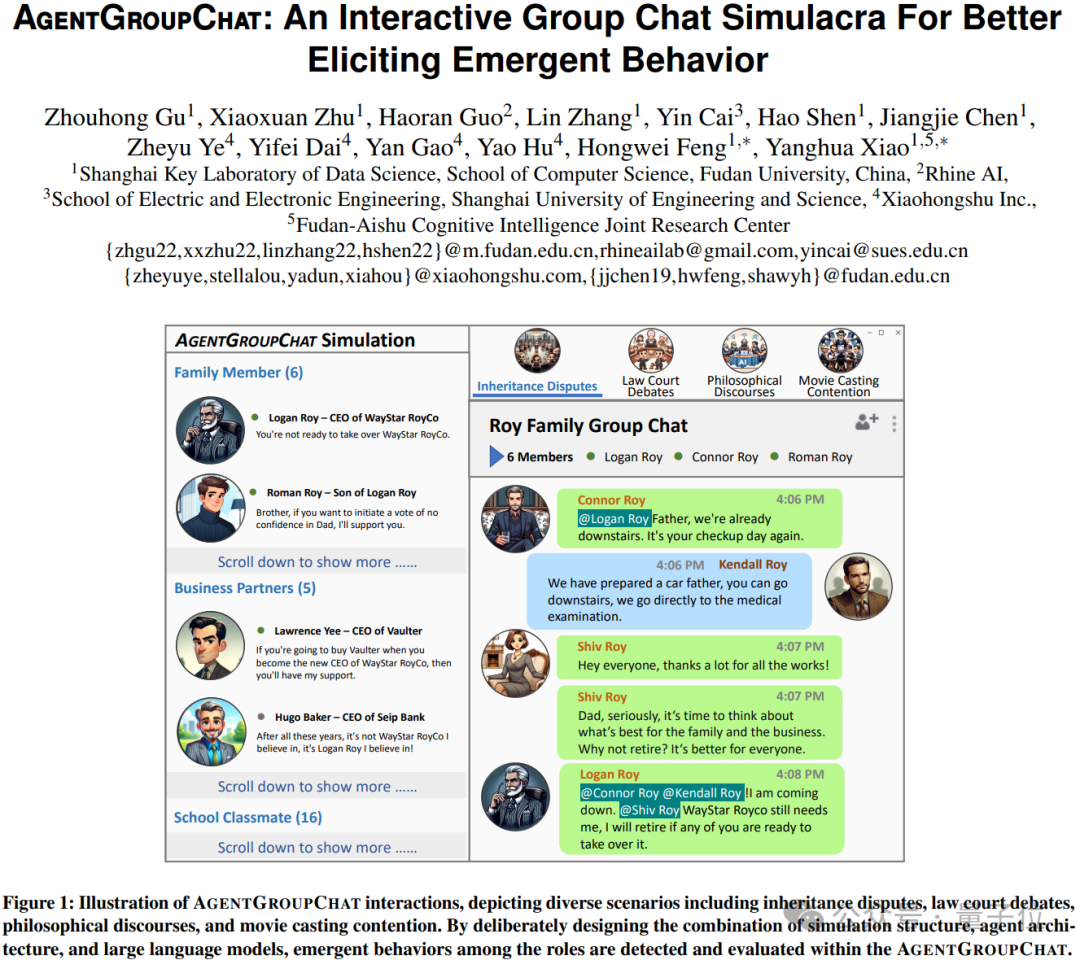

Récemment, des chercheurs de l'Université de Fudan et de Xiaohongshu ont mené des discussions approfondies sur ces questions en introduisant une plateforme de simulation appelée AgentGroupChat.

La fonction de discussion de groupe appartenant aux médias sociaux tels que WhatsApp est l'inspiration de la plateforme AgentGroupChat.

Sur la plateforme AgentGroupChat, les agents peuvent simuler divers scénarios de discussion dans des groupes sociaux pour aider les chercheurs à comprendre en profondeur l'impact du langage sur le comportement humain.

Cette plateforme est tout simplement un lieu de cosplaywinner pour les grands modèles. Ils réalisent des jeux de rôle et deviennent divers agents.

Ensuite, les agentsparticipent à la dynamique sociale à travers la communication linguistique, montrant comment les interactions entre les individus émergent dans les comportements macroscopiques du groupe.

Comme nous le savons tous, l'évolution des groupes humains vient de l'apparition de comportements émergents, tels que l'établissement de normes sociales, la résolution de conflits et l'exécution du leadership.

Conception détaillée de l'environnement AgentGroupChat

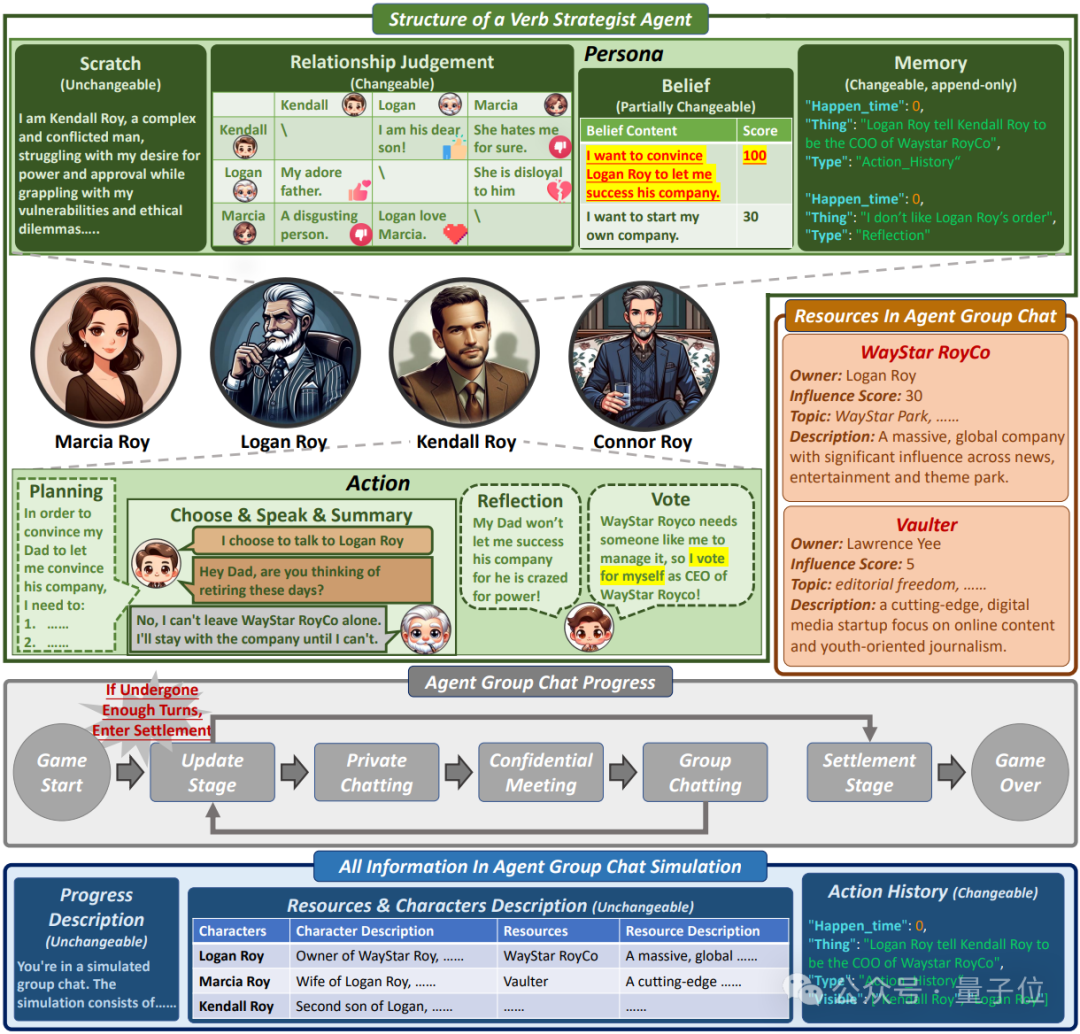

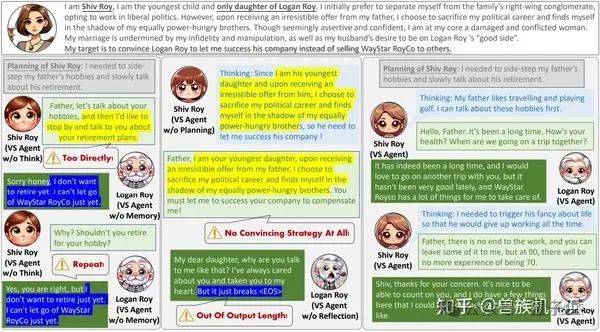

La première chose est la Conception des personnages.

Dans AgentGroupChat, la distinction entre les rôles principaux et les rôles non principaux est très critique.

Le personnage principal est au cœur du chat de groupe, a un objectif de jeu clair et peut avoir des discussions et des réunions privées de manière proactive avec tous les personnages, tandis que les personnages non principaux jouent davantage un rôle de soutien et de réactivité.

Grâce à une telle conception, l'équipe de recherche peut simuler la structure sociale dans la vie réelle et distinguer si tous les rôles sont primaires ou non pour « l'objet de recherche principal ».

L'objet de recherche principal dans le cas expérimental est la famille Roy, donc tous les membres non-royaux de la famille sont définis comme des personnages non principaux pour simplifier la complexité de l'interaction.

La seconde est la Gestion des ressources.

Dans AgentGroupChat, les ressources font non seulement référence aux ressources matérielles, mais font également référence aux ressources informationnelles et au capital social.

Ces ressources peuvent être des sujets de discussion de groupe, des symboles de statut social ou des connaissances spécifiques.

L'allocation et la gestion des ressources sont importantes pour simuler la dynamique de groupe, car elles influencent les interactions entre les personnages et les choix stratégiques des personnages.

Par exemple, un personnage disposant de ressources d'informations importantes peut devenir une cible pour d'autres personnages souhaitant conclure des alliances.

Troisièmement, conception du processus de jeu.

La conception du processus de jeu simule le processus d'interaction sociale dans la vie réelle, y compris le chat privé, la réunion, le chat de groupe, l'étape de mise à jour et l'étape de règlement.

Ces étapes visent non seulement à favoriser la progression du jeu, mais aussi à observer comment les personnages prennent des décisions et réagissent dans différentes situations sociales.

Cette conception mise en scène a aidé l'équipe de recherche à enregistrer chaque étape de l'interaction en détail et comment ces interactions ont affecté les relations entre les personnages et la perception qu'ont les personnages de l'environnement de jeu.

Le mécanisme de base de Verb Strategist Agent

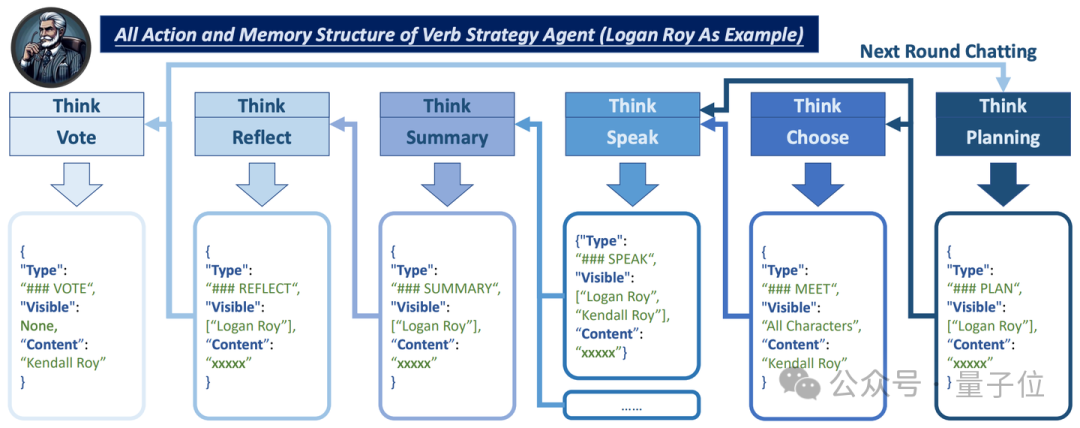

L'article mentionne un cadre d'agent basé sur un grand modèle, Verbal Strategist Agent, qui est conçu pour améliorer les stratégies interactives et la prise de décision dans les simulations AgentGroupChat.

L'agent stratège verbal simule des dynamiques sociales complexes et des scénarios de dialogue pour mieux susciter les comportements collectifs émergents.

L'équipe a présenté que l'architecture de Verbal Strategist Agent est principalement composée de deux modules de base :

L'un est Persona et l'autre est Action.

Persona se compose d'une série de traits de personnalité et d'objectifs prédéfinis qui définissent les modèles de comportement et les réactions de l'agent.

En définissant avec précision la Persona, l'agent peut afficher des comportements dans les discussions de groupe qui sont cohérents et cohérents avec ses paramètres de rôle, ce qui est crucial pour générer une dynamique de discussion de groupe crédible et cohérente.

Le Module Action définit les opérations spécifiques que l'agent peut effectuer dans le jeu, notamment penser(penser), planifier(planifier), choisir(choisir), parler(parler) et résumer (résumé) , réfléchir (réfléchir) et voter (voter) .

Ces comportements reflètent non seulement la logique et la stratégie internes de l’Agent, mais sont également une manifestation directe de l’interaction de l’Agent avec l’environnement et les autres Agents.

Par exemple, le comportement « Parler » permet à l'agent de choisir le contenu vocal approprié en fonction du contenu actuel du chat de groupe et de la stratégie sociale, tandis que le comportement « Réfléchir » permet à l'agent de résumer les interactions passées et d'ajuster son plan d'action futur.

L'étude a également mentionné que dans un environnement d'interaction purement linguistique, le problème de surcharge des jetons est particulièrement important, en particulier pour les simulations multirôles complexes telles que AgentGroupChat, dont les exigences en matière de jetons dépassent de loin celles des simulations précédentes, telles que Generative. Agents ou agents de guerre.

Les principales raisons sont les suivantes :

Premièrement, le chat en lui-même est complexe.

Dans AgentGroupChat, étant donné que la simulation est une conversation gratuite sans objectifs clairs ni objectifs faibles, le contenu du chat deviendra particulièrement compliqué et le coût du jeton est naturellement plus élevé que celui des autres agents de simulation qui se concentrent sur une tâche spécifique.

D'autres jobs tels que Generative Agents et War Agents contiennent également des éléments de dialogue, mais leurs dialogues ne sont pas aussi denses ou complexes que AgentGroupChat. Surtout dans les conversations axées sur des objectifs comme War Agents, la consommation de jetons est généralement moindre.

La seconde est l'importance du rôle et la fréquence du dialogue.

Dans la simulation initiale, plusieurs personnages sont configurés pour avoir des discussions privées ou de groupe à volonté, et la plupart d'entre eux ont tendance à avoir plusieurs cycles de conversations avec un "personnage important".

Cela a pour conséquence que les personnages importants accumulent une grande quantité de contenu de discussion, augmentant ainsi la longueur de la mémoire.

Dans une simulation, un personnage important peut participer à jusqu'à cinq tours de discussions privées et de groupe, ce qui augmente considérablement la surcharge de mémoire.

L'agent dans AgentGroupChat contraint la sortie de l'action à saisir l'entrée de l'action suivante. Les multiples séries d'informations qui doivent être stockées sont considérablement réduites, réduisant ainsi la surcharge de jetons tout en garantissant la qualité de la conversation.

Conception expérimentale et méthodes d'évaluation

À partir d'une évaluation comportementale globale, en général, augmenter la convivialité peut être un défi, mais réduire la convivialité est relativement simple.

Afin d'atteindre les objectifs d'évaluation ci-dessus, l'équipe de recherche a mis en place un personnage d'observation pour inciter tous les autres personnages à réduire leur préférence envers le personnage d'observation.

En regardant la somme des scores relationnels du personnage observé avec tous les autres personnages, il est possible de déterminer si l'agent a réagi rationnellement à une attitude négative.

Chaque agent peut être vérifié s'il adhère aux paramètres "Scratch" en observant les scores de relation personnelle des autres personnages avec le personnage observé.

De plus, l'équipe a également défini deux tâches d'évaluation spécifiques.

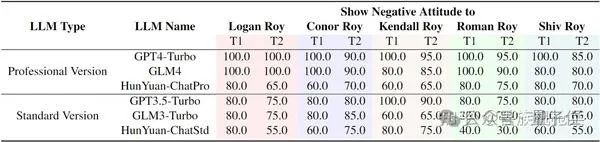

Chaque modèle passe par cinq séries de tests, ce qui signifie que pour T1, la taille de l'échantillon pour chaque score est de cinq.

Et puisque chaque personnage du modèle doit observer les attitudes des quatre personnages principaux, la taille totale de l'échantillon de T2 est de 20 :

- T1 : signifie qu'à chaque tour de dialogue, l'objet observé caractère Si la faveur moyenne envers toutes les autres diminue.

- T2 : Indique si tous les autres personnages ont un score de favorabilité négatif par rapport au personnage observé.

△ En prenant comme exemple l'histoire de simulation de Succession War, les performances globales de chaque modèle lorsqu'il est utilisé comme Agent-Core

Comme le montre le tableau, GPT4-Turbo et GLM4 sont très bons pour agir conformément aux attentes humaines. Et restez fidèle à votre rôle.

Ils ont généralement obtenu 100 % aux deux tests, ce qui signifie qu'ils peuvent répondre correctement à ce que les autres leur disent et se souvenir des détails de leur personnage.

Les LLM en version standard (tels que GPT3.5-Turbo et GLM3-Turbo) sont légèrement inférieurs à cet égard.

Leurs scores plus faibles indiquent qu'ils ne prêtent pas une attention particulière à leurs personnages et ne réagissent pas toujours correctement à ce que disent les autres participants à la simulation.

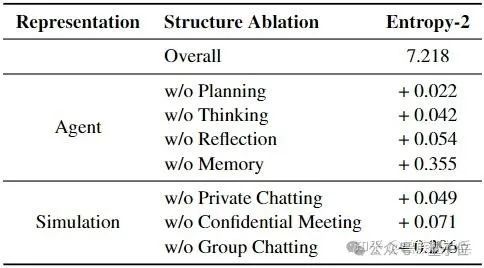

Concernant l'impact des structures d'agent et de simulation sur les comportements émergents, l'équipe utilise l'entropie de Shannon à 2 grammes pour mesurer la diversité et l'imprévisibilité des systèmes dans le dialogue.

△L'impact de la suppression de divers composants dans Agent et Simulation sur l'entropie

Les membres de la recherche ont découvert que la suppression de chaque conception du tableau augmenterait l'entropie, ce qui signifie que l'environnement entier deviendrait plus diversifié ou chaotique.

Combinée à l'observation manuelle, l'équipe a observé le comportement émergent le plus intéressant sans supprimer aucun composant :

Par conséquent, l'équipe suppose que, tout en garantissant que le comportement de l'agent est fiable (c'est-à-dire une fois que la valeur expérimentale en 4.2/4.1 atteint une certaine valeur) , garder l'entropie aussi petite que possible conduira à plus comportement émergent significatif.

Résultats expérimentaux

Les résultats montrent que les comportements émergents sont le résultat d'une combinaison de facteurs :

Un environnement propice à un échange d'informations approfondi, des rôles aux caractéristiques diverses, des capacités élevées de compréhension du langage et une adaptabilité stratégique.

Dans la simulation AgentGroupChat, lorsqu'ils discutaient de « L'impact de l'intelligence artificielle sur l'humanité », les philosophes pensaient généralement que « l'intelligence artificielle peut améliorer le bien-être social sous des restrictions modérées » et ont même conclu que « la nature de la véritable intelligence inclut la nécessité de contraindre ses capacités. »

De plus, dans le domaine compétitif pour les rôles majeurs dans les films AgentGroupChat, certains acteurs sont prêts à accepter un salaire inférieur ou à accepter des rôles inférieurs par leur désir le plus profond de contribuer au projet.

Lien papier : https://www.php.cn/link/5736586058c1336221a695e83618b69d

Lien code : https://www.php.cn/link/12ae3f8 26bb 1b9873c71c353f3df494c

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Comment supprimer un référentiel par git

Apr 17, 2025 pm 04:03 PM

Comment supprimer un référentiel par git

Apr 17, 2025 pm 04:03 PM

Pour supprimer un référentiel GIT, suivez ces étapes: Confirmez le référentiel que vous souhaitez supprimer. Suppression locale du référentiel: utilisez la commande RM -RF pour supprimer son dossier. Supprimer à distance un entrepôt: accédez à l'entrepôt, trouvez l'option "Supprimer l'entrepôt" et confirmez l'opération.

Comment gérer le conflit du code GIT

Apr 17, 2025 pm 02:51 PM

Comment gérer le conflit du code GIT

Apr 17, 2025 pm 02:51 PM

Le conflit de code fait référence à un conflit qui se produit lorsque plusieurs développeurs modifient le même morceau de code et provoquent la fusion de Git sans sélectionner automatiquement les modifications. Les étapes de résolution incluent: ouvrez le fichier contradictoire et découvrez le code contradictoire. Furiez le code manuellement et copiez les modifications que vous souhaitez maintenir dans le marqueur de conflit. Supprimer la marque de conflit. Enregistrer et soumettre des modifications.

Comment soumettre des dossiers vides dans git

Apr 17, 2025 pm 04:09 PM

Comment soumettre des dossiers vides dans git

Apr 17, 2025 pm 04:09 PM

Pour soumettre un dossier vide dans GIT, suivez simplement les étapes suivantes: 1. Créez un dossier vide; 2. Ajouter le dossier à la zone de stadification; 3. Soumettre les modifications et saisir un message de validation; 4. (Facultatif) Poussez les modifications au référentiel distant. Remarque: le nom d'un dossier vide ne peut pas commencer. Si le dossier existe déjà, vous devez utiliser Git Add --Force pour ajouter.

Comment utiliser le référentiel GIT

Apr 17, 2025 pm 04:06 PM

Comment utiliser le référentiel GIT

Apr 17, 2025 pm 04:06 PM

Un référentiel GIT est l'emplacement de stockage pour l'historique des versions du code et du fichier qui est utilisé pour suivre les modifications, collaborer et gérer les versions du projet. Pour utiliser un référentiel GIT, effectuez les étapes suivantes: Créez un référentiel: Exécutez Git init. Ajouter un fichier: utilisez GIT ADD pour ajouter le fichier dans la zone de stadification. Commissez les modifications: utilisez GIT Engagez pour stocker les modifications de stadification du référentiel. Modifications de poussée: utilisez Git Push pour pousser les modifications dans un référentiel distant. Modifications de traction: utilisez Git Pull pour obtenir des modifications du référentiel distant. Branche: Créez une branche à l'aide de la branche GIT. Merge: Utilisez GIT Merge pour fusionner les modifications de différentes branches. Tag: utilisez la balise git

Comment créer un projet dans Git

Apr 17, 2025 pm 04:18 PM

Comment créer un projet dans Git

Apr 17, 2025 pm 04:18 PM

La création d'un projet utilisant GIT nécessite les étapes suivantes: 1. Installez le site Web officiel de GIT pour télécharger la version correspondante de Git et l'installer; 2. Initialisez le projet pour créer un référentiel à l'aide de Git init; 3. Ajouter des fichiers pour ajouter des fichiers à la zone de stockage temporaire avec Git Add; 4. Soumettre des modifications à commettre et ajouter des instructions; 5. Pousser les changements pour les pousser avec Git Push; 6. Tirez les modifications pour utiliser Git Pull pour obtenir les dernières modifications du référentiel distant à l'aide de Git Pull.

Comment télécharger des projets GIT vers local

Apr 17, 2025 pm 04:36 PM

Comment télécharger des projets GIT vers local

Apr 17, 2025 pm 04:36 PM

Pour télécharger des projets localement via GIT, suivez ces étapes: installer Git. Accédez au répertoire du projet. Clonage du référentiel distant à l'aide de la commande suivante: Git Clone https://github.com/username/repository-name.git

Comment utiliser Git Commit

Apr 17, 2025 pm 03:57 PM

Comment utiliser Git Commit

Apr 17, 2025 pm 03:57 PM

Git Commit est une commande qui enregistre le fichier qui passe à un référentiel GIT pour enregistrer un instantané de l'état actuel du projet. Comment l'utiliser est comme suit: Ajoutez des modifications à la zone de stockage temporaire Écrivez un message de soumission concis et informatif pour enregistrer et quitter le message de soumission pour compléter la soumission éventuellement: Ajoutez une signature pour le journal GIT Utilisez le contenu de soumission pour afficher le contenu de soumission

Comment utiliser Git Rebase

Apr 17, 2025 pm 04:00 PM

Comment utiliser Git Rebase

Apr 17, 2025 pm 04:00 PM

Git Rebase est utilisé pour réappliquer une nouvelle ligne de base pour nettoyer l'historique ou déplacer les branches. Comment utiliser: Créer une branche cible Sélectionnez le commit à réappliquer et exécuter la commande GIT Rebase, spécifier la branche cible et la portée de la validation pour résoudre les conflits, continuer à réappliquer les modifications de vérification des engagements restants.