AIxivコラムは、当サイトが学術的・技術的な内容を掲載するコラムです。過去数年間で、このサイトの AIxiv コラムには 2,000 件を超えるレポートが寄せられ、世界中の主要な大学や企業のトップ研究室がカバーされ、学術交流と普及を効果的に促進しています。共有したい優れた作品がある場合は、お気軽に寄稿するか、報告のために当社までご連絡ください。提出電子メール: liyazhou@jiqizhixin.com; zhaoyunfeng@jiqizhixin.com

この論文の筆頭著者は孫文、コンピュータサイエンス学部修士課程2年生のChen Jiahaoです。大学では、ニューラルレンダリングと三次元再構成を研究指導者としています。この論文は彼の最初の作品でした。この論文の責任著者は、中山大学コンピューターサイエンス学部および人間・機械・オブジェクト知能統合研究室のリー・グアンビン教授であり、博士課程の指導教員であり、国家優秀青少年基金の受賞者でもある。チームの主な研究分野は、視覚認識、シーンモデリング、理解、生成です。現在までに、CCF カテゴリ A/CAS エリア 1 の論文を 150 本以上発表しており、Google Scholar に 12,000 回以上引用されており、Wu Wenjun Artificial Intelligence Outstanding Youth Award などの賞を受賞しています。 Neural Radiance Fields (NeRF) は、提案されて以来、新しい視点の合成と 3 次元の再構成における優れたパフォーマンスにより大きな注目を集めてきました。 NeRF のレンダリング品質や実行速度を向上させるために多くの取り組みが行われていますが、実際的な問題についてはほとんど言及されていません: モデル化するシーンに予期せぬ一時的な干渉が現れた場合、その影響を排除する方法ネフ? この記事では、中山大学、カーディフ大学、ペンシルベニア大学、および Simou Technology の研究者がこれについて詳細な研究を実施し、この問題を解決するための新しいパラダイムを提案しました。 この手法は、既存手法の長所と短所をまとめ、既存技術の応用アイデアを広げることで、さまざまなシーンにおける静的要素と一時的要素を正確に区別し、NeRFのレンダリング品質を向上させるだけでなく、 CVPR 2024 の最優秀論文候補の最終候補に選ばれました。

- 論文リンク: https://arxiv.org/abs/2403.17537

- プロジェクトリンク: https://www.sysu-hcp.net/projects/cv/132.html

この作品を一緒に理解しましょう。

新しい遠近合成は、コンピュータービジョンとグラフィックスにおける重要なタスクです。アルゴリズムモデルは、指定されたマルチビュー画像とカメラポーズを使用して、ターゲットポーズに対応する画像を生成する必要があります。 。 NeRF はこのタスクに関して重要なブレークスルーを達成しましたが、その有効性は静的なシーンの想定に関連しています。

具体的には、NeRF では、モデル化されるシーンが撮影プロセス中に静止したままであること、およびマルチビュー画像のコンテンツが一貫している必要があります。実際には、屋外での撮影では、シーン外の車両や通行人がレンズ内でランダムに動き、屋内での撮影では、意図せず物体や影がレンズを遮ってしまう可能性があります。このタイプのシーンの外側で動きや不一致を示す要素を、一時的なディストラクターと呼びます。それらを除去できない場合、NeRF のレンダリング結果にアーティファクトが生じます。

(一時的な干渉(黄色のボックス)の存在により、多数の疑似反射鏡が発生する可能性があります。 現在の一時的な干渉源の問題を解決する方法は、大きく分けて 2 種類あります。

(一時的な干渉(黄色のボックス)の存在により、多数の疑似反射鏡が発生する可能性があります。 現在の一時的な干渉源の問題を解決する方法は、大きく分けて 2 種類あります。

最初の方法は、セマンティック セグメンテーションなどの既存のセグメンテーション モデルを使用して、ディストラクターに関連するマスクを明示的に取得し、NeRF のトレーニング時に対応するピクセルをマスクします。このような方法では正確なセグメンテーション結果を生成できますが、万能ではありません。これは、ディストラクタに関する事前知識 (オブジェクト カテゴリ、初期マスクなど) を事前に知る必要があり、モデルはこれらのディストラクタを識別できるためです。 最初の方法とは異なり、2 番目の方法は、ヒューリスティック アルゴリズムを使用して、NeRF をトレーニングするときに一時的なディストラクターを暗黙的に処理し、事前知識を必要としません

。このような方法はより一般的ですが、設計の複雑さと高度な姿勢不良のため、一時的な気が散る要素と静的なシーン要素を正確に分離することができません。たとえば、一時的なピクセルに対応するカラー テクスチャは異なる視野角で一貫性がないため、NeRF をトレーニングする場合、このピクセルの予測値と真の値の間の色の残差は、多くの場合、静的なピクセルの残差よりも大きくなります。ただし、シーン内の高周波の静的ディテールにも、フィッティングの難しさにより過剰な残差が生じるため、残留しきい値を設定して一時的な干渉を除去する一部の方法では、高周波の静的ディテールが簡単に失われる可能性があります。

既存の手法とこの論文で提案するヒューリスティックガイドセグメンテーション(HuGS)との比較。静的なシーンが一時的な妨害物によって妨害される場合、(a) セグメンテーション ベースの方法は事前の知識に依存し、予期しない一時的なオブジェクト (ピザなど) を識別できないため、関連するアーティファクトが発生します。(b) ヒューリスティック ベースの方法。この方法はより一般的ですが、精度が十分ではありません(たとえば、高周波の静的なテーブルクロスのテクスチャが失われます)、(c)HuGS はそれらの利点を組み合わせて、一時的なディストラクタと静的なシーン要素を正確に分離できるため、NeRF の結果が大幅に向上します。

既存の手法とこの論文で提案するヒューリスティックガイドセグメンテーション(HuGS)との比較。静的なシーンが一時的な妨害物によって妨害される場合、(a) セグメンテーション ベースの方法は事前の知識に依存し、予期しない一時的なオブジェクト (ピザなど) を識別できないため、関連するアーティファクトが発生します。(b) ヒューリスティック ベースの方法。この方法はより一般的ですが、精度が十分ではありません(たとえば、高周波の静的なテーブルクロスのテクスチャが失われます)、(c)HuGS はそれらの利点を組み合わせて、一時的なディストラクタと静的なシーン要素を正確に分離できるため、NeRF の結果が大幅に向上します。

セグメンテーションモデルに基づく方法は正確ですが普遍的ではなく、ヒューリスティックアルゴリズムに基づく方法は普遍的ですが不正確です。お互いの強みを補い合って、それは正確かつ普遍的ですか?

そこで、論文の著者は、「コースの馬」を動機として、ヒューリスティックガイド付きセグメンテーション (HuGS) と呼ばれる新しいパラダイム

を提案しました。 HuGS は、手作業で設計されたヒューリスティックとキュー駆動のセグメンテーション モデルを巧みに組み合わせることで、追加の事前知識がなくても、シーン内の一時的な注意散漫要素と静的要素を正確に区別できます。

具体的には、HuGS はまずヒューリスティック アルゴリズムを使用して、マルチビュー画像内の静的な一時的な要素を大まかに区別し、大まかな手がかりを出力します。次に、その大まかな手がかりを使用してセグメンテーション モデルをガイドし、より正確なセグメンテーション マスクを生成します。 NeRF をトレーニングする場合、これらのマスクは一時的なピクセルをシールドし、NeRF に対する一時的なディストラクターの影響を排除するために使用されます。 HuGSのデザインアイデア。 具体的な実装に関して、論文の著者は HuGS のセグメンテーション モデル

HuGS のセグメンテーション モデル

として Segment Anything Model (SAM) を選択しました。 SAM は現在、最も高度なプロンプト駆動のセグメンテーション モデルであり、ポイント、ボックス、マスクなどのさまざまな種類のプロンプト入力を受け入れ、対応するインスタンス セグメンテーション マスクを出力できます。

ヒューリスティックアルゴリズムに関しては、著者は詳細な分析の後、結合ヒューリスティック

を提案しました。Structure-from-Motion(SfM)に基づくヒューリスティックは、シーンの高周波静的詳細をキャプチャするために使用されます。一方、カラー残差ヒューリスティックに基づくヒューリスティックは、低周波の静的な詳細をキャプチャするために使用されます。 2 つのヒューリスティックによって出力される大まかな静的マスクは互いに異なり、それらの和集合は SAM をより正確な静的マスクに導くために使用されます。これら 2 つのヒューリスティックをシームレスに組み合わせることで、HuGS は、さまざまなテクスチャの詳細に直面したときに、さまざまなタイプの静的要素を確実に識別できます。

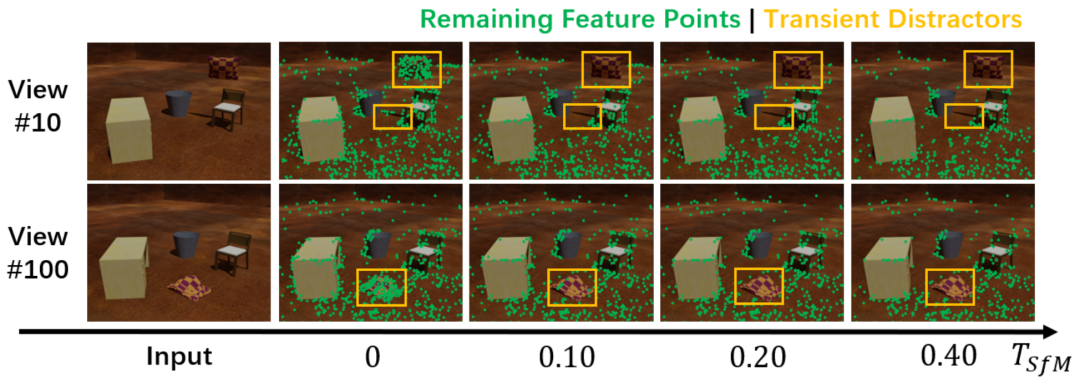

HuGS のフローチャート。 (a) 一時的なディストラクタのある静的シーン内の順序付けされていないマルチビュー画像が与えられると、HuGS は最初に 2 つのヒューリスティック情報を取得します。 (b) SfM ベースのヒューリスティック アルゴリズムは、SfM を使用して 静的特徴点 と 一時的特徴点 の間の区別を取得し、スパース静的特徴点をヒントとして使用します。ガイド SAM 高密度静的マスクを生成します。 (c) 色残差ベースのヒューリスティックは、部分的にトレーニングされた (つまり、わずか数千回の反復でトレーニングされた) NeRF に依存します。予測画像と実際の画像の間の色の残差を使用して、別の静的マスクのセットを生成できます。 (d) 2 つの異なるマスクの組み合わせにより、最終的に SAM は (e) 画像ごとに正確な静的マスクを生成します。 SfMは、2次元画像から3次元構造を再構成する技術です。画像の 2D 特徴を抽出した後、SfM はその特徴に対してマッチングと幾何学的検証を実行し、まばらな 3D 点群を再構築します。 SfM は NeRF で画像カメラのポーズを推定するためによく使用されますが、論文の著者は、SfM がシーンの静的要素と一時的要素を区別するためにも使用できることを発見しました。ある 2 次元特徴点の一致数を、同じ 3 次元点群点に対応する他の 2 次元特徴点の数とすると、静的領域からの 2 次元特徴点の一致数は次のようになります。は、過渡領域からの一致ポイントの数よりも大きくなります。 この結果に基づいて、一致数のしきい値を設定して静的特徴点を除外し、SAM を使用して静的特徴点を静的マスクに変換できます。この発見の正しさを検証するために、論文の著者は Kubric データセットの統計を実施しました。以下の図に示すように、異なる画像領域では特徴点一致の数に大きな違いがあります。別の視覚化は、適切なしきい値設定により、静的な特徴点を保持しながら一時的な特徴点を削除できることを示しています。

左の図は、さまざまな画像領域からの特徴点の一致数のヒストグラムです。静的領域の特徴点の一致数は [0,200] の間隔で均等に分布していますが、過渡領域の特徴は一致しています。ポイント 一致の数は 0 に近づき、[0,10] の間隔に集中します。右側の図は、しきい値が増加するにつれて、画像全体と静止領域の残留特徴点密度が線形に減少するのに対し、しきい値が変化したときのフィルタリング後のさまざまな画像領域の残留特徴点密度の曲線図です。過渡領域の点密度は指数関数的に減少し、しきい値が 0.2 を超えるとほぼ 0 になります。  閾値が増加するにつれて、異なる視点からの 2 つの画像の残りの特徴点の分布を視覚化します。一時領域にある残りの特徴点は徐々に削除されますが、静的領域のほとんどの特徴点はまだ保持されています。 SfM ベースのヒューリスティックはほとんどのシーンで良好に機能しますが、静的なスムーズ テクスチャをうまくキャプチャできません。これは、スムーズ テクスチャには重要な機能が欠けており、キャプチャすることが難しいためです。 SfM の特徴抽出アルゴリズムによって認識されます。 低周波テクスチャを識別できるようにするために、論文の著者は、色の残差に基づいたヒューリスティック アルゴリズムを導入しました。まず、元のマルチビュー画像で NeRF を部分的にトレーニングします (つまり、数千枚の画像を反復するだけです)。回)、アンダーフィッティング モデルを取得し、レンダリングされたイメージとターゲット イメージ間の色の残差を取得します。背景の紹介で述べたように、低周波静的テクスチャ領域の色残差は他のタイプの領域の残差よりも小さいため、色残差にしきい値を設定して、低周波静的テクスチャに関連する粗いマスクを取得できます。 。カラー残差によって取得されたマスクは、SfM によって取得されたマスクによって補完されて、完全な結果を形成できます。

閾値が増加するにつれて、異なる視点からの 2 つの画像の残りの特徴点の分布を視覚化します。一時領域にある残りの特徴点は徐々に削除されますが、静的領域のほとんどの特徴点はまだ保持されています。 SfM ベースのヒューリスティックはほとんどのシーンで良好に機能しますが、静的なスムーズ テクスチャをうまくキャプチャできません。これは、スムーズ テクスチャには重要な機能が欠けており、キャプチャすることが難しいためです。 SfM の特徴抽出アルゴリズムによって認識されます。 低周波テクスチャを識別できるようにするために、論文の著者は、色の残差に基づいたヒューリスティック アルゴリズムを導入しました。まず、元のマルチビュー画像で NeRF を部分的にトレーニングします (つまり、数千枚の画像を反復するだけです)。回)、アンダーフィッティング モデルを取得し、レンダリングされたイメージとターゲット イメージ間の色の残差を取得します。背景の紹介で述べたように、低周波静的テクスチャ領域の色残差は他のタイプの領域の残差よりも小さいため、色残差にしきい値を設定して、低周波静的テクスチャに関連する粗いマスクを取得できます。 。カラー残差によって取得されたマスクは、SfM によって取得されたマスクによって補完されて、完全な結果を形成できます。  2 つのヒューリスティック アルゴリズムの組み合わせ。(a) は入力ターゲット画像、(d) はわずか 5,000 回の反復による NeRF レンダリング結果です。 SfM ベースのヒューリスティックから得られた静的マスク (b) は、高周波の静的詳細 (ボックス テクスチャなど) をキャプチャしますが、静的で滑らかな部分 (白い椅子の背もたれなど) は欠落しています。カラー残差ベースのヒューリスティックから導出された静的マスク (e) と、ガイド付き SAM のみから導出されたセグメンテーション マスク (f) は、反対の効果を達成します。それらの結合 (c) は、すべての静的要素をカバーしながら、一時的なディストラクター (つまり、ピンクの風船) を区別します。

2 つのヒューリスティック アルゴリズムの組み合わせ。(a) は入力ターゲット画像、(d) はわずか 5,000 回の反復による NeRF レンダリング結果です。 SfM ベースのヒューリスティックから得られた静的マスク (b) は、高周波の静的詳細 (ボックス テクスチャなど) をキャプチャしますが、静的で滑らかな部分 (白い椅子の背もたれなど) は欠落しています。カラー残差ベースのヒューリスティックから導出された静的マスク (e) と、ガイド付き SAM のみから導出されたセグメンテーション マスク (f) は、反対の効果を達成します。それらの結合 (c) は、すべての静的要素をカバーしながら、一時的なディストラクター (つまり、ピンクの風船) を区別します。

ここでは、2つの異なる実際のシーンにおけるHuGSの視覚的セグメンテーションプロセスと、静的マスクを適用したときのベースラインモデルMip-NeRF 360を示します。フィルム撮影前後のレンダリング結果の比較。ヒューリスティックと SAM の組み合わせにより、HuGS は正確な静的マスクを生成できる一方、Mip-NeRF 360 は静的マスクの適用後に多数のアーティファクトを除去し、RGB および深度マップのレンダリング品質が大幅に向上しました。

ここでは、3つのデータセットと2つのベースラインモデルに対するペーパーメソッドの実験結果と、既存のメソッドとの比較を示します。既存の方法は、一時的なディストラクタによって引き起こされるアーティファクトを除去できなかったり、静的なテクスチャの詳細を消去しすぎたりするかのいずれかです。対照的に、私たちの方法では、アーティファクトを効果的に排除しながら、静的な詳細をより適切に保存できます。

論文の著者は、それを Kubric データセット上の既存のセグメンテーション アルゴリズムとも比較しました。実験結果によると、事前知識が提供されている場合でも、セマンティック セグメンテーションやビデオ セグメンテーションなどの既存のセグメンテーション モデルは、このタスク用に設計されていないため、パフォーマンスが依然として低いことがわかります。既存のヒューリスティックベースの方法では、一時的な干渉源の位置を大まかに特定できますが、より正確なセグメンテーション結果を取得することはできません。対照的に、HuGS は、ヒューリスティック アルゴリズムとセグメンテーション モデルを組み合わせることで、事前知識を追加することなく、一時的なディストラクタと静的なシーン要素を正確に分離します。

論文の著者は、さまざまなコンポーネントを除去することによって、HuGSに対する各コンポーネントの影響も検証しました。結果は、SfM ベースのヒューリスティックが欠如しているモデル (b) は青色のボックス内の低周波静的テクスチャをうまく再構築できませんが、色残差ベースのヒューリスティックが欠如しているモデル (c) と (d) は黄色のボックスを失っていることを示しています。カラーボックス内の高周波静的詳細。比較すると、完全な方法 (f) では、最良の数値メトリクスと視覚化結果が得られます。

この論文は、NeRF の実生活トレーニングにおける一般的な過渡干渉問題を効果的に解決する、新しいヒューリスティックなガイド付きセグメンテーション パラダイムを提案しています。手作業で設計されたヒューリスティックと最先端のセグメンテーション モデルの相補的な長所を戦略的に組み合わせることで、この方法は、事前知識がなくても、さまざまなシーンで一時的な注意をそらすものを高精度にセグメンテーションすることができます。慎重に設計されたヒューリスティックを通じて、私たちの方法は高周波および低周波の静的なシーン要素を確実にキャプチャできます。多数の実験により、この方法の進歩が証明されています。 以上がCVPR の最優秀論文候補 | 追加の事前知識なしでヒューリスティックに基づくセグメンテーションを使用して過渡干渉を除去する、NeRF の新たなブレークスルーの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

(一時的な干渉(黄色のボックス)の存在により、多数の疑似反射鏡が発生する可能性があります。

(一時的な干渉(黄色のボックス)の存在により、多数の疑似反射鏡が発生する可能性があります。  既存の手法とこの論文で提案するヒューリスティックガイドセグメンテーション(HuGS)との比較。静的なシーンが一時的な妨害物によって妨害される場合、(a) セグメンテーション ベースの方法は事前の知識に依存し、予期しない一時的なオブジェクト (ピザなど) を識別できないため、関連するアーティファクトが発生します。(b) ヒューリスティック ベースの方法。この方法はより一般的ですが、精度が十分ではありません(たとえば、高周波の静的なテーブルクロスのテクスチャが失われます)、(c)HuGS はそれらの利点を組み合わせて、一時的なディストラクタと静的なシーン要素を正確に分離できるため、NeRF の結果が大幅に向上します。

既存の手法とこの論文で提案するヒューリスティックガイドセグメンテーション(HuGS)との比較。静的なシーンが一時的な妨害物によって妨害される場合、(a) セグメンテーション ベースの方法は事前の知識に依存し、予期しない一時的なオブジェクト (ピザなど) を識別できないため、関連するアーティファクトが発生します。(b) ヒューリスティック ベースの方法。この方法はより一般的ですが、精度が十分ではありません(たとえば、高周波の静的なテーブルクロスのテクスチャが失われます)、(c)HuGS はそれらの利点を組み合わせて、一時的なディストラクタと静的なシーン要素を正確に分離できるため、NeRF の結果が大幅に向上します。  HuGS のセグメンテーション モデル

HuGS のセグメンテーション モデル