最初の Mamba ベースの MLLM が登場しました!モデルの重み、トレーニング コードなどはすべてオープンソースです

AIxivコラムは、当サイトが学術的・技術的な内容を掲載するコラムです。過去数年間で、このサイトの AIxiv コラムには 2,000 件を超えるレポートが寄せられ、世界中の主要な大学や企業のトップ研究室がカバーされ、学術交流と普及を効果的に促進しています。共有したい優れた作品がある場合は、お気軽に寄稿するか、報告のために当社までご連絡ください。提出電子メール: liyazhou@jiqizhixin.com; zhaoyunfeng@jiqizhixin.com。

元のリンク: https://arxiv.org/pdf/2403.14520v2.pdf プロジェクトリンク: https://sites.google.com/view/cobravlm/ 論文のタイトル: コブラ:効率的な推論のための Mamba のマルチモーダル大規模言語モデルへの拡張

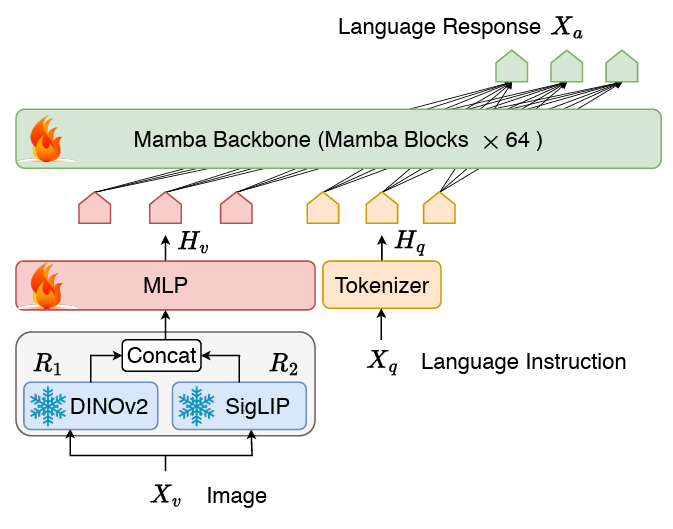

メソッドの紹介 モデルアーキテクチャ Cobra は、古典的なビジュアルエンコーダーを使用して 2 つのモデルを接続しますVLMの構造ステートフル プロジェクターと LLM 言語バックボーンで構成されます。 LLM のバックボーン部分は、2.8B パラメーターで事前トレーニングされた Mamba 言語モデルを使用します。これは、600B トークンを使用して SlimPajama データセットで事前トレーニングされ、会話データの指示で微調整されました。网络 Cobra ネットワーク構造図

LLAVA などとは異なり、COBRA は、Dinov2 と SIGLIP フュージョンの視覚的表現を使用します。 2 つのビジュアル コーダーの出力をつなぎ合わせてプロジェクターに供給することで、モデルはより適切にキャプチャできます。 SigLIP によってもたらされる高レベルの意味論的特徴と、DINOv2 によって抽出された低レベルのきめの細かい画像特徴です。 最近の研究では、LLaVAに基づく既存のトレーニングパラダイム(つまり、投影層の事前調整段階とLLMバックボーンの微調整段階を一度だけトレーニングするだけ)について、それぞれ)、事前調整段階は不要な場合があり、微調整されたモデルはまだ適合が不十分である可能性があります。したがって、Cobra は事前調整段階を放棄し、LLM 言語バックボーン全体とプロジェクターを直接微調整します。この微調整プロセスは、以下で構成される結合データセットでランダム サンプリングを使用して 2 つのエポックに対して実行されました: LLaVA v1.5 で使用されるハイブリッド データセット。これには、学術的な会話を含む、合計 655,000 の視覚的なマルチターン会話が含まれます。 VQA サンプル、LLaVA-Instruct のビジュアル命令チューニング データ、ShareGPT のプレーン テキスト命令チューニング データ。 - LRV-Instruct は、幻覚現象を軽減することを目的とした、16 の視覚言語タスクをカバーする 400,000 の視覚的指示を含むデータセットです。

データセット全体には、約 120 万枚の画像と、対応する複数ラウンドの会話データ、およびプレーンテキストの会話データが含まれています。

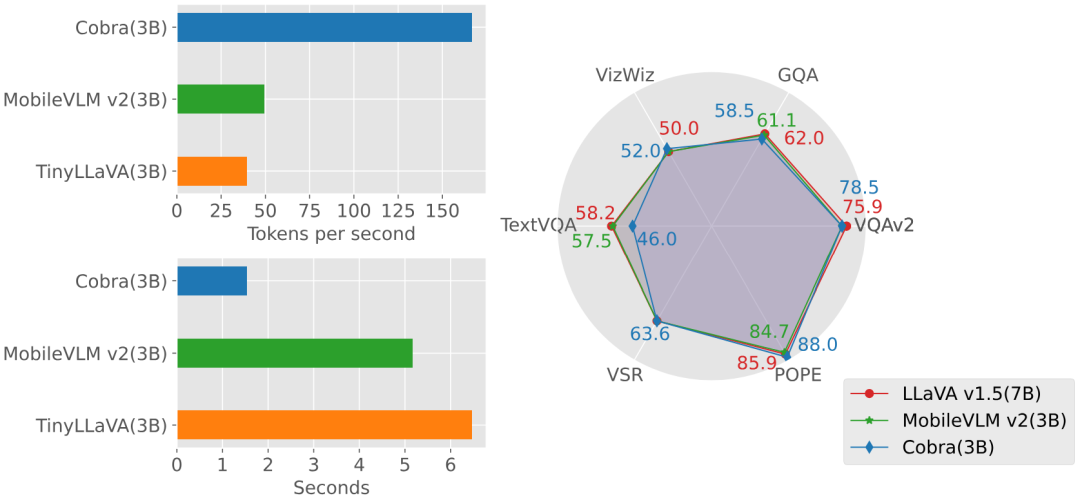

定量実験 実験部分では、この論文は、提案されたCobraモデルとオープンソースSOTA VLMモデルを基本ベンチマーク上で比較し、それを同じ大きさは、Transformer アーキテクチャに基づく VLM モデルの応答速度に基づいています。同時に、グラフの生成速度とパフォーマンスの比較を行います。COBRA は、VQA-V2、GQA、Vizwiz、TextVQA、VSR の 4 つのオープン VQA タスク、POPE 2 つの閉集合予測タスクの場合も同様です。 , 合計6つのベンチマークでスコアを比較しました。ベンチマーク上のマップと他のオープンソース モデルの比較

さらに、コブラは、オブジェクトのオブジェクトにおけるコブラを定性的に説明するために 2 つの VQA の例も示しています。空間関係を認識し、模型の錯覚を軽減する能力に優れています。和 図 COBRA とオブジェクトの空間関係の判断における他のベースライン モデル 예에서 Llava V1.5 및 Mobilevlm에는 오류 답변이 제공되는 반면 COBRA에는 정확한 설명이 제공되었으며, 특히 두 번째 인스턴스에서는, Cobra는 해당 사진이 로봇의 시뮬레이션 환경에서 나온 것임을 정확하게 식별했습니다.

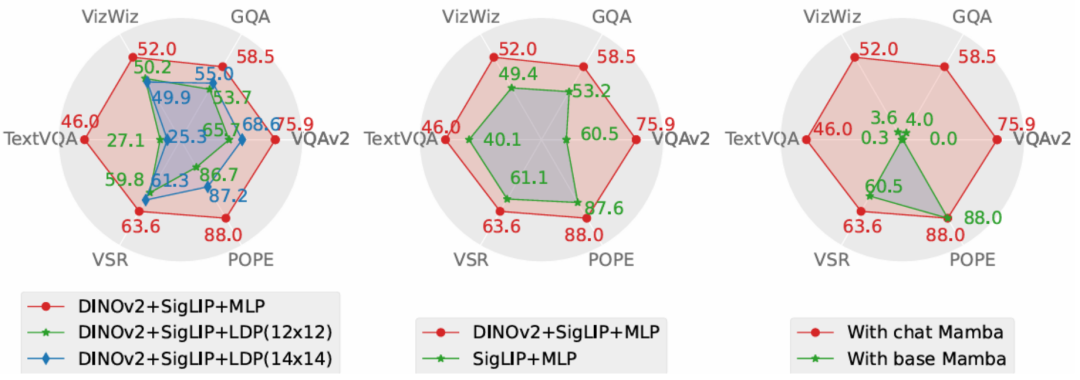

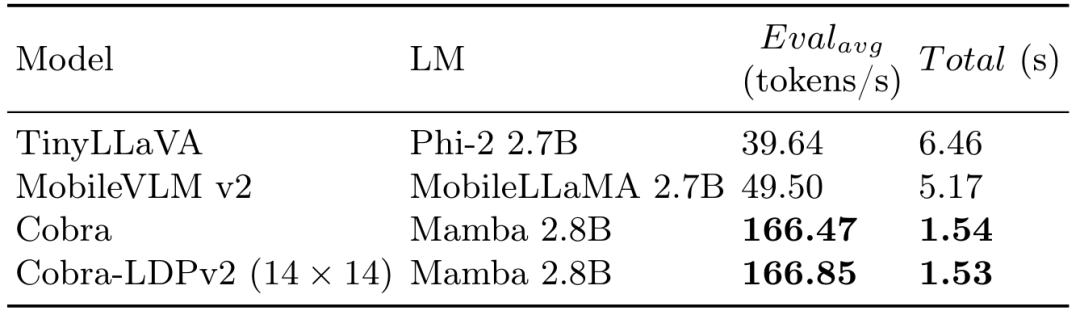

Ablation 실험이 기사에서는 성능과 세대 속도라는 두 가지 차원에서 Cobra가 채택한 솔루션에 대한 Ablation 연구를 수행합니다. 실험 계획에서는 프로젝터, 비주얼 인코더 및 LLM 언어 백본에 대해 각각 절제 실험을 수행합니다. 다이어그램 절제 실험의 성능 비교는 프로젝터의 프로젝트 부분에 대한 절제 실험에서 이 기사에서 채택한 MLP 프로젝터의 효과가 LDP에 시각적 토큰 수를 줄이는 데 전념하는 것보다 훨씬 더 우수함을 보여줍니다. 모듈은 컴퓨팅 속도를 향상시키는 동시에 Cobra의 시퀀스 처리 속도와 계산 복잡도가 Transformer보다 우수하므로 LDP 모듈은 생성 속도에 있어서 뚜렷한 이점이 없습니다. 따라서 시각적 토큰 수를 줄이기 위해 Mamba 클래스 모델이 사용됩니다. 정확성을 희생하면 샘플러가 필요하지 않을 수 있습니다.和 생성 속도 비교 범위의 COBRA 및 기타 모델

시각적 인코더 부분의 ablation 결과는 Dinov2 기능의 융합이 COBRA의 성능을 효과적으로 향상시키는 것을 보여줍니다. 언어 백본 실험에서 명령어 미세 조정이 없는 Mamba 언어 모델은 공개 질문 및 답변 테스트에서 합리적인 답변을 전혀 제공할 수 없는 반면, 미세 조정된 Mamba 언어 모델은 다양한 작업에서 상당한 성능을 달성할 수 있습니다.

결론 본 논문에서는 2차 계산 복잡도를 갖는 Transformer 네트워크에 의존하는 기존 다중 모달 대규모 언어 모델의 효율성 병목 현상을 해결하는 Cobra를 제안합니다. 이 논문에서는 선형 계산 복잡성과 다중 모드 입력을 갖춘 언어 모델의 조합을 탐구합니다. 시각적 정보와 언어 정보 융합 측면에서 본 논문은 Mamba 언어 모델의 내부 정보 통합을 성공적으로 최적화하고 다양한 모달 융합 방식에 대한 심층적인 연구를 통해 보다 효과적인 다중 모드 표현을 달성합니다. 실험에 따르면 Cobra는 계산 효율성을 크게 향상시킬 뿐만 아니라 특히 시각적 환상을 극복하고 공간적 관계 판단에 있어서 LLaVA와 같은 고급 모델과 성능면에서 비교할 수 있는 것으로 나타났습니다. 심지어 매개변수의 수도 크게 줄어듭니다. 이는 비전 기반 로봇 피드백 제어와 같이 시각적 정보의 고주파 처리가 필요한 환경에서 향후 고성능 AI 모델을 배포할 수 있는 새로운 가능성을 열어줍니다.

以上が最初の Mamba ベースの MLLM が登場しました!モデルの重み、トレーニング コードなどはすべてオープンソースですの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7549

7549

15

15

1382

1382

52

52

83

83

11

11

22

22

90

90

ControlNet の作者がまたヒット作を出しました!写真から絵画を生成し、2 日間で 1.4,000 個のスターを獲得する全プロセス

Jul 17, 2024 am 01:56 AM

ControlNet の作者がまたヒット作を出しました!写真から絵画を生成し、2 日間で 1.4,000 個のスターを獲得する全プロセス

Jul 17, 2024 am 01:56 AM

これも Tusheng のビデオですが、PaintsUndo は別の道を歩んでいます。 ControlNet 作者 LvminZhang が再び生き始めました!今回は絵画の分野を目指します。新しいプロジェクト PaintsUndo は、開始されて間もなく 1.4kstar を獲得しました (まだ異常なほど上昇しています)。プロジェクトアドレス: https://github.com/lllyasviel/Paints-UNDO このプロジェクトを通じて、ユーザーが静止画像を入力すると、PaintsUndo が線画から完成品までのペイントプロセス全体のビデオを自動的に生成するのに役立ちます。 。描画プロセス中の線の変化は驚くべきもので、最終的なビデオ結果は元の画像と非常によく似ています。完成した描画を見てみましょう。

オープンソース AI ソフトウェア エンジニアのリストのトップに立つ UIUC のエージェントレス ソリューションは、SWE ベンチの実際のプログラミングの問題を簡単に解決します

Jul 17, 2024 pm 10:02 PM

オープンソース AI ソフトウェア エンジニアのリストのトップに立つ UIUC のエージェントレス ソリューションは、SWE ベンチの実際のプログラミングの問題を簡単に解決します

Jul 17, 2024 pm 10:02 PM

AIxivコラムは、当サイトが学術的・技術的な内容を掲載するコラムです。過去数年間で、このサイトの AIxiv コラムには 2,000 件を超えるレポートが寄せられ、世界中の主要な大学や企業のトップ研究室がカバーされ、学術交流と普及を効果的に促進しています。共有したい優れた作品がある場合は、お気軽に寄稿するか、報告のために当社までご連絡ください。提出電子メール: liyazhou@jiqizhixin.com; zhaoyunfeng@jiqizhixin.com この論文の著者は全員、イリノイ大学アーバナ シャンペーン校 (UIUC) の Zhang Lingming 教師のチームのメンバーです。博士課程4年、研究者

OpenAI Super Alignment チームの遺作: 2 つの大きなモデルがゲームをプレイし、出力がより理解しやすくなる

Jul 19, 2024 am 01:29 AM

OpenAI Super Alignment チームの遺作: 2 つの大きなモデルがゲームをプレイし、出力がより理解しやすくなる

Jul 19, 2024 am 01:29 AM

AIモデルによって与えられた答えがまったく理解できない場合、あなたはそれをあえて使用しますか?機械学習システムがより重要な分野で使用されるにつれて、なぜその出力を信頼できるのか、またどのような場合に信頼してはいけないのかを実証することがますます重要になっています。複雑なシステムの出力に対する信頼を得る方法の 1 つは、人間または他の信頼できるシステムが読み取れる、つまり、考えられるエラーが発生する可能性がある点まで完全に理解できる、その出力の解釈を生成することをシステムに要求することです。見つかった。たとえば、司法制度に対する信頼を築くために、裁判所に対し、決定を説明し裏付ける明確で読みやすい書面による意見を提供することを求めています。大規模な言語モデルの場合も、同様のアプローチを採用できます。ただし、このアプローチを採用する場合は、言語モデルが

RLHF から DPO、TDPO に至るまで、大規模なモデル アライメント アルゴリズムはすでに「トークンレベル」になっています

Jun 24, 2024 pm 03:04 PM

RLHF から DPO、TDPO に至るまで、大規模なモデル アライメント アルゴリズムはすでに「トークンレベル」になっています

Jun 24, 2024 pm 03:04 PM

AIxivコラムは、当サイトが学術的・技術的な内容を掲載するコラムです。過去数年間で、このサイトの AIxiv コラムには 2,000 件を超えるレポートが寄せられ、世界中の主要な大学や企業のトップ研究室がカバーされ、学術交流と普及を効果的に促進しています。共有したい優れた作品がある場合は、お気軽に寄稿するか、報告のために当社までご連絡ください。提出メール: liyazhou@jiqizhixin.com; zhaoyunfeng@jiqizhixin.com 人工知能の開発プロセスにおいて、大規模言語モデル (LLM) の制御とガイダンスは常に中心的な課題の 1 つであり、これらのモデルが両方とも確実に機能することを目指しています。強力かつ安全に人類社会に貢献します。初期の取り組みは人間のフィードバックによる強化学習手法に焦点を当てていました (RL

arXiv 論文は「弾幕」として投稿可能、スタンフォード alphaXiv ディスカッション プラットフォームはオンライン、LeCun は気に入っています

Aug 01, 2024 pm 05:18 PM

arXiv 論文は「弾幕」として投稿可能、スタンフォード alphaXiv ディスカッション プラットフォームはオンライン、LeCun は気に入っています

Aug 01, 2024 pm 05:18 PM

乾杯!紙面でのディスカッションが言葉だけになると、どんな感じになるでしょうか?最近、スタンフォード大学の学生が、arXiv 論文のオープン ディスカッション フォーラムである alphaXiv を作成しました。このフォーラムでは、arXiv 論文に直接質問やコメントを投稿できます。 Web サイトのリンク: https://alphaxiv.org/ 実際、URL の arXiv を alphaXiv に変更するだけで、alphaXiv フォーラムの対応する論文を直接開くことができます。この Web サイトにアクセスする必要はありません。その中の段落を正確に見つけることができます。論文、文: 右側のディスカッション エリアでは、ユーザーは論文のアイデアや詳細について著者に尋ねる質問を投稿できます。たとえば、次のような論文の内容についてコメントすることもできます。

リーマン予想の大きな進歩!陶哲軒氏はMITとオックスフォードの新しい論文を強く推薦し、37歳のフィールズ賞受賞者も参加した

Aug 05, 2024 pm 03:32 PM

リーマン予想の大きな進歩!陶哲軒氏はMITとオックスフォードの新しい論文を強く推薦し、37歳のフィールズ賞受賞者も参加した

Aug 05, 2024 pm 03:32 PM

最近、2000年代の7大問題の一つとして知られるリーマン予想が新たなブレークスルーを達成した。リーマン予想は、数学における非常に重要な未解決の問題であり、素数の分布の正確な性質に関連しています (素数とは、1 とそれ自身でのみ割り切れる数であり、整数論において基本的な役割を果たします)。今日の数学文献には、リーマン予想 (またはその一般化された形式) の確立に基づいた 1,000 を超える数学的命題があります。言い換えれば、リーマン予想とその一般化された形式が証明されれば、これらの 1,000 を超える命題が定理として確立され、数学の分野に重大な影響を与えることになります。これらの命題の一部も有効性を失います。 MIT数学教授ラリー・ガスとオックスフォード大学から新たな進歩がもたらされる

公理的トレーニングにより、LLM は因果推論を学習できます。6,700 万個のパラメータ モデルは、1 兆個のパラメータ レベル GPT-4 に匹敵します。

Jul 17, 2024 am 10:14 AM

公理的トレーニングにより、LLM は因果推論を学習できます。6,700 万個のパラメータ モデルは、1 兆個のパラメータ レベル GPT-4 に匹敵します。

Jul 17, 2024 am 10:14 AM

LLM に因果連鎖を示すと、LLM は公理を学習します。 AI はすでに数学者や科学者の研究を支援しています。たとえば、有名な数学者のテレンス タオは、GPT などの AI ツールを活用した研究や探索の経験を繰り返し共有しています。 AI がこれらの分野で競争するには、強力で信頼性の高い因果推論能力が不可欠です。この記事で紹介する研究では、小さなグラフでの因果的推移性公理の実証でトレーニングされた Transformer モデルが、大きなグラフでの推移性公理に一般化できることがわかりました。言い換えれば、Transformer が単純な因果推論の実行を学習すると、より複雑な因果推論に使用できる可能性があります。チームが提案した公理的トレーニング フレームワークは、デモンストレーションのみで受動的データに基づいて因果推論を学習するための新しいパラダイムです。

最初の Mamba ベースの MLLM が登場しました!モデルの重み、トレーニング コードなどはすべてオープンソースです

Jul 17, 2024 am 02:46 AM

最初の Mamba ベースの MLLM が登場しました!モデルの重み、トレーニング コードなどはすべてオープンソースです

Jul 17, 2024 am 02:46 AM

AIxivコラムは、当サイトが学術的・技術的な内容を掲載するコラムです。過去数年間で、このサイトの AIxiv コラムには 2,000 件を超えるレポートが寄せられ、世界中の主要な大学や企業のトップ研究室がカバーされ、学術交流と普及を効果的に促進しています。共有したい優れた作品がある場合は、お気軽に寄稿するか、報告のために当社までご連絡ください。提出電子メール: liyazhou@jiqizhixin.com; zhaoyunfeng@jiqizhixin.com。はじめに 近年、さまざまな分野でマルチモーダル大規模言語モデル (MLLM) の適用が目覚ましい成功を収めています。ただし、多くの下流タスクの基本モデルとして、現在の MLLM はよく知られた Transformer ネットワークで構成されています。