200以上の関連研究を統合した、大規模モデル「生涯学習」の最新レビューはこちら

AIxivコラムは、本サイト上で学術的・技術的な内容を掲載するコラムです。過去数年間で、このサイトの AIxiv コラムには 2,000 件を超えるレポートが寄せられ、世界中の主要な大学や企業のトップ研究室がカバーされ、学術交流と普及を効果的に促進しています。共有したい優れた作品がある場合は、お気軽に寄稿するか、報告のために当社までご連絡ください。提出電子メール: liyazhou@jiqizhixin.com; zhaoyunfeng@jiqizhixin.com

論文タイトル: 大規模言語モデルの生涯学習に向けて: 調査 機関: 中国南部工科大学 論文アドレス: https://arxiv.org/abs/2406.06391 プロジェクトアドレス: https://github .com/qianlima-lab/awesome-lifelong-learning-methods-for-llm

小説の分類: はじめに生涯学習に関する広範な文献を 12 のシナリオに分割する詳細な構造化フレームワークが開発されました。 普遍的なテクニック: 生涯学習のあらゆる状況に共通するテクニックが特定され、存在します。各シナリオの技術グループ。 将来の方向性: LLM 以前の時代にはあまり検討されていなかった、モデル拡張やデータ選択などのいくつかの新しいテクノロジーに重点を置きます。

内部知識とは、継続的な事前トレーニングや継続的な微調整を含む、完全または部分的なトレーニングを通じてモデル パラメーターに新しい知識を吸収することを指します。 -

外部知識とは、検索ベースの生涯学習や生涯学習用ツールなど、モデル パラメーターを更新せずに、ウィキペディアやアプリケーション プログラム インターフェイスなどの外部リソースから新しい知識をモデルに組み込むことを指します。

- 継続的な垂直ドメイン事前トレーニング: 特定の垂直分野 (金融、医療など) 用。

- 継続的な言語ドメイン事前トレーニング: 自然言語とコード言語の継続的な事前トレーニング。

- 継続的時間領域事前トレーニング: 時間関連データ (時系列データなど) の継続的事前トレーニング。

- タスク固有:

- 連続テキスト分類: テキスト分類タスク用 継続的な微調整。

- 継続的な固有表現認識:固有表現認識タスクの継続的な微調整。

- 継続的な関係抽出: 関係抽出タスクの継続的な微調整。

- 継続的機械翻訳: 機械翻訳タスクの継続的な微調整。

- タスク非依存:

- 継続的な命令調整: モデルの継続的な学習は、命令の微調整によって実現されます。

- 継続的な知識編集: 知識を更新するための継続的な学習。

- 継続的調整: モデルを新しいタスクに調整するための継続的な学習。

- 全体の測定: 平均精度 (AA) と平均を含む増分精度 (AIA)。 AA はすべてのタスクを学習した後のモデルの平均パフォーマンスを指しますが、AIA は各タスクを学習した後の履歴変化を考慮します。

- 安定性測定: 忘却測定 (FGT) および逆方向転送 (BWT) を含みます。 FGT は古いタスクの平均パフォーマンス低下を評価し、BWT は古いタスクの平均パフォーマンス変化を評価します。

- 可塑性測定: 新しいタスクにおけるモデルのパフォーマンスの平均改善である順方向伝達 (FWD) を含みます。

意味: このメソッドは、新しいタスクをトレーニングするときに使用されます。前のタスクからのデータをリプレイして、タスクを統合します。モデルの古いタスクの記憶。通常、再生されたデータはバッファに保存され、現在のタスクのデータとともにトレーニングに使用されます。主に以下が含まれます:

– エクスペリエンス リプレイ: 古いタスクのデータ サンプルの一部を保存し、新しいタスクの発生をトレーニングするときにこれらのデータを再利用することで忘れを減らします。

– 生成リプレイ: 古いデータを保存するのとは異なり、この方法では生成モデルを使用して疑似サンプルを作成し、それによって古いタスクの知識を新しいタスクのトレーニングに導入します。

の図: 図 3 は、タスク t-1 からタスク t までのプロセスを示しています。モデルは、タスク をトレーニングしています。 、バッファ内の古いデータ (入力 t-1 ) が使用されます。

意味: この方法は、モデル パラメーターに正則化制約を課すことで、新しいタスクを学習するときにモデルが古いタスク パラメーターを過剰に調整するのを防ぎます。正則化制約は、モデルが古いタスクの記憶を保持するのに役立ちます。主に以下が含まれます:

– 重みの正規化: モデルパラメーターに追加の制約を課すことにより、新しいタスクをトレーニングする際の重要な重みの変更を制限し、それによって古いタスクの整合性を保護します。たとえば、L2 正則化や Elastic Weight Consolidation (EWC) は一般的な手法です。

– 特徴の正則化: 正則化は重みに作用するだけでなく、特徴空間内のモデルのパフォーマンスを制限することで、新しいタスクと古いタスクの間の特徴の分布が安定した状態を保つこともできます。

の図: 図 3 は、タスク t-1 からタスク t までのプロセスを示しています。モデルは、タスク をトレーニングしています。 、パラメータの正規化はタスク t-1 のパフォーマンスを維持するために使用されます。

意味: このアプローチは、以前に学習した知識への干渉を最小限に抑えながら、新しいタスクをシームレスに統合するためにモデル構造を適応させることに重点を置いています。これには主に、図 4 の 6 つのメソッドが含まれます:

–(a) プロンプト チューニング: モデルの入力の前に「ソフト プロンプト」を追加し、モデルの生成または分類タスクをガイドします。この方法では、モデルのバックボーン構造を変更せずに、少数のパラメーター (つまり、プロンプト ワード) を調整するだけで済みます。

–(b) プレフィックス チューニング: トレーニングされた調整可能なパラメーターを入力シーケンスのプレフィックス部分に追加します。これらのパラメーターは、モデルがコンテキスト情報をより適切にキャプチャできるようにするために、Transformer レイヤーのセルフ アテンション メカニズムに挿入されます。

–(c) 低ランク適応 (LoRA、低ランク適応): LoRA は、大規模モデルの主な重みを変更せずに、特定のレベルで低ランク行列を追加することによって、新しいタスクに適応します。このアプローチにより、モデルのパフォーマンスを維持しながら、パラメーター調整の数が大幅に削減されます。

– (d) アダプター: アダプターは、モデルの異なる層の間に挿入されるトレーニング可能なモジュールです。これらのモジュールは、元のモデルの新しいタスクを変更せずに、少数の追加パラメーターで適応できます。通常、FFN (フィード フォワード ネットワーク) および MHA (マルチヘッド アテンション) 部分に適用されます。

–(e) エキスパートの混合: モデル内の特定のレイヤーまたはサブネットワークである特定の「エキスパート」モジュールを選択的にアクティブにすることによって、さまざまな入力を処理します。 Router モジュールは、どのエキスパート モジュールをアクティブにする必要があるかを決定します。

–(f) モデルの拡張: 元のレイヤー (Old Layer) を保持したまま、新しいレイヤー (New Layer) を追加することでモデルの容量を拡張します。このアプローチにより、モデルの容量を徐々に増やして、より複雑なタスク要件に対応できるようになります。

図: 図 3 は、タスク t-1 からタスク t までのプロセスを示しています。モデルが新しいタスクを学習するとき、一部のパラメーターは固定されています。一方、新しく追加されたモジュールは、新しいタスク (Trainable) をトレーニングするために使用されます。

意味: この方法は、知識の蒸留を通じて古いモデルの知識を新しいモデルに転送します。新しいタスクをトレーニングするとき、新しいモデルは現在のタスクのデータを学習するだけでなく、古いタスクの古いモデルの出力を模倣することで、古いタスクの知識を維持します。主に以下が含まれます:

図: 図 3 は、タスク t-1 からタスク t への遷移を示しています。このプロセスでは、モデルが新しいタスクをトレーニングするときに、古いモデルの予測結果を模倣することで古いタスクの知識を維持します。

例: CorpusBrain++ は、バックボーン アダプター アーキテクチャとエクスペリエンス リプレイ戦略を使用して、現実世界の知識集約的な言語タスクに取り組みます。 例: Med-PaLM は、少数の例を使用して、医療分野における指示プロンプトのチューニングを紹介します。

例: ELLE特徴保持モデル拡張戦略を採用し、既存の事前トレーニング済み言語モデルの幅と深さを柔軟に拡張することで、知識の取得と統合の効率を向上させます。 例: LLaMA Pro は、Transformer ブロックを拡張し、新しいコーパスで微調整することにより、一般的な使用、プログラミング、数学タスクに優れています。

-

例: Gupta らによって提案された戦略では、新しいデータセットを導入するときに学習率を調整して、長期学習中に学習率が低くなりすぎないようにすることで、新しいデータセットへの適応効果を向上させます。

例: RHO -1 は、トレーニング プロセスに大きな影響を与えるトークンを優先する選択的言語モデル (SLM) を使用してトレーニングされます。 例: EcomGPT-CT は、半構造化された電子商取引データを使用したドメイン固有のタスクにおけるモデルのパフォーマンスを強化します。

例: Yadav らは、教師による強制メカニズムを導入し、新しいタスクでのモデルの微調整をガイドする一連のプロンプトを作成することで、プロンプト チューニングを改善しました。 例: ModuleFormer と Lifelong-MoE は、専門家混合 (MoE) アプローチを使用して、モジュール性とモデル容量の動的増加を通じて LLM の効率と適応性を強化しています。

-

例: Ibrahim らによって提案されたリウォーミング手法は、新しいデータをトレーニングするときに学習率を一時的に高めることで、モデルが新しい言語に迅速に適応できるようにします。

例: 連続テキスト分類タスクは、変化する分類ニーズに適応できるように、新しい分類カテゴリ (目的: 転送 -> 目的: クレジット スコア -> 目的: 楽しい事実など) を徐々に導入することでモデルをトレーニングします。

の例: 継続的な名前付きエンティティ認識タスクは、モデルが新しいエンティティの能力を認識しながら古いエンティティの認識を維持できるように、特定のエンティティを認識しながら、新しいエンティティ タイプ (スポーツ選手 -> スポーツ チーム -> 政治家など) を徐々に導入する方法を示します。 。

例:継続的関係抽出タスクは、新しい関係タイプ (関係: 創設者 -> 関係: 州または出身地 -> 関係: 本社の国など) を継続的に導入することによって、モデルが関係抽出機能を徐々に拡張する方法を示します。

例:継続的なナレッジ編集タスクでは、モデルのナレッジ ベースを継続的に更新することで、最新の事実に正確に答えることができます (米国の大統領は誰ですか? -> クリスティアーノ ロナウドは現在どのクラブでプレーしていますか? -> 最後の冬はどこでしたか?オリンピック開催?)

例:継続的機械翻訳タスクは、モデルの翻訳機能をさまざまな言語 (英語 -> 中国語、英語 -> スペイン語、英語 -> フランス語など) に徐々に拡張することで、多言語環境におけるモデルの適応性を実証します。

例: 継続的命令微調整タスクは、新しい命令タイプ (要約 -> スタイル転送 -> 数学など) を段階的に導入することによって、複数のタスク タイプでモデルのパフォーマンス能力をトレーニングします。

例: 連続アライメント タスクは、新しいアライメント目標 (有益で無害 -> 簡潔で組織的 -> ポジティブな感情など) を導入することにより、さまざまな道徳的および行動基準の下でのモデルの継続的な学習能力を実証します。

はじめに: 世界中の情報が増え続ける中、スケールアップと進化過去のデータに基づいてトレーニングされた静的モデルはすぐに古くなり、新しい開発に関するコンテンツを理解したり生成したりできなくなります。検索ベースの生涯学習は、大規模な言語モデルが外部ソースから最新の知識を取得して吸収するという重要なニーズを解決し、モデルは必要に応じてこれらの外部リソースを取得することで知識ベースを補完または更新します。これらの外部リソースは、現在の大規模な知識ベースを提供し、事前トレーニングされた LLM の静的特性を強化するための重要な補完的な資産を提供します。 例: 図内のこれらの外部リソースは、モデルによってアクセスおよび取得できます。ウィキペディア、書籍、データベースなどの外部情報ソースにアクセスすることで、モデルは知識を更新し、新しい情報に遭遇したときに適応することができます。

はじめに: ツールベースの生涯学習は、その機能を静的な知識を超えて拡張し、環境と動的に対話できるようにする必要性から生まれました。実際のアプリケーションでは、モデルは多くの場合、直接的なテキストの生成や解釈を超える操作を含むタスクを実行する必要があります。 例: 図のモデルは、これらのツールを使用して自身の機能を拡張および更新し、外部ツールとの対話を通じて生涯学習を可能にします。たとえば、モデルはアプリケーション プログラミング インターフェイスを通じてリアルタイム データを取得したり、物理ツールを通じて外部環境と対話して特定のタスクを完了したり、新しい知識を取得したりできます。

壊滅的な忘却: これは生涯学習の中核的な課題の 1 つであり、新しい情報の導入により上書きされる可能性があります。モデルが以前に学習したこと。 可塑性と安定性のジレンマ: モデルの学習能力と安定性の維持の間のバランスを見つけることが非常に重要であり、これはモデルが新しい知識を保持しながら新しい知識を獲得する能力に直接影響します。幅広い一般的な能力。 高額な計算コスト: 大規模な言語モデルを完全に微調整するための計算要件は非常に高くなる可能性があります。 モデルの重みや事前トレーニングされたデータが利用できない: プライバシー、独自の制限、または商用ライセンスのため、生のトレーニング データやモデルの重みは、さらなる改善のために利用できないことがよくあります。

特定のタスクから一般的なタスクへ: 研究は、特定のタスク (テキスト分類、固有表現認識など) から、命令調整、知識編集などのより広範囲の一般的なタスクに徐々に移行していきます。 完全な微調整から部分的な微調整へ: 完全な微調整、部分的な微調整戦略 (アダプター層、プロンプト チューニング、 LoRA) の人気はますます高まっています。 内部知識から外部知識へ: 頻繁な内部更新の制限を克服するために、検索拡張生成やツールなどの外部知識ソースを使用する戦略が増えています。学習によりモデルが可能になります。現在の外部データに動的にアクセスして活用します。

マルチモーダル生涯学習: テキストを超えた複数のモダリティ (画像、ビデオ、オーディオ、時系列データ、ナレッジ グラフなど) を生涯学習に統合し、より包括的で適応性のある性モデルを開発します。 効率的な生涯学習: 研究者たちは、モデルの枝刈り、モデルの結合、モデルの拡張、その他の方法など、モデルのトレーニングと更新の計算要件を管理するためのより効率的な戦略の開発に取り組んでいます。 普遍的な生涯学習: 最終的な目標は、大規模な言語モデルが、静的なデータセットのみに依存することなく、新しい知識を積極的に獲得し、環境との動的な相互作用を通じて学習できるようにすることです。

以上が200以上の関連研究を統合した、大規模モデル「生涯学習」の最新レビューはこちらの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

1668

1668

14

14

1426

1426

52

52

1328

1328

25

25

1273

1273

29

29

1256

1256

24

24

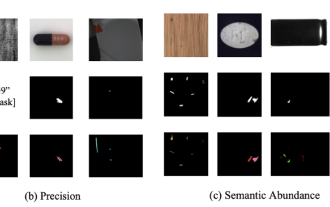

「Defect Spectrum」は、従来の欠陥検出の限界を打ち破り、超高精度かつ豊富なセマンティックな産業用欠陥検出を初めて実現します。

Jul 26, 2024 pm 05:38 PM

「Defect Spectrum」は、従来の欠陥検出の限界を打ち破り、超高精度かつ豊富なセマンティックな産業用欠陥検出を初めて実現します。

Jul 26, 2024 pm 05:38 PM

現代の製造において、正確な欠陥検出は製品の品質を確保するための鍵であるだけでなく、生産効率を向上させるための核心でもあります。ただし、既存の欠陥検出データセットには、実際のアプリケーションに必要な精度や意味論的な豊富さが欠けていることが多く、その結果、モデルが特定の欠陥カテゴリや位置を識別できなくなります。この問題を解決するために、広州香港科技大学と Simou Technology で構成されるトップの研究チームは、産業欠陥に関する詳細かつ意味的に豊富な大規模なアノテーションを提供する「DefectSpectrum」データセットを革新的に開発しました。表 1 に示すように、他の産業データ セットと比較して、「DefectSpectrum」データ セットは最も多くの欠陥注釈 (5438 個の欠陥サンプル) と最も詳細な欠陥分類 (125 個の欠陥カテゴリ) を提供します。

結晶相問題を解決するための数百万の結晶データを使用したトレーニング、深層学習手法 PhAI が Science 誌に掲載

Aug 08, 2024 pm 09:22 PM

結晶相問題を解決するための数百万の結晶データを使用したトレーニング、深層学習手法 PhAI が Science 誌に掲載

Aug 08, 2024 pm 09:22 PM

編集者 |KX 今日に至るまで、単純な金属から大きな膜タンパク質に至るまで、結晶学によって決定される構造の詳細と精度は、他のどの方法にも匹敵しません。しかし、最大の課題、いわゆる位相問題は、実験的に決定された振幅から位相情報を取得することのままです。デンマークのコペンハーゲン大学の研究者らは、結晶相の問題を解決するための PhAI と呼ばれる深層学習手法を開発しました。数百万の人工結晶構造とそれに対応する合成回折データを使用して訓練された深層学習ニューラル ネットワークは、正確な電子密度マップを生成できます。この研究では、この深層学習ベースの非経験的構造解法は、従来の非経験的計算法とは異なり、わずか 2 オングストロームの解像度で位相問題を解決できることが示されています。これは、原子解像度で利用可能なデータのわずか 10% ~ 20% に相当します。

NVIDIA 対話モデル ChatQA はバージョン 2.0 に進化し、コンテキストの長さは 128K と記載されています

Jul 26, 2024 am 08:40 AM

NVIDIA 対話モデル ChatQA はバージョン 2.0 に進化し、コンテキストの長さは 128K と記載されています

Jul 26, 2024 am 08:40 AM

オープンな LLM コミュニティは百花繚乱の時代です Llama-3-70B-Instruct、QWen2-72B-Instruct、Nemotron-4-340B-Instruct、Mixtral-8x22BInstruct-v0.1 などがご覧いただけます。優秀なパフォーマーモデル。しかし、GPT-4-Turboに代表される独自の大型モデルと比較すると、オープンモデルには依然として多くの分野で大きなギャップがあります。一般的なモデルに加えて、プログラミングと数学用の DeepSeek-Coder-V2 や視覚言語タスク用の InternVL など、主要な領域に特化したいくつかのオープン モデルが開発されています。

Google AI が IMO 数学オリンピック銀メダルを獲得、数理推論モデル AlphaProof が発売、強化学習が復活

Jul 26, 2024 pm 02:40 PM

Google AI が IMO 数学オリンピック銀メダルを獲得、数理推論モデル AlphaProof が発売、強化学習が復活

Jul 26, 2024 pm 02:40 PM

AI にとって、数学オリンピックはもはや問題ではありません。木曜日、Google DeepMind の人工知能は、AI を使用して今年の国際数学オリンピック IMO の本当の問題を解決するという偉業を達成し、金メダル獲得まであと一歩のところまで迫りました。先週終了したばかりの IMO コンテストでは、代数、組合せ論、幾何学、数論を含む 6 つの問題が出題されました。 Googleが提案したハイブリッドAIシステムは4問正解で28点を獲得し、銀メダルレベルに達した。今月初め、UCLA 終身教授のテレンス・タオ氏が、100 万ドルの賞金をかけて AI 数学オリンピック (AIMO Progress Award) を宣伝したばかりだったが、予想外なことに、AI の問題解決のレベルは 7 月以前にこのレベルまで向上していた。 IMO に関する質問を同時に行うのが最も難しいのは、最も歴史が長く、規模が最も大きく、最も否定的な IMO です。

PRO | なぜ MoE に基づく大規模モデルがより注目に値するのでしょうか?

Aug 07, 2024 pm 07:08 PM

PRO | なぜ MoE に基づく大規模モデルがより注目に値するのでしょうか?

Aug 07, 2024 pm 07:08 PM

2023 年には、AI のほぼすべての分野が前例のない速度で進化しています。同時に、AI は身体化されたインテリジェンスや自動運転などの主要な分野の技術的限界を押し広げています。マルチモーダルの流れのもと、AI大型モデルの主流アーキテクチャとしてのTransformerの状況は揺るがされるだろうか? MoE (専門家混合) アーキテクチャに基づく大規模モデルの検討が業界の新しいトレンドになっているのはなぜですか?ラージ ビジョン モデル (LVM) は、一般的な視覚における新たなブレークスルーとなる可能性がありますか? ...過去 6 か月間にリリースされたこのサイトの 2023 PRO メンバー ニュースレターから、上記の分野の技術トレンドと業界の変化を詳細に分析し、新しい分野での目標を達成するのに役立つ 10 の特別な解釈を選択しました。準備してください。この解釈は 2023 年の Week50 からのものです

新しい科学的で複雑な質問応答ベンチマークと大規模モデルの評価システムを提供するために、UNSW、アルゴンヌ、シカゴ大学、およびその他の機関が共同で SciQAG フレームワークを立ち上げました。

Jul 25, 2024 am 06:42 AM

新しい科学的で複雑な質問応答ベンチマークと大規模モデルの評価システムを提供するために、UNSW、アルゴンヌ、シカゴ大学、およびその他の機関が共同で SciQAG フレームワークを立ち上げました。

Jul 25, 2024 am 06:42 AM

編集者 |ScienceAI 質問応答 (QA) データセットは、自然言語処理 (NLP) 研究を促進する上で重要な役割を果たします。高品質の QA データ セットは、モデルの微調整に使用できるだけでなく、大規模言語モデル (LLM) の機能、特に科学的知識を理解し推論する能力を効果的に評価することもできます。現在、医学、化学、生物学、その他の分野をカバーする多くの科学 QA データ セットがありますが、これらのデータ セットにはまだいくつかの欠点があります。まず、データ形式は比較的単純で、そのほとんどが多肢選択式の質問であり、評価は簡単ですが、モデルの回答選択範囲が制限され、科学的な質問に回答するモデルの能力を完全にテストすることはできません。対照的に、自由回答型の Q&A

Transformer に基づく浙江大学の化学逆合成予測モデルは、Nature サブジャーナルで 60.8% に達しました。

Aug 06, 2024 pm 07:34 PM

Transformer に基づく浙江大学の化学逆合成予測モデルは、Nature サブジャーナルで 60.8% に達しました。

Aug 06, 2024 pm 07:34 PM

編集者 | KX 逆合成は創薬や有機合成において重要なタスクであり、そのプロセスを高速化するために AI の使用が増えています。既存の AI 手法はパフォーマンスが不十分で、多様性が限られています。実際には、化学反応は多くの場合、反応物と生成物の間にかなりの重複を伴う局所的な分子変化を引き起こします。これに触発されて、浙江大学のHou Tingjun氏のチームは、単一ステップの逆合成予測を分子列編集タスクとして再定義し、標的分子列を反復的に改良して前駆体化合物を生成することを提案した。そして、高品質かつ多様な予測を実現できる編集ベースの逆合成モデルEditRetroを提案する。広範な実験により、このモデルが標準ベンチマーク データ セット USPTO-50 K で優れたパフォーマンスを達成し、トップ 1 の精度が 60.8% であることが示されました。

自然の視点: 医療における人工知能のテストは混乱に陥っています。何をすべきでしょうか?

Aug 22, 2024 pm 04:37 PM

自然の視点: 医療における人工知能のテストは混乱に陥っています。何をすべきでしょうか?

Aug 22, 2024 pm 04:37 PM

編集者 | ScienceAI 限られた臨床データに基づいて、何百もの医療アルゴリズムが承認されています。科学者たちは、誰がツールをテストすべきか、そしてどのようにテストするのが最善かについて議論しています。デビン シン氏は、救急治療室で小児患者が治療を長時間待っている間に心停止に陥るのを目撃し、待ち時間を短縮するための AI の応用を模索するようになりました。 SickKids 緊急治療室からのトリアージ データを使用して、Singh 氏らは潜在的な診断を提供し、検査を推奨する一連の AI モデルを構築しました。ある研究では、これらのモデルにより医師の診察が 22.3% 短縮され、医療検査が必要な患者 1 人あたりの結果の処理が 3 時間近く高速化できることが示されました。ただし、研究における人工知能アルゴリズムの成功は、これを証明するだけです。