nvidia nimについてのすべて

nvidia nimとのAI推論の革新:深いダイビング

人工知能(AI)は、産業を世界的に変革し、ヘルスケア、自律車両、財務、顧客サービスに影響を与えています。 AIモデル開発は大きな注目を集めていますが、AI推論(トレーニングされたモデルを予測のために新しいデータに適用する)は、実際の影響が真に明らかになる場合です。 AIを搭載したアプリケーションがより一般的になるにつれて、効率的、スケーラブル、および低遅延の推論ソリューションの需要が高騰しています。 nvidia神経推論マイクロサービス(NIM)は、このニーズに対処します。 NIMは、開発者がAIモデルをマイクロサービスとして展開することを可能にし、大規模な推論ソリューションの提供を合理化します。この記事では、NIMの機能を調査し、NIM APIを介したモデルの使用法を示し、AI推論への変革的影響を紹介します。

主要な学習目標:

- AI推論とその産業間アプリケーションの重要性を把握します。

- AIモデルの展開におけるNVIDIA NIMの機能と利点を理解します。

- NVIDIA NIM APIを介して事前に訓練されたモデルにアクセスして利用することを学びます。

- 異なるAIモデル全体で推論速度を測定するプロセスをマスターします。

- テキスト生成と画像作成のためのNIMの実用的な例を探ります。

- NIMのモジュラーアーキテクチャと、スケーラブルなAIソリューションの利点に感謝します。

(この記事はデータサイエンスブログソンの一部です。)

目次:

- nvidia nimとは何ですか?

- Nvidia Nimの主要な機能の調査

- nvidia nim内のモデルへのアクセス

- さまざまなモデルで推論速度を評価します

- 安定した拡散3培地:ケーススタディ

- よくある質問

nvidia nimとは何ですか?

Nvidia Nimは、実際のアプリケーションでAI推論を簡素化するためのマイクロサービスを活用するプラットフォームです。独立しているが共同サービスであるマイクロサービスは、スケーラブルで適応可能なシステムの作成を可能にします。すぐに使用できるAIモデルをマイクロサービスとしてパッケージ化することにより、NIMを使用すると、開発者は複雑なインフラストラクチャやスケーリングの考慮事項なしでこれらのモデルを迅速に統合できます。

nvidia nimの重要な特性:

- 事前に訓練されたAIモデル: NIMは、音声認識、自然言語処理(NLP)、コンピュータービジョンなど、多様なタスク用の事前訓練を受けたモデルのライブラリを提供します。

- パフォーマンスの最適化: NIMは、低遅延のハイスループット推論のために、NVIDIAの強力なGPUおよびソフトウェアの最適化(Tensortなど)を利用しています。

- モジュラー設計:開発者は、マイクロサービスを組み合わせてカスタマイズして、特定の推論要件を満たすことができます。

Nvidia Nimの主要な機能の探索:

迅速な展開のための事前に訓練されたモデル: NIMは、さまざまなAIタスクを網羅した、即時展開の準備ができている幅広い事前訓練モデルを提供します。

低遅延の推論: NIMは、センサーとカメラデータの即時処理が最重要である自律運転などのリアルタイムアプリケーションにとって重要なクイック応答を提供することに優れています。

nvidia nimからのモデルへのアクセス:

- NVIDIA NIMにアクセスし、メールアドレスを使用してログインします。

- モデルを選択して、APIキーを取得します。

さまざまなモデルで推論速度を評価する:

このセクションでは、異なるAIモデルの推論速度を評価する方法を示します。応答時間は、リアルタイムアプリケーションにとって重要です。例として、推論モデル(llama-3.2-3b-instruct preview)を使用します。

推論モデル(llama-3.2-3b-instruct):

このNLPモデルは、ユーザークエリを処理および応答します。次のコードスニペット( openaiおよびpython-dotenvライブラリが必要)は、その使用法と測定の推論速度を示しています。

Openai Import Openaiから

dotenvインポートload_dotenvから

OSをインポートします

インポート時間

load_dotenv()

llama_api_key = os.getenv( 'nvidia_api_key')

client = openai(

base_url = "https://integrate.api.nvidia.com/v1"、

api_key = llama_api_key)

user_input = input( "クエリを入力:")

start_time = time.time()

client = client.chat.completions.create(

Model = "Meta/llama-3.2-3b-instruct"、

messages = [{"role": "user"、 "content":user_input}]、

温度= 0.2、

top_p = 0.7、

max_tokens = 1024、

ストリーム= true

))

end_time = time.time()

完了したチャンクの場合:

Chunk.Choices [0] .delta.contentは誰でもない場合:

print(chunk.choices [0] .delta.content、end = "")

Response_time = end_time -start_time

印刷(f "\ nresponse time:{respons_time}秒")

安定した拡散3培地:ケーススタディ

安定した拡散3培地は、テキストプロンプトから画像を生成します。次のコード( requestsライブラリを使用)は、その使用法を示しています。

リクエストをインポートします base64をインポートします dotenvインポートload_dotenvから OSをインポートします インポート時間 load_dotenv() invoke_url = "https://ai.api.nvidia.com/v1/genai/stability/stable-diffusion-3-medium" api_key = os.getenv( 'stable_diffusion_api') #...(コードの残りは同じままです)

結論:

Nvidia Nimは、効率的でスケーラブルなAI推論のための強力なソリューションを提供します。 GPU加速度と事前に訓練されたモデルと組み合わせたマイクロサービスアーキテクチャにより、クラウド環境とエッジ環境全体でリアルタイムAIアプリケーションを迅速に展開できます。

重要なテイクアウト:

- NIMのマイクロサービスアーキテクチャにより、AI推論の効率的なスケーリングが可能になります。

- Nimは、最適化された推論パフォーマンスのためにNvidia GPUとTensortをレバレッジします。

- NIMは、さまざまな業界の低遅延アプリケーションに最適です。

よくある質問:

Q1。 Nvidia Nimの主なコンポーネントは何ですか? A:コアコンポーネントには、推論サーバー、事前に訓練されたモデル、Tensortの最適化、マイクロサービスアーキテクチャが含まれます。

Q2。 nvidia nimは既存のAIモデルと統合できますか? A:はい、NIMは、コンテナ化されたマイクロサービスと標準APIを介して既存のモデルとの統合をサポートしています。

Q3。 nvidia nimはどのように機能しますか? A:NIMは、AIアシスタントとカピュロットの構築にAPIを提供し、ITおよびDevOpsチームのモデル展開を合理化することにより、AIアプリケーション開発を簡素化します。

Q4。 APIクレジットはいくつ提供されますか? A:個人用メールアカウントの1000単位、ビジネスアカウントの場合は5000クレジット。

(注:使用される画像は著者が所有しておらず、許可を得て使用されます。)

以上がnvidia nimについてのすべての詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7545

7545

15

15

1381

1381

52

52

83

83

11

11

21

21

87

87

カーソルAIでバイブコーディングを試してみましたが、驚くべきことです!

Mar 20, 2025 pm 03:34 PM

カーソルAIでバイブコーディングを試してみましたが、驚くべきことです!

Mar 20, 2025 pm 03:34 PM

バイブコーディングは、無限のコード行の代わりに自然言語を使用してアプリケーションを作成できるようにすることにより、ソフトウェア開発の世界を再構築しています。 Andrej Karpathyのような先見の明に触発されて、この革新的なアプローチは開発を許可します

2025年2月のトップ5 Genai発売:GPT-4.5、Grok-3など!

Mar 22, 2025 am 10:58 AM

2025年2月のトップ5 Genai発売:GPT-4.5、Grok-3など!

Mar 22, 2025 am 10:58 AM

2025年2月は、生成AIにとってさらにゲームを変える月であり、最も期待されるモデルのアップグレードと画期的な新機能のいくつかをもたらしました。 Xai’s Grok 3とAnthropic's Claude 3.7 SonnetからOpenaiのGまで

オブジェクト検出にYolo V12を使用する方法は?

Mar 22, 2025 am 11:07 AM

オブジェクト検出にYolo V12を使用する方法は?

Mar 22, 2025 am 11:07 AM

Yolo(あなたは一度だけ見ています)は、前のバージョンで各反復が改善され、主要なリアルタイムオブジェクト検出フレームワークでした。最新バージョンYolo V12は、精度を大幅に向上させる進歩を紹介します

クリエイティブプロジェクトのための最高のAIアートジェネレーター(無料&有料)

Apr 02, 2025 pm 06:10 PM

クリエイティブプロジェクトのための最高のAIアートジェネレーター(無料&有料)

Apr 02, 2025 pm 06:10 PM

この記事では、トップAIアートジェネレーターをレビューし、その機能、創造的なプロジェクトへの適合性、価値について説明します。 Midjourneyを専門家にとって最高の価値として強調し、高品質でカスタマイズ可能なアートにDall-E 2を推奨しています。

ChatGpt 4 oは利用できますか?

Mar 28, 2025 pm 05:29 PM

ChatGpt 4 oは利用できますか?

Mar 28, 2025 pm 05:29 PM

CHATGPT 4は現在利用可能で広く使用されており、CHATGPT 3.5のような前任者と比較して、コンテキストを理解し、一貫した応答を生成することに大幅な改善を示しています。将来の開発には、よりパーソナライズされたインターが含まれる場合があります

chatgptよりも優れたAIはどれですか?

Mar 18, 2025 pm 06:05 PM

chatgptよりも優れたAIはどれですか?

Mar 18, 2025 pm 06:05 PM

この記事では、Lamda、Llama、GrokのようなChatGptを超えるAIモデルについて説明し、正確性、理解、業界への影響における利点を強調しています(159文字)

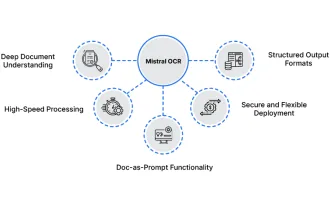

次のラグモデルにミストラルOCRを使用する方法

Mar 21, 2025 am 11:11 AM

次のラグモデルにミストラルOCRを使用する方法

Mar 21, 2025 am 11:11 AM

Mistral OCR:マルチモーダルドキュメントの理解により、検索された世代の革命を起こします 検索された生成(RAG)システムはAI機能を大幅に進めており、より多くの情報に基づいた応答のために膨大なデータストアにアクセスできるようになりました

トップAIライティングアシスタントは、コンテンツの作成を後押しします

Apr 02, 2025 pm 06:11 PM

トップAIライティングアシスタントは、コンテンツの作成を後押しします

Apr 02, 2025 pm 06:11 PM

この記事では、Grammarly、Jasper、Copy.ai、Writesonic、RytrなどのトップAIライティングアシスタントについて説明し、コンテンツ作成のためのユニークな機能に焦点を当てています。 JasperがSEOの最適化に優れているのに対し、AIツールはトーンの維持に役立つと主張します