前書き

これらはすべて Web に関連するものであり、Web サイトのクロールで多くの経験を積んできました。将来的には同じことを繰り返す必要はありません。

1. 最も基本的なサイトの取得

2. プロキシサーバーを使用しますIP がブロックされている場合や IP アクセスなどの場合には、これがより便利です回数制限があるなど。

import urllib2 content = urllib2.urlopen('http://XXXX').read()

ログインの状況はさらに厄介です: 3.1 Cookie の処理

import urllib2

proxy_support = urllib2.ProxyHandler({'http':'http://XX.XX.XX.XX:XXXX'})

opener = urllib2.build_opener(proxy_support, urllib2.HTTPHandler)

urllib2.install_opener(opener)

content = urllib2.urlopen('http://XXXX').read()を追加して

import urllib2, cookielib cookie_support= urllib2.HTTPCookieProcessor(cookielib.CookieJar()) opener = urllib2.build_opener(cookie_support, urllib2.HTTPHandler) urllib2.install_opener(opener) content = urllib2.urlopen('http://XXXX').read()

proxy_support然后operner

3.2 フォーム処理

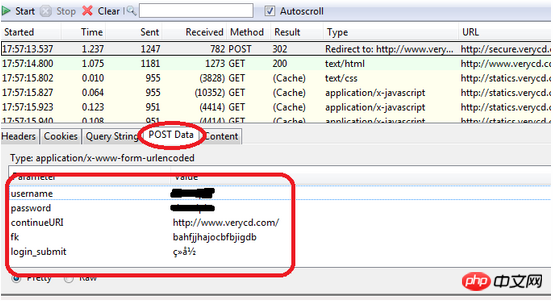

のフォームに記入する必要があります。ログイン、フォームに記入するにはどうすればよいですか?まず、ツールを使用して、入力するフォームのコンテンツを傍受します。たとえば、私は通常、どのようなパッケージを送信したかを確認するために firefox+httpfox プラグインを使用します

verycd を例に挙げて、まず送信した POST リクエストと POST フォーム項目を見つけます。 verycdが表示される場合は、username、password、 continueURI、fk、login_submit

を入力する必要があります。このうちfkはランダムに生成されます(実際にはそれほどランダムではなく、エポックタイムは単純なエンコードによって生成されているようです) ) は Web ページから取得する必要があります。つまり、最初に Web ページにアクセスし、正規表現などのツールを使用して、返されたデータ内の fk 項目をインターセプトする必要があります。ContinueURIはその名の通り気軽に書けるのに対し、login_submitは固定 なのがソースコードからも分かります。そしてユーザー名、パスワードは一目瞭然です。

なのがソースコードからも分かります。そしてユーザー名、パスワードは一目瞭然です。

それでは、データを入力したら、postdata を生成する必要がありますopener = urllib2.build_opener(proxy_support, cookie_support, urllib2.HTTPHandler)

次に、http リクエストを生成して、リクエストを送信します:

import urllib

postdata=urllib.urlencode({

'username':'XXXXX',

'password':'XXXXX',

'continueURI':'http://www.verycd.com/',

'fk':fk,

'login_submit':'登录'

})

一部の Web サイトはクローラーの訪問を嫌うため、クローラーからのリクエストを拒否します。現時点では、ブラウザとして偽装する必要があります。これは、http パッケージのヘッダーを変更することで実現できます:

req = urllib2.Request(

url = 'http://secure.verycd.com/signin/*/http://www.php.cn/',

data = postdata

)

result = urllib2.urlopen(req).read()

一部のサイトには、いわゆる実際、アンチホットリンク設定は、リクエストを送信するヘッダー内のリファラーサイトが自分のものであるかどうかを確認するだけなので、ヘッダーのリファラーを変更するだけです。 3.3 のようなウェブサイト。例として、有名な怪しげな cnbeta を取り上げます。

headers = {

'User-Agent':'Mozilla/5.0 (Windows; U; Windows NT 6.1; en-US; rv:1.9.1.6) Gecko/20091201 Firefox/3.5.6'

}

req = urllib2.Request(

url = 'http://secure.verycd.com/signin/*/http://www.php.cn/',

data = postdata,

headers = headers

)

headers は dict データ構造で、偽装したいヘッダーを置くことができます。たとえば、一部のスマートな Web サイトは、誰かがプロキシ経由でアクセスすると、ヘッダーの X-Forwarded-For を読み取り、その人の実際の IP を確認します。何も言うことがなければ、そのまま入力します。 X-Forwarded-For 変更してください、彼をいじめていじめるのに楽しいものに変更できます(笑)。

3.5 究極のトリック3.1 ~ 3.4 を実行してもアクセスがブロックされる場合があるため、httpfox に表示されるすべてのヘッダーを書き留めるだけで、通常は問題ありません。 それが機能しない場合は、ブラウザーが実行できる限り、Selenium がブラウザーを直接制御してアクセスすることもできます。同様のものにはパミエ、ワティルなどがあります。

4. マルチスレッド同時クロール

単一スレッドが遅すぎる場合は、マルチスレッドが必要です。このプログラムは単純に 1 ~ 10 を出力しますが、「はい」が表示されます。同時に。 headers = {

'Referer':'http://www.cnbeta.com/articles'

}

5. 確認コードの対処方法

確認コードが表示された場合はどうすればよいですか?ここで対処すべき状況は 2 つあります: 1. Google のような確認コード、クールです 2. 単純な確認コード: 文字数が制限されており、歪みのない単純な変換または回転とノイズのみが使用されます。検証コードはまだ残っていますが、一般的には回転させてノイズを除去し、分割が完了したら特徴抽出手法 (PCA など) を使用して個々の文字を分割します。次元を削減して特徴ライブラリを生成し、検証コードと特徴ライブラリを結合します。これは非常に複雑であり、1 つのブログ記事では説明できないため、ここでは詳しく説明しません。具体的な方法については、関連する教科書を入手してください。

実際、いくつかの検証コードはまだ非常に弱いので、ここでは名前を付けません。とにかく、方法 2 で非常に高い精度で検証コードを抽出できたので、2 は実際に実行可能です。

6 gzip/deflate のサポート

现在的网页普遍支持gzip压缩,这往往可以解决大量传输时间,以 VeryCD 的主页为例,未压缩版本247K,压缩了以后45K,为原来的1/5。这就意味着抓取速度会快5倍。

然而python的urllib/urllib2默认都不支持压缩,要返回压缩格式,必须在request的header里面写明'accept-encoding',然后读取response后更要检查header查看是否有'content-encoding'一项来判断是否需要解码,很繁琐琐碎。如何让urllib2自动支持gzip, defalte呢?

其实可以继承 BaseHanlder 类,然后build_opener的方式来处理:

import urllib2

from gzip import GzipFile

from StringIO import StringIO

class ContentEncodingProcessor(urllib2.BaseHandler):

"""A handler to add gzip capabilities to urllib2 requests """

# add headers to requests

def http_request(self, req):

req.add_header("Accept-Encoding", "gzip, deflate")

return req

# decode

def http_response(self, req, resp):

old_resp = resp

# gzip

if resp.headers.get("content-encoding") == "gzip":

gz = GzipFile(

fileobj=StringIO(resp.read()),

mode="r"

)

resp = urllib2.addinfourl(gz, old_resp.headers, old_resp.url, old_resp.code)

resp.msg = old_resp.msg

# deflate

if resp.headers.get("content-encoding") == "deflate":

gz = StringIO( deflate(resp.read()) )

resp = urllib2.addinfourl(gz, old_resp.headers, old_resp.url, old_resp.code) # 'class to add info() and

resp.msg = old_resp.msg

return resp

# deflate support

import zlib

def deflate(data): # zlib only provides the zlib compress format, not the deflate format;

try: # so on top of all there's this workaround:

return zlib.decompress(data, -zlib.MAX_WBITS)

except zlib.error:

return zlib.decompress(data)然后就简单了,

encoding_support = ContentEncodingProcessor opener = urllib2.build_opener( encoding_support, urllib2.HTTPHandler ) #直接用opener打开网页,如果服务器支持gzip/defalte则自动解压缩 content = opener.open(url).read()

7. 更方便地多线程

总结一文的确提及了一个简单的多线程模板,但是那个东东真正应用到程序里面去只会让程序变得支离破碎,不堪入目。在怎么更方便地进行多线程方面我也动了一番脑筋。先想想怎么进行多线程调用最方便呢?

1、用twisted进行异步I/O抓取

事实上更高效的抓取并非一定要用多线程,也可以使用异步I/O法:直接用twisted的getPage方法,然后分别加上异步I/O结束时的callback和errback方法即可。例如可以这么干:

from twisted.web.client import getPage from twisted.internet import reactor links = [ 'http://www.verycd.com/topics/%d/'%i for i in range(5420,5430) ] def parse_page(data,url): print len(data),url def fetch_error(error,url): print error.getErrorMessage(),url # 批量抓取链接 for url in links: getPage(url,timeout=5) \ .addCallback(parse_page,url) \ #成功则调用parse_page方法 .addErrback(fetch_error,url) #失败则调用fetch_error方法 reactor.callLater(5, reactor.stop) #5秒钟后通知reactor结束程序 reactor.run()

twisted人如其名,写的代码实在是太扭曲了,非正常人所能接受,虽然这个简单的例子看上去还好;每次写twisted的程序整个人都扭曲了,累得不得了,文档等于没有,必须得看源码才知道怎么整,唉不提了。

如果要支持gzip/deflate,甚至做一些登陆的扩展,就得为twisted写个新的 HTTPClientFactory 类诸如此类,我这眉头真是大皱,遂放弃。有毅力者请自行尝试。

2、设计一个简单的多线程抓取类

还是觉得在urllib之类python“本土”的东东里面折腾起来更舒服。试想一下,如果有个Fetcher类,你可以这么调用

f = Fetcher(threads=10) #设定下载线程数为10 for url in urls: f.push(url) #把所有url推入下载队列 while f.taskleft(): #若还有未完成下载的线程 content = f.pop() #从下载完成队列中取出结果 do_with(content) # 处理content内容

这么个多线程调用简单明了,那么就这么设计吧,首先要有两个队列,用Queue搞定,多线程的基本架构也和“技巧总结”一文类似,push方法和pop方法都比较好处理,都是直接用Queue的方法,taskleft则是如果有“正在运行的任务”或者”队列中的任务”则为是,也好办,于是代码如下:

import urllib2

from threading import Thread,Lock

from Queue import Queue

import time

class Fetcher:

def __init__(self,threads):

self.opener = urllib2.build_opener(urllib2.HTTPHandler)

self.lock = Lock() #线程锁

self.q_req = Queue() #任务队列

self.q_ans = Queue() #完成队列

self.threads = threads

for i in range(threads):

t = Thread(target=self.threadget)

t.setDaemon(True)

t.start()

self.running = 0

def __del__(self): #解构时需等待两个队列完成

time.sleep(0.5)

self.q_req.join()

self.q_ans.join()

def taskleft(self):

return self.q_req.qsize()+self.q_ans.qsize()+self.running

def push(self,req):

self.q_req.put(req)

def pop(self):

return self.q_ans.get()

def threadget(self):

while True:

req = self.q_req.get()

with self.lock: #要保证该操作的原子性,进入critical area

self.running += 1

try:

ans = self.opener.open(req).read()

except Exception, what:

ans = ''

print what

self.q_ans.put((req,ans))

with self.lock:

self.running -= 1

self.q_req.task_done()

time.sleep(0.1) # don't spam

if __name__ == "__main__":

links = [ 'http://www.verycd.com/topics/%d/'%i for i in range(5420,5430) ]

f = Fetcher(threads=10)

for url in links:

f.push(url)

while f.taskleft():

url,content = f.pop()

print url,len(content)8. 一些琐碎的经验

1、连接池:

opener.open和urllib2.urlopen一样,都会新建一个http请求。通常情况下这不是什么问题,因为线性环境下,一秒钟可能也就新生成一个请求;然而在多线程环境下,每秒钟可以是几十上百个请求,这么干只要几分钟,正常的有理智的服务器一定会封禁你的。

然而在正常的html请求时,保持同时和服务器几十个连接又是很正常的一件事,所以完全可以手动维护一个 HttpConnection 的池,然后每次抓取时从连接池里面选连接进行连接即可。

这里有一个取巧的方法,就是利用squid做代理服务器来进行抓取,则squid会自动为你维护连接池,还附带数据缓存功能,而且squid本来就是我每个服务器上面必装的东东,何必再自找麻烦写连接池呢。

2、设定线程的栈大小

栈大小的设定将非常显著地影响python的内存占用,python多线程不设置这个值会导致程序占用大量内存,这对openvz的vps来说非常致命。stack_size必须大于32768,实际上应该总要32768*2以上

from threading import stack_size stack_size(32768*16)

3、设置失败后自动重试

def get(self,req,retries=3):

try:

response = self.opener.open(req)

data = response.read()

except Exception , what:

print what,req

if retries>0:

return self.get(req,retries-1)

else:

print 'GET Failed',req

return ''

return data4、设置超时

import socket socket.setdefaulttimeout(10) #设置10秒后连接超时

登陆更加简化了,首先build_opener中要加入cookie支持,如要登陆 VeryCD ,给Fetcher新增一个空方法login,并在 init ()中调用,然后继承Fetcher类并override login方法:

def login(self,username,password):

import urllib

data=urllib.urlencode({'username':username,

'password':password,

'continue':'http://www.verycd.com/',

'login_submit':u'登录'.encode('utf-8'),

'save_cookie':1,})

url = 'http://www.verycd.com/signin'

self.opener.open(url,data).read()于是在Fetcher初始化时便会自动登录 VeryCD 网站。

9. 总结

如此,以上就是总结Python で Web サイトをクロールするための実践的なヒント的全部内容了,本文内容代码简单,使用方便,性能也不俗,相信对各位使用python有很大的帮助。

更多Python で Web サイトをクロールするための実践的なヒント相关文章请关注PHP中文网!