PHP クローラー テクノロジーのナレッジ ポイントのまとめ

現在、Python、nodejs、Java、C#、PHP をベースにしたクローラー フレームワークが数多くあり、その中でも Python ベースのクローラーが最も人気があり、すでに確実なものもあります。 Octopus、Locomotive、その他のソフトウェアなどのソフトウェアの操作。

今日最初に試みることは、PHP を使用してクローラー プログラムを実装することです。まず、クローラー フレームワークを使用せずに練習して、クローラーの原理を理解してから、PHP のライブラリ、フレームワーク、拡張機能を使用して練習します。

1.PHP シンプルなクローラー – プロトタイプ

クローラーの原理:

元の URL を指定します。

分析リンク、取得設定された正規表現に従ってリンク内のコンテンツを取得します。

元の URL を更新し、リンクを分析して特定のコンテンツを取得し、サイクルが再び始まります。

取得した内容をデータベース(mysql)またはローカルファイルに保存します

以下はインターネットからの例です。リストアップして分析してみましょうmain<span style="margin:0px;padding:0px;max-width:100%;font-size:15px;">main</span> function Start

<?php/** * 爬虫程序 -- 原型 * 从给定的url获取html内容 * @param string $url * @return string */function _getUrlContent($url) { $handle = fopen($url, "r");

if ($handle) {

$content = stream_get_contents($handle, -1);

//读取资源流到一个字符串,第二个参数需要读取的最大的字节数。默认是-1(读取全部的缓冲数据) // $content = file_get_contents($url, 1024 * 1024); return $content; } else {

return false; } } /** * 从html内容中筛选链接 * @param string $web_content * @return array */function _filterUrl($web_content) { $reg_tag_a = '/<[a|A].*?href=[\'\"]{0,1}([^>\'\"\ ]*).*?>/';

$result = preg_match_all($reg_tag_a, $web_content, $match_result);

if ($result) {

return $match_result[1]; } } /** * 修正相对路径 * @param string $base_url * @param array $url_list * @return array */function _reviseUrl($base_url, $url_list) { $url_info = parse_url($base_url);//解析url $base_url = $url_info["scheme"] . '://';

if ($url_info["user"] && $url_info["pass"]) {

$base_url .= $url_info["user"] . ":" . $url_info["pass"] . "@"; } $base_url .= $url_info["host"];

if ($url_info["port"]) {

$base_url .= ":" . $url_info["port"]; } $base_url .= $url_info["path"];

if (is_array($url_list)) {

foreach ($url_list as $url_item) {

if (preg_match('/^http/', $url_item)) {

// 已经是完整的url $result[] = $url_item; } else { // 不完整的url

$real_url = $base_url . '/' . $url_item;

$result[] = $real_url; } } return $result; } else {

return; } } /** * 爬虫 * @param string $url * @return array */function crawler($url) { $content = _getUrlContent($url);

if ($content) {

$url_list = _reviseUrl($url, _filterUrl($content));

if ($url_list) {

return $url_list; } else {

return ; } } else {

return ; } } /** * 测试用主程序 */function main() { $file_path = "url-01.txt";

$current_url = "http://www.baidu.com/"; //初始url if(file_exists($file_path)){ unlink($file_path); }

$fp_puts = fopen($file_path, "ab"); //记录url列表 $fp_gets = fopen($file_path, "r"); //保存url列表 do {

$result_url_arr = crawler($current_url);

if ($result_url_arr) {

foreach ($result_url_arr as $url) { fputs($fp_puts, $url . "\r\n"); } } }

while ($current_url = fgets($fp_gets, 1024)); //不断获得url} main();?>2. crul lib を使用します

Curl は、例外処理、http ヘッダー、POST などで優れた機能を果たします。重要なのは、MySQL を操作することです。データベース操作には PHP を使用します。 curl の具体的な手順については、PHP の公式ドキュメントを確認してください。ただし、マルチスレッド Curl (Curl_multi) に関しては、さらに面倒です。

crul を有効にする

winow システムの場合:

- php.in を変更します (コメントします。削除するだけです)

extension=php_curl.dll

libeay32.dll、php フォルダー内の ssleay32 。 dll、libssh2.dll、php_curl php/ext の下の 4 つのファイルが windows/system32 に移動されます

crul クローラーを使用する手順:- cURL 関数を使用する基本的な考え方は、curl_init( ) cURL セッション;

- 次に、curl_setopt() を通じて必要なオプションをすべて設定します。

- 次に、curl_exec() を使用してセッションを実行します。

- セッションが終了したら、curl_close() を使用します。

例文

$ch =curl_init("http://www.example.com/");

$fp = fopen("example_homepage.txt", "w");curl_setopt($ch, CURLOPT_FILE, $fp) );curl_setopt( $ch, CURLOPT_HEADER, 0);curl_exec($ch);curl_close($ch);fclose($fp); ?>

一个完整点的例子:

<?php/** * 将demo1-01换成curl爬虫 * 爬虫程序 -- 原型 * 从给定的url获取html内容 * @param string $url * @return string */function _getUrlContent($url) { $ch=curl_init(); //初始化一个cURL会话 /*curl_setopt 设置一个cURL传输选项*/ //设置需要获取的 URL 地址 curl_setopt($ch,CURLOPT_URL,$url);

curl_setopt($ch, CURLOPT_RETURNTRANSFER, 1); curl_setopt($ch,CURLOPT_HEADER,1); // 设置浏览器的特定header curl_setopt($ch, CURLOPT_HTTPHEADER,

array(

"Host: www.baidu.com",

"Connection: keep-alive",

"Accept: text/html,

application/xhtml+xml,application/xml;q=0.9,*/*;q=0.8",

"Upgrade-Insecure-Requests: 1",

"DNT:1",

"Accept-Language: zh-CN,zh;q=0.8,en-GB;q=0.6,en;q=0.4,en-US;q=0.2",

));

$result=curl_exec($ch);//执行一个cURL会话 $code=curl_getinfo($ch,CURLINFO_HTTP_CODE);// 最后一个收到的HTTP代码 if($code!='404' && $result){

return $result; } curl_close($ch);//关闭cURL} /** * 从html内容中筛选链接 * @param string $web_content * @return array */function _filterUrl($web_content) { $reg_tag_a = '/<[a|A].*?href=[\'\"]{0,1}([^>\'\"\ ]*).*?>/';

$result = preg_match_all($reg_tag_a, $web_content, $match_result);

if ($result) {

return $match_result[1]; } } /** * 修正相对路径 * @param string $base_url * @param array $url_list * @return array */function _reviseUrl($base_url, $url_list) { $url_info = parse_url($base_url);//解析url $base_url = $url_info["scheme"] . '://';

if ($url_info["user"] && $url_info["pass"]) {

$base_url .= $url_info["user"] . ":" . $url_info["pass"] . "@"; } $base_url .= $url_info["host"];

if ($url_info["port"]) {

$base_url .= ":" . $url_info["port"]; } $base_url .= $url_info["path"];

if (is_array($url_list)) {

foreach ($url_list as $url_item) {

if (preg_match('/^http/', $url_item)) {

// 已经是完整的url $result[] = $url_item; } else {

// 不完整的url $real_url = $base_url . '/' . $url_item;

$result[] = $real_url; } } return $result; } else {

return; } } /** * 爬虫 * @param string $url * @return array */function crawler($url) { $content = _getUrlContent($url);

if ($content) {

$url_list = _reviseUrl($url, _filterUrl($content));

if ($url_list) {

return $url_list; } else {

return ; } } else {

return ; } } /** * 测试用主程序 */function main() { $file_path = "./url-03.txt";

if(file_exists($file_path)){ unlink($file_path); } $current_url = "http://www.baidu.com"; //初始url //记录url列表 ab- 追加打开一个二进制文件,并在文件末尾写数据 $fp_puts = fopen($file_path, "ab"); //保存url列表 r-只读方式打开,将文件指针指向文件头 $fp_gets = fopen($file_path, "r"); do {

$result_url_arr = crawler($current_url);

echo "<p>$current_url</p>";

if ($result_url_arr) {

foreach ($result_url_arr as $url) { fputs($fp_puts, $url . "\r\n"); } } } while ($current_url = fgets($fp_gets, 1024)); //不断获得url} main();?>要对https支持,需要在_getUrlContent函数中加入下面的设置:

curl_setopt($ch, CURLOPT_HTTPAUTH, CURLAUTH_BASIC ) ; curl_setopt($ch, CURLOPT_USERPWD, "username:password"); curl_setopt($ch, CURLOPT_SSLVERSION,3); curl_setopt($ch, CURLOPT_SSL_VERIFYPEER, FALSE); curl_setopt($ch, CURLOPT_SSL_VERIFYHOST, 2);

结果疑惑:

我们通过1和2部分得到的结果差异很大,第1部分能得到四千多条url数据,而第2部分却一直是45条数据。

还有我们获得url数据可能会有重复的,这部分处理在我的github上,对应demo2-01.php,或者demo2-02.php

3.file_get_contents/stream_get_contents与curl对比

3.1 file_get_contents/stream_get_contents对比

stream_get_contents — 读取资源流到一个字符串

与 [file_get_contents()]一样,但是 stream_get_contents() 是对一个已经打开的资源流进行操作,并将其内容写入一个字符串返回

$handle = fopen($url, "r");

$content = stream_get_contents() $ハンドル、- 1);

//リソース ストリームを文字列に読み取ります。2 番目のパラメーターは、読み取られる最大バイト数です。デフォルトは -1 (バッファリングされたデータをすべて読み取る) です

file_get_contents — 将整个文件读入一个字符串

<code style="margin:0px;padding:0px;max-width:100%;font-family:Consolas, Inconsolata, Courier, monospace;white-space:pre;"><span style="color:#4f4f4f;margin:0px;padding:0px;max-width:100%;">$content</span> = file_get_contents(<span style="color:#4f4f4f;margin:0px;padding:0px;max-width:100%;">$url</span>, <span style="margin:0px;padding:0px;max-width:100%;">1024</span> * <span style="margin:0px;padding:0px;max-width:100%;">1024</span>);<br/><span style="font-family:'PingFang SC', 'Microsoft YaHei', SimHei, Arial, SimSun;color:#999999;margin:0px;padding:0px;max-width:100%;text-align:justify;background-color:rgb(238,240,244);">【注】 如果要打开有特殊字符的 URL (比如说有空格),就需要使用进行 URL 编码。</span></code>

3.2 file_get_contents/stream_get_contents与curl对比

- fopen /file_get_contents 每次请求都会重新做DNS查询,并不对 DNS信息进行缓存。但是CURL会自动对DNS信息进行缓存。对同一域名下的网页或者图片的请求只需要一次DNS查询。这大大减少了DNS查询的次数。所以CURL的性能比fopen /file_get_contents 好很多。

fopen /file_get_contents 在请求HTTP时,使用的是http_fopen_wrapper,不会keeplive。而curl却可以。这样在多次请求多个链接时,curl效率会好一些。

fopen / file_get_contents 函数会受到php.ini文件中allow_url_open选项配置的影响。如果该配置关闭了,则该函数也就失效了。而curl不受该配置的影响。

curl 可以模拟多种请求,例如:POST数据,表单提交等,用户可以按照自己的需求来定制请求。而fopen / file_get_contents只能使用get方式获取数据

相关推荐:

以上がPHP クローラー テクノロジーのナレッジ ポイントのまとめの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7488

7488

15

15

1377

1377

52

52

77

77

11

11

19

19

40

40

Ubuntu および Debian 用の PHP 8.4 インストールおよびアップグレード ガイド

Dec 24, 2024 pm 04:42 PM

Ubuntu および Debian 用の PHP 8.4 インストールおよびアップグレード ガイド

Dec 24, 2024 pm 04:42 PM

PHP 8.4 では、いくつかの新機能、セキュリティの改善、パフォーマンスの改善が行われ、かなりの量の機能の非推奨と削除が行われています。 このガイドでは、Ubuntu、Debian、またはその派生版に PHP 8.4 をインストールする方法、または PHP 8.4 にアップグレードする方法について説明します。

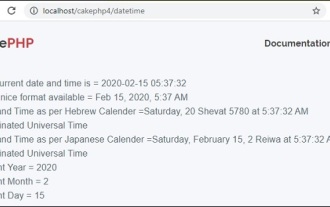

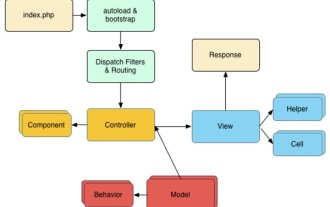

CakePHP について話し合う

Sep 10, 2024 pm 05:28 PM

CakePHP について話し合う

Sep 10, 2024 pm 05:28 PM

CakePHP は、PHP 用のオープンソース フレームワークです。これは、アプリケーションの開発、展開、保守をより簡単にすることを目的としています。 CakePHP は、強力かつ理解しやすい MVC のようなアーキテクチャに基づいています。モデル、ビュー、コントローラー

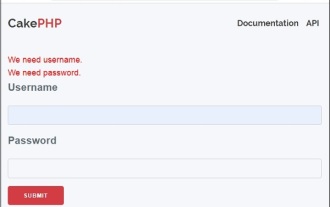

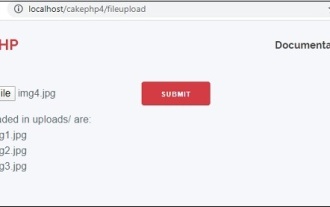

CakePHP ファイルのアップロード

Sep 10, 2024 pm 05:27 PM

CakePHP ファイルのアップロード

Sep 10, 2024 pm 05:27 PM

ファイルのアップロードを行うには、フォーム ヘルパーを使用します。ここではファイルアップロードの例を示します。

PHP 開発用に Visual Studio Code (VS Code) をセットアップする方法

Dec 20, 2024 am 11:31 AM

PHP 開発用に Visual Studio Code (VS Code) をセットアップする方法

Dec 20, 2024 am 11:31 AM

Visual Studio Code (VS Code とも呼ばれる) は、すべての主要なオペレーティング システムで利用できる無料のソース コード エディター (統合開発環境 (IDE)) です。 多くのプログラミング言語の拡張機能の大規模なコレクションを備えた VS Code は、

CakePHP クイックガイド

Sep 10, 2024 pm 05:27 PM

CakePHP クイックガイド

Sep 10, 2024 pm 05:27 PM

CakePHP はオープンソースの MVC フレームワークです。これにより、アプリケーションの開発、展開、保守がはるかに簡単になります。 CakePHP には、最も一般的なタスクの過負荷を軽減するためのライブラリが多数あります。

PHPでHTML/XMLを解析および処理するにはどうすればよいですか?

Feb 07, 2025 am 11:57 AM

PHPでHTML/XMLを解析および処理するにはどうすればよいですか?

Feb 07, 2025 am 11:57 AM

このチュートリアルでは、PHPを使用してXMLドキュメントを効率的に処理する方法を示しています。 XML(拡張可能なマークアップ言語)は、人間の読みやすさとマシン解析の両方に合わせて設計された多用途のテキストベースのマークアップ言語です。一般的にデータストレージに使用されます