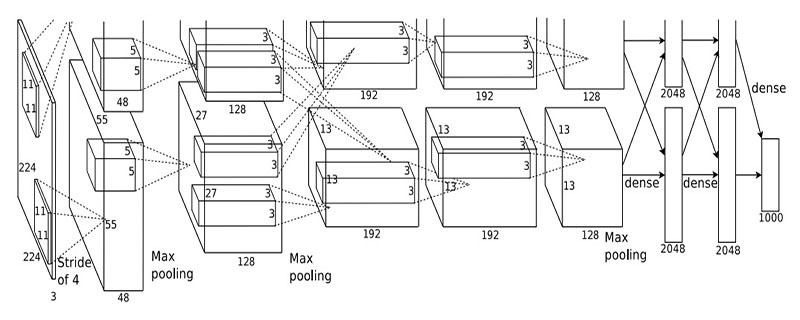

alexnet ネットワーク構造の詳細な説明

2012 年に Alex によって提案された Alexnet ネットワーク構造モデルは、ニューラル ネットワークの応用にブームを引き起こし、2012 年の画像認識コンペティションで優勝し、CNN を画像分類の中核アルゴリズム モデルにしました。

AlexNet モデルは 8 つの層、5 つの畳み込み層、および 3 つの全結合層に分割されており、各畳み込み層には励起関数 RELU と局所応答正規化 (LRN) が含まれています。 ) 処理を経て、ダウンサンプリング (プール処理) が行われます。 (推奨学習: Web フロントエンド ビデオ チュートリアル )

最初の層: 畳み込み層 1、入力は 224×224×3224 \times 224 \ × 3224×224×3 画像、コンボリューション カーネルの数は 96 です。論文では、2 つの GPU はそれぞれ 48 個のカーネルを計算します。コンボリューション カーネルのサイズは 11×11×311 \times 11 \times 311×11 です。 ×3; stride = 4、stride はステップ サイズを表し、pad = 0、エッジを拡張しないことを表します;

畳み込み後のグラフィックのサイズはどれくらいですか?

1 |

|

次に (ローカル応答の正規化) に進み、pool_size = (3, 3)、stride = 2、pad = 0 をプーリングして、最終的に畳み込みの最初の層の特徴マップを取得します

2 番目の層: 畳み込み層 2、入力は前の畳み込み層の特徴マップであり、畳み込みの数は 256 で、論文内の 2 つの GPU にはそれぞれ 128 個の畳み込み核があります。コンボリューション カーネルのサイズは次のとおりです: 5×5×485 \times 5 \times 485×5×48; パッド = 2、ストライド = 1; 次に LRN を実行し、最後に max_pooling、pool_size = (3, 3)、stride = 2;

3 番目の層: 畳み込み 3、入力は 2 番目の層の出力、畳み込みカーネルの数は 384、kernel_size = (3×3×2563 \times 3) \times 2563 ×3×256)、パディング = 1、3 番目の層は LRN とプールを実行しません

4 番目の層: Convolution 4、入力は 3 番目の層の出力です、畳み込みカーネル番号は 384、kernel_size = (3×33 \times 33×3)、padding = 1、LRN と Pool なしの 3 番目の層と同じです

5 番目の層: 畳み込み 5、入力は 4 番目の層の出力、畳み込みカーネルの数は 256、kernel_size = (3×33 \times 33×3)、パディング = 1。次に、max_pooling、pool_size = (3, 3)、stride = 2 に直接進みます。

6 番目、7 番目、8 番目の層は全結合層です、各層のニューロンの数は 4096 で、最終出力ソフトマックスは 1000 です。これは、前述したように、ImageNet コンペティションのカテゴリ数が 1000 であるためです。 RELU と Dropout は全結合層で使用されます。

以上がalexnet ネットワーク構造の詳細な説明の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

1664

1664

14

14

1423

1423

52

52

1318

1318

25

25

1269

1269

29

29

1248

1248

24

24

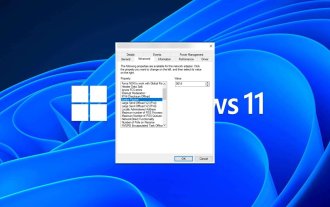

Windows 11でMTUサイズを調整する方法

Aug 25, 2023 am 11:21 AM

Windows 11でMTUサイズを調整する方法

Aug 25, 2023 am 11:21 AM

Windows 11 でインターネット接続が突然遅くなり、本書に記載されているすべての方法を試した場合、それはネットワークとは何の関係もなく、最大伝送単位 (MTU) に関係している可能性があります。システムが間違った MTU サイズでデータを送受信すると、問題が発生する可能性があります。この記事では、スムーズで中断のないインターネット接続のために Windows 11 で MTU サイズを変更する方法を学びます。 Windows 11 のデフォルトの MTU サイズはどれくらいですか? Windows 11 のデフォルトの MTU サイズは 1500 で、これが許容される最大値です。 MTU は最大伝送単位の略です。これは、ネットワーク上で送受信できる最大パケット サイズです。あらゆるサポートネットワーク

![WLAN拡張モジュールが停止しました[修正]](https://img.php.cn/upload/article/000/465/014/170832352052603.gif?x-oss-process=image/resize,m_fill,h_207,w_330) WLAN拡張モジュールが停止しました[修正]

Feb 19, 2024 pm 02:18 PM

WLAN拡張モジュールが停止しました[修正]

Feb 19, 2024 pm 02:18 PM

Windows コンピュータの WLAN 拡張モジュールに問題がある場合、インターネットから切断される可能性があります。この状況はイライラすることがよくありますが、幸いなことに、この記事では、この問題を解決し、ワイヤレス接続を再び正常に動作させるのに役立ついくつかの簡単な提案を提供します。 WLAN 拡張モジュールが停止しました。 WLAN 拡張モジュールが Windows コンピュータで動作を停止した場合は、次の提案に従って修正してください。 ネットワークとインターネットのトラブルシューティング ツールを実行して、ワイヤレス ネットワーク接続を無効にし、再度有効にします。 WLAN 自動構成サービスを再起動します。 電源オプションを変更します。 変更します。詳細な電源設定 ネットワーク アダプター ドライバーを再インストールする いくつかのネットワーク コマンドを実行する それでは、詳しく見てみましょう

win11のDNSサーバーエラーの解決方法

Jan 10, 2024 pm 09:02 PM

win11のDNSサーバーエラーの解決方法

Jan 10, 2024 pm 09:02 PM

インターネットにアクセスするには、インターネットに接続するときに正しい DNS を使用する必要があります。同様に、間違った DNS 設定を使用すると、DNS サーバー エラーが発生しますが、このときは、ネットワーク設定で DNS を自動的に取得するように選択することで問題を解決できます。ソリューション。 win11 ネットワーク dns サーバー エラーを解決する方法. 方法 1: DNS をリセットする 1. まず、タスクバーの [スタート] をクリックして入力し、[設定] アイコン ボタンを見つけてクリックします。 2. 次に、左側の列の「ネットワークとインターネット」オプションコマンドをクリックします。 3. 次に、右側で「イーサネット」オプションを見つけ、クリックして入力します。 4. その後、DNSサーバーの割り当ての「編集」をクリックし、最後にDNSを「自動(D)」に設定します。

Chrome、Google ドライブ、フォトでの「ネットワーク エラーの失敗」ダウンロードを修正してください。

Oct 27, 2023 pm 11:13 PM

Chrome、Google ドライブ、フォトでの「ネットワーク エラーの失敗」ダウンロードを修正してください。

Oct 27, 2023 pm 11:13 PM

「ネットワーク エラーのダウンロードに失敗しました」問題とは何ですか?解決策を詳しく説明する前に、まず「ネットワーク エラーのダウンロードに失敗しました」問題が何を意味するのかを理解しましょう。このエラーは通常、ダウンロード中にネットワーク接続が中断された場合に発生します。この問題は、インターネット接続の弱さ、ネットワークの混雑、サーバーの問題など、さまざまな理由で発生する可能性があります。このエラーが発生すると、ダウンロードが停止し、エラー メッセージが表示されます。ネットワークエラーで失敗したダウンロードを修正するにはどうすればよいですか? 「ネットワーク エラー ダウンロードに失敗しました」というメッセージが表示されると、必要なファイルへのアクセスまたはダウンロード中に障害が発生する可能性があります。 Chrome などのブラウザを使用している場合でも、Google ドライブや Google フォトなどのプラットフォームを使用している場合でも、このエラーはポップアップ表示され、不便を引き起こします。この問題を解決し、解決するために役立つポイントを以下に示します。

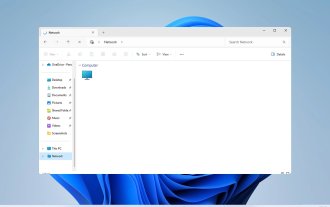

修正: WD My Cloud が Windows 11 のネットワーク上に表示されない

Oct 02, 2023 pm 11:21 PM

修正: WD My Cloud が Windows 11 のネットワーク上に表示されない

Oct 02, 2023 pm 11:21 PM

WDMyCloud が Windows 11 のネットワーク上に表示されない場合、特にそこにバックアップやその他の重要なファイルを保存している場合は、大きな問題になる可能性があります。これは、ネットワーク ストレージに頻繁にアクセスする必要があるユーザーにとって大きな問題となる可能性があるため、今日のガイドでは、この問題を永久に修正する方法を説明します。 WDMyCloud が Windows 11 ネットワークに表示されないのはなぜですか? MyCloud デバイス、ネットワーク アダプター、またはインターネット接続が正しく構成されていません。パソコンにSMB機能がインストールされていません。 Winsock の一時的な不具合がこの問題を引き起こす場合があります。クラウドがネットワーク上に表示されない場合はどうすればよいですか?問題の修正を開始する前に、いくつかの予備チェックを実行できます。

Windows 11 で Wake on LAN を有効/無効にする方法

Sep 06, 2023 pm 02:49 PM

Windows 11 で Wake on LAN を有効/無効にする方法

Sep 06, 2023 pm 02:49 PM

Wake on LAN は、コンピュータを休止状態またはスリープ モードからリモートで復帰できるようにする Windows 11 のネットワーク機能です。カジュアル ユーザーはあまり使用しませんが、この機能は有線ネットワークを使用するネットワーク管理者やパワー ユーザーにとっては便利です。今回はその設定方法を説明します。自分のコンピューターが Wake on LAN をサポートしているかどうかを確認するにはどうすればよいですか?この機能を使用するには、コンピュータに次のものが必要です。 リモートからスリープ モードから復帰できるように、PC を ATX 電源に接続する必要があります。アクセス コントロール リストを作成し、ネットワーク内のすべてのルーターに追加する必要があります。ネットワーク カードは Wake-up-on-LAN 機能をサポートしている必要があります。この機能が動作するには、両方のコンピュータが同じネットワーク上にある必要があります。ほとんどのイーサネット アダプタは

Windows 10 の右下に地球が表示されてインターネットにアクセスできない場合はどうすればよいですか? Win10 で地球がインターネットにアクセスできない問題のさまざまな解決策

Feb 29, 2024 am 09:52 AM

Windows 10 の右下に地球が表示されてインターネットにアクセスできない場合はどうすればよいですか? Win10 で地球がインターネットにアクセスできない問題のさまざまな解決策

Feb 29, 2024 am 09:52 AM

この記事では、Win10のシステムネットワーク上に地球儀マークが表示されるがインターネットにアクセスできない問題の解決策を紹介します。この記事では、地球がインターネットにアクセスできないことを示す Win10 ネットワークの問題を読者が解決するのに役立つ詳細な手順を説明します。方法 1: 直接再起動する まず、ネットワーク ケーブルが正しく接続されていないこと、ブロードバンドが滞っていないかを確認します。ルーターまたは光モデムが停止している可能性があります。この場合は、ルーターまたは光モデムを再起動する必要があります。コンピュータ上で重要な作業が行われていない場合は、コンピュータを直接再起動できます。ほとんどの軽微な問題は、コンピュータを再起動することですぐに解決できます。ブロードバンドが滞っておらず、ネットワークが正常であると判断される場合は、別の問題です。方法 2: 1. [Win]キーを押すか、左下の[スタートメニュー]をクリックし、表示されるメニュー項目の電源ボタンの上にある歯車アイコンをクリックし、[設定]をクリックします。

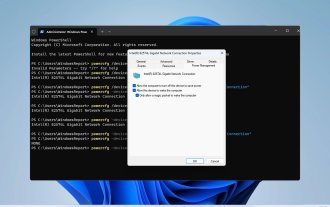

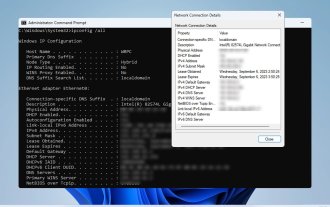

Windows 11 でネットワーク接続の詳細とステータスを確認する方法

Sep 11, 2023 pm 02:17 PM

Windows 11 でネットワーク接続の詳細とステータスを確認する方法

Sep 11, 2023 pm 02:17 PM

ネットワーク接続が適切に機能していることを確認するため、または問題を解決するために、Windows 11 のネットワーク接続の詳細を確認する必要がある場合があります。これにより、IP アドレス、MAC アドレス、リンク速度、ドライバーのバージョンなどのさまざまな情報を表示できます。このガイドでは、その方法を説明します。 Windows 11 でネットワーク接続の詳細を確認するにはどうすればよいですか? 1. 「設定」アプリを使用し、+ キーを押して Windows の設定を開きます。 WindowsI 次に、左側のペインで [ネットワークとインターネット] に移動し、ネットワークの種類を選択します。この場合、これはイーサネットです。ワイヤレス ネットワークを使用している場合は、代わりに Wi-Fi ネットワークを選択します。画面の下部に次のように表示されます。