Li Zhifei: GPT-4 に関する 8 つの観測、マルチモーダル大規模モデルの競争が始まる

GPT-4 は、標準化されたテストやその他のベンチマークで以前のモデルを上回り、数十の言語で動作し、入力として画像を取得します。つまり、チャットのコンテキストで写真や図の意図やロジックを理解できます。

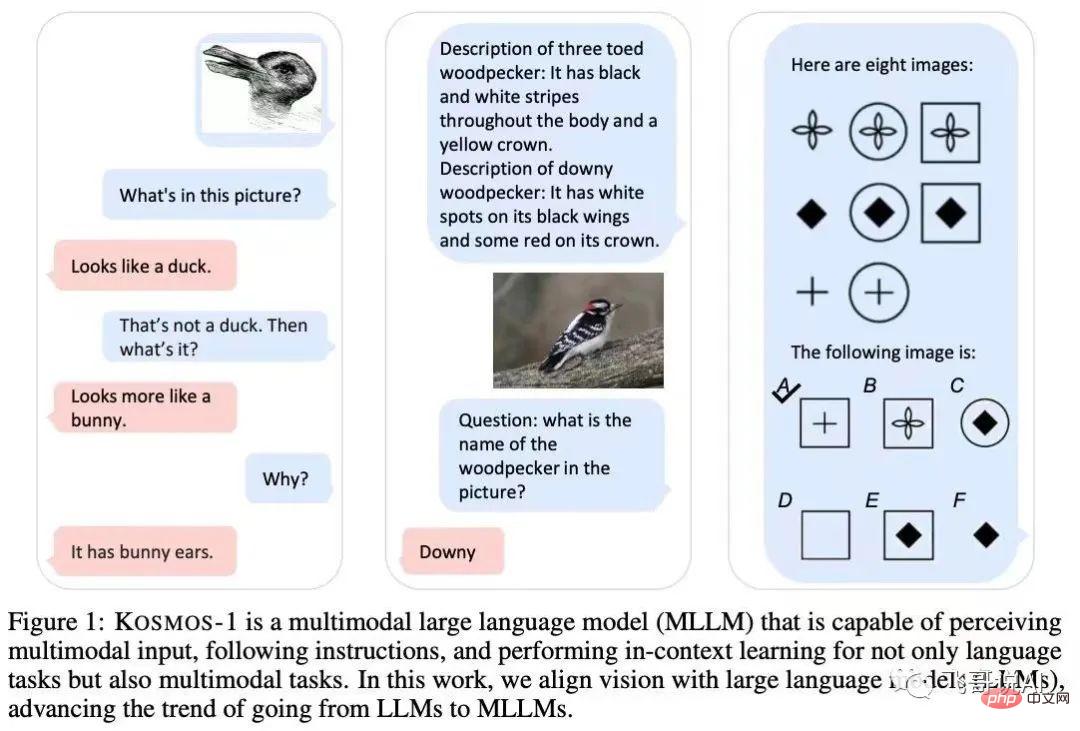

Microsoft は 3 月初旬にマルチモーダル モデル Kosmos-1 をリリースして以来、OpenAI のマルチモーダル モデルをテストおよび調整し、Microsoft 独自の製品との互換性を高めてきました。

案の定、GPT-4 のリリースに乗じて Microsoft も正式に手を出し、新しい Bing はすでに GPT-4 を使用しています。

ChatGPT で使用される言語モデルは GPT-3.5 です。GPT-4 が以前のバージョンよりもどのように強力であるかについて話したとき、OpenAI は、これら 2 つのバージョンは現在ランダム 話は似ていますが、「タスクの複雑さが十分なしきい値に達すると違いが現れます。」 GPT-4 はより信頼性が高く、より創造的で、より微妙な指示を処理できます。

国王が戴冠する? GPT-4 に関する 8 つの観察結果

#1. これまた驚くべき、人間よりも優れています

GPT-3 シリーズのモデルが AI に複数のタスクを実行できることを証明できれば、 GPT-4 は多くのタスクで人間のレベルに達しており、人間よりも優れたパフォーマンスを発揮します。 GPT-4 は多くの専門学術試験で人間の 90% を超えており、例えば司法試験模擬試験では、そのスコアは受験者の上位 10% にランクされています。さまざまな初等中等教育、大学、専門教育がこれにどう対応すべきでしょうか。2. "科学的" 錬金術

今回、OpenAI は具体的なパラメーターを発表しませんでしたが、GPT-4 モデルが小さくないはずであることが推測できます。モデルが多すぎると、トレーニング コストが高くなります。同時に、モデルのトレーニングは「エリクサーの精製」と非常に似ており、多くの実験が必要ですが、これらの実験を実際の環境でトレーニングすると、誰もが高いコストのプレッシャーに耐えられるわけではありません。 この目的のために、OpenAI は、いわゆる「予測可能なスケーリング」を独創的に開発しました。つまり、各実験の結果 (損失と人間の評価) を予測するためにコストの 1 万分の 1 を使用します。このようにして、当初の大規模な「幸運な」錬金術訓練は、「半科学的」錬金術訓練にアップグレードされました。3. 一石二鳥のクラウドソーシング評価

今回は、オープンソースの OpenAI Evals を非常に「スマート」な方法で提供し、誰でも利用できるようにします。クラウドソーシング 開発者や愛好家は、Evals を使用してモデルをテストし、同時に開発者エコシステムに参加することができます。この方法は、全員が参加意識を持てるだけでなく、全員が無料でシステムの評価や改善に協力することができ、質問やフィードバックもOpenAIが直接取得できるので一石二鳥です。

今回はシステムカードもリリースされました。これは、脆弱性を発見し、言語モデルの「無意味な」問題を軽減できるオープンな「パッチ適用」ツールです。前処理と後処理のためにシステムにさまざまなパッチが適用されており、パッチ適用機能を全員にクラウドソーシングするためにコードが後で公開される予定で、将来的には OpenAI によって全員がそれを支援できるようになる可能性があります。これは、LLM がついに、エレガントでシンプルな次のトークン予測タスクから、さまざまな厄介なエンジニアリング ハックに移行したことを示しています。

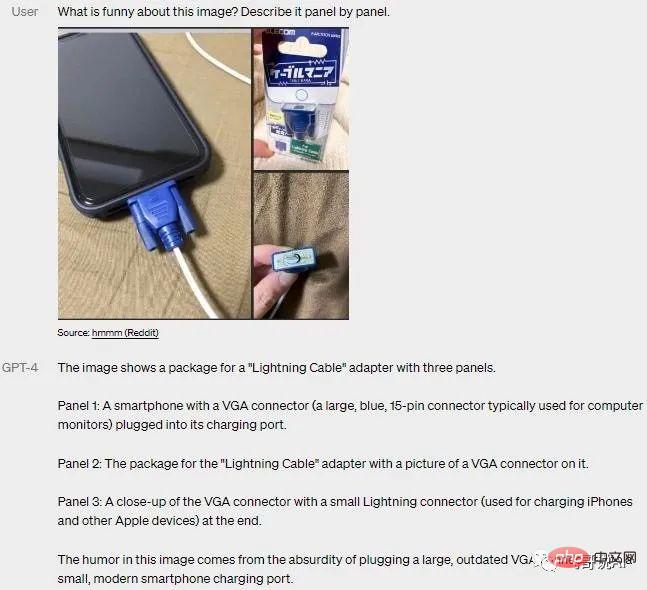

5. マルチモーダルドイツの Microsoft が先週、GPT-4 がマルチモーダルであることを明らかにして以来、一般の人々は非常に期待していました。

GPT-4 は長い間存在しています。「人間の脳に匹敵する」として知られるマルチモーダル機能は、実際には、多くの最新論文で説明されているマルチモーダル機能とそれほど変わりません。テキストモデルの少数ショットと論理チェーン(COT)を組み合わせるということですが、ここでの前提は、優れた基本機能とマルチモダリティを備えたテキストLLMが必要であり、それが良い結果を生み出すということです。

GPT-4 をデモする OpenAI のデモビデオによると, GPT-4は昨年8月にはすでにトレーニングを完了していましたが、本日リリースされたばかりで、残りの時間は大量のテストやさまざまなバグ修正、そして最も重要な危険なコンテンツ生成の除去に費やされています。

ChatGPT の驚くべき生成機能に誰もがまだ夢中になっている一方で、OpenAI はすでに GPT-4 を解決しています。この Google エンジニアの波は、おそらく再び追いつくために夜更かししなければならないでしょう?

7. OpenAI は Open ではなくなりましたOpenAI は公開論文でモデル パラメーターとデータ サイズについて言及しませんでした (オンラインで送信された GPT-4 パラメーターは 100 に達しました) GPT-4 の作り方を学んだ後は、誰もが GPT-4 を悪用したり、制御不能な事態を引き起こしたりするのではないかと心配しています。私個人としては、これにはまったく同意できません。ここにはシルバーの実践はありません。

8. 大きなことに努力を集中しましょう さまざまな「スキルの披露」に加えて、この論文では GPT-4 のさまざまなシステムに貢献したすべての人々のリストを 3 ページも使っています。大まかに見積もっても 100 人以上いるはずです。これもまた、OpenAI の内部チーム メンバー間の結束と高度なコラボレーションを反映しています。他社のチーム戦闘力と比較すると、団結力という点では少し遅れているでしょうか? 現在、マルチモーダル大型モデルは、AI 大型モデル全体の開発のトレンドであり、重要な方向性となっています。この大型モデル AI の「軍拡競争」では、Google、Microsoft、 DeepMind は、モーダルラージモデル (MLLM) またはラージモデル (LLM) といったマルチモーダル モデルを積極的に立ち上げています。 Microsoft: Kosmos-1 Microsoft は 3 月初旬に 16 億個のパラメータを備えたマルチモーダル モデル Kosmos-1 をリリースしましたが、そのネットワーク構造は Transformer の因果言語モデルに基づいています。その中で、Transformer デコーダは、マルチモーダル入力のユニバーサル インターフェイスとして使用されます。 Kosmos-1 モデルは、さまざまな自然言語タスクに加えて、視覚的な対話、視覚的な説明、視覚的な質問応答、画像の字幕、単純な数式など、知覚を必要とする幅広いタスクをネイティブに処理できます。 、OCR および説明 ゼロショット画像分類。 Google: PaLM-E 3 月初旬、Google とベルリン工科大学の研究チームは、最大規模のビジュアルを公開しました。現在までの言語モデル — —PaLM-E、最大 5,620 億のパラメーター (PaLM-540B ViT-22B)。 PaLM-E は、プレフィックスまたはプロンプトを指定して自己回帰的にテキスト補完を生成できる、大規模なデコーダー専用モデルです。モデルにエンコーダーを追加することで、モデルは画像または感覚データを言語タグと同じサイズの一連のベクトルにエンコードし、これをエンドツーエンド トレーニングの次のトークン予測の入力として使用できます。 DeepMind: Flamingo DeepMind は、昨年 4 月に Flamingo 視覚言語モデルを立ち上げました. このモデルは、画像、ビデオ、テキストをプロンプト (プロンプト) として使用し、関連する言語を出力します追加のトレーニングなしで多くの問題を解決するには、少数の具体的な例が必要です。 画像 (ビデオ) とテキストを相互入力することでモデルをトレーニングします。これにより、モデルは少数ショットのマルチモーダル シーケンス推論機能を備え、「テキスト説明の補完、VQA/テキスト VQA」およびその他のタスクを完了できます。 。 現在、マルチモーダル大規模モデルは、より多くのアプリケーションの可能性を示しており、比較的成熟したヴィンセント図に加えて、人間とコンピュータの相互作用、ロボット制御、画像検索、音声生成などの多数のアプリケーションが可能になっています。次々と登場しました。 まとめると、GPT-4 は AGI ではありませんが、マルチモーダル大規模モデルはすでに明確で明確な開発の方向性です。統一された、クロスシナリオ、マルチタスク、マルチモーダルの基本モデルを確立することは、人工知能の開発における主流のトレンドの 1 つになります。 ヒューゴは「科学は最終段階に達すると想像力に出会う。」と述べましたが、マルチモーダルな大型モデルの未来は人間の想像を超えているかもしれません。 新たな軍拡競争の幕開け: マルチモーダル大規模モデル

以上がLi Zhifei: GPT-4 に関する 8 つの観測、マルチモーダル大規模モデルの競争が始まるの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7486

7486

15

15

1377

1377

52

52

77

77

11

11

19

19

38

38

世界で最も強力なオープンソース MoE モデルが登場。GPT-4 に匹敵する中国語機能を備え、価格は GPT-4-Turbo のわずか 1% 近くです

May 07, 2024 pm 04:13 PM

世界で最も強力なオープンソース MoE モデルが登場。GPT-4 に匹敵する中国語機能を備え、価格は GPT-4-Turbo のわずか 1% 近くです

May 07, 2024 pm 04:13 PM

従来のコンピューティングを超える能力を備えているだけでなく、より低コストでより効率的なパフォーマンスを実現する人工知能モデルを想像してみてください。これは SF ではありません。世界で最も強力なオープンソース MoE モデルである DeepSeek-V2[1] が登場しました。 DeepSeek-V2 は、経済的なトレーニングと効率的な推論の特徴を備えた強力な専門家混合 (MoE) 言語モデルです。これは 236B のパラメータで構成されており、そのうち 21B は各マーカーをアクティブにするために使用されます。 DeepSeek67B と比較して、DeepSeek-V2 はパフォーマンスが優れていると同時に、トレーニング コストを 42.5% 節約し、KV キャッシュを 93.3% 削減し、最大生成スループットを 5.76 倍に高めます。 DeepSeek は一般的な人工知能を研究する会社です

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas は正式に電動ロボットの時代に突入します!昨日、油圧式アトラスが歴史の舞台から「涙ながらに」撤退したばかりですが、今日、ボストン・ダイナミクスは電動式アトラスが稼働することを発表しました。ボストン・ダイナミクス社は商用人型ロボットの分野でテスラ社と競争する決意を持っているようだ。新しいビデオが公開されてから、わずか 10 時間ですでに 100 万人以上が視聴しました。古い人が去り、新しい役割が現れるのは歴史的な必然です。今年が人型ロボットの爆発的な年であることは間違いありません。ネットユーザーは「ロボットの進歩により、今年の開会式は人間のように見え、人間よりもはるかに自由度が高い。しかし、これは本当にホラー映画ではないのか?」とコメントした。ビデオの冒頭では、アトラスは仰向けに見えるように地面に静かに横たわっています。次に続くのは驚くべきことです

MLP に代わる KAN は、オープンソース プロジェクトによって畳み込みまで拡張されました

Jun 01, 2024 pm 10:03 PM

MLP に代わる KAN は、オープンソース プロジェクトによって畳み込みまで拡張されました

Jun 01, 2024 pm 10:03 PM

今月初め、MIT やその他の機関の研究者らは、MLP に代わる非常に有望な代替案である KAN を提案しました。 KAN は、精度と解釈可能性の点で MLP よりも優れています。また、非常に少数のパラメーターを使用して、多数のパラメーターを使用して実行する MLP よりも優れたパフォーマンスを発揮できます。たとえば、著者らは、KAN を使用して、より小規模なネットワークと高度な自動化で DeepMind の結果を再現したと述べています。具体的には、DeepMind の MLP には約 300,000 個のパラメーターがありますが、KAN には約 200 個のパラメーターしかありません。 KAN は、MLP が普遍近似定理に基づいているのに対し、KAN はコルモゴロフ-アーノルド表現定理に基づいているのと同様に、強力な数学的基礎を持っています。以下の図に示すように、KAN は

テスラのロボットは工場で働く、マスク氏:手の自由度は今年22に達する!

May 06, 2024 pm 04:13 PM

テスラのロボットは工場で働く、マスク氏:手の自由度は今年22に達する!

May 06, 2024 pm 04:13 PM

テスラのロボット「オプティマス」の最新映像が公開され、すでに工場内で稼働可能となっている。通常の速度では、バッテリー(テスラの4680バッテリー)を次のように分類します:公式は、20倍の速度でどのように見えるかも公開しました - 小さな「ワークステーション」上で、ピッキング、ピッキング、ピッキング:今回は、それがリリースされたハイライトの1つビデオの内容は、オプティマスが工場内でこの作業を完全に自律的に行い、プロセス全体を通じて人間の介入なしに完了するというものです。そして、オプティマスの観点から見ると、自動エラー修正に重点を置いて、曲がったバッテリーを拾い上げたり配置したりすることもできます。オプティマスのハンドについては、NVIDIA の科学者ジム ファン氏が高く評価しました。オプティマスのハンドは、世界の 5 本指ロボットの 1 つです。最も器用。その手は触覚だけではありません

FisheyeDetNet: 魚眼カメラに基づいた最初のターゲット検出アルゴリズム

Apr 26, 2024 am 11:37 AM

FisheyeDetNet: 魚眼カメラに基づいた最初のターゲット検出アルゴリズム

Apr 26, 2024 am 11:37 AM

目標検出は自動運転システムにおいて比較的成熟した問題であり、その中でも歩行者検出は最も初期に導入されたアルゴリズムの 1 つです。ほとんどの論文では非常に包括的な研究が行われています。ただし、サラウンドビューに魚眼カメラを使用した距離認識については、あまり研究されていません。放射状の歪みが大きいため、標準のバウンディング ボックス表現を魚眼カメラに実装するのは困難です。上記の説明を軽減するために、拡張バウンディング ボックス、楕円、および一般的な多角形の設計を極/角度表現に探索し、これらの表現を分析するためのインスタンス セグメンテーション mIOU メトリックを定義します。提案された多角形モデルの FisheyeDetNet は、他のモデルよりも優れたパフォーマンスを示し、同時に自動運転用の Valeo 魚眼カメラ データセットで 49.5% の mAP を達成しました。

Llama 70B を実行するシングル カードはデュアル カードより高速、Microsoft は FP6 を A100 オープンソースに強制導入

Apr 29, 2024 pm 04:55 PM

Llama 70B を実行するシングル カードはデュアル カードより高速、Microsoft は FP6 を A100 オープンソースに強制導入

Apr 29, 2024 pm 04:55 PM

FP8 以下の浮動小数点数値化精度は、もはや H100 の「特許」ではありません。 Lao Huang は誰もが INT8/INT4 を使用できるようにしたいと考え、Microsoft DeepSpeed チームは NVIDIA からの公式サポートなしで A100 上で FP6 の実行を開始しました。テスト結果は、A100 での新しい方式 TC-FPx の FP6 量子化が INT4 に近いか、場合によってはそれよりも高速であり、後者よりも精度が高いことを示しています。これに加えて、エンドツーエンドの大規模モデルのサポートもあり、オープンソース化され、DeepSpeed などの深層学習推論フレームワークに統合されています。この結果は、大規模モデルの高速化にも即座に影響します。このフレームワークでは、シングル カードを使用して Llama を実行すると、スループットはデュアル カードのスループットの 2.65 倍になります。 1つ

オックスフォード大学の最新情報!ミッキー:2D画像を3D SOTAでマッチング! (CVPR\'24)

Apr 23, 2024 pm 01:20 PM

オックスフォード大学の最新情報!ミッキー:2D画像を3D SOTAでマッチング! (CVPR\'24)

Apr 23, 2024 pm 01:20 PM

前に書かれたプロジェクトのリンク: https://nianticlabs.github.io/mickey/ 2 枚の写真が与えられた場合、それらの写真間の対応関係を確立することで、それらの間のカメラのポーズを推定できます。通常、これらの対応は 2D 対 2D であり、推定されたポーズはスケール不定です。いつでもどこでもインスタント拡張現実などの一部のアプリケーションでは、スケール メトリクスの姿勢推定が必要なため、スケールを回復するために外部深度推定器に依存します。この論文では、3D カメラ空間でのメトリックの対応を予測できるキーポイント マッチング プロセスである MicKey を提案します。画像全体の 3D 座標マッチングを学習することで、相対的なメトリックを推測できるようになります。

OpenAI データは必要ありません。大規模なコード モデルのリストに加わりましょう。 UIUC が StarCoder-15B-Instruct をリリース

Jun 13, 2024 pm 01:59 PM

OpenAI データは必要ありません。大規模なコード モデルのリストに加わりましょう。 UIUC が StarCoder-15B-Instruct をリリース

Jun 13, 2024 pm 01:59 PM

ソフトウェア テクノロジの最前線に立つ UIUC Zhang Lingming のグループは、BigCode 組織の研究者とともに、最近 StarCoder2-15B-Instruct 大規模コード モデルを発表しました。この革新的な成果により、コード生成タスクにおいて大きな進歩が達成され、CodeLlama-70B-Instruct を上回り、コード生成パフォーマンス リストのトップに到達しました。 StarCoder2-15B-Instruct のユニークな特徴は、その純粋な自己調整戦略であり、トレーニング プロセス全体がオープンで透過的で、完全に自律的で制御可能です。このモデルは、高価な手動アノテーションに頼ることなく、StarCoder-15B 基本モデルの微調整に応じて、StarCoder2-15B を介して数千の命令を生成します。