ワンクリックでビデオのちらつきを除去、この研究は一般的なフレームワークを提案します

この論文は、追加のガイダンスやフリッカーの理解を必要とせず、さまざまなフリッカーアーティファクトを除去できる、初の汎用的なフリッカー除去方法を提案することに成功しました。

#高品質のビデオは通常、時間的には一貫していますが、多くのビデオではさまざまな理由によりちらつきが発生します。たとえば、一部の古いカメラ ハードウェアの品質が低く、各フレームの露光時間を同じに設定できないため、古い映画の明るさは非常に不安定になることがあります。さらに、露出時間が非常に短い高速カメラは、室内照明の高周波数 (60 Hz など) の変化を捉えることができます。

#画像強調、画像の色付け、スタイル転送などの効率的な処理アルゴリズムの中でも、時間的に一貫したビデオに画像アルゴリズムを適用すると、ちらつきが発生することがあります。

ビデオ生成方法によって生成されたビデオには、ちらつきアーティファクトが含まれる場合もあります。

ビデオからフリッカーを除去することは、一般的に時間的に一貫したビデオの方が視覚的に魅力的であるため、ビデオ処理やコンピュテーショナル フォトグラフィーの分野で非常に一般的です。

この CVPR 2023 論文は、次のような普遍的なフリッカー除去方法の研究に特化しています: (1) さまざまなフリッカー パターンまたはレベル (古い映画、高速カメラで撮影されたスローモーション画像など) アクションに対して高度に一般化されています。ビデオ)、(2)フリッカービデオのみが必要であり、他の補助情報(フリッカータイプ、追加の時間一貫性のあるビデオなど)は必要ありません。この方法はあまり多くの仮定を置かないため、幅広い適用シナリオがあります。

コード リンク: https://github.com/ChenyangLEI/All-in-one-Deflicker

プロジェクト リンク: https://chenyanglei. github.io/deflicker

ペーパーリンク: https://arxiv.org/pdf/2303.08120.pdf

方法

一般的なフリッカー除去方法は困難であるため、追加のガイダンスなしでビデオ全体で時間的一貫性を強制します。

既存の技術は通常、ちらつきの種類ごとに特定の戦略を設計し、特定の知識を使用します。たとえば、高速カメラで撮影されたスローモーション ビデオの場合、以前の研究では照明周波数を分析できました。画像処理アルゴリズムによって処理されたビデオの場合、ブラインド ビデオ時間的一貫性アルゴリズムは、時間的に一貫した未処理のビデオを参照として使用して、長期的な一貫性を取得できます。ただし、フリッカー タイプや未処理のビデオが常に利用できるとは限らないため、既存のフリッカー固有のアルゴリズムをこのケースに適用することはできません。

直観的な解決策は、オプティカル フローを使用して通信を追跡することです。ただし、フリッカービデオから取得されるオプティカル フローは十分な精度ではなく、オプティカル フローの累積誤差もフレーム数とともに増加します。

著者は、2 つの重要な観察と設計を通じて、追加のガイダンスなしでさまざまなちらつきアーティファクトを除去できる一般的なちらつき除去方法を提案することに成功しました。

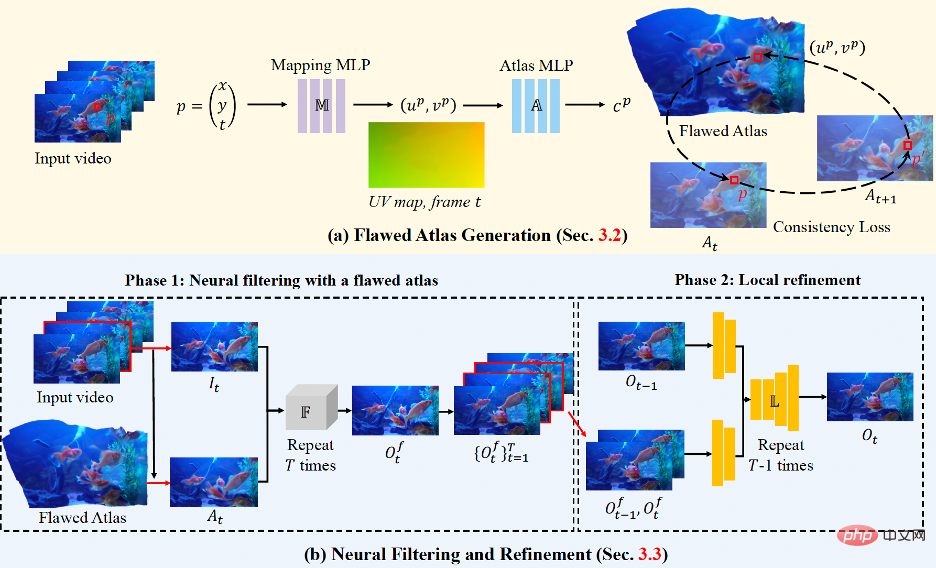

優れたブラインドフリッカー除去モデルには、すべてのビデオ フレーム間の対応する点を追跡する機能が必要です。ビデオ処理におけるほとんどのネットワーク構造は、少数のフレームしか入力として受け取ることができないため、受容野が小さくなり、長期的な一貫性を保証できません。研究者らは、ニューラル アトラスがフリッカー除去タスクに適していることを観察したため、このタスクにニューラル アトラスを導入する予定です。ニューラル アトラスは、ビデオ内のすべてのピクセルを統一的かつ簡潔に表現したものです。図 (a) に示すように、p をピクセルとします。各ピクセル p は、アトラス内のピクセルの対応する位置を示す 2D 座標 (up、vp) を予測するマッピング ネットワーク M に入力されます。理想的には、入力ピクセルが異なる色であっても、異なるフレーム間の対応する点はアトラス内のピクセルを共有する必要があります。つまり、これにより時間的な一貫性が確保されます。

第二に、共有レイヤーから取得されたフレームは一貫していますが、画像の構造には欠陥があります: ニューラル レイヤーは、動きの大きな動的オブジェクトを簡単にモデル化できません。オプティカル フローも完璧ではありません。そこで、著者らは、欠陥のある層から正常な部分を選択するためのニューラル フィルタリング戦略を提案しています。研究者らは、レイヤー内のアーティファクトとビデオ内のちらつきをシミュレートする 2 種類の歪みの下で不変性を学習するようにニューラル ネットワークをトレーニングしました。テストしたところ、ネットワークは一貫性プロパティを保持し、欠陥のある層のアーティファクトをブロックするフィルターとしてうまく機能しました。

実験

研究者らは、さまざまな実際のフリッカービデオを含むデータセットを構築しました。広範な実験により、私たちの方法が複数のタイプのフリッカービデオに対して満足のいくフリッカー除去効果を達成できることが示されています。研究者のアルゴリズムは、公開ベンチマークに関する追加のガイダンスを使用したベースライン手法をも上回りました。

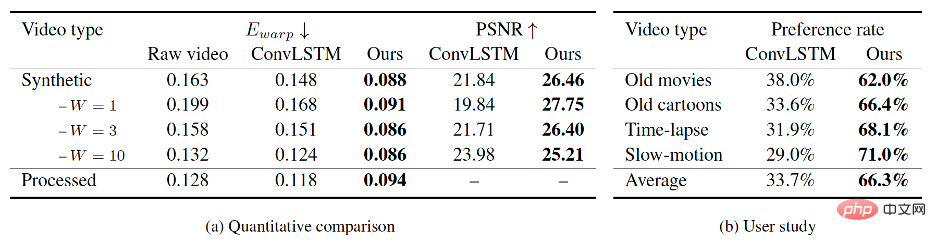

研究者は、(a) 処理されたフリッカー ビデオと合成されたフリッカー ビデオの定量的な比較を提供します。研究者の方法の変形誤差は、ベースラインよりもはるかに小さいです。 PSNR によると、研究者の結果は合成データの実際の値にも近いとのことです。他の現実世界のビデオについては、この研究では (b) 比較のための二重盲検実験が提供されており、ほとんどのユーザーは研究者の結果を好みました。

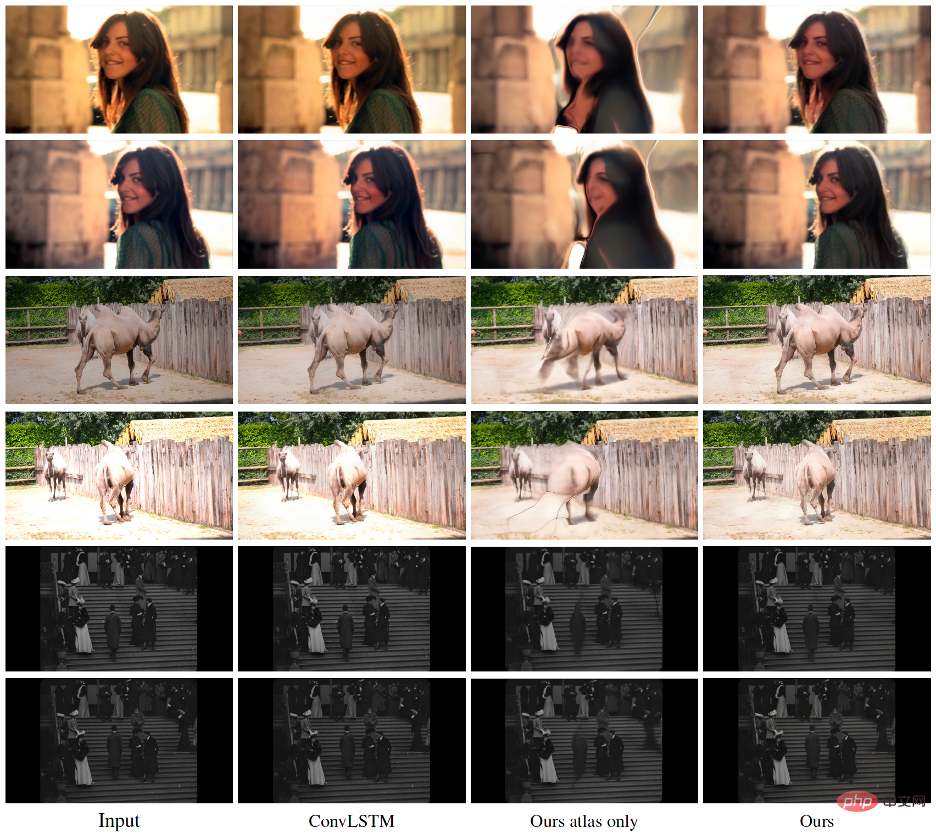

上の図に示すように、研究者のアルゴリズムは入力ビデオからちらつきを非常にうまく除去できます。写真の 3 列目はニューラル層の結果を示していることに注意してください。明らかな欠陥が観察されますが、研究者のアルゴリズムはその一貫性をうまく利用して、これらの欠陥の導入を回避できます。

このフレームワークは、古い映画や AI で生成されたビデオに含まれるさまざまなカテゴリのちらつきを除去できます。

以上がワンクリックでビデオのちらつきを除去、この研究は一般的なフレームワークを提案しますの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7486

7486

15

15

1377

1377

52

52

77

77

11

11

19

19

38

38

動画ファイルはブラウザのキャッシュのどこに保存されますか?

Feb 19, 2024 pm 05:09 PM

動画ファイルはブラウザのキャッシュのどこに保存されますか?

Feb 19, 2024 pm 05:09 PM

ブラウザはビデオをどのフォルダにキャッシュしますか? 私たちは毎日インターネット ブラウザを使用するときに、YouTube でミュージック ビデオを視聴したり、Netflix で映画を視聴したりするなど、さまざまなオンライン ビデオを視聴することがよくあります。これらのビデオは読み込みプロセス中にブラウザによってキャッシュされるため、将来再び再生するときにすぐに読み込むことができます。そこで問題は、これらのキャッシュされたビデオが実際にどのフォルダーに保存されるのかということです。ブラウザーが異なれば、キャッシュされたビデオ フォルダーは異なる場所に保存されます。以下に、いくつかの一般的なブラウザとそのブラウザを紹介します。

他人の動画をDouyinに投稿することは侵害になりますか?侵害せずにビデオを編集するにはどうすればよいですか?

Mar 21, 2024 pm 05:57 PM

他人の動画をDouyinに投稿することは侵害になりますか?侵害せずにビデオを編集するにはどうすればよいですか?

Mar 21, 2024 pm 05:57 PM

ショートビデオプラットフォームの台頭により、Douyinはみんなの日常生活に欠かせないものになりました。 TikTokでは世界中の面白い動画を見ることができます。他人のビデオを投稿することを好む人もいますが、「Douyin は他人のビデオを投稿することを侵害しているのでしょうか?」という疑問が生じます。この記事では、この問題について説明し、著作権を侵害せずに動画を編集する方法と、著作権侵害の問題を回避する方法について説明します。 1.Douyin による他人の動画の投稿は侵害ですか?私の国の著作権法の規定によれば、著作権者の著作物を著作権者の許可なく無断で使用することは侵害となります。したがって、オリジナルの作者または著作権所有者の許可なしに他人のビデオをDouyinに投稿することは侵害となります。 2. 著作権を侵害せずにビデオを編集するにはどうすればよいですか? 1. パブリックドメインまたはライセンスされたコンテンツの使用: パブリック

Wink でビデオの透かしを削除する方法

Feb 23, 2024 pm 07:22 PM

Wink でビデオの透かしを削除する方法

Feb 23, 2024 pm 07:22 PM

Wink でビデオからウォーターマークを削除するにはどうすればよいですか? winkAPP にはビデオからウォーターマークを削除するツールがありますが、ほとんどの友達は wink でビデオからウォーターマークを削除する方法を知りません。次は Wink でビデオからウォーターマークを削除する方法の画像です。編集者が持参したテキストチュートリアルですので、興味のある方はぜひ見に来てください! Wink でビデオ透かしを削除する方法 1. まず、Wink APP を開き、ホームページ領域で [透かしを削除] 機能を選択します; 2. 次に、アルバムで透かしを削除したいビデオを選択します; 3. 次に、ビデオを選択してクリックしますビデオ編集後、右上隅にある [√]; 4. 最後に、下図のように [ワンクリック印刷] をクリックし、[処理] をクリックします。

Douyin に動画を投稿して収益を得るにはどうすればよいですか?初心者はどうやってDouyinでお金を稼ぐことができますか?

Mar 21, 2024 pm 08:17 PM

Douyin に動画を投稿して収益を得るにはどうすればよいですか?初心者はどうやってDouyinでお金を稼ぐことができますか?

Mar 21, 2024 pm 08:17 PM

全国的なショートビデオプラットフォームであるDouyinは、自由な時間にさまざまな興味深く斬新なショートビデオを楽しむことができるだけでなく、自分自身を示し、自分の価値観を実現するステージも提供します。では、Douyin に動画を投稿してお金を稼ぐにはどうすればよいでしょうか?この記事ではこの質問に詳しく答え、TikTokでより多くのお金を稼ぐのに役立ちます。 1.Douyin に動画を投稿してお金を稼ぐにはどうすればよいですか?動画を投稿し、Douyin で一定の再生回数を獲得すると、広告共有プランに参加できるようになります。この収入方法はDouyinユーザーにとって最も馴染みのある方法の1つであり、多くのクリエイターにとって主な収入源でもあります。 Douyin は、アカウントの重み、動画コンテンツ、視聴者のフィードバックなどのさまざまな要素に基づいて、広告共有の機会を提供するかどうかを決定します。 TikTok プラットフォームでは、視聴者がギフトを送ったり、

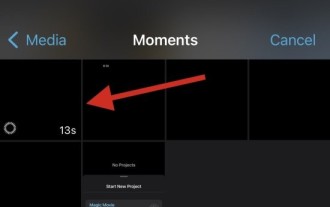

iPhoneのビデオからスローモーションを削除する2つの方法

Mar 04, 2024 am 10:46 AM

iPhoneのビデオからスローモーションを削除する2つの方法

Mar 04, 2024 am 10:46 AM

iOS デバイスでは、カメラ アプリを使用してスローモーション ビデオを撮影できます。最新の iPhone を使用している場合は、1 秒あたり 240 フレームのビデオを撮影することもできます。この機能により、高速アクションを詳細にキャプチャできます。ただし、ビデオの詳細やアクションをよりよく理解するために、スローモーション ビデオを通常の速度で再生したい場合もあります。この記事では、iPhone上の既存のビデオからスローモーションを削除するすべての方法を説明します。 iPhoneでビデオからスローモーションを削除する方法[2つの方法] 写真アプリまたはiMovieアプリを使用して、デバイス上のビデオからスローモーションを削除できます。方法 1: 写真アプリを使用して iPhone で開く

画質を圧縮せずにWeiboに動画を投稿する方法_画質を圧縮せずにWeiboに動画を投稿する方法

Mar 30, 2024 pm 12:26 PM

画質を圧縮せずにWeiboに動画を投稿する方法_画質を圧縮せずにWeiboに動画を投稿する方法

Mar 30, 2024 pm 12:26 PM

1. まず携帯電話で Weibo を開き、右下隅の [Me] をクリックします (図を参照)。 2. 次に、右上隅の [歯車] をクリックして設定を開きます (図を参照)。 3. 次に、[一般設定] を見つけて開きます (図を参照)。 4. 次に、[Video Follow] オプションを入力します (図を参照)。 5. 次に、[ビデオアップロード解像度]設定を開きます(図を参照)。 6. 最後に、圧縮を避けるために [オリジナルの画質] を選択します (図を参照)。

小紅書ビデオ作品を公開するにはどうすればよいですか?動画を投稿する際に注意すべきことは何ですか?

Mar 23, 2024 pm 08:50 PM

小紅書ビデオ作品を公開するにはどうすればよいですか?動画を投稿する際に注意すべきことは何ですか?

Mar 23, 2024 pm 08:50 PM

短編ビデオ プラットフォームの台頭により、Xiaohongshu は多くの人々が自分の生活を共有し、自分自身を表現し、トラフィックを獲得するためのプラットフォームになりました。このプラットフォームでは、ビデオ作品の公開が非常に人気のある交流方法です。では、小紅書ビデオ作品を公開するにはどうすればよいでしょうか? 1.小紅書ビデオ作品を公開するにはどうすればよいですか?まず、共有できるビデオ コンテンツがあることを確認します。携帯電話やその他のカメラ機器を使用して撮影することもできますが、画質と音声の明瞭さには注意する必要があります。 2.ビデオを編集する:作品をより魅力的にするために、ビデオを編集できます。 Douyin、Kuaishou などのプロ仕様のビデオ編集ソフトウェアを使用して、フィルター、音楽、字幕、その他の要素を追加できます。 3. 表紙を選択する: 表紙はユーザーのクリックを誘致するための鍵です。ユーザーのクリックを誘致するために、表紙には鮮明で興味深い写真を選択してください。

UC ブラウザでダウンロードしたビデオをローカルビデオに変換する方法

Feb 29, 2024 pm 10:19 PM

UC ブラウザでダウンロードしたビデオをローカルビデオに変換する方法

Feb 29, 2024 pm 10:19 PM

UC ブラウザでダウンロードしたビデオをローカルビデオに変換するにはどうすればよいですか?多くの携帯電話ユーザーは UC Browser を好んで使用しており、Web を閲覧するだけでなく、オンラインでさまざまなビデオやテレビ番組を視聴したり、お気に入りのビデオを携帯電話にダウンロードしたりすることもできます。実は、ダウンロードした動画をローカル動画に変換することもできますが、その方法がわからない人も多いでしょう。したがって、エディターは、UC ブラウザーによってキャッシュされたビデオをローカルビデオに変換する方法を特別に提供します。 uc ブラウザーのキャッシュされたビデオをローカルビデオに変換する方法 1. uc ブラウザーを開き、「メニュー」オプションをクリックします。 2.「ダウンロード/ビデオ」をクリックします。 3. 「キャッシュされたビデオ」をクリックします。 4. 任意のビデオを長押しし、オプションがポップアップ表示されたら、「ディレクトリを開く」をクリックします。 5. ダウンロードしたいものにチェックを入れます