GoogleはLLMの戦いに負けた! OpenAIに転職するトップ研究者が増えている

数日前、Google は広報上の危機に直面しそうになったが、Bert の元従業員で OpenAI を辞めた Jacob Devlin は、Bard が実際に ChatGPT データを使用してトレーニングされていることを明らかにした。

その後、Googleはすぐにそれを否定しました。

そして、この論争は大きな議論にもつながりました: なぜますます多くのトップ Google 研究者が OpenAI に転職するのでしょうか?それでもこのLLMの戦いに勝つことができるでしょうか?

友人の返信

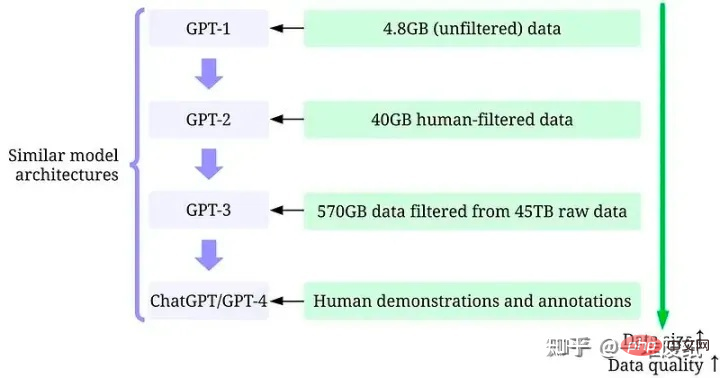

ライス大学の医師で親しい友人は、GoogleとOpenAIの間のギャップは実際にはデータのギャップであると言いました。

「OpenAI は LLM に強いこだわりを持っており、Google のような企業にはまったく匹敵しません。もちろん、人々の間のギャップは一面にすぎず、データのギャップとデータに対する態度が成功の鍵です。人々はおそらくお金をかけて掘り返しれば、テクノロジーで補うことはできるかもしれないが、Google がデータのギャップを短期間で追いつけることはないだろう。」

https://arxiv.org /abs/2303.10158

ChatGPT の成功の鍵となるのは、高品質の注釈付きデータであることは明らかです。

「紙くずの山」では、OpenAIがデータとラベルの品質を非常に重視しており、アノテーターの選定が非常に厳しく(試験がある)、最終的にはアンケートも発行するということが紹介されています。この執念こそが、Google がまったく匹敵することのできない GPT モデルの成功を生み出したのです。

そして、何億人ものユーザーが OpenAI に新しいデータを提供し続けるにつれて、Google と OpenAI の間の溝は広がるばかりです。

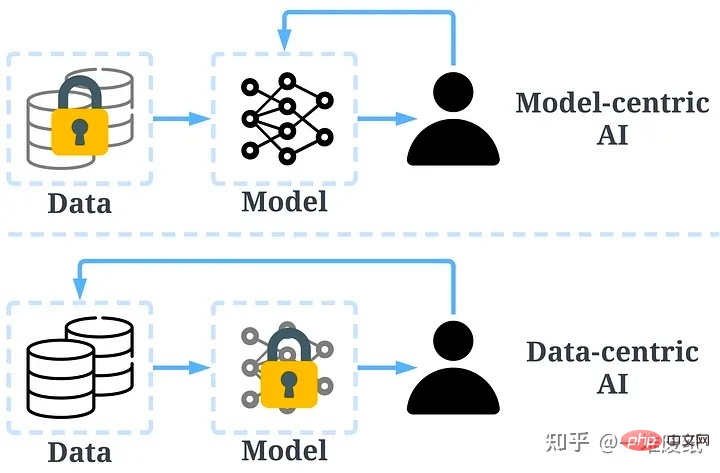

データ中心の AI の概念は、OpenAI の成功の基礎を築きました。

自然言語処理と深層学習のトピックに関する優れた回答者である「Zhang Junlin」は、OpenAI がすべての人を置き去りにしていると述べました。

実際、Googleを含め、LLM開発コンセプトの理解は明らかにOpenAIより一歩遅れています。 OpenAIのパフォーマンスが良すぎて、国内だけでなく誰もが置いてけぼりになっているのが現実だ。 OpenAIはLLMの概念や関連技術において海外ではGoogleやDeepMindより半年から1年程度先を行っており、中国よりも2年程度先を行っていると思います。

Zhihu の回答者「Zhou Daodao」は、Google の最近の転覆と OpenAI を比較したことは、これらのトップ研究者に大きなショックを与えたに違いないと述べた。

さらに、OpenAI は研究者に Google よりも多くのリソースと幅広い要件を与えると言われています。結局のところ、OpenAI は研究機関に近いのに対し、Google は AI を製品として扱う部門に近いのです。

回答者「陳大宝」さんの答えはとても悲痛なものです。

将来のビジネスの歴史には、2つの古典的で皮肉な事例が記録されるでしょう:

1. コダックがデジタルカメラを発明した

2. Googleが変圧器を発明した

写真出典: "Chen Dabao"

興味のある人もコメント欄に現れました。

また匿名の人が的中しました。

友人が、大企業としてのGoogleの「イノベーションのジレンマ」を指摘しました。

また匿名で関心のある人が現れました。

Zhihu "Xingnan Zhou (Bill)" は、Google のような大企業はポリシーに基づいて人間化しようとしていると結論付けました。

そして、Insider は、長年にわたって Google の人工知能チームから失われてきた優秀な人材についてまとめた長い記事をまとめてくれました。

才能ある人たちはどこへ行ったの?

Google は、人工知能の分野に非常に重要な研究に貢献してきました。しかし、同社はイノベーションを製品化するのが遅かった。

その結果、トップの AI 研究者は、OpenAI、Character.AI、DeepMind、Cohere、Inceptive など、より大きな価値と影響力を生み出すことができるスタートアップ企業に去っています。

Googleはすでに防御的な立場にあり、いつでも人工知能の分野で主導的な地位を失うことになるでしょう。一流の研究者の退職が問題を悪化させている。

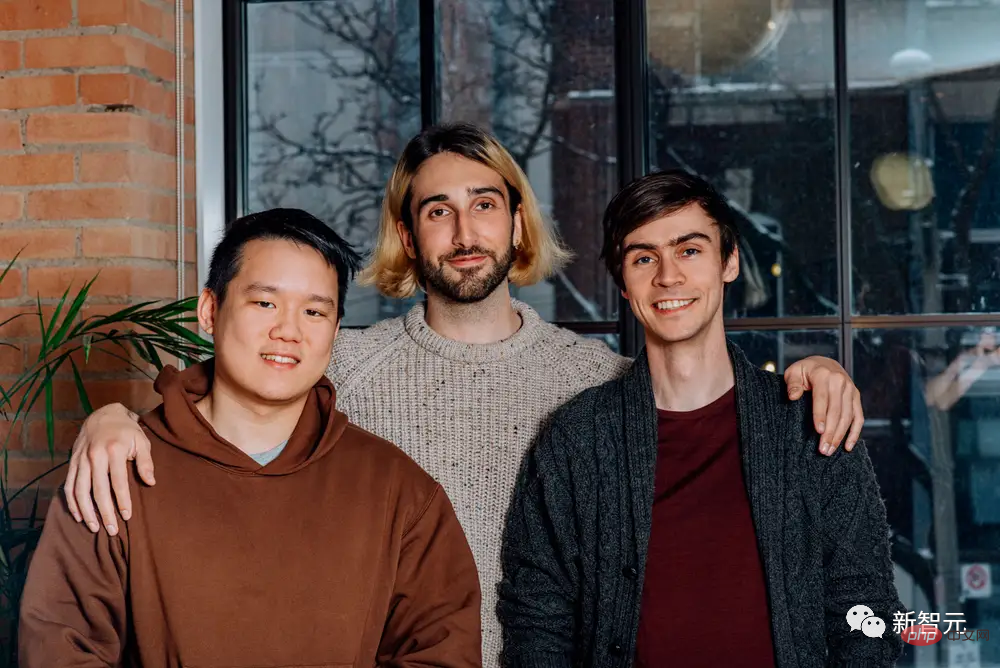

Cohere 共同創設者チームの Ivan Zhang、Aidan Gomez、Nick Frosst

Google は防御モードにあるかもしれませんが、その必要はありません。同社は基盤となるテクノロジーの多くを自ら開発し、ChatGPT などの製品を強化しました。また、その研究結果をオープンソースとして公開しているが、これは OpenAI の急速な台頭をいくぶん皮肉っている。

Google は、この技術が自社のビジネスに風評被害をもたらすのではないかという懸念から、ChatGPT に類似したチャットボットのリリースを長年躊躇してきました。

Googleの大規模言語モデルLaMDAの背後にある2人の研究者であるダニエル・デ・フレイタス氏とノーム・シャジーア氏は、同社がChatGPTに似たチャットボットのリリースが遅れていることに不満を抱き、同社を退職した。

他の元 Google 研究者も、このようなエキサイティングな人工知能の時代において、スタートアップ企業は研究者に成果の所有権を提供し、自らにより多くの価値と影響を与えるだろうと信じています。

ここでは、Google を辞めて他の企業に転職した研究者による、人工知能の分野で最も注目を集めた論文をいくつか紹介します。

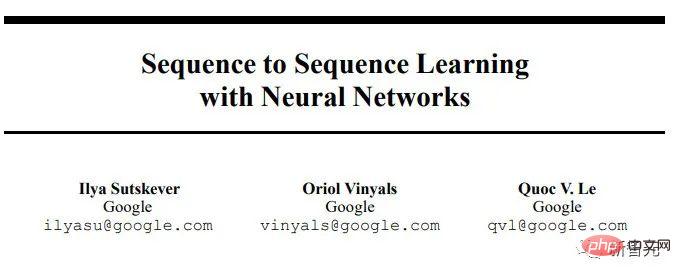

Ilya Sutskever

「ニューラルネットワークによるシーケンスツーシーケンス学習」は 2014 年に出版されました。このシーケンスツーシーケンスの論文では、あるドメインの単語シーケンスを別のドメインのシーケンスに変換する言語モデルのトレーニングについて検討しています。たとえば、英語の文をフランス語の文に変換します。

Ilya Sutskever がこの論文の研究を主導しました。彼は研究科学者として約 3 年間勤務した後、2015 年に Google を退職しました。 Sutskever 氏は OpenAI の共同創設者であり、引き続き主任科学者としてそこで働き続けています。

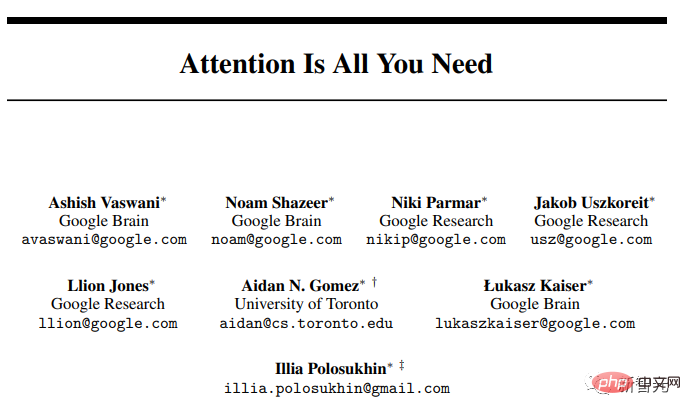

必要なのは注意だけです

このトランスフォーマーの大ヒット論文は現在 70,000 回以上引用されています。 Transformer は、自然言語処理における画期的な技術であると考えられています。文内の各単語を同時に調べて文脈上のニュアンスを収集し、各単語の重要性を比較検討することで、AI が意味を理解するのに役立ちます。

ChatGPT の「T」は Transformer の略で、この論文の重要性を示しています。

しかし、ライオン・ジョーンズを除くこの記事の著者 8 人は全員 Google を退職しました。

Ashish Vaswani 氏は、5 年間勤務した Google Brain (Google の深層学習 AI 研究チーム) を辞め、Adept を設立しました。この会社は、人々がより賢くなるのに役立つ生成 AI ツールを構築するために最近 3 億 5,000 万ドルを調達しました。彼は最近アデプト社を辞め、ステルススタートアップに転職した。

Noam Shazeer は現在、Character.AI の CEO です。

Niki Parmar は、Adept の共同創設者兼 CTO として 5 年間勤務した後、Google Brain を去りましたが、Vaswani と同様に、彼女も最近秘密のスタートアップに転職しました。

Jakob Uszkoreit は Google で 13 年間勤務し、ニューラル ネットワークとディープ ラーニングに取り組んでいます。彼は現在、深層学習を使用して新しい治療法を設計する新興企業 Inceptive の共同創設者です。

Aidan Gomez は、開発者がアプリや Web サイトに生成人工知能を組み込むのを支援するために約 1 億 6,000 万ドルを調達した会社 Cohere の共同創設者兼 CEO です。彼は Google Brain で研究者として 1 年半過ごしました。 Cohere の共同創設者である Nick Frosst は、Google Brain で研究者として 4 年間勤務しました。

Lukasz Kaiser は、Google Brain で 7 年以上勤務した後、Google Brain を退職し、2021 年に OpenAI に入社しました。 Kaiser は最近、OpenAI の GPT-4 ホワイト ペーパーで、チャットボットが議論のコンテキストを忘れる前に長い会話を可能にするロング コンテキスト機能への中心的な貢献者として引用されました。

Illia Polosukhin は、Google Brain でディープ ラーニングと自然言語理解に 3 年間取り組んできました。彼は 2017 年に退職し、Web3 スタートアップ プラットフォームである Pagoda を設立しました。

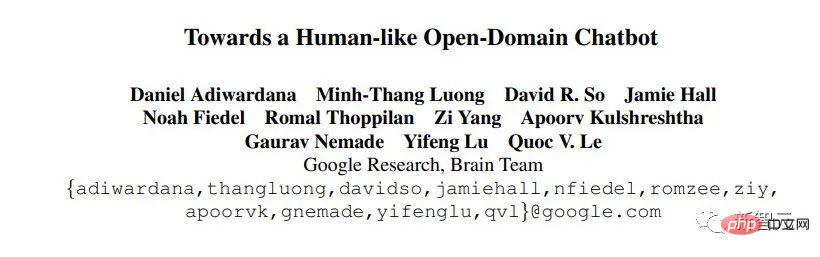

人間のようなオープン ドメイン チャットボットの構築

この論文では、Google のオリジナル チャットボット Meena を紹介し、公開ソーシャル メディアの会話から収集したデータを研究することで、チャットボットがトピックについて話す方法をどのように学習できるかを調査します。また、チャットボットの発話パフォーマンスを評価するために Google が作成したテストについても説明します。

この論文は、大規模言語モデリングにおけるもう 1 つの重要なマイルストーンです。著者らは、ハードコーディングされたトレーニングを行わずに、問題に対して人間のような応答を生成できる大規模言語モデルを作成できると信じています。

著者の 1 人である Daniel De Freitas は、Google Brain で研究者として 5 年間働いた後、Character.AI の共同創設者兼社長を務めました。

Character.AI の De Freitas の同僚、Romal Thoppilan もこの記事に寄稿しました。

左がRomal Thoppilan、右がDaniel De Freitas

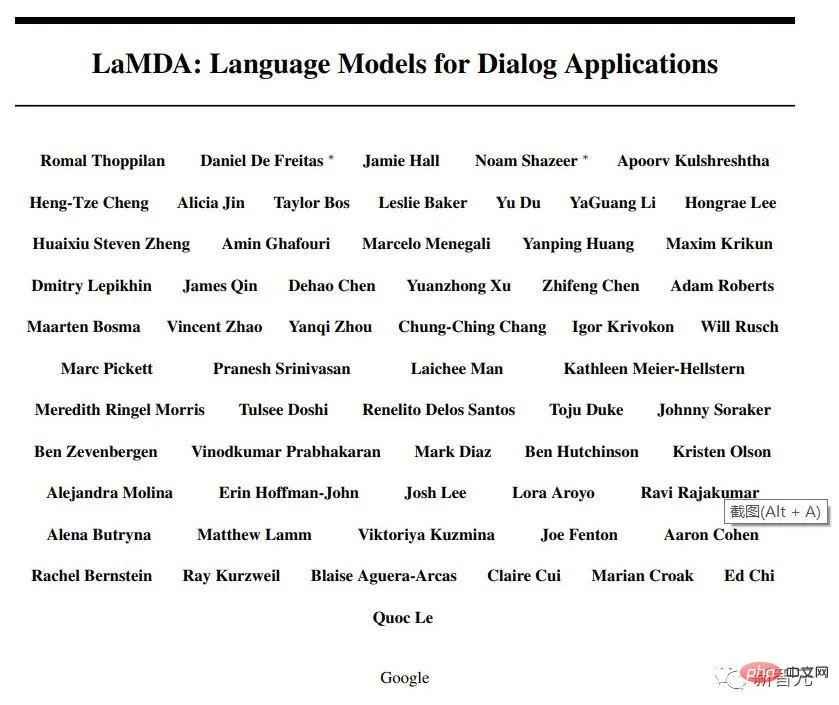

LaMDA: 会話型アプリケーションの言語モデル

LaMDAは会話型アプリケーションの言語モデルの略称であり、チャットボットBardの基礎です。 。 2020年にMeenaとして初めてデモされましたが、GoogleはMeenaを一般公開しませんでした。 Googleの人工知能研究グループの元従業員らは、Googleはボットが有害なコメントをすることを懸念していたので、これは広報上の悪夢になるだろうと説明した。

LaMDA の主要な研究者数名が Google Brain を去りました。

Daniel De Freitas と Noam Shazeer は昨年 Character.AI を設立しました。同社は最近、マスクからセラピスト、ライフ コーチに至るまで、さまざまなペルソナで話すチャットボットを作成するために約 2 億ドルを調達しました。

Romal Thoppilan は、Google Brain で 7 年間働いた後、Character.AI の創設研究者を務めています。

Alicia Jin は、2022 年末近くにリサーチ エンジニアとして Character.AI に入社します。彼女は Google Brain で 3 年間働いていました。

BERT

BERT (Transformers からの双方向エンコーダー表現) は、事前トレーニングの後、マスクされた言語モデリングと次の文の予測という 2 つのタスクを適切に完了できます。言い換えれば、BERT は隠れた単語または「マスクされた」単語を予測しようとし、周囲のテキストについてさらに学習し、隠された単語をより正確に予測するためにアルゴリズムに懸命に働くことを強います。

「他の人の薬局で薬を購入できますか?」と入力すると、「他の人」がクエリの重要な部分であることがわかります。

Google は、2019 年の初めに BERT を検索エンジンに組み込み始めました。これは、2015 年に別の機械学習アルゴリズムである RankBrain が組み込まれて以来、検索精度における最大の改善の 1 つです。

Jacob Devlin はこの論文の筆頭著者であり、ChatGPT の立ち上げ直前に OpenAI に参加しました。

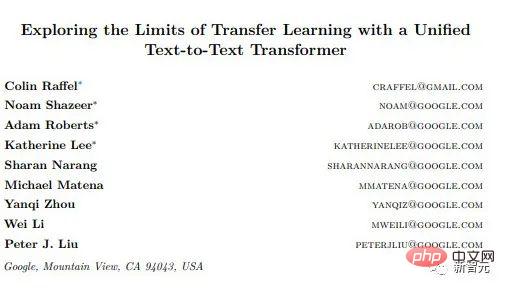

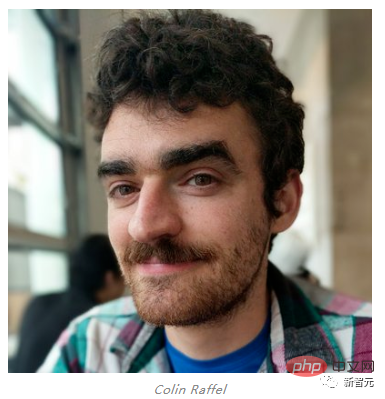

T5

T5 論文の正式名称は「Exploring the Limits of Transfer Learning with a Unified Text-to-Text Transformer」で、BERT に基づいて構築されており、タスクに非常に適しています。翻訳や要約など。

この論文を主導した Colin Raffel 氏は、2021 年に退職するまで、約 5 年間 Google Brain で研究員を務めていました。現在、UNC チャペルヒル校で助教授を務めている彼は、週に 1 日をハギング フェイスで研究者として過ごしています。ハギングフェイスは最近、2022年5月に1億ドルを調達し、企業価値を20億ドルと評価したと発表した。ユーザーは、Hugging Face で大規模な言語モデルとデータセットを共有できます。

T5 論文のもう一人の寄稿者、シャラン ナラン氏は、Google Brain で 4 年間勤務した後、2022 年に退社しました。彼は現在、メタ コーポレーションで人工知能の研究者を務めています。

迅速なチップ設計のためのパターン配置方法

Googleの科学者Azalia MirhoseiniとAnna Goldieが主導した論文では、人工知能が人間の専門家よりも早くチップの設計プロセスを完了できることが判明しました。

二人が主導した別の論文「深層強化学習によるチップレイアウト」では、チップ設計に人工知能を使用して面積と電力使用量を最小限に抑えながらパフォーマンスを最大化する方法を提供しています。

これらの発見は、Google が機械学習タスク専用の TPU チップを設計するのに役立ちました。

Mirhoseini と Goldie は 2022 年に Google を退職し、同じく OpenAI の競合企業である Anthropic に入社しました。Anthropic は独自の大規模言語モデルと Claude と呼ばれるチャットボットを開発しています。

ディープマインド

ムスタファ・スレイマンはディープマインドの共同創設者であり、同社の最高製品責任者を務めています。ここは 2014 年に Google に買収された人工知能研究所です。この研究所は、囲碁の世界チャンピオンのプロを破った機械学習プログラム、AlphaGo を開発しました。

Googleの親会社Alphabetは最近、第4四半期の財務報告書で、DeepMindの財務結果を「その他の投資」から分離すると発表し、Googleの将来戦略における人工知能の重要性を示した。通常、「その他の投資」とは、まだ収益性を達成していない会社の初期プロジェクトの総称です。

スレイマンは、新しい人工知能製品の安全性を確保することに熱心に取り組んできました。 DeepMind で働きながら、人工知能の実生活への影響を研究するために DeepMind 倫理と社会という研究部門を設立しました。 2019年、彼は従業員へのいじめで告発され、ディープマインドから休職処分を受けた。捜査が進行中、同氏は副社長としてグーグルに戻った。

スレイマンは、機械学習に関連する多くの研究論文で引用されています。 2022 年 2 月、彼は LinkedIn の創設者リード ホフマンと人工知能スタートアップ Inflection を共同設立しました。

Google の最も画期的な人工知能に関する論文の主要な寄稿者の多くが、OpenAI などの競合他社に入社するか、自分の会社を立ち上げるために退職しました。

2022年末にOpenAIのChatGPTが登場したとき、GoogleのCEOサンダー・ピチャイは社内で「緊急警報」を発表し、同社に対応を求めた。

当時、ピチャイ氏は、Googleは人工知能のトップ研究者を疑いなく雇用し続けると述べた。

しかし、これほど多くの有能な人材を失った後でも、Google は再び偉大さを達成できるでしょうか?

参考文献:

https://www.businessinsider.com/google-ai-teams-brain-drain-researchers-leave-2023-3

https://www.zhihu.com/question/592975340/answer /2963265672

https://zhuanlan.zhihu.com/p/597586623

https://www.zhihu.com/question/592975340/answer/2964598555

以上がGoogleはLLMの戦いに負けた! OpenAIに転職するトップ研究者が増えているの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

1656

1656

14

14

1415

1415

52

52

1309

1309

25

25

1257

1257

29

29

1229

1229

24

24

セサミオープンドアエクスチェンジウェブページログイン最新バージョンgateio公式ウェブサイトの入り口

Mar 04, 2025 pm 11:48 PM

セサミオープンドアエクスチェンジウェブページログイン最新バージョンgateio公式ウェブサイトの入り口

Mar 04, 2025 pm 11:48 PM

ログインステップやパスワード回復プロセスなど、セサミオープンエクスチェンジWebバージョンのログイン操作の詳細な紹介も、ログイン障害、ページを開くことができず、プラットフォームにスムーズにログインするのに役立つ検証コードを受信できません。

セサミオープンドア交換Webページ登録リンクゲートトレーディングアプリ登録Webサイト最新

Feb 28, 2025 am 11:06 AM

セサミオープンドア交換Webページ登録リンクゲートトレーディングアプリ登録Webサイト最新

Feb 28, 2025 am 11:06 AM

この記事では、SESAME Open Exchange(gate.io)Webバージョンの登録プロセスとGate Tradingアプリを詳細に紹介します。 Web登録であろうとアプリの登録であろうと、公式Webサイトまたはアプリストアにアクセスして、本物のアプリをダウンロードし、ユーザー名、パスワード、電子メール、携帯電話番号、その他の情報を入力し、電子メールまたは携帯電話の確認を完了する必要があります。

Crypto Digital Asset Trading App(2025グローバルランキング)に推奨されるトップ10

Mar 18, 2025 pm 12:15 PM

Crypto Digital Asset Trading App(2025グローバルランキング)に推奨されるトップ10

Mar 18, 2025 pm 12:15 PM

この記事では、Binance、Okx、Gate.io、Bitflyer、Kucoin、Bybit、Coinbase Pro、Kraken、Bydfi、Xbit分散化された交換など、注意を払う価値のある上位10の暗号通貨取引プラットフォームを推奨しています。これらのプラットフォームには、トランザクションの数量、トランザクションの種類、セキュリティ、コンプライアンス、特別な機能の点で独自の利点があります。適切なプラットフォームを選択するには、あなた自身の取引体験、リスク許容度、投資の好みに基づいて包括的な検討が必要です。 この記事があなたがあなた自身に最適なスーツを見つけるのに役立つことを願っています

セサミオープンドアトレーディングプラットフォームダウンロードモバイルバージョンgateioトレーディングプラットフォームのダウンロードアドレス

Feb 28, 2025 am 10:51 AM

セサミオープンドアトレーディングプラットフォームダウンロードモバイルバージョンgateioトレーディングプラットフォームのダウンロードアドレス

Feb 28, 2025 am 10:51 AM

アプリをダウンロードしてアカウントの安全を確保するために、正式なチャネルを選択することが重要です。

OUYI OKEXアカウントを登録、使用、キャンセルする方法に関するチュートリアル

Mar 31, 2025 pm 04:21 PM

OUYI OKEXアカウントを登録、使用、キャンセルする方法に関するチュートリアル

Mar 31, 2025 pm 04:21 PM

この記事では、OUYI OKEXアカウントの登録、使用、キャンセル手順を詳細に紹介します。登録するには、アプリをダウンロードし、携帯電話番号または電子メールアドレスを入力して登録する必要があります。使用法は、ログイン、リチャージ、引き出し、取引、セキュリティ設定などの操作手順をカバーします。アカウントをキャンセルするには、OUYI Okexカスタマーサービスに連絡し、必要な情報を提供し、処理を待つ必要があり、最後にアカウントキャンセルの確認を取得する必要があります。 この記事を通じて、ユーザーはOUYI OKEXアカウントの完全なライフサイクル管理を簡単に習得し、デジタルアセットトランザクションを安全かつ便利に実施できます。

Bitget公式Webサイトで最新のアプリを登録およびダウンロードする方法

Mar 05, 2025 am 07:54 AM

Bitget公式Webサイトで最新のアプリを登録およびダウンロードする方法

Mar 05, 2025 am 07:54 AM

このガイドは、AndroidおよびiOSシステムに適した公式Bitget Exchangeアプリの詳細なダウンロードとインストール手順を提供します。このガイドは、公式ウェブサイト、App Store、Google Playなど、複数の権威ある情報源からの情報を統合し、ダウンロードおよびアカウント管理中の考慮事項を強調しています。ユーザーは、App Store、公式WebサイトAPKダウンロード、公式Webサイトジャンプ、完全な登録、ID検証、セキュリティ設定など、公式チャネルからアプリをダウンロードできます。さらに、ガイドはよくある質問や考慮事項をカバーします。

なぜビテンサーはAIトラックの「ビットコイン」と言われているのですか?

Mar 04, 2025 pm 04:06 PM

なぜビテンサーはAIトラックの「ビットコイン」と言われているのですか?

Mar 04, 2025 pm 04:06 PM

元のタイトル:Bittensor = Aibitcoin:S4MMYETH、分散型AI研究元の翻訳:Zhouzhou、BlockBeats編集者注:この記事では、Bockchain Technologyを通じて中央集権的なAI企業の独占を破り、オープンおよび共同AI Ecosemsytemを促進することを望んでいます。 Bittensorは、さまざまなAIソリューションの出現を可能にし、Tao Tokensを通じてイノベーションを刺激するサブネットモデルを採用しています。 AI市場は成熟していますが、両節は競争リスクに直面し、他のオープンソースの対象となる場合があります

Binanceの登録方法に関する詳細なチュートリアル(2025初心者ガイド)

Mar 18, 2025 pm 01:57 PM

Binanceの登録方法に関する詳細なチュートリアル(2025初心者ガイド)

Mar 18, 2025 pm 01:57 PM

この記事では、ビナンスの登録とセキュリティ設定の完全なガイドを提供し、事前登録の準備(機器、電子メール、携帯電話番号、IDドキュメントの準備を含む)をカバーし、公式ウェブサイトとアプリに2つの登録方法、およびさまざまなレベルのID検証(KYC)プロセスを紹介します。さらに、この記事では、ファンドパスワードの設定、2要素検証(Google AuthenticatorおよびSMS検証を含む2FA)の有効化、アンチフィッシングコードのセットアップなどの主要なセキュリティ手順にも焦点を当て、ユーザーが暗号通貨トランザクションのBinance Binanceプラットフォームを安全かつ便利に登録および使用するのに役立ちます。 取引する前に、関連する法律や規制、市場のリスクを必ず理解してください。