GPT-4は苦情のため禁止を求められた:OpenAIはFTCが発行した人工知能標準のいずれも満たしていない

数日前、マスク氏、ヨシュア・ベンジオ氏らは、すべてのAI研究所に対し、GPT-4より強力なAIモデルのトレーニングを直ちに中止するよう求める公開書簡に連名で署名した。今、誰かがリリースされた GPT-4 を止めようとしています。

今回、GPT-4を阻止したのは非営利団体Center for Artificial Intelligence and Digital Policy (CAIDP)でした。 CAIDPは米国連邦取引委員会(FTC)に対し、OpenAIを調査し、同社がGPT-4を今後リリースすることを禁止するよう要請した。

ファイルアドレス: https://cdn.arstechnica.net/wp-content/uploads/2023/03/CAIDP-FTC -Complaint-OpenAI-GPT-033023.pdf

CAIDP は、「OpenAI がリリースした消費者向け製品 GPT-4 には偏りがあり、欺瞞的である」と考えたため、この申請を FTC に提出しました。 「プライバシーと公共の安全にリスクをもたらします。モデルの出力は証明も再現もできず、展開前に個別に評価されることもありません。」

CAIDP は、米国内のすべての商用人工知能製品に対する独立した監視と評価を求め、消費者、企業、商業市場を保護するために必要な「安全策」が確実に講じられるようにします。

以前、FTCは人工知能の基準を発表したが、その基準は「説明責任を促進する一方で、人工知能の使用には透明性、説明可能性、公平性、そして「経験的に合理的」であることが要求される」とCAIDPは述べた。 「OpenAI の GPT-4 はこれらの要件をいずれも満たしていません。」

GPT-4 のリリースからまだ 2 週間しか経っていませんが、この種の強力な AI モデルについてはすでに人々の意見が大きく分かれています。 GPT-4 のような強力なモデルを阻止したいと考えている人たちは、これらのモデルが情報セキュリティ、さらには人間社会に大きなリスクをもたらすと信じている一方で、今は人工知能にとって良い時期だと信じている人もいます。技術進歩の加速が促進されるべきである。

興味深いことに、OpenAI CEO の Sam Altman 氏は、新しいツイートを投稿しました:「嵐の真っ只中にいても落ち着いてください。」これは、最近の一連の「GPT-4 の停止、など」「モデル研究」の呼びかけに応えたもの。

リスクの観点から言えば、OpenAI はリリース時に、GPT-4 によってもたらされる潜在的なリスクを評価するよう外部の専門家に依頼したと述べました。しかし、CAIDPはFTCへの提出文書の中で、GPT-4が違反する行為を明らかにした。

CAIDP は、GPT-4 が商業的公平性に重大な影響を与えていると考えており、「GPT-4 の商業的リリースは、FTC 法の第 5 条と、使用と広告に関する FTC の規制に違反します」と述べています。 「人工知能製品の標準。企業によって設定された標準、および人工知能のガバナンスなどの新たな規範」

さらに、OpenAI はそうではありませんでした。 GPT-4 の技術的詳細を開示すること。これが、CAIDP が FTC に申請を提出した理由の 1 つです。

CAIDPは、「OpenAIは、アーキテクチャ、モデルサイズ、ハードウェア、コンピューティングリソース、トレーニング技術、データセット構築やトレーニング方法に関する詳細を開示しておらず、これは研究では一般的な慣行である」と述べた。コミュニティは、大規模な言語モデルのトレーニング データとトレーニング テクノロジを文書化する予定ですが、OpenAI は GPT-4 ではこれらのことを行わないことを選択しました。特に、生成人工知能モデルは、使用中に異常な動作を示す可能性があるため、通常の消費者製品ではありません。この行為は、発行会社によって以前に発見されていなかった可能性があります。」

苦情の詳細

具体的には、CAIDP は GPT-4 をターゲットにしており、関連モデルである ChatGPT は、潜在的なリスクの範囲。

たとえば、OpenAI は、記事「GPT-4 システム カード」の中で、GPT-4 が特定の疎外されたグループに対するものを含め、特定の偏見や世界観を強化し、再現する可能性があることを明らかにしました。固定観念と軽蔑的な連想。 CAIDPはまた、OpenAI社のブログ投稿を引用し、同様の大規模モデルであるChatGPTが有害な指示に応答したり、偏った動作を示したりする場合があると述べた。

FTC に提出した訴状の中で CAIDP は、「OpenAI はリスクを十分に理解しているにもかかわらず、商業利用を目的として GPT-4 を一般公開した」と述べています。訴状ではまた、「GPT-4 システムカードには、OpenAI がテスト中に実施したセキュリティチェックの詳細が記載されておらず、OpenAI が児童を保護するために講じた措置についても詳細が記載されておらず、これにより、GPT-4 システムカードの使用についても疑問が生じている」とも主張されています。

CAIDP はまた、欧州の消費者団体 BEUC が提起した懸念についても指摘しました。「ChatGPT が消費者信用や保険のスコアに使用された場合、 「不適切な結果?公平で偏った結果?」 このツイートは CAIDP の苦情申請書にも引用されている。

さらに、ネットワーク セキュリティの観点から、ChatGPT はフィッシング、偽のテキストの作成、または悪意のあるコードの生成に使用される可能性があります。 CAIDPはプライバシーの面で、OpenAIが他のユーザーにプライベートチャットを表示したという報告が今月あったと述べた。

別のケースでは、AI 研究者は、ChatGPT がどのようにして誰かのアカウントを乗っ取り、チャット履歴を表示し、情報に気付かずに請求書にアクセスできるかを説明しました。ただし、OpenAI はこの脆弱性を修正しました。

CAIDP はまた、GPT-4 は画像入力からのテキスト応答を提供でき、これは個人のプライバシーと個人の自律性に多大な影響を与える機能であり、ユーザーが個人画像をリンクされた画像に変換できるとも述べています。詳細な個人データまで。 OpenAIが画像からテキストへの変換機能を停止したことは理解されているが、実際の状況がどうなのかを言うのは難しい。

CAIDP は、FTC が OpenAI による GPT のさらなる商用展開を禁止し、展開前および GPT AI ライフサイクル全体を通じて GPT 製品の独立した評価を要求し、OpenAI に FTC AI に準拠するよう要求すべきであると考えています。消費者詐欺を報告するための FTC のメカニズムと同様に、公的にアクセス可能な GPT-4 のインシデント報告メカニズムを確立します。

CAIDPはまた、FTCに対し、「生成人工知能市場分野における製品の基本標準」として機能する標準仕様をさらに公開するよう求めた。

AI 学界、議論

過去 2 日間で、数千人が GPT-4 フォローアップ AI 大型モデルの開発を中止する請願書に署名しました。本日、CAIDP は FTC に対し、OpenAI の禁止を調査し、GPT-4 の新しい商用バージョンをリリースするよう要請しました。わずか 1 ~ 2 日でさまざまな議論が爆発し、AI の責任者やさまざまな専門家が公の場で応答するようになりました。それに反対する人もいるし、支持する人もいる。

GPT-4フォローアップAI大型モデルの研究開発の一時停止に関して、チューリング賞受賞者のヨシュア・ベンジオ氏、テスラCEO(OpenAI共同創設者)のイーロン・マスク氏、新氏ヨーク大学のゲイリー・マーカス名誉教授とカリフォルニア大学バークレー校のスチュアート・ラッセル教授は全員賛成しており、巨大なAI実験の中止を求める公開書簡に署名した。注目すべきことに、CAIDPの社長兼創設者であるマーク・ローテンバーグ氏も公開書簡に署名した。

公開書簡のアドレス: https://futureoflife.org/open-letter/pause-giant-ai-experiments /

#しかし、ChatGPTを批判してきたYann LeCun氏は公開書簡に署名しないと公言し、公開書簡の内容に同意しないと述べた。 。

オレゴン州立大学名誉教授のトーマス・G・ディーテリッヒ氏はツイッターで、「私も署名していない。この手紙は記入されている」と述べた。 「恐ろしい内容がたくさん含まれている。レトリックと非効果的または存在しない政策。重要な技術的および政策的問題に取り組んでいる。」ルカン氏は「私も同意する」と公に述べた。

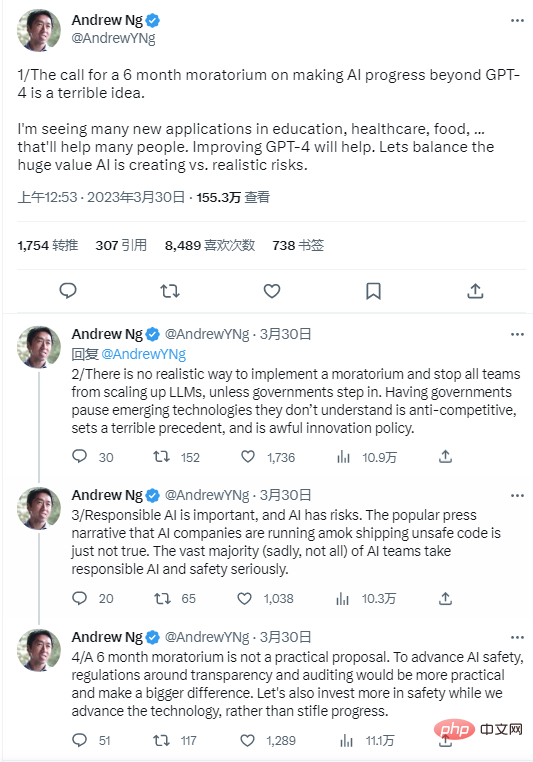

Ng Enda 氏はまた、嘆願書に署名した何千人もの人々に公に反対する記事を発表し、「GPT-4 には教育、医療、食品などの分野で多くの新しい用途があり、多くの人々を助けるだろう」と述べた。 「政府が介入しない限り、停止は実施されるだろうし、すべてのチームがLLMの拡張を阻止するのは非現実的だ。さらに、理解していない新興技術の停止を政府に求めるのは、反競争的であり、悪い前例を作り、悪い政策だ」

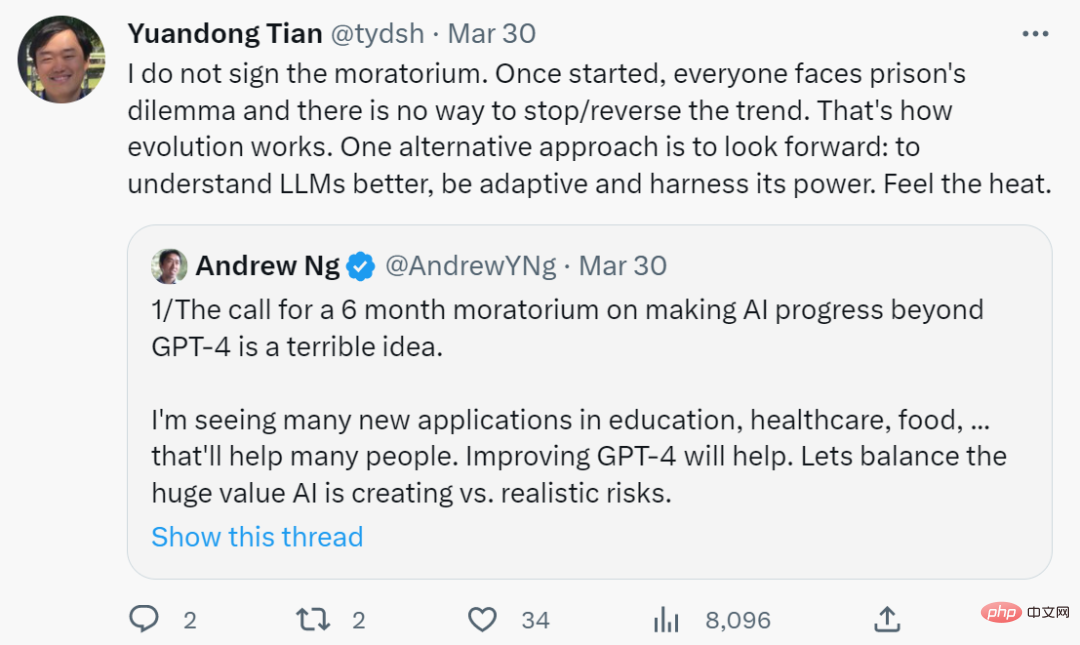

Tian Yuandong 氏も後に Ng Enda 氏の見解を支持し、「一時停止には署名しないと述べた。そして、このようなことが始まったら、 「この傾向を止めたり逆転させる方法はありません。これは進化の避けられない必然です。私たちは別の視点から先を見据え、LLM をより深く理解し、それに適応してその力を活用し、熱を感じるべきです。」

# Google Brain からの退職を発表したばかりの #Yi Tay (元 Google Brain 上級研究員) は次のように述べています。 6ヶ月間の出場停止処分なら署名します。」

以上がGPT-4は苦情のため禁止を求められた:OpenAIはFTCが発行した人工知能標準のいずれも満たしていないの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

1672

1672

14

14

1428

1428

52

52

1333

1333

25

25

1277

1277

29

29

1257

1257

24

24

Bytedance Cutting が SVIP スーパー メンバーシップを開始: 継続的な年間サブスクリプションは 499 元で、さまざまな AI 機能を提供

Jun 28, 2024 am 03:51 AM

Bytedance Cutting が SVIP スーパー メンバーシップを開始: 継続的な年間サブスクリプションは 499 元で、さまざまな AI 機能を提供

Jun 28, 2024 am 03:51 AM

このサイトは6月27日、JianyingはByteDanceの子会社であるFaceMeng Technologyによって開発されたビデオ編集ソフトウェアであり、Douyinプラットフォームに依存しており、基本的にプラットフォームのユーザー向けに短いビデオコンテンツを作成すると報告しました。 Windows、MacOS、その他のオペレーティング システム。 Jianyingは会員システムのアップグレードを正式に発表し、インテリジェント翻訳、インテリジェントハイライト、インテリジェントパッケージング、デジタルヒューマン合成などのさまざまなAIブラックテクノロジーを含む新しいSVIPを開始しました。価格的には、クリッピングSVIPの月額料金は79元、年会費は599元(当サイト注:月額49.9元に相当)、継続月額サブスクリプションは月額59元、継続年間サブスクリプションは、年間499元(月額41.6元に相当)です。さらに、カット担当者は、ユーザーエクスペリエンスを向上させるために、オリジナルのVIPに登録している人は、

Rag と Sem-Rag を使用したコンテキスト拡張 AI コーディング アシスタント

Jun 10, 2024 am 11:08 AM

Rag と Sem-Rag を使用したコンテキスト拡張 AI コーディング アシスタント

Jun 10, 2024 am 11:08 AM

検索強化生成およびセマンティック メモリを AI コーディング アシスタントに組み込むことで、開発者の生産性、効率、精度を向上させます。 JanakiramMSV 著者の EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG から翻訳。基本的な AI プログラミング アシスタントは当然役に立ちますが、ソフトウェア言語とソフトウェア作成の最も一般的なパターンに関する一般的な理解に依存しているため、最も適切で正しいコードの提案を提供できないことがよくあります。これらのコーディング アシスタントによって生成されたコードは、彼らが解決する責任を負っている問題の解決には適していますが、多くの場合、個々のチームのコーディング標準、規約、スタイルには準拠していません。これにより、コードがアプリケーションに受け入れられるように修正または調整する必要がある提案が得られることがよくあります。

微調整によって本当に LLM が新しいことを学習できるようになるのでしょうか: 新しい知識を導入すると、モデルがより多くの幻覚を生成する可能性があります

Jun 11, 2024 pm 03:57 PM

微調整によって本当に LLM が新しいことを学習できるようになるのでしょうか: 新しい知識を導入すると、モデルがより多くの幻覚を生成する可能性があります

Jun 11, 2024 pm 03:57 PM

大規模言語モデル (LLM) は巨大なテキスト データベースでトレーニングされ、そこで大量の現実世界の知識を取得します。この知識はパラメータに組み込まれており、必要なときに使用できます。これらのモデルの知識は、トレーニングの終了時に「具体化」されます。事前トレーニングの終了時に、モデルは実際に学習を停止します。モデルを調整または微調整して、この知識を活用し、ユーザーの質問により自然に応答する方法を学びます。ただし、モデルの知識だけでは不十分な場合があり、モデルは RAG を通じて外部コンテンツにアクセスできますが、微調整を通じてモデルを新しいドメインに適応させることが有益であると考えられます。この微調整は、ヒューマン アノテーターまたは他の LLM 作成物からの入力を使用して実行され、モデルは追加の実世界の知識に遭遇し、それを統合します。

GenAI および LLM の技術面接に関する 7 つのクールな質問

Jun 07, 2024 am 10:06 AM

GenAI および LLM の技術面接に関する 7 つのクールな質問

Jun 07, 2024 am 10:06 AM

AIGC について詳しくは、51CTOAI.x コミュニティ https://www.51cto.com/aigc/Translator|Jingyan Reviewer|Chonglou を参照してください。これらの質問は、インターネット上のどこでも見られる従来の質問バンクとは異なります。既成概念にとらわれずに考える必要があります。大規模言語モデル (LLM) は、データ サイエンス、生成人工知能 (GenAI)、および人工知能の分野でますます重要になっています。これらの複雑なアルゴリズムは人間のスキルを向上させ、多くの業界で効率とイノベーションを推進し、企業が競争力を維持するための鍵となります。 LLM は、自然言語処理、テキスト生成、音声認識、推奨システムなどの分野で幅広い用途に使用できます。 LLM は大量のデータから学習することでテキストを生成できます。

あなたが知らない機械学習の 5 つの流派

Jun 05, 2024 pm 08:51 PM

あなたが知らない機械学習の 5 つの流派

Jun 05, 2024 pm 08:51 PM

機械学習は人工知能の重要な分野であり、明示的にプログラムしなくてもコンピューターにデータから学習して能力を向上させる機能を提供します。機械学習は、画像認識や自然言語処理から、レコメンデーションシステムや不正行為検出に至るまで、さまざまな分野で幅広く応用されており、私たちの生活様式を変えつつあります。機械学習の分野にはさまざまな手法や理論があり、その中で最も影響力のある 5 つの手法は「機械学習の 5 つの流派」と呼ばれています。 5 つの主要な学派は、象徴学派、コネクショニスト学派、進化学派、ベイジアン学派、およびアナロジー学派です。 1. 象徴主義は、象徴主義とも呼ばれ、論理的推論と知識の表現のためのシンボルの使用を強調します。この学派は、学習は既存の既存の要素を介した逆演繹のプロセスであると信じています。

新しい科学的で複雑な質問応答ベンチマークと大規模モデルの評価システムを提供するために、UNSW、アルゴンヌ、シカゴ大学、およびその他の機関が共同で SciQAG フレームワークを立ち上げました。

Jul 25, 2024 am 06:42 AM

新しい科学的で複雑な質問応答ベンチマークと大規模モデルの評価システムを提供するために、UNSW、アルゴンヌ、シカゴ大学、およびその他の機関が共同で SciQAG フレームワークを立ち上げました。

Jul 25, 2024 am 06:42 AM

編集者 |ScienceAI 質問応答 (QA) データセットは、自然言語処理 (NLP) 研究を促進する上で重要な役割を果たします。高品質の QA データ セットは、モデルの微調整に使用できるだけでなく、大規模言語モデル (LLM) の機能、特に科学的知識を理解し推論する能力を効果的に評価することもできます。現在、医学、化学、生物学、その他の分野をカバーする多くの科学 QA データ セットがありますが、これらのデータ セットにはまだいくつかの欠点があります。まず、データ形式は比較的単純で、そのほとんどが多肢選択式の質問であり、評価は簡単ですが、モデルの回答選択範囲が制限され、科学的な質問に回答するモデルの能力を完全にテストすることはできません。対照的に、自由回答型の Q&A

SOTA パフォーマンス、厦門マルチモーダルタンパク質-リガンド親和性予測 AI 手法、初めて分子表面情報を結合

Jul 17, 2024 pm 06:37 PM

SOTA パフォーマンス、厦門マルチモーダルタンパク質-リガンド親和性予測 AI 手法、初めて分子表面情報を結合

Jul 17, 2024 pm 06:37 PM

編集者 | KX 医薬品の研究開発の分野では、タンパク質とリガンドの結合親和性を正確かつ効果的に予測することが、医薬品のスクリーニングと最適化にとって重要です。しかし、現在の研究では、タンパク質とリガンドの相互作用における分子表面情報の重要な役割が考慮されていません。これに基づいて、アモイ大学の研究者らは、初めてタンパク質の表面、3D 構造、配列に関する情報を組み合わせ、クロスアテンション メカニズムを使用して異なるモダリティの特徴を比較する、新しいマルチモーダル特徴抽出 (MFE) フレームワークを提案しました。アライメント。実験結果は、この方法がタンパク質-リガンド結合親和性の予測において最先端の性能を達成することを実証しています。さらに、アブレーション研究は、この枠組み内でのタンパク質表面情報と多峰性特徴の位置合わせの有効性と必要性を実証しています。 「S」で始まる関連研究

SKハイニックスは8月6日に12層HBM3E、321層NANDなどのAI関連新製品を展示する。

Aug 01, 2024 pm 09:40 PM

SKハイニックスは8月6日に12層HBM3E、321層NANDなどのAI関連新製品を展示する。

Aug 01, 2024 pm 09:40 PM

8月1日の本サイトのニュースによると、SKハイニックスは本日(8月1日)ブログ投稿を発表し、8月6日から8日まで米国カリフォルニア州サンタクララで開催されるグローバル半導体メモリサミットFMS2024に参加すると発表し、多くの新世代の製品。フューチャー メモリおよびストレージ サミット (FutureMemoryandStorage) の紹介。以前は主に NAND サプライヤー向けのフラッシュ メモリ サミット (FlashMemorySummit) でしたが、人工知能技術への注目の高まりを背景に、今年はフューチャー メモリおよびストレージ サミット (FutureMemoryandStorage) に名前が変更されました。 DRAM およびストレージ ベンダー、さらに多くのプレーヤーを招待します。昨年発売された新製品SKハイニックス