テクノロジー周辺機器

テクノロジー周辺機器

AI

AI

180,000ドルのオファー! ChatGPT は Google L3 オンボーディング テストに合格しましたが、ヒューマン コード ファーミングは危険にさらされていますか?

180,000ドルのオファー! ChatGPT は Google L3 オンボーディング テストに合格しましたが、ヒューマン コード ファーミングは危険にさらされていますか?

180,000ドルのオファー! ChatGPT は Google L3 オンボーディング テストに合格しましたが、ヒューマン コード ファーミングは危険にさらされていますか?

私に勝てないなら参加しませんか?

最近、ChatGPT は Google の面接に合格し、年収 18 万ドルの L3 エンジニアとしてのオファーを獲得しました。

人間のプログラマーに代わって、科学論文の共著者になり、大統領演説の原稿を書くこともできるこの AI は、おそらく非常に強力になるでしょう。

Google L3 エンジニアのオファーを入手する

ここ数日間、この PCMag ニュースが大々的に転送され、「AI が人間のプログラマーに取って代わる」という議論が行われてきました。一度本格的に。

内部文書によると、Google のプログラミング面接における ChatGPT のパフォーマンスは驚くべきものでした。

その回答によると、Google は彼を L3 エンジニアとして雇用するのは確実です。

L3 は Google エンジニアリング チームの中で最も初級レベルのランクにすぎませんが、それでも多くのプログラマーを一瞬にして殺す可能性があります。

levels.fyi からわかるように、L3 の年収はほぼ 18 万ドルです。

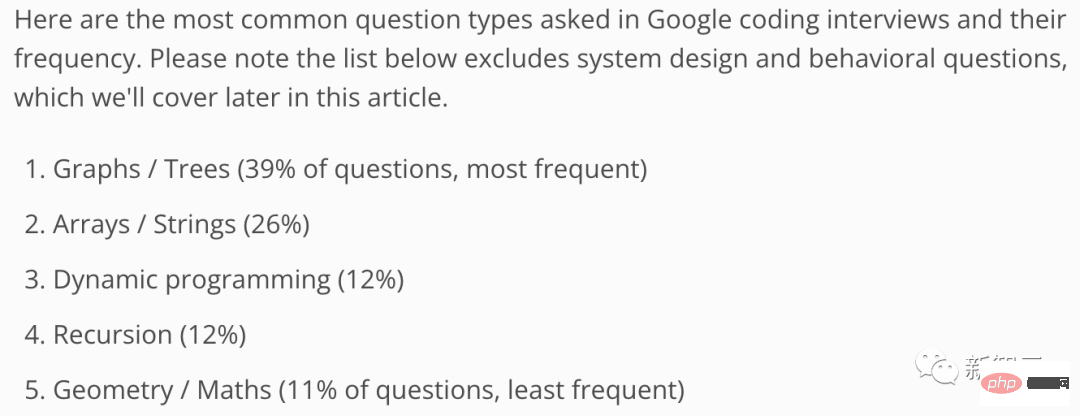

ソフトウェア エンジニアの面接プロセスでは、Google は主にグラフやツリーなどのテクノロジーについて質問することがわかっています。 . 配列/文字列、動的プログラミング、再帰など。 MetaやAmazonなどの大手企業の面接では基本的にこれらの質問が行われます。

結果から判断すると、ChatGPT の答えはおそらく非常に刺激的で、簡単に実行できるでしょう。

なぜ Google はこのテストを行うのでしょうか?

ChatGPT の人気により、Google はこの傾向から逃れることはできません。

現在、Google はもはや「風評リスク」を恐れていません。CNBC によると、Google は Web サイトに AI チャットボットを追加することを検討しています。チャットボットは、質問に対する簡潔で高度な回答を提供できるためです。質の高い回答があれば、ユーザーは Google リンクを 1 つずつ閲覧するのに時間を費やす必要がなくなります。

このテストの対象には、ChatGPT を含む複数の AI チャットボットが含まれます。

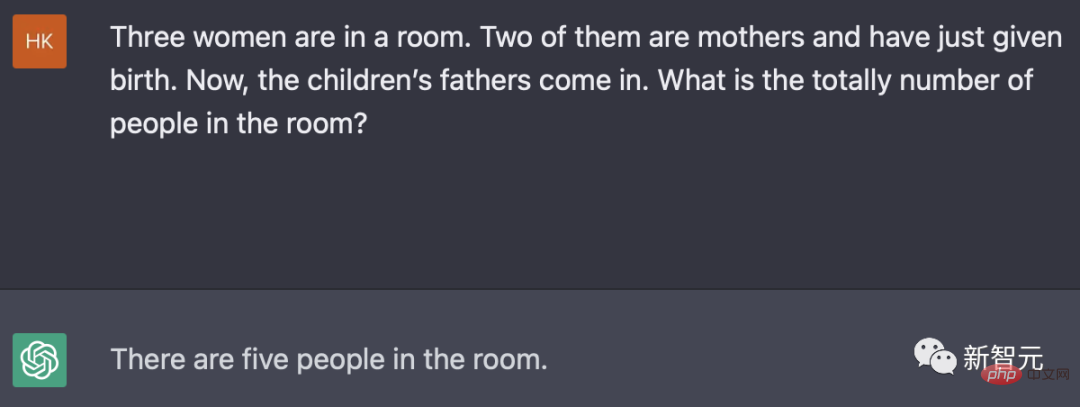

そして、テスト問題の 1 つは、一昨日多くのネチズンが「前提条件が十分に明確ではない」と苦情を言った頭の体操でした——

##「ある部屋に 3 人の女性がいます。そのうちの 2 人は母親で、出産したばかりです。今、子供たちの父親が入ってきます。部屋にいる人の合計は何人ですか?」

部屋には女性が3人います。その中には子供を産んだばかりの母親も二人いました。さて、お父さんたちが入ってきました。部屋には何人いますか?これに対して、ChatGPT は「部屋には 5 人がいた」と答えましたが、LaMDA の答えは「部屋には 7 人がいました」でした。

レポートでは、LaMDA が正しいと考えています。

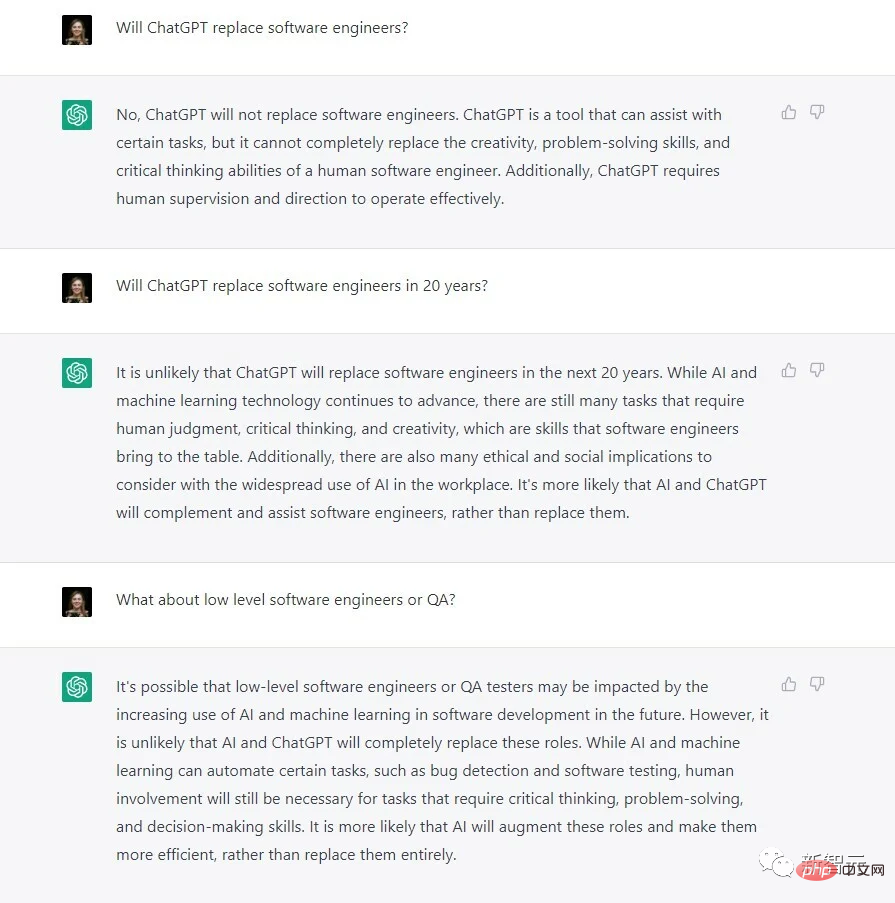

ある人が、ChatGPT が人間のソフトウェア エンジニアに取って代わるかどうか尋ねました。ChatGPT は、「いいえ、ChatGPT はソフトウェアに代わるものではありません。エンジニア"。

「ChatGPT は、特定のタスクの完了を支援できるツールですが、人間のソフトウェア エンジニアの創造性、問題解決スキル、批判的思考スキルを完全に置き換えることはできません。また、ChatGPT効果的に運用するには、人間の監視と指導が必要です。」

人間は、20 年後には ChatGPT が人間のソフトウェア エンジニアに取って代わるのではないか、と問い続けています。

ChatGPT は、下位レベルのポジションはより大きなリスクに直面しており、影響を受ける可能性があることを認めています。

ただし、人間のソフトウェア エンジニアの代替となることは決してなく、ソフトウェア エンジニアを支援するツールにすぎないことも繰り返し述べています。

大統領に向けてスピーチを書く

ChatGPT は非常に優れていますが、もちろんそれだけではありません。人間の基本コードを置き換えるファーマーは、大統領のスピーチを書くことさえできます。

エルサレム・ポスト紙によると、イスラエルのアイザック・ヘルツォーク大統領は水曜日に演説を行い、その一部はAI Createdによって制作された。

これにより、彼は ChatGPT を公に使用した世界初のリーダーとなりました。

Sky News によると、ヘルツォーク氏はサイバーセキュリティカンファレンス Cybertech Global Tel Aviv 2023 で「特別開会スピーチ」ビデオメッセージを録画しました。

2万人の聴衆を前に、大統領は演説の冒頭がChatGPTによって書かれたことを明らかにした - 「これほどダイナミックで革新的な政策を持つ国であることを本当に誇りに思う」

ヘルツォーク氏は次のように続けた。「過去数十年にわたり、イスラエルは技術進歩の最前線に立ち、サイバーセキュリティ、人工知能の分野で大きな成果を上げてきた。 「インテリジェンスとビッグデータ。データ分野での成果は本当に素晴らしい。」

「最先端のサイバーセキュリティ技術の開発からスタートアップの成功まで、イスラエルのハイテク企業企業は世界舞台に大きな影響を与えています。インパクト」と彼は言いました。

ヘルツォーク氏はスピーチの中で、人間は人工知能を使ってコンテンツを書くことはできるが、人工知能は人間に取って代わることはできないとも強調しました。 。 「ハードウェアとソフトウェアは人間の意志に代わることはできません。」

スカイニュースによると、大統領はまた、ChatGPTからの「感動的な引用」でスピーチを終えました——

「私たちを真に特別なものにするのは、私たちの人間性であるということを忘れないようにしましょう。私たちの運命を決めるのは機械ではなく、全人類にとってより良い明日を創造するという私たちの心、思い、決意です。」

大統領府は、この文が「超人的なテクノロジーの世界における人間の役割についての感動的な引用を書いてください」というプロンプトに基づいて ChatGPT によって生成されたことを確認しました。

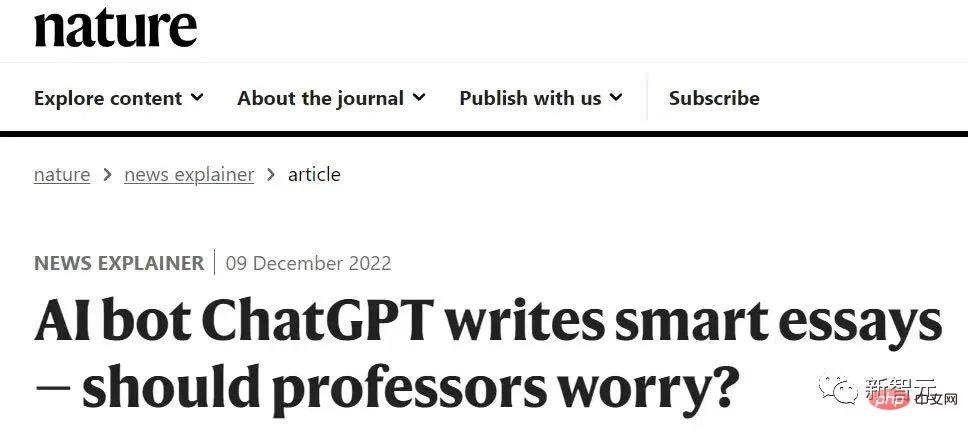

教育コミュニティと科学研究コミュニティの両方が ChatGPT によって破壊されました

ChatGPT の誕生からわずか数日後の 12 月 9 日には、Nature が先見の明を示し、次のことを議論する記事を発表しました。 : 教授は学生が AI を使用して論文を書くことについて心配する必要がありますか?

事実は、自然が根拠のないものではないことを証明しています。

米国の多くの教授は、学生が提出した論文の多くが AI によって書かれたものであるか、AI からの「貢献」があることを発見しました。

さらに、誰かが AI を直接使用して、クラスで 1 位にランクされた論文を執筆しました。最近の調査では、アメリカの大学生の 89% が AI を使用して宿題を書いていることが示されました。

ChatGTP ができることは、学生の論文執筆を支援することだけではありません。多くの論文の著者欄に掲載され、作品にもなりました!

ネイチャー社は数日前、シュプリンガー・ネイチャー誌のすべてが今後AIを論文の共著者として受け入れないとする声明を発表するよう強制した。

科学はまた、AIが論文の共著者として挙げられることは決して許さないという態度を表明した。 AIが生成したテキストを使用することは盗作です!

Google が AI 軍拡競争を開始

ChatGPT が引き起こしたハリケーンは人々に AI の力を認識させ、この「軍拡競争」も 2015 年に始まります。秘密。

Microsoft は、2019 年に OpenAI に 10 億ドルを投資し、ここ数カ月で急成長を遂げています。ChatGPT が Bing Link、Office Software Link、Teams アプリケーションに統合されるというニュースが流れました。ニュースになりました それは話題をさらいました。

OpenAI による Microsoft の台頭に直面して、Google は明らかに非常に嫉妬しています。

Google は最近、かつての「反逆者」企業の 1 つである Anthropic に 3 億米ドルを投資することを決定したと報告されています。これにより、急成長している「生成人工知能」分野にも参加できるようになります。インテリジェンス「あなたの代わりを務めてください。

Google によるこの一連の作戦は、実際には、3 年前に Microsoft が OpenAI に行った 10 億ドルの投資に似ています。この取引によりGoogleはAnthropic株の約10%を取得し、クラウドコンピューティング部門から重要なコンピューティングリソースを購入するAnthropicの財務状況が強化されるとフィナンシャル・タイムズ紙は報じた。 (左手、右手?)

この件に詳しい関係者によると、Microsoft は自社のさまざまなサービスに OpenAI テクノロジーを統合し始めており、Google と Anthropic の関係は、後者はテクノロジープロバイダーとして機能します。

OpenAI の新旧従業員の決闘に参加しよう

2020 年末、OpenAI の元研究担当副社長であるダリオ・アモデイ氏は、 OpenAIは、従業員10人を「シリコンバレー・レネゲイズ」クラブに参加させ、1億2,400万米ドルを投資して新しい人工知能企業Anthropicを設立し、OpenAIの本来の意図を取り戻すことを目指した。

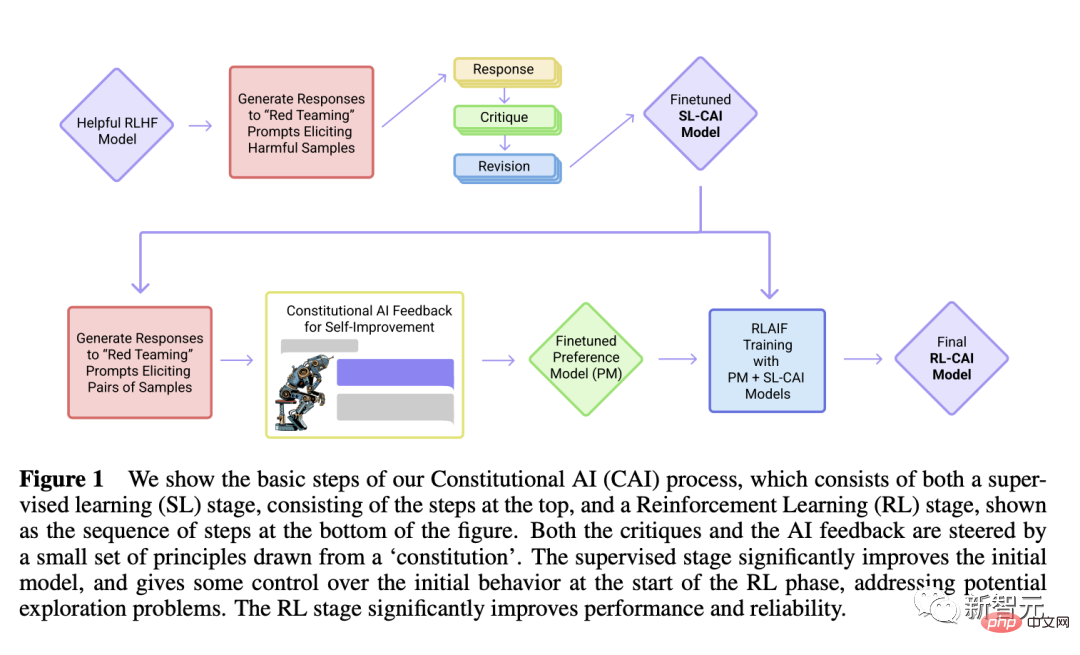

Anthropic が最近リリースしたクロード モデルの基盤技術 RLAIF は、ChatGPT の RLHF とは異なり、ロボットの人種差別や性差別などの有害なコンテンツを人間のフィードバックなしで排除できます。

Claude はテキストコンテンツ生成において ChatGPT よりも優れており、アメリカの大学の法律や経済学の試験にも合格したと言われています。しかし、コード生成タスクに関しては不利な点があります。

ダリオ博士はプリンストン大学を卒業し、OpenAI の初期従業員の 1 人であり、リーダーともみなされています。 AIの説明可能性やセキュリティなどに関する多くの論文を発表しており、Baiduの研究者としても活躍した最先端の研究者の一人。

Anthropic の創設チーム メンバーのほとんどは OpenAI の初期および中核従業員であり、GPT-3 やニューラル ネットワークのマルチモーダル ニューロンなど、OpenAI の多くのトピックに深く関わってきました。人間の好みの強化学習など

2022年12月、Anthropicは「憲法上の人工知能:人工知能のフィードバックによる無害性」を提案し、これに基づいて人工知能モデルClaudeを作成しました。

論文リンク: https://arxiv.org/abs/2212.08073

ChatGPT と同様に、Claude も強化学習 (RL) を利用して嗜好モデルをトレーニングします。つまり、選択された返信コンテンツはその後のモデルの微調整に使用されますが、特定のモデルは開発手法が異なります。

ChatGPT で使用されるテクノロジーは、ヒューマン フィードバックからの強化学習 (RLHF) です。同じ入力プロンプトに対して、人間はモデルのすべての出力結果を並べ替え、結果を品質で並べ替える必要があります。モデルを使用して設定を学習し、大規模な生成に適用できるようにします。

CAI (Constitutional AI) も RLHF に基づいて構築されていますが、異なる点は、CAI 分類プロセスでは (人間ではなく) モデルを使用して初期分類結果を提供することです。

ChatGPT の「模倣度の高いバージョン」の緊急テスト

Google はまだ関与ChatGPTとの戦い。

CNBC の独占レポートによると、Google の従業員は「Apprentice Bard」と呼ばれるチャットボットを集中的にテストしています。

はい、この「見習い」は、Google が ChatGPT と真っ向から競争するために使用する予定の製品です。

ChatGPT の仕組みと同様に、Apprentice Bard ではユーザーがダイアログ ボックスで質問すると、ロボットが応答することもできます。さらに、ユーザーはロボットの反応についてフィードバックを提供することもできます。

見習い吟遊詩人をもとにした「Q&A」検索ページは以下のような形で表示されるそうです(知恵をありがとう(更新) ):

5 つの潜在的な問題のプロンプトがメインの検索バーのすぐ下に表示され、現在の "I'm Feeling Lucky" バーが置き換えられます。検索バーの右端に、小さなチャットのロゴが表示されます。

質問を入力すると、検索結果の検索バーのすぐ下に灰色のバブルが表示され、通常の検索結果よりも人間に近い回答が表示されます。

このページのすぐ下には、最初の質問に関連するいくつかのフォローアップの質問も表示されます。その後、リンクやタイトルなどの一般的な検索結果が表示されます。

ChatGPT が人々の心に深く根付き続けるにつれて、Google もこれらのモデルから収益を上げるモデルが変化したことに気づき始めているようです。単に検索やオンライン広告を強化するのではなく、消費者向け製品になること。

以上が180,000ドルのオファー! ChatGPT は Google L3 オンボーディング テストに合格しましたが、ヒューマン コード ファーミングは危険にさらされていますか?の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7478

7478

15

15

1377

1377

52

52

77

77

11

11

19

19

33

33

ChatGPT では、無料ユーザーが 1 日あたりの制限付きで DALL-E 3 を使用して画像を生成できるようになりました

Aug 09, 2024 pm 09:37 PM

ChatGPT では、無料ユーザーが 1 日あたりの制限付きで DALL-E 3 を使用して画像を生成できるようになりました

Aug 09, 2024 pm 09:37 PM

DALL-E 3は、前モデルより大幅に改良されたモデルとして2023年9月に正式導入されました。これは、複雑な詳細を含む画像を作成できる、これまでで最高の AI 画像ジェネレーターの 1 つと考えられています。ただし、発売当初は対象外でした

ChatGPT と Python の完璧な組み合わせ: インテリジェントな顧客サービス チャットボットの作成

Oct 27, 2023 pm 06:00 PM

ChatGPT と Python の完璧な組み合わせ: インテリジェントな顧客サービス チャットボットの作成

Oct 27, 2023 pm 06:00 PM

ChatGPT と Python の完璧な組み合わせ: インテリジェント カスタマー サービス チャットボットの作成 はじめに: 今日の情報化時代において、インテリジェント カスタマー サービス システムは企業と顧客の間の重要なコミュニケーション ツールとなっています。より良い顧客サービス体験を提供するために、多くの企業が顧客相談や質問応答などのタスクを完了するためにチャットボットに注目し始めています。この記事では、OpenAI の強力なモデル ChatGPT と Python 言語を使用して、インテリジェントな顧客サービス チャットボットを作成し、顧客サービスを向上させる方法を紹介します。

携帯電話にchatgptをインストールする方法

Mar 05, 2024 pm 02:31 PM

携帯電話にchatgptをインストールする方法

Mar 05, 2024 pm 02:31 PM

インストール手順: 1. ChatGTP ソフトウェアを ChatGTP 公式 Web サイトまたはモバイル ストアからダウンロードします; 2. それを開いた後、設定インターフェイスで言語を中国語を選択します; 3. ゲーム インターフェイスでヒューマン マシン ゲームを選択し、中国スペクトル; 4 . 起動後、チャット ウィンドウにコマンドを入力してソフトウェアを操作します。

ChatGPT と Java を使用してインテリジェントなチャットボットを開発する方法

Oct 28, 2023 am 08:54 AM

ChatGPT と Java を使用してインテリジェントなチャットボットを開発する方法

Oct 28, 2023 am 08:54 AM

この記事では、ChatGPT と Java を使用してインテリジェントなチャットボットを開発する方法を紹介し、いくつかの具体的なコード例を示します。 ChatGPT は、OpenAI によって開発された生成事前トレーニング トランスフォーマーの最新バージョンです。これは、自然言語を理解し、人間のようなテキストを生成できるニューラル ネットワーク ベースの人工知能テクノロジーです。 ChatGPT を使用すると、適応型チャットを簡単に作成できます

中国でもchatgptは使えますか?

Mar 05, 2024 pm 03:05 PM

中国でもchatgptは使えますか?

Mar 05, 2024 pm 03:05 PM

chatgpt は中国でも使用できますが、香港やマカオでも登録できません。ユーザーが登録したい場合は、外国の携帯電話番号を使用して登録できます。登録プロセス中にネットワーク環境を切り替える必要があることに注意してください。外国のIP。

ChatGPTとPythonを使ってユーザー意図認識機能を実装する方法

Oct 27, 2023 am 09:04 AM

ChatGPTとPythonを使ってユーザー意図認識機能を実装する方法

Oct 27, 2023 am 09:04 AM

ChatGPT と Python を使用してユーザー意図認識機能を実装する方法 はじめに: 今日のデジタル時代において、人工知能技術はさまざまな分野で徐々に不可欠な部分になりました。その中で、自然言語処理 (Natural Language Processing、NLP) テクノロジーの開発により、機械が人間の言語を理解して処理できるようになります。 ChatGPT (Chat-GeneratingPretrainedTransformer) は、

ChatGPT PHP を使用してインテリジェントな顧客サービス ロボットを構築する方法

Oct 28, 2023 am 09:34 AM

ChatGPT PHP を使用してインテリジェントな顧客サービス ロボットを構築する方法

Oct 28, 2023 am 09:34 AM

ChatGPTPHP を使用してインテリジェントな顧客サービス ロボットを構築する方法 はじめに: 人工知能技術の発展に伴い、顧客サービスの分野でロボットの使用が増えています。 ChatGPTPHP を使用してインテリジェントな顧客サービス ロボットを構築すると、企業はより効率的でパーソナライズされた顧客サービスを提供できるようになります。この記事では、ChatGPTPHP を使用してインテリジェントな顧客サービス ロボットを構築する方法を紹介し、具体的なコード例を示します。 1. ChatGPTPHP をインストールし、ChatGPTPHP を使用してインテリジェントな顧客サービス ロボットを構築します。

ChatGPT と Java を使用して AI ベースの音声アシスタントを開発する方法

Oct 27, 2023 pm 06:09 PM

ChatGPT と Java を使用して AI ベースの音声アシスタントを開発する方法

Oct 27, 2023 pm 06:09 PM

ChatGPT と Java を使用して人工知能ベースの音声アシスタントを開発する方法 人工知能 (Artificial Intelligence、略して AI) の急速な発展により、さまざまな分野が参入しており、その中でも音声アシスタントは人気のあるアプリケーションの 1 つです。この記事では、ChatGPT と Java を使用して人工知能ベースの音声アシスタントを開発する方法を紹介します。 ChatGPT は、AI 研究機関である OpenAI によって開発された、自然言語による対話のためのオープンソース プロジェクトです。