一度トレーニングするだけで、新しい 3D シーンが生成されます。 Googleの「ライトフィールドニューラルレンダリング」の進化の歴史

ビュー合成は、コンピューター ビジョンとコンピューター グラフィックスが交わる重要な問題であり、シーンの複数の写真からシーンの新しいビューを作成することを指します。

シーンの新しいビューを正確に合成するには、モデルは小さな参照画像のセットから、 詳細な 3D 構造などの複数の種類の情報をキャプチャする必要があります。 、マテリアルと照明など。

研究者らが 神経放射線場 (NeRF) モデルを 2020 年に提案して以来、この問題にもますます注目が集まり、合成パフォーマンスという新しい見解が大きく推進されました。

超大手企業の 1 つは Google であり、NeRF の分野で多くの論文も発表しています。 CVPR 2022 と ECCV 2022 で Google が発表した 2 つの論文を紹介します。 ライト フィールド ニューラル レンダリング モデル の進化について説明します。

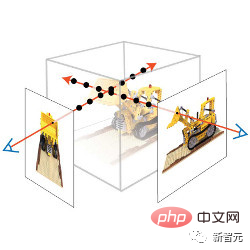

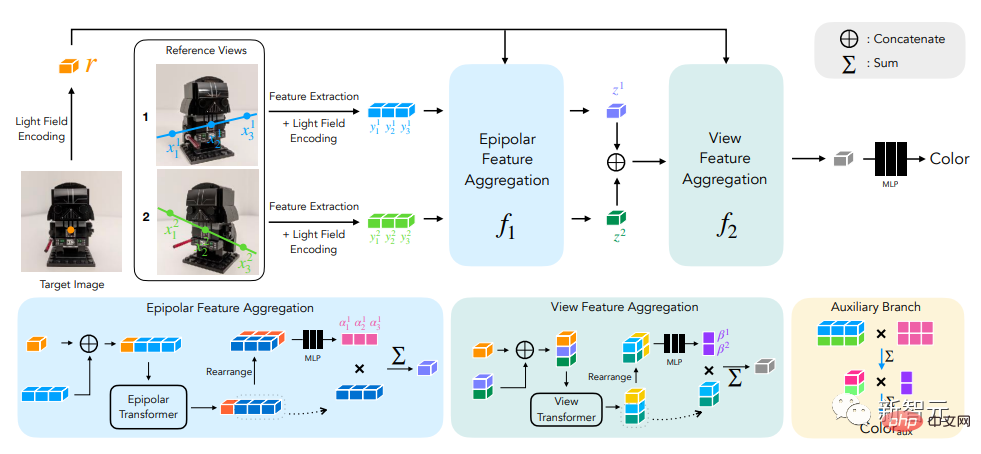

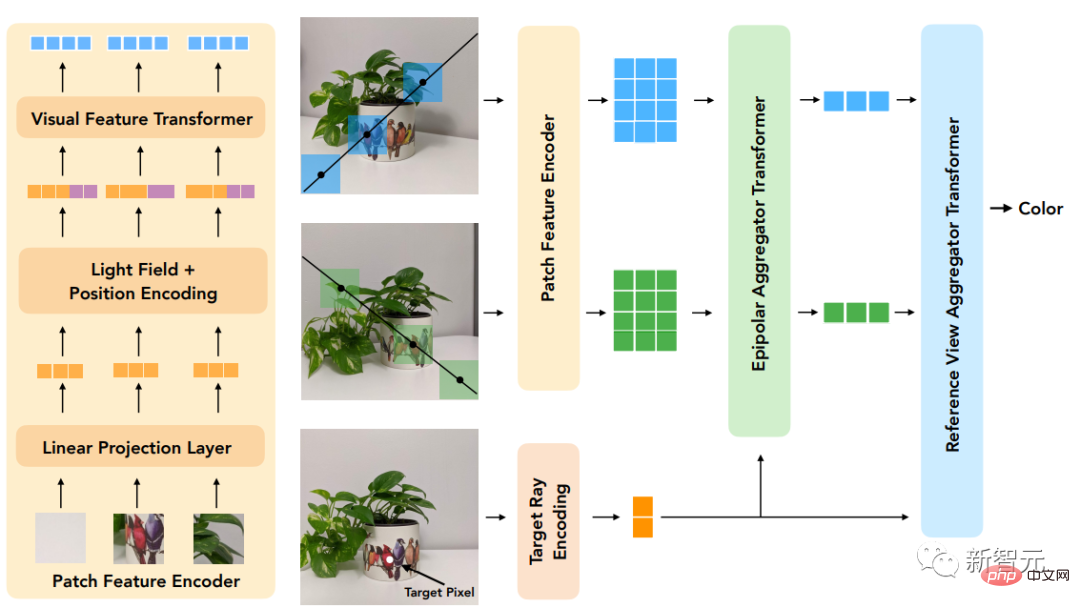

最初の論文では、参照ピクセルの色の組み合わせを学習するための、Transformer に基づく 2 段階モデルを提案しています。まず、エピポーラ ラインに沿った特徴が取得されます。次に、参照ビューに沿った特徴が取得されてターゲット光線の色が生成され、ビューの再現精度が大幅に向上します。

#紙のリンク: https://arxiv.org/pdf/2112.09687.pdf

#クラシックライト フィールド レンダリング反射、屈折、半透明などのビュー関連の効果を正確に再現できますが、シーンの高密度のビュー サンプリングが必要です。幾何学的再構成に基づく方法は、まばらなビューのみを必要としますが、非ランバート効果、つまり 非理想散乱 を正確にシミュレートすることはできません。

その制限を軽減しますフィールドの 4 次元表現を操作することにより、モデルはビュー依存の効果を正確に表現することを学習できます。シーン ジオメトリは、トレーニングと推論中に幾何学的制約を強制することによって、まばらなビューのセットから暗黙的に学習されます。

別の論文では、正規化された位置エンコーディングを備えた

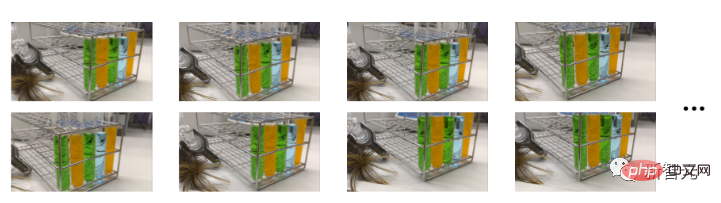

Transformer シーケンス を使用して、目に見えないシーンを合成する 一般化問題を解決しています。モデルが一連のシーンでトレーニングされた後、それを使用して新しいシーンのビューを合成できます。

#この記事では、深度機能と NeRF のようなボリューム レンダリングを必要としない別のパラダイムを提案します。この方法では、シーンからパッチ セットをサンプリングするだけで、新しいシーンのターゲット レイの色を直接予測できます。

最初に エピポーラ ジオメトリ

を使用して、各参照ビューの エピポーラ ラインに沿ってパッチ を抽出し、各パッチを 1 つに線形投影して割り当てます。次元特徴ベクトルに変換されると、このセットは一連の Transformer によって処理されます。 位置エンコーディングの場合、研究者らはライト フィールド表現法と同様の方法を使用して光線をパラメータ化しました。違いは、座標が相対的に正規化されていることです。これにより、メソッドが参照フレームから独立し、汎用性が向上します。 このモデルの革新的な点は、画像ベースのレンダリングを実行し、参照画像の色と特性を組み合わせて新しいビューをレンダリングすることです。それは純粋に Transformer に基づいており、イメージ パッチ セットで動作します。また、位置エンコードに 4D ライト フィールド表現を利用し、ビュー関連の効果をシミュレートするのに役立ちます。 最終的な実験結果は、この方法が、 よりもはるかに少ないデータでトレーニングされた場合でも、まだ見ていないシーンの新しいビュー合成において他の方法よりも優れていることを示しています。同じことが ## にも当てはまります。 ライト フィールド ニューラル レンダリング 新しい画像を生成するには、入力画像のカメラ パラメーターから開始し、まずターゲット レイの座標 (それぞれがピクセルに対応します) を取得する必要があります。そして各座標のモデルクエリ。 研究者らの解決策は、各参照画像を完全に処理するのではなく、ターゲット ピクセルに影響を与える可能性のある領域のみを確認することでした。これらの領域は、各ターゲット ピクセルを各参照フレーム上のラインにマッピングするエピポーラ幾何学によって決定できます。 安全のため、エピポーラ ライン上のいくつかの点の周囲の小さな領域を選択して、モデルによって実際に処理されるパッチのセットを形成し、適用する必要があります。 Transformer をこのパッチのセットに追加し、ターゲット ピクセルの色を取得します。

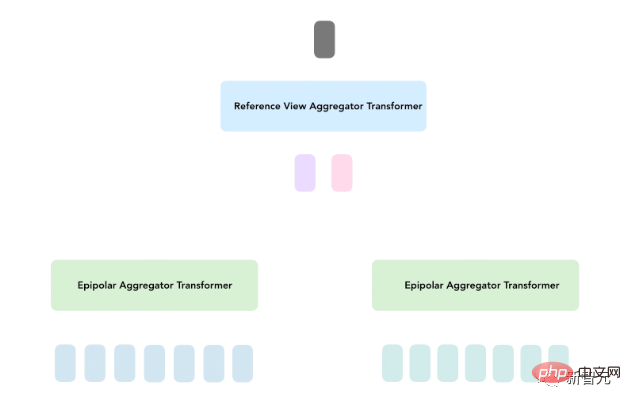

ライト フィールド ニューラル レンダリング (LFNR) では、研究者は 2 つの Transformer シーケンスを使用して、パッチのコレクションをターゲット ピクセル カラーにマッピングします。 最初の Transformer は各エピポーラ ラインに沿って情報を集約し、2 番目の Transformer は各参照イメージに沿って情報を集約します。 このメソッドは、最初のトランスフォーマーが各参照フレーム上のターゲット ピクセルの潜在的な対応関係を見つけるものとして解釈でき、2 番目のトランスフォーマーはオクルージョンと視線依存効果を担当します。これは、イメージベースのレンダリングでよくある困難でもあります。

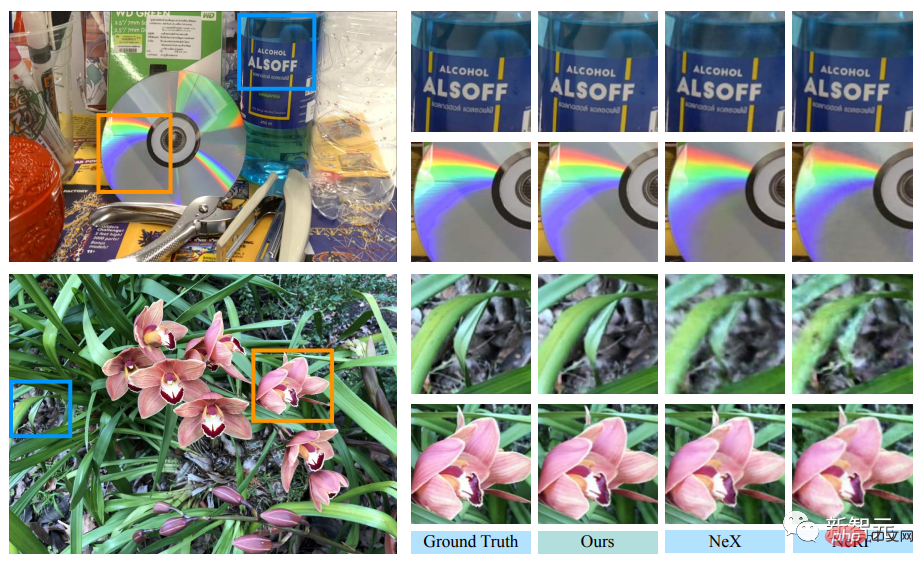

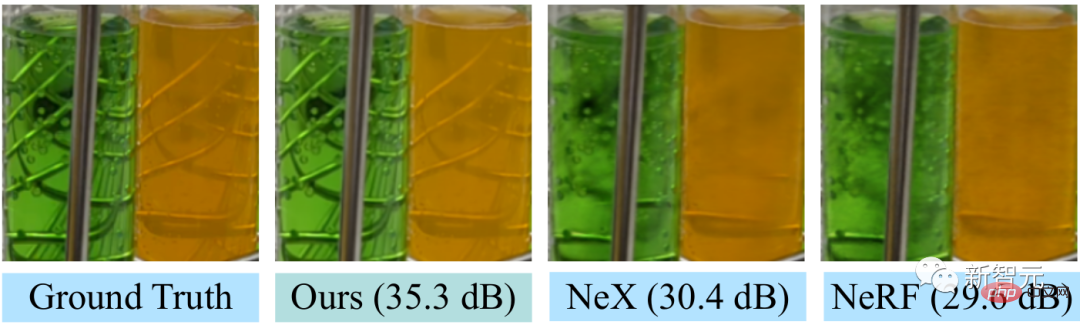

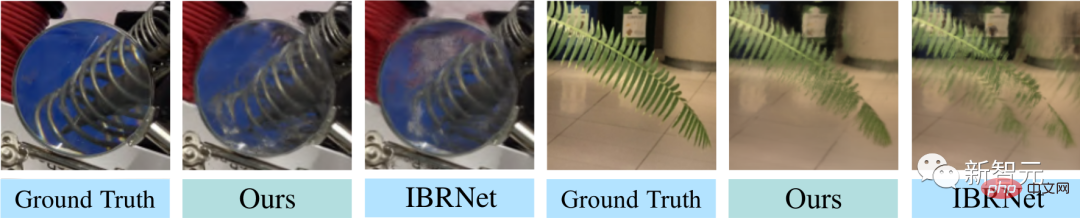

LFNR は、CD 上の虹や反射、ボトル上の反射、屈折、半透明など、NeX/Shiny データセット内のより困難な視線依存効果の一部を再現できます。 。

#1 つのトレーニング、新しいシーンへの一般化 最初の Transformer は、参照イメージごとに独立して各エピポーラ ラインに沿って情報を折り畳みます。これは、モデルがどの情報を保持するかを決定できるのは各参照イメージの出力光線座標とパッチに基づいてのみであることも意味します。これは機能します。 (ほとんどのニューラル レンダリング手法と同様に) 単一のシーンでのトレーニングでは問題ありませんが、異なるシーンに一般化することはできません。 一般化可能なモデルは、再トレーニングせずに新しいシナリオに直接適用できるため重要です。 研究者らは、LFNR のこの欠点を解決するために、一般的なパッチベース ニューラル レンダリング (GPNR) モデルを提案しました。 トランスフォーマーをモデルに追加して、他の 2 つのトランスフォーマーよりも前に、すべての参照画像交換の同じ深度のポイント間で実行されるようにします。間の情報。 GPNR は、エピポーラ ラインに沿って抽出されたパッチのセットをピクセル カラーにマッピングする 3 つのトランスフォーマーのシーケンスで構成されます。画像パッチは、線形投影レイヤーを介して初期特徴にマッピングされ、その後、これらの特徴がモデルによって継続的に洗練され、集約されて、最終的に特徴と色が形成されます。 たとえば、最初の Transformer が「公園のベンチ」からパッチ シーケンスを抽出した後、新しいモデルは両方のビューの対応する深さに表示される「花」を使用できます。このような手がかりは、潜在的な可能性を示しています。マッチ。 この作業のもう 1 つの重要なアイデアは、さまざまなシナリオで一般化したいため、ターゲット レイに従って位置エンコーディングを正規化することです。量は、絶対的な参照枠ではなく相対的な参照枠で表す必要があります。 モデルの汎化パフォーマンスを評価するために、研究者らは一連のシナリオで GPNR をトレーニングし、新しいシナリオでテストしました。 GPNR は、いくつかのベンチマーク (IBRNet および MVSNeRF プロトコルに従う) で平均 0.5 ~ 1.0 dB 改善されます。特に IBRNet ベンチマークでは、トレーニング シナリオの 11% のみを使用して GPNR が改善されます。の場合、ベースラインモデルを超えています。 GPNR は、微調整を行わずに、NeX/Shiny および LLFF で維持されているシーンのビューの詳細を生成しました。 GPNR は、IBRNet よりもブレードの詳細とレンズを通した屈折をより正確に再現します。

しかし、LFNR にも限界があります。

以上が一度トレーニングするだけで、新しい 3D シーンが生成されます。 Googleの「ライトフィールドニューラルレンダリング」の進化の歴史の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7719

7719

15

15

1641

1641

14

14

1396

1396

52

52

1289

1289

25

25

1233

1233

29

29

エンコーダ/デコーダ アーキテクチャを放棄し、より効果的なエッジ検出に拡散モデルを使用する 国立防衛工科大学は DiffusionEdge を提案しました

Feb 07, 2024 pm 10:12 PM

エンコーダ/デコーダ アーキテクチャを放棄し、より効果的なエッジ検出に拡散モデルを使用する 国立防衛工科大学は DiffusionEdge を提案しました

Feb 07, 2024 pm 10:12 PM

現在のディープ エッジ検出ネットワークは通常、エンコーダ/デコーダ アーキテクチャを採用しています。このアーキテクチャには、マルチレベルの特徴をより適切に抽出するためのアップ サンプリング モジュールとダウン サンプリング モジュールが含まれています。ただし、この構造では、ネットワークが正確かつ詳細なエッジ検出結果を出力することが制限されます。この問題に対して、AAAI2024 に関する論文は新しい解決策を提供しています。論文のタイトル: DiffusionEdge:DiffusionProbabilisticModelforCrispEdgeDetection 著者: Ye Yunfan (国立国防技術大学)、Xu Kai (国立国防技術大学)、Huang Yuxing (国立国防技術大学)、Yi Renjiao (国立国防技術大学)、Cai Zhiping (防衛工科大学) 論文リンク:https://ar

オープンソース!ゾーイデプスを超えて! DepthFM: 高速かつ正確な単眼深度推定!

Apr 03, 2024 pm 12:04 PM

オープンソース!ゾーイデプスを超えて! DepthFM: 高速かつ正確な単眼深度推定!

Apr 03, 2024 pm 12:04 PM

0.この記事は何をするのですか?私たちは、多用途かつ高速な最先端の生成単眼深度推定モデルである DepthFM を提案します。従来の深度推定タスクに加えて、DepthFM は深度修復などの下流タスクでも最先端の機能を実証します。 DepthFM は効率的で、いくつかの推論ステップ内で深度マップを合成できます。この作品について一緒に読みましょう〜 1. 論文情報タイトル: DepthFM: FastMonocularDepthEstimationwithFlowMatching 著者: MingGui、JohannesS.Fischer、UlrichPrestel、PingchuanMa、Dmytr

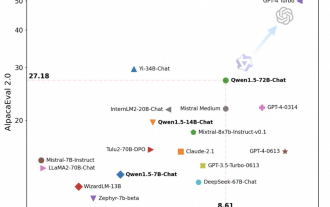

Tongyi Qianwen が再びオープンソースになり、Qwen1.5 では 6 つのボリューム モデルが提供され、そのパフォーマンスは GPT3.5 を超えます

Feb 07, 2024 pm 10:15 PM

Tongyi Qianwen が再びオープンソースになり、Qwen1.5 では 6 つのボリューム モデルが提供され、そのパフォーマンスは GPT3.5 を超えます

Feb 07, 2024 pm 10:15 PM

春節に合わせて、Tongyi Qianwen Model (Qwen) のバージョン 1.5 がオンラインになりました。今朝、新しいバージョンのニュースが AI コミュニティの注目を集めました。大型モデルの新バージョンには、0.5B、1.8B、4B、7B、14B、72Bの6つのモデルサイズが含まれています。その中でも最強バージョンの性能はGPT3.5やMistral-Mediumを上回ります。このバージョンには Base モデルと Chat モデルが含まれており、多言語サポートを提供します。アリババの同義前文チームは、関連技術が同義前文公式ウェブサイトと同義前文アプリでもリリースされたと述べた。さらに、本日の Qwen 1.5 リリースには、32K のコンテキスト長のサポート、Base+Chat モデルのチェックポイントのオープン、および 32K のコンテキスト長のサポートなどのハイライトもあります。

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas は正式に電動ロボットの時代に突入します!昨日、油圧式アトラスが歴史の舞台から「涙ながらに」撤退したばかりですが、今日、ボストン・ダイナミクスは電動式アトラスが稼働することを発表しました。ボストン・ダイナミクス社は商用人型ロボットの分野でテスラ社と競争する決意を持っているようだ。新しいビデオが公開されてから、わずか 10 時間ですでに 100 万人以上が視聴しました。古い人が去り、新しい役割が現れるのは歴史的な必然です。今年が人型ロボットの爆発的な年であることは間違いありません。ネットユーザーは「ロボットの進歩により、今年の開会式は人間のように見え、人間よりもはるかに自由度が高い。しかし、これは本当にホラー映画ではないのか?」とコメントした。ビデオの冒頭では、アトラスは仰向けに見えるように地面に静かに横たわっています。次に続くのは驚くべきことです

CLIP-BEVFormer: BEVFormer 構造を明示的に監視して、ロングテール検出パフォーマンスを向上させます。

Mar 26, 2024 pm 12:41 PM

CLIP-BEVFormer: BEVFormer 構造を明示的に監視して、ロングテール検出パフォーマンスを向上させます。

Mar 26, 2024 pm 12:41 PM

上記および筆者の個人的な理解: 現在、自動運転システム全体において、認識モジュールが重要な役割を果たしている。道路を走行する自動運転車は、認識モジュールを通じてのみ正確な認識結果を得ることができる。下流の規制および制御モジュール自動運転システムでは、タイムリーかつ正確な判断と行動決定が行われます。現在、自動運転機能を備えた自動車には通常、サラウンドビューカメラセンサー、ライダーセンサー、ミリ波レーダーセンサーなどのさまざまなデータ情報センサーが搭載されており、さまざまなモダリティで情報を収集して正確な認識タスクを実現しています。純粋な視覚に基づく BEV 認識アルゴリズムは、ハードウェア コストが低く導入が容易であるため、業界で好まれており、その出力結果はさまざまな下流タスクに簡単に適用できます。

超知性の生命力が覚醒する!しかし、自己更新 AI の登場により、母親はデータのボトルネックを心配する必要がなくなりました。

Apr 29, 2024 pm 06:55 PM

超知性の生命力が覚醒する!しかし、自己更新 AI の登場により、母親はデータのボトルネックを心配する必要がなくなりました。

Apr 29, 2024 pm 06:55 PM

世界は狂ったように大きなモデルを構築していますが、インターネット上のデータだけではまったく不十分です。このトレーニング モデルは「ハンガー ゲーム」のようであり、世界中の AI 研究者は、データを貪欲に食べる人たちにどのように餌を与えるかを心配しています。この問題は、マルチモーダル タスクで特に顕著です。何もできなかった当時、中国人民大学学部のスタートアップチームは、独自の新しいモデルを使用して、中国で初めて「モデル生成データフィード自体」を実現しました。さらに、これは理解側と生成側の 2 つの側面からのアプローチであり、両方の側で高品質のマルチモーダルな新しいデータを生成し、モデル自体にデータのフィードバックを提供できます。モデルとは何ですか? Awaker 1.0 は、中関村フォーラムに登場したばかりの大型マルチモーダル モデルです。チームは誰ですか?ソフォンエンジン。人民大学ヒルハウス人工知能大学院の博士課程学生、ガオ・イージャオ氏によって設立されました。

Kuaishou バージョンの Sora「Ke Ling」がテスト用に公開されています。120 秒以上のビデオを生成し、物理学をより深く理解し、複雑な動きを正確にモデル化できます。

Jun 11, 2024 am 09:51 AM

Kuaishou バージョンの Sora「Ke Ling」がテスト用に公開されています。120 秒以上のビデオを生成し、物理学をより深く理解し、複雑な動きを正確にモデル化できます。

Jun 11, 2024 am 09:51 AM

何?ズートピアは国産AIによって実現するのか?ビデオとともに公開されたのは、「Keling」と呼ばれる新しい大規模な国産ビデオ生成モデルです。 Sora も同様の技術的ルートを使用し、自社開発の技術革新を多数組み合わせて、大きく合理的な動きをするだけでなく、物理世界の特性をシミュレートし、強力な概念的結合能力と想像力を備えたビデオを制作します。データによると、Keling は、最大 1080p の解像度で 30fps で最大 2 分の超長時間ビデオの生成をサポートし、複数のアスペクト比をサポートします。もう 1 つの重要な点は、Keling は研究所が公開したデモやビデオ結果のデモンストレーションではなく、ショートビデオ分野のリーダーである Kuaishou が立ち上げた製品レベルのアプリケーションであるということです。さらに、主な焦点は実用的であり、白紙小切手を書かず、リリースされたらすぐにオンラインに移行することです。Ke Ling の大型モデルは Kuaiying でリリースされました。

オックスフォード大学の最新情報!ミッキー:2D画像を3D SOTAでマッチング! (CVPR\'24)

Apr 23, 2024 pm 01:20 PM

オックスフォード大学の最新情報!ミッキー:2D画像を3D SOTAでマッチング! (CVPR\'24)

Apr 23, 2024 pm 01:20 PM

前に書かれたプロジェクトのリンク: https://nianticlabs.github.io/mickey/ 2 枚の写真が与えられた場合、それらの写真間の対応関係を確立することで、それらの間のカメラのポーズを推定できます。通常、これらの対応は 2D 対 2D であり、推定されたポーズはスケール不定です。いつでもどこでもインスタント拡張現実などの一部のアプリケーションでは、スケール メトリクスの姿勢推定が必要なため、スケールを回復するために外部深度推定器に依存します。この論文では、3D カメラ空間でのメトリックの対応を予測できるキーポイント マッチング プロセスである MicKey を提案します。画像全体の 3D 座標マッチングを学習することで、相対的なメトリックを推測できるようになります。