ワイヤレスで「魂のコミュニケーション」!学者の崔鉄軍氏が、柔軟で非侵襲的な新しいブレインコンピューター超表面の開発を主導

近年、コーディングメタサーフェスにより、電磁気機能のリアルタイムでプログラム可能な制御が実現されましたが、以前の電磁気機能は静的であるか、従来の方法では非常に制限されていました。受動的なデバイス。ただし、そのようなメタサーフェスは依然として手動操作が必要です。

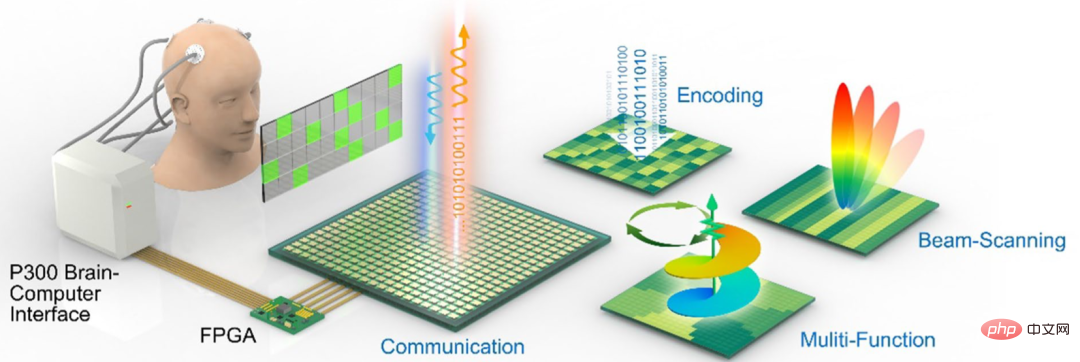

人々の願望を直接検出して区別するために、科学者たちはその後、ブレイン コンピューター インターフェイス (BCI) の概念を提案し、ブレイン コンピューター インターフェイスを使用して次のことを試みました。脳とデバイス間の通信を確立するインターフェイスは、プログラム可能なメタサーフェスの制御に新しい視点を提供します。 「特別な帽子」から脳信号を収集することにより、ブレイン コンピューター インターフェイスは、オペレーターが複雑な筋肉活動を行う必要なく、オペレーターの願望を解読し、制御対象にコマンドを送信することができます。

今回、東南大学ミリ波国家重点研究所の崔鉄軍院士のチームは、華南理工大学やシンガポール国立大学などの科学研究機関と協力し、さらに一歩前進しました。そして、電磁ブレイン コンピューター メタサーフェス (電磁ブレイン コンピューター メタサーフェス、EBCM) を開発しました。

報告によると、このメタサーフェスは、情報合成と無線送信を柔軟かつ非侵襲的に制御し、操作者の脳情報を脳波 (EEG) 信号に変換し、さらにさまざまな電磁 (EM) 信号に変換することができます。 2人のオペレーター間のワイヤレス「スピリチュアルコミュニケーション」を実現します。

以下に示すように、関連するコマンドを表示するモニターがオペレーターの目の前に配置されます。 EBCM は簡単な指示を受け取るだけで、オペレーターの意図を理解し、可視ビーム走査、波形変調、パターンエンコーディングなどの電磁気機能を実装できます。

関連する研究論文のタイトルは「非侵襲的なブレイン・コンピュータ・メタサーフェス・プラットフォームを介した人間の心の直接ワイヤレス通信」です。 」 この問題は科学雑誌 eLight に掲載されました。

研究者らは、この研究は電磁波空間とブレイン・コンピューター・インターフェースを組み合わせ、超表面、人間の脳知能、人工知能の深い統合の探求に新たな方向性を切り開き、新たなシステムの構築に役立つと述べた。バイオインテリジェントなメタサーフェス システムの生成。

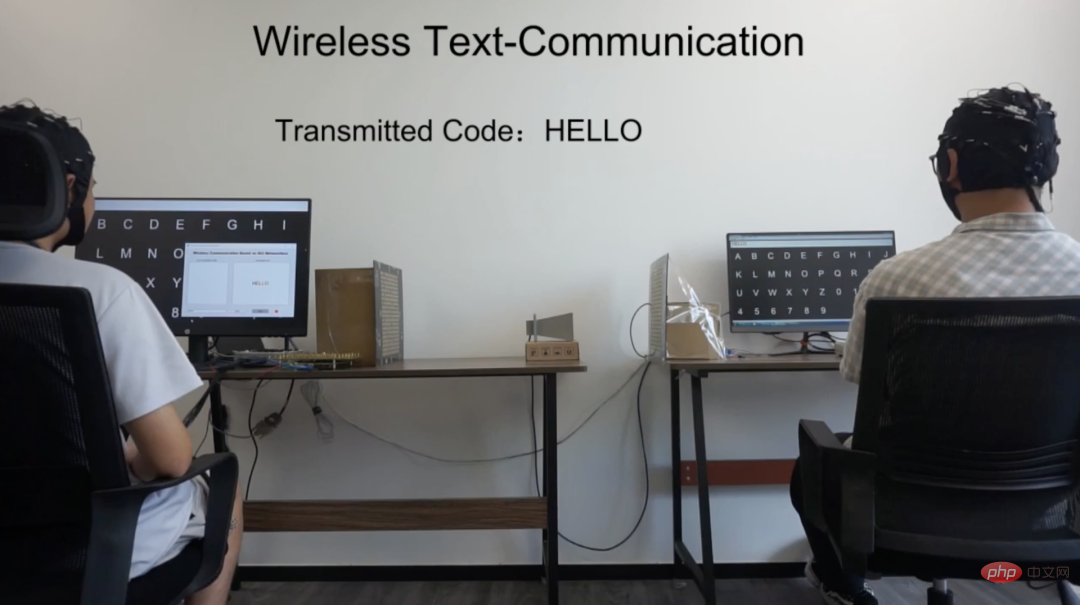

頭を使って「HELLO」を出力しましょう

この研究では、研究チームは、 EBCM 用のワイヤレス テキスト通信。

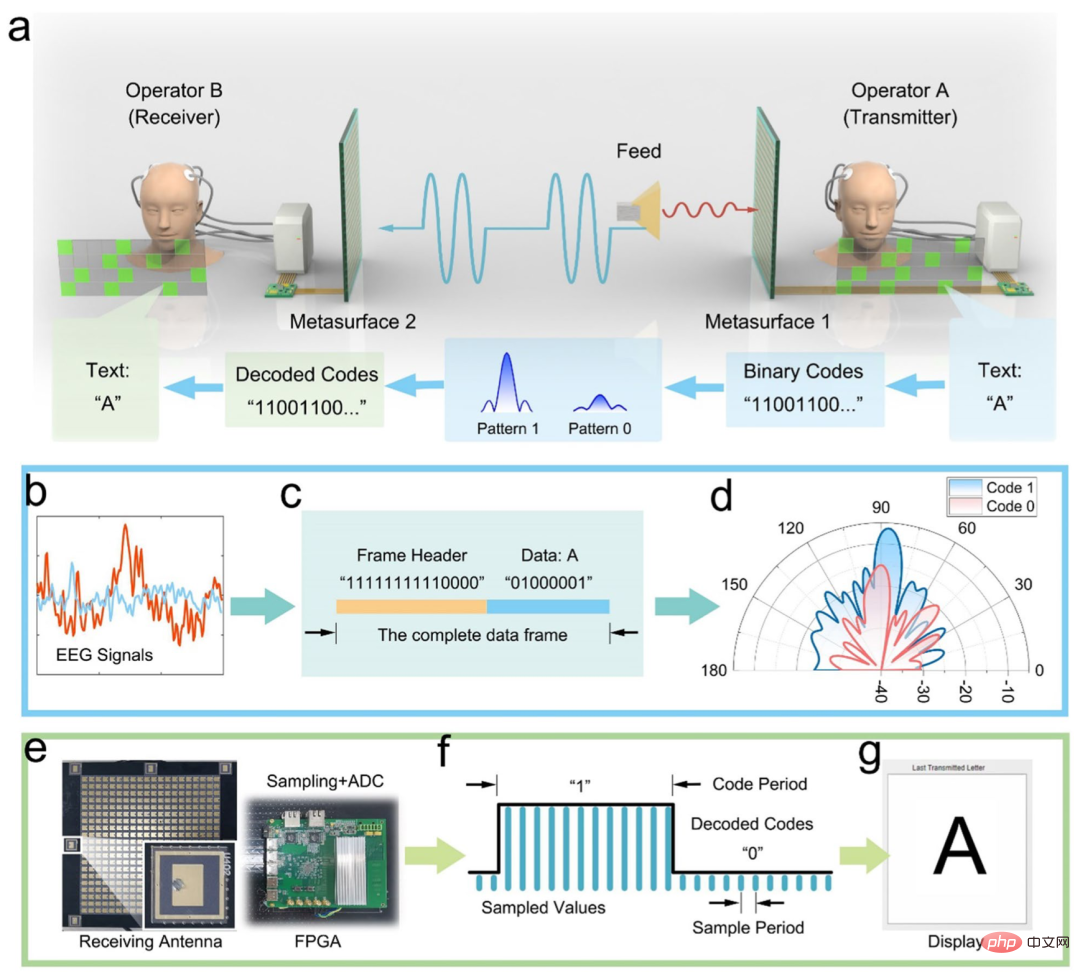

研究チームは、ブレイン コンピューター インターフェイスのオペレーター向けにテキスト形式のグラフィカル ユーザー インターフェイス (GUI) を提供し、視覚的なボタンを「0」と「1」で構成される特定のエンコード シーケンスに直接エンコードできるようにしています。

実験では、コード「1」(高振幅)と「それぞれ「無線情報送信用」。0」(低振幅)。

プロトタイプのデモンストレーションとして、研究者らは、EBCM 通信システムにおけるあるオペレータから別のオペレータへのテキストのワイヤレス送信をデモンストレーションしました。

テキスト送信者として機能するオペレーター A は、EBCM GUI 上の文字ボタンを視覚的に確認してレターを送信します。 EEG 信号からターゲット文字をデコードする場合、ASCII ベースのエンコード シーケンスが FPGA に実装されて時変モードを切り替え、メタサーフェスを操作して情報を空間に送信し、そこで情報が受信され、復調され、オペレーター B の EBCM によって表示されます。

以下に示すように、研究チームは、オペレーターBの画面に「HELLO」という5文字を無線送信するプロセスを示しています。 「HELLO」という単語が画面に表示されました。

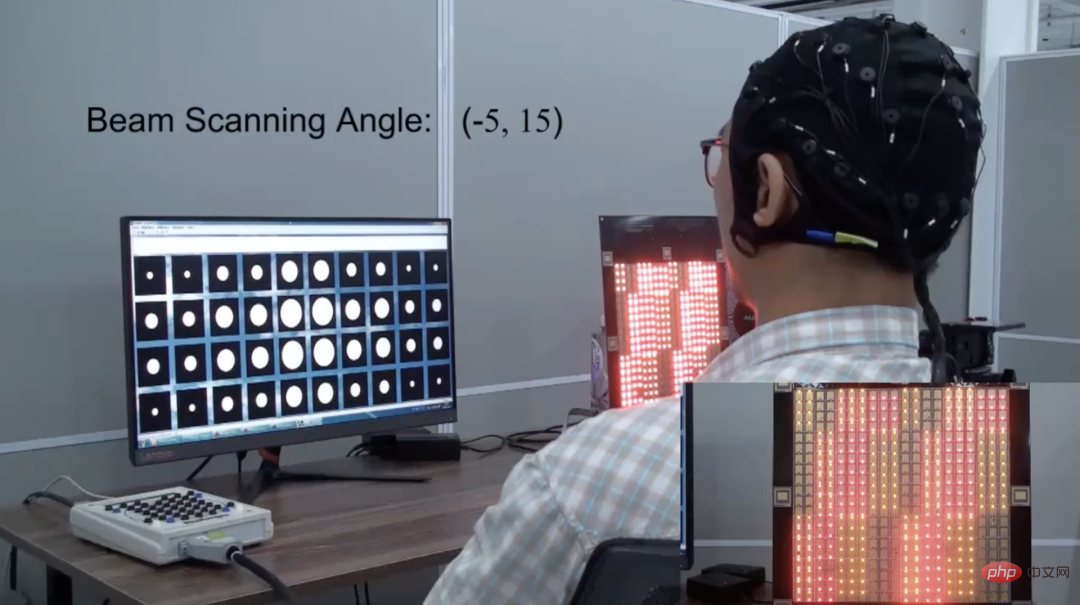

視覚ビーム走査実験では、オペレータは特定の方向を視覚的に見ることによって、所望のビーム走査方向を直接達成しました。 EBCM はオペレータの EEG を検出した後、関連するビーム走査方向の実行エンコーディング パターンを表示できます。

さらに、研究チームはEBCMのパターンエンコードプロセスも実証しました。オペレーターは特定のボタンを押して必要なコードを入力します。 EBCM によって検出された入力コードは、画面上に黄色の四角で表示されます。最後のコード「C4」は、エンコード プロセスを終了し、最終的なエンコード パターンを計算するように FPGA に指示する停止命令です。その後、EBCM は計算されたエンコード パターンを実行し、メタサーフェス上に表示します。

上記の実験は、オペレーターが筋肉を伴う動きを必要とせず、関連する継続的な刺激を得るために特定の視覚的なボタンを見つめるだけでよいことを示しています。刺激は認識され、通信のために対応する EM 信号に変換されます。

スマート メタサーフェスとは何ですか?

メタサーフェスとは、波長よりも薄い厚さの人工層状物質を指します。メタ表面は、面内の構造形態に応じて、横方向にサブ波長の微細構造を有するものと、均一な膜層を有するものとの2種類に分類できる。メタサーフェスは、電磁波の位相、偏波モード、伝播モードなどの特性を柔軟かつ効果的に制御することができます。

スマート メタサーフェスは、モバイル通信分野における情報メタマテリアルの重要な応用例であり、その基本原理は、デジタル プログラミングを通じてメタマテリアルの電磁特性を制御し、通常の壁における空間電磁波の乱反射を変化させ、空間電磁波のインテリジェントな制御とビームフォーミングの実現、低消費電力、低コストが将来のモバイル通信ネットワークの重要なインフラとなることが期待されています。

2014 年にはすでに、学者の崔鉄軍氏のチームがインテリジェント メタサーフェス ハードウェア システムの実現を主導し、情報メタマテリアルの適用を促進する先例を打ち立てました。

今年 2 月、学者の崔鉄軍氏のチームとその協力者は、多層伝送デジタル エンコードされたメタサーフェスを使用して、リアルタイムで適切に調整できる完全な回折ニューラル ネットワーク (プログラム可能な人工知能マシン、PAIM) を構築しました。ネットワークパラメータのリアルタイムプログラミングと光速度計算特性を実現し、画像認識、強化学習、通信マルチチャネル符号化・復号化などのさまざまな応用例を実証しました。マイクロ波空間で調整可能なニューラルネットワークを世界で初めて実現。

もちろん、超表面の応用シナリオはこれに限定されるわけではありません。

メタ表面の豊かでユニークな物理的特性と、電磁波を柔軟に制御する能力により、メタ表面は、ステルス技術、アンテナ技術、マイクロ波およびテラヘルツデバイス、光電子デバイスなどの多くの分野で重要な応用の可能性を秘めています。

以上がワイヤレスで「魂のコミュニケーション」!学者の崔鉄軍氏が、柔軟で非侵襲的な新しいブレインコンピューター超表面の開発を主導の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7518

7518

15

15

1378

1378

52

52

81

81

11

11

21

21

67

67

モデル、データ、フレームワークの詳細: 効率的な大規模言語モデルの 54 ページにわたる徹底的なレビュー

Jan 14, 2024 pm 07:48 PM

モデル、データ、フレームワークの詳細: 効率的な大規模言語モデルの 54 ページにわたる徹底的なレビュー

Jan 14, 2024 pm 07:48 PM

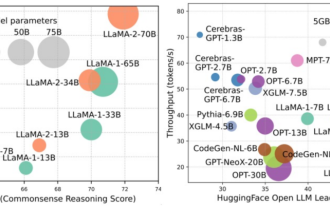

大規模言語モデル (LLM) は、自然言語理解、言語生成、複雑な推論などの多くの重要なタスクにおいて説得力のある能力を実証し、社会に大きな影響を与えてきました。ただし、これらの優れた機能には、大量のトレーニング リソース (左の図に示す) と長い推論時間 (右の図に示す) が必要です。したがって、研究者は効率の問題を解決するための効果的な技術的手段を開発する必要があります。さらに、図の右側からわかるように、Mistral-7B などのいくつかの効率的な LLM (LanguageModel) が、LLM の設計と展開にうまく使用されています。これらの効率的な LLM は、LLaMA1-33B と同様の精度を維持しながら、推論メモリを大幅に削減できます。

H100 を粉砕、Nvidia の次世代 GPU が明らかに!最初の 3nm マルチチップ モジュール設計、2024 年に発表

Sep 30, 2023 pm 12:49 PM

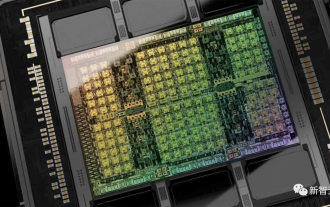

H100 を粉砕、Nvidia の次世代 GPU が明らかに!最初の 3nm マルチチップ モジュール設計、2024 年に発表

Sep 30, 2023 pm 12:49 PM

3nmプロセス、H100を超える性能!最近、海外メディア DigiTimes が、Nvidia が人工知能 (AI) およびハイパフォーマンス コンピューティング (HPC) アプリケーション向けの製品として、コードネーム「Blackwell」という次世代 GPU である B100 を開発しているというニュースを伝えました。 , B100はTSMCの3nmプロセスと、より複雑なマルチチップモジュール(MCM)設計を採用し、2024年の第4四半期に登場する予定だ。人工知能 GPU 市場の 80% 以上を独占している Nvidia にとって、B100 を使用して鉄は熱いうちに攻撃し、この AI 導入の波において AMD や Intel などの挑戦者をさらに攻撃することができます。 NVIDIA の推定によると、2027 年までに、この分野の生産額は約

拡散 + 超解像度モデルの強力な組み合わせ、Google の画像生成ツール Imagen を支えるテクノロジー

Apr 10, 2023 am 10:21 AM

拡散 + 超解像度モデルの強力な組み合わせ、Google の画像生成ツール Imagen を支えるテクノロジー

Apr 10, 2023 am 10:21 AM

近年、マルチモーダル学習、特にテキストと画像の合成と画像とテキストの対比学習の 2 つの方向において、多くの注目が集まっています。 OpenAIが発表したテキスト画像モデルDALL・EやDALL-E 2、NVIDIAのGauGANやGauGAN2など、一部のAIモデルはクリエイティブな画像生成や編集への応用で広く注目を集めています。 Google も負けじと、独自のテキストから画像へのモデル Imagen を 5 月末にリリースしました。これにより、キャプション付きの条件付き画像生成の境界がさらに拡大されるようです。シーンの説明だけを与えると、Imagen は高品質、高解像度の画像を生成できます。

マルチモーダル大型モデルの最も包括的なレビューがここにあります。 7 人のマイクロソフト研究者が精力的に協力、5 つの主要テーマ、119 ページの文書

Sep 25, 2023 pm 04:49 PM

マルチモーダル大型モデルの最も包括的なレビューがここにあります。 7 人のマイクロソフト研究者が精力的に協力、5 つの主要テーマ、119 ページの文書

Sep 25, 2023 pm 04:49 PM

マルチモーダル大型モデルの最も包括的なレビューがここにあります。マイクロソフトの中国人研究者7名が執筆した119ページで、すでに完成し、現在も最前線にある2種類のマルチモーダル大規模モデル研究の方向性から始まり、視覚理解と視覚生成という5つの具体的な研究テーマを包括的にまとめている。統合ビジュアル モデル LLM によってサポートされるマルチモーダル大規模モデル マルチモーダル エージェントは、マルチモーダル基本モデルが特殊なモデルから汎用的なモデルに移行したという現象に焦点を当てています。 Ps. 著者が論文の冒頭に直接ドラえもんの絵を描いたのはこのためである。このレビュー (レポート) は誰が読むべきですか? Microsoft の原文では次のようになります。プロの研究者でも学生でも、マルチモーダル基本モデルの基礎知識と最新の進歩を学ぶことに興味がある限り、このコンテンツは参加するのに非常に適しています。

SD コミュニティの I2V アダプター: 設定不要、プラグアンドプレイ、Tusheng ビデオ プラグインと完全に互換性あり

Jan 15, 2024 pm 07:48 PM

SD コミュニティの I2V アダプター: 設定不要、プラグアンドプレイ、Tusheng ビデオ プラグインと完全に互換性あり

Jan 15, 2024 pm 07:48 PM

画像からビデオへの生成 (I2V) タスクは、静止画像を動的なビデオに変換することを目的としたコンピューター ビジョンの分野における課題です。このタスクの難しさは、画像コンテンツの信頼性と視覚的な一貫性を維持しながら、単一の画像から時間次元で動的な情報を抽出して生成することです。既存の I2V 手法では、多くの場合、この目標を達成するために複雑なモデル アーキテクチャと大量のトレーニング データが必要になります。最近、Kuaishou が主導した新しい研究成果「I2V-Adapter: AGeneralImage-to-VideoAdapter for VideoDiffusionModels」が発表されました。この研究では、革新的な画像からビデオへの変換方法を導入し、軽量のアダプター モジュールを提案します。

2022 年ボルツマン賞が発表: ホップフィールド ネットワークの創設者が受賞

Aug 13, 2023 pm 08:49 PM

2022 年ボルツマン賞が発表: ホップフィールド ネットワークの創設者が受賞

Aug 13, 2023 pm 08:49 PM

IUPAP統計物理委員会(C3)が統計物理学の分野で優れた業績をあげた研究者を表彰するために創設した2022年度ボルツマン賞の受賞者2名が発表されました。受賞者は、これまでにボルツマン賞やノーベル賞を受賞したことのない科学者でなければなりません。この賞は 1975 年に始まり、統計物理学の創始者ルートヴィヒ ボルツマンを記念して 3 年ごとに授与されます。組織化されたクリティカルモデル、インターフェースの成長、無秩序

VPR 2024 満点用紙! Meta は EfficientSAM を提案しています。すべてを素早く分割します。

Mar 02, 2024 am 10:10 AM

VPR 2024 満点用紙! Meta は EfficientSAM を提案しています。すべてを素早く分割します。

Mar 02, 2024 am 10:10 AM

EfficientSAM のこの作品は、5/5/5 の満点を獲得して CVPR2024 に収録されました。下の写真に示すように、著者は結果をソーシャル メディアで共有しました。ルカン チューリング賞受賞者もこの作品を強く推薦しました。最近の研究で、メタ研究者は、SAM を使用したマスク画像事前トレーニング (SAMI) という新しい改良された方法を提案しました。この方法では、MAE 事前トレーニング テクノロジーと SAM モデルを組み合わせて、高品質の事前トレーニングされた ViT エンコーダーを実現します。 SAMI を通じて、研究者はモデルのパフォーマンスと効率を向上させ、視覚タスクにより良いソリューションを提供しようとしています。この手法の提案は、コンピューター ビジョンとディープ ラーニングの分野をさらに探索し、発展させるための新しいアイデアと機会をもたらします。異なるものを組み合わせることで

Google AI の新星が Pika に乗り換え: ビデオ生成の Lumiere が創設科学者を務める

Feb 26, 2024 am 09:37 AM

Google AI の新星が Pika に乗り換え: ビデオ生成の Lumiere が創設科学者を務める

Feb 26, 2024 am 09:37 AM

ビデオ生成は本格的に進歩しており、Pika は偉大な将軍、Pika の創設科学者を務める Google 研究者の Omer Bar-Tal を迎えました。 1か月前、Googleが共著者としてビデオ生成モデルLumiereをリリースしましたが、その効果は素晴らしかったです。当時、ネチズンは次のように述べました。「Google がビデオ生成の戦いに参加し、また見るべき良い番組ができた。」 StabilityAI CEOやGoogleの元同僚など、業界関係者の中には祝福の声が寄せられた。 Lumiere の最初の作品である Omer Bar-Tal は、修士号を取得して卒業したばかりで、2021 年にテルアビブ大学の数学およびコンピュータ サイエンス学部を卒業し、その後ワイツマン科学大学に進学してコンピュータの修士号を取得しました。科学、主に画像とビデオの合成分野の研究に焦点を当てています。彼の論文の結果は何度も出版されています