ターゲット検出のための最新のディープ アーキテクチャはパラメータが半分で、3 倍高速です +

簡単な紹介

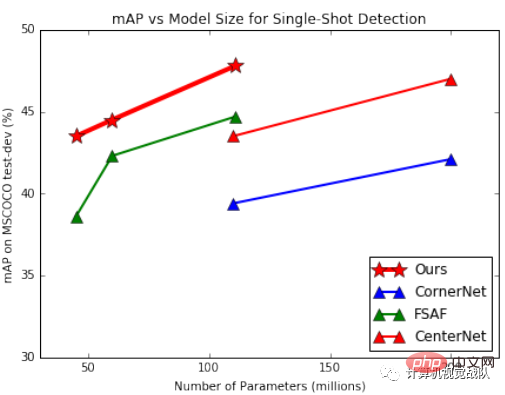

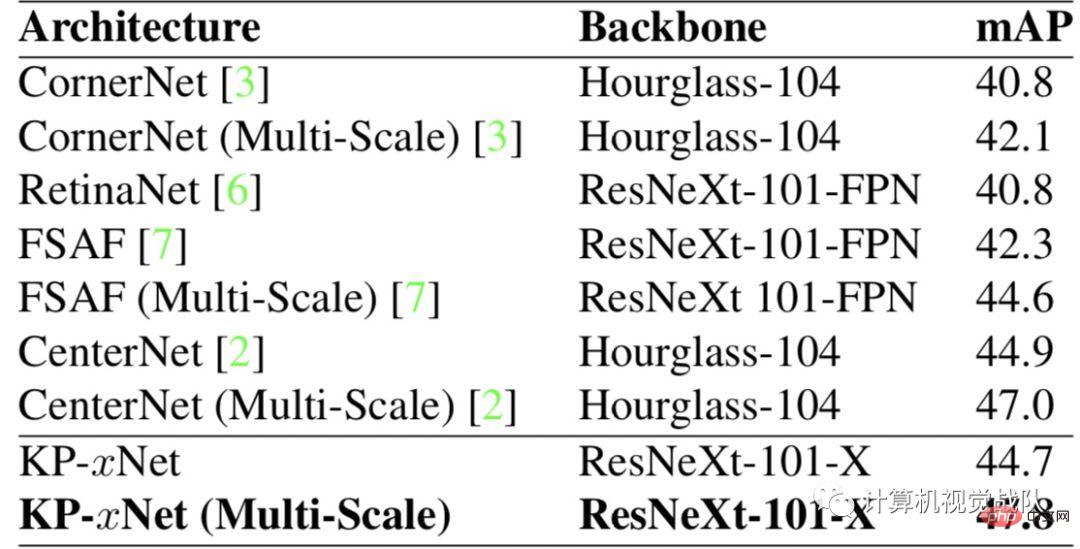

研究著者らは、物体検出のための新しいディープ アーキテクチャである Matrix Net (xNet) を提案しています。 xNet は、サイズ寸法とアスペクト比が異なるオブジェクトをネットワーク層にマッピングします。ネットワーク層では、オブジェクトのサイズとアスペクト比は層内でほぼ均一です。したがって、xNet はサイズとアスペクト比を認識したアーキテクチャを提供します。研究者は xNet を使用して、キーポイントベースのターゲット検出を強化します。新しいアーキテクチャは、他のシングルショット検出器よりも高い時間効率を実現し、MS COCO データセットで 47.8 mAP を達成しながら、パラメータの半分を使用し、2 番目に優れたフレームワークよりも 3 倍高速にトレーニングします。

簡易結果表示

上図に示すように、xNet のパラメータと効率は他のモデルをはるかに上回っています。その中でも、FSAF はアンカーベースの検出器の中で最も優れた効果を発揮し、古典的な RetinaNet を上回ります。研究者らによって提案されたモデルは、同様の数のパラメータを備えた他のすべてのシングルショット アーキテクチャよりも優れています。

背景と現在の状況

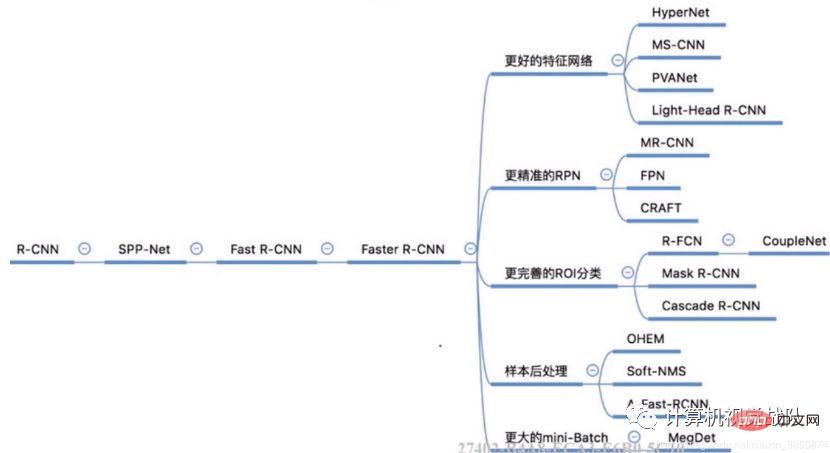

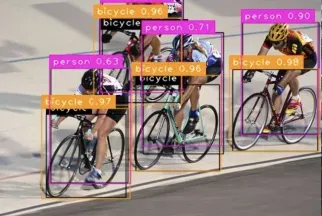

オブジェクト検出は、コンピューター ビジョンで最も広く研究されているタスクの 1 つであり、オブジェクト追跡、インスタンス セグメンテーションなどの他のビジョン タスクにも多くの応用例があります。および画像のキャプション。ターゲット検出構造は、シングルショット検出器と2段階検出器の2つのカテゴリに分類できます。 2 段階検出器は、領域提案ネットワークを利用して固定数のオブジェクト候補を見つけ、次に 2 番目のネットワークを使用して各候補のスコアを予測し、その境界ボックスを改善します。

一般的な 2 段階アルゴリズム

シングルショット検出器は、アンカーベースの検出器とキーポイントの 2 つのカテゴリに分類することもできます。ベースの検出器。アンカーベースの検出器には多くのアンカー境界ボックスが含まれており、各テンプレートのオフセットとクラスを予測します。最も有名なアンカーベースのアーキテクチャは RetinaNet です。RetinaNet は、アンカー境界ボックスのクラスの不均衡を修正するのに役立つ焦点損失関数を提案しています。最もパフォーマンスの高いアンカーベースの検出器は FSAF です。 FSAF は、アンカーベースの出力をアンカーレス出力ヘッドと統合して、パフォーマンスをさらに向上させます。

一方、キーポイント ベースの検出器は、左上と右下のヒートマップを予測し、特徴の埋め込みを使用してそれらを照合します。オリジナルのキーポイント ベースの検出器は CornerNet です。これは、特別なコーナー プーリング レイヤーを利用して、さまざまなサイズのオブジェクトを正確に検出します。それ以来、Centerne はオブジェクトの中心とコーナーを予測することにより、CornerNet アーキテクチャを大幅に改善しました。

マトリックス ネット

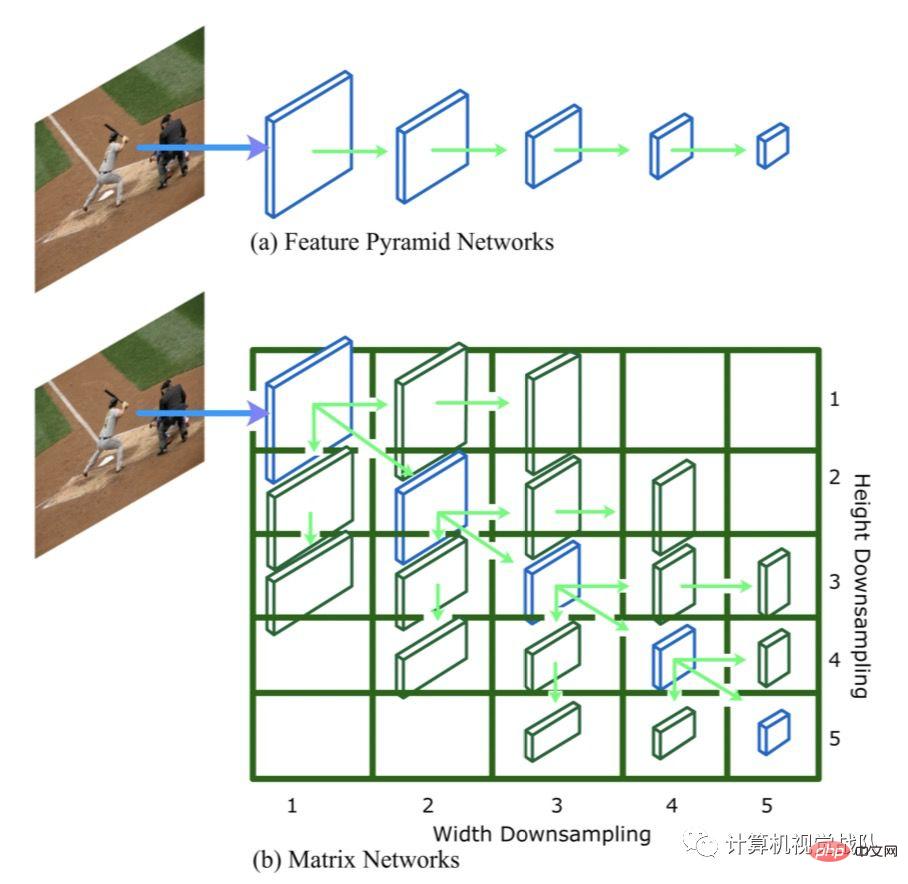

下の図は、階層マトリックスを使用して、さまざまなサイズとクラスター横比を持つターゲットをモデル化するマトリックス ネット (xNet) を示しています。エントリ i, j of は層 li,j を表します。行列 l1,1 の左上隅の幅は 2^(i-1) でダウンサンプリングされ、高さは 2^(j-1) でダウンサンプリングされます。対角レイヤーは、FPN に相当するさまざまなサイズの正方形レイヤーであり、非対角レイヤーは長方形レイヤーです (これは xNet に固有です)。レイヤ l1,1 が最大のレイヤで、右へ 1 ステップごとにレイヤの幅が半分になり、右へ 1 ステップごとに高さが半分になります。

#たとえば、レイヤー l3,4 はレイヤー l3,3 の半分の幅です。対角レイヤーはアスペクト比が正方形に近いオブジェクトをモデル化するのに対し、非対角レイヤーはアスペクト比が正方形に近いオブジェクトをモデル化します。マトリックスの右上または左下隅近くのレイヤーは、アスペクト比が極端に高いまたは低いオブジェクトをモデル化します。このようなターゲットは非常にまれであるため、効率を向上させるためにプルーニングできます。

1. レイヤーの生成

マトリックス レイヤーの生成は、モデル パラメーターの数に影響するため、重要なステップです。パラメーターが多いほど、モデルの式が強化され、最適化問題がより困難になるため、研究者は新しいパラメーターをできるだけ少なく導入することを選択します。対角層は、バックボーンのさまざまな段階から、またはフィーチャ ピラミッド フレームワークを使用して取得できます。上三角レイヤーは、対角レイヤーに 1x2 ストライドを持つ一連の共有 3x3 畳み込みを適用することによって取得されます。同様に、左下の層は、2x1 のストライドで共有 3x3 畳み込みを使用して取得されます。新しいパラメータの数を最小限に抑えるために、パラメータはすべてのダウンサンプリング畳み込み間で共有されます。

2. レイヤー範囲

マトリックスの各レイヤーは、特定の幅と高さでターゲットをモデル化するため、マトリックスの各レイヤーのターゲットに割り当てられる幅と高さを定義する必要があります。範囲。この範囲は、マトリックス層の特徴ベクトルの受容野を反映する必要があります。マトリックスの右への各ステップは水平方向の受容野を効果的に 2 倍にし、各ステップは垂直方向の受容野を 2 倍にします。したがって、マトリックス内で右または下に移動すると、幅または高さの範囲を 2 倍にする必要があります。最初の層 l1,1 の範囲が定義されたら、上記のルールを使用して残りの行列層の範囲を生成できます。

3. 行列ネットの利点

行列ネットの主な利点は、正方畳み込みカーネルがさまざまなアスペクト比に関する情報を正確に収集できることです。 RetinaNet などの従来の物体検出モデルでは、さまざまなアスペクト比とスケールを出力するには正方形コンボリューション カーネルが必要です。境界ボックスの異なる側面には異なる背景が必要となるため、これは直観に反します。マトリックス ネットでは、各マトリックス層のコンテキストが変化するため、同じ正方形コンボリューション カーネルを異なるスケールとアスペクト比の境界ボックスに使用できます。

ターゲット サイズは指定されたレイヤー内でほぼ均一であるため、幅と高さのダイナミック レンジは他のアーキテクチャ (FPN など) に比べて小さくなります。したがって、ターゲットの高さと幅を回帰することは、より簡単な最適化問題になります。最後に、マトリックス ネットは、アンカーベースまたはキーポイントベースのワンショットまたはツーショット検出器として、任意の物体検出アーキテクチャとして使用できます。

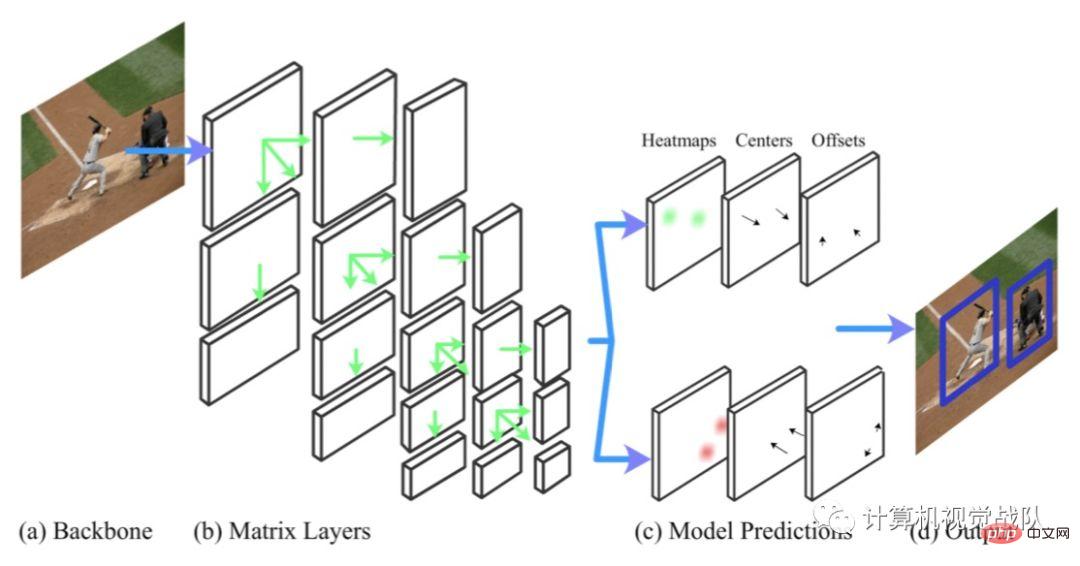

マトリックス ネットはキー ポイントに基づく検出に使用されます

コーナーネットが提案されたとき、それは代わりに使用されました。アンカーベースの検出では、一対のコーナー (左上と右下) を利用して境界ボックスを予測します。 CornerNet はコーナーごとにヒートマップ、オフセット、エンベディングを予測します。

上の図は、キーポイントに基づくターゲット検出フレームワーク - KP-xNet で、4 つのステップが含まれています。

- (a-b): xNet のバックボーンが使用されます;

- (c): 共有出力サブネットワークが使用されます、および各マトリックス レイヤーについて、左上隅と右下隅のヒートマップとオフセットが予測され、ターゲット レイヤー内のそれらの中心点が予測されます;

- (d ): 中心点予測を使用すると、同じレイヤー内のコーナーが一致し、すべてのレイヤーの出力がソフト非最大抑制と結合されて、最終出力が得られます。

#次の表は、MS COCO データ セットの結果を示しています。

研究者らはまた、さまざまなバックボーンのパラメーターの数に基づいて、新しく提案されたモデルを他のモデルと比較しました。最初の図では、KP-xNet がすべてのパラメーター レベルで他のすべての構造よりも優れていることがわかります。研究者らは、これは KP-xNet がスケールとアスペクト比を意識したアーキテクチャを使用しているためであると考えています。

#論文アドレス: https://arxiv.org/pdf/1908.04646.pdf

以上がターゲット検出のための最新のディープ アーキテクチャはパラメータが半分で、3 倍高速です +の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7562

7562

15

15

1384

1384

52

52

84

84

11

11

28

28

98

98

![iPhone で深度効果を使用する方法 [2023]](https://img.php.cn/upload/article/000/465/014/169410031113297.png?x-oss-process=image/resize,m_fill,h_207,w_330) iPhone で深度効果を使用する方法 [2023]

Sep 07, 2023 pm 11:25 PM

iPhone で深度効果を使用する方法 [2023]

Sep 07, 2023 pm 11:25 PM

iPhone で他と違う点が 1 つあるとすれば、それは iPhone のロック画面を処理する際に利用できるカスタマイズ オプションの数です。オプションの中には、壁紙がロック画面の時計ウィジェットと相互作用しているように見せる深度効果機能があります。深度効果について、いつ、どこで適用できるのか、iPhoneでの使い方などを解説します。 iPhone の深度効果とは何ですか?さまざまな要素を含む壁紙を追加すると、iPhone はそれを複数の深さのレイヤーに分割します。これを行うために、iOS は内蔵のニューラル エンジンを利用して壁紙内の深度情報を検出し、焦点を当てて表示したい被写体を選択した背景の他の要素から分離します。これにより、主人公が壁紙に登場するクールな効果が得られます。

深層学習アーキテクチャの比較分析

May 17, 2023 pm 04:34 PM

深層学習アーキテクチャの比較分析

May 17, 2023 pm 04:34 PM

深層学習の概念は人工ニューラル ネットワークの研究に由来しており、複数の隠れ層を含む多層パーセプトロンが深層学習構造です。ディープラーニングは、低レベルの特徴を組み合わせて、データのカテゴリや特性を表すより抽象的な高レベルの表現を形成します。データの分散された特徴表現を検出できます。ディープラーニングは機械学習の一種であり、機械学習は人工知能を実現する唯一の方法です。では、さまざまな深層学習システム アーキテクチャの違いは何でしょうか? 1. 完全接続ネットワーク (FCN) 完全接続ネットワーク (FCN) は、一連の完全接続層で構成され、各層のすべてのニューロンが別の層のすべてのニューロンに接続されています。その主な利点は、「構造に依存しない」ことです。つまり、入力に関する特別な仮定が必要ありません。この構造にとらわれないことにより、完全な

正確なオブジェクト検出のためのマルチグリッド冗長境界ボックス注釈

Jun 01, 2024 pm 09:46 PM

正確なオブジェクト検出のためのマルチグリッド冗長境界ボックス注釈

Jun 01, 2024 pm 09:46 PM

1. はじめに 現在、主要なオブジェクト検出器は、深層 CNN のバックボーン分類器ネットワークを再利用した 2 段階または 1 段階のネットワークです。 YOLOv3 は、入力画像を受け取り、それを等しいサイズのグリッド マトリックスに分割する、よく知られた最先端の 1 段階検出器の 1 つです。ターゲット中心を持つグリッド セルは、特定のターゲットの検出を担当します。今日私が共有するのは、各ターゲットに複数のグリッドを割り当てて正確なタイトフィット境界ボックス予測を実現する新しい数学的手法です。研究者らはまた、ターゲット検出のための効果的なオフラインのコピー&ペーストデータの強化も提案しました。新しく提案された方法は、現在の最先端の物体検出器の一部よりも大幅に性能が優れており、より優れたパフォーマンスが期待されます。 2. バックグラウンドターゲット検出ネットワークは、次のように設計されています。

ターゲット検出用の新しい SOTA: YOLOv9 が登場し、新しいアーキテクチャにより従来の畳み込みが復活します

Feb 23, 2024 pm 12:49 PM

ターゲット検出用の新しい SOTA: YOLOv9 が登場し、新しいアーキテクチャにより従来の畳み込みが復活します

Feb 23, 2024 pm 12:49 PM

ターゲット検出の分野では、YOLOv9 は実装プロセスで進歩を続けており、新しいアーキテクチャとメソッドを採用することにより、従来の畳み込みのパラメータ利用を効果的に改善し、そのパフォーマンスが前世代の製品よりもはるかに優れています。 2023 年 1 月に YOLOv8 が正式にリリースされてから 1 年以上が経過し、ついに YOLOv9 が登場しました。 2015 年に Joseph Redmon 氏や Ali Farhadi 氏らが第 1 世代の YOLO モデルを提案して以来、ターゲット検出分野の研究者たちはそれを何度も更新し、反復してきました。 YOLO は画像のグローバル情報に基づく予測システムであり、そのモデルのパフォーマンスは継続的に強化されています。アルゴリズムとテクノロジーを継続的に改善することにより、研究者は目覚ましい成果を上げ、ターゲット検出タスクにおける YOLO をますます強力にしています。

Spring Data JPA のアーキテクチャと動作原理は何ですか?

Apr 17, 2024 pm 02:48 PM

Spring Data JPA のアーキテクチャと動作原理は何ですか?

Apr 17, 2024 pm 02:48 PM

SpringDataJPA は JPA アーキテクチャに基づいており、マッピング、ORM、トランザクション管理を通じてデータベースと対話します。そのリポジトリは CRUD 操作を提供し、派生クエリによりデータベース アクセスが簡素化されます。さらに、遅延読み込みを使用して必要な場合にのみデータを取得するため、パフォーマンスが向上します。

マルチパス、マルチドメイン、すべてを網羅! Google AI がマルチドメイン学習一般モデル MDL をリリース

May 28, 2023 pm 02:12 PM

マルチパス、マルチドメイン、すべてを網羅! Google AI がマルチドメイン学習一般モデル MDL をリリース

May 28, 2023 pm 02:12 PM

視覚タスク (画像分類など) の深層学習モデルは、通常、単一の視覚領域 (自然画像やコンピューター生成画像など) からのデータを使用してエンドツーエンドでトレーニングされます。一般に、複数のドメインのビジョン タスクを完了するアプリケーションは、個別のドメインごとに複数のモデルを構築し、それらを個別にトレーニングする必要があります。データは異なるドメイン間で共有されません。推論中、各モデルは特定のドメインの入力データを処理します。たとえそれらが異なる分野を指向しているとしても、これらのモデル間の初期層のいくつかの機能は類似しているため、これらのモデルの共同トレーニングはより効率的です。これにより、遅延と消費電力が削減され、各モデル パラメーターを保存するためのメモリ コストが削減されます。このアプローチはマルチドメイン学習 (MDL) と呼ばれます。さらに、MDL モデルは単一モデルよりも優れたパフォーマンスを発揮します。

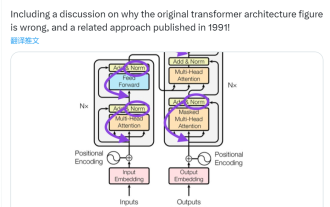

この「間違い」は実際には間違いではありません。Transformer アーキテクチャ図の何が「間違っている」のかを理解するには、4 つの古典的な論文から始めてください。

Jun 14, 2023 pm 01:43 PM

この「間違い」は実際には間違いではありません。Transformer アーキテクチャ図の何が「間違っている」のかを理解するには、4 つの古典的な論文から始めてください。

Jun 14, 2023 pm 01:43 PM

少し前に、Transformer のアーキテクチャ図と Google Brain チームの論文「Attending IsAllYouNeed」のコードとの間の矛盾を指摘したツイートが多くの議論を引き起こしました。セバスチャンの発見は意図せぬ間違いだったのではないかと考える人もいるが、これもまた驚くべきことである。結局のところ、Transformer 論文の人気を考慮すると、この矛盾については何千回も言及されるべきでした。 Sebastian Raschka氏はネチズンのコメントに答えて、「最もオリジナルな」コードは確かにアーキテクチャ図と一致していたが、2017年に提出されたコードバージョンは修正されたものの、アーキテクチャ図は同時に更新されていなかったと述べた。これが議論の「齟齬」の根本原因でもある。

1.3ミリ秒には1.3ミリ秒かかります。清華社の最新オープンソース モバイル ニューラル ネットワーク アーキテクチャ RepViT

Mar 11, 2024 pm 12:07 PM

1.3ミリ秒には1.3ミリ秒かかります。清華社の最新オープンソース モバイル ニューラル ネットワーク アーキテクチャ RepViT

Mar 11, 2024 pm 12:07 PM

論文のアドレス: https://arxiv.org/abs/2307.09283 コードのアドレス: https://github.com/THU-MIG/RepViTRepViT は、モバイル ViT アーキテクチャで優れたパフォーマンスを発揮し、大きな利点を示します。次に、この研究の貢献を検討します。記事では、主にモデルがグローバル表現を学習できるようにするマルチヘッド セルフ アテンション モジュール (MSHA) のおかげで、軽量 ViT は一般的に視覚タスクにおいて軽量 CNN よりも優れたパフォーマンスを発揮すると述べられています。ただし、軽量 ViT と軽量 CNN のアーキテクチャの違いは十分に研究されていません。この研究では、著者らは軽量の ViT を効果的なシステムに統合しました。