自動運転車は歩行者に意思を伝えることができるのでしょうか?

広い道路を安全に横断できるかどうかを判断するには、社会的な手がかりと、歩行者とドライバーの間の協力的なコミュニケーションが必要です。では、それが自動運転車になったらどうなるでしょうか?自動運転車会社 Motional は、車両をより表現力豊かにすることが、これらの重要な信号を維持するための鍵となる可能性があると考えています。

Motional のチーフ エンジニア、ポール シュミットは、横断歩道で待っているときに、彼の言うところの「一瞥によるダンス」を体験しました。それは簡単かつほとんど無意識のうちに行われる評価です。対向車のドライバーはどこを見ているのでしょうか?彼らは彼に気づきましたか? 「自動運転車では、こうしたインタラクションの半分は存在しません。では、歩行者が車両の意図を理解するための手がかりは何でしょうか?」

この質問に答えるために、チームはアニメーションを採用しました。 Studio CHRLX は、さまざまな信号メカニズムに対する歩行者の反応をテストするように設計された、非常にリアルな VR 体験を構築します。彼らの研究結果は、IEEE Robotics and Automation Letters に掲載されました。シュミット氏と彼のチームは、早めにブレーキをかけたり、歩行者の前で停止したりする大げさな運転操作が、自分の意図を伝える最も効果的な方法であると述べている。

同社は現在、最も有望な表現動作をモーション プランニング システムに統合しており、他のチームが実験できるように仮想現実交通環境もオープンソース化しています。

この研究では、車両が停止していることを歩行者に暗黙のうちに知らせるさまざまな表現行動もテストされました。これらには、車のブレーキをベースラインからさらに強くすること、車から 1 メートル離れたところで停止すること、急ブレーキ音と低回転数の音を追加すること、そして最終的に、車両が急ブレーキをかけているかのような誇張されたノーズ ダイブ音とこれらの音を組み合わせることが含まれます。

チームは、歩行者がどのくらい早く車線を横断しようと決意するかを測定し、各試行後に歩行者に簡単な調査を実施して、歩行者がどの程度安全だと感じているか、車線を横断する決断にどの程度自信があるかを把握し、また、歩行者がどの程度安全に車線を横断できるかを把握しました。車の意図が分かります。安全性と車の意図の理解に関しては、短い停止が最も高いスコアを獲得しました。

シュミット氏は、短い停止が最も良い反応を得たと述べました。このアプローチは、歩行者の前で減速する人間のドライバーの行動からインスピレーションを得たものであるため、これは驚くべきことではありませんでした。驚いたことに、ドライバーの有無にかかわらず、この基本シナリオに対する反応にほとんど差はなく、歩行者がハンドルを握るドライバーよりも車両の動きに注意を払っていることを示唆していると同氏は付け加えた。

以上が自動運転車は歩行者に意思を伝えることができるのでしょうか?の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7453

7453

15

15

1374

1374

52

52

77

77

11

11

14

14

9

9

自動運転シナリオにおけるロングテール問題を解決するにはどうすればよいでしょうか?

Jun 02, 2024 pm 02:44 PM

自動運転シナリオにおけるロングテール問題を解決するにはどうすればよいでしょうか?

Jun 02, 2024 pm 02:44 PM

昨日の面接で、ロングテール関連の質問をしたかと聞かれたので、簡単にまとめてみようと思いました。自動運転のロングテール問題とは、自動運転車におけるエッジケース、つまり発生確率が低い考えられるシナリオを指します。認識されているロングテール問題は、現在、単一車両のインテリジェント自動運転車の運用設計領域を制限している主な理由の 1 つです。自動運転の基礎となるアーキテクチャとほとんどの技術的問題は解決されており、残りの 5% のロングテール問題が徐々に自動運転の開発を制限する鍵となってきています。これらの問題には、さまざまな断片的なシナリオ、極端な状況、予測不可能な人間の行動が含まれます。自動運転におけるエッジ シナリオの「ロング テール」とは、自動運転車 (AV) におけるエッジ ケースを指します。エッジ ケースは、発生確率が低い可能性のあるシナリオです。これらの珍しい出来事

nuScenes の最新 SOTA | SparseAD: スパース クエリは効率的なエンドツーエンドの自動運転に役立ちます。

Apr 17, 2024 pm 06:22 PM

nuScenes の最新 SOTA | SparseAD: スパース クエリは効率的なエンドツーエンドの自動運転に役立ちます。

Apr 17, 2024 pm 06:22 PM

先頭と開始点に書かれている エンドツーエンドのパラダイムでは、統一されたフレームワークを使用して自動運転システムのマルチタスクを実現します。このパラダイムの単純さと明確さにも関わらず、サブタスクにおけるエンドツーエンドの自動運転手法のパフォーマンスは、依然としてシングルタスク手法に比べてはるかに遅れています。同時に、以前のエンドツーエンド手法で広く使用されていた高密度鳥瞰図 (BEV) 機能により、より多くのモダリティやタスクに拡張することが困難になります。ここでは、スパース検索中心のエンドツーエンド自動運転パラダイム (SparseAD) が提案されています。このパラダイムでは、スパース検索は、高密度の BEV 表現を使用せずに、空間、時間、タスクを含む運転シナリオ全体を完全に表します。具体的には、統合されたスパース アーキテクチャが、検出、追跡、オンライン マッピングなどのタスク認識のために設計されています。さらに、重い

FisheyeDetNet: 魚眼カメラに基づいた最初のターゲット検出アルゴリズム

Apr 26, 2024 am 11:37 AM

FisheyeDetNet: 魚眼カメラに基づいた最初のターゲット検出アルゴリズム

Apr 26, 2024 am 11:37 AM

目標検出は自動運転システムにおいて比較的成熟した問題であり、その中でも歩行者検出は最も初期に導入されたアルゴリズムの 1 つです。ほとんどの論文では非常に包括的な研究が行われています。ただし、サラウンドビューに魚眼カメラを使用した距離認識については、あまり研究されていません。放射状の歪みが大きいため、標準のバウンディング ボックス表現を魚眼カメラに実装するのは困難です。上記の説明を軽減するために、拡張バウンディング ボックス、楕円、および一般的な多角形の設計を極/角度表現に探索し、これらの表現を分析するためのインスタンス セグメンテーション mIOU メトリックを定義します。提案された多角形モデルの FisheyeDetNet は、他のモデルよりも優れたパフォーマンスを示し、同時に自動運転用の Valeo 魚眼カメラ データセットで 49.5% の mAP を達成しました。

自動運転の初の純粋な視覚的静的再構築

Jun 02, 2024 pm 03:24 PM

自動運転の初の純粋な視覚的静的再構築

Jun 02, 2024 pm 03:24 PM

純粋に視覚的な注釈ソリューションでは、主に視覚に加えて、GPS、IMU、および車輪速度センサーからのデータを動的注釈に使用します。もちろん、量産シナリオでは、純粋な視覚である必要はありません。一部の量産車両には固体レーダー (AT128) などのセンサーが搭載されています。大量生産の観点からデータの閉ループを作成し、これらすべてのセンサーを使用すると、動的オブジェクトのラベル付けの問題を効果的に解決できます。しかし、私たちの計画には固体レーダーはありません。したがって、この最も一般的な量産ラベル ソリューションを紹介します。純粋に視覚的な注釈ソリューションの中核は、高精度のポーズ再構築にあります。再構築の精度を確保するために、Structure from Motion (SFM) のポーズ再構築スキームを使用します。でもパスする

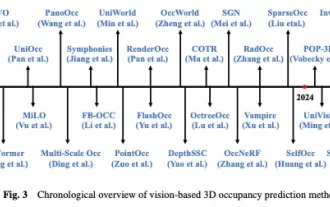

Occと自動運転の過去と現在を見てみよう!最初のレビューでは、機能強化/量産展開/アノテーションの効率化という 3 つの主要テーマを包括的にまとめています。

May 08, 2024 am 11:40 AM

Occと自動運転の過去と現在を見てみよう!最初のレビューでは、機能強化/量産展開/アノテーションの効率化という 3 つの主要テーマを包括的にまとめています。

May 08, 2024 am 11:40 AM

以上、筆者個人の理解 近年、自動運転はドライバーの負担軽減や運転の安全性の向上につながる可能性があるため、注目が高まっています。ビジョンベースの 3 次元占有予測は、自動運転の安全性に関する費用対効果の高い包括的な調査に適した新たな認識タスクです。オブジェクト中心の知覚タスクと比較して 3D 占有予測ツールの優位性は多くの研究で実証されていますが、この急速に発展している分野に特化したレビューはまだあります。このホワイトペーパーでは、まずビジョンベースの 3D 占有予測の背景を紹介し、このタスクで直面する課題について説明します。次に、現在の 3D 占有予測手法の現状と開発傾向を、機能強化、展開の容易さ、ラベル付けの効率という 3 つの側面から包括的に説明します。やっと

LLMはすべて完了しました! OmniDrive: 3D 認識と推論プランニングの統合 (NVIDIA の最新)

May 09, 2024 pm 04:55 PM

LLMはすべて完了しました! OmniDrive: 3D 認識と推論プランニングの統合 (NVIDIA の最新)

May 09, 2024 pm 04:55 PM

上記と著者の個人的な理解: この論文は、自動運転アプリケーションにおける現在のマルチモーダル大規模言語モデル (MLLM) の主要な課題、つまり MLLM を 2D 理解から 3D 空間に拡張する問題の解決に特化しています。自動運転車 (AV) は 3D 環境について正確な決定を下す必要があるため、この拡張は特に重要です。 3D 空間の理解は、情報に基づいて意思決定を行い、将来の状態を予測し、環境と安全に対話する車両の能力に直接影響を与えるため、AV にとって重要です。現在のマルチモーダル大規模言語モデル (LLaVA-1.5 など) は、ビジュアル エンコーダーの解像度制限や LLM シーケンス長の制限により、低解像度の画像入力しか処理できないことがよくあります。ただし、自動運転アプリケーションには次の要件が必要です。

「クローズド ループ」に向けて | PlanAgent: MLLM に基づく自動運転のクローズド ループ プランニングのための新しい SOTA!

Jun 08, 2024 pm 09:30 PM

「クローズド ループ」に向けて | PlanAgent: MLLM に基づく自動運転のクローズド ループ プランニングのための新しい SOTA!

Jun 08, 2024 pm 09:30 PM

中国科学院オートメーション研究所の深層強化学習チームは、Li Auto氏らとともに、マルチモーダル大規模言語モデルMLLM(PlanAgent)に基づく自動運転のための新しい閉ループ計画フレームワークを提案した。この手法は、シーンの鳥瞰図とグラフベースのテキスト プロンプトを入力として受け取り、マルチモーダル大規模言語モデルのマルチモーダル理解機能と常識推論機能を利用して、シーンの理解から生成までの階層的推論を実行します。水平移動と垂直移動の指示を作成し、プランナーが必要とする指示をさらに生成します。このメソッドは、大規模で困難な nuPlan ベンチマークでテストされており、実験では、PlanAgent が通常のシナリオとロングテール シナリオの両方で最先端 (SOTA) のパフォーマンスを達成することが示されています。従来の大規模言語モデル (LLM) メソッドと比較して、PlanAgent

パス計画の概要: サンプリング、検索、最適化に基づいてすべて完了しました。

Jun 01, 2024 pm 08:12 PM

パス計画の概要: サンプリング、検索、最適化に基づいてすべて完了しました。

Jun 01, 2024 pm 08:12 PM

1 意思決定制御と動作計画の概要 現在の意思決定制御方法は、逐次計画、行動認識型計画、およびエンドツーエンド計画の 3 つのカテゴリに分類できます。逐次計画: 最も伝統的な方法であり、認識、意思決定、制御の 3 つの部分が比較的明確です。行動を意識した計画: 最初の方法と比較して、ハイライトは人間と機械の共同運転、車両と道路の導入です。外部動的環境のコラボレーションと車両リスク推定。エンドツーエンドの計画: DL および DRL テクノロジーは、画像やハンドルのコーナーなどの感覚情報を取得するために大量のデータ トレーニングを使用します。