CNN と Transformer の正しい組み合わせを解き放ち、ByteDance は効果的な次世代ビジュアル Transformer を提案します

複雑なアテンション メカニズムとモデル設計により、既存のビジュアル トランスフォーマー (ViT) のほとんどは、実際の産業展開シナリオでは畳み込みニューラル ネットワーク (CNN) ほど効率的に実行できません。ここで、ビジュアル ニューラル ネットワークは CNN と同じくらい速く、ViT と同じくらい強力な推論を行うことができるのかという疑問が生じます。

最近のいくつかの研究では、この問題を解決するために CNN と Transformer のハイブリッド アーキテクチャを設計しようとしていますが、これらの研究の全体的なパフォーマンスは満足のいくものとは程遠いです。これに基づいて、ByteDance の研究者は、現実の産業シナリオに効果的に導入できる次世代ビジュアル トランスフォーマー Next-ViT を提案しました。レイテンシと精度のトレードオフの観点から見ると、Next-ViT のパフォーマンスは優れた CNN や ViT に匹敵します。

論文アドレス: https://arxiv.org/pdf/2207.05501.pdf ##Next-ViT の研究チームは、新しい畳み込みブロック (NCB) とトランスフォーマー ブロック (NTB) を開発することで、ローカルおよびグローバルの情報を取得するフレンドリーなメカニズムを導入しました。次に、この研究では、効率的なハイブリッド パラダイムで NCB と NTB をスタックし、さまざまな下流タスクのパフォーマンスを向上させることを目的とした、新しいハイブリッド戦略 NHS を提案しています。

広範な実験により、Next-ViT は、さまざまな視覚タスクの遅延と精度のトレードオフの点で、既存の CNN、ViT、および CNN-Transformer ハイブリッド アーキテクチャよりも大幅に優れていることが示されています。 TensorRT では、Next-ViT は、COCO 検出タスクで 5.4 mAP (40.4 VS 45.8)、ADE20K セグメンテーションで 8.2% mIoU (38.8% VS 47.0%) で ResNet を上回ります。一方、Next-ViT は CSWin と同等のパフォーマンスを実現し、3.6 倍の高速推論を実現します。 CoreML では、Next-ViT は EfficientFormer よりも COCO 検出タスクで 4.6 mAP (42.6 VS 47.2)、ADE20K セグメンテーションで 3.5% mIoU (45.2% から 48.7%) 優れています。

方法

Next-ViT の全体的なアーキテクチャを以下の図 2 に示します。 Next-ViT は、各ステージにパッチ埋め込み層と一連の畳み込みブロックまたは Transformer ブロックを備えた階層ピラミッド アーキテクチャに従います。空間解像度は徐々に元の 1/32 まで低下し、チャネル寸法は段階的に拡大されます。

研究者らはまず、情報インタラクションのコアモジュールを徹底的に設計し、短期および長期のシミュレーションを行うための強力なNCBとNTBをそれぞれ開発しました。ビジュアルデータの -term 依存関係。ローカル情報とグローバル情報も NTB に融合され、モデリング機能がさらに向上します。最後に、既存の手法に固有の欠点を克服するために、この研究では畳み込みブロックと Transformer ブロックの統合を系統的に研究し、NCB と NTB をスタックして新しい CNN-Transformer ハイブリッド アーキテクチャを構築する NHS 戦略を提案します。

研究者らはまず、情報インタラクションのコアモジュールを徹底的に設計し、短期および長期のシミュレーションを行うための強力なNCBとNTBをそれぞれ開発しました。ビジュアルデータの -term 依存関係。ローカル情報とグローバル情報も NTB に融合され、モデリング機能がさらに向上します。最後に、既存の手法に固有の欠点を克服するために、この研究では畳み込みブロックと Transformer ブロックの統合を系統的に研究し、NCB と NTB をスタックして新しい CNN-Transformer ハイブリッド アーキテクチャを構築する NHS 戦略を提案します。

NCB

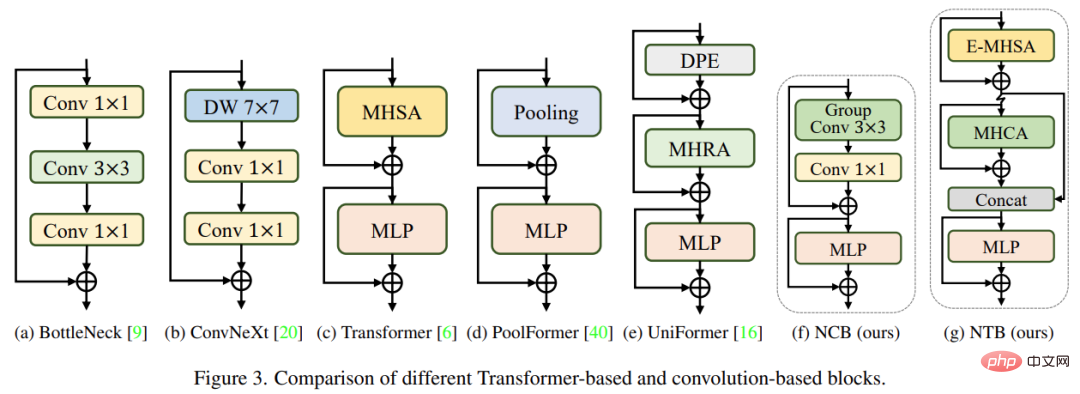

研究者らは、以下の図 3 に示すように、いくつかの古典的な構造設計を分析しました。 ResNet [9] によって提案された BottleNeck ブロックは、その固有の誘導バイアスと、ほとんどのハードウェア プラットフォームでの展開の容易さにより、ビジュアル ニューラル ネットワークを長い間支配してきました。残念ながら、BottleNeck ブロックは Transformer ブロックほど効果的ではありません。 ConvNeXt ブロック [20] は、Transformer ブロックの設計を模倣することにより、BottleNeck ブロックを最新化します。 ConvNeXt ブロックはネットワーク パフォーマンスを向上させますが、TensorRT/CoreML での推論速度は非効率なコンポーネントによって大幅に制限されます。 Transformer ブロックは、さまざまなビジョン タスクで優れた結果を達成していますが、Transformer ブロックの推論速度は、そのアテンション メカニズムがより複雑であるため、TensorRT および CoreML の BottleNeck ブロックよりもはるかに遅くなりますが、これはほとんどの現実世界では当てはまりません。産業シナリオ。耐えられない。

上記のブロックの問題を克服するために、この研究では、BottleNeck ブロックの展開上の利点を維持する Next Convolution Block (NCB) を提案しました。同時にトランスブロックの優れた性能も得られます。図 3(f) に示すように、NCB は MetaFormer の一般的なアーキテクチャに従っています (これは Transformer ブロックにとって重要であることが証明されています)。

上記のブロックの問題を克服するために、この研究では、BottleNeck ブロックの展開上の利点を維持する Next Convolution Block (NCB) を提案しました。同時にトランスブロックの優れた性能も得られます。図 3(f) に示すように、NCB は MetaFormer の一般的なアーキテクチャに従っています (これは Transformer ブロックにとって重要であることが証明されています)。

さらに、効率的なアテンションベースのトークンミキサーも同様に重要です。この研究では、畳み込み演算を展開する効率的なトークンミキサーとしてマルチヘッド畳み込みアテンション (MHCA) を設計し、MetaFormer のパラダイムで MHCA 層と MLP 層を使用して NCB を構築しました [40]。

NTB

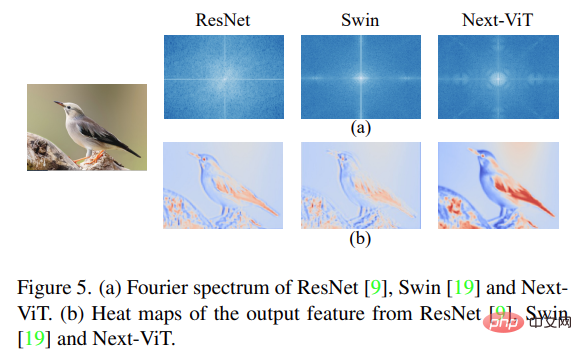

NCB はローカル表現を効果的に学習しました。次のステップでは、グローバル情報を取得する必要があります。 Transformer アーキテクチャは、グローバルな情報 (グローバルな形状や構造など) を提供する低周波信号をキャプチャする強力な機能を備えています。

しかし、関連する研究により、Transformer ブロックはローカル テクスチャ情報などの高周波情報をある程度劣化させる可能性があることが判明しています。さまざまな周波数帯域からの信号は人間の視覚システムに不可欠であり、それらはより本質的でユニークな特徴を抽出するために特定の方法で融合されます。

これらの既知の結果に影響されて、この研究では、軽量のメカニズムで複数周波数信号を捕捉する Next Transformer Block (NTB) を開発しました。さらに、NTB は効率的なマルチ周波数信号ミキサーとして使用でき、全体的なモデリング機能がさらに強化されます。

NHS

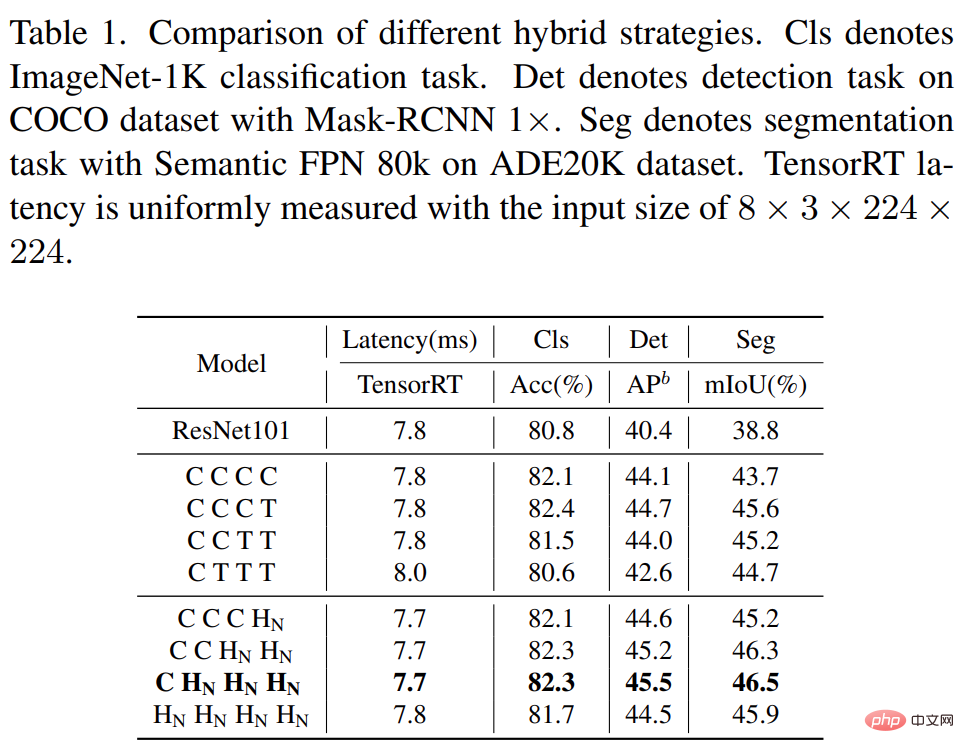

最近の研究では、CNN と Transformer を組み合わせて効率的に展開する試みが行われています。以下の図 4(b)(c) に示すように、ほとんどの場合、浅い段階では畳み込みブロックを使用し、最後の 1 つまたは 2 つの段階では Transformer ブロックのみをスタックしており、この組み合わせは分類タスクに効果的です。しかし、この調査では、これらのハイブリッド戦略は、セグメンテーションや検出などの下流タスクでパフォーマンスが簡単に飽和状態に達する可能性があることが判明しました。その理由は、分類タスクは予測に最終ステージの出力のみを使用するのに対し、下流タスク (セグメンテーションや検出など) は通常、より良い結果を得るために各ステージの機能に依存するためです。これは、従来のハイブリッド戦略では最後の数ステージで Transformer ブロックを積み重ねるだけであり、浅い層ではグローバルな情報を取得できないためです。

この研究では、畳み込みブロック (NCB) とトランスフォーマー ブロック (NTB) を創造的に組み合わせる新しいハイブリッド戦略 (NHS) を提案します。 (N 1) * L ハイブリッド パラダイム。 NHS は、ダウンストリーム タスクにおけるモデルのパフォーマンスを大幅に向上させ、Transformer ブロックの割合を制御しながら効率的な展開を実現します。

まず、浅い層にグローバルな情報をキャプチャする能力を与えるために、この研究では、各段階で N を順番に積み重ねる (NCB×N NTB×1) モード混合戦略を提案します。図 4(d) に示すように、NCB と NTB です。具体的には、トランスフォーマー ブロック (NTB) が各ステージの最後に配置され、モデルが浅いレイヤーでグローバル表現を学習できるようにします。この研究では、提案されたハイブリッド戦略の優位性を検証するために一連の実験を実施しました。さまざまなハイブリッド戦略のパフォーマンスを以下の表 1 に示します。

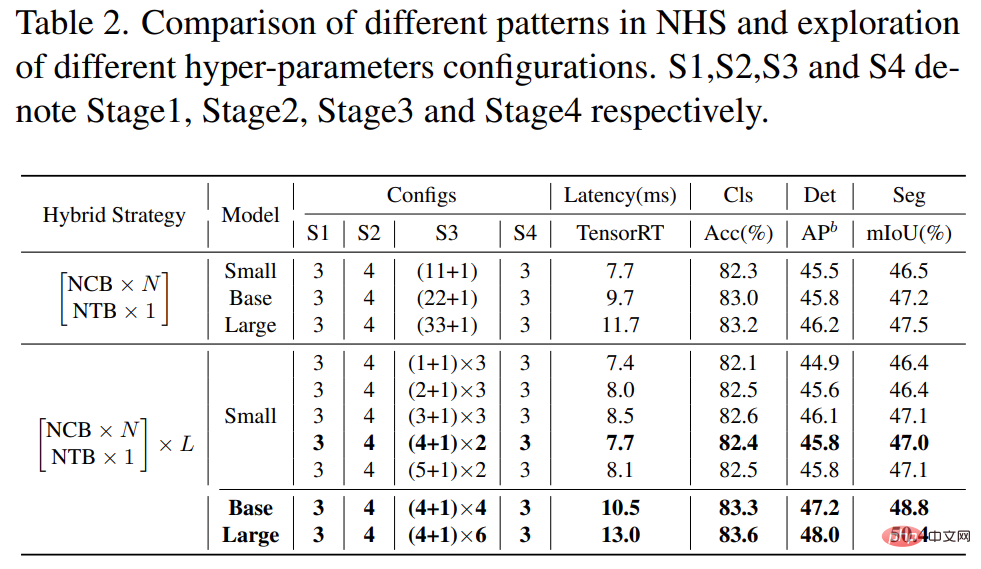

さらに、以下の表 2 に示すように、大規模モデルのパフォーマンスは徐々に飽和に達します。この現象は、(NCB × N NTB × 1) モードで N を拡大することによってモデル サイズを拡大すること、つまり、(NCB × N NTB × 1) モードでは単に畳み込みブロックを追加することが最適な選択ではないことを示しています。モデルのパフォーマンスに重大な影響を与えます。

したがって、研究者は、広範な実験を通じてモデルのパフォーマンスに対する N の値の影響を調査し始めました。表 2 (中) に示すように、研究では第 3 段階で異なる N 値を使用してモデルを構築しました。公平な比較のために同様のレイテンシを持つモデルを構築するために、この研究では、N の小さい値で (NCB × N NTB × 1) パターンの L セットをスタックします。

表 2 に示すように、第 3 段階の N = 4 のモデルは、パフォーマンスとレイテンシーの間で最適なトレードオフを実現します。さらに、第 3 段階では (NCB × 4 NTB × 1) × L モードの L を拡張することで、より大きなモデルを構築します。表 2 (下記) に示すように、Base (L = 4) および Large (L = 6) モデルのパフォーマンスは、小型モデルと比較して大幅に向上しており、提案された (NCB × N NTB × 1) × L モードが検証されています。 . 一般的な有効性。

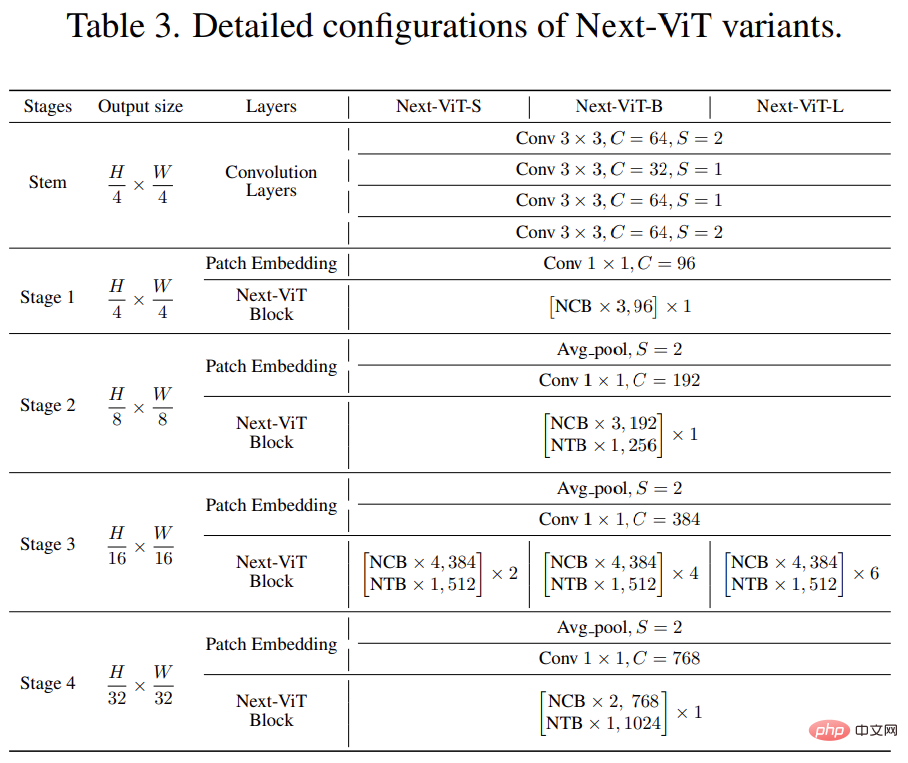

最後に、既存の SOTA ネットワークとの公正な比較を提供するために、研究者らは 3 つの典型的なバリアント、つまり Next-ViTS/B/L を提案しました。

実験結果

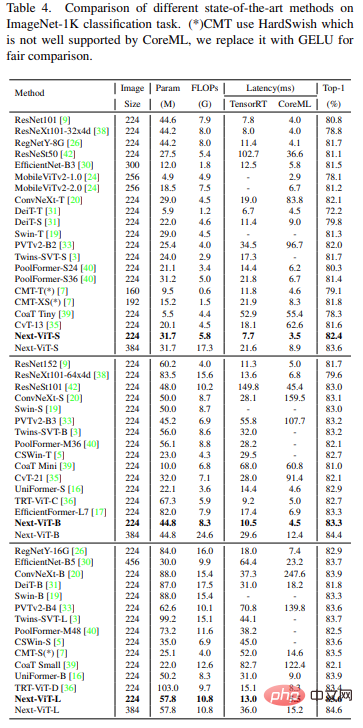

ImageNet-1Kでの分類タスク

CNN、ViT、ハイブリッドネットワークなどの最新のSOTA手法と比較して、Next-ViTはより高い精度を実現します。 -off は待ち時間と待ち時間の間で達成され、結果は以下の表 4 に示されています。

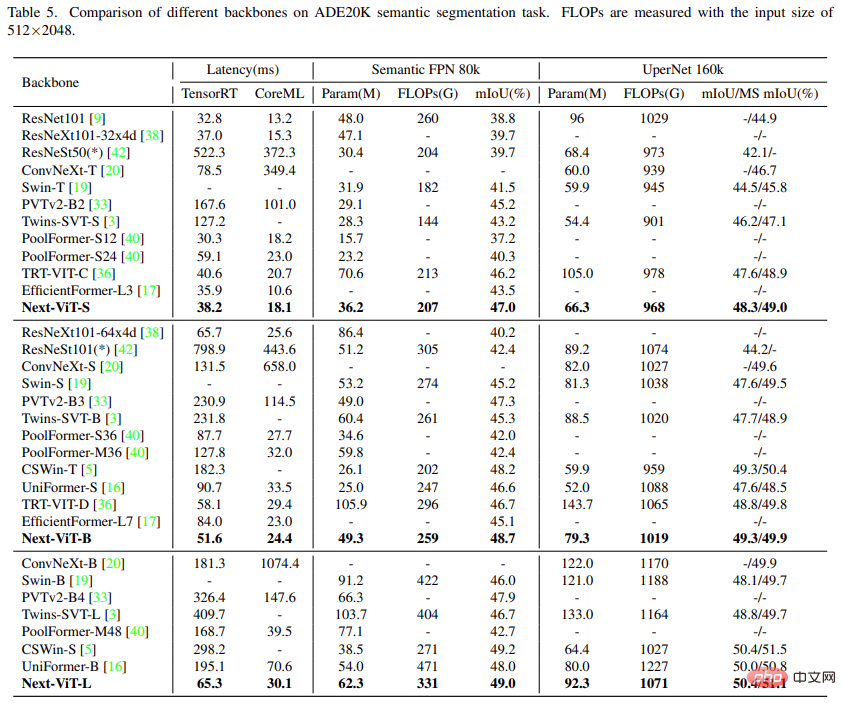

この研究では、Next-ViT と CNN を組み合わせています。 ViT といくつかの最近のハイブリッド アーキテクチャが、セマンティック セグメンテーション タスクに関して比較されます。以下の表 5 に示すように、広範な実験により、Next-ViT がセグメンテーション タスクにおいて優れた可能性を秘めていることが示されています。

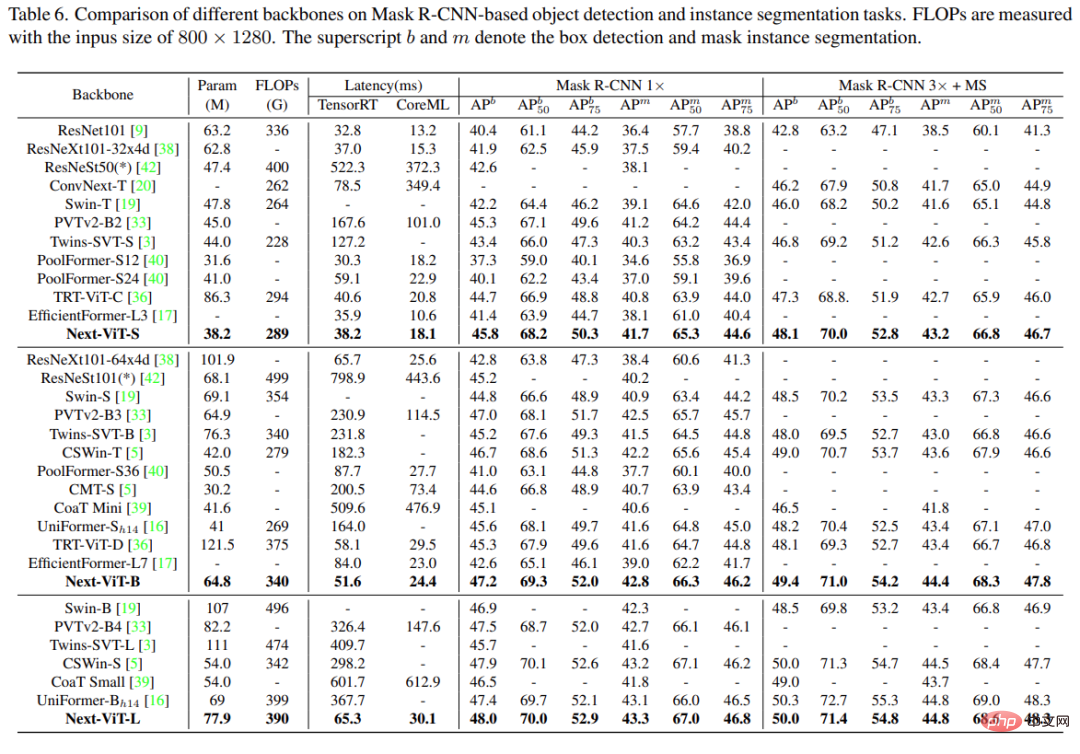

#オブジェクト検出とインスタンス セグメンテーション

アブレーション実験と視覚化

アブレーション実験と視覚化

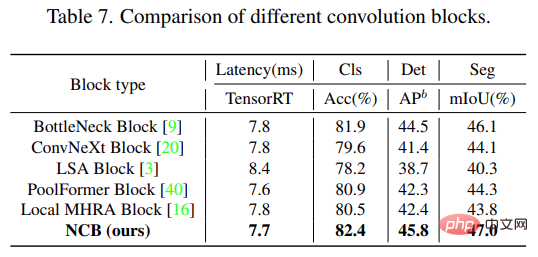

以下の表 7 に示すように、NCB は 3 つのタスクすべてで最適な遅延と精度のトレードオフを実現しています。

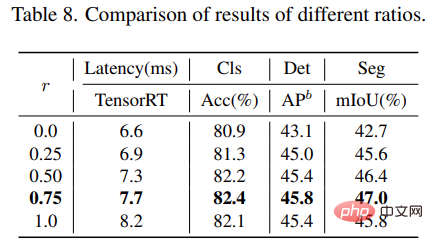

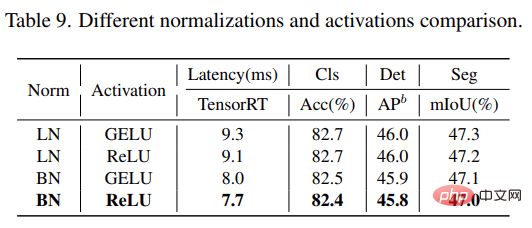

さらに、r = 0.75 および r = 0.5 のモデルは、純粋な Transformer (r = 1) を備えたモデルよりも優れたパフォーマンスを示します。 )。これは、複数周波数信号を適切な方法で融合すると、モデルの表現学習能力が強化されることを示しています。特に、r = 0.75 のモデルは、レイテンシと精度の最適なトレードオフを実現します。これらの結果は、NTB ブロックの有効性を示しています。 この研究では、Next-ViT のさまざまな正規化層と活性化関数の影響をさらに分析します。以下の表 9 に示すように、LN と GELU はパフォーマンスの向上をもたらしますが、TensorRT の推論レイテンシは大幅に高くなります。一方、BN と ReLU は、タスク全体で最適なレイテンシと精度のトレードオフを実現します。したがって、Next-ViT は BN と ReLU を均一に使用して、実際の産業シナリオでの効率的な展開を実現します。

以上がCNN と Transformer の正しい組み合わせを解き放ち、ByteDance は効果的な次世代ビジュアル Transformer を提案しますの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7524

7524

15

15

1378

1378

52

52

81

81

11

11

21

21

74

74

Bytedance Cutting が SVIP スーパー メンバーシップを開始: 継続的な年間サブスクリプションは 499 元で、さまざまな AI 機能を提供

Jun 28, 2024 am 03:51 AM

Bytedance Cutting が SVIP スーパー メンバーシップを開始: 継続的な年間サブスクリプションは 499 元で、さまざまな AI 機能を提供

Jun 28, 2024 am 03:51 AM

このサイトは6月27日、JianyingはByteDanceの子会社であるFaceMeng Technologyによって開発されたビデオ編集ソフトウェアであり、Douyinプラットフォームに依存しており、基本的にプラットフォームのユーザー向けに短いビデオコンテンツを作成すると報告しました。 Windows、MacOS、その他のオペレーティング システム。 Jianyingは会員システムのアップグレードを正式に発表し、インテリジェント翻訳、インテリジェントハイライト、インテリジェントパッケージング、デジタルヒューマン合成などのさまざまなAIブラックテクノロジーを含む新しいSVIPを開始しました。価格的には、クリッピングSVIPの月額料金は79元、年会費は599元(当サイト注:月額49.9元に相当)、継続月額サブスクリプションは月額59元、継続年間サブスクリプションは、年間499元(月額41.6元に相当)です。さらに、カット担当者は、ユーザーエクスペリエンスを向上させるために、オリジナルのVIPに登録している人は、

Rag と Sem-Rag を使用したコンテキスト拡張 AI コーディング アシスタント

Jun 10, 2024 am 11:08 AM

Rag と Sem-Rag を使用したコンテキスト拡張 AI コーディング アシスタント

Jun 10, 2024 am 11:08 AM

検索強化生成およびセマンティック メモリを AI コーディング アシスタントに組み込むことで、開発者の生産性、効率、精度を向上させます。 JanakiramMSV 著者の EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG から翻訳。基本的な AI プログラミング アシスタントは当然役に立ちますが、ソフトウェア言語とソフトウェア作成の最も一般的なパターンに関する一般的な理解に依存しているため、最も適切で正しいコードの提案を提供できないことがよくあります。これらのコーディング アシスタントによって生成されたコードは、彼らが解決する責任を負っている問題の解決には適していますが、多くの場合、個々のチームのコーディング標準、規約、スタイルには準拠していません。これにより、コードがアプリケーションに受け入れられるように修正または調整する必要がある提案が得られることがよくあります。

微調整によって本当に LLM が新しいことを学習できるようになるのでしょうか: 新しい知識を導入すると、モデルがより多くの幻覚を生成する可能性があります

Jun 11, 2024 pm 03:57 PM

微調整によって本当に LLM が新しいことを学習できるようになるのでしょうか: 新しい知識を導入すると、モデルがより多くの幻覚を生成する可能性があります

Jun 11, 2024 pm 03:57 PM

大規模言語モデル (LLM) は巨大なテキスト データベースでトレーニングされ、そこで大量の現実世界の知識を取得します。この知識はパラメータに組み込まれており、必要なときに使用できます。これらのモデルの知識は、トレーニングの終了時に「具体化」されます。事前トレーニングの終了時に、モデルは実際に学習を停止します。モデルを調整または微調整して、この知識を活用し、ユーザーの質問により自然に応答する方法を学びます。ただし、モデルの知識だけでは不十分な場合があり、モデルは RAG を通じて外部コンテンツにアクセスできますが、微調整を通じてモデルを新しいドメインに適応させることが有益であると考えられます。この微調整は、ヒューマン アノテーターまたは他の LLM 作成物からの入力を使用して実行され、モデルは追加の実世界の知識に遭遇し、それを統合します。

OpenAI データは必要ありません。大規模なコード モデルのリストに加わりましょう。 UIUC が StarCoder-15B-Instruct をリリース

Jun 13, 2024 pm 01:59 PM

OpenAI データは必要ありません。大規模なコード モデルのリストに加わりましょう。 UIUC が StarCoder-15B-Instruct をリリース

Jun 13, 2024 pm 01:59 PM

ソフトウェア テクノロジの最前線に立つ UIUC Zhang Lingming のグループは、BigCode 組織の研究者とともに、最近 StarCoder2-15B-Instruct 大規模コード モデルを発表しました。この革新的な成果により、コード生成タスクにおいて大きな進歩が達成され、CodeLlama-70B-Instruct を上回り、コード生成パフォーマンス リストのトップに到達しました。 StarCoder2-15B-Instruct のユニークな特徴は、その純粋な自己調整戦略であり、トレーニング プロセス全体がオープンで透過的で、完全に自律的で制御可能です。このモデルは、高価な手動アノテーションに頼ることなく、StarCoder-15B 基本モデルの微調整に応じて、StarCoder2-15B を介して数千の命令を生成します。

新しい科学的で複雑な質問応答ベンチマークと大規模モデルの評価システムを提供するために、UNSW、アルゴンヌ、シカゴ大学、およびその他の機関が共同で SciQAG フレームワークを立ち上げました。

Jul 25, 2024 am 06:42 AM

新しい科学的で複雑な質問応答ベンチマークと大規模モデルの評価システムを提供するために、UNSW、アルゴンヌ、シカゴ大学、およびその他の機関が共同で SciQAG フレームワークを立ち上げました。

Jul 25, 2024 am 06:42 AM

編集者 |ScienceAI 質問応答 (QA) データセットは、自然言語処理 (NLP) 研究を促進する上で重要な役割を果たします。高品質の QA データ セットは、モデルの微調整に使用できるだけでなく、大規模言語モデル (LLM) の機能、特に科学的知識を理解し推論する能力を効果的に評価することもできます。現在、医学、化学、生物学、その他の分野をカバーする多くの科学 QA データ セットがありますが、これらのデータ セットにはまだいくつかの欠点があります。まず、データ形式は比較的単純で、そのほとんどが多肢選択式の質問であり、評価は簡単ですが、モデルの回答選択範囲が制限され、科学的な質問に回答するモデルの能力を完全にテストすることはできません。対照的に、自由回答型の Q&A

Yolov10: 詳細な説明、展開、アプリケーションがすべて 1 か所にまとめられています。

Jun 07, 2024 pm 12:05 PM

Yolov10: 詳細な説明、展開、アプリケーションがすべて 1 か所にまとめられています。

Jun 07, 2024 pm 12:05 PM

1. はじめに ここ数年、YOLO は、計算コストと検出パフォーマンスの効果的なバランスにより、リアルタイム物体検出の分野で主流のパラダイムとなっています。研究者たちは、YOLO のアーキテクチャ設計、最適化目標、データ拡張戦略などを調査し、大きな進歩を遂げました。同時に、後処理に非最大抑制 (NMS) に依存すると、YOLO のエンドツーエンドの展開が妨げられ、推論レイテンシに悪影響を及ぼします。 YOLO では、さまざまなコンポーネントの設計に包括的かつ徹底的な検査が欠けており、その結果、大幅な計算冗長性が生じ、モデルの機能が制限されます。効率は最適ではありませんが、パフォーマンス向上の可能性は比較的大きくなります。この作業の目標は、後処理とモデル アーキテクチャの両方から YOLO のパフォーマンス効率の境界をさらに改善することです。この目的を達成するために

SOTA パフォーマンス、厦門マルチモーダルタンパク質-リガンド親和性予測 AI 手法、初めて分子表面情報を結合

Jul 17, 2024 pm 06:37 PM

SOTA パフォーマンス、厦門マルチモーダルタンパク質-リガンド親和性予測 AI 手法、初めて分子表面情報を結合

Jul 17, 2024 pm 06:37 PM

編集者 | KX 医薬品の研究開発の分野では、タンパク質とリガンドの結合親和性を正確かつ効果的に予測することが、医薬品のスクリーニングと最適化にとって重要です。しかし、現在の研究では、タンパク質とリガンドの相互作用における分子表面情報の重要な役割が考慮されていません。これに基づいて、アモイ大学の研究者らは、初めてタンパク質の表面、3D 構造、配列に関する情報を組み合わせ、クロスアテンション メカニズムを使用して異なるモダリティの特徴を比較する、新しいマルチモーダル特徴抽出 (MFE) フレームワークを提案しました。アライメント。実験結果は、この方法がタンパク質-リガンド結合親和性の予測において最先端の性能を達成することを実証しています。さらに、アブレーション研究は、この枠組み内でのタンパク質表面情報と多峰性特徴の位置合わせの有効性と必要性を実証しています。 「S」で始まる関連研究

SKハイニックスは8月6日に12層HBM3E、321層NANDなどのAI関連新製品を展示する。

Aug 01, 2024 pm 09:40 PM

SKハイニックスは8月6日に12層HBM3E、321層NANDなどのAI関連新製品を展示する。

Aug 01, 2024 pm 09:40 PM

8月1日の本サイトのニュースによると、SKハイニックスは本日(8月1日)ブログ投稿を発表し、8月6日から8日まで米国カリフォルニア州サンタクララで開催されるグローバル半導体メモリサミットFMS2024に参加すると発表し、多くの新世代の製品。フューチャー メモリおよびストレージ サミット (FutureMemoryandStorage) の紹介。以前は主に NAND サプライヤー向けのフラッシュ メモリ サミット (FlashMemorySummit) でしたが、人工知能技術への注目の高まりを背景に、今年はフューチャー メモリおよびストレージ サミット (FutureMemoryandStorage) に名前が変更されました。 DRAM およびストレージ ベンダー、さらに多くのプレーヤーを招待します。昨年発売された新製品SKハイニックス