Meta のリアルなデジタル ヒューマン 2.0 が再び進化し、iPhone で生成できるようになりました。携帯電話を取り出してスキャンするだけです。

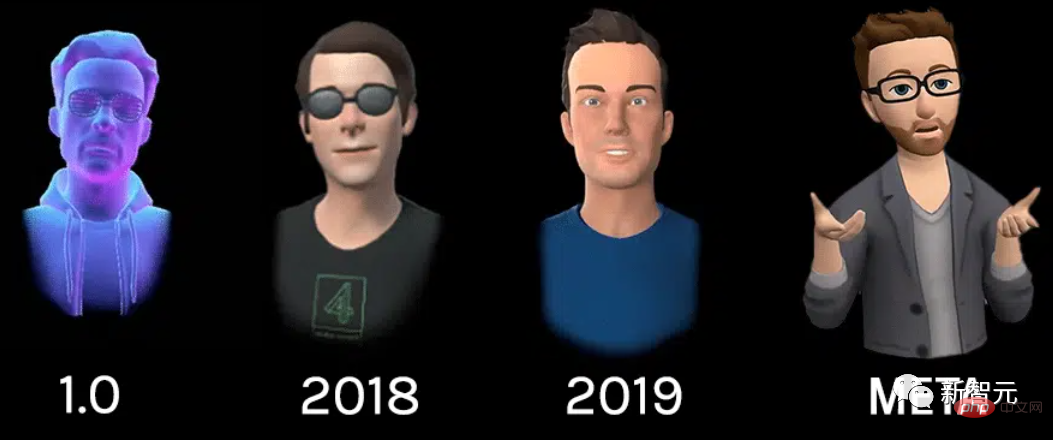

2019 年 3 月の初めに、Facebook はイベントで第 1 世代のデジタル ヒューマン イメージ (Codec Avatar 1.0) をデモンストレーションしました。第一世代のデジタル ヒューマンは、複数のニューラル ネットワークを使用した 132 台のカメラを備えた専用のキャプチャ リグを使用して生成されました。

生成されると、VR ヘッドセット デバイスに 5 台のカメラが追加されます。それぞれの目には、顔の下に 2 つの内部ビューと 3 つの外部ビューが表示されます。以下のように。

#それ以来、Facebook はこれらのアバターのリアリズムを改善し続けてきました。たとえば、必要なのはマイクとマイクだけです。 eyeballs トラッキング技術を使用すると、よりリアルな画像を取得できます。 2020 年 8 月に、ついに Codec Avatar バージョン 2.0 に進化しました。バージョン 2.0 のバージョン 1.0 に対する最大の改善点は、カメラが顔をスキャンして追跡する必要がなくなり、目の動きを追跡するだけでよいことです。

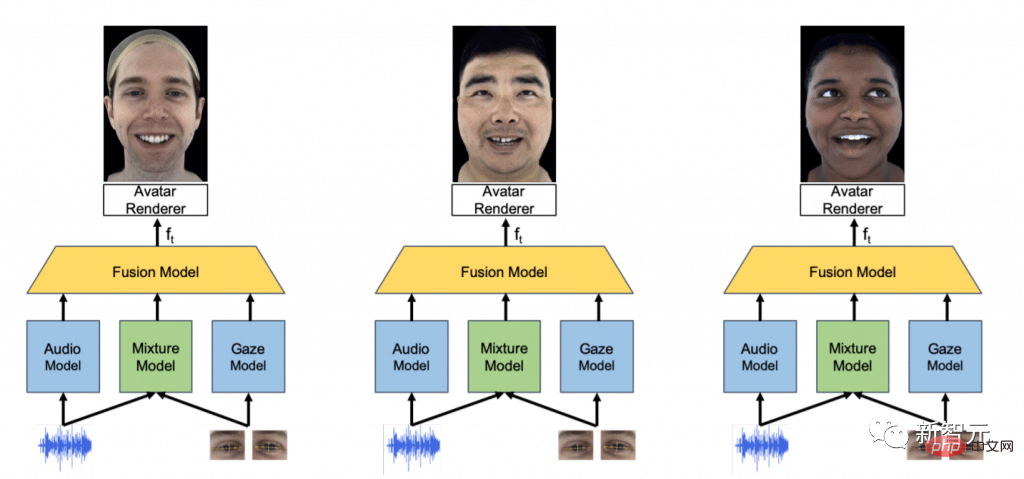

新しいニューラル ネットワークは、VR ヘッドセットからの視線追跡データとマイクからの音声フィードを融合し、着用の可能性のある顔の表情を推測します。音声モデルと眼球運動モデルのデータはハイブリッドモデルにフィードバックされ、フュージョンモデルによる計算・処理を経てレンダラーからアバター画像が出力されます。

今年 5 月、チームはさらに、アバターのバージョン 2.0 が完全にバージョンアップされたことを発表しました。 「完全にリアル」な効果を実現しました。 「今後 10 年間の大きな課題の 1 つは、対面のインタラクションと区別できないリモート アバター インタラクションを実現できるかどうかだと思います」とプロジェクト リーダーの 1 人であるシェイク氏は述べています。

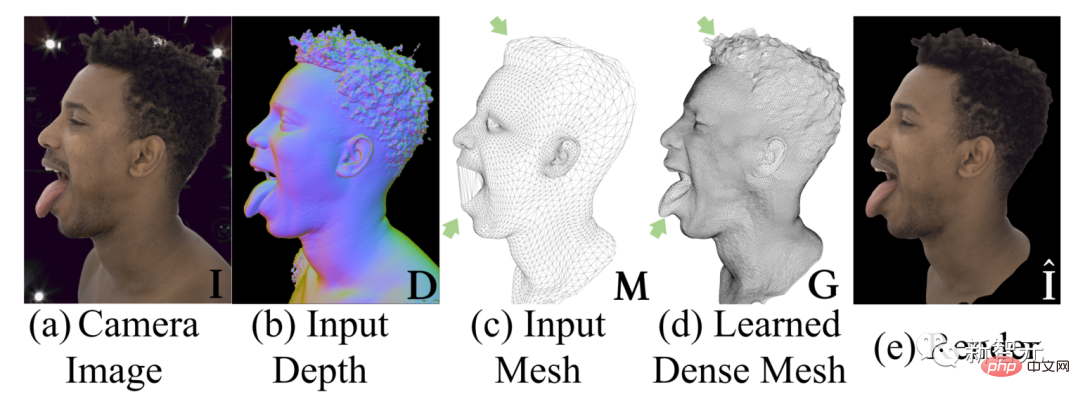

上の比較を見てください。a は実際の写真、e は最終的なレンダリングです。仮想の人はあまり自慢していないようですか?上記は実験での比較結果であり、実際の応用シナリオでは現状のメタ仮想人間のイメージはこのようになるのでご安心ください。

右端の「最も現実的な」画像であっても、依然として漫画の画像です。これは真実からはほど遠いです。「完全に本物そっくり」というのは、まだ少し先の話でしょうが、Meta は 10 年くらいかかると言っています。デモの画像を見ると、この目標が達成できるという期待はまだたくさんあります。

また、バーチャルヒューマン技術の進歩はリアリズムの方向に反映されるだけでなく、一つの道を歩み続ける必要はなく、メタは別の方向にも挑戦しています。たとえば、VR ヘッドセットを外しますか?

これまで、別個のコーデック アバターを生成するには、171 台の高解像度カメラを備えた「MUGSY」と呼ばれる特別なキャプチャ デバイスが必要でした。上の写真の1つ(秘密は後退するのを恐れています)。

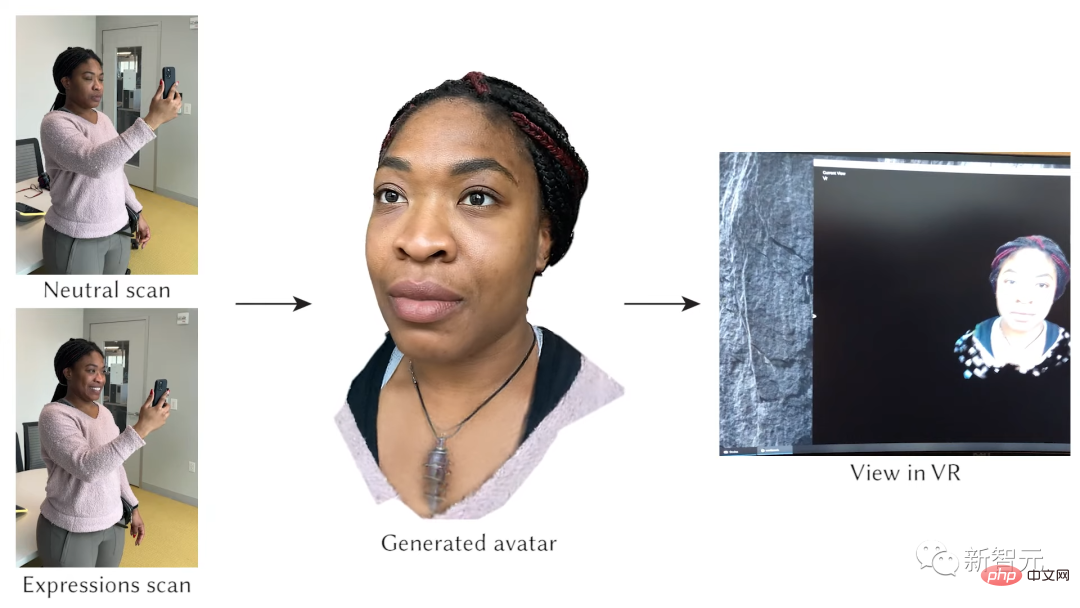

メタは今、これを持っていく必要はない、iPhone さえあればいいと言っています。正面に深度センサーを搭載したスマートフォン(FaceID機能を搭載したiPhoneなど)で直接スキャン(正確には数十回)できれば、リアルな仮想人間アバターを生成できます。

まず顔を無表情にして、一度スキャンしてからさまざまな表情を作ります。最大 65 種類の表情がサポートされています。

Meta 氏によると、携帯電話で表情スキャンを完了するには平均して 3 ~ 4 分ほどかかります。もちろん、これにはコンピューティング能力のサポートが必要で、最終的に生成されるリアルな仮想人間アバターは、4 つのハイエンド GPU を搭載したマシンで約 6 時間かかります。もちろん、このテクノロジーが製品に使用される場合、これらの計算はユーザー独自のコンピューティング リソースなしでクラウド GPU に引き渡されます。

では、なぜ、以前は 100 台のカメラが必要だったことが、たった 1 台の携帯電話でできるのでしょうか?その秘密はハイパーネットワークと呼ばれる汎用モデルです。これは、別のニューラル ネットワークの重みを生成するニューラル ネットワークです。上記の例では、特定の人物のコーデック アバターを生成することになります。このモデルは、MUGSY によく似た高度なキャプチャ デバイスを使用して、255 の異なる顔をスキャンすることによってトレーニングされましたが、カメラの数はわずか 90 台でした。

他の研究者はスマートフォンでスキャンして生成されたポートレートを実証しており、メタ氏は生成された結果は SOTA レベルであると述べました。  しかし、現在のシステムではメガネと長髪にはまだ対応できません。そして、それは頭にのみ到達でき、体の他の部分には到達できません。

しかし、現在のシステムではメガネと長髪にはまだ対応できません。そして、それは頭にのみ到達でき、体の他の部分には到達できません。

もちろん、Meta がこのレベルの忠実度に到達するまでには、まだ長い道のりがあります。メタのポートレートが漫画風になりました。そして、その現実感は時間の経過とともに徐々に減少していきました。この画像は、Quest 2 を使用して Horizon Worlds をプレイする人に適しているかもしれません。

ただし、コーデック アバターは現在ではなく別のオプションになる可能性があります この漫画のスタイルアップグレードします。 Meta の CEO、ザッカーバーグは未来を次のように説明しました。普通のゲームをプレイするために表現主義的なポートレートを使用し、仕事の会議に参加するためにより現実的なポートレートを使用することができます。

今年 4 月、コーデック アバター チームの責任者であるヤセル シェイク氏は、「コーデック アバターの開発にどれくらいの時間がかかるかを予測することは不可能です」と述べました。しかし、彼は、プロジェクトが大きな進歩を遂げたと信じていることを明らかにしました。

以上がメタデジタル第二世代の登場です! VR ヘッドセットに別れを告げましょう。iPhone でスワイプするだけですの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。