リオーダリングRPTQに基づく新しい量子化手法:大規模言語モデルの3ビット量子化を実現

大規模言語モデル (LLM) は、さまざまなタスクで良好に機能しますが、モデルのサイズが非常に大きいため、展開に課題が生じます。

この論文では、Humo Intelligence、Tencent AI Lab、華中科技大学、北京大学、イリノイ工科大学の研究者が、大規模な言語モデルを定量化することが主な課題であることを発見しました。これは、単なる外れ値の問題ではなく、チャネル間のアクティベーション範囲の違いに起因します。

著者は、大規模な言語モデルのアクティベーションを定量化する問題を解決する、新しい再ランキングベースの量子化手法 RPTQ を提案します。 RPTQ は、アクティブ化時にチャネルを再配置し、定量化するためにそれらをクラスタリングすることにより、チャネル全体の差異の影響を軽減します。

さらに、著者らは、明示的な並べ替えを避けることで、ストレージと計算のオーバーヘッドを削減しています。この研究は、LLM モデルのアクティベーション量子化を 3 ビットに押し上げる最初の作業です。アクティベーション値の 3 ビット量子化は、重みの 3 ビット量子化と併用することもできるため、大規模な音声モデルのオーバーヘッドが大幅に削減されます。

紙のアドレス: https://arxiv.org/abs/2304.01089

オープンソース アドレス: https://github.com/hahnyuan/RPTQ4LLM

大規模言語モデル (LLM) はさまざまな分野で広く使用されているこのタスクでは優れたパフォーマンスが実証されていますが、モデルのサイズが巨大であるため、その導入は課題に直面しています。たとえば、66B モデルには 660 億個のパラメータが含まれており、保存するために大量のメモリが必要です。さらに、シーケンス長とバッチサイズが増加するにつれて、Self-attention のキーと値のキャッシュ (Key/Value Cache) など、アクティブ化によって大量のメモリも消費されるため、メモリ消費の問題はさらに深刻になります。ただし、単一の GPU またはサーバーには、このような多数のモデルの重みと中間アクティベーションを保存するのに十分なメモリ容量がありません。したがって、LLM を複数のチャンクに分割し、異なるデバイスに保存する必要があります。重みとアクティベーションは異なるデバイスに保存されるため、計算中にこれらのデバイス間でデータを転送する必要があり、その結果、帯域幅とエネルギーが大幅に消費されます。

LLM のモデル スケーリングの課題を克服するために、モデルの定量化が有望なアプローチとして浮上しています。この手法には、低ビット整数を使用して LLM の重みとアクティベーションを量子化することが含まれており、これにより、これらのモデルの保存と実行のコストが大幅に削減されます。具体的には、量子化により、テンソルを保持するためのメモリ要件が軽減され、行列の乗算や線形層などの計算量の多い演算が高速化されます。重みとアクティベーションを量子化することにより、ストレージと通信のオーバーヘッドが削減され、効率と推論速度が向上します。

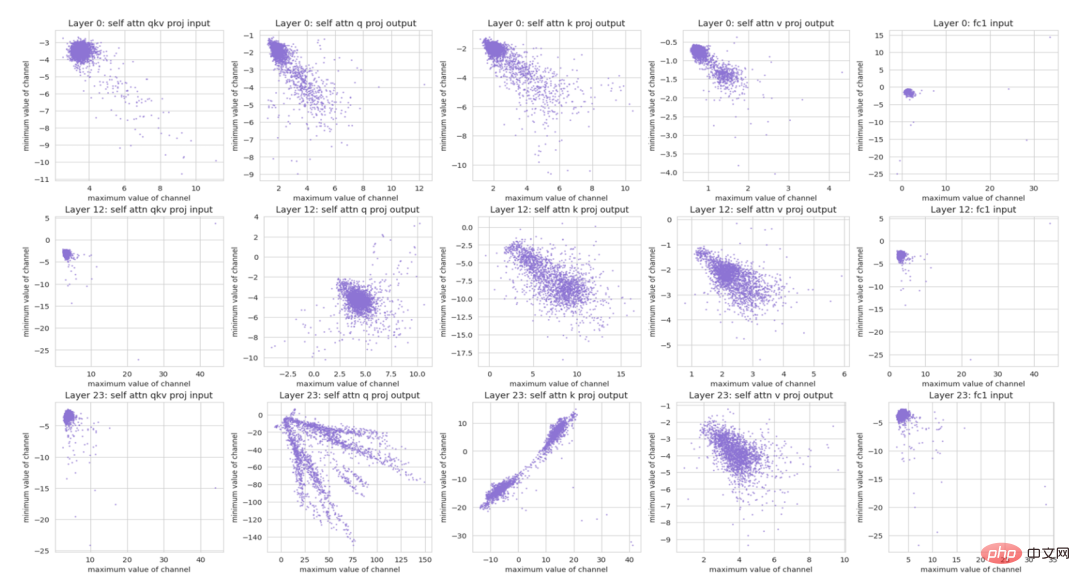

#図 1 さまざまなチャネルの数値分布。各点は、アクティベーション チャネルの (最大、最小) 値を表します。

最近、GPTQ は PTQ を使用して LLM の重みを 4 ビットまたは 3 ビットに量子化することに成功しました。ただし、LLM の活性化を定量化することは依然として困難な作業です。図 1 から 2 つの観察ができます:

1) 一部のチャネルには、最大値または最小値を持つ重大な外れ値があります。値は数百です。他のチャンネルよりも数倍大きい。以前の研究でもこの問題が発見され、外れ値に対する特別な処理が提案されています。

2) チャネルが異なると、数値範囲に大きな違いがあります。同じ量子化パラメータを使用して異なるチャネルを量子化すると、重大な量子化エラーが発生する可能性があります。 2 つのチャネルの外れ値の絶対値が同じであっても、数値範囲に大きなばらつきがある可能性があります。

同じ量子化パラメータを使用してテンソル全体を量子化するテンソルごとの量子化手法は、効率が低い可能性があります。その理由は、広い範囲の値をカバーするように量子化範囲を設定すると、より小さい値のチャネルで大きな量子化誤差が発生する可能性があり、一方、狭い範囲の値をカバーするように設定すると、外れ値が大幅に切り捨てられ、結果が大きくなる可能性があるためです。重大な量子化エラー。たとえば、あるチャネルの値の範囲は -100 ~ -50 であり、別のチャネルの値の範囲は 80 ~ 100 である場合があります。 -100 から 100 までの範囲を量子化してその範囲をカバーしようとすると、両方のチャネルで重大な量子化エラーが発生します。これは、これまでの研究では効果的に対処されていない課題です。

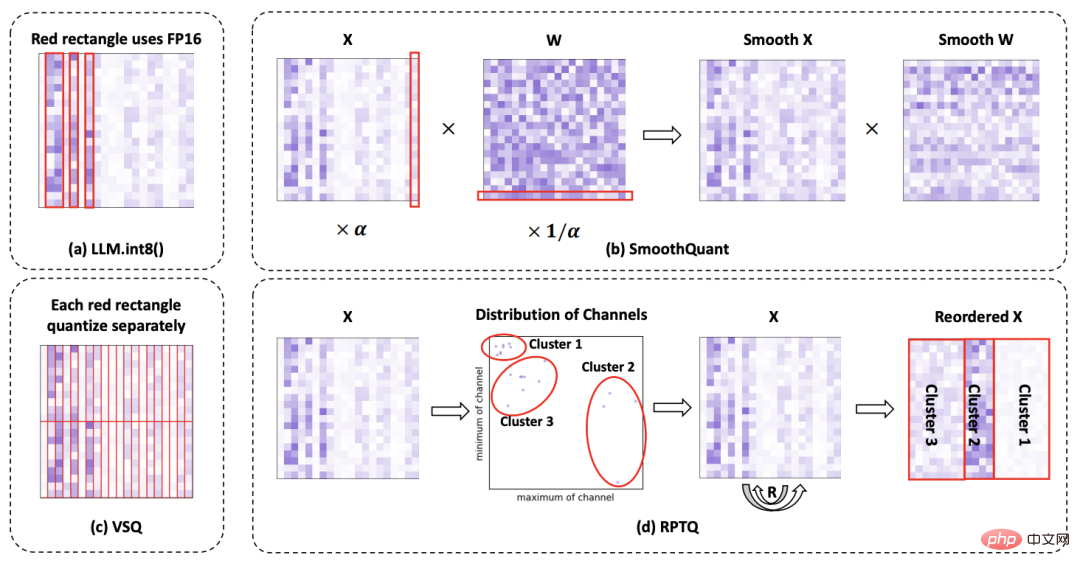

# 図 2 活性化量子化問題を解決するためのさまざまな方法の比較。

活性化におけるチャネルの違いの問題を解決するために、著者らは並べ替えベースの新しいポストトレーニング量子化手法 RPTQ を提案します。

図 2 に示すように、この方法では、同様の数値範囲を持つチャネルをクラスター化し、同じ量子化パラメーターを使用して各クラスターの値を量子化します。再ランキングベースの定量化手法を実装するために、著者らはまず、推論入力として校正データセットを使用し、そこから各活性化チャネルの最大値と最小値を導き出しました。

次に、KMeans アルゴリズムを使用して、各チャネルの最大値と最小値によって形成される点に基づいて、さまざまなチャネルを g 個のクラスターに分割しました。クラスタが確立されると、チャネルの並べ替えが実行され、同じクラスタのチャネルが近接して配置されます。このようにして、同様の最大値と最小値を持つチャネルがグループ化され、量子化パラメータの共通セットを共有します。並べ替えプロセスの後、著者らは各クラスター内の活性化を定量化しました。この方法では、量子化パラメータ (スケーリング係数 s およびゼロ点 z) がクラスタごとに個別に計算され、これらのパラメータが対応するチャネルに固有であることが保証されます。

最終的に、この方法により、各クラスターの量子化が最適化され、量子化エラーが減少します。

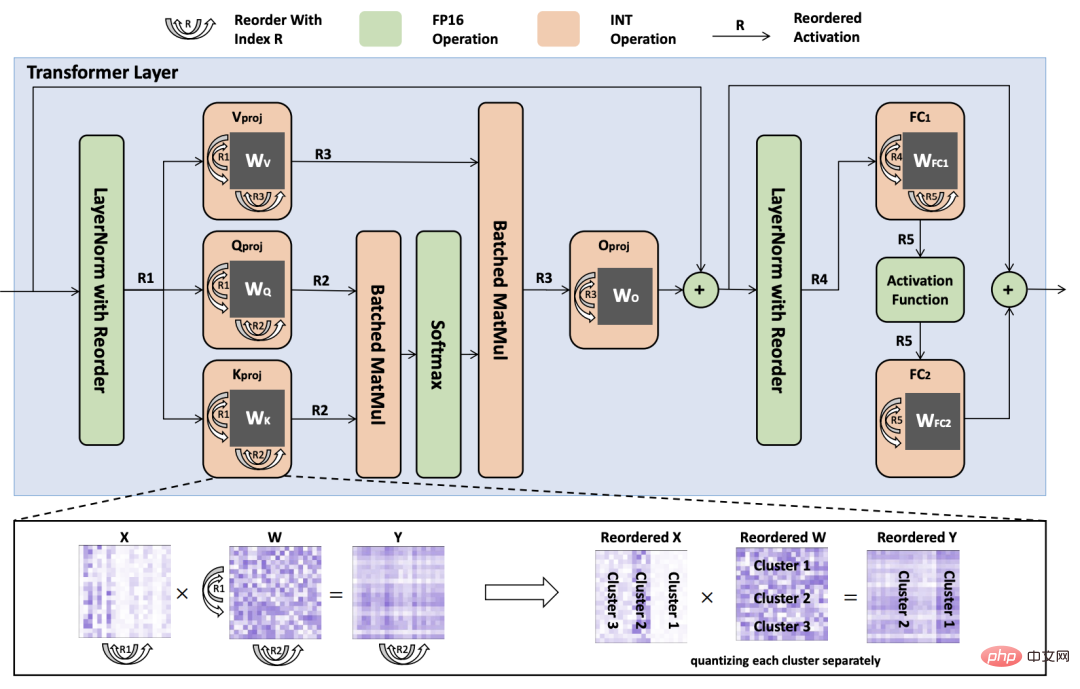

図 3: 重みとアクティベーションが再配置された量子化された Transformer 層の推論プロセスの失敗図。並べ替えインデックスは記号 R1 ~ R5 で表されます。

明示的な再配置は、アクティブなチャネルを再配置する実行時操作であり、異なるチャネルのデータをあるメモリ位置から別のメモリ位置に物理的に移動する必要があるため、大規模なモデルの場合は、チャンネルの数が多いと、再配置プロセスに非常に時間がかかる場合があります。さらに、ソースとターゲットのアクティベーション テンソルを保存すると、メモリのオーバーヘッドが増加します。したがって、著者らは、明示的な並べ替えを回避し、それによって計算オーバーヘッドを削減し、推論効率を向上させる戦略を提案しています。

図 3 に示すように、作成者は線形層の重みを並べ替えて、ソートされた順序で直接アクティベーションを生成します。さらに、著者らは、並べ替えられたアクティベーションを直接生成するように LayerNorm のメソッドを変更し、推論中の明示的なチャネル調整の必要性を排除しました。

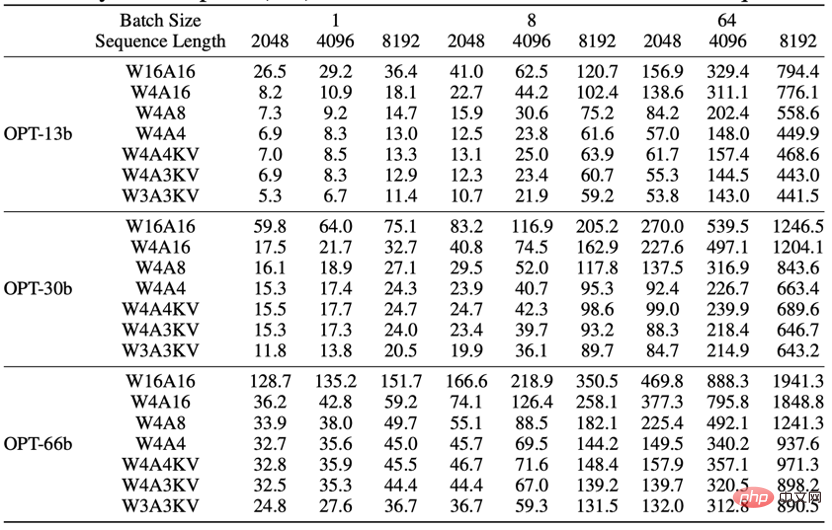

LLM のメモリ オーバーヘッドは 3 つの側面から生じます。 まず、量子化によってデバイス メモリ内の重みの保存を大幅に削減できます。第 2 に、ネットワークの実行中に生成される一時的なアクティベーションには、デバイス メモリの割り当てが必要です。これらの一時的なアクティベーションは使用後に解放できるため、全体的なメモリ使用量に大きな影響を与えることはありません。最後に、後続の単語を予測するにはキー/値キャッシュが必要です。バッチ サイズとシーケンスの長さが大きい場合、キーと値のキャッシュがメモリの大部分を占有します。

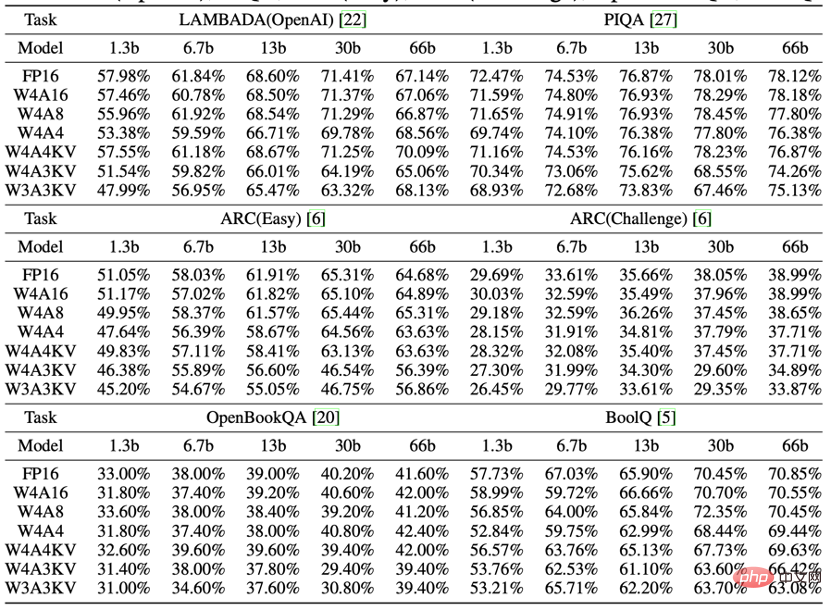

この表は、さまざまな設定でのメモリ使用量を示しています。特にバッチ サイズとシーケンス長が大きい場合、より低いビットをアクティブにするとメモリ使用量が大幅に削減できることがわかります。具体的には、バッチ サイズが 64、シーケンス長が 8192 の場合、OPT-66b に基づく W4A4 構成は、W4A16 構成と比較して 900GB 以上のメモリを節約します。したがって、RPTQ を使用してアクティベーションを定量化すると、長いテキスト タスクや大量のシナリオでのメモリ負荷を大幅に軽減できます。

以上がリオーダリングRPTQに基づく新しい量子化手法:大規模言語モデルの3ビット量子化を実現の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7491

7491

15

15

1377

1377

52

52

77

77

11

11

19

19

41

41

世界で最も強力なオープンソース MoE モデルが登場。GPT-4 に匹敵する中国語機能を備え、価格は GPT-4-Turbo のわずか 1% 近くです

May 07, 2024 pm 04:13 PM

世界で最も強力なオープンソース MoE モデルが登場。GPT-4 に匹敵する中国語機能を備え、価格は GPT-4-Turbo のわずか 1% 近くです

May 07, 2024 pm 04:13 PM

従来のコンピューティングを超える能力を備えているだけでなく、より低コストでより効率的なパフォーマンスを実現する人工知能モデルを想像してみてください。これは SF ではありません。世界で最も強力なオープンソース MoE モデルである DeepSeek-V2[1] が登場しました。 DeepSeek-V2 は、経済的なトレーニングと効率的な推論の特徴を備えた強力な専門家混合 (MoE) 言語モデルです。これは 236B のパラメータで構成されており、そのうち 21B は各マーカーをアクティブにするために使用されます。 DeepSeek67B と比較して、DeepSeek-V2 はパフォーマンスが優れていると同時に、トレーニング コストを 42.5% 節約し、KV キャッシュを 93.3% 削減し、最大生成スループットを 5.76 倍に高めます。 DeepSeek は一般的な人工知能を研究する会社です

AI が数学研究を破壊する!フィールズ賞受賞者で中国系アメリカ人の数学者が上位 11 件の論文を主導 | テレンス・タオが「いいね!」しました

Apr 09, 2024 am 11:52 AM

AI が数学研究を破壊する!フィールズ賞受賞者で中国系アメリカ人の数学者が上位 11 件の論文を主導 | テレンス・タオが「いいね!」しました

Apr 09, 2024 am 11:52 AM

AI は確かに数学を変えつつあります。最近、この問題に細心の注意を払っている陶哲軒氏が『米国数学協会会報』(米国数学協会会報)の最新号を送ってくれた。 「機械は数学を変えるのか?」というテーマを中心に、多くの数学者が意見を述べ、そのプロセス全体は火花に満ち、ハードコアで刺激的でした。著者には、フィールズ賞受賞者のアクシャイ・ベンカテシュ氏、中国の数学者鄭楽軍氏、ニューヨーク大学のコンピューター科学者アーネスト・デイビス氏、その他業界で著名な学者を含む強力な顔ぶれが揃っている。 AI の世界は劇的に変化しています。これらの記事の多くは 1 年前に投稿されたものです。

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas は正式に電動ロボットの時代に突入します!昨日、油圧式アトラスが歴史の舞台から「涙ながらに」撤退したばかりですが、今日、ボストン・ダイナミクスは電動式アトラスが稼働することを発表しました。ボストン・ダイナミクス社は商用人型ロボットの分野でテスラ社と競争する決意を持っているようだ。新しいビデオが公開されてから、わずか 10 時間ですでに 100 万人以上が視聴しました。古い人が去り、新しい役割が現れるのは歴史的な必然です。今年が人型ロボットの爆発的な年であることは間違いありません。ネットユーザーは「ロボットの進歩により、今年の開会式は人間のように見え、人間よりもはるかに自由度が高い。しかし、これは本当にホラー映画ではないのか?」とコメントした。ビデオの冒頭では、アトラスは仰向けに見えるように地面に静かに横たわっています。次に続くのは驚くべきことです

MLP に代わる KAN は、オープンソース プロジェクトによって畳み込みまで拡張されました

Jun 01, 2024 pm 10:03 PM

MLP に代わる KAN は、オープンソース プロジェクトによって畳み込みまで拡張されました

Jun 01, 2024 pm 10:03 PM

今月初め、MIT やその他の機関の研究者らは、MLP に代わる非常に有望な代替案である KAN を提案しました。 KAN は、精度と解釈可能性の点で MLP よりも優れています。また、非常に少数のパラメーターを使用して、多数のパラメーターを使用して実行する MLP よりも優れたパフォーマンスを発揮できます。たとえば、著者らは、KAN を使用して、より小規模なネットワークと高度な自動化で DeepMind の結果を再現したと述べています。具体的には、DeepMind の MLP には約 300,000 個のパラメーターがありますが、KAN には約 200 個のパラメーターしかありません。 KAN は、MLP が普遍近似定理に基づいているのに対し、KAN はコルモゴロフ-アーノルド表現定理に基づいているのと同様に、強力な数学的基礎を持っています。以下の図に示すように、KAN は

Google は大喜び: JAX のパフォーマンスが Pytorch や TensorFlow を上回りました! GPU 推論トレーニングの最速の選択肢となる可能性があります

Apr 01, 2024 pm 07:46 PM

Google は大喜び: JAX のパフォーマンスが Pytorch や TensorFlow を上回りました! GPU 推論トレーニングの最速の選択肢となる可能性があります

Apr 01, 2024 pm 07:46 PM

Google が推進する JAX のパフォーマンスは、最近のベンチマーク テストで Pytorch や TensorFlow のパフォーマンスを上回り、7 つの指標で 1 位にランクされました。また、テストは最高の JAX パフォーマンスを備えた TPU では行われませんでした。ただし、開発者の間では、依然として Tensorflow よりも Pytorch の方が人気があります。しかし、将来的には、おそらくより大規模なモデルが JAX プラットフォームに基づいてトレーニングされ、実行されるようになるでしょう。モデル 最近、Keras チームは、ネイティブ PyTorch 実装を使用して 3 つのバックエンド (TensorFlow、JAX、PyTorch) をベンチマークし、TensorFlow を使用して Keras2 をベンチマークしました。まず、主流のセットを選択します

テスラのロボットは工場で働く、マスク氏:手の自由度は今年22に達する!

May 06, 2024 pm 04:13 PM

テスラのロボットは工場で働く、マスク氏:手の自由度は今年22に達する!

May 06, 2024 pm 04:13 PM

テスラのロボット「オプティマス」の最新映像が公開され、すでに工場内で稼働可能となっている。通常の速度では、バッテリー(テスラの4680バッテリー)を次のように分類します:公式は、20倍の速度でどのように見えるかも公開しました - 小さな「ワークステーション」上で、ピッキング、ピッキング、ピッキング:今回は、それがリリースされたハイライトの1つビデオの内容は、オプティマスが工場内でこの作業を完全に自律的に行い、プロセス全体を通じて人間の介入なしに完了するというものです。そして、オプティマスの観点から見ると、自動エラー修正に重点を置いて、曲がったバッテリーを拾い上げたり配置したりすることもできます。オプティマスのハンドについては、NVIDIA の科学者ジム ファン氏が高く評価しました。オプティマスのハンドは、世界の 5 本指ロボットの 1 つです。最も器用。その手は触覚だけではありません

FisheyeDetNet: 魚眼カメラに基づいた最初のターゲット検出アルゴリズム

Apr 26, 2024 am 11:37 AM

FisheyeDetNet: 魚眼カメラに基づいた最初のターゲット検出アルゴリズム

Apr 26, 2024 am 11:37 AM

目標検出は自動運転システムにおいて比較的成熟した問題であり、その中でも歩行者検出は最も初期に導入されたアルゴリズムの 1 つです。ほとんどの論文では非常に包括的な研究が行われています。ただし、サラウンドビューに魚眼カメラを使用した距離認識については、あまり研究されていません。放射状の歪みが大きいため、標準のバウンディング ボックス表現を魚眼カメラに実装するのは困難です。上記の説明を軽減するために、拡張バウンディング ボックス、楕円、および一般的な多角形の設計を極/角度表現に探索し、これらの表現を分析するためのインスタンス セグメンテーション mIOU メトリックを定義します。提案された多角形モデルの FisheyeDetNet は、他のモデルよりも優れたパフォーマンスを示し、同時に自動運転用の Valeo 魚眼カメラ データセットで 49.5% の mAP を達成しました。

Llama 70B を実行するシングル カードはデュアル カードより高速、Microsoft は FP6 を A100 オープンソースに強制導入

Apr 29, 2024 pm 04:55 PM

Llama 70B を実行するシングル カードはデュアル カードより高速、Microsoft は FP6 を A100 オープンソースに強制導入

Apr 29, 2024 pm 04:55 PM

FP8 以下の浮動小数点数値化精度は、もはや H100 の「特許」ではありません。 Lao Huang は誰もが INT8/INT4 を使用できるようにしたいと考え、Microsoft DeepSpeed チームは NVIDIA からの公式サポートなしで A100 上で FP6 の実行を開始しました。テスト結果は、A100 での新しい方式 TC-FPx の FP6 量子化が INT4 に近いか、場合によってはそれよりも高速であり、後者よりも精度が高いことを示しています。これに加えて、エンドツーエンドの大規模モデルのサポートもあり、オープンソース化され、DeepSpeed などの深層学習推論フレームワークに統合されています。この結果は、大規模モデルの高速化にも即座に影響します。このフレームワークでは、シングル カードを使用して Llama を実行すると、スループットはデュアル カードのスループットの 2.65 倍になります。 1つ