ユニバーサルビジョン GPT の瞬間は来るのでしょうか? Zhiyuan がユニバーサル セグメンテーション モデル SegGPT を発表

ChatGPT は大規模言語モデルの流行を引き起こしましたが、AI のもう 1 つの主要な領域であるビジョンに GPT の瞬間が訪れるのはいつでしょうか?

2 日前、Machine Heart は Meta の最新の研究結果、Segment Anything Model (SAM) を紹介しました。この研究は、AI コミュニティで広範な議論を引き起こしました。

私たちが知る限り、ほぼ同時に、Zhiyuan Research Institute のビジョン チームは、ビジュアルを使用した一般的なセグメンテーション モデル SegGPT (Segment Everything In Context) を立ち上げました。プロンプト (prompt ) は、任意のセグメンテーション タスクを完了するための汎用視覚モデルです。

- 文書アドレス: https://arxiv.org/abs/2304.03284

- #コード アドレス: https://github.com/baaivision/Painter ##デモ: https://huggingface.co / space/BAAI/SegGPT

- ##SegGPT は、メタ AI 画像セグメンテーション基本モデル SAM と同時にリリースされました。両者の違いは次のとおりです。

##SegGPT 「ワンサイズですべてに対応」: 1 つまたは複数のサンプル画像とインテント マスクが与えられると、モデルはユーザーのインテントを取得し、同様のセグメンテーション タスクを「模倣」できます。ユーザーは、画面上のオブジェクトの種類をマークして認識すると、現在の画面、他の画面、またはビデオ環境にあるかどうかに関係なく、類似したオブジェクトをバッチで識別してセグメント化できます。

- SAM 「ワンタッチ アンド ゴー」: ポイントまたは境界ボックスを通じて、予測される画像上にインタラクティブなプロンプトが表示され、分割画面上の指定されたオブジェクトが識別されます。

-

「ワンタッチですべて」でも「ワンタッチですべて」でも、ビジュアルモデルが「理解した」ことを意味します。 「画像構造。 SAM の細かい注釈機能と SegGPT の一般的なセグメンテーション アノテーション機能を組み合わせることで、ピクセル配列からのあらゆる画像を視覚的な構造単位に解析し、生物学的な視覚のようにあらゆるシーンを理解することができます。ユニバーサル ビジュアル GPT の夜明けがここにあります。

#このモデルには次の利点と機能があります:

1. 一般的な機能

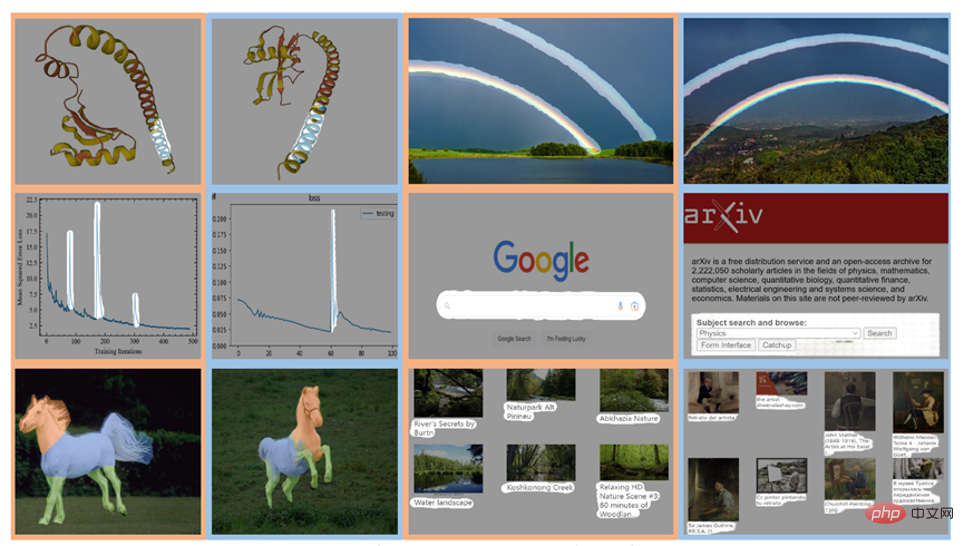

: SegGPT にはコンテキスト推論機能があり、モデルは提供されたセグメンテーションの例 (プロンプト) に基づいて予測を適応的に調整し、インスタンス、カテゴリ、コンポーネント、輪郭、テキスト、人物を含む「すべて」のセグメンテーションを実現できます。 、医療画像、リモートセンシング画像など。 2. 柔軟な推論能力

: 任意の数のプロンプトをサポート、特定のシナリオ向けに調整されたプロンプトをサポート、マスク異なる色の色を使用して異なるターゲットを表現し、並列セグメンテーション推論を実現できます。 3. 自動ビデオ セグメンテーションおよび追跡機能:

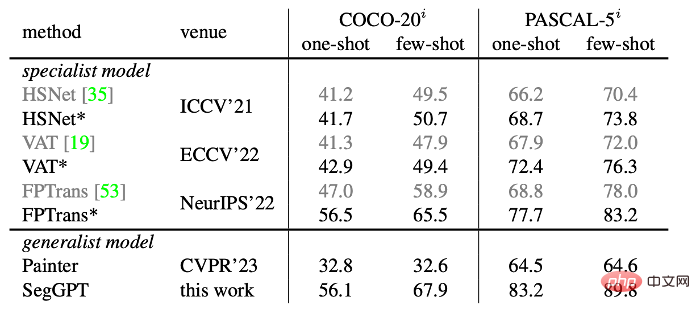

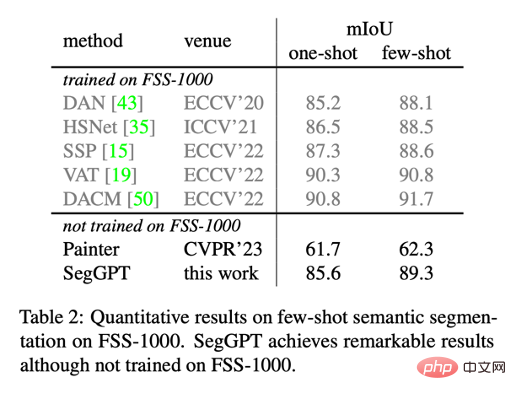

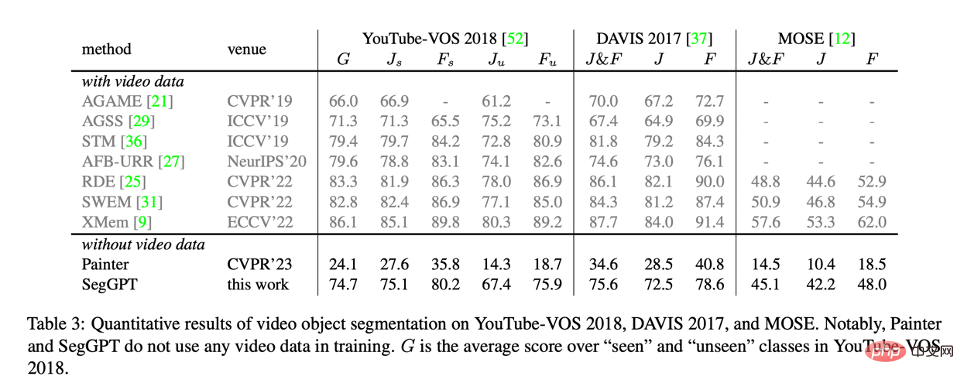

最初のフレーム画像と対応するオブジェクト マスクに基づく状況に応じた例として、SegGPT は後続のビデオ フレームを自動的にセグメント化し、マスクの色をオブジェクトの ID として使用して自動追跡を実現できます。 ケースプレゼンテーション1. 著者らは、少数ショットのセマンティック セグメンテーション、ビデオ オブジェクト セグメンテーション、セマンティック セグメンテーション、パノラマ セグメンテーションなどの幅広いタスクで SegGPT を評価しました。 。以下の図は、インスタンス、カテゴリー、コンポーネント、アウトライン、テキスト、および任意形状のオブジェクトに対する SegGPT のセグメンテーション結果を具体的に示しています。

2. 1 つの写真 (上の写真) で虹をマークし、他の写真の虹をバッチに分割します (下の写真)

#3. ブラシを使って惑星環を大まかに囲み (上図)、予測マップのターゲット画像内の惑星環を正確に出力します。 (写真下))。

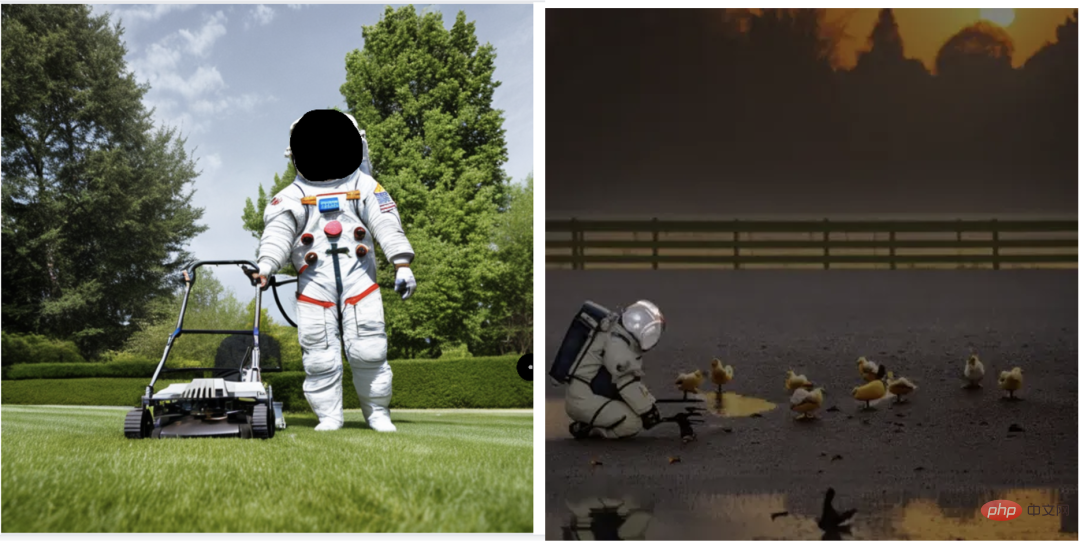

4. SegGPT は、宇宙飛行士のヘルメット マスク (左の画像) は、新しい画像 (右の画像) 内の対応する宇宙飛行士のヘルメット領域を予測します。

#トレーニング方法

#トレーニング方法

具体的には、SegGPT のトレーニングは、データ サンプルごとにランダムなカラー マッピングを使用したコンテキスト カラーリング問題として定義されます。目標は、特定の色に依存するのではなく、コンテキストに基づいてさまざまなタスクを実行することです。トレーニング後、SegGPT は、インスタンス、カテゴリ、コンポーネント、輪郭、テキストなどの文脈推論を通じて、画像またはビデオ内の任意のセグメンテーション タスクを実行できます。

テスト時のテクニック

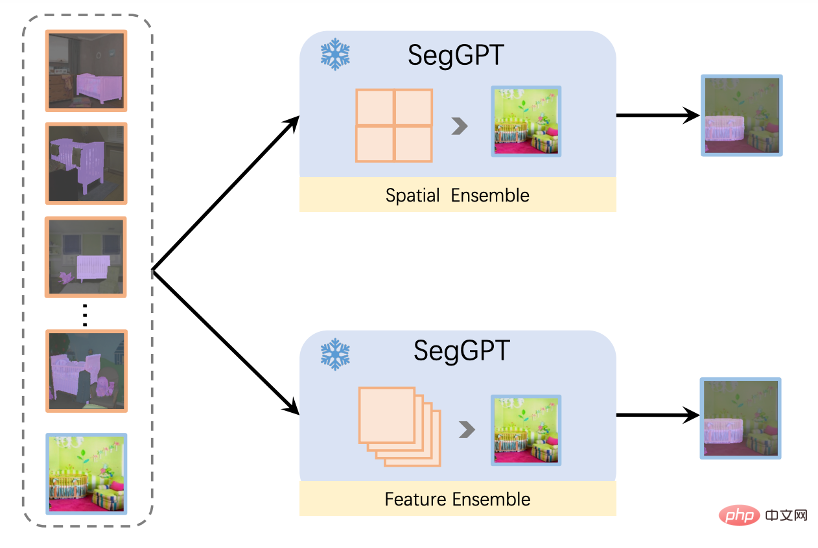

テスト時のテクニックを通じてさまざまな能力を解き放つ方法は、ユニバーサル モデルのハイライトです。 SegGPT の論文では、以下の図に示すさまざまなコンテキスト アンサンブル手法など、さまざまなセグメンテーション機能を解放および強化するための複数のテクノロジが提案されています。提案された特徴アンサンブル手法は、人間に優しい推論効果を達成するために、任意の数のプロンプト サンプルをサポートできます。

結果の表示

結果の表示

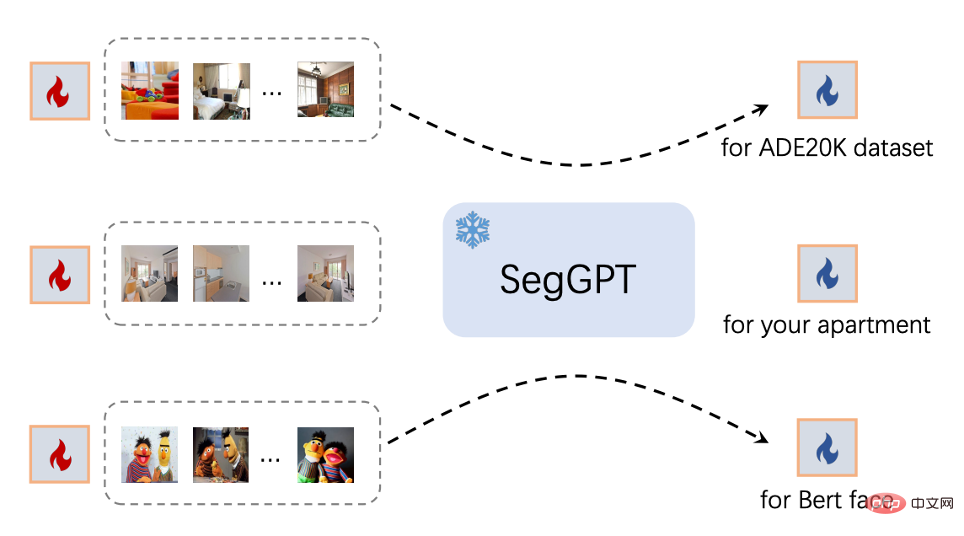

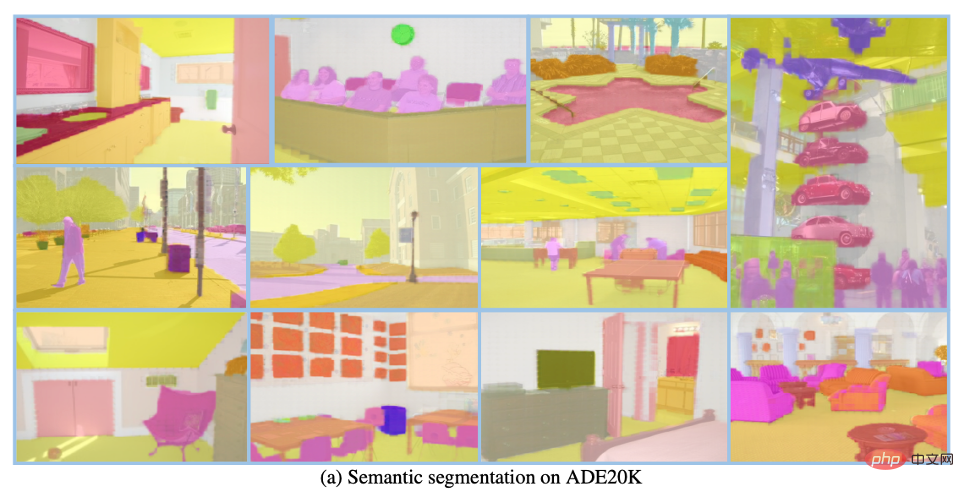

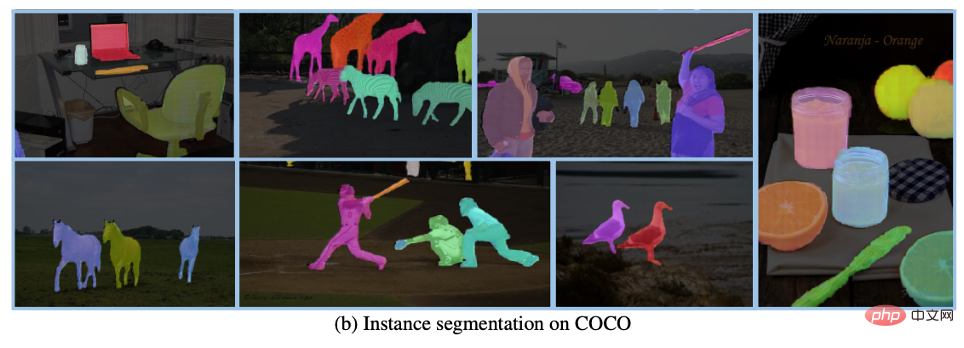

次は、セマンティック セグメンテーション タスクとインスタンス セグメンテーション タスクに対する調整されたプロンプトの効果を示します。

次は、セマンティック セグメンテーション タスクとインスタンス セグメンテーション タスクに対する調整されたプロンプトの効果を示します。

以上がユニバーサルビジョン GPT の瞬間は来るのでしょうか? Zhiyuan がユニバーサル セグメンテーション モデル SegGPT を発表の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7564

7564

15

15

1386

1386

52

52

87

87

11

11

28

28

99

99

世界で最も強力なオープンソース MoE モデルが登場。GPT-4 に匹敵する中国語機能を備え、価格は GPT-4-Turbo のわずか 1% 近くです

May 07, 2024 pm 04:13 PM

世界で最も強力なオープンソース MoE モデルが登場。GPT-4 に匹敵する中国語機能を備え、価格は GPT-4-Turbo のわずか 1% 近くです

May 07, 2024 pm 04:13 PM

従来のコンピューティングを超える能力を備えているだけでなく、より低コストでより効率的なパフォーマンスを実現する人工知能モデルを想像してみてください。これは SF ではありません。世界で最も強力なオープンソース MoE モデルである DeepSeek-V2[1] が登場しました。 DeepSeek-V2 は、経済的なトレーニングと効率的な推論の特徴を備えた強力な専門家混合 (MoE) 言語モデルです。これは 236B のパラメータで構成されており、そのうち 21B は各マーカーをアクティブにするために使用されます。 DeepSeek67B と比較して、DeepSeek-V2 はパフォーマンスが優れていると同時に、トレーニング コストを 42.5% 節約し、KV キャッシュを 93.3% 削減し、最大生成スループットを 5.76 倍に高めます。 DeepSeek は一般的な人工知能を研究する会社です

AI が数学研究を破壊する!フィールズ賞受賞者で中国系アメリカ人の数学者が上位 11 件の論文を主導 | テレンス・タオが「いいね!」しました

Apr 09, 2024 am 11:52 AM

AI が数学研究を破壊する!フィールズ賞受賞者で中国系アメリカ人の数学者が上位 11 件の論文を主導 | テレンス・タオが「いいね!」しました

Apr 09, 2024 am 11:52 AM

AI は確かに数学を変えつつあります。最近、この問題に細心の注意を払っている陶哲軒氏が『米国数学協会会報』(米国数学協会会報)の最新号を送ってくれた。 「機械は数学を変えるのか?」というテーマを中心に、多くの数学者が意見を述べ、そのプロセス全体は火花に満ち、ハードコアで刺激的でした。著者には、フィールズ賞受賞者のアクシャイ・ベンカテシュ氏、中国の数学者鄭楽軍氏、ニューヨーク大学のコンピューター科学者アーネスト・デイビス氏、その他業界で著名な学者を含む強力な顔ぶれが揃っている。 AI の世界は劇的に変化しています。これらの記事の多くは 1 年前に投稿されたものです。

Google は大喜び: JAX のパフォーマンスが Pytorch や TensorFlow を上回りました! GPU 推論トレーニングの最速の選択肢となる可能性があります

Apr 01, 2024 pm 07:46 PM

Google は大喜び: JAX のパフォーマンスが Pytorch や TensorFlow を上回りました! GPU 推論トレーニングの最速の選択肢となる可能性があります

Apr 01, 2024 pm 07:46 PM

Google が推進する JAX のパフォーマンスは、最近のベンチマーク テストで Pytorch や TensorFlow のパフォーマンスを上回り、7 つの指標で 1 位にランクされました。また、テストは最高の JAX パフォーマンスを備えた TPU では行われませんでした。ただし、開発者の間では、依然として Tensorflow よりも Pytorch の方が人気があります。しかし、将来的には、おそらくより大規模なモデルが JAX プラットフォームに基づいてトレーニングされ、実行されるようになるでしょう。モデル 最近、Keras チームは、ネイティブ PyTorch 実装を使用して 3 つのバックエンド (TensorFlow、JAX、PyTorch) をベンチマークし、TensorFlow を使用して Keras2 をベンチマークしました。まず、主流のセットを選択します

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas は正式に電動ロボットの時代に突入します!昨日、油圧式アトラスが歴史の舞台から「涙ながらに」撤退したばかりですが、今日、ボストン・ダイナミクスは電動式アトラスが稼働することを発表しました。ボストン・ダイナミクス社は商用人型ロボットの分野でテスラ社と競争する決意を持っているようだ。新しいビデオが公開されてから、わずか 10 時間ですでに 100 万人以上が視聴しました。古い人が去り、新しい役割が現れるのは歴史的な必然です。今年が人型ロボットの爆発的な年であることは間違いありません。ネットユーザーは「ロボットの進歩により、今年の開会式は人間のように見え、人間よりもはるかに自由度が高い。しかし、これは本当にホラー映画ではないのか?」とコメントした。ビデオの冒頭では、アトラスは仰向けに見えるように地面に静かに横たわっています。次に続くのは驚くべきことです

MLP に代わる KAN は、オープンソース プロジェクトによって畳み込みまで拡張されました

Jun 01, 2024 pm 10:03 PM

MLP に代わる KAN は、オープンソース プロジェクトによって畳み込みまで拡張されました

Jun 01, 2024 pm 10:03 PM

今月初め、MIT やその他の機関の研究者らは、MLP に代わる非常に有望な代替案である KAN を提案しました。 KAN は、精度と解釈可能性の点で MLP よりも優れています。また、非常に少数のパラメーターを使用して、多数のパラメーターを使用して実行する MLP よりも優れたパフォーマンスを発揮できます。たとえば、著者らは、KAN を使用して、より小規模なネットワークと高度な自動化で DeepMind の結果を再現したと述べています。具体的には、DeepMind の MLP には約 300,000 個のパラメーターがありますが、KAN には約 200 個のパラメーターしかありません。 KAN は、MLP が普遍近似定理に基づいているのに対し、KAN はコルモゴロフ-アーノルド表現定理に基づいているのと同様に、強力な数学的基礎を持っています。以下の図に示すように、KAN は

テスラのロボットは工場で働く、マスク氏:手の自由度は今年22に達する!

May 06, 2024 pm 04:13 PM

テスラのロボットは工場で働く、マスク氏:手の自由度は今年22に達する!

May 06, 2024 pm 04:13 PM

テスラのロボット「オプティマス」の最新映像が公開され、すでに工場内で稼働可能となっている。通常の速度では、バッテリー(テスラの4680バッテリー)を次のように分類します:公式は、20倍の速度でどのように見えるかも公開しました - 小さな「ワークステーション」上で、ピッキング、ピッキング、ピッキング:今回は、それがリリースされたハイライトの1つビデオの内容は、オプティマスが工場内でこの作業を完全に自律的に行い、プロセス全体を通じて人間の介入なしに完了するというものです。そして、オプティマスの観点から見ると、自動エラー修正に重点を置いて、曲がったバッテリーを拾い上げたり配置したりすることもできます。オプティマスのハンドについては、NVIDIA の科学者ジム ファン氏が高く評価しました。オプティマスのハンドは、世界の 5 本指ロボットの 1 つです。最も器用。その手は触覚だけではありません

FisheyeDetNet: 魚眼カメラに基づいた最初のターゲット検出アルゴリズム

Apr 26, 2024 am 11:37 AM

FisheyeDetNet: 魚眼カメラに基づいた最初のターゲット検出アルゴリズム

Apr 26, 2024 am 11:37 AM

目標検出は自動運転システムにおいて比較的成熟した問題であり、その中でも歩行者検出は最も初期に導入されたアルゴリズムの 1 つです。ほとんどの論文では非常に包括的な研究が行われています。ただし、サラウンドビューに魚眼カメラを使用した距離認識については、あまり研究されていません。放射状の歪みが大きいため、標準のバウンディング ボックス表現を魚眼カメラに実装するのは困難です。上記の説明を軽減するために、拡張バウンディング ボックス、楕円、および一般的な多角形の設計を極/角度表現に探索し、これらの表現を分析するためのインスタンス セグメンテーション mIOU メトリックを定義します。提案された多角形モデルの FisheyeDetNet は、他のモデルよりも優れたパフォーマンスを示し、同時に自動運転用の Valeo 魚眼カメラ データセットで 49.5% の mAP を達成しました。

DualBEV: BEVFormer および BEVDet4D を大幅に上回る、本を開いてください!

Mar 21, 2024 pm 05:21 PM

DualBEV: BEVFormer および BEVDet4D を大幅に上回る、本を開いてください!

Mar 21, 2024 pm 05:21 PM

この論文では、自動運転においてさまざまな視野角 (遠近法や鳥瞰図など) から物体を正確に検出するという問題、特に、特徴を遠近法 (PV) 空間から鳥瞰図 (BEV) 空間に効果的に変換する方法について検討します。 Visual Transformation (VT) モジュールを介して実装されます。既存の手法は、2D から 3D への変換と 3D から 2D への変換という 2 つの戦略に大別されます。 2D から 3D への手法は、深さの確率を予測することで高密度の 2D フィーチャを改善しますが、特に遠方の領域では、深さ予測に固有の不確実性により不正確さが生じる可能性があります。 3D から 2D への方法では通常、3D クエリを使用して 2D フィーチャをサンプリングし、Transformer を通じて 3D と 2D フィーチャ間の対応のアテンション ウェイトを学習します。これにより、計算時間と展開時間が増加します。