犬は世界をどのように見ていますか?人間の研究者が犬の脳の視覚認知の解読に着手

過去 15,000 年にわたり、犬と人間は共進化してきました。現在、犬はペットとして人間の環境に生息することが多くなっています。時々、犬も人間と同じように家でビデオを見て、理解しているようです。

それでは、犬の目には世界はどのように見えるのでしょうか?

最近、エモリー大学の研究により、犬の脳から視覚画像が解読され、犬の脳が見たものをどのように再構成するのかが初めて明らかになりました。この研究は、Journal of Visualized Experiments に掲載されました。

論文アドレス: https://www.jove.com/t/64442/through-dog-s-eyes-fmri-decoding-naturalistic-videos -from-dog

研究者らは、覚醒した拘束されていない 2 匹の犬から 30 分間のビデオを 3 回、合計 90 分間視聴しながら、fMRI 神経データを記録しました。次に、機械学習アルゴリズムを使用して、ニューラル データのパターンを分析しました。

エモリー大学の心理学教授で論文著者の一人であるグレゴリー・バーンズ氏は、「犬がビデオを見ている間の脳活動を監視し、その活動をある程度再構築することができる」と述べた。

バーンズらは、犬における fMRI スキャン技術の使用の先駆けとなり、神経活動を測定している間完全に静止するように犬を訓練しました。無制限。 10年前、研究チームは完全に覚醒し拘束されていない犬のfMRI脳画像を初めて公開し、バーンズが「犬プロジェクト」と呼ぶものの扉を開いた。

バーンズとカリーは、完全に覚醒し拘束されていない状態で脳活動をスキャンされた最初の犬です。

バーンズ博士の研究室は、長年にわたり、犬の脳が視覚、言語、匂い、報酬(賞賛や食べ物を受け取るなど)をどのように処理するかに関する複数の研究を発表してきました。

同時に、機械学習テクノロジーは進歩を続けており、科学者は人間の脳活動のパターンの一部を解読できるようになりました。その後、バーンズ氏は同様の技術を犬の脳に応用できないか考え始めた。

この新しい研究は、機械学習と fMRI テクノロジーに基づいています。 fMRI は、磁気共鳴画像法を使用して神経活動によって引き起こされる血行動態の変化を測定する神経画像技術です。この技術は非侵襲的であり、脳機能の位置特定の分野で重要な役割を果たします。人間に加えて、この技術は一部の霊長類を含む他の少数の種でのみ使用されています。

研究紹介

実験には2頭の犬が使用され、機械学習やfMRIなどの技術が犬の分析に一般的に使用できることが証明されました。この研究は、他の人がさまざまな動物がどのように考えるかをより深く理解するのに役立つことを意味します。

実験プロセスは大まかに次のとおりです:

実験参加者: ブボ、4 歳、デイジー、11 歳。両犬とも、これまでにいくつかの fMRI トレーニング セッション (ブーボ: 8 セッション、デイジー: 11 セッション) に参加しており、その一部にはスクリーンに投影された視覚刺激の観察が含まれていました。 2 匹の犬が選ばれたのは、飼い主に見られずに動き回ることなく、スキャナー内に長時間留まることができたからです。

ビデオ撮影: 犬の視点からビデオを撮影し、犬の生活の日常シーンを捉えます。これらのシナリオには、散歩、餌を食べる、遊ぶ、人間との交流、犬と犬の交流などが含まれます。このビデオは 256 のユニークなシーンに編集されており、各シーンには犬が人間に寄り添う、犬が走る、散歩するなどの出来事が描かれています。各シーンには、その内容に基づいて一意の番号とラベルが割り当てられます。その後、シーンはそれぞれ約 6 分の 5 つの大きなコンピレーション ビデオに編集されました。

#実験デザイン: 参加者はまず、MRI ボアの後ろのスクリーンに投影されたコンピレーション ビデオを見ながら、3T MRI を使用してスキャンを受けました。犬の場合、事前訓練は、以下の写真のような安定した頭の位置を達成するために特注のあご当てに頭を置くことによって達成されます。は 3 回の視聴に分かれており、各回 30 分のビデオが視聴され、合計時間は 90 分になります。

実験では、fMRI を使用して犬を同時にスキャンし、データを分析しました。実験では、ツイン ニューラルに基づく非線形手法である Ivis 機械学習アルゴリズムが使用されました。ネットワーク (SNN) は、高次元の生物学的データの解析に成功しました。さらに、実験では scikit-learn や RFC などの機械学習アルゴリズムも使用されました。

スキャンを受けているデイジーは、騒音を消すために耳栓を固定するために耳にテープを貼っています。

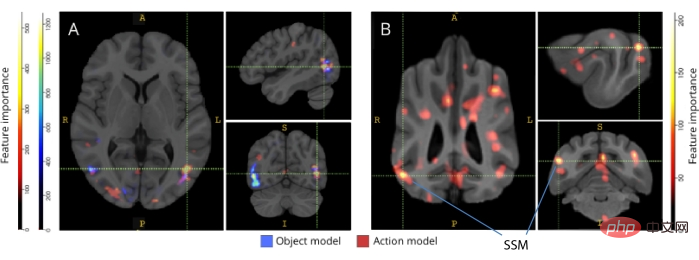

この研究では、人間と犬の脳がどのように機能するかを比較しました。 2人の人間の被験者からの結果は、ニューラルネットワークを使用して開発されたモデルが脳データを99%の精度でオブジェクトベースおよびアクションベースの分類子にマッピングしたことを示しました;同じモデルは、犬の脳パターンを解読する際に良好に機能しました。アクション分類、精度は 75% ~ 88% に達しました。これは、以下の人間 (A) と犬 (B) の実験結果に示すように、人間と犬の脳の働きに大きな違いがあることを示しています。これに関してバーンズ博士は、「私たち人間は、自分が見ているものを非常に気にしますが、犬は、誰が見ているか、何を見ているかということよりも、行動の行動を気にしているようです。」

以上が犬は世界をどのように見ていますか?人間の研究者が犬の脳の視覚認知の解読に着手の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7557

7557

15

15

1384

1384

52

52

83

83

11

11

28

28

96

96

ORB-SLAM3を超えて! SL-SLAM: 低照度、重度のジッター、弱いテクスチャのシーンはすべて処理されます。

May 30, 2024 am 09:35 AM

ORB-SLAM3を超えて! SL-SLAM: 低照度、重度のジッター、弱いテクスチャのシーンはすべて処理されます。

May 30, 2024 am 09:35 AM

以前に書きましたが、今日は、深層学習テクノロジーが複雑な環境におけるビジョンベースの SLAM (同時ローカリゼーションとマッピング) のパフォーマンスをどのように向上させることができるかについて説明します。ここでは、深部特徴抽出と深度マッチング手法を組み合わせることで、低照度条件、動的照明、テクスチャの弱い領域、激しいセックスなどの困難なシナリオでの適応を改善するように設計された多用途のハイブリッド ビジュアル SLAM システムを紹介します。当社のシステムは、拡張単眼、ステレオ、単眼慣性、ステレオ慣性構成を含む複数のモードをサポートしています。さらに、他の研究にインスピレーションを与えるために、ビジュアル SLAM と深層学習手法を組み合わせる方法も分析します。公開データセットと自己サンプリングデータに関する広範な実験を通じて、測位精度と追跡堅牢性の点で SL-SLAM の優位性を実証しました。

NeRFとは何ですか? NeRF ベースの 3D 再構成はボクセルベースですか?

Oct 16, 2023 am 11:33 AM

NeRFとは何ですか? NeRF ベースの 3D 再構成はボクセルベースですか?

Oct 16, 2023 am 11:33 AM

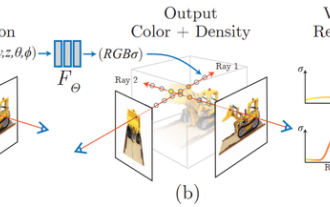

1 はじめに Neural Radiation Fields (NeRF) は、深層学習とコンピューター ビジョンの分野におけるかなり新しいパラダイムです。この技術は、ECCV2020 の論文「NeRF: Representing Scenes as Neural Radiation Fields for View Synthesis」(最優秀論文賞を受賞) で紹介され、それ以来非常に人気となり、現在までに 800 件近く引用されています [1]。このアプローチは、機械学習による 3D データの従来の処理方法に大きな変化をもたらします。神経放射線場のシーン表現と微分可能なレンダリング プロセス: カメラ光線に沿って 5D 座標 (位置と視線方向) をサンプリングして画像を合成し、これらの位置を MLP に入力して色と体積密度を生成し、体積レンダリング技術を使用してこれらの値を合成します。 ; レンダリング関数は微分可能であるため、渡すことができます。

Python を使用した Base64 エンコードとデコード

Sep 02, 2023 pm 01:49 PM

Python を使用した Base64 エンコードとデコード

Sep 02, 2023 pm 01:49 PM

ネットワーク経由で転送したいバイナリ イメージ ファイルがあるとします。相手がファイルを正しく受信できなかったことに驚きました。ファイルには奇妙な文字が含まれているだけです。そうですね、使用しているメディアがテキストのストリーミング用に設計されているのに、生のビットおよびバイト形式でファイルを送信しようとしているようです。このような問題を回避するための解決策は何でしょうか?答えはBase64エンコーディングです。この記事では、Python を使用してバイナリ画像をエンコードおよびデコードする方法を説明します。このプログラムはスタンドアロンのローカル プログラムとして説明されていますが、この概念は、エンコードされた画像をモバイル デバイスからサーバーや他の多くのアプリケーションに送信するなど、さまざまなアプリケーションに適用できます。 Base64とは何ですか?この記事に入る前に、Base6 を定義しましょう

自動運転の初の純粋な視覚的静的再構築

Jun 02, 2024 pm 03:24 PM

自動運転の初の純粋な視覚的静的再構築

Jun 02, 2024 pm 03:24 PM

純粋に視覚的な注釈ソリューションでは、主に視覚に加えて、GPS、IMU、および車輪速度センサーからのデータを動的注釈に使用します。もちろん、量産シナリオでは、純粋な視覚である必要はありません。一部の量産車両には固体レーダー (AT128) などのセンサーが搭載されています。大量生産の観点からデータの閉ループを作成し、これらすべてのセンサーを使用すると、動的オブジェクトのラベル付けの問題を効果的に解決できます。しかし、私たちの計画には固体レーダーはありません。したがって、この最も一般的な量産ラベル ソリューションを紹介します。純粋に視覚的な注釈ソリューションの中核は、高精度のポーズ再構築にあります。再構築の精度を確保するために、Structure from Motion (SFM) のポーズ再構築スキームを使用します。でもパスする

Occと自動運転の過去と現在を見てみよう!最初のレビューでは、機能強化/量産展開/アノテーションの効率化という 3 つの主要テーマを包括的にまとめています。

May 08, 2024 am 11:40 AM

Occと自動運転の過去と現在を見てみよう!最初のレビューでは、機能強化/量産展開/アノテーションの効率化という 3 つの主要テーマを包括的にまとめています。

May 08, 2024 am 11:40 AM

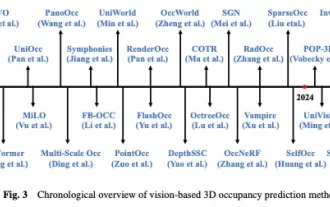

以上、筆者個人の理解 近年、自動運転はドライバーの負担軽減や運転の安全性の向上につながる可能性があるため、注目が高まっています。ビジョンベースの 3 次元占有予測は、自動運転の安全性に関する費用対効果の高い包括的な調査に適した新たな認識タスクです。オブジェクト中心の知覚タスクと比較して 3D 占有予測ツールの優位性は多くの研究で実証されていますが、この急速に発展している分野に特化したレビューはまだあります。このホワイトペーパーでは、まずビジョンベースの 3D 占有予測の背景を紹介し、このタスクで直面する課題について説明します。次に、現在の 3D 占有予測手法の現状と開発傾向を、機能強化、展開の容易さ、ラベル付けの効率という 3 つの側面から包括的に説明します。やっと

3D ビジョンには点群の登録が不可欠です。すべての主流のソリューションと課題を 1 つの記事で理解する

Apr 02, 2024 am 11:31 AM

3D ビジョンには点群の登録が不可欠です。すべての主流のソリューションと課題を 1 つの記事で理解する

Apr 02, 2024 am 11:31 AM

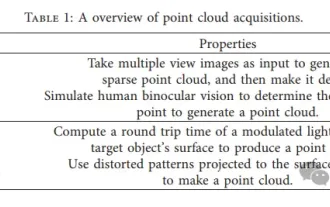

点の集合体である点群は、3D再構築、工業用検査、ロボット操作などを通じて、物体の3次元(3D)表面情報の取得と生成に変化をもたらすことが期待されています。最も困難だが重要なプロセスは、点群の登録です。つまり、2 つの異なる座標で取得された 2 つの点群を位置合わせして一致させる空間変換を取得します。このレビューは、点群登録の概要と基本原理を紹介し、さまざまな方法を体系的に分類して比較し、点群登録に存在する技術的問題を解決することで、分野外の学術研究者やエンジニアに指導を提供し、統一されたビジョンに関する議論を促進することを目的としています。点群登録用。一般的な点群取得方法はアクティブ方式とパッシブ方式に分けられ、センサーが能動的に点群を取得するのがアクティブ方式で、点群は後で再構成されます。

C言語プログラミングで漢字のエンコードとデコードを実装するにはどうすればよいですか?

Feb 19, 2024 pm 02:15 PM

C言語プログラミングで漢字のエンコードとデコードを実装するにはどうすればよいですか?

Feb 19, 2024 pm 02:15 PM

現代のコンピューター プログラミングにおいて、C 言語は最も一般的に使用されるプログラミング言語の 1 つです。 C 言語自体は中国語のエンコードとデコードを直接サポートしていませんが、いくつかのテクノロジとライブラリを使用してこの機能を実現できます。この記事では、C言語プログラミングソフトウェアで中国語のエンコードとデコードを実装する方法を紹介します。まず、中国語のエンコードとデコードを実装するには、中国語のエンコードの基本概念を理解する必要があります。現在、最も一般的に使用されている中国語のエンコード スキームは Unicode エンコードです。 Unicode エンコードでは、各文字に一意の数値が割り当てられるため、計算時に

口を動かすだけで原神がプレイできる! AIを使ってキャラクターを切り替えて敵を攻撃するネチズン「アヤカ、神里流フロストデストラクションを使って」

May 13, 2023 pm 07:52 PM

口を動かすだけで原神がプレイできる! AIを使ってキャラクターを切り替えて敵を攻撃するネチズン「アヤカ、神里流フロストデストラクションを使って」

May 13, 2023 pm 07:52 PM

過去 2 年間で世界中で人気を博した国産ゲームといえば、間違いなく原神が挙げられます。 5月に発表された今年第1四半期のモバイルゲーム収益調査報告書によると、「原神」が5億6,700万ドルの絶対的な優位性を獲得し、カードを引くモバイルゲームの中で断然1位を獲得したことも発表された。わずか 18 年でオンライン化され、数か月後、モバイル プラットフォームだけでの総収益は 30 億米ドル (約 130 億リンギット) を超えました。さて、Xumi オープン前の最後の 2.8 アイランド バージョンは長い間待ち望まれており、長いドラフト期間を経て、ようやく新しいプロットとプレイできるエリアが登場しました。でも、「肝臓皇帝」が何人いるのかは分かりませんが、島の探索が完了し、また草が生え始めました。宝箱は合計 182 個 + モラボックス 1 個 (含まれていません) 草期間が長くても心配する必要はありません。いや、長い草のあいだに