深層学習におけるトポロジカルの美学: GNN の基礎と応用

はじめに: 現実世界では、ソーシャル ネットワーク、電子商取引ショッピング、タンパク質の相互作用関係など、多くのデータがグラフの形で現れることがよくあります。 2007年には、ニューラルネットワークに基づくグラフデータ分析やマイニング手法がその優れた性能から広く注目を集め、学術界の注目の研究スポットとなっただけでなく、さまざまな分野でも注目を集めています。アプリケーションの。この記事は主に関連文献、その分野の専門家からの共有、および著者の表面的な経験を組み合わせて、大まかな要約と誘導を作成します。知識伝達ではありますが、個人の主観的判断も混じっており、偏りや漏れは避けられませんので、ご参照の際はご注意ください。クリスマスイブと重なって執筆を中断することになりますが、新年の願いがすべて叶い、皆様が安全で幸せに過ごせますよう、この場を借りて心よりお祈り申し上げます。

1. グラフ ニューラル ネットワークの開発の概要

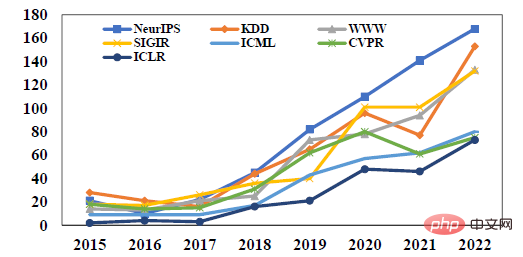

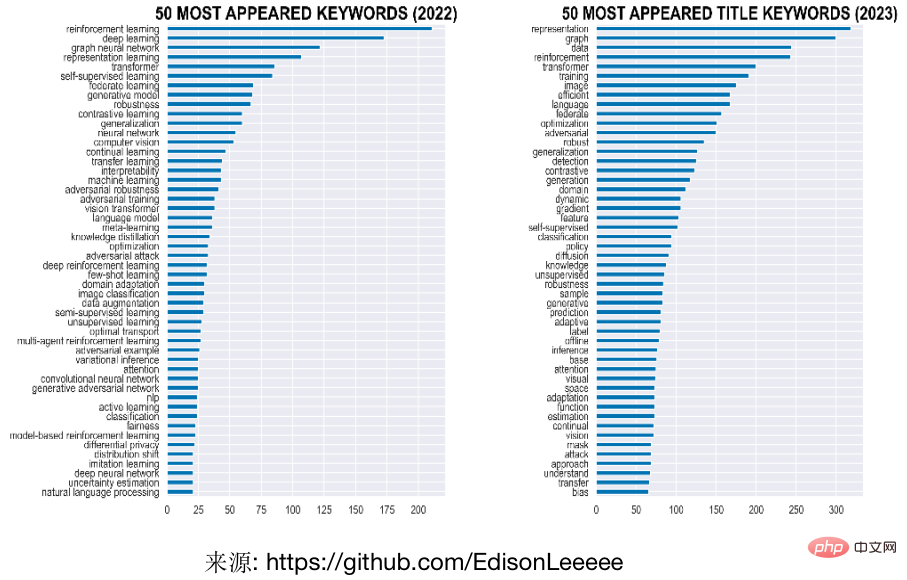

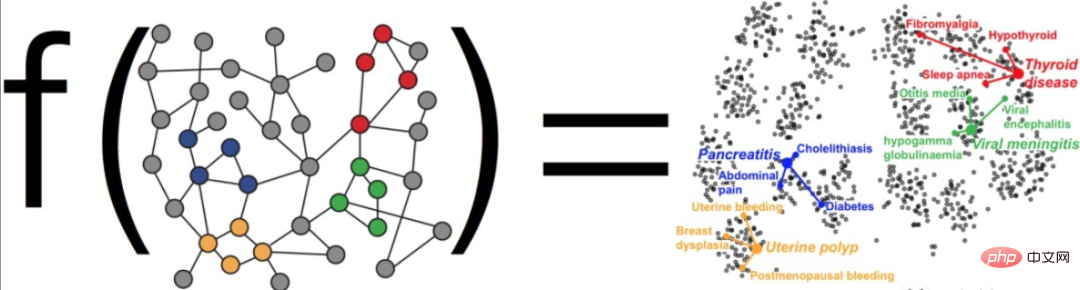

近年、モデリングを利用してグラフ構造を解析する研究が注目を集めており、その中でもグラフニューラルネットワークをベースとしたものが注目を集めています。深層学習グラフ モデリング手法について グラフ ニューラル ネットワーク (GNN) は、その優れたパフォーマンスにより、学術界で人気の研究スポットの 1 つとなっています。たとえば、下図に示すように、機械学習関連のトップカンファレンスにおけるグラフニューラルネットワークに関する論文数は増加を続けており、グラフをタイトルやキーワードとして使用することは、トップカンファレンスであるICLRにおいて最もよく使われる言葉の1つとなっています。過去 2 年間で表現を学習したこと。また、今年の多くの学会でグラフニューラルネットワークが最優秀論文賞に選ばれており、例えば、データマイニングのトップカンファレンスであるKDDの最優秀博士論文の1位と2位をグラフ関連の若手学者2名が受賞しました。機械学習: 最高の研究論文と応用論文も、それぞれハイパーグラフと連合グラフ学習に関する因果学習に関するものです。一方、グラフニューラルネットワークは、電子商取引の検索、レコメンデーション、オンライン広告、金融リスク管理、交通予測などの分野でも多くの実用化が図られており、大手企業もグラフ学習関連のプラットフォームや機能の構築に力を入れている。

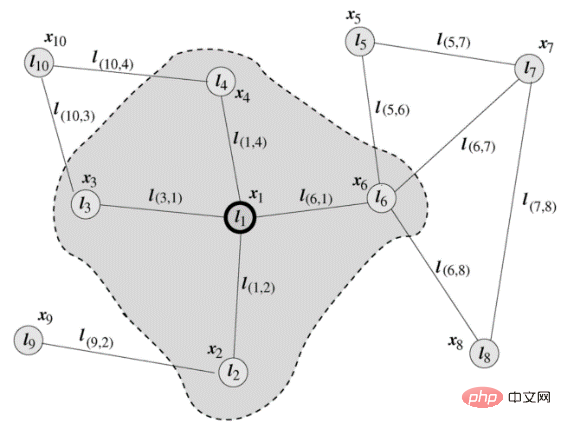

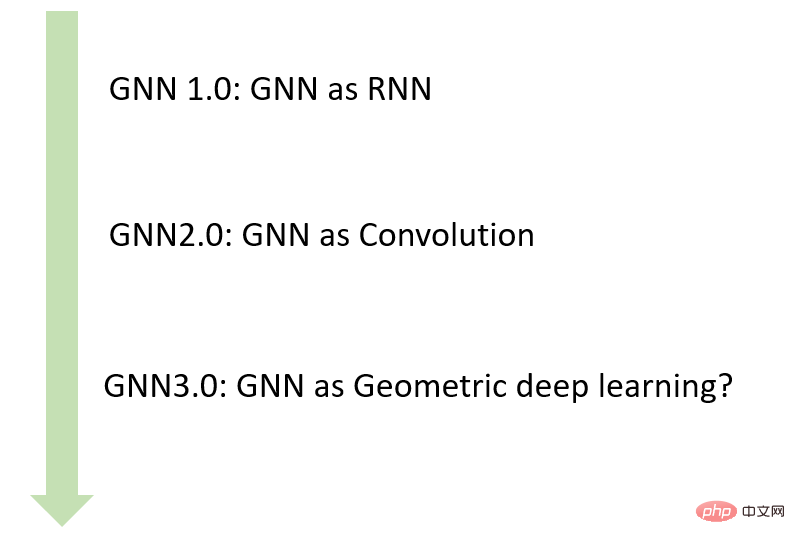

グラフ ニューラル ネットワークは、世界の研究のホットスポットになり始めたばかりですが、しかし、関連する定義は 2005 年にイタリアの学者マルコ ゴリとフランコ スカルセリによって提案されました。 Scarselli の論文にある典型的な図を以下に示します。 GNN の初期段階では、主に RNN をメインフレームワークとして使用し、ノードの隣接情報を入力してノードの状態を更新し、ローカル伝達関数を循環再帰関数として定義します。各ノードは、周囲の隣接ノードと接続されたエッジをソース情報として使用して更新します。独自のエクスプレス。

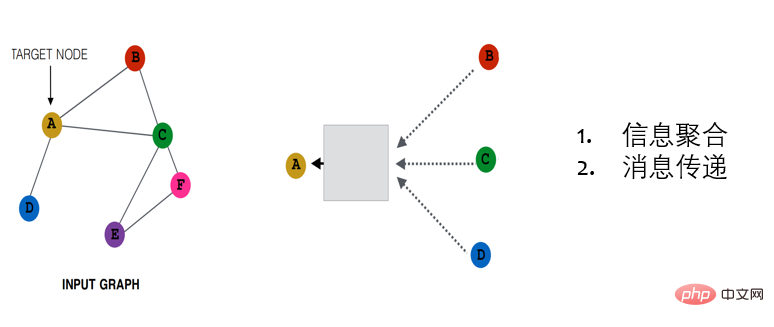

LeCun の学生 Bruna らは、2014 年に CNN をグラフに適用することを提案しました。彼らは、畳み込み演算子の巧妙な変換を通じて、周波数領域と空間領域に基づいた 2 つのグラフ畳み込みネットワークの情報集約手法を提案しました。スペクトルベースの方法では、グラフ信号処理の観点からフィルターを導入してグラフ畳み込みを定義します。グラフ畳み込み演算は、グラフ信号からノイズを除去するものとして解釈されます。空間ベースの手法は、CNN パラダイムにより準拠しており、近傍からの特徴情報を集約するものとしてグラフの畳み込みを表します。その後数年間、いくつかの新しいモデルが散発的に提案されましたが、それらは依然として比較的ニッチな研究方向でした。グラフ モデルの三銃士、GCN、GAT、GraphSage に代表される一連の研究成果が提案されたのは 2017 年になってからであり、これによりグラフ データと畳み込みニューラル ネットワークの間の計算障壁が開かれ、グラフ ニューラル ネットワークは徐々に普及してきました。研究のホットスポットであり、メッセージ パッシング メカニズム (MPNN) に基づくグラフ ニューラル ネットワーク モデルの現在の基本パラダイムの基礎を築きました。

典型的な MPNN アーキテクチャは、複数の伝播層で構成され、それぞれがノードは、近隣特性の集約関数に基づいて更新されます。さまざまな集約関数に従って、MPNN は次のように分類できます: 情報集約 (隣接する特徴の線形結合、重みは GCN などのグラフの構造のみに依存します)、アテンション (線形結合、重みはグラフの構造に依存します)機能 (GAT など) とメッセージ パッシング (GraphSAGE などの一般化された非線形関数) を以下の図の左から右に示します。

##推論の観点から見ると、次のように分けることもできます。 Transductive (GCN など) と Inductive (GraphSage など) に分けられます。ダイレクト プッシュ メソッドは各ノードの一意の表現を学習しますが、このモデルの制限は非常に明らかです。業界のほとんどのビジネス シナリオでは、グラフ内の構造とノードを固定することはできません。変化します。たとえば、新しいユーザーはユーザー コレクションに表示され続け、ユーザーの注目関係コレクションも成長し続け、コンテンツ プラットフォームには毎日大量の新しい記事が追加されます。このようなシナリオでは、ダイレクト プッシュ学習では、新しいノードの表現を学習するために継続的な再トレーニングが必要になります。帰納的手法は、ノードの隣接特性の「集約関数」を学習するもので、新しいノードの表現やグラフの構造の変更など、より柔軟なシナリオに適用できるため、さまざまなグラフに適用できます。実際のシナリオ、ダイナミックに変化するシーン。

#グラフ ニューラル ネットワークの開発過程では、グラフ ネットワークの計算精度とスケーラビリティの問題を解決するために、常に新しいモデルが提案されています。世代から世代へ。グラフ ニューラル ネットワークがグラフ データを表現できることに疑いの余地はありませんが、新しいモデルの設計は主に経験的な直観、ヒューリスティックな手法、および実験的な試行錯誤手法に基づいています。 Jure Leskovec のグループの 2019 年の関連研究 GIN (Graph Isomorphism Networks) は、グラフ同型性検出のための GNN と古典的なヒューリスティック アルゴリズム Weisfeiler Lehman (WL) との接続を確立し、GNN の表現能力の上限が 1-WL であることを理論的に証明しました (Jure は現在、スタンフォード大学コンピューター サイエンス学部の准教授を務めています。彼が率いる SNAP 研究室は、現在、グラフ ネットワークの分野で最も有名な研究室の 1 つです。彼が教えている CS224W「グラフ機械学習」は、強く推奨される学習です材料)。ただし、WL アルゴリズムの表現機能は、次の図の 2 つの例など、多くのデータ シナリオに対して非常に限られています。 (a) のサーキュラー スキップ リンク (CSL) グラフの場合、1-WL は 2 つのグラフの各ノードを同じ色でマークします。つまり、これらは明らかに完全に異なる構造を持つ 2 つのグラフです。1-WL を使用してテストします。同じラベルを取得します。 2 番目の例は、(b) に示すデカリン分子です。1-WL は a と b を同じ色に染め、c と d を同じ色に染めます。そのため、リンク予測のタスクでは、(a, d ) と (b 、d) は区別できません。

WL テストは、三角形や環状構造を持つ多くのデータでは満足のいく結果が得られませんが、生化学などの分野では、環状構造は非常に一般的かつ非常に重要であり、分子の性質も決定します。対応するプロパティにより、関連するシナリオでのグラフ ニューラル ネットワークの適用性が大幅に制限されます。 Michael Bosteinらは、グラフ深層学習手法における現在の「ノード中心とエッジ中心」の考え方には大きな限界があるとし、これに基づいてグラフ学習の開発と、幾何学的な観点から新たなアプローチの可能性を再考することを提案した。ディープ ラーニング、パラダイム (マイケルは現在、オックスフォード大学の人工知能の DeepMind 教授であり、Twitter Graph Learning Research Group の主席科学者であり、幾何学ディープ ラーニングの推進者の 1 人です)。多くの学者も、微分幾何学、代数トポロジー、微分方程式の分野から一連の新しいツールの研究を開始し、等変グラフ ニューラル ネットワーク、トポロジカル グラフ ニューラル ネットワーク、サブグラフ ニューラル ネットワークなどの一連の研究を提案しています。多くの問題を解決し、目を引く結果を達成しました。グラフ ニューラル ネットワークの開発コンテキストと組み合わせると、以下に示すように簡単にまとめることができます。

2. 複雑なグラフ モデル

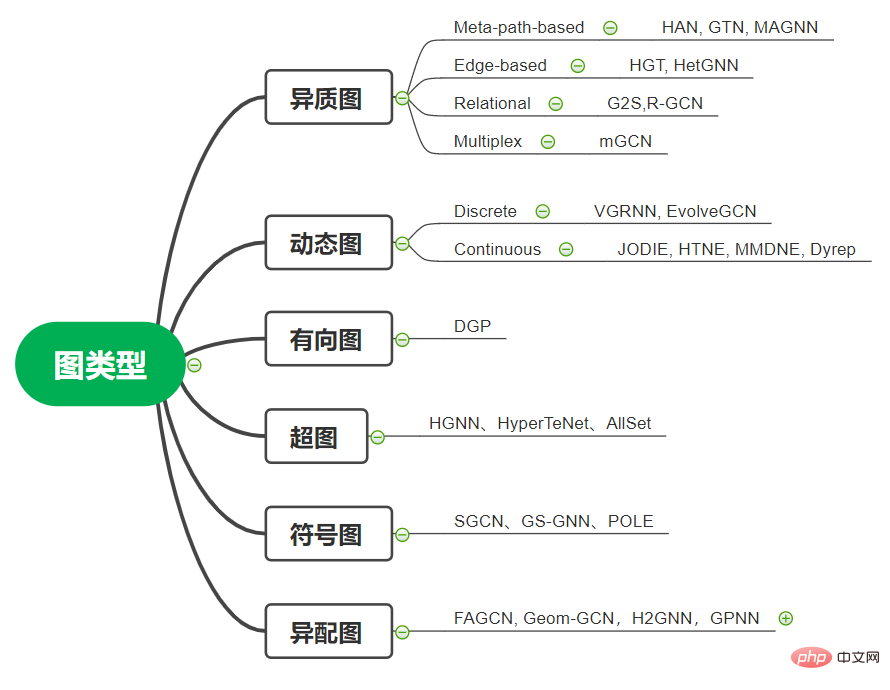

前のセクションでは、グラフ ニューラルの開発プロセスの概要を説明しました。ネットワーク , 言及されている対応するグラフ ニューラル ネットワークは、基本的に無向グラフと同種グラフのシナリオに設定されています。しかし、現実世界のグラフは多くの場合複雑です。研究者は、有向グラフ、異種グラフ、動的グラフの手法を提案しています。ハイパーグラフ、符号付きこれらのグラフ データ フォームと関連モデルをそれぞれ簡単に紹介します:

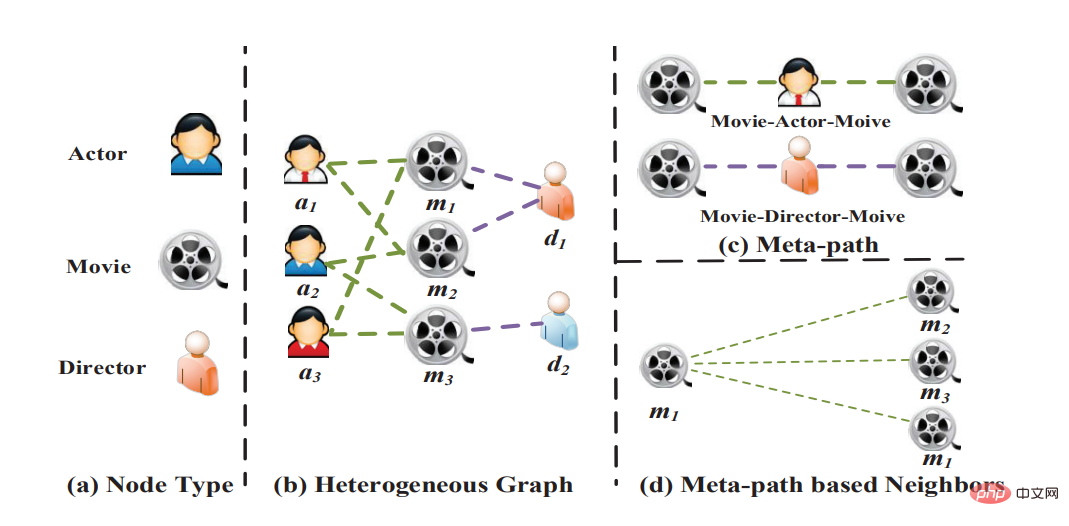

1. 異種グラフ: 異種グラフとは、ノードとエッジに複数のカテゴリがあり、複数のモードが存在するシナリオを指します。たとえば、電子商取引のシナリオでは、ノードは製品、店舗、ユーザーなどであり、エッジ タイプはクリック、コレクション、トランザクションなどです。具体的には、異種グラフでは各ノードが型情報を保持し、各エッジも型情報を保持しますが、一般的な GNN モデルでは対応する異種情報をモデル化できません。一方で、異なるタイプのノードのエンベディング次元を揃えることはできませんが、他方では、異なるタイプのノードのエンベディングは異なる意味空間に配置されます。異種グラフに対して最も広く使用されている学習方法は、メタパス ベースの方法です。メタパスは、パス内の各場所のノード タイプを指定します。トレーニング中に、メタパスはノード シーケンスとしてインスタンス化され、メタパス インスタンスの両端のノードをリンクすることで、直接接続されていない可能性がある 2 つのノードの類似性をキャプチャします。このようにして、異種グラフをいくつかの同型グラフに縮小することができ、これらの同型グラフにグラフ学習アルゴリズムを適用できます。さらに、いくつかの研究では、異種グラフを処理するためのエッジベースの方法が提案されています。この方法では、異なる隣接ノードとエッジに対して異なるサンプリング関数と集計関数が使用されます。代表作にHetGNN、HGTなど。関係グラフも扱う必要がある場合がありますが、これらのグラフのエッジにはカテゴリ以外の情報が含まれている場合や、エッジ カテゴリの数が非常に多いため、メタパスやメタ関係に基づく手法を使用することが困難になります。異種グラフに興味のある友人は、北京大学の石川先生と王暁先生の一連の研究をフォローしてください。

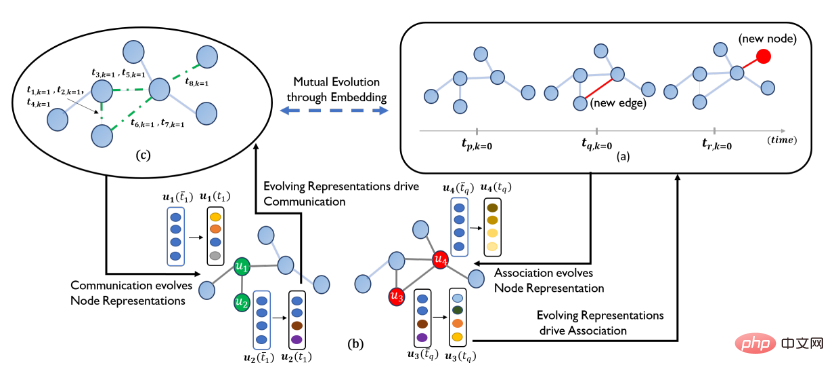

2. ダイナミック グラフ: ダイナミック グラフとは、ノードや位相構造が時間の経過とともに進化するグラフ データを指し、実際のシナリオでも広く使用されています。たとえば、学術引用ネットワークは時間の経過とともに拡大し続け、ユーザーと製品間のインタラクション グラフはユーザーの興味に応じて変化し、交通ネットワークと交通の流れは時間の経過とともに変化し続けます。動的グラフ上の GNN モデルは、特定の時点でノード表現を生成することを目的としています。時間粒度の厚さに応じて、動的グラフは離散時間動的グラフ (スナップショット ベースとも呼ばれます) と連続時間動的グラフ (イベント ベース) に分けることができます。離散時間動的グラフでは、時間が複数の時間に分割されます。スライス (たとえば、日/時間に分割)、各タイム スライスは静止画像に対応します。離散時間動的グラフの GNN モデルは、通常、タイム スライスごとに個別に GNN モデルを適用し、その後、RNN を使用して異なる時点のノードの表現を集約します。代表的な作品としては、DCRNN、STGCN、DGNN、EvolveGCN などが挙げられます。連続時間の動的グラフでは、各エッジにタイムスタンプが付けられ、インタラクション イベントが発生した瞬間を示します。静的グラフと比較して、連続時間動的グラフのメッセージ関数は、特定のサンプルのタイムスタンプとエッジのタイムスタンプにも依存します。さらに、隣接ノードは時間に関連している必要があります。たとえば、特定の時間後に出現するノードは隣接ノードに出現できません。モデルの観点から見ると、点プロセスは連続動的グラフのモデル化によく使用され、シーケンスの到着率は、生成された近傍シーケンスの条件付き強度関数を最適化することによって生成されます。この方法では、イベントが発生する特定の瞬間をさらに予測することもできます(ネットワークの特定のリンクの停止時間など)。連続動的グラフのモデリングに関する代表的な作品には、JODIE、HTNE、MMDNE、Dyrep などがあります。

出典: Dyrep

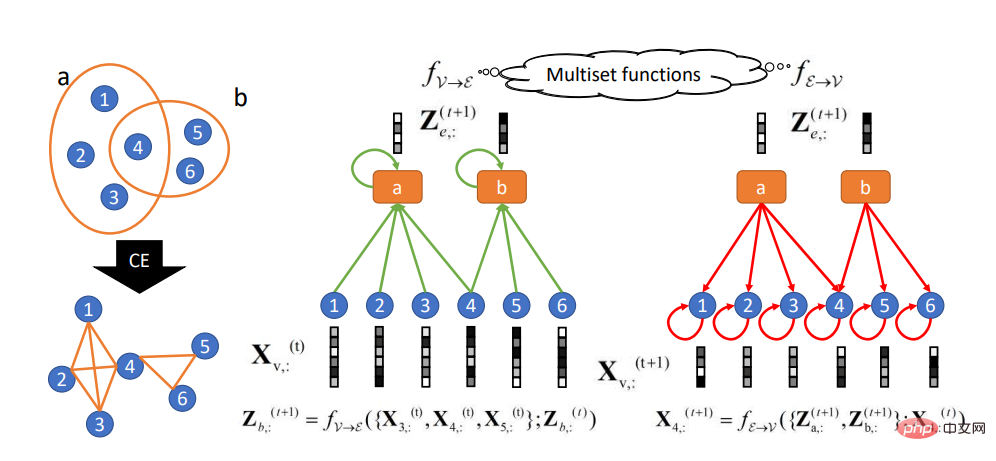

#3. ハイパーグラフ:ハイパーグラフは広義のグラフであり、そのエッジの 1 つは任意の数の頂点を接続できます。ハイパーグラフの研究の初期には、主にコンピュータ ビジョン シナリオへの応用に関連していましたが、最近ではグラフ ニューラル ネットワークの分野でも注目を集めています。主な応用分野とシナリオは推奨システムです。グラフ内のノードはさまざまな種類のノードを通過でき、複数のエッジが関連付けられます。さまざまなタイプのエッジを利用することで、グラフを複数の層に編成でき、各層が関係のタイプを表します。代表作はHGNN、AllSetなど。

4. 有向グラフ :

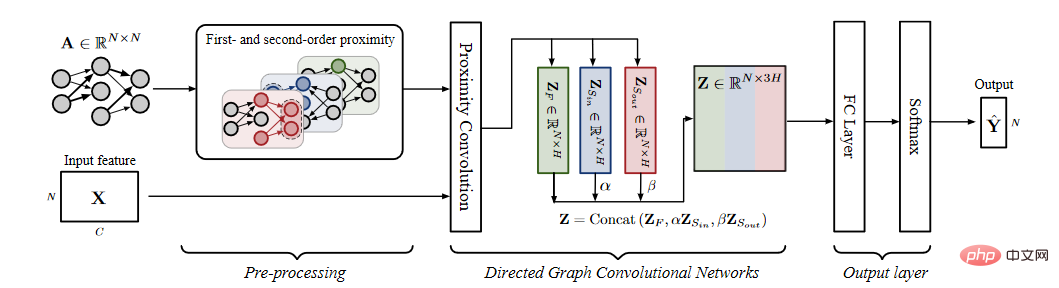

有向グラフとは、ノードの接続関係に方向性があることを意味し、有向エッジには無向エッジよりも多くの情報が含まれることがよくあります。たとえば、ナレッジ グラフでは、先頭エンティティが末尾エンティティの親クラスである場合、エッジの方向によってこの半順序関係に関する情報が得られます。有向グラフのシナリオでは、単純に畳み込み演算で非対称隣接行列を使用するだけでなく、エッジの 2 つの方向を個別にモデル化してより適切な表現を得ることができます (代表的な作品としては DGP などが挙げられます)。

#出典: DGP

#出典: DGP

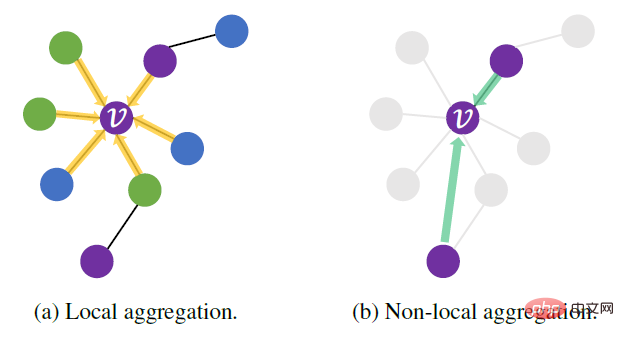

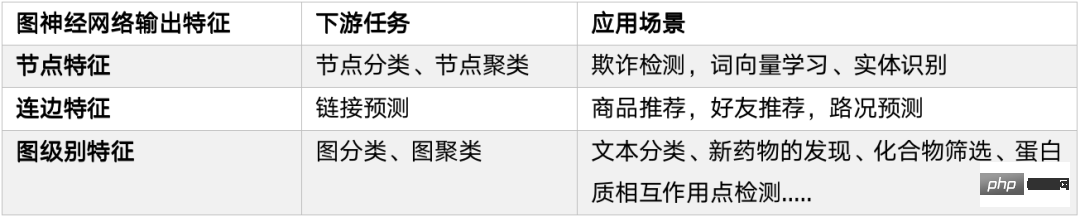

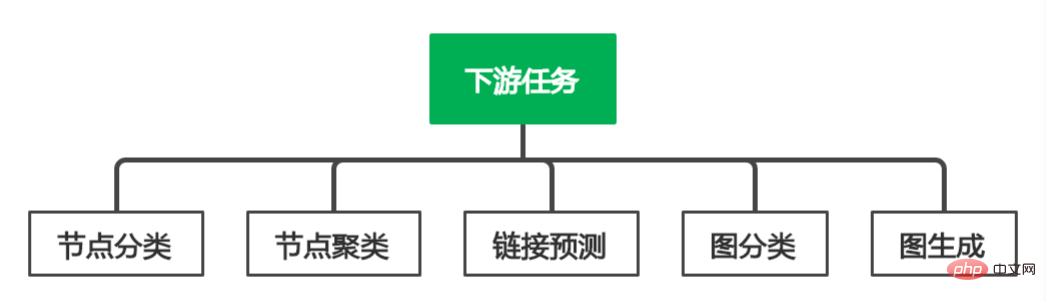

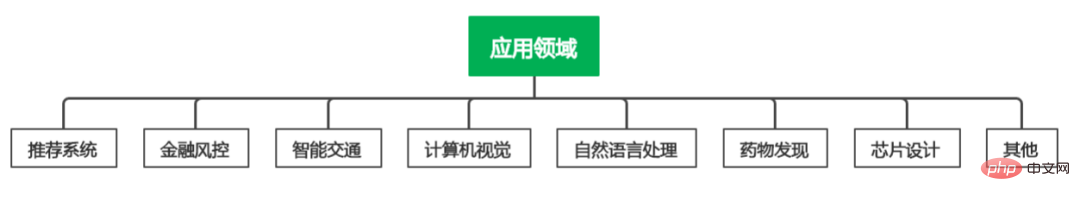

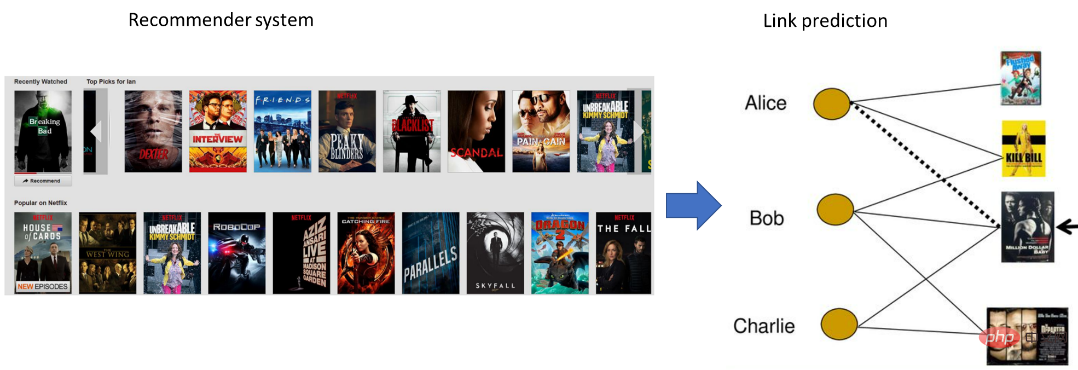

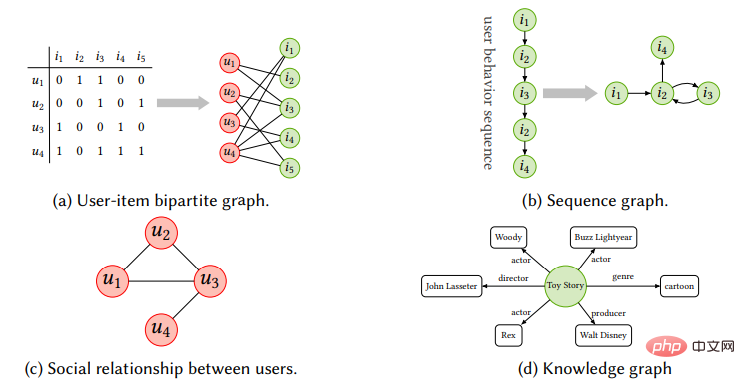

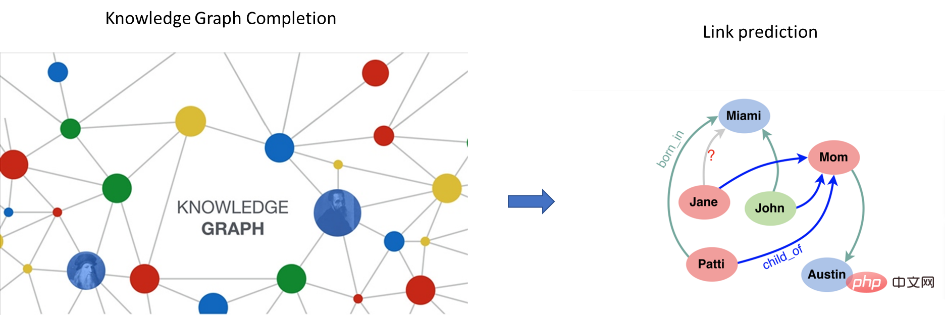

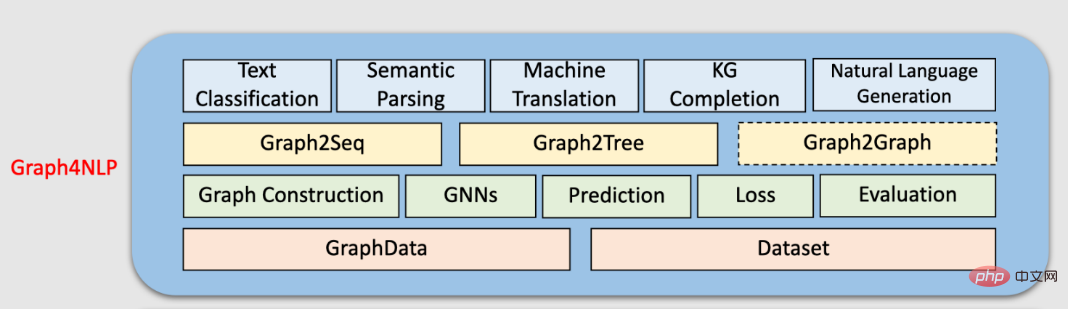

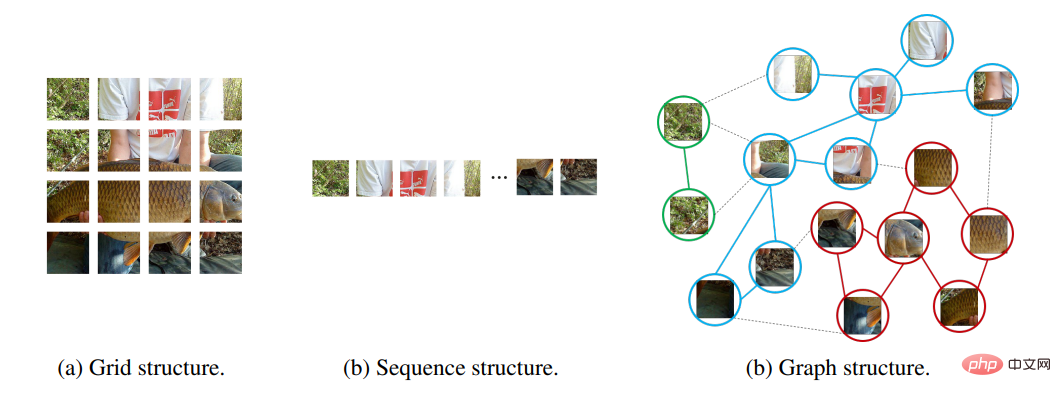

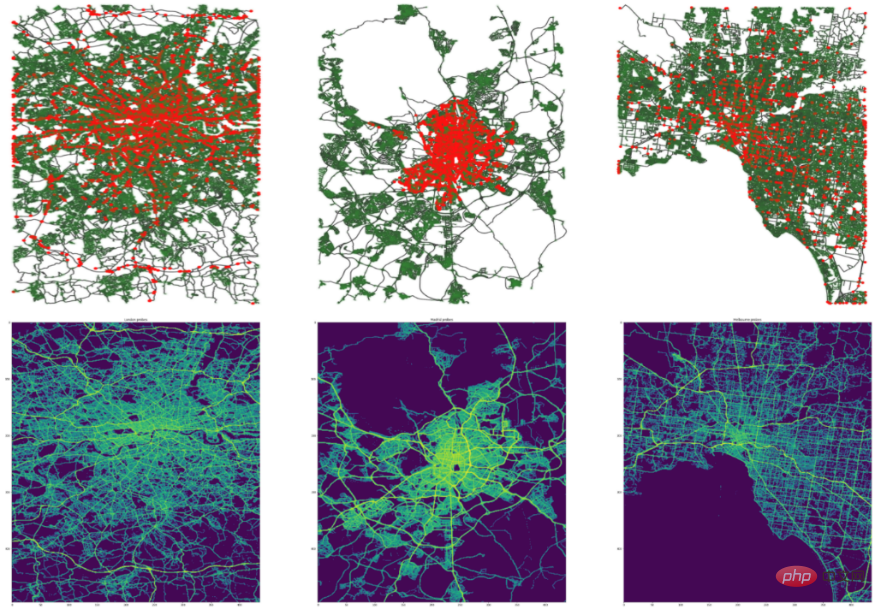

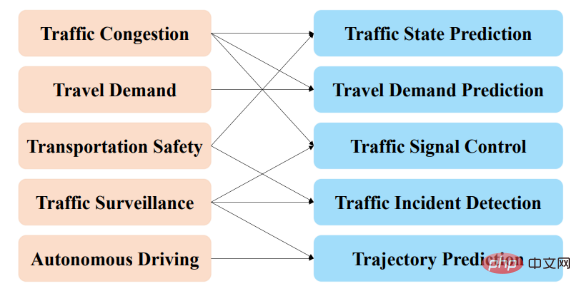

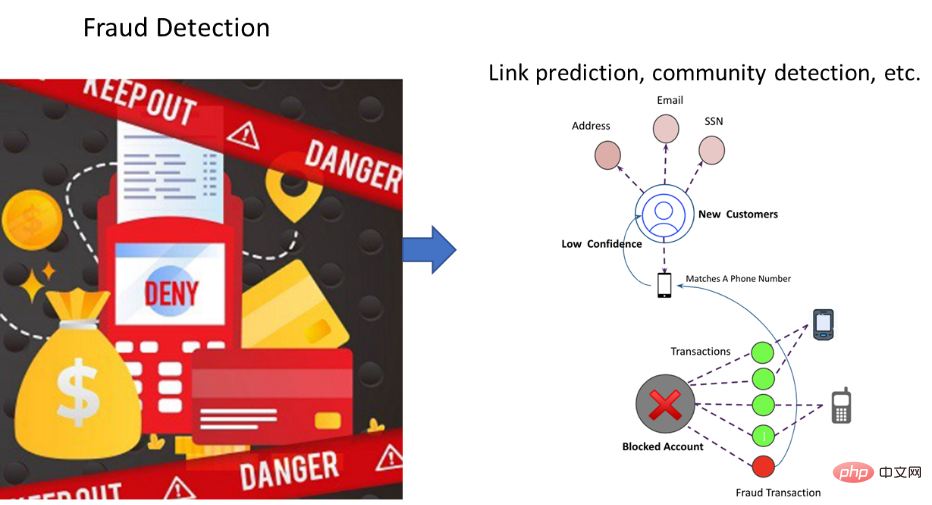

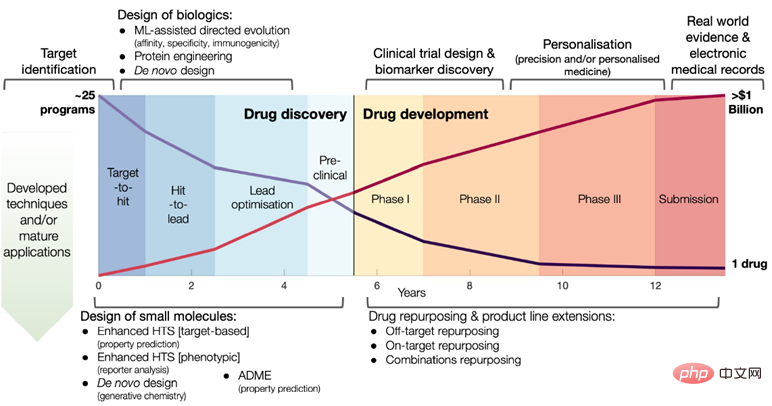

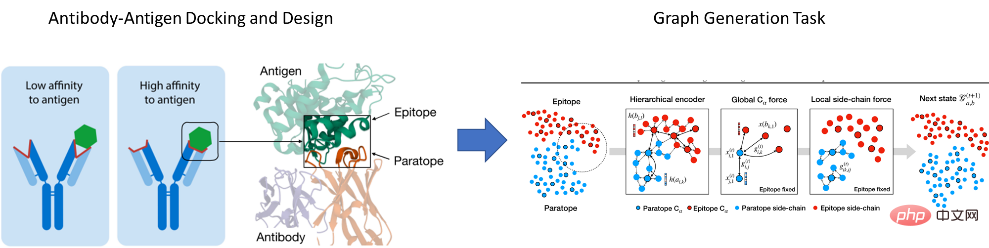

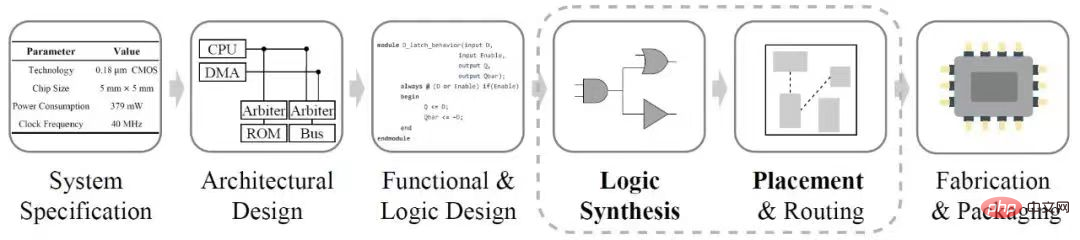

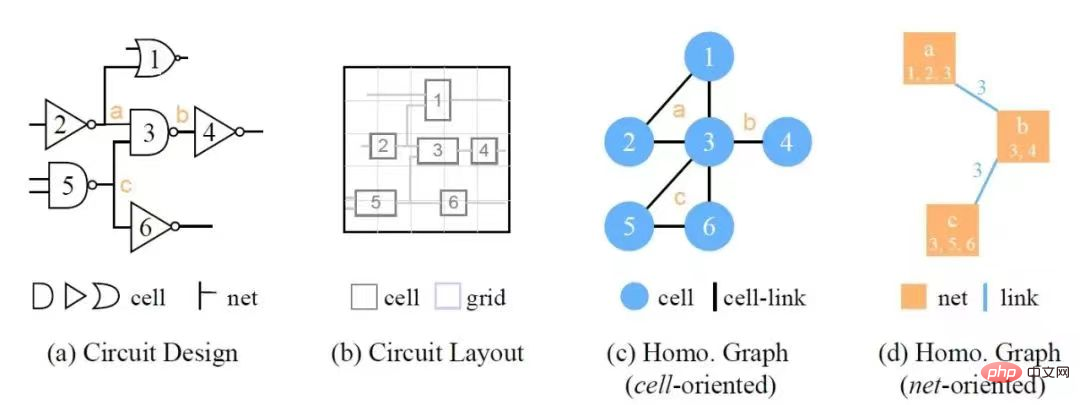

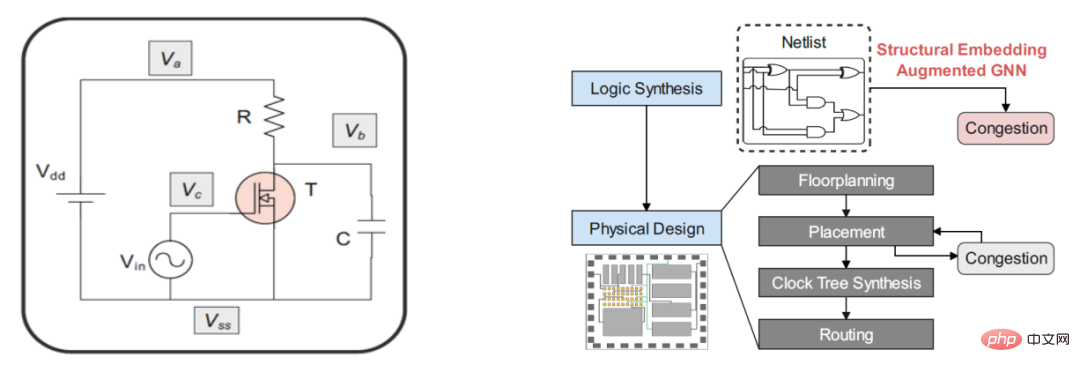

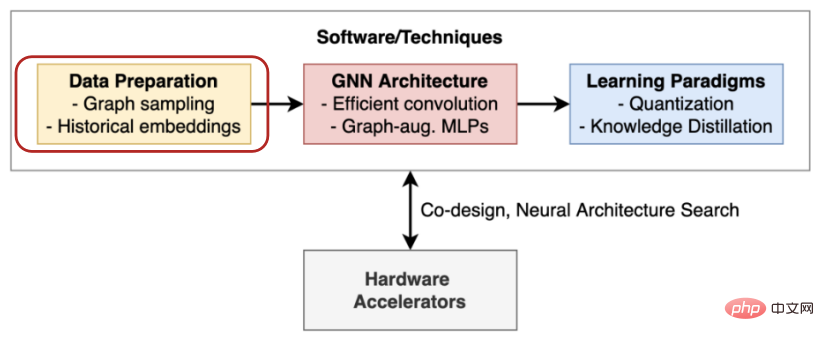

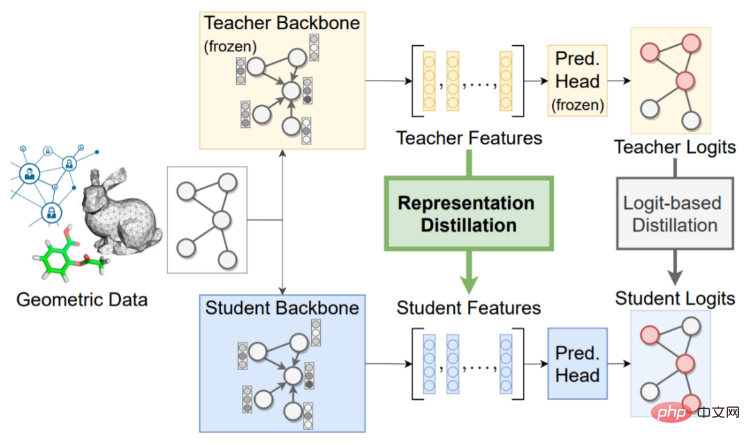

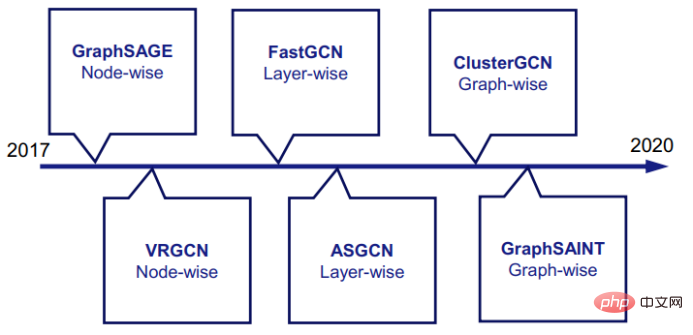

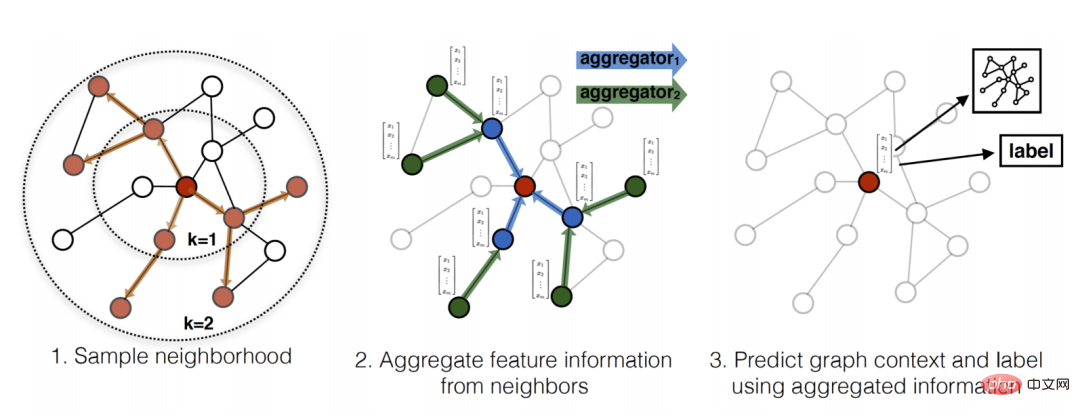

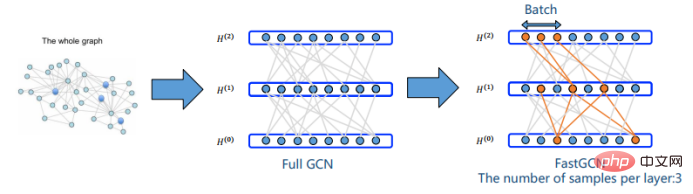

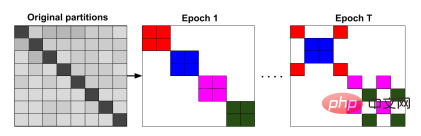

5. シンボル図:

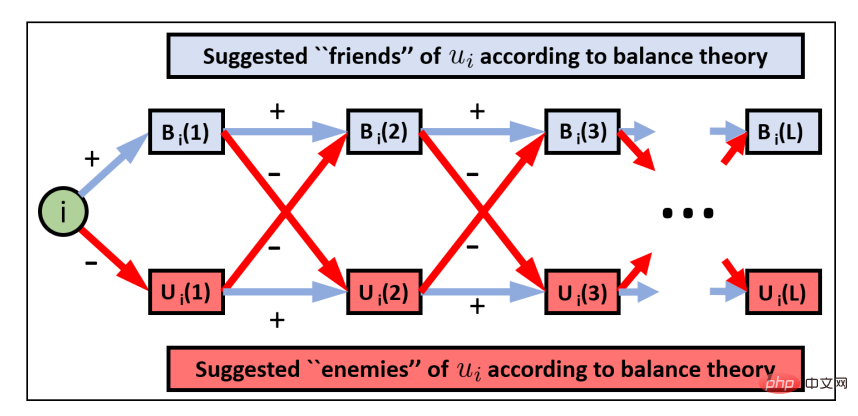

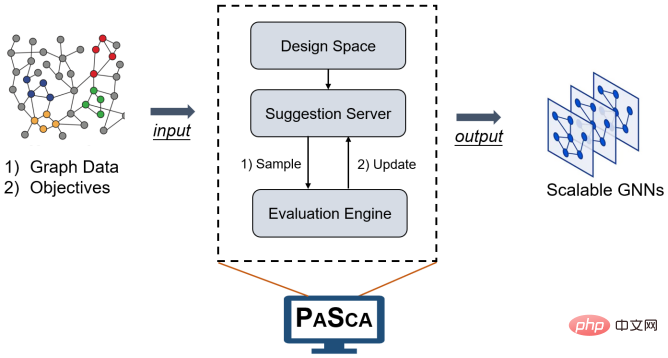

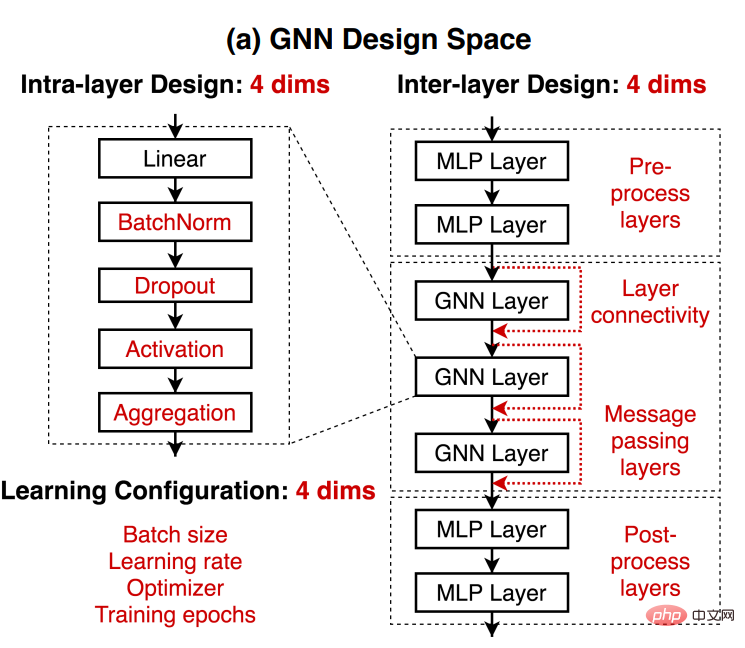

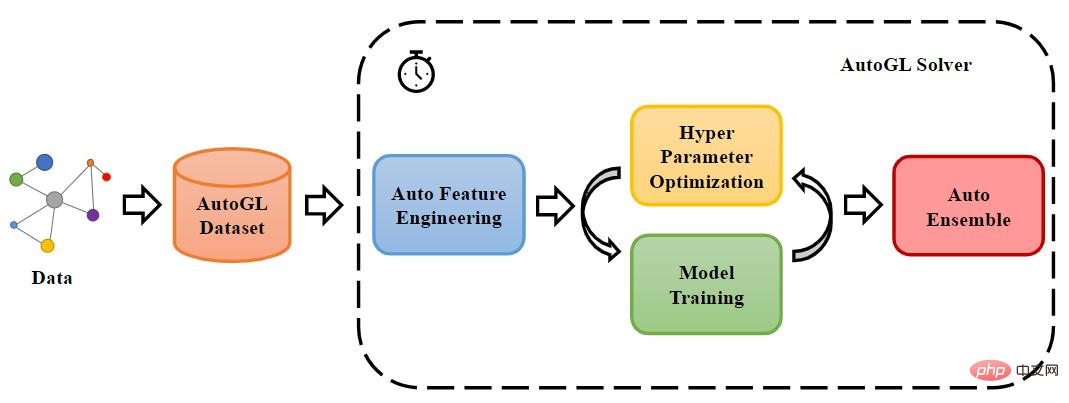

符号付きグラフは、順方向関係と逆方向関係を含む、グラフ内のノード間の関係を指します。たとえば、ソーシャル ネットワークでは、インタラクティブな関係には、友情、合意、サポートなどの肯定的な関係が含まれます。通常のグラフと比較して、シンボリック グラフには、より豊富なノードの相互作用が含まれています。シンボリック グラフをモデリングするときに解決すべき主な問題は、負のエッジをどのようにモデル化するか、および 2 種類のエッジに関する情報をどのように集約するかです。SGCN はバランス理論の仮定に基づいています (友人の友人は友人であり、敵の友人は敵です)。対応する平衡パスは、対応するモデリングを実行するために定義されます。その他、シンボリックネットワークを用いた偏光埋め込みモデルPOLE、二部シンボリックグラフニューラルネットワークモデルSBGNN、k群理論に基づくシンボリックグラフニューラルネットワークGS-GNNなどの代表作がある。 #出典: SGCN 6. 不一致の画像: #上記の他のタイプのグラフとは定義が少し異なります。ヘテロフィリー グラフは、グラフ データの特性を説明する指標です。いわゆるヘテロフィリー グラフは、グラフ上の隣接するノード間の類似性が比較的低いデータを指します。タイプヘテロガミーに相当するのはホモガミーです。これは、リンクされたノードが通常同じカテゴリに属するか、同様の特性 (「羽毛のある鳥が群れをなす」) を持つことを意味します。たとえば、友人が同じような政治的信念や年齢を持っている場合があり、論文では同じ研究分野の論文が引用される傾向があるかもしれません。ただし、現実世界のネットワークは、高度なホモプラシーの仮定に完全に準拠しているわけではなく、たとえば、タンパク質分子では、異なる種類のアミノ酸が結合しています。グラフ ニューラル ネットワークの集約とリンク関係による特徴の伝播のメカニズムは、同種のデータを前提としているため、異種性の高いデータに対して GNN の結果が劣悪になることがよくあります。現在、グラフ ニューラル ネットワークを異種グラフ シナリオに一般化しようとする多くの研究が行われています。たとえば、構造情報を使用してノードの近傍を選択するモデルである Geom-GCN や、メッセージパッシングメカニズム、中央ノード相関並べ替えに基づく情報集約のためのポインタネットワーク GPNN を構築することにより (以下の図に示すように、異なる色は異なるノードタイプを表します)、高周波信号処理と低周波信号処理を同時に組み合わせることにより FAGCN、等 3. グラフ ニューラル ネットワーク アプリケーション 1. 下流タスク ノードの属性 (カテゴリまたは数値)、エッジ情報、エッジ属性に応じて(存在する場合)、既知のノード予測ラベル、および未知のラベルを持つノードのカテゴリ予測。たとえば、OGB の ogbn-products データ セットは、無向製品購入ネットワークです。ノードは、電子商取引で販売される製品を表します。2 つの製品間のエッジは、これらの製品が一緒に購入されたことを示します。ノードの属性は、製品から決定されます。説明からバッグオブワード特徴が抽出され、主成分分析が実行されて次元削減が行われます。対応するタスクは、製品の欠落しているカテゴリ情報を予測することです。 リンク予測: ネットワークにおけるリンク予測 (Link Prediction) は、既知のネットワーク ノードやネットワーク構造などを通過する方法を指します。この情報は、ネットワーク内のまだ接続されていない 2 つのノード間のリンクの可能性を予測します。この予測には、未知のリンクの予測と将来のリンクの予測の両方が含まれます。リンク予測は、レコメンデーション システム、生化学実験、その他のシナリオで広く使用されています。たとえば、製品の推奨では、ユーザーと製品の 2 部グラフで、ユーザーが製品を購入すると、ユーザーと製品の間にリンクが存在します。似たユーザーは同じものを持っている可能性がある 商品には需要があるため、ユーザーと商品の間に「購入」や「クリック」などのリンクが発生しやすいかどうかを予測し、ユーザーにターゲットを絞った商品のレコメンドを行う、商品の購入率を高めることができます。さらに、自然言語処理におけるナレッジ グラフの完成やスマート交通における交通予測は、リンク予測問題としてモデル化できます。 グラフ分類: グラフ分類は実際にはノード分類に似ており、本質はグラフのラベルを予測することです。グラフの特性 (グラフ密度、グラフ トポロジ情報など) と既知のグラフのラベルに基づいて、未知のラベルを持つグラフのカテゴリ予測を行うことは、トレーニング グラフ ニューラルなどの生物情報学および化学情報学で見られます。タンパク質の構造を予測するためのネットワーク。 グラフ生成: グラフ生成の目標は、一連の観察されたグラフを与えられて新しいグラフを生成することです。たとえば、生物学的情報では、新しい分子構造の生成や自然言語処理に基づいて、与えられた文に基づいてセマンティック グラフやナレッジ グラフを生成します。 2. 応用分野 検討しますそれに応じて、さまざまなアプリケーション シナリオが紹介されます。 推奨システム: モバイル インターネットの発展により、情報検索の急速な発展が大きく促進されました。 . .レコメンデーション システムは、最も重要な方向性として広く注目されています。レコメンド システムの主な目的は、過去のインタラクションやサイド情報から効果的なユーザーとアイテムの表現を学習し、ユーザーが好む可能性が高いアイテム (商品、音楽、ビデオ、映画など) を推奨することです。したがって、グラフニューラルネットワークをレコメンドシステムに適用してレコメンド効果を向上させるために、アイテムとユーザをノードとする二部グラフを構築することを考えるのは自然なことである。 Pinterest は、GraphSAGE に基づいて、GCN に基づく初の産業レベルのレコメンデーション システムである PinSage を提案しました。これは、30 億のノードと 180 億のエッジによる大規模な画像レコメンデーション シナリオをサポートします。実際、オンライン化後、Pinterest のショップとルックの製品ビューは増加しました。さらに、アリババ、アマゾン、その他多くの電子商取引プラットフォームは GNN を使用して、対応する推奨アルゴリズムを構築しています。 ユーザーとアイテムのインタラクションで構成される二部グラフに加えて、レコメンデーション システムの社会的関係および知識グラフシーケンス内のアイテム転送グラフはグラフ データの形式で存在しますが、一方で、レコメンデーション システムの電子商取引シナリオでは、クエリ、アイテム、ショップ、ユーザーなどの異種データも広く存在します。エッジ タイプには、クリック、収集、取引などがあります。プロジェクト間、ユーザーとユーザー、ユーザーとプロジェクト間の関係やコンテンツ情報を活用し、マルチソースの異種混合およびマルチモーダルグラフモデルに基づいて、より質の高いレコメンド効果も継続的に探索されています。さらに、実際のビジネスにおける時間の経過に伴うユーザー行動の変化に基づいたシリアル化された推奨事項や、新しいユーザーや製品の追加による増分学習も、GNN モデルの開発に新たな課題と機会をもたらしました。 自然言語処理: 自然言語処理における多くの問題とシナリオについて説明します。関連関係を表すと、グラフ データ構造として自然にモデル化できます。最初の直接適用シナリオは、ナレッジ グラフ (KG) の完成と推論です。たとえば、Mila の研究者は、シングルホップ推論問題を NBFNet に基づいたパス表現学習問題にモデル化し、それによってナレッジ グラフを実現することを提案しました。 。グラフ ニューラル ネットワークは、ディープ ニューラル ネットワークを使用して、グラフ データ内の位相構造情報と属性特徴情報を統合することで、ノードまたは部分構造のより洗練された特徴表現を提供し、分離またはエンドツーエンドの方法でダウンストリームと簡単に通信できます。エンティティと関係の属性特性と構造特性を学習するための、さまざまなアプリケーション シナリオにおけるナレッジ グラフの要件を満たします。 さらに、グラフ ニューラル ネットワークは、テキスト分類、意味分析、機械翻訳、ナレッジ グラフ補完、固有表現認識、機械分類、その他のシナリオなど、自然言語処理の多くの問題で使用されます。対応するアプリケーションの詳細については、Wu Lingfei 博士の Graph4NLP 関連のチュートリアルとレビューを参照することをお勧めします。 出典: (https://github.com/graph4ai/graph4nlp) コンピュータ ビジョンは、機械学習と深層学習の分野における最大のアプリケーション シナリオの 1 つであり、レコメンデーション システムや自然言語処理の分野と比較すると、グラフニューラル インターネットはコンピュータ ビジョンの主流ではありません。その理由は、GNN の利点は関係のモデリングと学習にあり、コンピューター ビジョンのデータ形式のほとんどは通常の画像データであるためです。 CV シナリオで GNN を使用する場合、鍵となるのはグラフの構築方法、つまり頂点と頂点特徴とは何でしょうか。頂点の接続関係を定義するにはどうすればよいですか?初期作業は主に、直感的でグラフ構造を抽象化しやすいいくつかのシーンに使用されます。例えば、動的骨格に用いられる動作認識手法ST-GCNでは、人体の自然な骨格を自然にグラフ構造とみなして空間グラフを構築することができます。シーン グラフの生成では、オブジェクト間の意味論的な関係は、ビジュアル シーンの背後にある意味論的な意味を理解するのに役立ちます。画像が与えられると、シーン グラフ生成モデルはオブジェクトを検出および識別し、オブジェクトのペア間の意味論的な関係を予測します。点群の分類とセグメンテーションでは、点群が k 最近傍グラフまたはオーバーレイ グラフに変換され、グラフ ネットワークを使用して関連タスクが学習されます。最近では、コンピュータ ビジョンにおけるグラフ ニューラル ネットワークの応用方向も高まっています。研究者の中には、物体検出などの一般的なコンピュータ ビジョン タスクにおいて、関連する調査や試みを行っている人もいます。たとえば、ファーウェイは、グラフ表現に基づいた新しい一般的なビジュアル アーキテクチャを提案しました。ViG では、研究者は入力画像を多くの小さなブロックに分割し、対応するノード グラフを構築しました。実験結果は、行列やグリッドと比較して、グラフ構造がオブジェクトのコンポーネントをより表現できることを示していますより理想的な結果を達成するために、柔軟な関係を構築します。 インテリジェントな交通: 交通のインテリジェントな管理は、現代の都市におけるホットな問題です。交通ネットワークにおける交通速度、交通量、道路密度を正確に予測することは、ルート計画と流量制御において非常に重要です。トラフィック フローは高度に非線形で複雑な性質を持っているため、従来の機械学習手法では空間依存性と時間依存性を同時に学習することが困難です。オンライン旅行プラットフォームと物流サービスの急速な発展により、インテリジェント交通のための豊富なデータ シナリオが提供されており、ニューラル ネットワークを使用して交通データの時空間相関を自動的に学習し、より優れた交通流の分析と管理を実現する方法が研究のホットスポットになっています。都市交通 (下の図に示すように) は自然に不規則なグリッドの形で存在するため、インテリジェントな交通管理にグラフ ニューラル ネットワークを使用することは非常に自然な研究です。 たとえば、古典的な時空間ネットワーク STGCN は、GCN を使用して各瞬間の各トラフィック フロー マップの空間特徴をキャプチャし、時間次元での畳み込みを通じて各ノードの時間特徴をキャプチャします。 2 クロスハイブリッド並列処理を操作して、時空間の両方の次元での特徴のエンドツーエンド学習を実現します。また、マルチソース情報を使用してさまざまな視点からノード関連グラフを構築し、情報を集約してより正確な予測効果を実現する対応する作業もあります。グラフ ニューラル ネットワークは、交通予測に加えて、信号機管理、交通イベント検出、車両軌道予測、道路渋滞予測などの多くの側面でも使用されています。近年、KDD や NeurIPS などのトップカンファレンスの関連コンテストでも、対応するトラフィック予測問題が設定されており、勝者のソリューションには基本的にグラフ ニューラル ネットワークが含まれています。時空間ダイナミクスが同時に存在するため、インテリジェント交通分野における関連アプリケーションの需要が、時空間グラフ ニューラル ネットワークの開発の最も重要な推進力であると言っても過言ではありません。 財務リスク管理: 市場経済の発展と業界のデジタル化のプロセスに伴い従来のビジネスがオンラインに移行する一方で、さまざまな新しいオンライン製品やサービスも日々増加しており、大量のデータと複雑な関係が金融取引や関連する監査に大きな課題をもたらしています。銀行の与信管理や上場企業のリスク管理は、金融市場の秩序を維持する上で重要な役割を果たしています。 Alipay や Paypal などの新興のグローバル決済管理システムの推進に伴い、それらを保護する決済リスク管理システムは、ユーザー資金のセキュリティを保護し、カード盗難やアカウント盗難を防止し、プラットフォームの損失を軽減する上で重要な役割を果たしています。しかし、従来のアルゴリズムでは、関連情報を含むグラフ ネットワーク データの分析を解決するには不十分であり、グラフ データを処理するグラフ ニューラル ネットワークの機能のおかげで、さまざまな金融リスク管理シナリオにおける一連の実践が登場しました。たとえば、取引プロセス中の融資前後のリスク評価、バーチャルアカウント/詐欺/不正行為の検出などです。グラフ深層学習技術の適用はリスク管理の分野で効果的かつ必要であることが証明されていますが、開発期間は短く、全体的なプロセスはまだ開発の初期段階にあります。業界データのプライバシーにより、主要な技術革新は依然として対応する企業に基づいており、その中で最も顕著なのは Ant Financial と Amazon です。たとえば、Ant Financial が提案した GeniePath アルゴリズムは、アカウントのバイナリ分類問題として定義されており、グラフ畳み込みを使用して悪意のあるアカウントを識別する Ant Financial が提案した最初の GEM アルゴリズムは、主にアカウントのログイン/登録シナリオで使用されます。データのプライバシーとシナリオの多様性により、モデルの比較と検証のための業界内での統一基準が欠如しています。最近、Xinye Technology と浙江大学は共同で大規模な動的グラフ データセット DGraph をリリースしましたが、これは、詐欺やその他の異常検出シナリオの検証に実際の現場の大規模データを提供します。ノードは、Xinye が提供する金融融資ユーザーを表しています。エッジは緊急連絡先関係を表し、各ノードには感度を下げた属性特性と、ユーザーが金融詐欺ユーザーであるかどうかを示すラベルが含まれています。データ障壁などの問題はありますが、金融リスク管理シナリオにおける一般的なデータの不均衡、ラベルの取得の難しさ、モデルの解釈可能性の要求なども、グラフ ニューラル ネットワークの開発に新しい考え方と機会をもたらしています。 創薬: 創薬は長期にわたる、費用がかかり、リスクの高い仕事です。最初の医薬品設計と分子スクリーニングからその後の安全性試験と臨床試験まで、新薬の研究開発サイクルには約 10 ~ 15 年かかり、各医薬品の平均研究開発コストは約 30 億米ドルです。このプロセス中、1時間とコストの 3 分の 1 は創薬段階に費やされます。特に、新型コロナウイルス感染症(COVID-19)のような感染症の流行に直面して、深層学習モデルを効果的に使用して、可能性のある多様な候補分子を迅速に発見し、新薬の開発プロセスを加速する方法は、多くの研究者の考えと参加を呼び起こしています。 医薬品の研究開発に関わる分子化合物、タンパク質、その他の物質は、当然のことながらグラフ構造として存在します。分子を例にとると、グラフの端は分子内の原子間の結合、またはタンパク質内のアミノ酸残基間の相互作用である可能性があります。さらに大きなスケールでは、グラフはタンパク質、mRNA、代謝産物などのより複雑な構造間の相互作用を表すことができます。細胞ネットワークでは、ノードは細胞、腫瘍、リンパ球を表し、エッジはそれらの間の空間的近接性を表します。したがって、グラフ ニューラル ネットワークには、分子特性の予測、ハイスループット スクリーニング、新薬設計、タンパク質工学、および薬物の再利用において幅広い応用の見通しがあります。たとえば、MIT CSIAL の研究者とその共同研究者は、グラフ ニューラル ネットワークを使用して分子が抗生物質特性を持つかどうかを予測する研究を Cell (2020) に発表しました。今年、同グループのメンバーらは、特定の抗原に高度に適合する抗体を設計するための、グラフ生成法に基づいた抗原ベースの条件付き生成モデルの構築などの一連の研究を提案した。 Mila Labs は、グラフ学習を創薬に適用する先駆者でもあり、最近では、対応する探索に基づく PyTorch ベースの創薬機械学習プラットフォーム、TorchDrug をオープンソース化しました。また、大手テクノロジー企業も近年、AI医薬品の計画と探索を行っており、それに応じて優れた成果を上げており、Tencent AI Labの「Yunshen」プラットフォームは、業界初の医薬品AIの大規模な流通外研究フレームワークをリリースしました。 、DrugOODは、医薬品研究開発産業の発展を支援するために、医薬品シナリオにおける流通シフト問題に関する研究を推進します。 Baidu の創設者 Robin Li によって設立された Baidu Biotech は、高度な AI テクノロジーと最先端のバイオテクノロジーを組み合わせて、独自の標的発見と創薬を生み出すことに取り組んでいます。 ##チップ設計: チップイットはデジタル時代の魂であり、情報産業の 3 つの要素の 1 つです。グラフ構造化データは、チップ設計の複数の段階で実行されます。たとえば、論理合成段階では、デジタル回路が NAND グラフで表現されます。物理設計段階では、論理合成によって生成された回路ネットリストに基づいて相関関係が生成されます。制約、エンジニア特定の密度と混雑制限の要件に従って、チップのレイアウトと配線を完了します。 回路のサイズと複雑さが増大し続けるにつれて、設計は電子設計自動化(EDA)ツールの効率と精度は重要な問題となっており、研究者は回路設計プロセスを支援するディープラーニング技術を採用するようになっています。チップ設計の初期段階で回路の品質と使いやすさを予測できれば、チップの反復効率が向上し、設計コストを削減できます。例えば、物理設計段階で回路の混雑状況を予測することで、回路の欠陥を検出して不良チップの発生を回避できますが、論理合成段階で予測できれば、チップの設計・生産サイクルをさらに短縮することができます。 Google とスタンフォード大学のチームは、Google TPU チップ ブロックの消費電力、面積、パフォーマンスの最適化など、強化学習と組み合わせてハードウェア設計に GNN を使用することに成功しました。チップのネットリスト表現におけるさまざまな異種情報を考慮して、ファーウェイと北京大学によって提案されたCircuit GNNは、位相情報と幾何学的情報を統合することによってマップを構成し、セルとネットの属性予測のためのさまざまなEDAタスクのパフォーマンスを向上させることができます。 前のコンテンツでは、グラフ モデルの基本的なパラダイムとそれに対応するアプリケーション シナリオを紹介しましたが、グラフ ニューラル ネットワークは新しい深さ学習アーキテクチャとしてさまざまな分野で活躍することがわかります。ソーシャルネットワーク、推奨システム、生物医学的発見などの分野。ただし、実際のアプリケーションでは、グラフィカル モデルのスケーラビリティと使いやすさに関して、依然として多くの理論的および工学的課題に直面しています。 1 つ目はメモリの制限です。設計の初めに、GCN の畳み込み演算はグラフ全体で実行されました。つまり、各層の畳み込み演算はグラフ全体を横断しますが、実際のアプリケーションでは、必要なメモリと時間のオーバーヘッドは許容範囲外です。さらに、従来の機械学習フレームワークでは、モデルの損失関数を個々のサンプルの損失の合計に分解できるため、ミニバッチおよび確率的最適化を使用して、GPU メモリよりもはるかに大きいトレーニング セットを処理できます。ただし、GNN のトレーニングでは、サンプルが独立している機械学習の標準データセットとは異なり、ネットワーク データのリレーショナル構造によりサンプル間に統計的な依存関係が生じます。ランダム サンプリングを通じてミニバッチ トレーニングを直接実行すると、多くの場合、モデル効果が大幅に低下します。ただし、サブグラフが完全なグラフのセマンティクスを保持し、GNN のトレーニングに信頼できる勾配を提供することを保証するのは簡単な問題ではありません。 2 つ目はハードウェアの制限です。画像データやテキスト データと比較すると、グラフは本質的に疎な構造であるため、効率的かつスケーラブルな計算にはその疎性を利用する必要がありますが、対応する深層学習プロセッサと関連ハードウェアの現在の設計は、行列の集中的な演算を処理することを目的としています。このセクションでは、主にグラフ モデルのスケーラビリティについてまとめます。ケンブリッジ大学の博士課程学生である Chaitanya K. Joshi 氏の要約を参照すると、関連する研究は、データ前処理、効率的なモデル アーキテクチャ、新しい学習パラダイム、およびハードウェア アクセラレーションの 4 つの側面に要約できます (次の図を参照)。 。 データ前処理では、通常、元のデータをサンプリングまたは単純化することによって、大規模なグラフ データの計算が実装されます (さらに下で説明します)。新しいアーキテクチャは、特定のタスクやデータの観点から、より効率的で簡潔な新しいアーキテクチャを提案します。たとえば、LightGCN は隣接するノード間の内積部分を除去して実行速度を高速化します。一部の研究では、ノード フィーチャで MLP を実行した後にラベル伝播メソッドを使用すると、良好な結果が得られることも判明しています。さらに、知識の蒸留や量子化を意識したトレーニングなどの軽量学習パラダイムを通じて、GNN のパフォーマンスを向上させ、レイテンシを短縮することもできます。言及すべき点は、グラフ ニューラル ネットワークのトレーニングを高速化する上記の方法は互いに切り離されているということです。これは、実際のシナリオでは複数の方法を同時に使用できることを意味します。 出典: G-CRD@TNNNLS # #データ前処理は、モデル最適化や新しい学習パラダイムと比較して、より一般的で応用性の高い手法であり、現時点でも相対的に言えますが、ここで簡単に分析して紹介します。一般に、データ前処理方法では、メモリの制約を満たすために、サンプリングやグラフの簡略化を使用して元の画像のサイズを削減します。 1. サンプリング ベースのデータ処理 サンプリング ベースのメソッドは、ノードという 3 つのサブカテゴリに分類できます。 -ワイズサンプリング、レイヤーワイズサンプリング、グラフワイズサンプリング。 ノードごとのサンプリング: GraphSage によって最初に提案された、比較的一般的で効果的で最も広く使用されている方法です。 GraphSAGE の 1 つの層は、1 ホップの隣接ノードからの情報を集約します。GraphSAGE の k 層をオーバーレイすると、k ホップの隣接ノードによって誘発されるサブグラフへの受容野を増加させることができます。同時に、隣接ノードは均等にサンプリングされ、速度を制御できます。集約操作を実行し、近傍の数を減らすことで、計算の量を減らします。ただし、層の数が増加するにつれて、サンプリングされる近傍の数も指数関数的に増加することに注意してください。最終的には、k ホップの近傍によって引き起こされるサブグラフ上のメッセージ集約と同等であり、時間計算量は次のようになります。実質的ではありません。改善してください。 #レイワイズサンプリング:Fast GCN によって初めて提案されました. GraphSAGE とは異なり, ノードの近傍サンプリング範囲を直接制限します. 重要度サンプリングを通じて, GraphSAGE の各サンプル ノードをすべてのノードから小さなバッチでサンプリングします. 近傍セットは独立しており, すべてのサンプル ノードFast GCN の複数の層は同じ近傍セットを共有するため、計算量を線形レベルに直接制御できます。ただし、処理しているグラフが大きくてまばらな場合、この方法でサンプリングされた隣接する層からのサンプルは、まったく関係がないため、学習できなくなります。 グラフごとのサンプリング: 近隣サンプリング手法とは異なり、グラフ サンプリング手法は次のとおりです。たとえば、Cluster GCN は、元の画像のサブグラフのサンプリングに基づいて、クラスタリングのアイデアを使用してグラフをトレーニング用の小さなブロックに分割し、グラフのサンプリングを実現します。グラフ クラスタリング アルゴリズム (METIS など) は、類似したノードをグループ化するため、クラス内のノード分布が元のグラフのノード分布から逸脱します。グラフ サンプリングによって引き起こされる問題を解決するために、Cluster GCN は複数のカテゴリをバッチとして同時に抽出し、ノード分布のバランスをとるためのトレーニングに参加します。ただし、構造ベースのサンプリング手法の情報損失は比較的大きく、ほとんどのデータ結果はフルバッチ GNN よりも大きく、各エポックでサンプリングする必要があり、時間のオーバーヘッドは小さくありません。 サンプリングに加えてある程度のグラフ縮小を行うことは、後続の処理と分析のために重要な属性を保持しながら、元のグラフのサイズを縮小する実現可能な方向でもあります。グラフの単純化には、主にグラフの疎化 (グラフのエッジの数を減らす) とグラフの粗化 (グラフの頂点の数を減らす) が含まれます。 その中でも、一部のサブグラフをスーパーノードに集約するグラフ粗化は、元のグラフの単純化を実現するのに適したフレームワークです。イメージスケール。加速された GNN トレーニングにグラフ粗化を使用するアルゴリズムは、KDD 2021 の作業で最初に提案されました。プロセスは次の図に示すとおりです。 ##まず、グラフ粗化アルゴリズム (スペクトル クラスタリング粗化など) を使用して元のグラフを粗化し、粗化されたグラフ G' でモデル トレーニングを実行することで、グラフ ニューラル ネットワークのトレーニングに必要なパラメーターを削減し、トレーニングを削減します。時間と実行メモリのオーバーヘッド。この方法は普遍的に単純であり、トレーニング時間とスペースが線形です。著者の理論分析では、スペクトル クラスタリングによって粗くなったグラフでの APPNP トレーニングが、元のグラフでの制限された APPNP トレーニングと同等であることも示しています。ただし、グラフ サンプリング方法と同様に、グラフの粗大化に基づく方法でもデータの前処理が必要であり、時間のオーバーヘッドは実験結果と粗大化アルゴリズムの選択に関係します。 同様に、上で紹介したいくつかのサンプリングまたは単純化されたグラフ モデル拡張メソッドも、互いに切り離されたメソッドです。つまり、クラスター GCN など、複数のメソッドを同時に一緒に使用できます。グラフSAGE。本質的に、k ホップ近傍によって引き起こされるサブグラフ上のメッセージの集約は指数関数的な操作です。元の画像を前処理しながらダウンサンプリングしながら、情報を失わずに線形レベルでのノード サンプリングに基づいてアルゴリズムの時間計算量を制御することは困難です。画像全体を計算のためにメモリに入れることができれば、GCN の時間計算量は線形になりますが、前処理のコストは無視できないため、これは良い解決策です。世界にはフリーランチはありません. グラフ ニューラル ネットワークのトレーニング高速化には依然として情報損失と前処理オーバーヘッドの間のトレードオフが必要です. 実際の状況に基づいて分析するには、さまざまな方法を使用する必要があります。 さらに、グラフは本質的に疎なオブジェクトであるため、設計効率とスケーラビリティの問題は、データの疎性の観点からさらに考慮する必要があります。しかし、最新の GPU は行列に対する集中的な演算を処理するように設計されているため、これは言うは易く行うは難しです。スパース行列用にカスタマイズされたハードウェア アクセラレータは、GNN の適時性とスケーラビリティを大幅に向上させることができますが、関連する作業はまだ開発の初期段階にあります。さらに、グラフコンピューティングのためのコミュニケーション戦略の設計も、最近非常に注目を集めている方向です。たとえば、VLDB2022 と Webconf 2022 の最優秀研究論文賞と最優秀学生論文賞は、グラフ モデルの処理を高速化するシステムまたはアルゴリズムに授与されました。その中で、SANCUS@VLDB2022 は、通信量を削減し、分散メカニズムを使用してグラフ ニューラル ネットワークの分散トレーニングを高速化することを目的とした、一連の分散トレーニング フレームワーク (SANCUS) を提案しました。この記事では、SANCUS の収束速度がフルグラフ トレーニングの収束速度に近いことを理論的に証明するだけでなく、多数の実際のシーン グラフの実験を通じて、SANCUS のトレーニング効率と精度も検証しています。 PASCA@Webconf2022 の取り組みでは、メッセージ パッシング フレームワークにおけるメッセージ集約操作と更新操作を分離することを試み、分散シナリオでの通信オーバーヘッドを達成するための前処理、トレーニング、後処理の新しいパラダイムを定義します。 出典: PASCA@Webconf2022 コンピューティング リソースの急速な成長とディープ ニューラル ネットワークの強力な表現能力のおかげで、ディープ ラーニングは、知識 掘削するための重要なツール。グラフは、エンティティとその関係を簡潔な形で表現する多用途かつ強力なデータ構造であり、自然科学や社会科学のアプリケーションで広く普及しています。ただし、現実世界のグラフ データは構造、内容、タスクが大きく異なるため、あるタスクで最高のパフォーマンスを発揮する GNN ネットワークとアーキテクチャの設計が、別のタスクには適していない可能性があります。特定のデータ セットと予測タスクについて、良好な結果を持つモデルを迅速に取得する方法は、研究者やアプリケーション アルゴリズム エンジニアにとって非常に意味があります。特定のデータセットと予測タスクに対して、どのようなニューラル ネットワーク アーキテクチャが効果的ですか?適切な GNN 設計を自動的に予測するシステムを構築できるでしょうか?これらの考えをもとに、Jure Leskovec のグループは、2020 年にグラフ ニューラル ネットワーク設計空間に関する発表された研究の中で、GNN の設計空間を 3 つのレベルから定義しました。基礎。 特定のタスクと特定のデータセットが与えられた場合、最初に次のパスを渡すことができます: (1) 層内設計: 単一の GNN 層の設計。 # (2) 層間設計: GNN 層を接続する方法。 #(3) 学習構成: 機械学習のパラメータを設定する方法。 対応する GNN 設計空間を 3 方向に構築し、モデルを並べ替えることで特定のタスクにおけるパフォーマンスの違いを定量化して、与えられたデータの下での最適なモデル設計を理解します。さらに、新しいタスクとデータについては、新しいデータセットとタスク空間内の既存のコレクションの間の類似性を計算するだけで、最も類似したタスクを迅速に特定し、その最適なモデルを新しいデータに移行することもできます。セット。このようにして、これまでに使用されたことのないデータセットからより良いモデルを迅速に取得できます。もちろん、グラフ上の自動機械学習とグラフ モデルの移転可能性は、学術研究や産業応用において非常に重要な問題です。過去 2 年間、関連する多くの調査や考察が行われてきました。ここでは触れません。グラフ上の自動機械学習に関するさらなる研究については、清華大学教師 Zhu Wenwu の学術グループとそのオープンソース自動学習ツールキット AutoGL および第 4 パラダイムの関連研究の関連レビューに注意を払うことをお勧めします。業界。 #出典: AutoGL 前述得られたモデル設計空間は主にモデル構造レベルに焦点を当てていますが、モデルの表現または学習空間という別の非常に重要な次元があり、これも補足することが非常に必要です。グラフ機械学習は、グラフデータの表現学習手段であり、元データを学習して観測結果を予測するのではなく、データの基礎となる構造を学習し、対応する元データの特徴学習を行うことを目的としています。下流のタスクでより良い結果を達成するためのパフォーマンスと表現。 ユークリッド空間は私たちの直観的で親しみやすいビジュアルを自然に一般化したものであるため、最新の表現学習はユークリッド空間で実行されます。スペースが広く、計算と計算の面で大きな利点があります。しかし、誰もが知っているように、グラフは非ユークリッド構造を持っています。たとえば、複雑なネットワークの分野の研究では、実際のネットワーク データ (ソーシャル ネットワーク、商品ネットワーク、電気通信ネットワーク、病気など) にはスケールフリーの特性が多数存在することが示されています。ネットワーク、セマンティック ネットワークなど) (スケールフリー)、これはツリー状/階層構造が現実には遍在していることを意味します。対応するモデリングを実行するための表現学習の事前空間としてユークリッド空間を使用すると、必然的に対応するエラー (歪み) が発生します。したがって、最近、異なる曲率空間に基づく表現学習が注目を集めています。曲率は空間の曲率の尺度であり、曲率が 0 に近づくほど、空間は平坦になります。 SF 小説「三体問題」では、人類は空間の曲率の変化を利用して曲率宇宙船を建造しています。以下の図に示すように、ユークリッド空間はどこでも均一かつ平坦であり、等方性と並進不変性を備えているため、グリッド データのモデリングに適しています。正の曲率を持つ球面の空間距離測定は角度測定と同等であり、回転不変性があるため、リング データや高密度で均一なグラフ データ構造のモデリングに適しています。負の曲率を持つ双曲空間距離計量はべき乗則分布に相当し、スケールフリー ネットワークやツリー構造のモデリングに適しています。 ##実際のデータには不明なデータが多数あるため、ネットワーク データ、スケールフリーとは、ツリー状/階層構造が現実に遍在していることを意味します。中でも双曲空間は、従来のネットワーク科学の分野においてツリー構造・階層構造の連続表現とされており、実際のデータのモデリングに適しており、近年多くの優れた作品が生まれています。さらに、ユークリッド空間と比較して、双曲空間の体積は半径とともに指数関数的に増加するため、より大きな埋め込み空間を持ちます。ユークリッド空間とは異なり、双曲空間は複数のモデルで記述できるので、ポアンカレ球を例に簡単に紹介します。 ポアンカレ円板は、埋め込み空間を単位球に制限することにより双曲モデルになります。ポアンカレ球の双曲モデルでは、上の明るい三角形と暗い三角形はすべて同じサイズですが、ユークリッドの観点から見ると、エッジ近くの三角形は比較的小さくなります。つまり、ヨーロッパの視点で見ると、上の円の中心を原点として、半径が大きくなるにつれて三角形の数が増えていきます。 ##双曲空間モデリングの使用は、「風船を膨らませる」ようなものであると想像できます。しぼんだ風船の表面に 10 億個のノードがあると仮定すると、これは非常に高密度の状態になります。風船が徐々に膨張して大きくなるにつれて、風船の表面はますます「湾曲」し、節点はさらに離れていきます。 Alimama の技術チームは曲率空間 (Curvlearn) をタオバオベースの検索広告シナリオに適用し、システムの完全開始後、ストレージ消費量が 80% 削減され、ユーザー側のリクエスト照合精度が 15% 向上しました。推奨システムに加えて, 双曲線グラフ モデルはさまざまな異なるシナリオで優れた結果を示しています. 関連コンテンツに興味のある学生は, 今年の ECML-PKDD に関する双曲線グラフ表現学習に関する関連チュートリアルも参照できます (ホームページ ポータル: https://hyperbolicgraphlearning.github.io/ )、またはバージニア工科大学や Amazon などの学者による WebConf での双曲ニューラル ネットワーク関連のチュートリアル。 6. グラフ ニューラル ネットワーク トレーニング システム、フレームワーク、ベンチマーク プラットフォーム

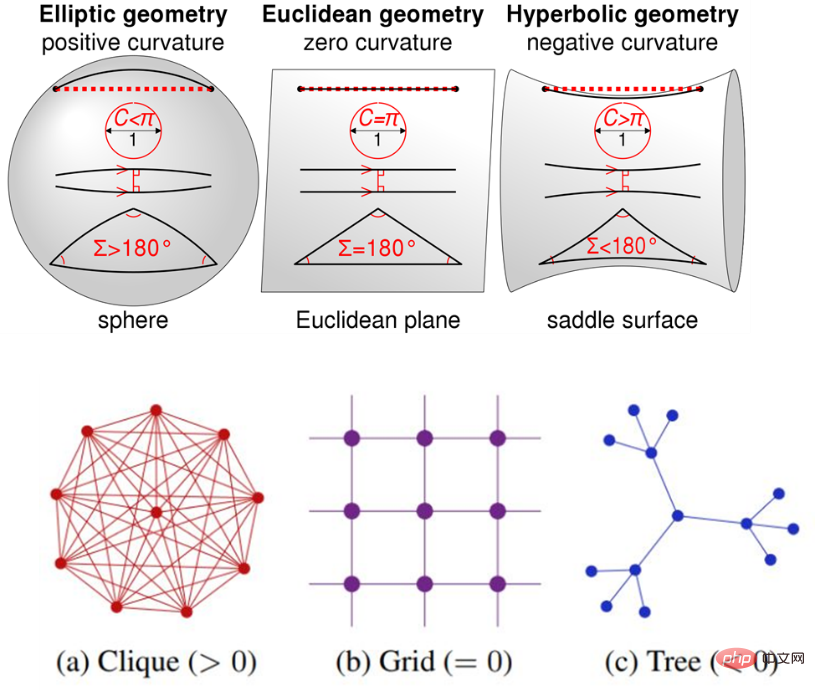

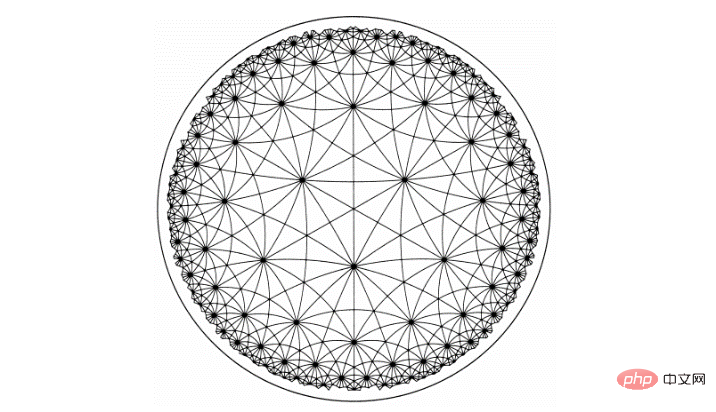

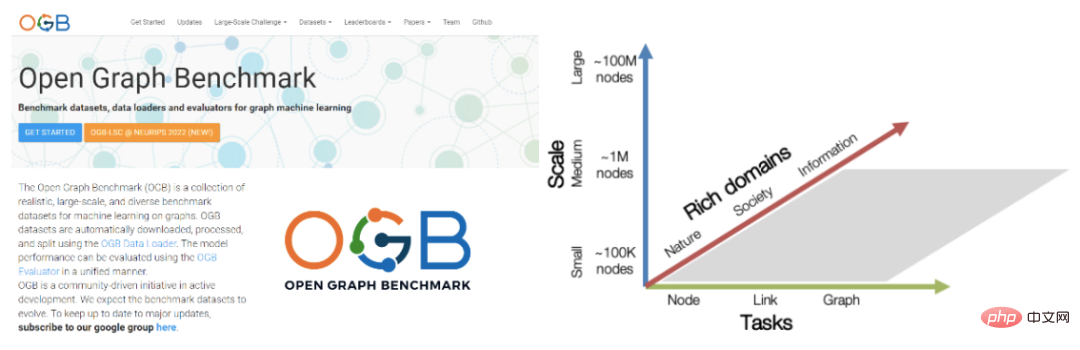

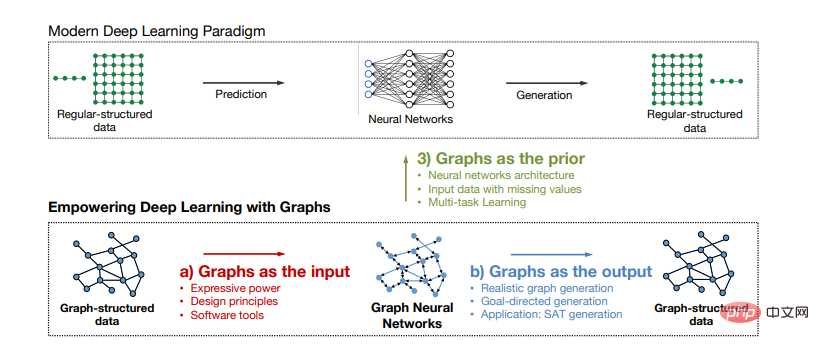

ベンチマーク プラットフォームについてもう一度話しましょう。深層機械学習の中核となる研究または応用分野では、ベンチマーク データセットとプラットフォームは、どのタイプのアーキテクチャ、原理、メカニズムが普遍的であり、実際のタスクや大規模なデータセットに一般化できるかを特定し、定量化するのに役立ちます。たとえば、ニューラル ネットワーク モデルにおける最新の革命は、大規模なベンチマーク画像データ セット ImageNet によって引き起こされました。グリッド データやシーケンス データと比較すると、グラフ データ モデルの開発はまだ比較的自由な成長段階にあります。まず、データセットは多くの場合、現実世界のシナリオに一致するには小さすぎるため、アルゴリズムを確実かつ厳密に評価することが困難です。第二に、アルゴリズムを評価するためのスキームは均一ではありません。基本的に、各研究論文は独自の「トレーニング セット/テスト セット」データ分割方法とパフォーマンス評価指標を使用します。これは、論文やアーキテクチャ間でパフォーマンスを比較するのが難しいことを意味します。さらに、さまざまな研究者が、データ セットを分割するときに従来のランダム分割手法を使用することがよくあります。グラフ学習コミュニティにおける一貫性のないデータとタスクデータの分割方法と評価スキームの問題を解決するために、スタンフォード大学の Jure Leskovec チームは、グラフ ニューラル ネットワーク ベンチマーク プラットフォームの基礎となる Open Graph Benchmark (OGB) を 2020 年に開始しました。 。 OGB には、グラフ上の主要なタスク (ノード分類、リンク予測、グラフ) のためのすぐに使えるツールが含まれています分類など)に加え、パフォーマンス評価指標の共通コード ライブラリと実装コードも含まれており、迅速なモデルの評価と比較が可能です。さらに、OGB にはモデル パフォーマンス ランキング ボード (リーダーボード) もあり、誰もが対応する研究の進捗状況をすぐに追跡できるようになります。さらに、2021年にOGBはKDD CUPと共同で第1回OGB-LSC(OGB Large-Scale Challenge)コンペティションを開催し、実世界からの超大規模グラフデータを提供してノード分類、エッジ予測、グラフ学習を完了させました。グラフ学習の分野 3 つの主要なタスクに戻ると、Microsoft、Deepmind、Facebook、Alibaba、Baidu、ByteDance、スタンフォード、MIT、北京大学などを含む多くのトップ大学やテクノロジー企業の参加を集めています。今年、NeurIPS2022 競技トラックでは、KDD カップの経験に基づいて、対応するデータセットが更新され、第 2 回 OGB-LSC 競技会が開催され、優勝プランが公開されました #(ある分野に早く慣れる良い方法は、研究室を卒業したばかりの学生の博士論文を読むことです。SNAP研究室のRex YINGとYou Jiaxuanには名前があるはずです。彼らはそれぞれ 2016 年と 2017 年に Jure での作業を開始しました。Leskovec の指導の下、グラフ学習に関連する研究が始まりました。多くの成果はグラフ学習の開発プロセスのランドマークとなっています。それらはそれぞれの博士論文「表現力と表現力に向けて」にも含まれています。 「Scalable Deep Representation Learning for Graphs」と「Empowering Deep Learning with Graphs」。対応する結合が実行されました。) 10 年以上の開発と最近のさまざまな業界での実用化を経て、実験室での理論の応用と継続的な反復を通じて、グラフ ニューラル ネットワークはグラフ構造データを処理する効果的な方法およびフレームワークであることが証明されました。理論的にも実践的にも。普遍的で簡潔かつ強力なデータ構造であるグラフは、非ユークリッド構造化データをマイニングおよび学習するためのグラフ モデルの入力および出力として使用できるだけでなく、ヨーロッパ データ (テキストやテキストなど) をモデル化するためのアプリオリ構造としても使用できます。写真).アプリケーション中。長期的には、グラフ データ ニューラル ネットワークが新興の研究分野から機械学習の研究と応用のための標準的なデータ モデル パラダイムに変わり、より多くの業界やシナリオに力を与えると私たちは信じています。 ##(見通しは立てざるを得ない) GNNですがこれまで多くの分野で大きな成功を収めてきましたが、アプリケーション シナリオの拡大、実際の動的な変化、未知のオープン環境に伴い、上記の多くの問題や課題に加えて、さらなる探求に値する方向性がまだ多くあります。 グラフ ニューラル ネットワークの新しいシーンと新しいパラダイム: 現実世界では、地球の重力から分子の相互作用に至るまで、ほぼすべてが接続されているように見えます。何らかの関係性があれば、それを絵として捉えることができます。ソーシャル ネットワーク分析からレコメンデーション システムや自然科学に至るまで、さまざまな分野でのグラフ ニューラル ネットワークの関連アプリケーションの探索や、インテリジェント交通機関における時空間相互作用、金融リスク管理シナリオのさまざまなカテゴリなどのアプリケーション問題から生じるモデル開発を見てきました。したがって、さまざまなシーンでシーン関連の特徴を適応的に学習する方法は依然として重要な方向性です。また、現在の GNN は主にメッセージパッシングパラダイムに基づいており、情報転送、情報集約、情報更新の 3 つのステップを使用しますが、情報転送、集約、更新をどのように合理的かつ効率的に行うかが課題です。現在、GNN の作業にとってはより重要ですが、その一方で、メッセージ パッシング フレームワークと同類の仮定によって引き起こされる情報の過度の平滑化の問題と情報のボトルネックも、より複雑なデータやシナリオではその効果を制限します。全体として、ほとんどの GNN は常にコンピューター ビジョンや自然言語処理からアイデアを借用しますが、借用のルールを破り、グラフ データの帰納的な好みに基づいてより強力なモデルを設計し、グラフ ニューラル ネットワークに独自の機能を注入するにはどうすればよいでしょうか?魂は、その分野の研究者が考え、努力し続ける方向でもあります。 グラフ構造の学習: グラフ ニューラル ネットワークと従来のニューラル ネットワークの主な違いは、グラフの構造によってガイドされることです。近隣情報を集約してノード表現を学習します。実際、アプリケーションには、グラフ構造が正しい、つまりグラフ上の接続が実際で信頼できるという前提があります。たとえば、ソーシャル グラフのエッジは本当の友情を意味します。しかし実際には、グラフの構造はそれほど信頼できるものではなく、ノイズの多い接続や誤接続がよく発生します。間違ったグラフ構造と GNN の拡散プロセスは、ノード表現と下流タスク (ガベージ イン、ガベージ アウト) のパフォーマンスを大幅に低下させます。したがって、グラフ構造をより適切に学習する方法、およびさまざまなデータ シナリオでより信頼性の高いグラフ構造を構築する方法が重要な方向性となります。 信頼されたグラフ ニューラル ネットワーク: 情報転送メカニズムとグラフ データの非 IID 特性により、GNN は、次のような攻撃に対して非常に効果的です。脆弱で、ノードの特性やグラフ構造における敵対的な摂動の影響を受けやすい。たとえば、詐欺師は、特定の高信用ユーザーとのトランザクションを作成することで、GNN ベースの詐欺検出を回避できます。したがって、セキュリティ リスクの高い一部の領域に対しては、堅牢なグラフ ニューラル ネットワークを開発することが非常に必要です。一方で、社会全体のプライバシー保護への関心が高まる中、グラフニューラルネットワークの公平性やデータプライバシー保護も最近の研究で注目されています。たとえば、2022 年の Alibaba DAMO Academy のグラフ データ向けフェデレーテッド ラーニング オープンソース プラットフォームである FederatedScope-GNN も、今年の KDD 2022 で最優秀応募論文を受賞しました。さらに、モデル内の暗黙的データを保護するという目的を達成するために、学習済みグラフ モデルに特定のデータ学習効果/特定のパラメーターをどのように忘れさせるか (グラフのアンラーニング) も議論に値する方向性です。 解釈可能性: ディープ ラーニング モデルは、多くのタスクで従来の方法では到達できないパフォーマンスを達成しますが、モデルの複雑さは、解釈可能性がより制限される傾向があります。ただし、バイオインフォマティクス、健康、金融リスク管理などの多くの高感度分野では、計算モデルを評価し、基礎となるメカニズムをより深く理解する際に解釈可能性が重要です。したがって、解釈可能な、または複雑な関係をより適切に視覚化できるモデル/アーキテクチャを設計することが、最近より注目を集めています。既存の研究は主にテキストと画像における解釈可能性の処理方法に言及しています。たとえば、勾配の変化や入力摂動に基づくメソッド (GNNExplainer など)。最近、一部の研究者は、不変学習に基づいてグラフ ニューラル ネットワークの固有の説明可能性をより適切に導き出し、グラフ モデルの説明可能性についての洞察を提供するために、因果スクリーニング手法を使用して説明可能性測定フレームワークを探求しようとしています。 分布外の一般化: 一般的な学習問題は、トレーニング セットでモデルのトレーニングを完了し、その後モデルは新しいテスト セットで結果を返す必要があります。テスト データの分布がトレーニング分布と大きく異なる場合、モデルの汎化誤差を制御することが困難になります。現在のほとんどのグラフ ニューラル ネットワーク (GNN) 手法では、トレーニング グラフとテスト グラフの間の未知の偏差が考慮されていないため、分布外 (OOD) グラフでの GNN の汎化パフォーマンスが低下します。ただし、実際の多くのシナリオでは、モデルがオープンで動的な環境と対話する必要があります。トレーニング段階では、モデルは、レコメンデーション システムの新しいユーザーやアイテムなど、将来の未知の分布からの新しいエンティティやサンプルを考慮する必要があります。オンライン広告システムの製品など。プラットフォームのユーザー ポートレート/行動特性、動的ネットワーク内の新しいノードまたはエッジ関係など。したがって、限られた観測データを使用して、未知または限られたデータを持つ新しい環境に一般化できる安定した GNN モデルを学習する方法も重要な研究の方向性です。 グラフ データの事前トレーニングと一般モデル: 事前トレーニング パラダイムは、コンピューター ビジョンと自然現象の分野で革命的な成功を収めました。言語処理その能力は多くのミッションで実証されています。 GNN はすでに比較的成熟したモデルと成功したアプリケーションをいくつか持っていますが、特定のタスクのモデルをトレーニングするために大量のラベル付きデータを使用する深層学習にまだ限定されており、タスクが変更されたり、ラベルが不十分な場合、結果は満足のいくものではないことがよくあります。したがって、グラフ データ シナリオにおける一般的なモデルについて全員が探索し、考えることが自然に始まります。事前トレーニングの鍵は、豊富なトレーニング データ、移転可能な知識、強力なバックボーン モデル、効果的なトレーニング方法にあります。コンピューター ビジョンや自然言語処理における明確な意味情報と比較すると、グラフ データ構造は大きく異なるため、グラフ内のどのような知識が伝達可能であるかは、まだ比較的未解決の問題です。さらに、深い一般的な GNN モデルが研究されていますが、まだ革命的な改善をもたらしていません。幸いなことに、グラフ機械学習コミュニティは大規模なグラフ データを蓄積しており、グラフ再構成などの自己教師ありトレーニング手法を開発しました。ディープ GNN、より表現力の高い GNN、グラフ自己監視の新しいパラダイムに関するその後の研究のさらなる探求により、最終的には強力な汎用性を備えた普遍的なモデルが実現されると考えられています。 ソフトウェアとハードウェアのコラボレーション: グラフ学習のアプリケーションと研究開発が進むにつれて、GNN は間違いなく PyTorch にさらに深く統合されるでしょう。 TensorFlow や Mindpsore などの標準フレームワークやプラットフォーム。グラフ モデルのスケーラビリティをさらに向上させるために、よりハードウェアに優しいアルゴリズム フレームワークと、ソフトウェアと調整されたハードウェア アクセラレーション ソリューションが一般的な傾向にあります。グラフ ニューラル ネットワーク アプリケーション用の専用アクセラレーション構造は徐々に出現しており、グラフ ニューラル ネットワーク用のコンピューティング ハードウェア ユニットとオンチップ ストレージ階層のカスタマイズ、およびコンピューティングとメモリ アクセスの動作を最適化する専用チップはある程度の成功を収めていますが、これらのテクノロジはまだ初期段階にあります。大きな課題に直面し、それに応じて多くの機会を提供します。

ノード分類:

ノード分類:

出典: Traffic4Cast@NeurIPS 2022

出典: Traffic4Cast@NeurIPS 2022

4. グラフ ニューラル ネットワークのスケーラビリティ

グラフ ニューラル ネットワーク アルゴリズムは、ディープ ニューラル ネットワーク (たとえば、畳み込み、勾配計算など) と反復グラフ伝播の組み合わせ: 各頂点の特徴は、一連のディープ ニューラル ネットワークと組み合わせた隣接する頂点の特徴によって計算されます。ただし、既存の深層学習フレームワークはグラフ伝播モデルを拡張して実行できないため、グラフ ニューラル ネットワークを効率的にトレーニングする機能がありません。さらに、現実世界のグラフ データの規模は膨大であり、頂点間には複雑な依存関係があります。たとえば、Facebook のソーシャル ネットワーク グラフには 20 億以上の頂点と 1 兆のエッジが含まれています。このサイズのグラフでは 100 TB が生成される可能性があります。従来のグラフ アルゴリズムとは異なり、バランス グラフ パーティショニングは、パーティション内の頂点の数だけでなく、パーティション内の隣接する頂点の数にも依存します。 -layer グラフ ニューラル ネットワーク モデルの違いは非常に大きく、これらのパーティション間では頻繁なデータ交換が必要です。分散トレーニングのパフォーマンスを確保するためにグラフ データを合理的に分割する方法は、分散システムにとって大きな課題です。さらに、グラフ データは非常にまばらであるため、分散処理では頻繁にクロスノード アクセスが発生し、大量のメッセージ パッシング オーバーヘッドが発生します。したがって、グラフの特殊な特性に基づいてシステムのオーバーヘッドをどのように削減するかが、システムのパフォーマンスを向上させるための大きな課題となります。労働者が仕事をうまくやりたいなら、まず道具を研ぐ必要があります。大規模なグラフへのグラフ ニューラル ネットワークの適用と、より複雑なグラフ ニューラル ネットワーク構造の探索をサポートするには、グラフ ニューラル ネットワークのトレーニング システムを開発する必要があります。まず最初に言及するのは、最もよく知られている 2 つのオープン ソース フレームワークである PyG (PyTorch Geometric) と DGL (Deep Graph Library) で、前者はスタンフォード大学とドルトムント工科大学が共同開発した PyTorch ベースのグラフ ニューラル ネットワーク ライブラリです。多くの GNN が含まれています. 関連論文でメソッドの実装と一般的に使用されるデータセットが提供されており, シンプルで使いやすいインターフェイスが提供されています. 後者はニューヨーク大学と Amazon Research Institute が共同開発したグラフ学習フレームワークです.学界と産業界のオープンソース フレームワークは、どちらも積極的なコミュニティのサポートを受けています。

さらに、多くの企業は、自社のビジネス特性に基づいて独自のグラフ ニューラル ネットワーク フレームワークとデータベースも構築しています。例: NeuGraph、EnGN、PSGraph、AliGraph、Roc、AGL、PGL、Galileo、TuGraph、Angle Graph など。このうち、AliGraph は、Alibaba Computing Platform と DAMO Academy Intelligent Computing Laboratory によって開発された、サンプリング モデリングとトレーニングを統合したグラフ ニューラル ネットワーク プラットフォームです。 PGL (パドルグラフ学習) は、Baidu が開発した PaddlePaddle をベースとした対応グラフ学習フレームワークです。 Angle Graph は、Tencent TEG データ プラットフォームによって開始された大規模な高性能グラフ コンピューティング プラットフォームです。

さらに、多くの企業は、自社のビジネス特性に基づいて独自のグラフ ニューラル ネットワーク フレームワークとデータベースも構築しています。例: NeuGraph、EnGN、PSGraph、AliGraph、Roc、AGL、PGL、Galileo、TuGraph、Angle Graph など。このうち、AliGraph は、Alibaba Computing Platform と DAMO Academy Intelligent Computing Laboratory によって開発された、サンプリング モデリングとトレーニングを統合したグラフ ニューラル ネットワーク プラットフォームです。 PGL (パドルグラフ学習) は、Baidu が開発した PaddlePaddle をベースとした対応グラフ学習フレームワークです。 Angle Graph は、Tencent TEG データ プラットフォームによって開始された大規模な高性能グラフ コンピューティング プラットフォームです。

以上が深層学習におけるトポロジカルの美学: GNN の基礎と応用の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7456

7456

15

15

1376

1376

52

52

77

77

11

11

16

16

10

10

Python での感情分析に BERT を使用する方法と手順

Jan 22, 2024 pm 04:24 PM

Python での感情分析に BERT を使用する方法と手順

Jan 22, 2024 pm 04:24 PM

BERT は、2018 年に Google によって提案された事前トレーニング済みの深層学習言語モデルです。正式名は BidirectionEncoderRepresentationsfromTransformers で、Transformer アーキテクチャに基づいており、双方向エンコードの特性を備えています。従来の一方向コーディング モデルと比較して、BERT はテキストを処理するときにコンテキスト情報を同時に考慮できるため、自然言語処理タスクで優れたパフォーマンスを発揮します。その双方向性により、BERT は文内の意味関係をより深く理解できるようになり、それによってモデルの表現能力が向上します。事前トレーニングおよび微調整方法を通じて、BERT は感情分析、命名などのさまざまな自然言語処理タスクに使用できます。

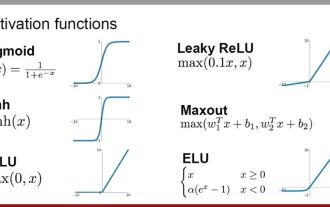

一般的に使用される AI 活性化関数の分析: Sigmoid、Tanh、ReLU、Softmax のディープラーニングの実践

Dec 28, 2023 pm 11:35 PM

一般的に使用される AI 活性化関数の分析: Sigmoid、Tanh、ReLU、Softmax のディープラーニングの実践

Dec 28, 2023 pm 11:35 PM

活性化関数は深層学習において重要な役割を果たしており、ニューラル ネットワークに非線形特性を導入することで、ネットワークが複雑な入出力関係をより適切に学習し、シミュレートできるようになります。活性化関数の正しい選択と使用は、ニューラル ネットワークのパフォーマンスとトレーニング結果に重要な影響を与えます。この記事では、よく使用される 4 つの活性化関数 (Sigmoid、Tanh、ReLU、Softmax) について、導入、使用シナリオ、利点、欠点と最適化ソリューション アクティベーション関数を包括的に理解できるように、次元について説明します。 1. シグモイド関数 シグモイド関数の公式の概要: シグモイド関数は、任意の実数を 0 と 1 の間にマッピングできる一般的に使用される非線形関数です。通常は統一するために使用されます。

ORB-SLAM3を超えて! SL-SLAM: 低照度、重度のジッター、弱いテクスチャのシーンはすべて処理されます。

May 30, 2024 am 09:35 AM

ORB-SLAM3を超えて! SL-SLAM: 低照度、重度のジッター、弱いテクスチャのシーンはすべて処理されます。

May 30, 2024 am 09:35 AM

以前に書きましたが、今日は、深層学習テクノロジーが複雑な環境におけるビジョンベースの SLAM (同時ローカリゼーションとマッピング) のパフォーマンスをどのように向上させることができるかについて説明します。ここでは、深部特徴抽出と深度マッチング手法を組み合わせることで、低照度条件、動的照明、テクスチャの弱い領域、激しいセックスなどの困難なシナリオでの適応を改善するように設計された多用途のハイブリッド ビジュアル SLAM システムを紹介します。当社のシステムは、拡張単眼、ステレオ、単眼慣性、ステレオ慣性構成を含む複数のモードをサポートしています。さらに、他の研究にインスピレーションを与えるために、ビジュアル SLAM と深層学習手法を組み合わせる方法も分析します。公開データセットと自己サンプリングデータに関する広範な実験を通じて、測位精度と追跡堅牢性の点で SL-SLAM の優位性を実証しました。

潜在空間の埋め込み: 説明とデモンストレーション

Jan 22, 2024 pm 05:30 PM

潜在空間の埋め込み: 説明とデモンストレーション

Jan 22, 2024 pm 05:30 PM

潜在空間埋め込み (LatentSpaceEmbedding) は、高次元データを低次元空間にマッピングするプロセスです。機械学習と深層学習の分野では、潜在空間埋め込みは通常、高次元の入力データを低次元のベクトル表現のセットにマッピングするニューラル ネットワーク モデルです。このベクトルのセットは、「潜在ベクトル」または「潜在ベクトル」と呼ばれることがよくあります。エンコーディング」。潜在空間埋め込みの目的は、データ内の重要な特徴をキャプチャし、それらをより簡潔でわかりやすい形式で表現することです。潜在空間埋め込みを通じて、低次元空間でデータの視覚化、分類、クラスタリングなどの操作を実行し、データをよりよく理解して活用できます。潜在空間埋め込みは、画像生成、特徴抽出、次元削減など、多くの分野で幅広い用途があります。潜在空間埋め込みがメイン

1 つの記事で理解: AI、機械学習、ディープラーニングのつながりと違い

Mar 02, 2024 am 11:19 AM

1 つの記事で理解: AI、機械学習、ディープラーニングのつながりと違い

Mar 02, 2024 am 11:19 AM

今日の急速な技術変化の波の中で、人工知能 (AI)、機械学習 (ML)、および深層学習 (DL) は輝かしい星のようなもので、情報技術の新しい波をリードしています。これら 3 つの単語は、さまざまな最先端の議論や実践で頻繁に登場しますが、この分野に慣れていない多くの探検家にとって、その具体的な意味や内部のつながりはまだ謎に包まれているかもしれません。そこで、まずはこの写真を見てみましょう。ディープラーニング、機械学習、人工知能の間には密接な相関関係があり、進歩的な関係があることがわかります。ディープラーニングは機械学習の特定の分野であり、機械学習

超強い!深層学習アルゴリズムのトップ 10!

Mar 15, 2024 pm 03:46 PM

超強い!深層学習アルゴリズムのトップ 10!

Mar 15, 2024 pm 03:46 PM

2006 年にディープ ラーニングの概念が提案されてから、ほぼ 20 年が経過しました。ディープ ラーニングは、人工知能分野における革命として、多くの影響力のあるアルゴリズムを生み出してきました。では、ディープラーニングのトップ 10 アルゴリズムは何だと思いますか?私の考えでは、ディープ ラーニングのトップ アルゴリズムは次のとおりで、いずれもイノベーション、アプリケーションの価値、影響力の点で重要な位置を占めています。 1. ディープ ニューラル ネットワーク (DNN) の背景: ディープ ニューラル ネットワーク (DNN) は、多層パーセプトロンとも呼ばれ、最も一般的なディープ ラーニング アルゴリズムです。最初に発明されたときは、コンピューティング能力のボトルネックのため疑問視されていました。最近まで長年にわたる計算能力、データの爆発的な増加によって画期的な進歩がもたらされました。 DNN は、複数の隠れ層を含むニューラル ネットワーク モデルです。このモデルでは、各層が入力を次の層に渡し、

CNN と Transformer のハイブリッド モデルを使用してパフォーマンスを向上させる方法

Jan 24, 2024 am 10:33 AM

CNN と Transformer のハイブリッド モデルを使用してパフォーマンスを向上させる方法

Jan 24, 2024 am 10:33 AM

畳み込みニューラル ネットワーク (CNN) と Transformer は、さまざまなタスクで優れたパフォーマンスを示した 2 つの異なる深層学習モデルです。 CNN は主に、画像分類、ターゲット検出、画像セグメンテーションなどのコンピューター ビジョン タスクに使用されます。畳み込み演算を通じて画像上の局所的な特徴を抽出し、プーリング演算を通じて特徴の次元削減と空間的不変性を実行します。対照的に、Transformer は主に、機械翻訳、テキスト分類、音声認識などの自然言語処理 (NLP) タスクに使用されます。セルフアテンション メカニズムを使用してシーケンス内の依存関係をモデル化し、従来のリカレント ニューラル ネットワークにおける逐次計算を回避します。これら 2 つのモデルは異なるタスクに使用されますが、シーケンス モデリングでは類似点があるため、

RMSprop アルゴリズムの改善

Jan 22, 2024 pm 05:18 PM

RMSprop アルゴリズムの改善

Jan 22, 2024 pm 05:18 PM

RMSprop は、ニューラル ネットワークの重みを更新するために広く使用されているオプティマイザーです。これは、2012 年に Geoffrey Hinton らによって提案され、Adam オプティマイザーの前身です。 RMSprop オプティマイザの登場は主に、勾配の消失や勾配の爆発など、SGD 勾配降下法アルゴリズムで発生するいくつかの問題を解決することを目的としています。 RMSprop オプティマイザーを使用すると、学習率を効果的に調整し、重みを適応的に更新できるため、深層学習モデルのトレーニング効果が向上します。 RMSprop オプティマイザの中心となるアイデアは、異なるタイム ステップでの勾配が重みの更新に異なる影響を与えるように、勾配の加重平均を実行することです。具体的には、RMSprop は各パラメータの 2 乗を計算します。