止められない!拡散モデルを使用すると、テキストのみを使用して写真を Photoshop で作成できます

当事者 A と当事者 B の共通の願いは、言葉だけで状況を改善できることですが、通常、当事者 B だけがその内容を知っています。痛みや悲しみが伴う。今日、AI がこの困難な問題への挑戦を開始しました。

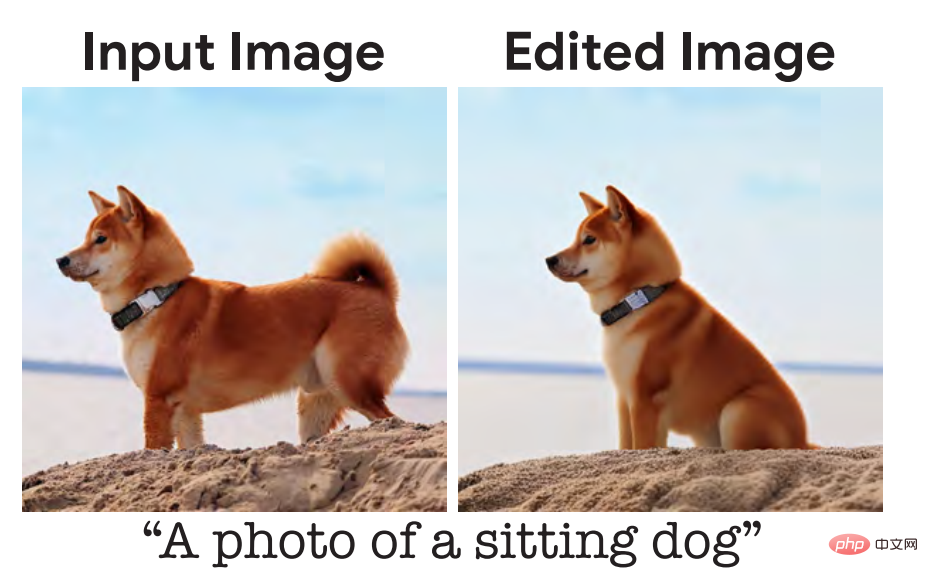

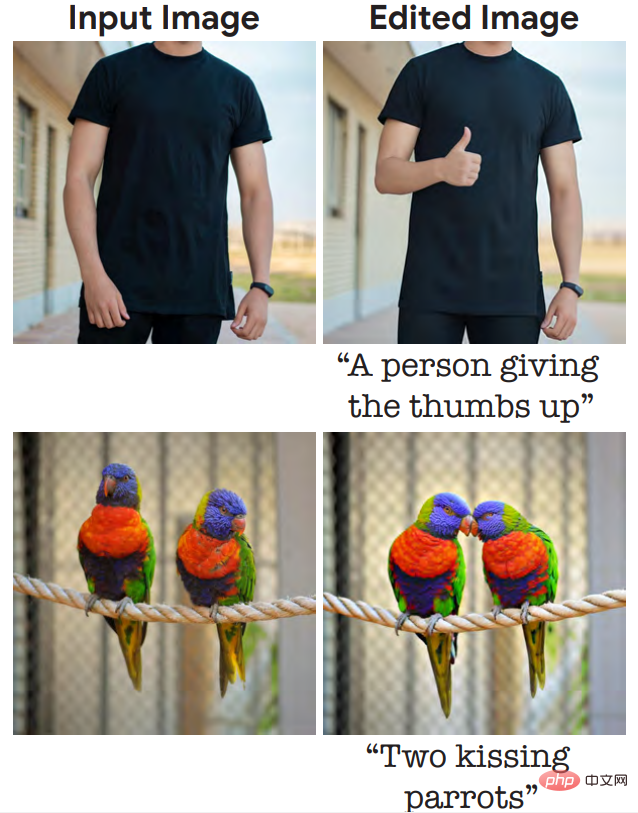

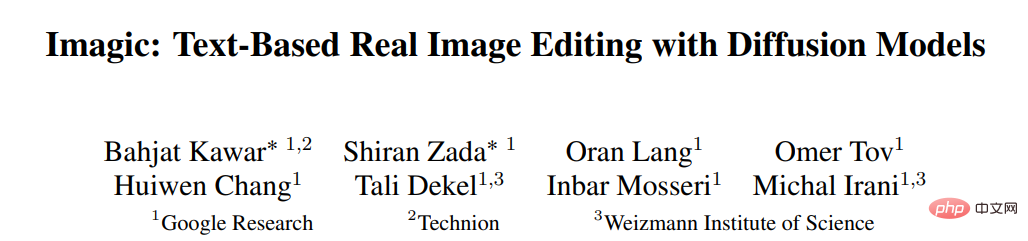

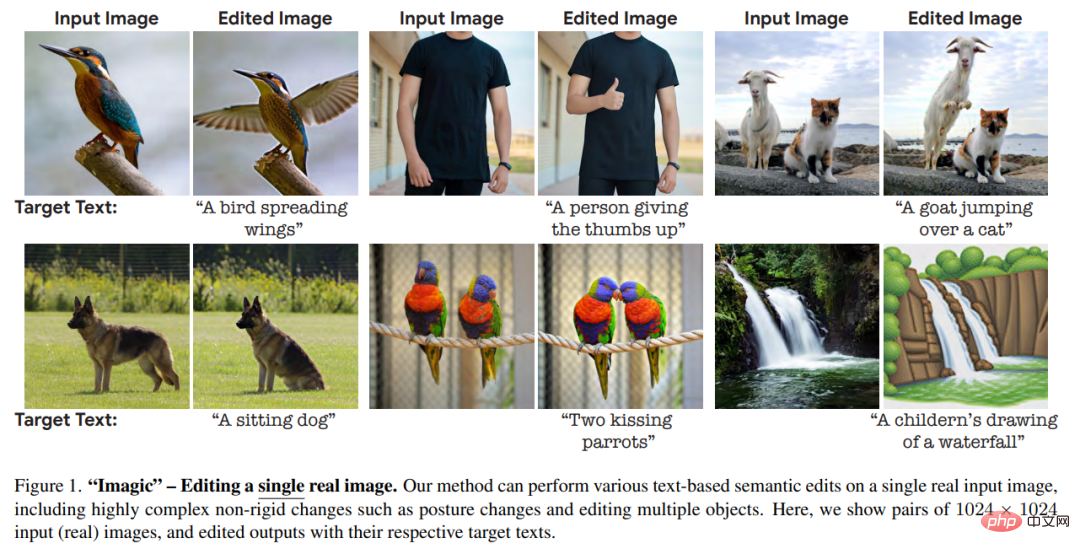

10 月 17 日に arXiv にアップロードされた論文で、Google Research、イスラエル工科大学、イスラエルのワイツマン科学研究所の研究者は、実際の画像編集に基づく手法を紹介しました。拡散モデルの手法 - Imagic は、人に親指を立てさせたり、2 羽のオウムにキスさせたりするなど、テキストのみを使用して実際の写真の PS を実現できます:

「いいね!のジェスチャーを手伝ってください。」 普及モデル: 問題ありません、私がカバーします。

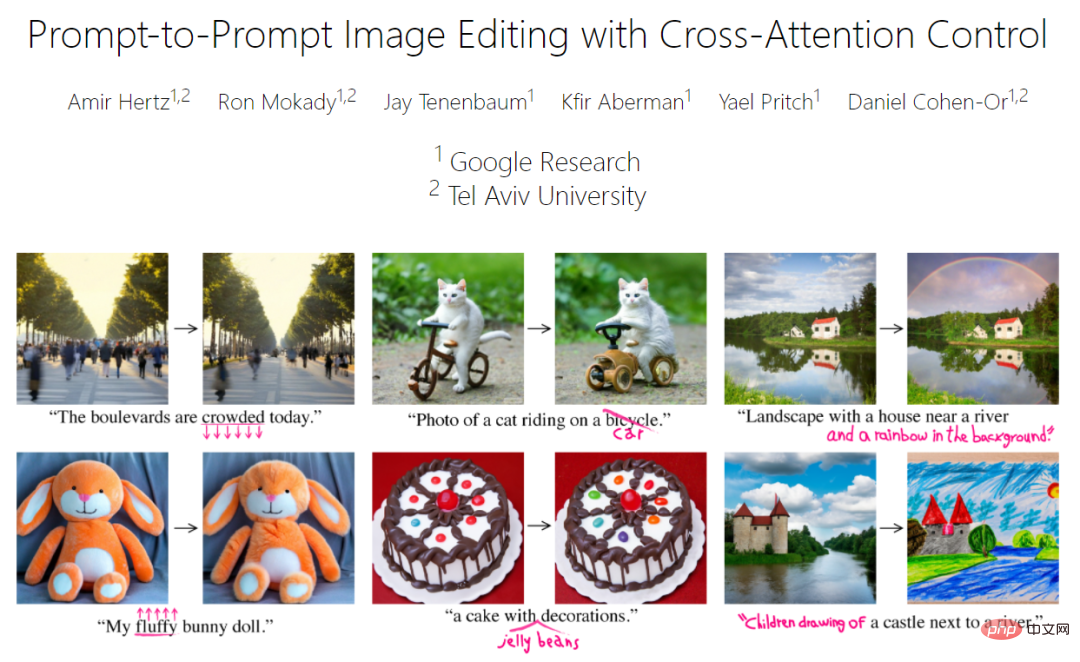

#論文の画像から、変更された画像は依然として非常に自然であり、情報に明らかな損傷がないことがわかります。変更が必要な内容。同様の研究には、Google Research とイスラエルのテルアビブ大学によって以前に完了した Prompt-to-Prompt が含まれます (Imagic 論文の参考文献 [16]):

プロジェクトリンク (論文とコードを含む): https://prompt-to-prompt.github.io/

したがって、ある人は感情を込めてこう言いました。 「この分野はあまりにも急速に変化しているので、少し大袈裟です。」これからは、甲は本当に言葉だけでどんな変化も起こすことができるのです。

Imagic Paper の概要

##論文リンク: https://arxiv.org / pdf/2210.09276.pdf

#実際の写真に実質的なセマンティック編集を適用することは、画像処理において常に興味深い作業でした。近年、深層学習ベースのシステムが大幅に進歩したため、このタスクは研究コミュニティから大きな関心を集めています。単純な自然言語テキスト プロンプトを使用して、必要なエディターを説明する (犬に座るように頼むなど) ことは、人間のコミュニケーション方法と非常に一致しています。したがって、研究者はテキストベースの画像編集方法を数多く開発しており、これらの方法も効果的です。

ただし、現在の主流の方法には次のような多かれ少なかれ問題があります:

1. 特定の編集セットに限定されます。画像へのペイント、オブジェクトの追加、またはスタイルの転送として [6, 28];

2. 特定のフィールドの画像または合成画像のみを操作できます [16, 36 ];

3. 入力画像に加えて、目的の編集位置を示す画像マスク、同じ被写体の複数の画像、元の画像を説明するテキストなどの補助入力も必要です。 6、13、40、44]。

本稿では、上記の問題を軽減するための意味的画像編集手法「Imagic」を提案します。編集対象の入力画像とターゲット編集を説明する単一のテキスト プロンプトが与えられると、この方法により、実際の高解像度画像の複雑で非固定的な編集が可能になります。結果として得られる画像出力は、元の画像の全体的なコンテキスト、構造、構成を維持しながら、ターゲット テキストとよく一致します。

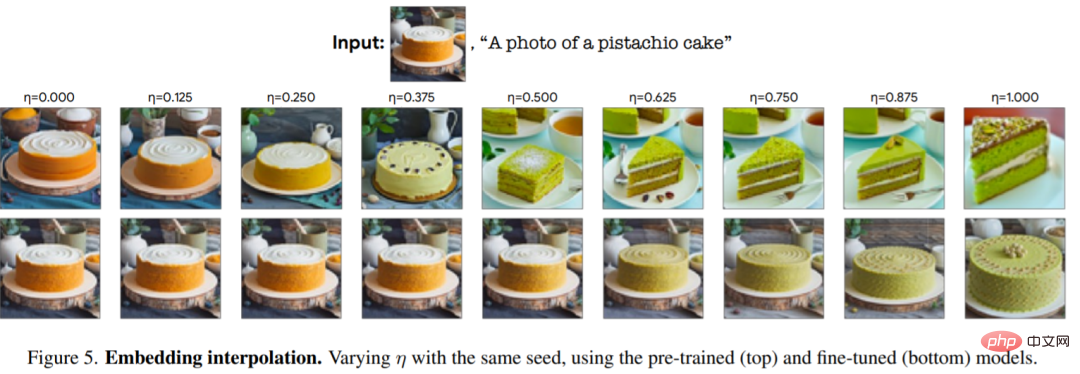

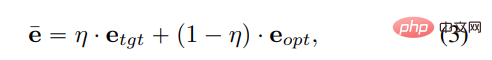

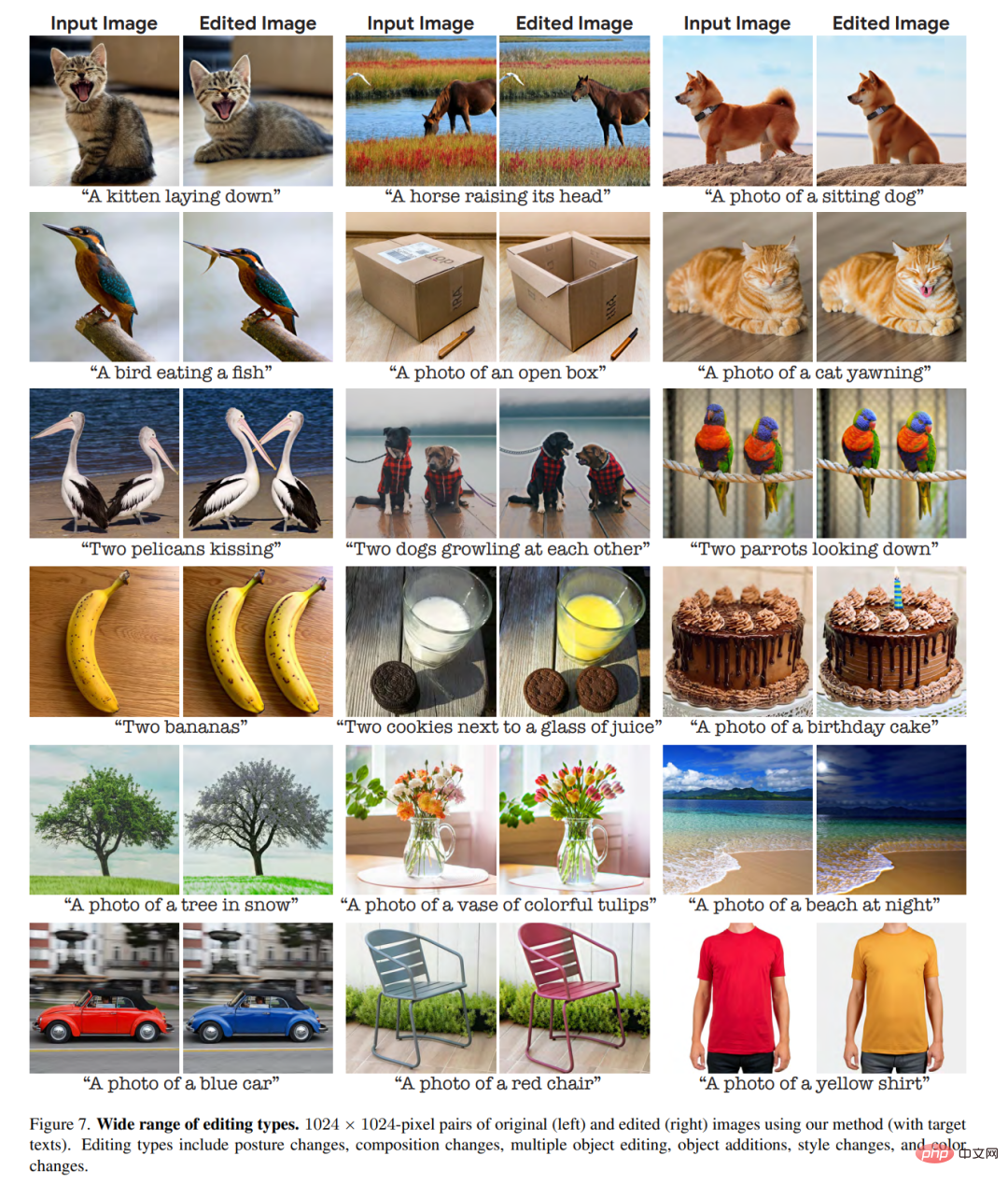

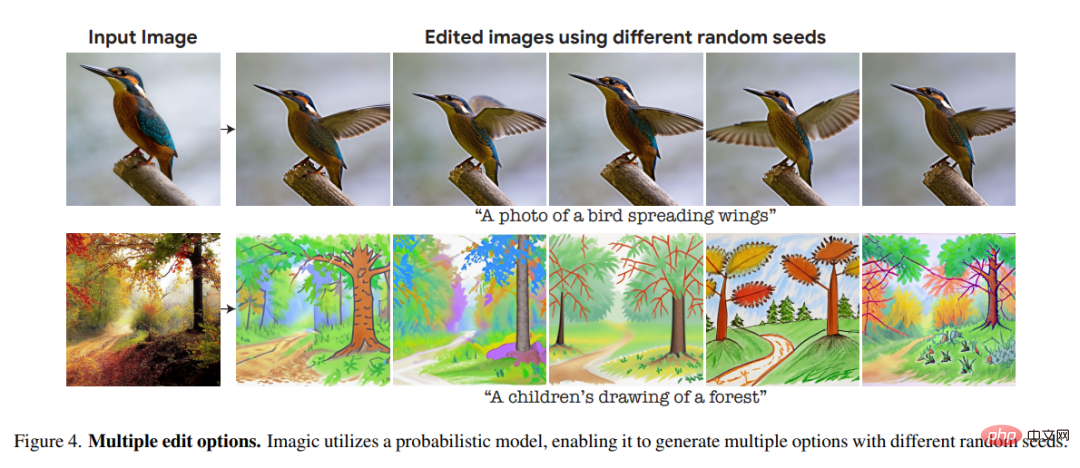

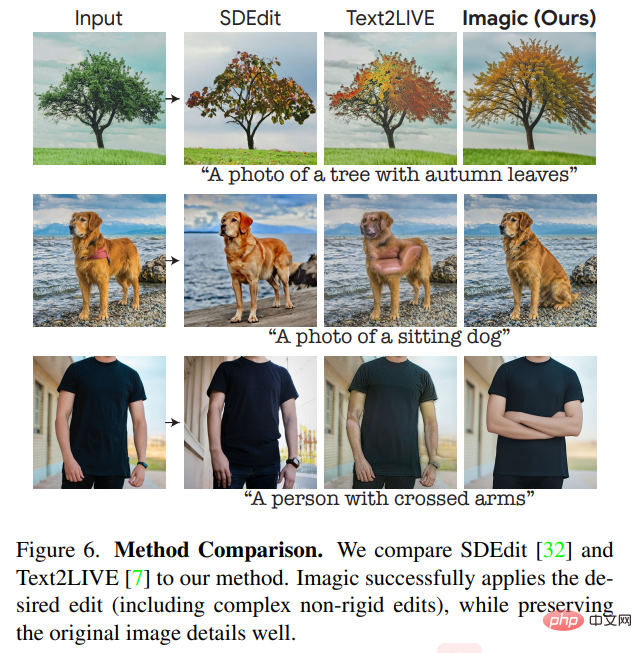

図 1 に示すように、Imagic は 2 羽のオウムにキスをさせたり、人に親指を立てさせたりすることができます。これが提供するテキストベースのセマンティック編集は、複数のオブジェクトの編集を含むこのような複雑な操作を単一の実際の高解像度画像に適用できるのは初めてです。これらの複雑な変更に加えて、Imagic ではスタイルの変更、色の変更、オブジェクトの追加など、さまざまな編集が可能です。 #この偉業を達成するために、研究者らは最近成功したテキストから画像への拡散モデルを活用しました。拡散モデルは、高品質の画像合成が可能な強力な生成モデルです。自然言語テキスト プロンプトを条件にすると、要求されたテキストと一致する画像を生成できます。この研究では、研究者らは新しい画像を合成するのではなく、実際の画像を編集するためにそれらを使用しました。 図 3 に示すように、Imagic は上記のタスクを完了するのに 3 つのステップだけを必要とします。まず、テキストの埋め込みを最適化して、入力画像と同様の画像を生成します。事前トレーニングされた生成拡散モデルは、最適化された埋め込みを条件として、入力画像をより適切に再構築するために微調整されます。最後に、ターゲット テキストの埋め込みと最適化された埋め込みの間で線形補間が実行され、入力画像とターゲット テキストを組み合わせた表現が得られます。この表現は、微調整されたモデルを使用した生成拡散プロセスに渡され、最終的に編集された画像が出力されます。 Imagic の力を証明するために、研究者らはこの方法をさまざまな分野の多数の画像に適用していくつかの実験を行い、すべての実験で印象的な結果をもたらしました。 Imagic によって出力される高品質の画像は、入力画像と非常に類似しており、必要なターゲット テキストと一致しています。これらの結果は、Imagic の多用途性、汎用性、品質を示しています。研究者らはまた、提案された方法の各コンポーネントの有効性を強調するアブレーション研究も実施しました。最近のさまざまな方法と比較して、Imagic は、特に非常に複雑で厳密でない編集作業を行う場合に、大幅に優れた編集品質と元の画像の忠実度を示します。 入力画像 x とターゲット テキストが与えられた場合、この記事は、画像 x を保持しながら、指定されたテキストを満たす方法で画像を編集することを目的としています。詳細がたくさんあります。この目標を達成するために、この論文では、拡散モデルのテキスト埋め込み層を利用して、GAN ベースの方法にやや似た方法でセマンティック操作を実行します。研究者は、意味のある表現を探すことから始めて、入力画像に似た画像を生成する生成プロセスを経ます。次に、入力画像をより適切に再構築するために生成モデルが最適化され、最後のステップでは潜在表現を処理して編集結果を取得します。 上の図 3 に示すように、私たちの方法は 3 つの段階で構成されています: (1) テキスト埋め込みを最適化して、ターゲットのテキスト埋め込みの近くで指定された画像に最もよく一致するテキスト埋め込みを見つけます。 2) 与えられた画像によりよく一致するように拡散モデルを微調整する; (3) 最適化された埋め込みとターゲット テキストの埋め込みの間を線形補間して、画像の忠実性とターゲット テキストの位置合わせの両方を達成する埋め込みを見つけます。 具体的な詳細は次のとおりです。 テキスト埋め込みの最適化 まず、ターゲット テキストがテキスト エンコーダに入力され、対応するテキスト埋め込み ここで、x は入力画像、 モデルの微調整 ここで取得される最適化された埋め込み e_opt は、次の方法で生成されることに注意してください。拡散プロセスでは、少数の最適化ステップしか実行されないため、必ずしも入力画像 x と正確に類似しているわけではありません (図 5 の左上の画像を参照)。したがって、第 2 段階では、最適化の埋め込みを凍結しながら、式 (2) で提供される同じ損失関数を使用してモデル パラメーター θ を最適化することで、このギャップを埋めます。 テキスト埋め込み補間 Imagic の 3 番目の段階は実行ですe_tgt と e_opt 間の単純な線形補間。特定のハイパーパラメータ 効果をテストするために、研究者らはこの方法をさまざまな分野の多数の実際の写真に適用し、さまざまな内容を説明する単純なテキストプロンプトを使用しました。スタイル、外観、色、姿勢、構成などのカテゴリを編集します。彼らは、Unsplash と Pixabay から無料で使用できる高解像度の画像を収集し、5 つのランダム シードを使用して各編集を生成するように画像を最適化し、最良の結果を選択しました。 Imagic は、図 1 と 7 に示すように、一般的な入力画像とテキストにさまざまな編集カテゴリを適用する機能により、優れた結果を示します。 図 2 は、同じ画像上でさまざまなテキスト プロンプトを使用した実験であり、Imagic の多用途性を示しています。 研究者が使用している基本的な生成拡散モデルは確率に基づいているため、この方法は単一の場合に使用できます。画像とテキストのペアによって異なる結果が生成されます。図 4 は、さまざまなランダム シードを使用した編集のためのいくつかのオプションを示しています (シードごとにイータをわずかに調整します)。自然言語のテキスト プロンプトは一般的に曖昧で不正確であるため、このランダム性により、ユーザーはこれらの異なるオプションから選択することができます。 研究では、実世界の画像の単一入力について、Imagic と現在主要な汎用手法を比較しました。アクションを選択し、テキスト プロンプトに基づいて編集します。図 6 は、Text2LIVE[7] や SDEdit[32] などのさまざまなメソッドの編集結果を示しています。 私たちの方法は、必要な編集を適切に実行しながら、入力画像に対する高い忠実度を維持していることがわかります。 「犬を座らせる」などの複雑で厳密ではない編集タスクが与えられた場合、私たちの方法は以前の技術を大幅に上回ります。 Imagic は、この高度なテキストベースの編集を単一の実世界の画像に適用する最初のデモです。

方法の詳細

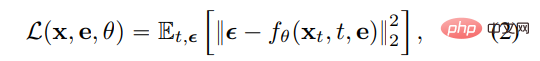

が出力されます。ここで、T は指定されたターゲット テキストのトークンの数、d はトークン埋め込みの次元です。次に、研究者らは、生成された拡散モデル f_θ のパラメーターを凍結し、ノイズ除去拡散目標を使用してターゲット テキストの埋め込み e_tgt

が出力されます。ここで、T は指定されたターゲット テキストのトークンの数、d はトークン埋め込みの次元です。次に、研究者らは、生成された拡散モデル f_θ のパラメーターを凍結し、ノイズ除去拡散目標を使用してターゲット テキストの埋め込み e_tgt

は x のノイズ バージョン、θ は事前にトレーニングされた拡散モデルの重みです。これにより、テキストの埋め込みが入力画像と可能な限り一致します。このプロセスは比較的少ないステップで実行され、元のターゲット テキストの埋め込みに近い状態を保ち、その結果、最適化された埋め込み e_opt が得られます。

は x のノイズ バージョン、θ は事前にトレーニングされた拡散モデルの重みです。これにより、テキストの埋め込みが入力画像と可能な限り一致します。このプロセスは比較的少ないステップで実行され、元のターゲット テキストの埋め込みに近い状態を保ち、その結果、最適化された埋め込み e_opt が得られます。

に対して、

に対して、 を取得します。次に、著者らは、

を取得します。次に、著者らは、 を条件として微調整されたモデルを使用して、基本的な生成拡散プロセスを適用します。これにより、低解像度の編集画像が生成され、その後、微調整された補助モデルを使用して超解像され、ターゲット テキストが超解像されます。この生成プロセスにより、最終的な高解像度編集画像

を条件として微調整されたモデルを使用して、基本的な生成拡散プロセスを適用します。これにより、低解像度の編集画像が生成され、その後、微調整された補助モデルを使用して超解像され、ターゲット テキストが超解像されます。この生成プロセスにより、最終的な高解像度編集画像  が出力されます。

が出力されます。 実験結果

以上が止められない!拡散モデルを使用すると、テキストのみを使用して写真を Photoshop で作成できますの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

1676

1676

14

14

1429

1429

52

52

1333

1333

25

25

1278

1278

29

29

1257

1257

24

24

WordPress Cookieを設定、取得、削除する方法(専門家のように)

May 12, 2025 pm 08:57 PM

WordPress Cookieを設定、取得、削除する方法(専門家のように)

May 12, 2025 pm 08:57 PM

WordPress WebサイトでCookieの使用方法を知りたいですか? Cookieは、ユーザーのブラウザに一時情報を保存するための便利なツールです。この情報を使用して、パーソナライズと行動ターゲティングを通じてユーザーエクスペリエンスを強化できます。この究極のガイドでは、プロフェッショナルのようにWordPressCookiesを設定、取得、削除する方法を紹介します。注:これは高度なチュートリアルです。 HTML、CSS、WordPress Webサイト、PHPに習熟する必要があります。クッキーとは何ですか?ユーザーがWebサイトにアクセスすると、Cookieが作成および保存されます。

2025 HUOBI APKV10.50.0ダウンロードガイドのダウンロード方法

May 12, 2025 pm 08:48 PM

2025 HUOBI APKV10.50.0ダウンロードガイドのダウンロード方法

May 12, 2025 pm 08:48 PM

Huobi APKV10.50.0ダウンロードガイド:1。記事の直接リンクをクリックします。 2.正しいダウンロードパッケージを選択します。 3。登録情報を入力します。 4. Huobi取引プロセスを開始します。

2025 HUOBI APKV10.50.0のダウンロードアドレス

May 12, 2025 pm 08:42 PM

2025 HUOBI APKV10.50.0のダウンロードアドレス

May 12, 2025 pm 08:42 PM

Huobi APKV10.50.0ダウンロードガイド:1。記事の直接リンクをクリックします。 2.正しいダウンロードパッケージを選択します。 3。登録情報を入力します。 4. Huobi取引プロセスを開始します。

2025 HUOBI APKV10.50.0インストール方法APKガイド

May 12, 2025 pm 08:27 PM

2025 HUOBI APKV10.50.0インストール方法APKガイド

May 12, 2025 pm 08:27 PM

Huobi APKV10.50.0ダウンロードガイド:1。記事の直接リンクをクリックします。 2.正しいダウンロードパッケージを選択します。 3。登録情報を入力します。 4. Huobi取引プロセスを開始します。

2025 HUOBI APKV10.50.0のダウンロードWebサイト

May 12, 2025 pm 08:39 PM

2025 HUOBI APKV10.50.0のダウンロードWebサイト

May 12, 2025 pm 08:39 PM

Huobi APKV10.50.0ダウンロードガイド:1。記事の直接リンクをクリックします。 2.正しいダウンロードパッケージを選択します。 3。登録情報を入力します。 4. Huobi取引プロセスを開始します。

トップ10のデジタル通貨交換アプリの最新のランキングがトップ10のデジタル通貨交換アプリを推奨しました

May 12, 2025 pm 08:15 PM

トップ10のデジタル通貨交換アプリの最新のランキングがトップ10のデジタル通貨交換アプリを推奨しました

May 12, 2025 pm 08:15 PM

トップ10のデジタル通貨交換アプリの最新のランキングは次のとおりです。1。Okx、2。Binance、3。Huobi、4。Coinbase、5。Kraken、6。Kucoin、7。Bitfinex、8。Gemini、9。Bitstamp、10。Poloniex。これらのアプリを使用するための手順には、アプリのダウンロードとインストール、アカウントの登録、KYC認定の完了、トップアップ、トランザクションの開始などがあります。

2025年のトップ10仮想通貨交換アプリのランキング、デジタル通貨取引アプリのトップ10の最新ランキング

May 12, 2025 pm 08:18 PM

2025年のトップ10仮想通貨交換アプリのランキング、デジタル通貨取引アプリのトップ10の最新ランキング

May 12, 2025 pm 08:18 PM

2025年の上位10の仮想通貨交換アプリは、次のようにランク付けされています。1。Okx、2。Binance、3。Huobi、4。Coinbase、5。Kraken、6。Kucoin、7。Bybit、8。ftx、9。Bitfinex、10。Gate.io。これらの交換は、ユーザーエクスペリエンス、セキュリティ、トランザクションのボリュームなどのディメンションに基づいて選択されます。各プラットフォームは、異なるユーザーのニーズを満たすためのユニークな機能とサービスを提供します。

Huobi APKV10.50.0バージョンインストールチュートリアル

May 12, 2025 pm 08:33 PM

Huobi APKV10.50.0バージョンインストールチュートリアル

May 12, 2025 pm 08:33 PM

Huobi APKV10.50.0ダウンロードガイド:1。記事の直接リンクをクリックします。 2.正しいダウンロードパッケージを選択します。 3。登録情報を入力します。 4. Huobi取引プロセスを開始します。