史上最も完全なトランスフォーマーのコレクション! LeCun の推奨事項: 60 モデルのカタログを作成します。見逃した論文は何ですか?

ここ数年、大型モデルの開発を支えてきたものがあるとすれば、それはTransformerに違いありません。

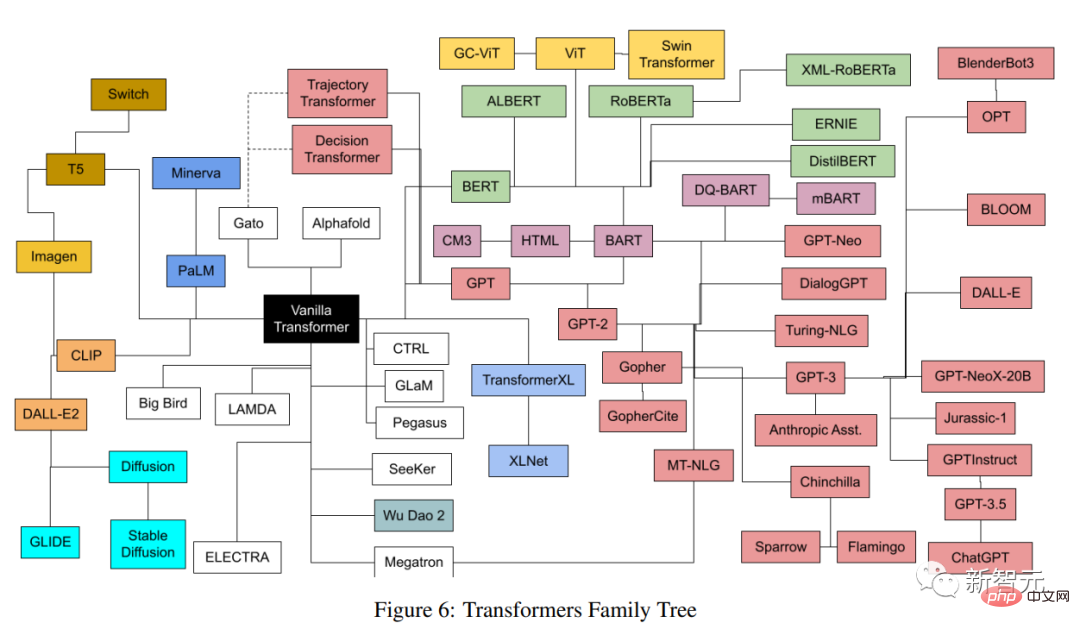

Transformer をベースに、さまざまな分野で多数のモデルが誕生しており、それぞれのモデルにはアーキテクチャが異なり、詳細が異なり、説明が難しい名前が付けられています。

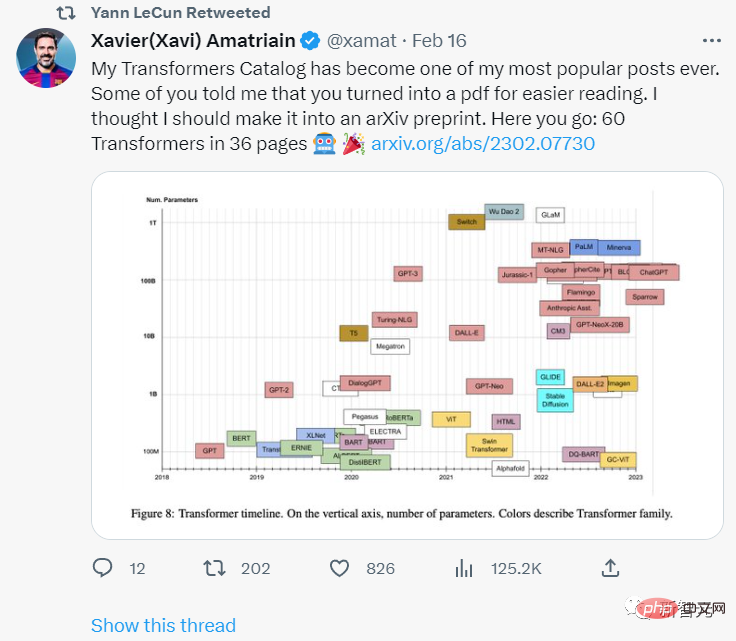

最近、著者は、近年リリースされたすべての人気のあるトランスフォーマー モデルの 包括的な分類を実施しました。 、包括的でありながらシンプルなカタログを提供するようにしてください . この記事には、Transformer のイノベーションの概要と開発プロセスのレビューが含まれています。

紙のリンク: https://arxiv.org/pdf/2302.07730.pdf

チューリング賞受賞者のヤン・ルカン氏は賛同を表明した。

##記事の著者であるザビエル (シャビ) アマトリアンは、2005 年にスペインのポンペウ ファブラ大学を博士号を取得して卒業しました。現在は LinkedIn のエンジニアとして同部門の副社長を務めており、主に製品の人工知能戦略を担当しています。

Transformer は、いくつかのユニークなアーキテクチャ機能を備えたディープ ラーニング モデルの一種です。2017 年に Google 研究者によって発表された有名な論文「Attending is All you Need」で初めて登場しました。わずか 5 年間で、驚くべきことに 38,000 件の引用が蓄積されました。

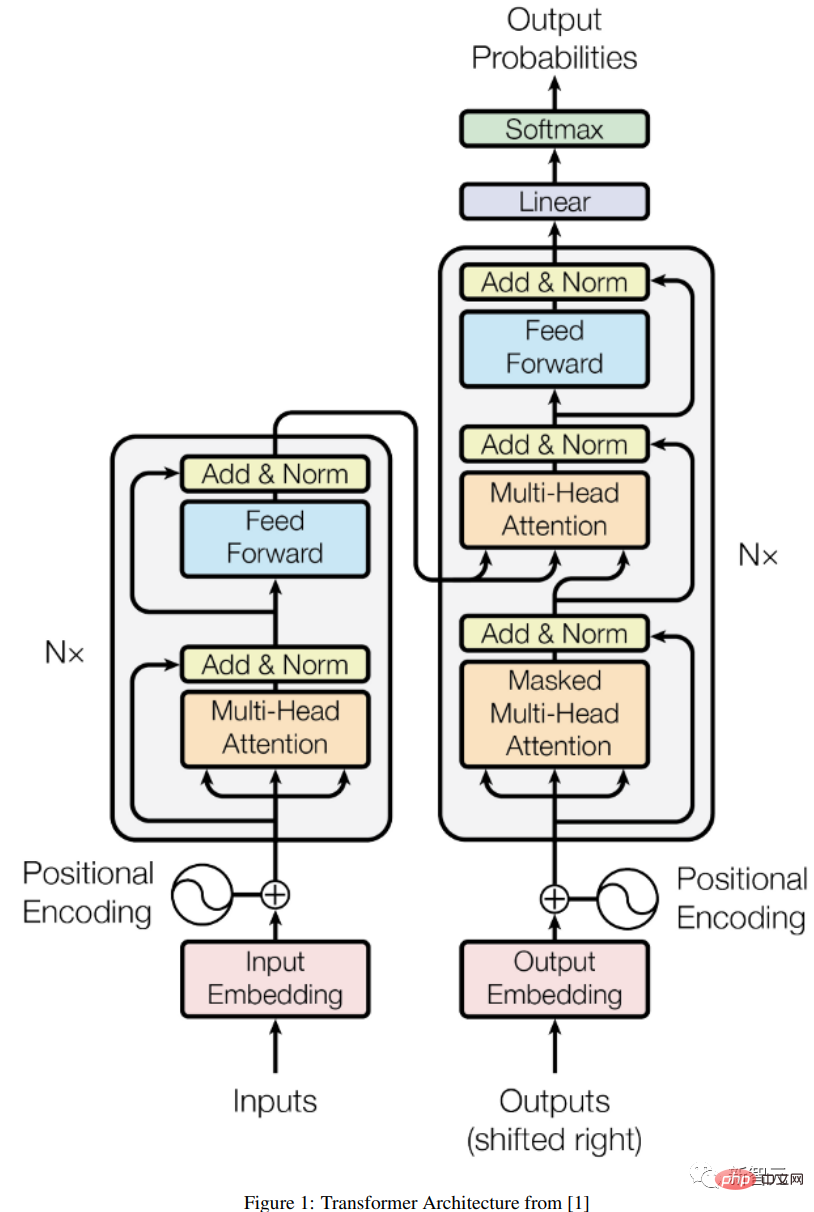

Transformer アーキテクチャもエンコーダ デコーダ モデル (エンコーダ デコーダ) に属しますが、以前のモデルでは、注目はメカニズムの 1 つにすぎず、そのほとんどはLSTM. (Long Short-Term Memory) および RNN (Recurrent Neural Network) のその他の変種。

Transformer を提案するこの論文の重要な洞察の 1 つは、アテンション メカニズムが入力と出力の間の依存関係を導き出す唯一のメカニズムとして使用できるということです。トランスフォーマーのアーキテクチャの詳細をすべて調べるには、興味のある友人は「The Illustrated Transformer」ブログを検索してください。

ブログリンク: https://jalammar.github.io/illustrated-transformer/

#最も重要なコンポーネントのみを以下に簡単に説明します。

エンコーダ/デコーダのアーキテクチャ

a 一般的なものエンコーダ/デコーダ アーキテクチャは 2 つのモデルで構成され、エンコーダは入力を取得して固定長ベクトルにエンコードし、デコーダはベクトルを取得して出力シーケンスにデコードします。エンコーダーとデコーダーは、条件付き対数尤度を最小化するように共同でトレーニングされます。トレーニングが完了すると、エンコーダー/デコーダーは、指定された入力シーケンスに基づいて出力を生成したり、入力/出力シーケンスのペアをスコアリングしたりできます。

元の Transformer アーキテクチャでは、エンコーダとデコーダの両方に 6 つの同一のレイヤがあります。これらの 6 つのレイヤのそれぞれに、エンコーダには 2 つのサブレイヤがあります: マルチヘッド アテンション レイヤとシンプル フィードフォワード ネットワークです。各サブレイヤーに対して 1 つの残りの接続と 1 つのレイヤー正規化を使用します。

エンコーダーの出力サイズは 512 で、デコーダーは 3 番目のサブレイヤー、つまり別のマルチヘッド アテンション レイヤーをエンコーダー出力に追加します。さらに、デコーダ内の別のマルチヘッド層はマスクアウトされ、後続の位置に注意が向けられる情報漏洩を防ぎます。

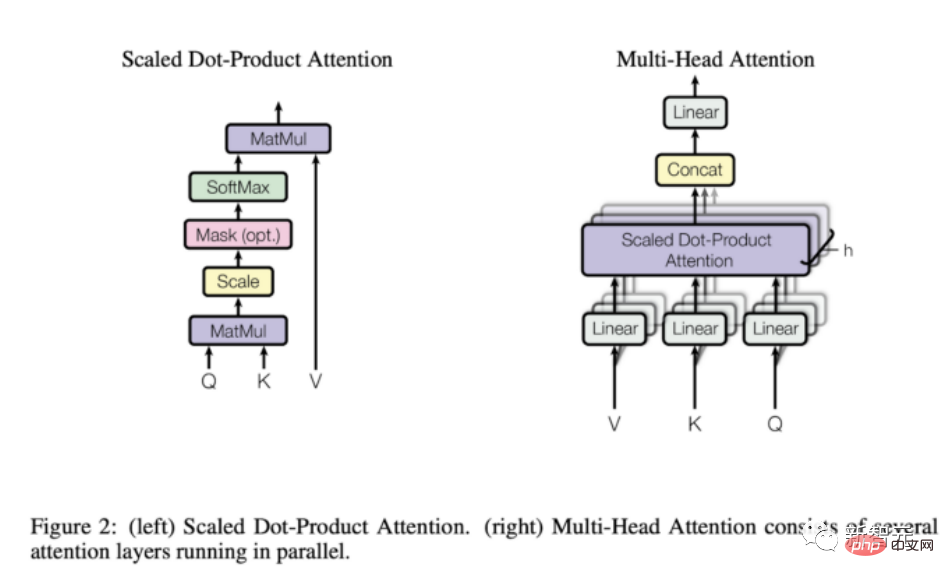

#アテンションメカニズム

上記の説明より 可能な限りご覧のとおり、モデルの構造における唯一の「奇妙な」要素は雄牛の注意であり、ここにモデルのすべての力がかかっています。

attention 関数は、クエリと一連のキーと値のペアの間の出力へのマッピングです。出力は、値の加重合計として計算され、各値に重みが割り当てられます。は、クエリと対応するキーの間の互換性関数によって計算されます。

Transformer は、マルチヘッド アテンションを使用します。これは、スケーリング ドット積アテンションとも呼ばれる、一連のアテンション関数の並列計算です。

リカレント ネットワークや畳み込みネットワークと比較して、アテンション層にはいくつかの利点があります。より重要なのは、計算の複雑さが低いことと、シーケンスの学習に適した接続性の高さです。特に長時間のネットワークに役立ちます。の -term 依存関係。

Transformer では何ができるのですか?なぜ人気になったのでしょうか?

元の Transformer は、主に英語からドイツ語への言語翻訳用に設計されましたが、論文の最初のバージョンは実験結果は、このアーキテクチャが他の言語タスクによく一般化できることを示しています。

この特定の傾向は、研究コミュニティによってすぐに注目されました。

今後数か月のうちに、言語関連の ML タスクのランキングは、すぐに質問と回答のタスク Squad などの Transformer アーキテクチャの一部のバージョンによって完全に占められるでしょう。さまざまなトランスフォーマーモデルによって殺されました。

Transofrmer がすぐにほとんどの NLP ランキングを占めることができる主な理由の 1 つは、他のタスク (転移学習) にすぐに適応できる能力です。事前トレーニングされた Transformer モデルは、トレーニングされていないタスクに非常に簡単かつ迅速に適応できるため、他のモデルに比べて大きな利点となります。

ML 実践者として、巨大なデータセットで大規模なモデルを一からトレーニングする必要はなくなりました。目の前のタスクで事前トレーニングされたモデルを再利用するだけで済みます。場合によってはわずかに調整するだけです。はるかに小さいデータセットを使用します。

事前トレーニングされたモデルをさまざまなタスクに適応させるために使用される特定の手法は、いわゆる微調整です。

トランスフォーマーは他のタスクにも非常に適応力があり、元々は言語関連のタスク用に開発されましたが、すぐにビジュアル アプリケーションやオーディオ アプリケーション、音楽アプリケーションなど、他のタスクにも役立つようになったことがわかりました。チェスをしたり、数学をしたりするまで。

もちろん、数行のコードを書くことができる人なら誰でもすぐに利用できる無数のツールがなければ、これらのアプリケーションはいずれも実現できません。

Transformer は、主要な人工知能フレームワーク (つまり、Pytorch や TensorFlow) にすぐに統合されただけでなく、完全に Transformer 用に構築された企業もいくつかありました。

Huggingface は、これまでに 6,000 万ドル以上を調達したスタートアップで、ほぼ完全にオープンソースの Transformer ライブラリを商用化するというアイデアに基づいて構築されました。

GPT-3 は、2020 年 5 月に OpenAI によって発売された Transformer モデルです。これは、以前の GPT および GPT-2 の後継バージョンです。同社はこのモデルをプレプリントで紹介し、このモデルは非常に強力であるため世界にリリースする資格がないと主張し、多くの話題を呼びました。

さらに、OpenAI は GPT-3 をリリースしなかっただけでなく、Microsoft との非常に大規模なパートナーシップを通じて商用化を達成しました。

現在、GPT-3 は 300 を超えるさまざまなアプリケーションに基礎的な技術サポートを提供しており、OpenAI のビジネス戦略の基盤となっています。これは10億ドル以上の資金提供を受けている企業にとって重要なことだ。

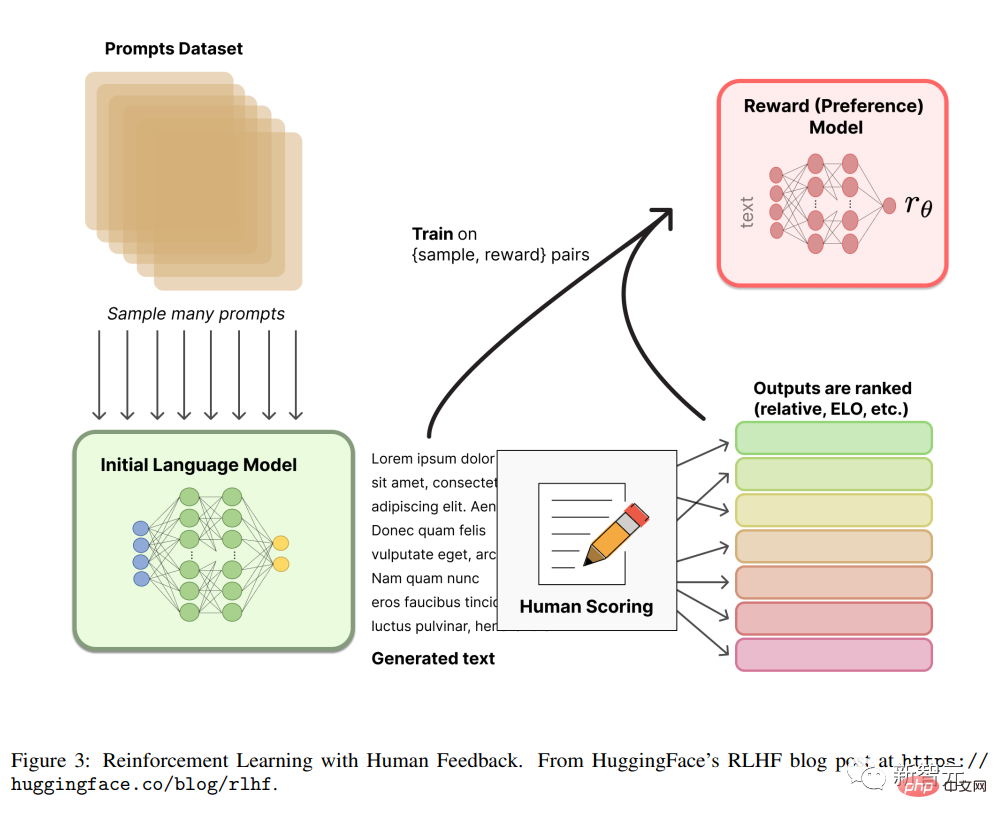

RLHF

人間のフィードバック (または好み) からRLHF (または RLHP) としても知られるこのツールは、最近人工知能ツールボックスに大きく追加されました。

この概念は、2017 年の論文「人間の好みからの深層強化学習」で初めて生まれましたが、最近では ChatGPT や同様の会話型エージェントに適用され、非常に良い結果を達成しています。その効果が再び注目を集めています。

#この記事のアイデアは非常にシンプルで、言語モデルが事前にトレーニングされると、さまざまな効果を生み出すことができます。対話の応答に基づいて人間に結果をランク付けさせ、これらのランキング (好みまたはフィードバックとも呼ばれます) を使用して、強化学習メカニズムを使用して報酬をトレーニングすることができます。

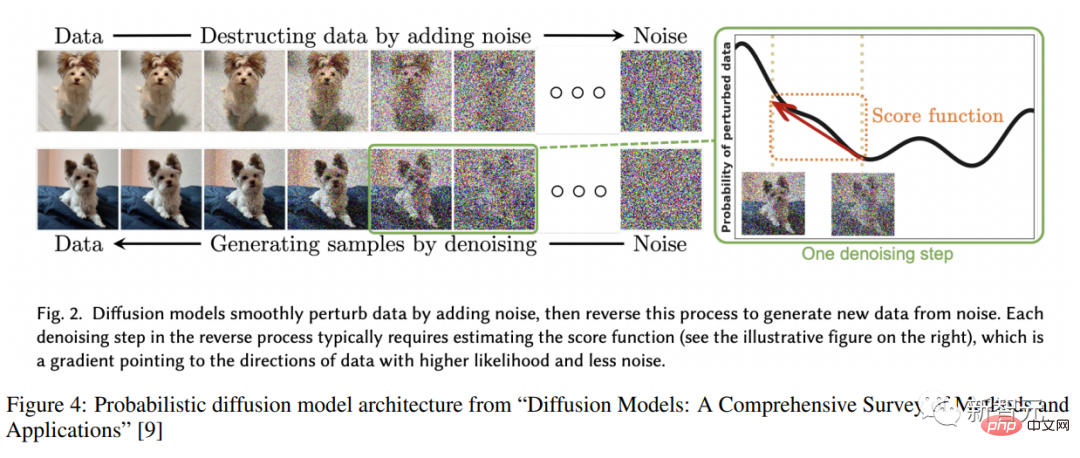

普及モデル拡散

##普及モデルは、画像生成のための新しい SOTA は、GAN (Generative Adversarial Networks) に取って代わられる傾向があります。拡散モデルは、変分推論のトレーニング済み潜在変数モデルの一種です。実際には、特定のノイズ関数を使用するようにディープ ニューラル ネットワークをトレーニングすることを意味します。ぼやけた画像はノイズ除去されます。

はじめにを読んだ後、

Transformerの振り返りの旅を始めましょう!

以上が史上最も完全なトランスフォーマーのコレクション! LeCun の推奨事項: 60 モデルのカタログを作成します。見逃した論文は何ですか?の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7333

7333

9

9

1627

1627

14

14

1351

1351

46

46

1262

1262

25

25

1209

1209

29

29

世界で最も強力なオープンソース MoE モデルが登場。GPT-4 に匹敵する中国語機能を備え、価格は GPT-4-Turbo のわずか 1% 近くです

May 07, 2024 pm 04:13 PM

世界で最も強力なオープンソース MoE モデルが登場。GPT-4 に匹敵する中国語機能を備え、価格は GPT-4-Turbo のわずか 1% 近くです

May 07, 2024 pm 04:13 PM

従来のコンピューティングを超える能力を備えているだけでなく、より低コストでより効率的なパフォーマンスを実現する人工知能モデルを想像してみてください。これは SF ではありません。世界で最も強力なオープンソース MoE モデルである DeepSeek-V2[1] が登場しました。 DeepSeek-V2 は、経済的なトレーニングと効率的な推論の特徴を備えた強力な専門家混合 (MoE) 言語モデルです。これは 236B のパラメータで構成されており、そのうち 21B は各マーカーをアクティブにするために使用されます。 DeepSeek67B と比較して、DeepSeek-V2 はパフォーマンスが優れていると同時に、トレーニング コストを 42.5% 節約し、KV キャッシュを 93.3% 削減し、最大生成スループットを 5.76 倍に高めます。 DeepSeek は一般的な人工知能を研究する会社です

MLP に代わる KAN は、オープンソース プロジェクトによって畳み込みまで拡張されました

Jun 01, 2024 pm 10:03 PM

MLP に代わる KAN は、オープンソース プロジェクトによって畳み込みまで拡張されました

Jun 01, 2024 pm 10:03 PM

今月初め、MIT やその他の機関の研究者らは、MLP に代わる非常に有望な代替案である KAN を提案しました。 KAN は、精度と解釈可能性の点で MLP よりも優れています。また、非常に少数のパラメーターを使用して、多数のパラメーターを使用して実行する MLP よりも優れたパフォーマンスを発揮できます。たとえば、著者らは、KAN を使用して、より小規模なネットワークと高度な自動化で DeepMind の結果を再現したと述べています。具体的には、DeepMind の MLP には約 300,000 個のパラメーターがありますが、KAN には約 200 個のパラメーターしかありません。 KAN は、MLP が普遍近似定理に基づいているのに対し、KAN はコルモゴロフ-アーノルド表現定理に基づいているのと同様に、強力な数学的基礎を持っています。以下の図に示すように、KAN は

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas は正式に電動ロボットの時代に突入します!昨日、油圧式アトラスが歴史の舞台から「涙ながらに」撤退したばかりですが、今日、ボストン・ダイナミクスは電動式アトラスが稼働することを発表しました。ボストン・ダイナミクス社は商用人型ロボットの分野でテスラ社と競争する決意を持っているようだ。新しいビデオが公開されてから、わずか 10 時間ですでに 100 万人以上が視聴しました。古い人が去り、新しい役割が現れるのは歴史的な必然です。今年が人型ロボットの爆発的な年であることは間違いありません。ネットユーザーは「ロボットの進歩により、今年の開会式は人間のように見え、人間よりもはるかに自由度が高い。しかし、これは本当にホラー映画ではないのか?」とコメントした。ビデオの冒頭では、アトラスは仰向けに見えるように地面に静かに横たわっています。次に続くのは驚くべきことです

Google は大喜び: JAX のパフォーマンスが Pytorch や TensorFlow を上回りました! GPU 推論トレーニングの最速の選択肢となる可能性があります

Apr 01, 2024 pm 07:46 PM

Google は大喜び: JAX のパフォーマンスが Pytorch や TensorFlow を上回りました! GPU 推論トレーニングの最速の選択肢となる可能性があります

Apr 01, 2024 pm 07:46 PM

Google が推進する JAX のパフォーマンスは、最近のベンチマーク テストで Pytorch や TensorFlow のパフォーマンスを上回り、7 つの指標で 1 位にランクされました。また、テストは最高の JAX パフォーマンスを備えた TPU では行われませんでした。ただし、開発者の間では、依然として Tensorflow よりも Pytorch の方が人気があります。しかし、将来的には、おそらくより大規模なモデルが JAX プラットフォームに基づいてトレーニングされ、実行されるようになるでしょう。モデル 最近、Keras チームは、ネイティブ PyTorch 実装を使用して 3 つのバックエンド (TensorFlow、JAX、PyTorch) をベンチマークし、TensorFlow を使用して Keras2 をベンチマークしました。まず、主流のセットを選択します

AI が数学研究を破壊する!フィールズ賞受賞者で中国系アメリカ人の数学者が上位 11 件の論文を主導 | テレンス・タオが「いいね!」しました

Apr 09, 2024 am 11:52 AM

AI が数学研究を破壊する!フィールズ賞受賞者で中国系アメリカ人の数学者が上位 11 件の論文を主導 | テレンス・タオが「いいね!」しました

Apr 09, 2024 am 11:52 AM

AI は確かに数学を変えつつあります。最近、この問題に細心の注意を払っている陶哲軒氏が『米国数学協会会報』(米国数学協会会報)の最新号を送ってくれた。 「機械は数学を変えるのか?」というテーマを中心に、多くの数学者が意見を述べ、そのプロセス全体は火花に満ち、ハードコアで刺激的でした。著者には、フィールズ賞受賞者のアクシャイ・ベンカテシュ氏、中国の数学者鄭楽軍氏、ニューヨーク大学のコンピューター科学者アーネスト・デイビス氏、その他業界で著名な学者を含む強力な顔ぶれが揃っている。 AI の世界は劇的に変化しています。これらの記事の多くは 1 年前に投稿されたものです。

時系列予測 NLP 大規模モデルの新機能: 時系列予測の暗黙的なプロンプトを自動的に生成

Mar 18, 2024 am 09:20 AM

時系列予測 NLP 大規模モデルの新機能: 時系列予測の暗黙的なプロンプトを自動的に生成

Mar 18, 2024 am 09:20 AM

今日は、時系列予測のパフォーマンスを向上させるために、時系列データを潜在空間上の大規模な自然言語処理 (NLP) モデルと整合させる方法を提案するコネチカット大学の最近の研究成果を紹介したいと思います。この方法の鍵は、潜在的な空間ヒント (プロンプト) を使用して時系列予測の精度を高めることです。論文タイトル: S2IP-LLM: SemanticSpaceInformedPromptLearningwithLLMforTimeSeriesForecasting ダウンロードアドレス: https://arxiv.org/pdf/2403.05798v1.pdf 1. 大きな問題の背景モデル

FisheyeDetNet: 魚眼カメラに基づいた最初のターゲット検出アルゴリズム

Apr 26, 2024 am 11:37 AM

FisheyeDetNet: 魚眼カメラに基づいた最初のターゲット検出アルゴリズム

Apr 26, 2024 am 11:37 AM

目標検出は自動運転システムにおいて比較的成熟した問題であり、その中でも歩行者検出は最も初期に導入されたアルゴリズムの 1 つです。ほとんどの論文では非常に包括的な研究が行われています。ただし、サラウンドビューに魚眼カメラを使用した距離認識については、あまり研究されていません。放射状の歪みが大きいため、標準のバウンディング ボックス表現を魚眼カメラに実装するのは困難です。上記の説明を軽減するために、拡張バウンディング ボックス、楕円、および一般的な多角形の設計を極/角度表現に探索し、これらの表現を分析するためのインスタンス セグメンテーション mIOU メトリックを定義します。提案された多角形モデルの FisheyeDetNet は、他のモデルよりも優れたパフォーマンスを示し、同時に自動運転用の Valeo 魚眼カメラ データセットで 49.5% の mAP を達成しました。

テスラのロボットは工場で働く、マスク氏:手の自由度は今年22に達する!

May 06, 2024 pm 04:13 PM

テスラのロボットは工場で働く、マスク氏:手の自由度は今年22に達する!

May 06, 2024 pm 04:13 PM

テスラのロボット「オプティマス」の最新映像が公開され、すでに工場内で稼働可能となっている。通常の速度では、バッテリー(テスラの4680バッテリー)を次のように分類します:公式は、20倍の速度でどのように見えるかも公開しました - 小さな「ワークステーション」上で、ピッキング、ピッキング、ピッキング:今回は、それがリリースされたハイライトの1つビデオの内容は、オプティマスが工場内でこの作業を完全に自律的に行い、プロセス全体を通じて人間の介入なしに完了するというものです。そして、オプティマスの観点から見ると、自動エラー修正に重点を置いて、曲がったバッテリーを拾い上げたり配置したりすることもできます。オプティマスのハンドについては、NVIDIA の科学者ジム ファン氏が高く評価しました。オプティマスのハンドは、世界の 5 本指ロボットの 1 つです。最も器用。その手は触覚だけではありません