ChatGPT は学校への入場を禁止されました。AI は特別にルールを変更します。 LeCun: 小型モデルも禁止したらどうですか?

最近の AI 業界でどのモデルが最も人気があるかを尋ねたい場合、10 人中 9 人が ChatGPT に投票するでしょう。このモデルは人気がありすぎるわけがありません。できることが多すぎます。多くの人がこれを本物の「六角形の戦士」と表現します。チャット、検索、翻訳に使用できるだけでなく、ストーリーを書いたり、コードを書いたり、デバッグしたり、さらには小さなゲームを開発してアメリカのゲームを開発することにも使用できます。大学入学試験... 将来の人工知能モデルは ChatGPT とその他の 2 種類だけになるだろうと冗談を言う人もいます。

ChatGPT の機能は非常に優れているため、広く一般に愛されている一方で、常に問題が発生しており、さまざまな機関によって禁止されています。少し前に、Stack Overflow が ChatGPT を他の理由もなく禁止したというニュースがありました。関係者は、ChatGPT が生成した回答の精度が低すぎるため、ChatGPT が一時的に禁止されたと述べました。ChatGPT によって作成された回答を公開することは、Web サイトにとって非常に重要であり、正しい答えを探しているユーザーにとって有害です。

この事件が過ぎてから間もなく、人工知能のトップカンファレンスも ChatGPT と AI ツールを使用して書かれた学術論文を禁止し始めました。具体的に何が起こっているのか見てみましょう。

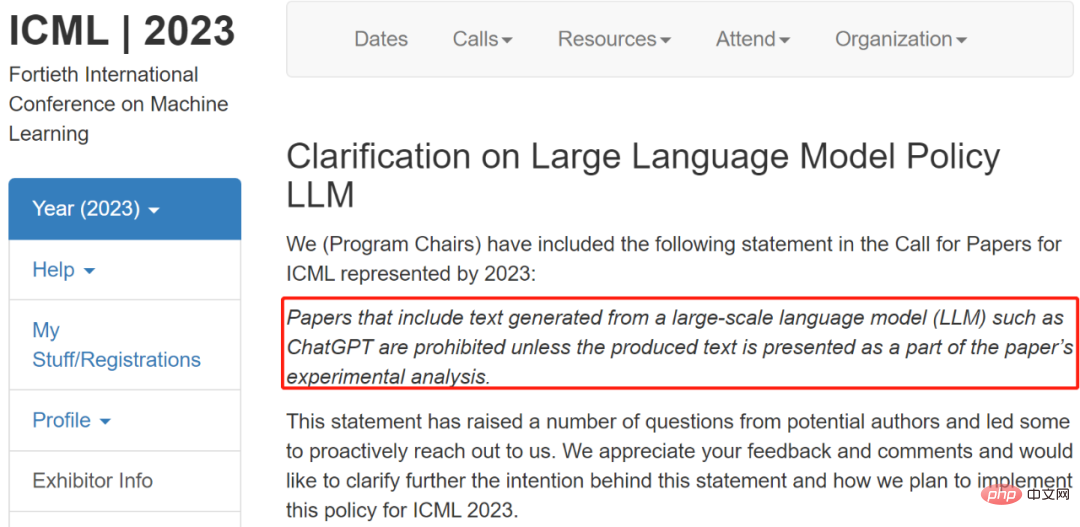

ICML は論文執筆のための大規模な言語モデルの使用を禁止します

数日前、国際機械学習会議 ICML は大規模な言語モデルの使用を禁止すると発表しました。 (LLM、ChatGPT など) を使用して論文を生成します。ただし、生成されたテキストが論文の実験的分析の一部として提示される場合を除きます。

ファイル アドレス: https://icml.cc/Conferences/2023/llm-policy

#ICML によると、ChatGPT などの言語モデルは将来の開発トレンドを表していますが、その後には予期せぬ結果や解決が難しい問題がいくつか発生します。 ICMLによると、ChatGPTは公開データに基づいて訓練されており、多くの場合同意なしに収集されており、何か問題が発生した場合は誰が責任を負うのか。著者の問題もあります。論文を「書いた」のは誰ですか?機械ですか、それとも人間ですか? ICML が AI によって完全に生成されたテキストのみを禁止していることを考慮すると、これは特に重要です。カンファレンスの主催者らは、著者が書いたテキストを編集したり推敲するためにChatGPTなどのツールを使用することは禁止していないと述べ、多くの著者がすでに文法修正ソフトウェアGrammarlyなどの半自動編集ツールを使って記事を推敲していることを指摘した。

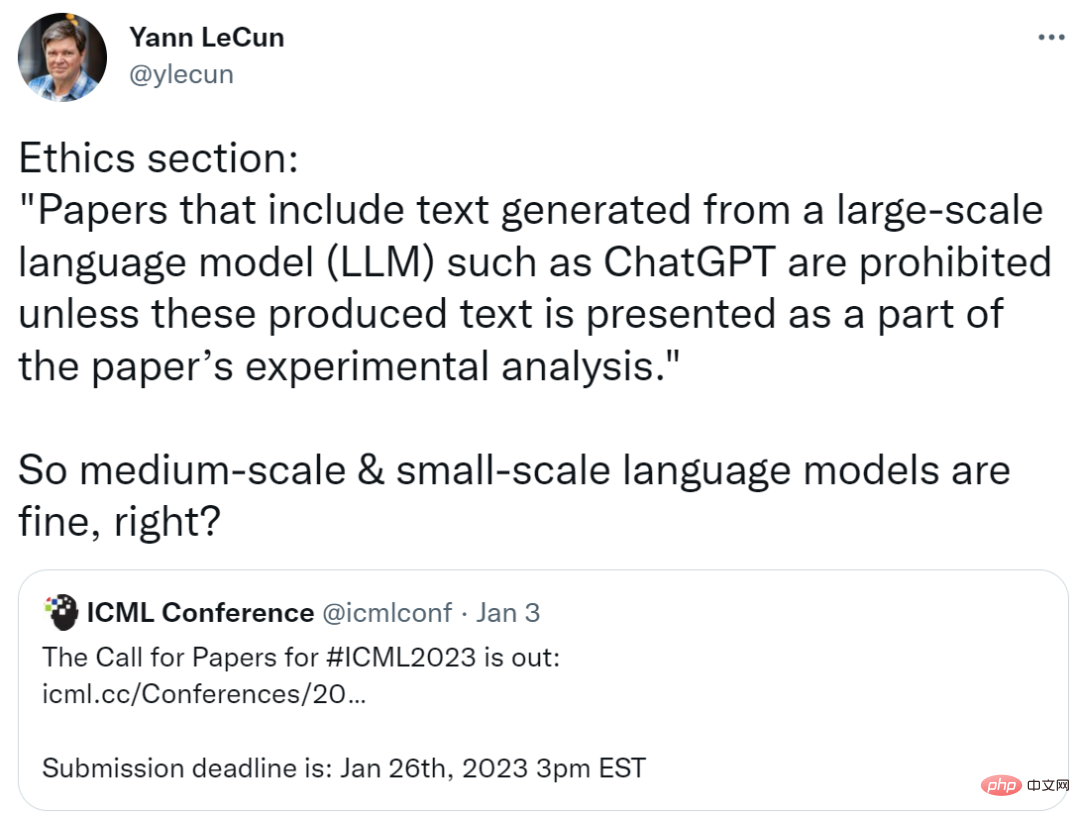

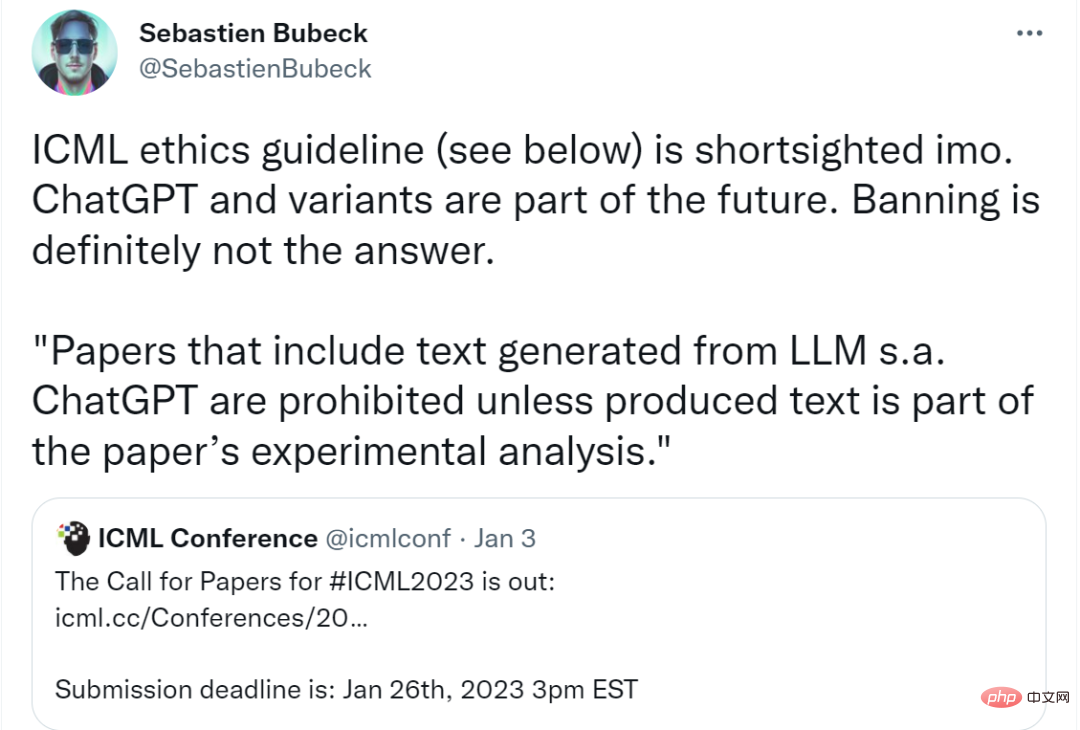

しかし、このニュースが発表されるやいなや、依然としてソーシャル メディアで大きな議論を引き起こしました。Yann LeCun 氏は次のように転送し、コメントしました。「大規模な言語モデルは使用できないため、中小規模の言語モデルは使用できません」言語モデルはまだ使用可能ではありませんか?」

# #ICML は、AI 生成テキストの禁止は来年再評価されるだろうと述べました。

# #ICML は、AI 生成テキストの禁止は来年再評価されるだろうと述べました。

人工知能が生成したテキストの悪影響については、常にさまざまな懸念がありました。最も一般的な問題の 1 つは、これらのシステムからの出力がまったく信頼できないことです。

AI モデルは、特定の文の次の単語を予測するようにトレーニングされますが、そこから抽出できる「事実」のハードコードされたデータベースがないため、モデルが生成した結果は多くの場合、矛盾した状況です。多くの場合、生成された文は文法論理には準拠していますが、客観的な現実には準拠していません。

もう 1 つ、これも非常に難しい問題があります。テキストが AI によって「洗練および編集」されたのか、それとも完全に AI によって生成されたのかを区別するのが難しいのです。この問題は論文にとって非常に深刻です。著者が AI モデルを使用して論文に基づいて簡潔な要約を生成した場合、これはテキストを編集したものとみなされますか、それともテキストを最初から生成したものとみなされますか?

もちろん、ChatGPT のような AI ツールを使用することだけが欠点ではありません。たとえば、査読では流暢な英語表現がより高い評価を受ける傾向があり、AI モデルは英語を母語としない論文著者がより流暢な英語の文章を生成するのに役立ちます。これにより研究者の時間が節約され、学術分野でより平等な競争の場が生まれるでしょう。

ただし、ChatGPT は大規模言語モデル (LLM) であり、Grammarly などの単純な文法修正ソフトウェアとは大きく異なることに注意してください。 LLM 自体の主な機能は、すでに書かれたテキストの構造や言語を調整することではなく、新しいテキストを生成することです。

実際、AI 言語モデルを実際に使用して学術論文を作成する論文著者はほとんどいません。学術論文の要件は非常に厳しいため、著者は通常、出版する前に論文の内容を何度もチェックします。 AI を使用して生成された論文に誤りがあった場合、指名されたすべての論文著者の評判は深刻な影響を受け、キャリア全体に影響を及ぼします。

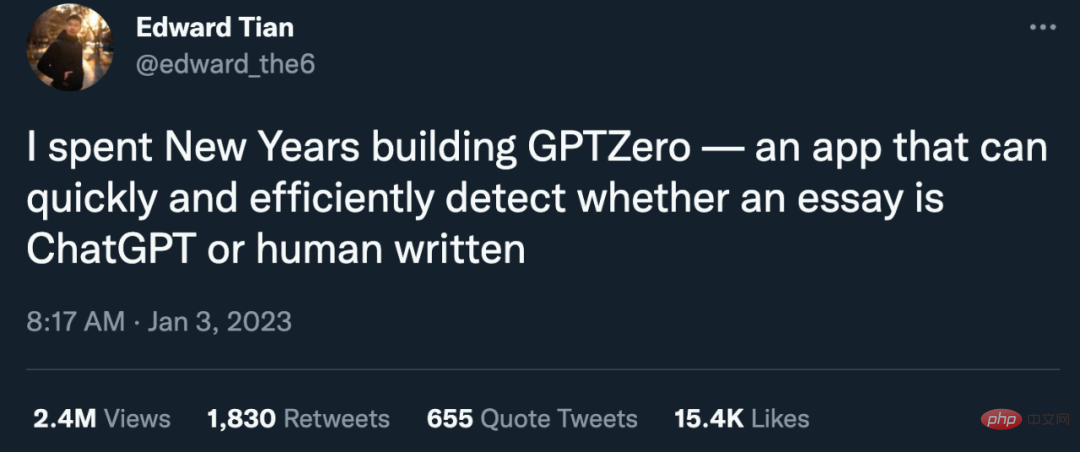

論文レビューの観点から見ると、論文が AI によって生成されたものであるか、手動で書かれたものであるかを区別するための高速かつ効果的な検出ツールが必要です。最近、開発者は、この検出機能を備えた GPTZero と呼ばれる新しいアプリケーションをリリースしました。

GPTZero はプリンストン大学のコンピューター サイエンスの学生 Edward Tian によって開発され、テキストが書かれたかどうかという 2 つの異なる指標を使用して評価されます。 AI モデルによる: 複雑さとバースト性。これは、「モデル」を倒すために「モデル」を使用している可能性があります。

ニューヨーク市の学校は ChatGPT へのアクセスを禁止しました

ほぼ同時に、ChatGPT は学校によって禁止されました。ニューヨーク市教育省は、AIツールが教育を混乱させる可能性があるとの懸念から、そのネットワークとデバイス上でChatGPTへのアクセスをブロックした。

同省の広報担当者、ジェナ・ライル氏は次のように述べています。この禁止は主に、ChatGPT が学生の学習に悪影響を与える可能性と、その安全性と精度に対する懸念によるものです。 ChatGPT によって生成されたコンテンツです。このツールは迅速かつ簡単な答えを提供しますが、学生の学業上および生涯にわたる成功に不可欠な批判的思考と問題解決スキルを開発することはできません。

さらに、ChatGPT には他の言語モデルが抱える問題もあります。トレーニング データはインターネットから取得されているため、その回答には性差別や人種的偏見などの内容が繰り返され、増幅されることがよくあります。このタイプの言語モデルは、歴史的な日付から科学法則に至るまで情報を捏造する傾向がありますが、他の言語モデルは通常、情報を捏造していることを検出できません。

教育者がこのツールについて特に懸念しているのは、こうした事実上の誤りです。多くの教師は、ChatGPT のようなソフトウェアでは生徒の作文を書く能力をテストすることは本質的に不可能だと述べています。 ChatGPT を使用して生徒が数秒で書けるのであれば、生徒は書くことに労力を費やしたくないでしょう。

しかし、教育システムも、Google 検索や Wikipedia などの初期の破壊的テクノロジーに適応したのと同じように、このテクノロジーの出現に適応する必要があると主張する人もいます。しかし、誰もが ChatGPT に適応するには時間がかかるのは明らかです。

テキスト記述仕様を手動で策定して強制する場合でも、テキストが AI によって生成されたかどうかを判断するために何らかの方法を使用する場合でも、人々がその使用法を標準化する緊急の必要性を認識していることを示しています。 ChatGPT などのテキスト生成モデルの。 ChatGPT の使用例と価値はまだ定義されていません。

以上がChatGPT は学校への入場を禁止されました。AI は特別にルールを変更します。 LeCun: 小型モデルも禁止したらどうですか?の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7773

7773

15

15

1644

1644

14

14

1399

1399

52

52

1296

1296

25

25

1234

1234

29

29

WorldCoin(WLD)価格予測2025-2031:WLDは2031年までに4ドルに達しますか?

Apr 21, 2025 pm 02:42 PM

WorldCoin(WLD)価格予測2025-2031:WLDは2031年までに4ドルに達しますか?

Apr 21, 2025 pm 02:42 PM

WorldCoin(WLD)は、独自の生体認証とプライバシー保護メカニズムを備えた暗号通貨市場で際立っており、多くの投資家の注目を集めています。 WLDは、特にOpenai人工知能技術と組み合わせて、革新的なテクノロジーを備えたAltcoinsの間で驚くほど演奏しています。しかし、デジタル資産は今後数年間でどのように振る舞いますか? WLDの将来の価格を一緒に予測しましょう。 2025年のWLD価格予測は、2025年にWLDで大幅に増加すると予想されています。市場分析は、平均WLD価格が1.31ドルに達する可能性があり、最大1.36ドルであることを示しています。ただし、クマ市場では、価格は約0.55ドルに低下する可能性があります。この成長の期待は、主にWorldCoin2によるものです。

ビットコイン完成品構造の分析チャートは何ですか?描く方法は?

Apr 21, 2025 pm 07:42 PM

ビットコイン完成品構造の分析チャートは何ですか?描く方法は?

Apr 21, 2025 pm 07:42 PM

ビットコイン構造分析チャートを描画する手順には、次のものが含まれます。1。図面の目的と視聴者を決定します。2。適切なツールを選択します。3。フレームワークを設計し、コアコンポーネントを入力します。4。既存のテンプレートを参照してください。完全な手順チャートが正確で理解しやすいことを確認してください。

なぜ仮想通貨価格の上昇または下落があるのですか?なぜ仮想通貨価格の上昇または下落があるのですか?

Apr 21, 2025 am 08:57 AM

なぜ仮想通貨価格の上昇または下落があるのですか?なぜ仮想通貨価格の上昇または下落があるのですか?

Apr 21, 2025 am 08:57 AM

仮想通貨価格の上昇の要因には、次のものが含まれます。1。市場需要の増加、2。供給の減少、3。刺激された肯定的なニュース、4。楽観的な市場感情、5。マクロ経済環境。衰退要因は次のとおりです。1。市場需要の減少、2。供給の増加、3。ネガティブニュースのストライキ、4。悲観的市場感情、5。マクロ経済環境。

クロスチェーントランザクションとはどういう意味ですか?クロスチェーントランザクションとは何ですか?

Apr 21, 2025 pm 11:39 PM

クロスチェーントランザクションとはどういう意味ですか?クロスチェーントランザクションとは何ですか?

Apr 21, 2025 pm 11:39 PM

クロスチェーントランザクションをサポートする交換:1。Binance、2。Uniswap、3。Sushiswap、4。CurveFinance、5。Thorchain、6。1inchExchange、7。DLNTrade、これらのプラットフォームはさまざまな技術を通じてマルチチェーン資産トランザクションをサポートします。

通貨サークル市場に関するリアルタイムデータの上位10の無料プラットフォーム推奨事項がリリースされます

Apr 22, 2025 am 08:12 AM

通貨サークル市場に関するリアルタイムデータの上位10の無料プラットフォーム推奨事項がリリースされます

Apr 22, 2025 am 08:12 AM

初心者に適した暗号通貨データプラットフォームには、Coinmarketcapと非小さいトランペットが含まれます。 1。CoinMarketCapは、初心者と基本的な分析のニーズに合わせて、グローバルなリアルタイム価格、市場価値、取引量のランキングを提供します。 2。小さい引用は、中国のユーザーが低リスクの潜在的なプロジェクトをすばやくスクリーニングするのに適した中国フレンドリーなインターフェイスを提供します。

カーネルエアドロップ報酬を獲得する方法バイナンスフルプロセス戦略

Apr 21, 2025 pm 01:03 PM

カーネルエアドロップ報酬を獲得する方法バイナンスフルプロセス戦略

Apr 21, 2025 pm 01:03 PM

暗号通貨の賑やかな世界では、新しい機会が常に現れます。現在、Kerneldao(Kernel)Airdropアクティビティは多くの注目を集め、多くの投資家の注目を集めています。それで、このプロジェクトの起源は何ですか? BNBホルダーはそれからどのような利点を得ることができますか?心配しないでください、以下はあなたのためにそれを一つ一つ明らかにします。

Aavenomicsは、Aaveプロトコルトークンを変更し、Tokenの買戻しを導入するための推奨事項です。

Apr 21, 2025 pm 06:24 PM

Aavenomicsは、Aaveプロトコルトークンを変更し、Tokenの買戻しを導入するための推奨事項です。

Apr 21, 2025 pm 06:24 PM

Aavenomicsは、Aaveプロトコルトークンを変更し、Aavedaoの定足数を実装したToken Reposを導入する提案です。 Aave Project Chain(ACI)の創設者であるMarc Zellerは、これをXで発表し、契約の新しい時代をマークしていることに注目しました。 Aave Chain Initiative(ACI)の創設者であるMarc Zellerは、Aavenomicsの提案にAave Protocolトークンの変更とトークンリポジトリの導入が含まれていると発表しました。 Zellerによると、これは契約の新しい時代を告げています。 Aavedaoのメンバーは、水曜日の週に100でした。

Rexas Finance(RXS)は、2025年にSolana(Sol)、Cardano(ADA)、XRP、Dogecoin(Doge)を上回ることができます

Apr 21, 2025 pm 02:30 PM

Rexas Finance(RXS)は、2025年にSolana(Sol)、Cardano(ADA)、XRP、Dogecoin(Doge)を上回ることができます

Apr 21, 2025 pm 02:30 PM

不安定な暗号通貨市場では、投資家は人気のある通貨を超えた代替品を探しています。 Solana(Sol)、Cardano(ADA)、XRP、Dogecoin(DOGE)などのよく知られた暗号通貨も、市場の感情、規制の不確実性、スケーラビリティなどの課題に直面しています。ただし、新しい新興プロジェクトであるRexasFinance(RXS)が出現しています。それは有名人の効果や誇大広告に依存するのではなく、現実世界の資産(RWA)とブロックチェーン技術を組み合わせて投資家に革新的な投資方法を提供することに焦点を当てています。この戦略により、2025年の最も成功したプロジェクトの1つになることを望んでいます。Rexasfi