ICLR のブラインドレビュー段階で査読者から高く評価された論文: Transformer アーキテクチャの大きな革新となるでしょうか?

多くの注目すべき成果にもかかわらず、ディープ ニューラル ネットワーク (DNN) のトレーニングにおける実際的な進歩は、理論的根拠とはほとんど無関係です。成功している最新の DNN のほとんどは、残余接続と正規化層の特定の配置に依存していますが、新しいアーキテクチャでこれらのコンポーネントを使用する方法の一般原則はまだ不明であり、既存のアーキテクチャにおけるそれらの役割はまだ完全には理解されていません。

残差アーキテクチャは最も人気があり成功を収めており、もともと畳み込みニューラル ネットワーク (CNN) のコンテキストで開発され、後にアテンション ネットワークから遍在的に出現しました。残差アーキテクチャが成功する理由の 1 つは、通常の DNN と比較して信号伝播が優れていることです。信号伝播とは、DNN 層を介した幾何学的情報の送信を指し、カーネル関数によって表されます。

最近、信号伝播原理を使用して、残留接続や残留アーキテクチャの正規化層を関与させずに、より深い DNN をトレーニングすることが、コミュニティの関心の対象となっています。理由は 2 つあります: 第 1 に、残差アーキテクチャの有効性に関する信号伝播仮説が検証され、DNN の解釈可能性の理解を明確にすることができます。第 2 に、これにより、残差パラダイムを超えた DNN トレーニング可能性の一般原理と方法が可能になる可能性があります。

CNN の場合、Xiao et al. (2018) の研究では、初期化を改善することで信号伝播を改善することで、通常のディープ ネットワークを効率的にトレーニングできることが示されています。残りのネットワークよりも大幅に遅い。 Martens et al. (2021) の研究では、活性化関数変換を使用して信号伝播を制御し、K-FAC などの強力な 2 次オプティマイザーを使用して通常のネットワークと残差ネットワークのトレーニングを実装するディープ カーネル シェーピング (DKS) を提案しました。 ImageNet では速度は同等です。 Zhang et al. (2022) の研究では、DKS をより大きなクラスの活性化関数に拡張し、一般化においてほぼ同等の結果を達成しています。

信号伝播で分析する重要な量は、DNN の初期化時間カーネル、より正確には、無限幅制限の下での近似カーネルです。デルタ初期化を使用する多層パーセプトロン (MLP) および CNN の場合、カーネルは 2D 関数のみを含む単純な層再帰として記述でき、簡単な分析を容易にします。クロスレイヤトランスフォーマのカーネル進化はより複雑であるため、DKS などの既存の方法はトランスフォーマや、実際にはセルフアテンション層を含むアーキテクチャには適していません。

MLP では、信号の伝播は (1 次元の) カーネルの動作を見て判断されますが、トランス内の信号の伝播は (高次元の) カーネルの動作を見て判断できます。 ) ネットワーク層のカーネルマトリックス の進化から判断します。

この研究では、対角要素が深さの増加とともに急速に拡大または縮小する状況を回避する必要があります。これは制御されていない活性化規範に関連しており、飽和損失や数値的問題を引き起こす可能性があります。ランク崩壊を回避することはディープトランスフォーマーのトレーニング可能性のために必要ですが、ディープ残差フリートランスフォーマーをトレーニングできるかどうかは未解決の問題のままです。

ICLR 2023 のブラインドレビュー段階のこの論文は、この問題を解決し、残留接続や正規化層なしでディープトランスフォーマーを正常に訓練できることを初めて実証します。この目的を達成するために、彼らは深い残留物のない変圧器における信号伝播とランク崩壊の問題を研究し、それらを防ぐための 3 つの方法を導き出しました。具体的には、このアプローチでは、パラメーターの初期化、バイアス行列、位置依存の再スケーリングを組み合わせて使用し、位置エンコーディングや因果関係マスキングとの相互作用など、トランス内の信号伝播に特有のいくつかの複雑さを浮き彫りにします。研究者らは、彼らの方法が深く訓練可能な残差のない変換器を生成できることを経験的に実証しました。

実験部分では、WikiText-103 および C4 データセットを使用して、研究者らは主要な手法である指数関数的信号維持注意 (E-SPA) の使用を実証しました。トレーニング時間を約 5 倍に延長することで、標準変圧器のトレーニング損失が論文の残留変圧器の損失と同等になります。さらに、研究者らは、この方法を残差接続と組み合わせることで、正規化層のないトランスフォーマーが標準トランスフォーマーと同等のトレーニング速度を達成できることも示しました。

#論文アドレス: https://openreview.net/pdf?id=NPrsUQgMjKK

この論文に関して、Google AI のチーフ エンジニアである Rohan Anil は、これが Transformer アーキテクチャの大きな前進であり、根本的な改善であると信じています。

ショートカットなしでトレーニング可能な深い Transformer の構築

これまでのところ、Transformer のランク崩壊を修正する唯一の戦略は残留接続に依存しており、このアプローチでは省略されています。自己注意層に固有の訓練可能性の問題。対照的に、この研究はこの質問に直接取り組んでいます。まずアテンション層を介した信号伝播をより深く理解し、次に洞察に基づいて変更を加えて、残留接続の有無にかかわらずトレーニングできる深いトランスフォーマーでの忠実な信号伝送を実現します。

具体的には、まず研究では、ディープバニラトランスの簡単な設定を注意のみで実施し、次にトランスが単一ヘッド (h = 1) 設定またはマルチヘッド設定では、注意行列 A は異なるヘッド間で変化しません。ブロック l≤L が初期化時にアテンション行列 A_l を持つ場合、最終ブロックの表現は X_L になります。

上記の式の場合、  と

と  は直交初期化を採用しており、

は直交初期化を採用しており、 は初期化中に直交することができます。

は初期化中に直交することができます。

上記の仮定の下で、クロスポジション入力カーネル行列を表すために  を使用すると、いくつかの単純化の後、次の式が得られます。

を使用すると、いくつかの単純化の後、次の式が得られます。

この単純化された式 (深さのみのアテンション変換器のカーネル行列) から、(A_l)_l の 3 つの要件を決定できます。

-

各ブロック内で適切に実行し、ランクの崩壊や対角値の爆発/消失などの劣化状況を回避する必要があります。

各ブロック内で適切に実行し、ランクの崩壊や対角値の爆発/消失などの劣化状況を回避する必要があります。

- #A_l する必要があります。要素ごとに非負の ∀l である必要があります。

- A_l は、因果マスク アテンションと互換性があるように下三角 ∀l である必要があります。

次のセクション 3.1 と 3.2 では、研究は上記のニーズを満たすアテンション マトリックスを見つけることに焦点を当て、E-SPA、U-SPA、および 3 つの方法を提案しています。 Value-Skipinit、それぞれのメソッドを使用してトランスのアテンション マトリックスを制御し、深い深さでも忠実な信号伝播を可能にします。さらに、セクション 3.3 では、これらのアテンション マトリックスを実装するためにソフトマックス アテンションを変更する方法を示します。

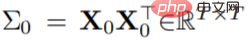

以下の図では、研究では提案された 2 つの SPA スキーム、U-SPA と E-SPA を検証しました。結果は、ネットワークが深い場合でも、うまく回避できることを示しています。バニラトランスフォーマーにおけるランク崩壊現象のみに注目してください。

実験

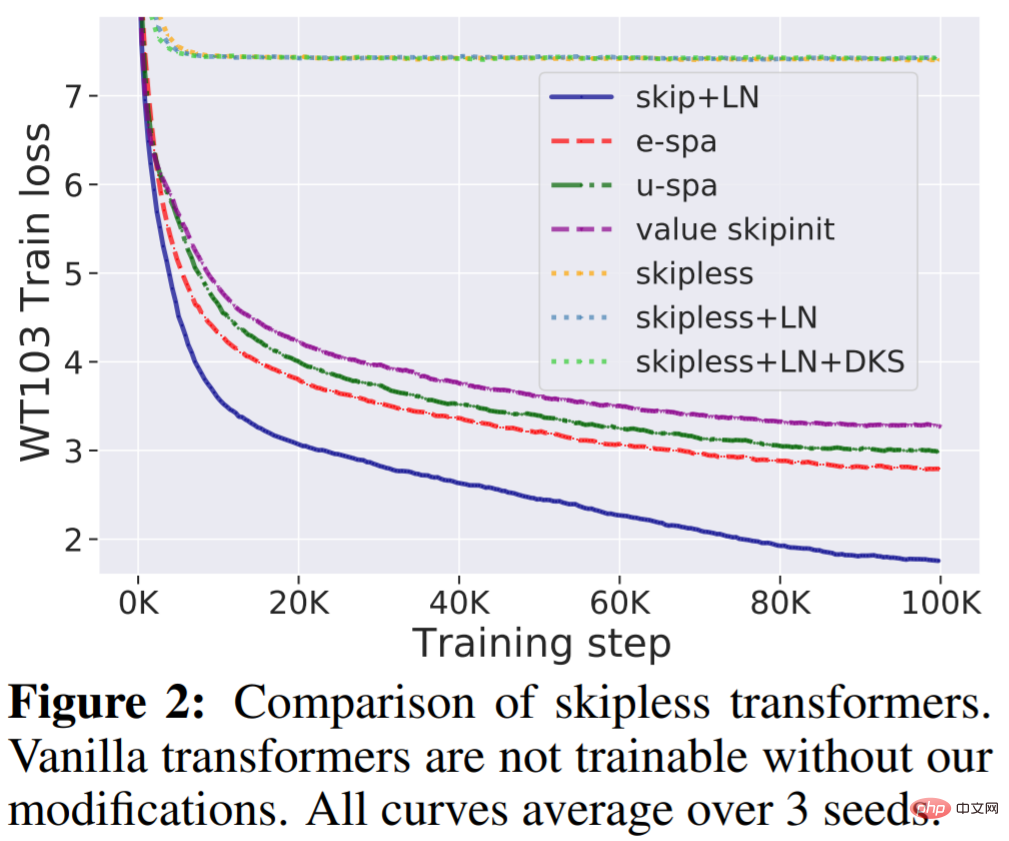

WikiText-103 ベースライン: まず、この研究では、正規化層 (LN) と変換されたアクティベーションがある場合でも、残差接続のない標準的なディープ トランスフォーマーはトレーニングできないことを検証しますが、メソッドはこの記事ではこの問題を解決できます。図 2 に示すように、標準変圧器から残留接続を除去するとトレーニング不能になり、トレーニング損失が約 7.5 で安定することがはっきりとわかります。図 1 に示すように、標準トランスにはランク崩壊が発生します。

一方、本研究で提案した E-SPA 手法は、U-SPA や Value-Skipinit を上回っています。ただし、残差と LN を含むデフォルトのトランスフォーマーは、残差のない方法と比較してトレーニング速度の利点を維持します。

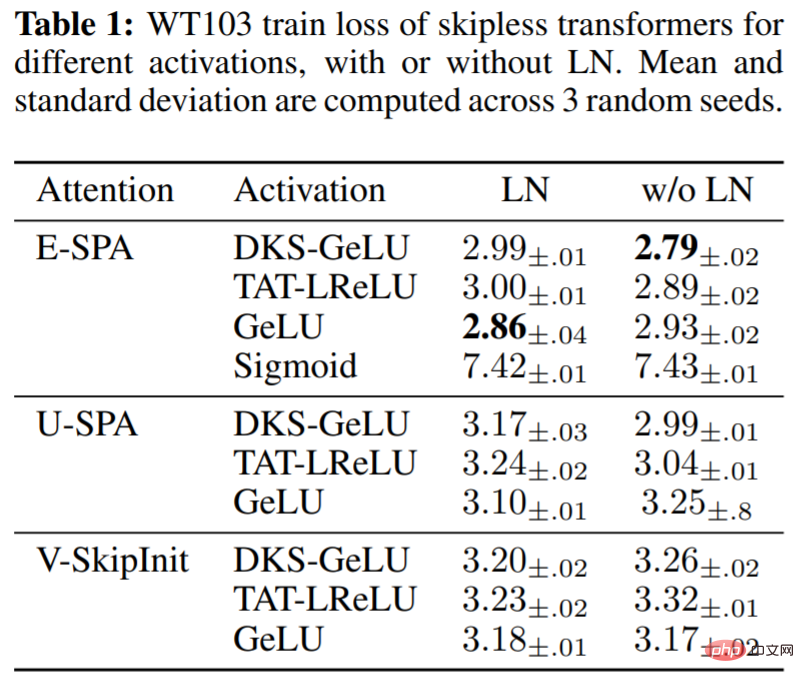

表 1 では、提案された方法と残差のない変換器での LN の使用を使用して、MLP ブロック内のさまざまな活性化関数の影響を評価しています。深さ 36 では、私たちの方法は一連のアクティベーション (DKS 変換された GeLU、TAT 変換された Leaky ReLU、および未変換の GeLU) に対して良好なトレーニング パフォーマンスを達成しましたが、未変換の Sigmoid ではないことがわかります。また、層の正規化はトレーニング速度にとって比較的重要ではなく、アクティベーション仕様を制御するためのメカニズムがすでに組み込まれている SPA を使用する場合、変換されたアクティベーションに悪影響を与える可能性さえあることが実験的に確認されています。

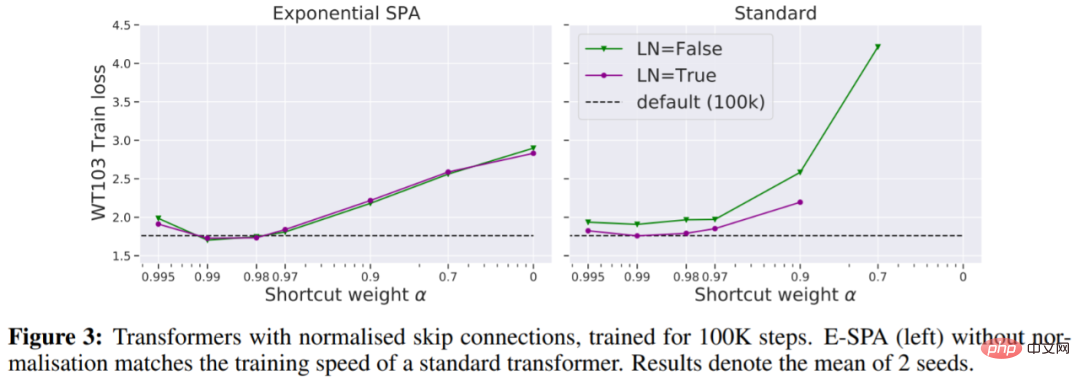

図 3 では、追加の反復を必要とせずにデフォルトのトランスフォーマーのトレーニング損失を一致させる 1 つの方法は、正規化残差接続を使用することであることがわかります。

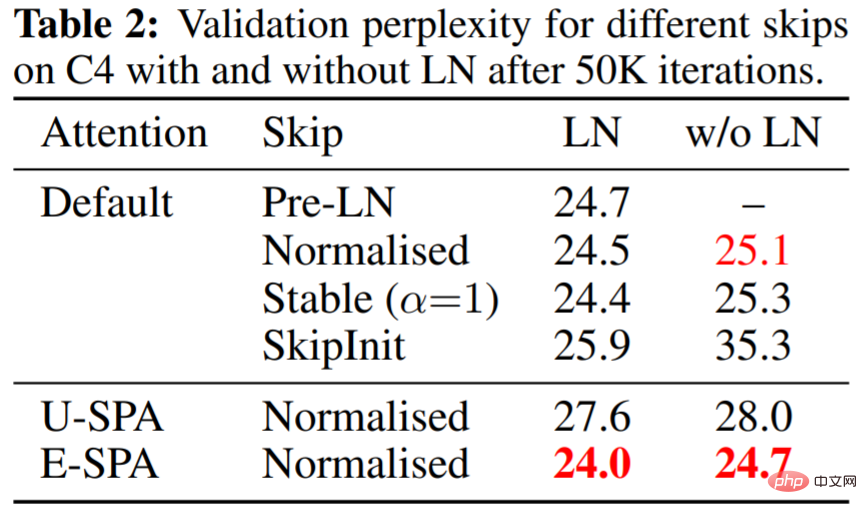

#表 2 は、正規化された残差と LN を備えた E-SPA がデフォルトの PreLN トランスフォーマーよりも優れていることを示しています。

以上がICLR のブラインドレビュー段階で査読者から高く評価された論文: Transformer アーキテクチャの大きな革新となるでしょうか?の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7484

7484

15

15

1377

1377

52

52

77

77

11

11

19

19

38

38

オープンソース!ゾーイデプスを超えて! DepthFM: 高速かつ正確な単眼深度推定!

Apr 03, 2024 pm 12:04 PM

オープンソース!ゾーイデプスを超えて! DepthFM: 高速かつ正確な単眼深度推定!

Apr 03, 2024 pm 12:04 PM

0.この記事は何をするのですか?私たちは、多用途かつ高速な最先端の生成単眼深度推定モデルである DepthFM を提案します。従来の深度推定タスクに加えて、DepthFM は深度修復などの下流タスクでも最先端の機能を実証します。 DepthFM は効率的で、いくつかの推論ステップ内で深度マップを合成できます。この作品について一緒に読みましょう〜 1. 論文情報タイトル: DepthFM: FastMonocularDepthEstimationwithFlowMatching 著者: MingGui、JohannesS.Fischer、UlrichPrestel、PingchuanMa、Dmytr

エンコーダ/デコーダ アーキテクチャを放棄し、より効果的なエッジ検出に拡散モデルを使用する 国立防衛工科大学は DiffusionEdge を提案しました

Feb 07, 2024 pm 10:12 PM

エンコーダ/デコーダ アーキテクチャを放棄し、より効果的なエッジ検出に拡散モデルを使用する 国立防衛工科大学は DiffusionEdge を提案しました

Feb 07, 2024 pm 10:12 PM

現在のディープ エッジ検出ネットワークは通常、エンコーダ/デコーダ アーキテクチャを採用しています。このアーキテクチャには、マルチレベルの特徴をより適切に抽出するためのアップ サンプリング モジュールとダウン サンプリング モジュールが含まれています。ただし、この構造では、ネットワークが正確かつ詳細なエッジ検出結果を出力することが制限されます。この問題に対して、AAAI2024 に関する論文は新しい解決策を提供しています。論文のタイトル: DiffusionEdge:DiffusionProbabilisticModelforCrispEdgeDetection 著者: Ye Yunfan (国立国防技術大学)、Xu Kai (国立国防技術大学)、Huang Yuxing (国立国防技術大学)、Yi Renjiao (国立国防技術大学)、Cai Zhiping (防衛工科大学) 論文リンク:https://ar

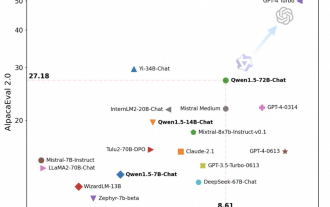

Tongyi Qianwen が再びオープンソースになり、Qwen1.5 では 6 つのボリューム モデルが提供され、そのパフォーマンスは GPT3.5 を超えます

Feb 07, 2024 pm 10:15 PM

Tongyi Qianwen が再びオープンソースになり、Qwen1.5 では 6 つのボリューム モデルが提供され、そのパフォーマンスは GPT3.5 を超えます

Feb 07, 2024 pm 10:15 PM

春節に合わせて、Tongyi Qianwen Model (Qwen) のバージョン 1.5 がオンラインになりました。今朝、新しいバージョンのニュースが AI コミュニティの注目を集めました。大型モデルの新バージョンには、0.5B、1.8B、4B、7B、14B、72Bの6つのモデルサイズが含まれています。その中でも最強バージョンの性能はGPT3.5やMistral-Mediumを上回ります。このバージョンには Base モデルと Chat モデルが含まれており、多言語サポートを提供します。アリババの同義前文チームは、関連技術が同義前文公式ウェブサイトと同義前文アプリでもリリースされたと述べた。さらに、本日の Qwen 1.5 リリースには、32K のコンテキスト長のサポート、Base+Chat モデルのチェックポイントのオープン、および 32K のコンテキスト長のサポートなどのハイライトもあります。

大規模なモデルもスライスでき、Microsoft SliceGPT により LLAMA-2 の計算効率が大幅に向上します。

Jan 31, 2024 am 11:39 AM

大規模なモデルもスライスでき、Microsoft SliceGPT により LLAMA-2 の計算効率が大幅に向上します。

Jan 31, 2024 am 11:39 AM

大規模言語モデル (LLM) には通常、数十億のパラメーターがあり、数兆のトークンでトレーニングされます。ただし、このようなモデルのトレーニングとデプロイには非常にコストがかかります。計算要件を軽減するために、さまざまなモデル圧縮技術がよく使用されます。これらのモデル圧縮技術は一般に、蒸留、テンソル分解 (低ランク因数分解を含む)、枝刈り、および量子化の 4 つのカテゴリに分類できます。プルーニング手法は以前から存在していましたが、多くはパフォーマンスを維持するためにプルーニング後にリカバリ微調整 (RFT) を必要とするため、プロセス全体のコストが高くつき、拡張が困難になります。チューリッヒ工科大学とマイクロソフトの研究者は、この問題に対する SliceGPT と呼ばれる解決策を提案しました。この方法の中心となるアイデアは、重み行列の行と列を削除することでネットワークの埋め込みを減らすことです。

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas は正式に電動ロボットの時代に突入します!昨日、油圧式アトラスが歴史の舞台から「涙ながらに」撤退したばかりですが、今日、ボストン・ダイナミクスは電動式アトラスが稼働することを発表しました。ボストン・ダイナミクス社は商用人型ロボットの分野でテスラ社と競争する決意を持っているようだ。新しいビデオが公開されてから、わずか 10 時間ですでに 100 万人以上が視聴しました。古い人が去り、新しい役割が現れるのは歴史的な必然です。今年が人型ロボットの爆発的な年であることは間違いありません。ネットユーザーは「ロボットの進歩により、今年の開会式は人間のように見え、人間よりもはるかに自由度が高い。しかし、これは本当にホラー映画ではないのか?」とコメントした。ビデオの冒頭では、アトラスは仰向けに見えるように地面に静かに横たわっています。次に続くのは驚くべきことです

更新された Point Transformer: より効率的、高速、そして強力になりました。

Jan 17, 2024 am 08:27 AM

更新された Point Transformer: より効率的、高速、そして強力になりました。

Jan 17, 2024 am 08:27 AM

原題: PointTransformerV3: Simpler, Faster, Stronger 論文リンク: https://arxiv.org/pdf/2312.10035.pdf コードリンク: https://github.com/Pointcept/PointTransformerV3 著者単位: HKUSHAILabMPIPKUMIT 論文アイデア: この記事は「注目メカニズム内のイノベーションを求めて」で公開することを目的としたものではありません。代わりに、スケールの力を活用して、点群処理のコンテキストにおける精度と効率の間の既存のトレードオフを克服することに焦点を当てています。 3D 大規模表現学習の最近の進歩からインスピレーションを得て、

Kuaishou バージョンの Sora「Ke Ling」がテスト用に公開されています。120 秒以上のビデオを生成し、物理学をより深く理解し、複雑な動きを正確にモデル化できます。

Jun 11, 2024 am 09:51 AM

Kuaishou バージョンの Sora「Ke Ling」がテスト用に公開されています。120 秒以上のビデオを生成し、物理学をより深く理解し、複雑な動きを正確にモデル化できます。

Jun 11, 2024 am 09:51 AM

何?ズートピアは国産AIによって実現するのか?ビデオとともに公開されたのは、「Keling」と呼ばれる新しい大規模な国産ビデオ生成モデルです。 Sora も同様の技術的ルートを使用し、自社開発の技術革新を多数組み合わせて、大きく合理的な動きをするだけでなく、物理世界の特性をシミュレートし、強力な概念的結合能力と想像力を備えたビデオを制作します。データによると、Keling は、最大 1080p の解像度で 30fps で最大 2 分の超長時間ビデオの生成をサポートし、複数のアスペクト比をサポートします。もう 1 つの重要な点は、Keling は研究所が公開したデモやビデオ結果のデモンストレーションではなく、ショートビデオ分野のリーダーである Kuaishou が立ち上げた製品レベルのアプリケーションであるということです。さらに、主な焦点は実用的であり、白紙小切手を書かず、リリースされたらすぐにオンラインに移行することです。Ke Ling の大型モデルは Kuaiying でリリースされました。

超知性の生命力が覚醒する!しかし、自己更新 AI の登場により、母親はデータのボトルネックを心配する必要がなくなりました。

Apr 29, 2024 pm 06:55 PM

超知性の生命力が覚醒する!しかし、自己更新 AI の登場により、母親はデータのボトルネックを心配する必要がなくなりました。

Apr 29, 2024 pm 06:55 PM

世界は狂ったように大きなモデルを構築していますが、インターネット上のデータだけではまったく不十分です。このトレーニング モデルは「ハンガー ゲーム」のようであり、世界中の AI 研究者は、データを貪欲に食べる人たちにどのように餌を与えるかを心配しています。この問題は、マルチモーダル タスクで特に顕著です。何もできなかった当時、中国人民大学学部のスタートアップチームは、独自の新しいモデルを使用して、中国で初めて「モデル生成データフィード自体」を実現しました。さらに、これは理解側と生成側の 2 つの側面からのアプローチであり、両方の側で高品質のマルチモーダルな新しいデータを生成し、モデル自体にデータのフィードバックを提供できます。モデルとは何ですか? Awaker 1.0 は、中関村フォーラムに登場したばかりの大型マルチモーダル モデルです。チームは誰ですか?ソフォンエンジン。人民大学ヒルハウス人工知能大学院の博士課程学生、ガオ・イージャオ氏によって設立されました。

各ブロック内で適切に実行し、ランクの崩壊や対角値の爆発/消失などの劣化状況を回避する必要があります。

各ブロック内で適切に実行し、ランクの崩壊や対角値の爆発/消失などの劣化状況を回避する必要があります。