ビジュアルAI機能を統合!中国のチームによって作成された、自動化された画像検出とセグメンテーション、および制御可能なヴィンセント画像

この記事はAI New Media Qubit(公開アカウントID:QbitAI)の許可を得て転載していますので、転載については出典元にご連絡ください。

さあ、AI サークルが手の速さを競う時が来ました。

いいえ、Meta の SAM は数日前にリリースされたばかりで、国内のプログラマーが次々とバフを重ね、ターゲットの検出、セグメンテーション、主要なビジュアル AI 機能の生成をすべて 1 つに統合するようになりました。

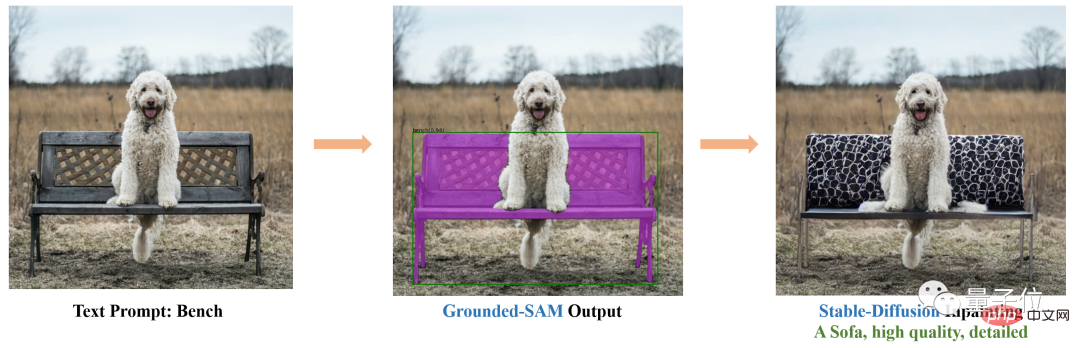

たとえば、安定拡散と SAM に基づいて、写真の椅子をソファにシームレスに置き換えることができます。

これも非常に簡単です。服と髪の色を変える :

このプロジェクトがリリースされるとすぐに、多くの人が「手のスピードが速すぎる!」と叫びました。

他の人が言いました: 新垣結衣と私の新しい結婚式の写真があります。

上記は Gounded-SAM によってもたらされる効果であり、このプロジェクトは GitHub で 1.8k スターを獲得しています。

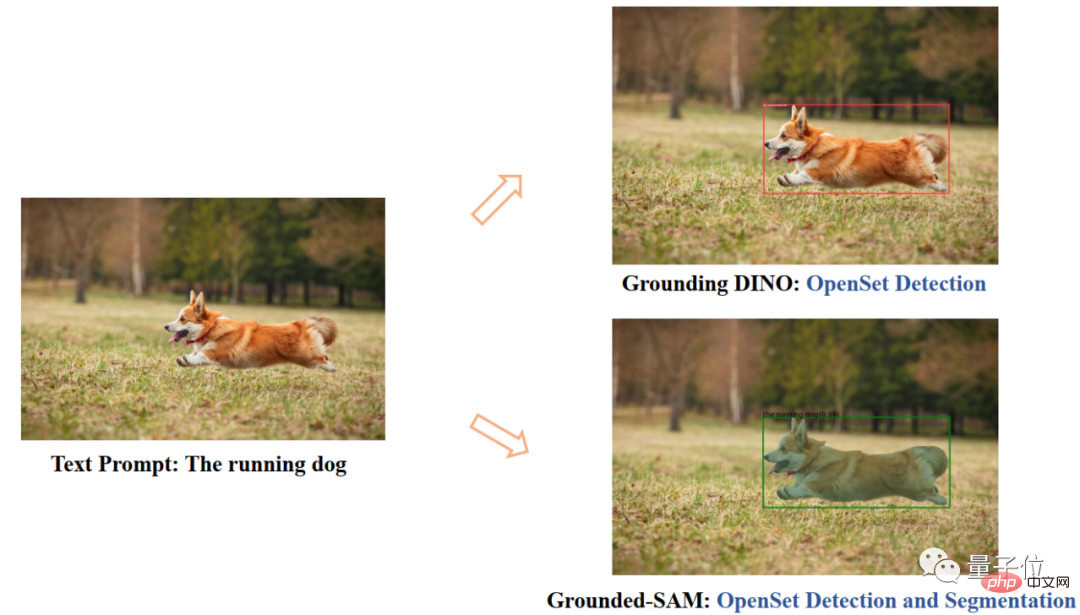

簡単に言うと、これは画像を入力するだけで自動的に画像を検出してセグメント化するゼロショット ビジョン アプリケーションです。

この調査は、IDEA Research Institute (Guangdong-Hong Kong-Macao Greater Bay Area Digital Economy Research Institute) によるもので、その創設者および会長は沈祥陽氏です。

追加のトレーニングは必要ありません

Grounded SAM は、主に Grounding DINO と SAM の 2 つのモデルで構成されています。

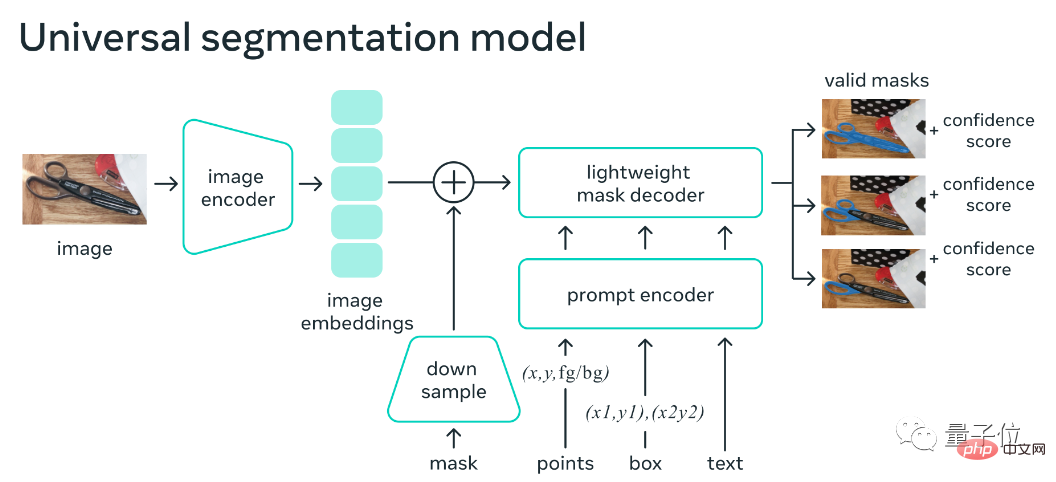

SAM (Segment Anything) は、Meta によって 4 日前に発表されたばかりのゼロサンプル セグメンテーション モデルです。

トレーニング プロセス中に表示されなかったオブジェクトや画像を含む、画像/ビデオ内のあらゆるオブジェクトのマスクを生成できます。

SAM が任意のプロンプトに対して有効なマスクを返せるようにすることで、プロンプトがあいまいな場合や複数のオブジェクトを指している場合でも、モデルの出力はあらゆる可能性の中で妥当なマスクになるはずです。このタスクは、モデルを事前トレーニングし、ヒントを介して一般的な下流のセグメンテーション タスクを解決するために使用されます。

モデル フレームワークは、主に画像エンコーダー、ヒント エンコーダー、および高速マスク デコーダーで構成されます。画像の埋め込みを計算した後、SAM は Web 上の任意のプロンプトに基づいて 50 ミリ秒以内にセグメンテーションを生成できます。

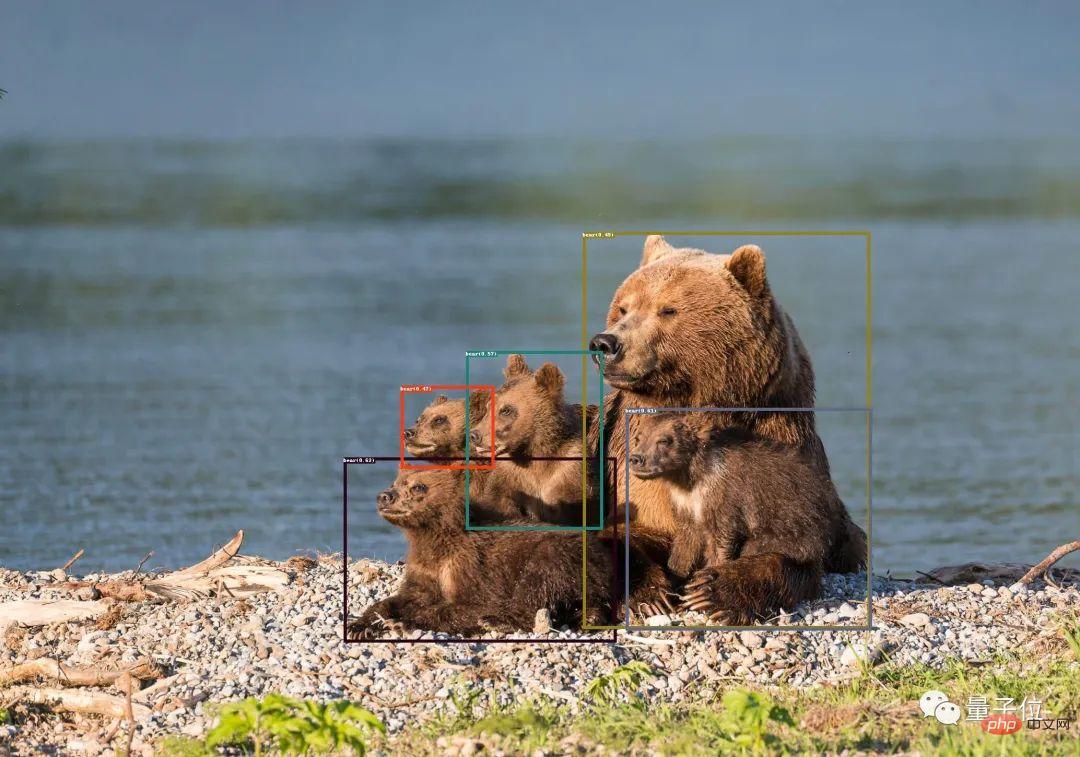

Grounding DINO は、この研究チームの既存の成果です。

これは ゼロショット検出モデル で、テキストの説明を含むオブジェクト ボックスとラベルを生成できます。

この 2 つを組み合わせると、テキストの説明を通じて画像内の任意のオブジェクトを検索し、SAM の強力なセグメンテーション機能を使用してマスクをきめ細かい方法でセグメント化できます。

これらの機能に加えて、冒頭で示した制御可能な画像生成である安定拡散の機能も追加されました。

Stable Diffusion が以前にも同様の機能を実現できたことは言及する価値があります。置き換えたい画像要素を消去し、テキスト プロンプトを入力するだけです。

今回、Grounded SAM は手動選択のステップを保存し、テキストの説明を通じて直接制御できます。

さらに、BLIP (Bootstrapping Language-Image Pre-training) と組み合わせて、画像のタイトルを生成し、ラベルを抽出し、オブジェクト ボックスとマスクを生成します。

現在、さらに興味深い機能が開発中です。

例: キャラクターの拡張: 服の変更、髪の色、肌の色など。

公開情報によると、同研究所は人工知能、デジタル経済産業、最先端技術に関する国際的な革新的な研究機関であることが示されています。マイクロソフト アジア研究所の元主席科学者、マイクロソフト グローバル インテリジェンス元副社長 シェン シャンヤン 博士. は創設者兼会長を務めています。

One More Thing

グラウンデッド SAM の今後の取り組みについて、チームはいくつかの展望を持っています:

- 画像を自動的に生成して新しいデータ セットを形成する

- セグメンテーションの事前トレーニングを備えた強力な基本モデル

- (チャット-)GPT

- と連携して、画像ラベル、ボックス、マスクを自動的に生成するパイプラインを形成し、新しい画像を生成できます。

このプロジェクトのチーム メンバーの多くは、Zhihu の AI 分野で積極的に回答していることを言及する価値があります。今回は、Zhihu で Grounded SAM に関する質問にも回答しました。コンテンツ、興味のある子供たち質問するメッセージを残してください~

以上がビジュアルAI機能を統合!中国のチームによって作成された、自動化された画像検出とセグメンテーション、および制御可能なヴィンセント画像の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7513

7513

15

15

1378

1378

52

52

79

79

11

11

19

19

64

64

Debian Readdirによるファイルソートを実装する方法

Apr 13, 2025 am 09:06 AM

Debian Readdirによるファイルソートを実装する方法

Apr 13, 2025 am 09:06 AM

Debian Systemsでは、Readdir関数はディレクトリコンテンツを読み取るために使用されますが、それが戻る順序は事前に定義されていません。ディレクトリ内のファイルを並べ替えるには、最初にすべてのファイルを読み取り、QSORT関数を使用してソートする必要があります。次のコードは、debianシステムにreaddirとqsortを使用してディレクトリファイルを並べ替える方法を示しています。

Debian Readdirのパフォーマンスを最適化する方法

Apr 13, 2025 am 08:48 AM

Debian Readdirのパフォーマンスを最適化する方法

Apr 13, 2025 am 08:48 AM

Debian Systemsでは、Directoryコンテンツを読み取るためにReadDirシステム呼び出しが使用されます。パフォーマンスが良くない場合は、次の最適化戦略を試してください。ディレクトリファイルの数を簡素化します。大きなディレクトリをできる限り複数の小さなディレクトリに分割し、Readdirコールごとに処理されたアイテムの数を減らします。ディレクトリコンテンツのキャッシュを有効にする:キャッシュメカニズムを構築し、定期的にキャッシュを更新するか、ディレクトリコンテンツが変更されたときに、頻繁な呼び出しをreaddirに削減します。メモリキャッシュ(memcachedやredisなど)またはローカルキャッシュ(ファイルやデータベースなど)を考慮することができます。効率的なデータ構造を採用する:ディレクトリトラバーサルを自分で実装する場合、より効率的なデータ構造(線形検索の代わりにハッシュテーブルなど)を選択してディレクトリ情報を保存およびアクセスする

Debian OpenSSLがどのように中間の攻撃を防ぐか

Apr 13, 2025 am 10:30 AM

Debian OpenSSLがどのように中間の攻撃を防ぐか

Apr 13, 2025 am 10:30 AM

Debian Systemsでは、OpenSSLは暗号化、復号化、証明書管理のための重要なライブラリです。中間の攻撃(MITM)を防ぐために、以下の測定値をとることができます。HTTPSを使用する:すべてのネットワーク要求がHTTPの代わりにHTTPSプロトコルを使用していることを確認してください。 HTTPSは、TLS(Transport Layer Security Protocol)を使用して通信データを暗号化し、送信中にデータが盗まれたり改ざんされたりしないようにします。サーバー証明書の確認:クライアントのサーバー証明書を手動で確認して、信頼できることを確認します。サーバーは、urlsessionのデリゲート方法を介して手動で検証できます

Debian Apacheログレベルを設定する方法

Apr 13, 2025 am 08:33 AM

Debian Apacheログレベルを設定する方法

Apr 13, 2025 am 08:33 AM

この記事では、DebianシステムのApachewebサーバーのロギングレベルを調整する方法について説明します。構成ファイルを変更することにより、Apacheによって記録されたログ情報の冗長レベルを制御できます。方法1:メイン構成ファイルを変更して、構成ファイルを見つけます。Apache2.xの構成ファイルは、通常/etc/apache2/ディレクトリにあります。ファイル名は、インストール方法に応じて、apache2.confまたはhttpd.confである場合があります。構成ファイルの編集:テキストエディターを使用してルートアクセス許可を使用して構成ファイルを開く(nanoなど):sudonano/etc/apache2/apache2.conf

Debian Readdirが他のツールと統合する方法

Apr 13, 2025 am 09:42 AM

Debian Readdirが他のツールと統合する方法

Apr 13, 2025 am 09:42 AM

DebianシステムのReadDir関数は、ディレクトリコンテンツの読み取りに使用されるシステムコールであり、Cプログラミングでよく使用されます。この記事では、ReadDirを他のツールと統合して機能を強化する方法について説明します。方法1:C言語プログラムを最初にパイプラインと組み合わせて、cプログラムを作成してreaddir関数を呼び出して結果をinclude#include#include inctargc、char*argv []){dir*dir; structdireant*entry; if(argc!= 2){(argc!= 2){

Debian syslogを学ぶ方法

Apr 13, 2025 am 11:51 AM

Debian syslogを学ぶ方法

Apr 13, 2025 am 11:51 AM

このガイドでは、Debian SystemsでSyslogの使用方法を学ぶように導きます。 Syslogは、ロギングシステムとアプリケーションログメッセージのLinuxシステムの重要なサービスです。管理者がシステムアクティビティを監視および分析して、問題を迅速に特定および解決するのに役立ちます。 1. syslogの基本的な知識Syslogのコア関数には以下が含まれます。複数のログ出力形式とターゲットの場所(ファイルやネットワークなど)をサポートします。リアルタイムのログ表示およびフィルタリング機能を提供します。 2。syslog(rsyslogを使用)をインストールして構成するDebianシステムは、デフォルトでrsyslogを使用します。次のコマンドでインストールできます:sudoaptupdatesud

Debian Mail Server SSL証明書のインストール方法

Apr 13, 2025 am 11:39 AM

Debian Mail Server SSL証明書のインストール方法

Apr 13, 2025 am 11:39 AM

Debian Mail ServerにSSL証明書をインストールする手順は次のとおりです。1。最初にOpenSSL Toolkitをインストールすると、OpenSSLツールキットがシステムに既にインストールされていることを確認してください。インストールされていない場合は、次のコマンドを使用してインストールできます。sudoapt-getUpdatesudoapt-getInstalopenssl2。秘密キーと証明書のリクエストを生成次に、OpenSSLを使用して2048ビットRSA秘密キーと証明書リクエスト(CSR)を生成します:Openss

Debian Mail Serverファイアウォールの構成のヒント

Apr 13, 2025 am 11:42 AM

Debian Mail Serverファイアウォールの構成のヒント

Apr 13, 2025 am 11:42 AM

Debian Mail Serverのファイアウォールの構成は、サーバーのセキュリティを確保するための重要なステップです。以下は、iPtablesやFirewalldの使用を含む、一般的に使用されるファイアウォール構成方法です。 iPtablesを使用してファイアウォールを構成してIPTablesをインストールします(まだインストールされていない場合):sudoapt-getupdatesudoapt-getinstalliptablesview現在のiptablesルール:sudoiptables-l configuration