テクノロジー周辺機器

テクノロジー周辺機器

AI

AI

1 枚のカードで AI ペイント モデルを実行できます。初心者でも理解できるチュートリアルはこちらです。100 万枚のカードで無料の NPU コンピューティング パワーを利用できます。

1 枚のカードで AI ペイント モデルを実行できます。初心者でも理解できるチュートリアルはこちらです。100 万枚のカードで無料の NPU コンピューティング パワーを利用できます。

1 枚のカードで AI ペイント モデルを実行できます。初心者でも理解できるチュートリアルはこちらです。100 万枚のカードで無料の NPU コンピューティング パワーを利用できます。

最近のAI描画の人気は皆さんもよくご存じかと思います。

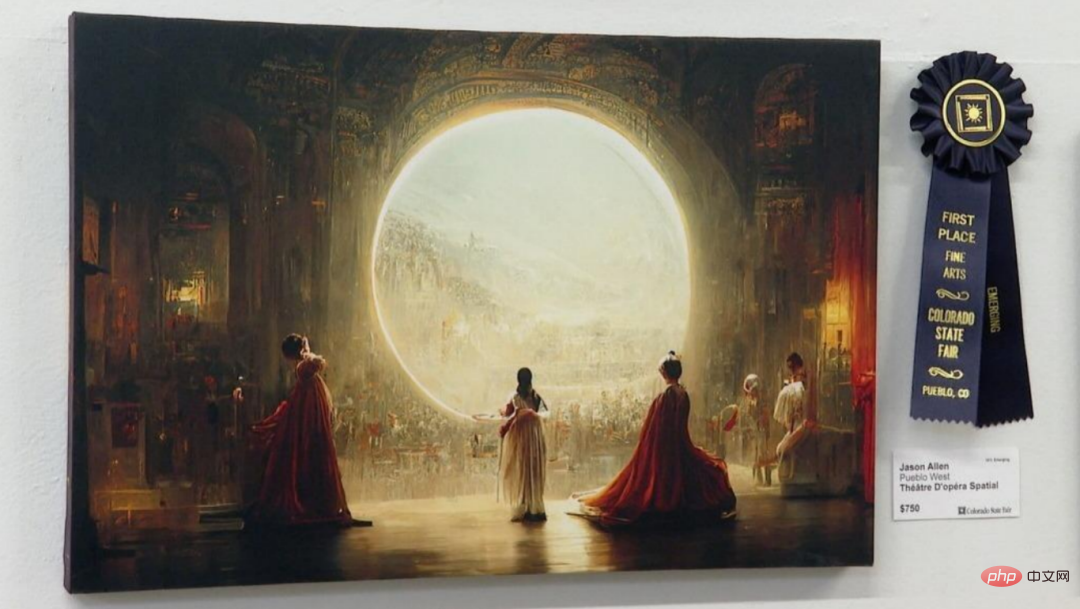

AI 描画ソフトウェアによって生成された作品から、多くの人間のアーティストを破ってデジタル アート チャンピオンシップで優勝するまで、現在に至るまで、DALL.E、Imagen、novelai などの国内外のプラットフォームが繁栄しています。

おそらくあなたは、関連するウェブサイトをクリックして、頭の中の風景を AI に描写させようとしたり、自分のハンサム/美しい写真をアップロードして、最終的に生成された荒々しい男を見て笑ったりしたことがあるのではないでしょうか。

それでは、AI 描画の魅力を感じながら、その背後にある謎とは何なのか、考えたことはありますか (いや、きっとあるはずです)。

△米国コロラドテクノロジーエキスポデジタルアート部門優勝作品「スペースオペラ」

すべてはプロジェクトから始まるDDPM モデルと言えば...

DDPM とは何ですか?

DDPMモデル、正式名称はDenoising Diffusion Probabilistic Modelであり、現在の拡散モデルの元祖とも言えます。

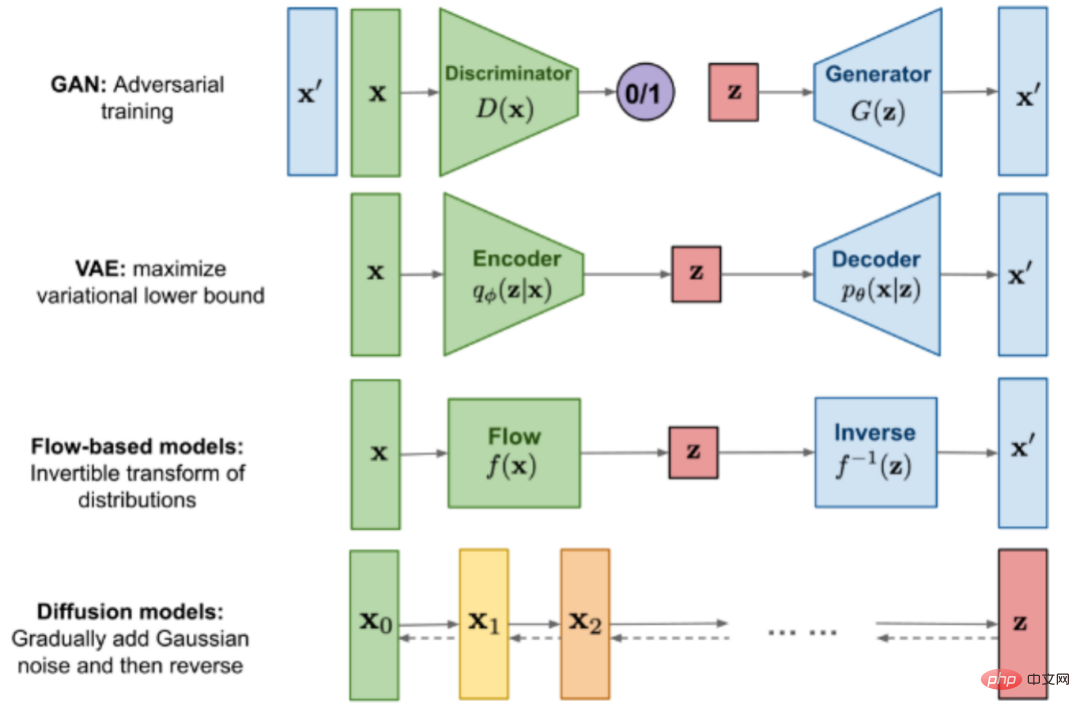

GAN、VAE、フロー モデルなどの以前のモデルとは異なり、拡散モデルの全体的な考え方は、最適化指向のアプローチを通じて純粋なノイズ画像から画像を徐々に生成することです。

ノイズ除去のルールを学ぶのは難しいので、最初にノイズを追加して画像を純粋なノイズ画像に変えてから、プロセス全体を逆に実行してみてはいかがでしょうか?

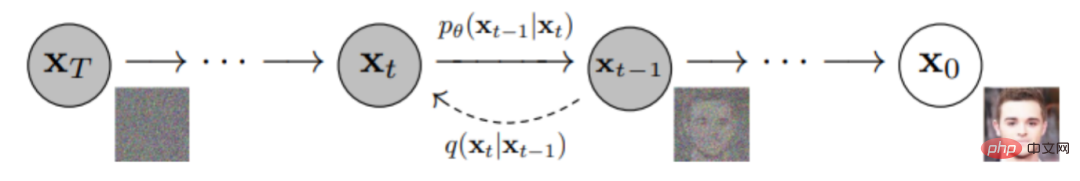

これにより、拡散モデルのトレーニング推論プロセス全体が確立されます。まず、順方向プロセスでノイズを徐々に追加することで、画像がガウス分布に近似する純粋なノイズ画像に変換されます。 次に、逆のプロセスで徐々にノイズを除去して画像を生成します。最後に、元の画像と生成された画像の類似性を高めることを目的として、理想的な効果に達するまでモデルが最適化されます。

1.1.1 前進プロセス

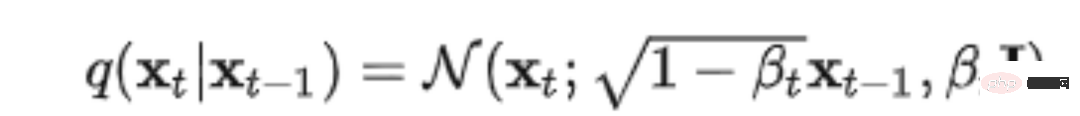

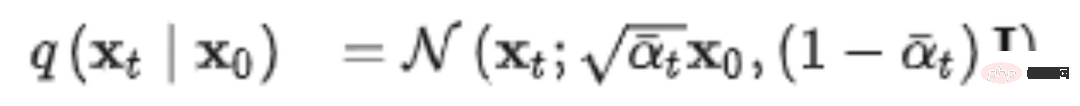

前進プロセスは拡散プロセスとも呼ばれ、全体がパラメータ化されたマルコフ連鎖 (マルコフ連鎖) です。初期データ分布 x0~q(x) から開始して、T 回の各ステップでデータ分布にガウス ノイズが追加されます。ステップ t-1 xt-1 からステップ t xt までのプロセスは、ガウス分布で次のように表すことができます。

に注意してください

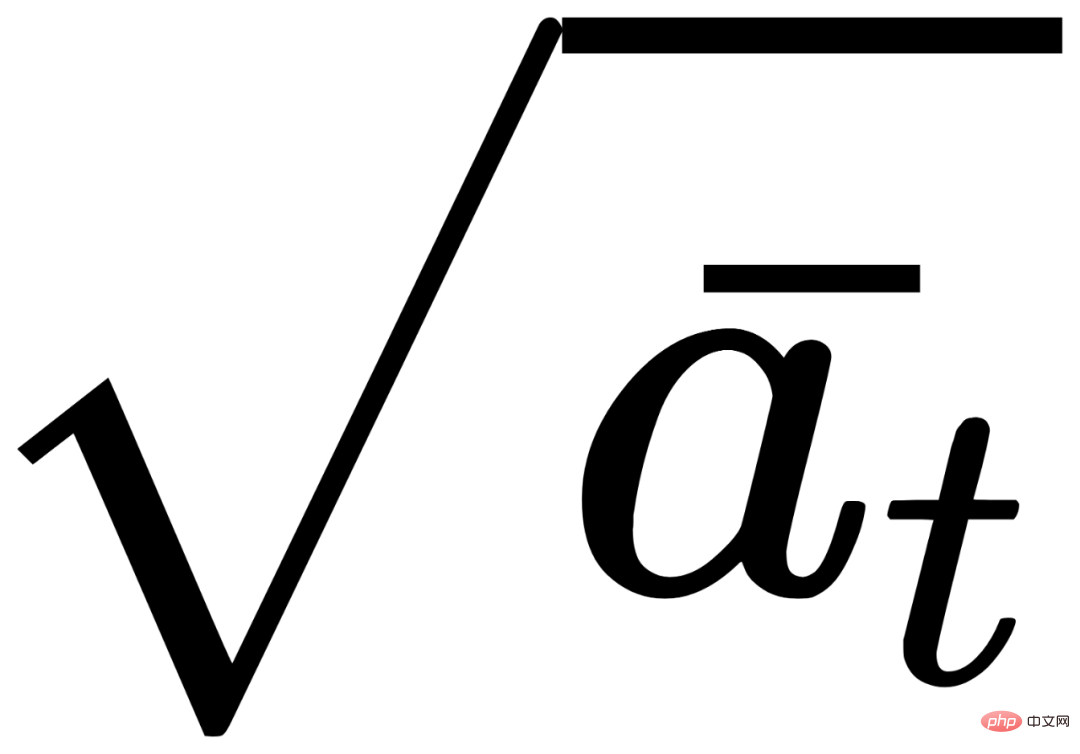

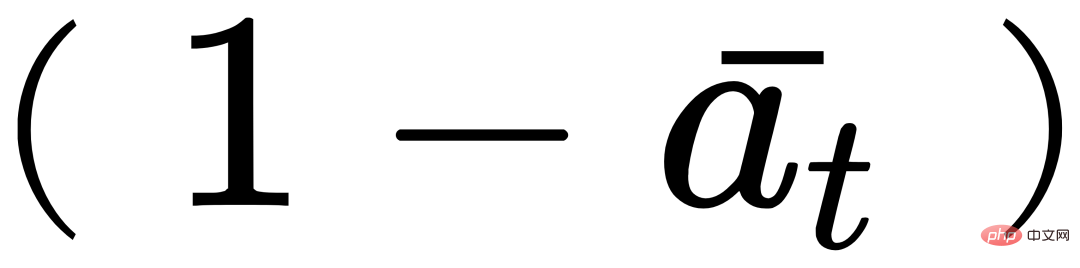

と  は結合係数であり、本質的にはハイパーパラメータの βt 式です。

は結合係数であり、本質的にはハイパーパラメータの βt 式です。

1.1.2 逆過程

逆過程も順過程と同様にマール・マルコフ連鎖ですが、ここで使用されるパラメータは異なります。特定のパラメータに関しては、これがマシンに学習させる必要があるものです。

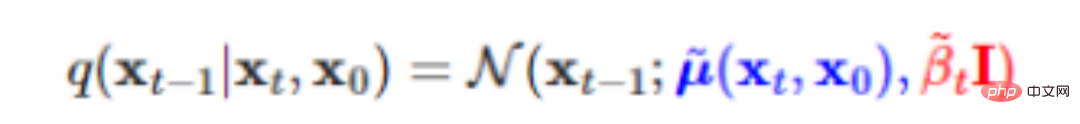

機械がどのように学習するかを理解する前に、ある元のデータ x0 に基づいてステップ t xt からステップ t-1 xt-1 に正確に戻るプロセスはどのようなものであるべきかを考えます。

答えは、これは依然としてガウス分布で表現できるということです。

ここでは x0 を考慮する必要があることに注意してください。これは、によって生成される最終画像を意味します。逆のプロセスは、元のデータに関連するものと比較する必要があります。猫の写真を入力した場合、モデルによって生成される画像は猫のものである必要があり、犬の写真を入力した場合、モデルによって生成される画像も犬に関連するものでなければなりません。 x0 を削除すると、どのような画像学習を入力しても、拡散によって生成される最終的な画像は同じになり、「犬と猫の区別がつかない」ことになります。

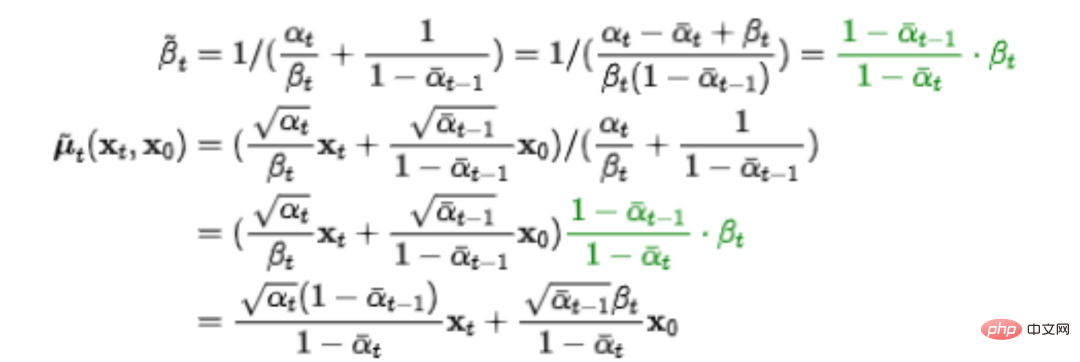

一連の導出の後、パラメータが逆の処理

と

で表すことができます。すごいですね~

1.1.3 最適化の目標

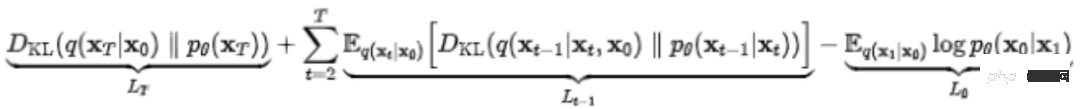

最初に、元のデータと最終的に生成されたデータの間の類似性を高めることによってモデルを最適化する必要があると述べました。逆のプロセス。機械学習では、クロスエントロピーに基づいてこの類似性を計算します。 クロスエントロピーについては、学術的な定義では「2つの確率分布間の差異情報を測定するために使用される」とされています。言い換えれば、クロスエントロピーが小さいほど、モデルによって生成された画像は元の画像に近づきます。ただし、ほとんどの場合、クロス エントロピーの計算は困難または不可能であるため、通常は、より単純な式を最適化することで同じ効果が得られます。 拡散モデルは、VAE モデルの最適化アイデアを利用し、最大最適化ターゲットとしてクロス エントロピーを変分下限 (VLB、ELBO とも呼ばれる) に置き換えます。無数の分解ステップを経て、最終的に次の結果が得られました。

DDPM の背後にある原則を理解した後、DDPM モデルがどのように実装されるかを見てみましょう...

これは奇妙です。これを読んだあなたは、何百行、何千行ものコードの洗礼は絶対に受けたくないと思います。

幸いなことに、MindSpore は完全に開発された DDPM モデルを提供しました。トレーニングと推論は両手で行うことができます。操作は簡単で、1 枚のカードで実行できます。効果だけを体験したい友人

pip install denoising-diffusion-mindspore

#次に、次のコードを参照してパラメータを設定する必要があります:

重要なパラメータの分析:

GaussianDiffusion

- image_size: 画像サイズ

- timesteps: ノイズ ステップ数

- sampling_timesteps :サンプリング ステップの数。推論パフォーマンスを向上させるには、ノイズ追加ステップの数よりも少なくする必要があります。

Trainer

- folder_or_dataset: パスに対応します。図では、ダウンロードされたデータセットのパス (str) であることも、データ用に処理された VisionBaseDataset、GeneratorDataset、または MindDataset であることもできます。

- train_batch_size:バッチ サイズ

- train_lr: 学習率

- train_num_steps: トレーニング ステップ数

「上級バージョン」DDPM モデル MindDiffusion

DDPM は Diffusion のストーリーの始まりにすぎません。現在、数え切れないほどの研究者がその背後にある壮大な世界に魅了され、研究を続けています。

モデルを継続的に最適化しながら、さまざまな分野での拡散の応用も徐々に開発してきました。

これには、画像の最適化、修復、コンピューター ビジョンの分野での 3D ビジョン、自然言語処理でのテキスト読み上げ、分子構造の生成、科学用 AI の分野でのマテリアル デザインなどが含まれます。

スタンフォード大学コンピューター サイエンス学部の博士課程の学生、エリック ゼリクマンは、想像力を駆使して、DALLE-2 と、最近人気のもう 1 つの会話モデルである ChatGPT を組み合わせて、心温まる絵本の物語を作成しようとしました。

△DALLE-2 ChatGPT は、「ロビー」という名前の小さなロボットについての物語を完成させました。

しかし、それは一般に最も広く知られています。それはテキストから画像への応用であるべきです。いくつかのキーワードまたは短い説明を入力すると、モデルが対応する画像を生成します。

たとえば、「City Night Scene Cyberpunk Greg Lutkowsky」と入力すると、未来的な SF スタイルの色鮮やかな作品が完成します。

別の例として、「Monet's Woman Holding a Parasol in Moon Dream」と入力すると、木製スタイルの、非常にかすんだ女性のポートレートが生成されます。モネの「睡蓮」を思い出しますか?

リアルな風景写真をスクリーンセーバーとして使いたいですか?問題ない!

△カントリー フィールド スクリーンセーバー

より 2 次元の密度が高いものが必要ですか?それもOKです!

△現実的なスタイルの深淵風景画から

上の写真はすべて、MindDiffusionプラットフォームの下でWukong Paintingによって作成されたものです。ああ、Wukong Huahuaは大きな絵です。拡散モデルに基づく中国語テキスト グラフ モデル。ファーウェイのノア チーム、チャイナソフト分散並列研究所、およびアセンド コンピューティング製品部門によって共同開発されました。

モデルは Wukong データセットに基づいてトレーニングされ、MindSpore と Ascend のソフトウェアおよびハードウェア ソリューションを使用して実装されています。

試してみたいと思っている友達、心配しないでください。誰もがより良い経験をし、自己開発の余地を増やすために、MindDiffusion のモデルには次のような特性も持たせる予定です。トレーニング可能性と推論。来年皆さんにお会いできる予定ですので、楽しみにお待ちください。

ブレインストーミングを行って、さまざまなユニークなスタイルの作品を生み出すことを歓迎します~

(内部情報を聞きに行った同僚によると、すでに「張飛刺繍」を試し始めている人もいるそうです。 「劉華強」「メロンの切り方」「古代ギリシャの神々対ゴジラ」うーん、どうしようかな、俄然完成が楽しみです(ಡωಡ))

One More Thing

最後に、Diffusion がブームになっている今、なぜこれほど人気が高まり、脚光を浴びて GAN ネットワークを超え始めているのかと疑問に思う人もいます。

普及には顕著な利点と明らかな欠点があり、その分野の多くはまだ空白であり、その将来性はまだ不明です。

なぜこれほど多くの人が精力的に取り組んでいるのでしょうか?

もしかしたら、マーイー教授の言葉が答えを与えてくれるかもしれません。

しかし、拡散プロセスの有効性とその急速な GAN の置き換えは、単純な真実も十分に示しています。

単純で正確な数学的導出を数行行えば、それらよりも優れた結果を達成できるということです。ハイパーパラメータを大規模にデバッグすることは、ネットワーク構造をデバッグするよりもはるかに効果的です。

これがディフュージョンモデルの魅力なのかもしれません。

参考链接(可滑動查看):

[1]https://medium.com/mlearning-ai/ai-art-wins-fine-arts-competition-and-sparks-controversy- 882f9b4df98c

[2]ジョナサン・ホー、アジェイ・ジェイン、ピーター・アッビール。ノイズ除去拡散確率モデル。 arXiv:2006.11239、2020.

[3]Ling Yang、Zhilong Zhang、Shenda Hon、Runsheng Xu、Yue Zhao、Yingxia Shao、Wentao Zhang、Ming-Hsuan Yang、Bin Cui。普及モデル: 手法とアプリケーションの包括的な調査。 arXiv プレプリント arXiv:2209.00796、2022.

[4]https://lilianweng.github.io/posts/2021-07-11-diffusion-models

[5]https:/ /github.com/lvyufeng/denoising-diffusion-mindspore

[6]https://zhuanlan.zhihu.com/p/525106459

[7]https://zhuanlan.zhihu .com/p/500532271

[8]https://www.zhihu.com/question/536012286

[9]https://mp.weixin.qq.com/s /XTNk1saGcgPO-PxzkrBnIg

[10]https://m.weibo.cn/3235040884/4804448864177745

以上が1 枚のカードで AI ペイント モデルを実行できます。初心者でも理解できるチュートリアルはこちらです。100 万枚のカードで無料の NPU コンピューティング パワーを利用できます。の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7720

7720

15

15

1642

1642

14

14

1396

1396

52

52

1289

1289

25

25

1233

1233

29

29

WorldCoin(WLD)価格予測2025-2031:WLDは2031年までに4ドルに達しますか?

Apr 21, 2025 pm 02:42 PM

WorldCoin(WLD)価格予測2025-2031:WLDは2031年までに4ドルに達しますか?

Apr 21, 2025 pm 02:42 PM

WorldCoin(WLD)は、独自の生体認証とプライバシー保護メカニズムを備えた暗号通貨市場で際立っており、多くの投資家の注目を集めています。 WLDは、特にOpenai人工知能技術と組み合わせて、革新的なテクノロジーを備えたAltcoinsの間で驚くほど演奏しています。しかし、デジタル資産は今後数年間でどのように振る舞いますか? WLDの将来の価格を一緒に予測しましょう。 2025年のWLD価格予測は、2025年にWLDで大幅に増加すると予想されています。市場分析は、平均WLD価格が1.31ドルに達する可能性があり、最大1.36ドルであることを示しています。ただし、クマ市場では、価格は約0.55ドルに低下する可能性があります。この成長の期待は、主にWorldCoin2によるものです。

Aavenomicsは、Aaveプロトコルトークンを変更し、Tokenの買戻しを導入するための推奨事項です。

Apr 21, 2025 pm 06:24 PM

Aavenomicsは、Aaveプロトコルトークンを変更し、Tokenの買戻しを導入するための推奨事項です。

Apr 21, 2025 pm 06:24 PM

Aavenomicsは、Aaveプロトコルトークンを変更し、Aavedaoの定足数を実装したToken Reposを導入する提案です。 Aave Project Chain(ACI)の創設者であるMarc Zellerは、これをXで発表し、契約の新しい時代をマークしていることに注目しました。 Aave Chain Initiative(ACI)の創設者であるMarc Zellerは、Aavenomicsの提案にAave Protocolトークンの変更とトークンリポジトリの導入が含まれていると発表しました。 Zellerによると、これは契約の新しい時代を告げています。 Aavedaoのメンバーは、水曜日の週に100でした。

なぜ仮想通貨価格の上昇または下落があるのですか?なぜ仮想通貨価格の上昇または下落があるのですか?

Apr 21, 2025 am 08:57 AM

なぜ仮想通貨価格の上昇または下落があるのですか?なぜ仮想通貨価格の上昇または下落があるのですか?

Apr 21, 2025 am 08:57 AM

仮想通貨価格の上昇の要因には、次のものが含まれます。1。市場需要の増加、2。供給の減少、3。刺激された肯定的なニュース、4。楽観的な市場感情、5。マクロ経済環境。衰退要因は次のとおりです。1。市場需要の減少、2。供給の増加、3。ネガティブニュースのストライキ、4。悲観的市場感情、5。マクロ経済環境。

クロスチェーントランザクションとはどういう意味ですか?クロスチェーントランザクションとは何ですか?

Apr 21, 2025 pm 11:39 PM

クロスチェーントランザクションとはどういう意味ですか?クロスチェーントランザクションとは何ですか?

Apr 21, 2025 pm 11:39 PM

クロスチェーントランザクションをサポートする交換:1。Binance、2。Uniswap、3。Sushiswap、4。CurveFinance、5。Thorchain、6。1inchExchange、7。DLNTrade、これらのプラットフォームはさまざまな技術を通じてマルチチェーン資産トランザクションをサポートします。

カーネルエアドロップ報酬を獲得する方法バイナンスフルプロセス戦略

Apr 21, 2025 pm 01:03 PM

カーネルエアドロップ報酬を獲得する方法バイナンスフルプロセス戦略

Apr 21, 2025 pm 01:03 PM

暗号通貨の賑やかな世界では、新しい機会が常に現れます。現在、Kerneldao(Kernel)Airdropアクティビティは多くの注目を集め、多くの投資家の注目を集めています。それで、このプロジェクトの起源は何ですか? BNBホルダーはそれからどのような利点を得ることができますか?心配しないでください、以下はあなたのためにそれを一つ一つ明らかにします。

「ブラックマンデーセル」は、暗号通貨業界にとって厳しい日です

Apr 21, 2025 pm 02:48 PM

「ブラックマンデーセル」は、暗号通貨業界にとって厳しい日です

Apr 21, 2025 pm 02:48 PM

暗号通貨市場での突入は投資家の間でパニックを引き起こし、Dogecoin(Doge)は最も困難なヒット分野の1つになりました。その価格は急激に下落し、分散財務財務(DEFI)(TVL)の総価値が激しく減少しました。 「ブラックマンデー」の販売波が暗号通貨市場を席巻し、ドゲコインが最初にヒットしました。そのdefitVLは2023レベルに低下し、通貨価格は過去1か月で23.78%下落しました。 DogecoinのDefitVLは、主にSOSO値指数が26.37%減少したため、272万ドルの安値に低下しました。退屈なDAOやThorchainなどの他の主要なDefiプラットフォームも、それぞれ24.04%と20減少しました。

通貨サークルでのレバレッジされた交換のランキングは

Apr 21, 2025 pm 11:24 PM

通貨サークルでのレバレッジされた交換のランキングは

Apr 21, 2025 pm 11:24 PM

2025年のレバレッジド取引、セキュリティ、ユーザーエクスペリエンスで優れたパフォーマンスを持つプラットフォームは次のとおりです。1。OKX、高周波トレーダーに適しており、最大100倍のレバレッジを提供します。 2。世界中の多通貨トレーダーに適したバイナンス、125倍の高いレバレッジを提供します。 3。Gate.io、プロのデリバティブプレーヤーに適し、100倍のレバレッジを提供します。 4。ビットゲットは、初心者やソーシャルトレーダーに適しており、最大100倍のレバレッジを提供します。 5。Kraken、安定した投資家に適しており、5倍のレバレッジを提供します。 6。Altcoinエクスプローラーに適したBybit。20倍のレバレッジを提供します。 7。低コストのトレーダーに適したKucoinは、10倍のレバレッジを提供します。 8。ビットフィネックス、シニアプレイに適しています

ハイブリッドブロックチェーン取引プラットフォームとは何ですか?

Apr 21, 2025 pm 11:36 PM

ハイブリッドブロックチェーン取引プラットフォームとは何ですか?

Apr 21, 2025 pm 11:36 PM

暗号通貨交換を選択するための提案:1。流動性の要件については、優先度は、その順序の深さと強力なボラティリティ抵抗のため、Binance、gate.ioまたはokxです。 2。コンプライアンスとセキュリティ、Coinbase、Kraken、Geminiには厳格な規制の承認があります。 3.革新的な機能、Kucoinのソフトステーキング、Bybitのデリバティブデザインは、上級ユーザーに適しています。