オクルージョンを恐れない全身追跡、CMU の 2 人の中国人が WiFi 信号に基づいて DensePose を作成

ここ数年、自動運転や VR などのアプリケーションによって、RGB センサー、LiDAR、レーダーなどの 2D および 3D センサーを使用した人間の姿勢推定が大きく進歩してきました。ただし、これらのセンサーには技術的にも実用的にもいくつかの制限があります。まずコストが高く、一般家庭や中小企業にはLiDARやレーダーセンサーを購入する余裕がないことが多いです。第二に、これらのセンサーは日常使用や家庭で使用するには電力を大量に消費します。

RGB カメラに関しては、狭い視野と不十分な照明条件がカメラベースの方法に重大な影響を与える可能性があります。オクルージョンは、カメラベースのモデルが画像内で合理的な姿勢予測を生成することを妨げるもう 1 つの障害になります。家具が人の邪魔になることが多いため、屋内のシーンは特に困難です。さらに、プライバシーへの懸念により、公共の場所以外でのこれらのテクノロジーの使用は妨げられており、多くの人は自分の行動を記録するために自宅にカメラを設置することに消極的です。しかし、医療分野では、安全、健康、その他の理由から、多くの高齢者がカメラやその他のセンサーの助けを借りてリアルタイム監視を実行する必要がある場合があります。

最近、CMU の 3 人の研究者が論文「DensePose From WiFi」で、場合によっては、WiFi 信号を RGB 画像の代わりに使用できることを提案しました。人体認識を実行します。照明と遮蔽は、屋内監視用の WiFi ソリューションにはほとんど影響しません。 WiFi 信号は個人のプライバシーを保護するのに役立ち、必要な機器は手頃な価格です。重要な点は、多くの家に WiFi が設置されているため、この技術は高齢者の健康状態を監視したり、家庭内での不審な行動を特定したりするために拡張される可能性があるということです。

論文アドレス: https://arxiv.org/pdf/2301.00250.pdf

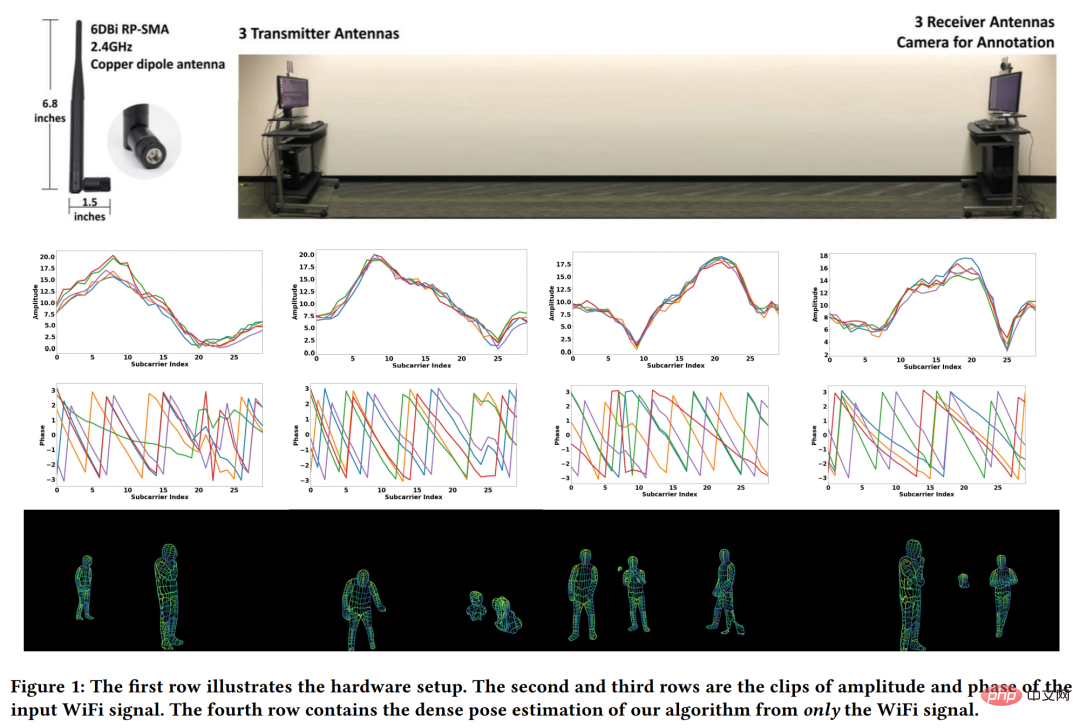

研究者が望んでいること解決すべき問題は、以下の図 1 の最初の行に示されています。3 つの WiFi 送信機と 3 つの対応する受信機があるとすると、複数の人がいる乱雑な環境 (図 1 の 4 行目) で、人間の姿勢の密集した対応関係を検出して復元できるでしょうか? 多くの WiFi ルーター (TP-Link AC1750 など) には 3 つのアンテナがあるため、この方法ではそのようなルーターは 2 つだけ必要であることに注意してください。各ルーターのコストは約 30 ドルで、セットアップ全体が LiDAR やレーダー システムよりもはるかに安いことを意味します。

図 1 の 4 行目に示されている効果を達成するために、研究者はコンピューター ビジョンのディープ ラーニング アーキテクチャからインスピレーションを得て、次のことができるを提案しました。密な姿勢推定のための WiFi ニューラル ネットワーク アーキテクチャに基づいて実行され、オクルージョンや複数の人物が含まれるシーンで WiFi 信号のみを使用して密な姿勢推定を実現します。

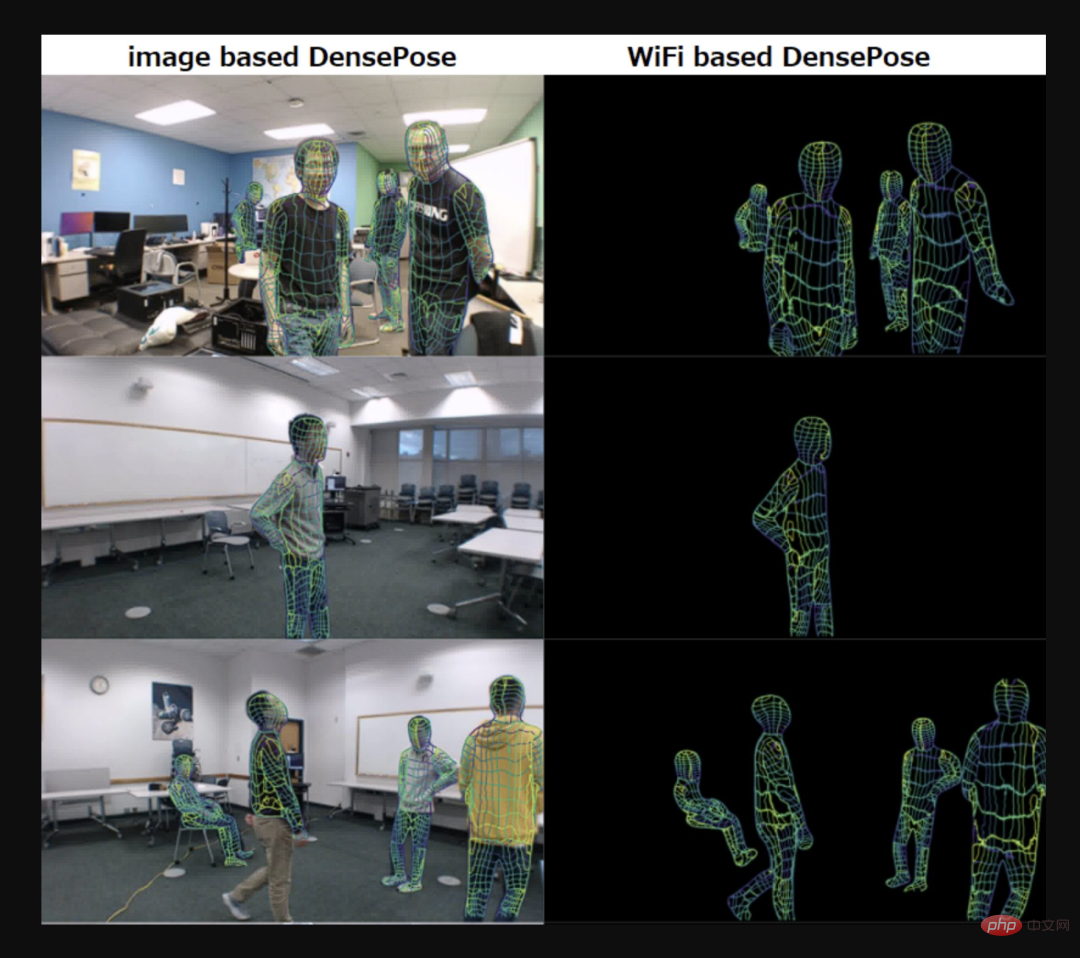

#下の左の図は画像ベースの DensePose を示し、右の図は WiFi ベースの DensePose を示します。

出典: Twitter @AiBreakfast

Inさらに、この論文の最初の著者と 2 番目の著者は両方とも中国人である ことにも言及する価値があります。この論文の筆頭著者である Jiaqi Geng 氏は、昨年 8 月に CMU でロボット工学の修士号を取得し、2 番目の著者である Dong Huang 氏は現在 CMU の上級プロジェクトサイエンティストを務めています。

方法の紹介

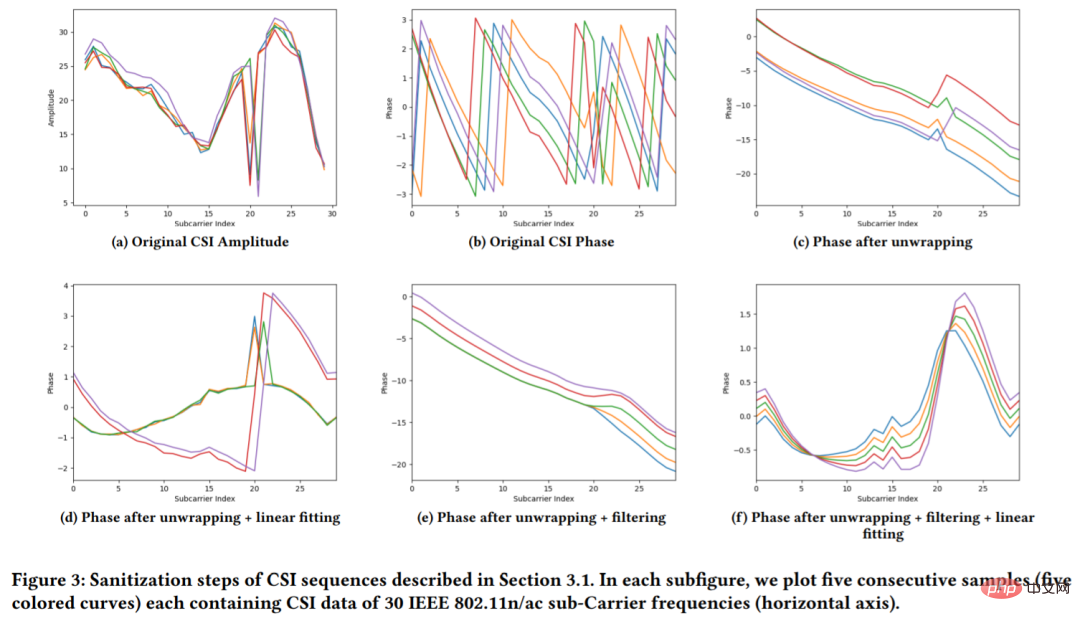

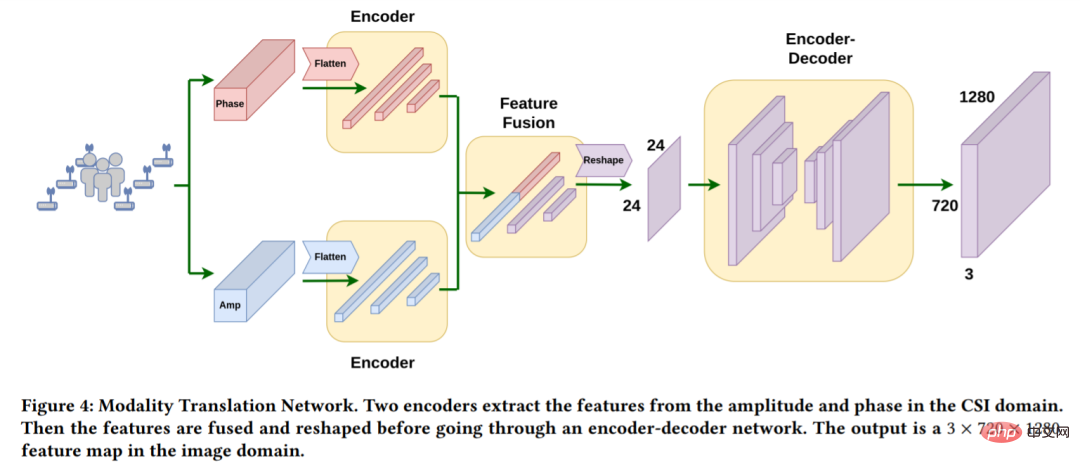

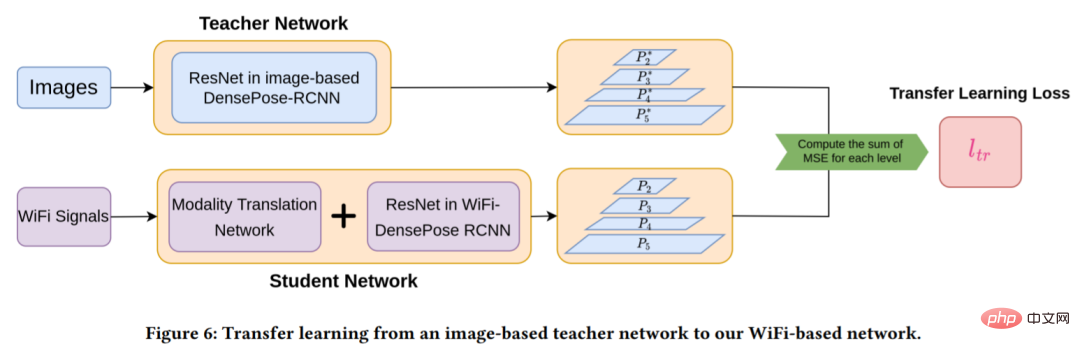

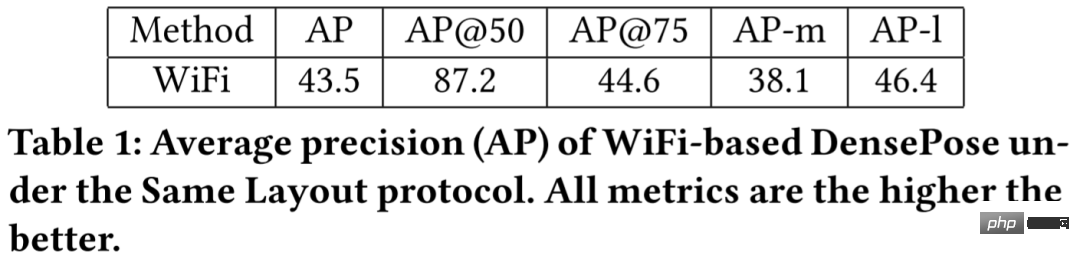

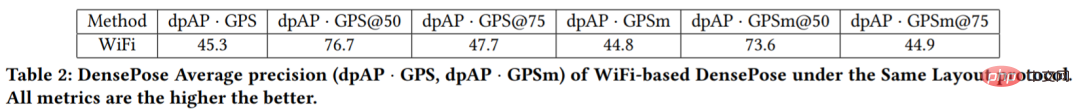

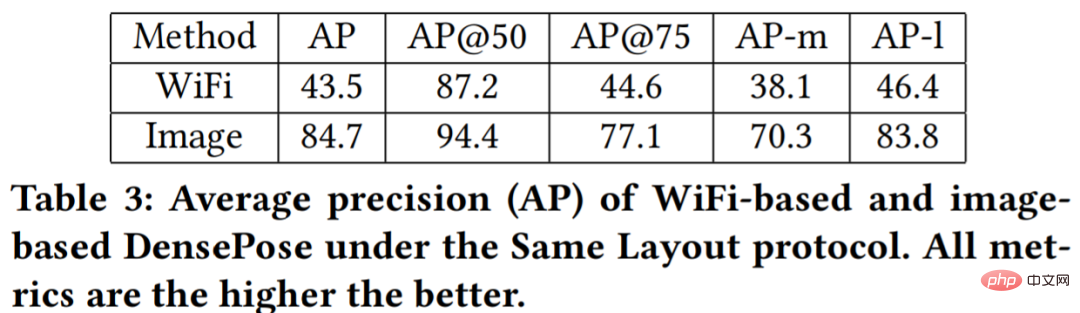

WiFi を使用して人体表面の UV 座標を生成するには、3 つのコンポーネントが必要です。 pass 振幅と位相のステップにより、元の CSI (送信信号波と受信信号波の比率を示すチャネル状態情報) 信号がクリーンアップされ、処理された CSI サンプルがデュアル ブランチ エンコーダ/デコーダを通じて変換されます。ネットワークは 2D 特徴マップであり、2D 特徴マップは DensePose-RCNN (主に 2D 画像を 3D 人体モデルに変換する) と呼ばれるアーキテクチャに入力されて、UV マップが推定されます。元の CSI サンプルにはノイズが多く (図 3 (b) を参照)、それだけでなく、ほとんどの WiFi ベースのソリューションは CSI 信号の位相を無視し、信号の振幅に焦点を当てています (図 3 (a) を参照) ))。ただし、位相情報を破棄すると、モデルのパフォーマンスに悪影響を及ぼす可能性があります。そこで本研究ではCSI情報をより有効に活用するために、安定した位相値を得るためにサニタイズ処理を行う。 #一次元 CSI 信号から空間領域の UV マッピングを推定するには、まず次のことが必要です。ネットワーク入力を CSI ドメインから空間ドメインに変換します。この記事は、Modality Translation Network を使用して完成しました (図 4 を参照)。いくつかの操作の後、WiFi 信号によって生成された画像領域の 3×720×1280 のシーン表現を取得できます。 #画像ドメインで 3×720×1280 のシーン表現を取得した後、この研究では DensePose と同様の方法を使用します。 -RCNN 人体の UV マップを予測するためのネットワーク アーキテクチャ WiFi-DensePose RCNN。具体的には、WiFi-DensePose RCNN (図 5) において、この研究では ResNet-FPN をバックボーンとして使用し、取得された 3 × 720 × 1280 の画像特徴マップから空間特徴を抽出します。その後、出力は地域提案ネットワークに供給されます。さまざまなソースからの補完的な情報をより効果的に利用するために、WiFi-DensePose RCNN には DensePose ヘッドと Keypoint ヘッドという 2 つのブランチも含まれており、その後、処理結果がマージされてリファインメント ユニットに入力されます。 ただし、ランダムな初期化から Modality Translation Network と WiFi-DensePose RCNN ネットワークをトレーニングするには、多くの時間 (約 80 時間) が必要です。トレーニング効率を向上させるために、この研究では画像ベースの DensPose ネットワークを WiFi ベースのネットワークに移行しました (詳細は図 6 を参照)。 画像ベースのネットワーク重みを使用して WiFi ベースのネットワークを直接初期化することは機能しませんでした。そのため、この研究では最初に画像ベースの DensePose-RCNN モデルは教師ネットワークとして機能し、生徒ネットワークはモダリティ変換ネットワークと WiFi-DensePose RCNN で構成されます。この目的は、学生モデルと教師モデルによって生成された多層特徴マップ間の差異を最小限に抑えることです。 表 1 の結果は、WiFi ベースの方法で 87.2 という非常に高い AP@50 値が得られたことを示しており、モデルが効果的に近似値を検出できることを示しています。人体の境界ボックスの位置。 AP@75 は 35.6 と比較的低く、人体の詳細が完全には推定されていないことを示しています。 表 2 の結果は、dpAP・GPS@50 と dpAP・GPSm@50 の値が高いことを示していますが、dpAP・GPS@75 と dpAP・GPSm @75 は低い値です。これは、私たちのモデルが人間の胴体の姿勢を推定する際にはうまく機能しますが、手足などの詳細を検出するのがまだ難しいことを示しています。

以上がオクルージョンを恐れない全身追跡、CMU の 2 人の中国人が WiFi 信号に基づいて DensePose を作成の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

HP プリンターが Wi-Fi に接続できない場合の対処方法 - HP プリンターが Wi-Fi に接続できない場合の対処方法

Mar 06, 2024 pm 01:00 PM

HP プリンターが Wi-Fi に接続できない場合の対処方法 - HP プリンターが Wi-Fi に接続できない場合の対処方法

Mar 06, 2024 pm 01:00 PM

HP プリンターを使用する多くのユーザーは、HP プリンターが Wi-Fi に接続できない場合の対処法に慣れていません。以下では、HP プリンターが Wi-Fi に接続できない問題の解決策をエディターが提供します。以下を見てみましょう。 HP プリンターの MAC アドレスを設定して、自動的に選択し、ネットワークに自動的に参加します。チェックを入れて、ネットワーク構成を変更します。dhcp を使用してパスワードを入力し、HP プリンターに接続します。Wi-Fi に接続されていることが表示されます。

モデル、データ、フレームワークの詳細: 効率的な大規模言語モデルの 54 ページにわたる徹底的なレビュー

Jan 14, 2024 pm 07:48 PM

モデル、データ、フレームワークの詳細: 効率的な大規模言語モデルの 54 ページにわたる徹底的なレビュー

Jan 14, 2024 pm 07:48 PM

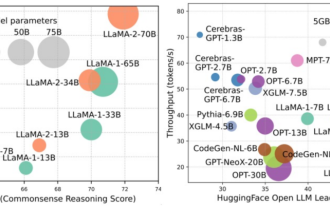

大規模言語モデル (LLM) は、自然言語理解、言語生成、複雑な推論などの多くの重要なタスクにおいて説得力のある能力を実証し、社会に大きな影響を与えてきました。ただし、これらの優れた機能には、大量のトレーニング リソース (左の図に示す) と長い推論時間 (右の図に示す) が必要です。したがって、研究者は効率の問題を解決するための効果的な技術的手段を開発する必要があります。さらに、図の右側からわかるように、Mistral-7B などのいくつかの効率的な LLM (LanguageModel) が、LLM の設計と展開にうまく使用されています。これらの効率的な LLM は、LLaMA1-33B と同様の精度を維持しながら、推論メモリを大幅に削減できます。

Windows 10 で Wi-Fi に接続できないのはなぜですか?

Jan 16, 2024 pm 04:18 PM

Windows 10 で Wi-Fi に接続できないのはなぜですか?

Jan 16, 2024 pm 04:18 PM

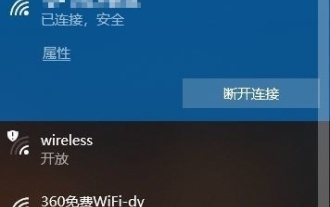

win10 オペレーティング システムを使用して Wi-Fi ワイヤレス ネットワークに接続すると、Wi-Fi ネットワークに接続できず制限されているというメッセージが表示されます。この種の問題の場合は、ネットワークと共有センターで独自のネットワークを見つけて、一連の調整を行うことができると思います。エディターがどのように行ったかを確認するための具体的な手順を見てみましょう ~ Win10 が Wi-Fi に接続できないのはなぜですか? 方法 1: 1. コンピューター画面の下部にある通知領域にあるワイヤレス WIFI アイコンを右クリックし、[Wi-Fi] を選択します。 「ネットワークとインターネットの設定」を開き、「アダプター オプションの変更」ボタンをクリックします。 2. ポップアップ ネットワーク接続インターフェイスで、「WLAN」という名前のワイヤレス接続を探し、再度右クリックして、「閉じる」(または「無効」)を選択します。 3. 待ちます

win10でWi-Fiパスワードが入力できない問題の解決方法

Dec 30, 2023 pm 05:43 PM

win10でWi-Fiパスワードが入力できない問題の解決方法

Dec 30, 2023 pm 05:43 PM

win10wifi のパスワードを入力できないのは非常に憂鬱な問題です。通常、カードの所有者が原因です。コンピュータを再度開くか再起動してください。それでも問題を解決できないユーザーは、急いで詳細な解決策を確認してください。チュートリアル。 Win10 Wifi でパスワードを入力できないチュートリアル方法 1: 1. パスワードを入力できない場合は、キーボードの接続に問題がある可能性があります。キーボードが使用できるかどうかを慎重に確認してください。 2. キーパッドを使用して数字を入力する必要がある場合は、キーパッドがロックされているかどうかも確認する必要があります。方法 2: 注: 一部のユーザーは、この操作を実行した後、コンピューターの電源をオンにできなかったと報告しました。実際には、この設定の原因ではなく、コンピューター システム自体の問題です。この操作を実行した後は、コンピュータの通常の起動には影響せず、コンピュータ システムには影響がありません。

Win11でWiFiを表示できない場合の解決策

Jan 29, 2024 pm 04:03 PM

Win11でWiFiを表示できない場合の解決策

Jan 29, 2024 pm 04:03 PM

WiFi はインターネットを閲覧するための重要なメディアですが、最近多くのユーザーが Win11 に WiFi が表示されないことを報告しています。ユーザーは、検索オプションの下にあるサービスを直接クリックし、スタートアップの種類を選択して自動に変更するか、左側のネットワークとインターネットをクリックして操作を実行できます。このサイトでは、Win11 コンピューターで Wi-Fi リストが表示されない問題の分析をユーザーに丁寧に紹介します。 win11 コンピューターで Wi-Fi リストが表示できない問題を解決する方法 1: 1. 検索オプションをクリックします。 3. 次に、スタートアップの種類を自動に変更します。方法 2: 1. win+i を押して設定に入ります。 2. 左側の「ネットワークとインターネット」をクリックします。 4.その後

Wi-Fi 機能をオンにできない原因は何ですか? 添付: Wi-Fi 機能をオンにできない場合の解決方法

Mar 14, 2024 pm 03:34 PM

Wi-Fi 機能をオンにできない原因は何ですか? 添付: Wi-Fi 機能をオンにできない場合の解決方法

Mar 14, 2024 pm 03:34 PM

現在、携帯電話にはデータ通信と Wi-Fi に加えて 2 つの方法でインターネットにアクセスでき、OPPO 携帯電話も例外ではありませんが、使用中に Wi-Fi 機能をオンにできない場合はどうすればよいでしょうか?まだ心配しないでください。このチュートリアルを読んでもいいでしょう。きっと役に立ちます。携帯電話の Wi-Fi 機能をオンにできない場合はどうすればよいですか? WLAN スイッチがオンになるまでにわずかな遅延が発生している可能性があります。オンになるまで 2 秒待ってください。連続クリックしないでください。 1. 「設定 > WLAN」に入り、WLAN スイッチを再度オンにしてみてください。 2. 機内モードをオン/オフにして、WLAN スイッチを再度オンにしてみてください。 3. 電話機を再起動し、WLAN が正常にオンになるかどうかを確認します。 4. データをバックアップした後、工場出荷時の設定に復元してみることをお勧めします。上記のいずれの方法でも問題が解決しない場合は、購入した製品をご持参ください。

Win11アップデート後、Wifiに接続できない問題の解決方法_Win11アップデート後、Wifiに接続できない問題の解決方法

Mar 20, 2024 pm 05:50 PM

Win11アップデート後、Wifiに接続できない問題の解決方法_Win11アップデート後、Wifiに接続できない問題の解決方法

Mar 20, 2024 pm 05:50 PM

Windows 11 システムは現在最も注目を集めているシステムです。多くのユーザーが Win 11 にアップグレードしました。多くのコンピューター操作はインターネットに接続することでのみ完了できます。しかし、Win にアップデートした後、Wi-Fi に接続できなくなった場合はどうすればよいですか? 11? 以下のアップデートについて編集者がお知らせします win11以降wifiに接続できない問題の解決策。 1. まず、スタートメニューを開き、「設定」に入り、「トラブルシューティング」をクリックします。 2. 次に、「その他のトラブルシューティング」を選択し、インターネット接続の右側にある「実行」をクリックします。 3. 最後に、システムは自動的に Wi-Fi に接続できない問題の解決を支援します。

win11パソコンでwifiアイコンが消えた場合の解決策

Jan 07, 2024 pm 12:33 PM

win11パソコンでwifiアイコンが消えた場合の解決策

Jan 07, 2024 pm 12:33 PM

新しく更新された win11 システムでは、多くのユーザーが Wi-Fi アイコンが見つからないことに気づきました。このため、Win11 コンピューターで Wi-Fi アイコンが消えた場合の解決策を紹介しました。設定スイッチをオンにして Wi-Fi 設定を有効にします。 win11 コンピューターで Wi-Fi アイコンが消えた場合の対処方法: 1. まず、下部のタスクバーを右クリックし、[タスクバーの設定] をクリックします。 2. 次に、左側のタスクバーにある「タスクバー」オプションをクリックします。 3.プルダウン後、通知領域が表示されるので、「タスクバーに表示するアイコンを選択」をクリックします。 4. 最後に、以下のネットワーク設定が表示されるので、背面のスイッチをオンにします。