注目のGPT-4が登場!

3 月 14 日、人工知能企業 OpenAI は ChatGPT のアップグレード版 GPT-4 (GPT-3.5 段階) をリリースし、少し沈黙していた ChatGPT の話題に再び「爆発的な熱い議論」が巻き起こりました。ソーシャルプラットフォーム上でハラハラドキドキの検索が行われています。 「最終的には AI が人間に取って代わる」「GPP-4 試験の能力が高い国の人間の 90% 」などのトピックは、ユーザーの注目を集めています。

以前の ChatGPT と比較すると、この GPT-4 のアップグレードは「重量級」と言えます。「スーパー マルチモーダル モデル」を採用しており、回答精度は大幅に改善されました; 出力テキスト拡張機能が強化され、処理制限が 2.5W ワードに増加しました; 純粋なテキスト入力に基づいて画像認識が追加されました; 創造性が大幅に向上し、処理能力が向上しましたより微妙な指示...

ChatGPT と比較すると、GPT-4 は非常に優れていますが、恐ろしい結果は次のとおりです。ユーザーの狂気の注文により OpenAI 支払いシステムがクラッシュしました。

Chat を捨てた後、GPT-4 はさらに強力になりました

GPT-3.5 モデルに基づく ChatGPT がまだ合格点をさまよっている「劣等生」である場合GPT-4 の強さは、「優等生」の仲間入りを期待されており、より賢いだけでなく、「だまされにくい」という特徴もあります。

Chat の接頭辞を廃止した後、GPT-4 の機能は大幅に変更されました。簡単に言えば、OpenAI がディープラーニングの方向に拡張し続ける中、GPT-4 は「より人間に近い」方向に大きな一歩を踏み出し、統一司法試験やロースクール入学にも参加しています。 LSAT などのスコアは上位 20% にランクされます。GPT-4 を使用して YouTube でライブ ブロードキャストを行い、記事を書いたり、コードを書いたり、税金を申告したり、詩を書いたり、ジョークを言ったりするユーザーもいます...

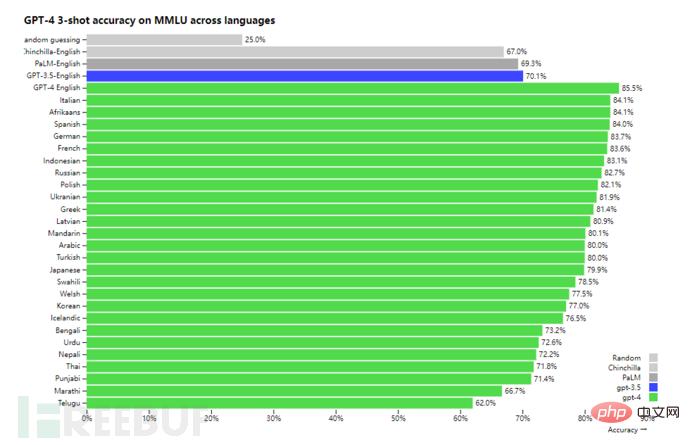

26の言語でテストを実施することにより、テストでは、GPT-4は、ラトビア語、ウェールズ語、スワヒリ語などの低リソース言語を含む24言語でGPT-3.5などの他の大規模言語モデルを上回り、その中で中国語の認識精度が高かった80.1%に達しました(下)。

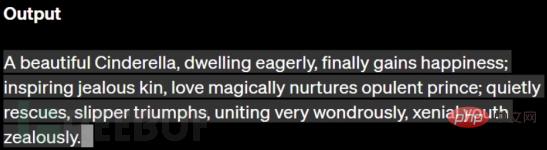

OpenAI は、GPT-4 を使用して「シンデレラ」の物語の概要を 26 単語で記述したことを実証しました。この 26 単語の最初の文字は、から始まる 26 文字と完全に一致します。 A から Z までの正しい順序付けは、語彙と言語作成の点で GPT-4 の威力を証明するのに十分です。

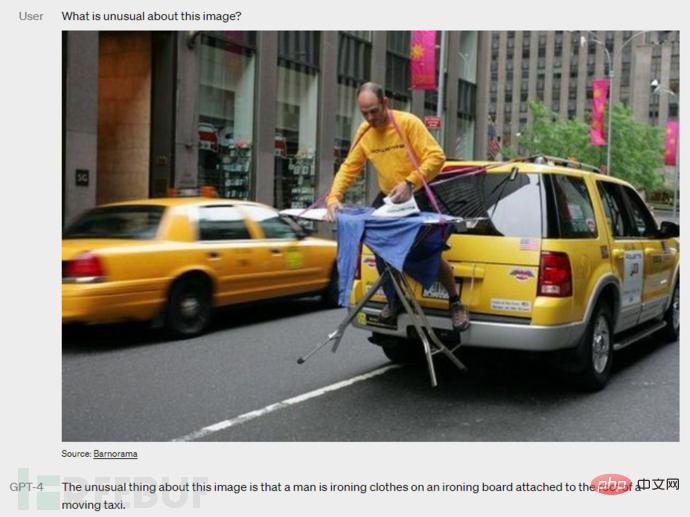

しかし、最大のアップデートは、GPT-4 が画像認識をサポートし、画像の内容の理解に基づいて論理的な答えを与えることができることです。たとえば、ユーザーが下の写真の何が特別なのか尋ねると、GPT-4 はそれを「走行中のタクシーの屋根にあるアイロン台でアイロンをかけている男性」と直接説明できます。

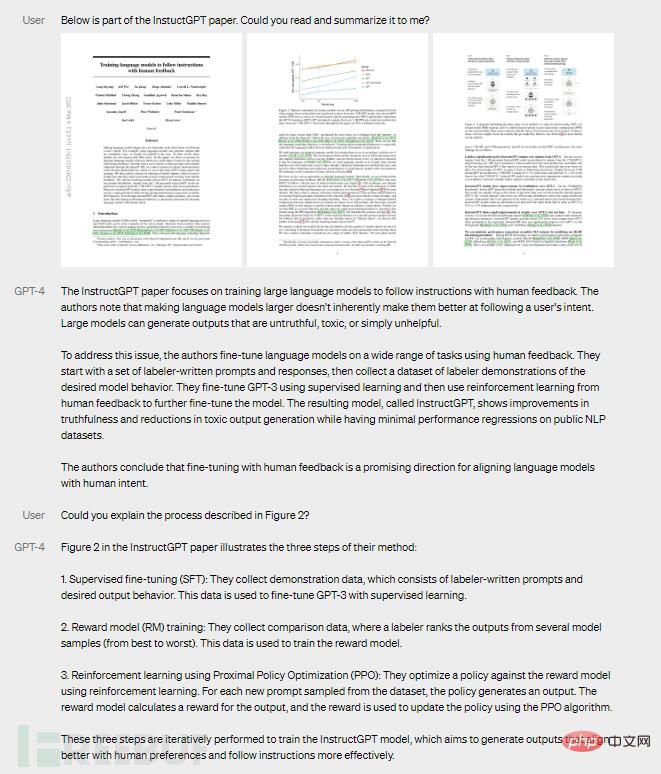

別の例では、GPT-4 は、ユーザーの要件に従って論文の「理解」に基づいた要約を提供したり、実験の 1 つの要約を提供したりできます。プロセスの簡潔な説明。

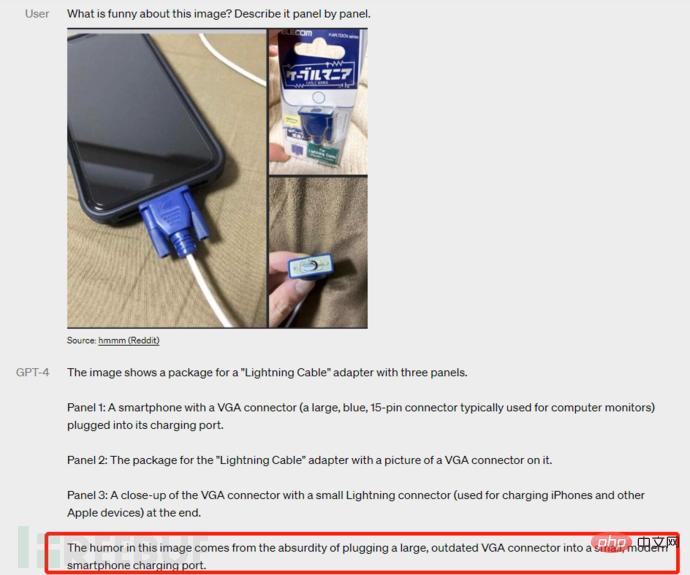

さらに、GPT-4 は、インターネット上で人気のある面白い「ミーム」もある程度理解できます。たとえば、写真の面白い点を説明することができます。大きくて時代遅れの VGA コネクタを、小型の最新のスマートフォンの充電ポートに差し込むという不条理。」

GPT-4 はハッカーの手に渡れば鋭い剣となるのでしょうか?

まず第一に、問題を認識する必要があります。ますますインテリジェントになる GPT-4 は、より恐ろしいセキュリティ リスクをもたらすのでしょうか、それともサイバー犯罪組織の手にかかる「鋭い剣」になるのでしょうか?

ChatGPT バージョンでは、FreeBuf がサイバー犯罪での使用と、それがサイバー空間にもたらす可能性のあるセキュリティ リスクについて深く議論しました。

1 つ目は、それ自体のリスクです。

たとえば、セキュリティ専門家は、ChatGPT によって生成されたコンテンツ内で社内の企業秘密に非常によく似たテキストを発見しました。その理由は、Amazon の従業員が ChatGPT を使用してコードとテキストを生成するときに会社の内部データ情報を入力した可能性があります。 GPT-4 では、そのようなセキュリティ リスクは依然として存在し、大手企業は引き続き GPT を擁護します。

ネットワーク セキュリティ ポリシーの観点から見ると、GPT-4 は越えられない一線を踏む危険にも直面しています。たとえば、GDPR の「最小限のデータ」原則に違反しているかどうか、「忘れられる権利」または「削除する権利」を満たしているかどうか、公開データの使用が準拠しているかどうか、学術財産や知的財産の収集が行われているかどうかなどです。情報が適切であり、現在の法律や規制と一致していること。

現在、我が国の「サイバーセキュリティ法」、「データ保護法」、「個人情報保護法」では、データの収集と利用に関して詳細な規制が設けられており、現状だけから判断しても GPT-4 が適用されないことは明らかです。すべての要件を満たすことはできません。また、将来的には世界の法制度が「データ保護」の方向にさらに洗練されることになり、その際にGPTはより厳しいコンプライアンス圧力にさらされることになる。

第二に、GPT-4 を使用してコードを編集する場合には、さらに多くの隠れた脆弱性が存在する可能性があります。

ChatGPT-3.5 の段階では、一部の企業や開発者がすでに ChatGPT-3.5 を使用してコードを記述し、脆弱性をトラブルシューティングしようとしています。 Kaspersky の実験で、アナリストは、エンドポイント検出および応答 (EDR) システムを実行していない企業、コード難読化の検出、またはコード バイナリのリバース エンジニアリングを行っていない企業のフォレンジック情報を収集するために ChatGPT を使用できることを発見しました。

より賢くなった GPT-4 にも、多くの人々が大きな期待を寄せています。GPT-4 を使用してコードを書く開発者が増えると、隠れた脆弱性はより恐ろしい時限爆弾になるでしょう。攻撃者に悪用されると、ネットワーク セキュリティ領域全体、特にサプライ チェーン セキュリティの分野では計り知れない災害が発生しており、厳重な警戒が必要です。

最後に、ハッカーによる GPT-4 の使用を防ぎ、ネットワーク セキュリティ防御に新たな圧力をもたらす方法について説明します。

非常に明白な事実は、ChatGPT の段階以来、ブラック産業、サイバー犯罪、ハッカー攻撃などの分野で GPT が使用されるケースがますます増えており、将来的にはそれが標準になる可能性さえあるということです。 。

たとえば、Cybernews の研究者は、ハッカーが Web サイトのセキュリティ脆弱性を見つけるために ChatGPT を使用できることを発見しました。彼らの協力を得て、研究者は通常の Web サイトで侵入テストを実施し、ChatGPT と組み合わせて提案と情報を提供しました。コード変更例によりハックが完了します。

ChatGPT にはすでにそのような機能が備わっており、よりインテリジェントな GPT-4 は言うまでもありません。 GPT-4を活用してネットワークセキュリティ体制を短期的に大幅に強化することは難しいと思われますが、サイバー犯罪への活用は差し迫っており、同様のセキュリティリスクにどう対処するかが今から検討すべき課題となっています。

もちろん、OpenAI はセキュリティにも引き続き熱心に取り組んでいます。たとえば、人工知能のドッキング リスク、サイバーセキュリティ、バイオリスク、信頼とセキュリティ、国際セキュリティの分野から 50 人以上の専門家を雇用して、モデルの敵対的テストを実施し、さまざまな高リスク シナリオをトレーニングして、緩和策やリスクを軽減するためのガイダンスを提供しました。モデルの開発、改善の基礎を提供します。たとえば、追加の専門データを収集して、有害な化学物質の合成方法に関する要求を拒否する GPT-4 の能力を向上させます。

しかし、それだけではセキュリティ要件を満たせないことは明らかであり、GPT-4に代表される人工知能のセキュリティ機能をポリシーや規制の策定など多方面から強化する必要があります。悪事等のリスクを抑制するための技術的手段の使用。

最後に書きます

いずれにせよ、テクノロジーの進歩が人類の発展に与える影響は計り知れませんが、同時にリスクについてもしっかりと理解しておく必要があります。 . .言い換えれば、私たちは GPT-4 を前向きな姿勢で受け入れていますが、リスクに対処する準備をしておく必要があります。

第二次世界大戦の指導者はこう言いました:「他人の考えを変えることはできません。彼らが戦争の準備をしたがっているのですから、私たちも戦争の準備をしなければなりません」。 GPT-4についても同様で、「悪」に使うように他人を変えることはできませんが、「善」に使う方法は自分で決めることができます。

AI の剣は、ネットワーク セキュリティにおいても非常に鋭利です。 ######私たちは準備ができています!

以上が注目のGPT-4が登場!の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7470

7470

15

15

1377

1377

52

52

77

77

11

11

19

19

29

29

Laravelの地理空間:インタラクティブマップと大量のデータの最適化

Apr 08, 2025 pm 12:24 PM

Laravelの地理空間:インタラクティブマップと大量のデータの最適化

Apr 08, 2025 pm 12:24 PM

700万のレコードを効率的に処理し、地理空間技術を使用したインタラクティブマップを作成します。この記事では、LaravelとMySQLを使用して700万を超えるレコードを効率的に処理し、それらをインタラクティブなマップの視覚化に変換する方法について説明します。最初の課題プロジェクトの要件:MySQLデータベースに700万のレコードを使用して貴重な洞察を抽出します。多くの人は最初に言語をプログラミングすることを検討しますが、データベース自体を無視します。ニーズを満たすことができますか?データ移行または構造調整は必要ですか? MySQLはこのような大きなデータ負荷に耐えることができますか?予備分析:キーフィルターとプロパティを特定する必要があります。分析後、ソリューションに関連している属性はわずかであることがわかりました。フィルターの実現可能性を確認し、検索を最適化するためにいくつかの制限を設定しました。都市に基づくマップ検索

MySQLを解決する方法は開始できません

Apr 08, 2025 pm 02:21 PM

MySQLを解決する方法は開始できません

Apr 08, 2025 pm 02:21 PM

MySQLの起動が失敗する理由はたくさんあり、エラーログをチェックすることで診断できます。一般的な原因には、ポートの競合(ポート占有率をチェックして構成の変更)、許可の問題(ユーザー許可を実行するサービスを確認)、構成ファイルエラー(パラメーター設定のチェック)、データディレクトリの破損(テーブルスペースの復元)、INNODBテーブルスペースの問題(IBDATA1ファイルのチェック)、プラグインロード障害(エラーログのチェック)が含まれます。問題を解決するときは、エラーログに基づいてそれらを分析し、問題の根本原因を見つけ、問題を防ぐために定期的にデータをバックアップする習慣を開発する必要があります。

インストール後にMySQLの使用方法

Apr 08, 2025 am 11:48 AM

インストール後にMySQLの使用方法

Apr 08, 2025 am 11:48 AM

この記事では、MySQLデータベースの操作を紹介します。まず、MySQLWorkBenchやコマンドラインクライアントなど、MySQLクライアントをインストールする必要があります。 1. mysql-uroot-pコマンドを使用してサーバーに接続し、ルートアカウントパスワードでログインします。 2。CreatedAtaBaseを使用してデータベースを作成し、データベースを選択します。 3. createTableを使用してテーブルを作成し、フィールドとデータ型を定義します。 4. INSERTINTOを使用してデータを挿入し、データをクエリし、更新することでデータを更新し、削除してデータを削除します。これらの手順を習得することによってのみ、一般的な問題に対処することを学び、データベースのパフォーマンスを最適化することでMySQLを効率的に使用できます。

mysqlはjsonを返すことができますか

Apr 08, 2025 pm 03:09 PM

mysqlはjsonを返すことができますか

Apr 08, 2025 pm 03:09 PM

MySQLはJSONデータを返すことができます。 json_extract関数はフィールド値を抽出します。複雑なクエリについては、Where句を使用してJSONデータをフィルタリングすることを検討できますが、そのパフォーマンスへの影響に注意してください。 JSONに対するMySQLのサポートは絶えず増加しており、最新バージョンと機能に注意を払うことをお勧めします。

リモートシニアバックエンジニア(プラットフォーム)がサークルが必要です

Apr 08, 2025 pm 12:27 PM

リモートシニアバックエンジニア(プラットフォーム)がサークルが必要です

Apr 08, 2025 pm 12:27 PM

リモートシニアバックエンジニアの求人事業者:サークル場所:リモートオフィスジョブタイプ:フルタイム給与:$ 130,000- $ 140,000職務記述書サークルモバイルアプリケーションとパブリックAPI関連機能の研究開発に参加します。ソフトウェア開発ライフサイクル全体をカバーします。主な責任は、RubyonRailsに基づいて独立して開発作業を完了し、React/Redux/Relay Front-Endチームと協力しています。 Webアプリケーションのコア機能と改善を構築し、機能設計プロセス全体でデザイナーとリーダーシップと緊密に連携します。肯定的な開発プロセスを促進し、反復速度を優先します。 6年以上の複雑なWebアプリケーションバックエンドが必要です

酸性特性を理解する:信頼できるデータベースの柱

Apr 08, 2025 pm 06:33 PM

酸性特性を理解する:信頼できるデータベースの柱

Apr 08, 2025 pm 06:33 PM

データベース酸属性の詳細な説明酸属性は、データベーストランザクションの信頼性と一貫性を確保するための一連のルールです。データベースシステムがトランザクションを処理する方法を定義し、システムのクラッシュ、停電、または複数のユーザーの同時アクセスの場合でも、データの整合性と精度を確保します。酸属性の概要原子性:トランザクションは不可分な単位と見なされます。どの部分も失敗し、トランザクション全体がロールバックされ、データベースは変更を保持しません。たとえば、銀行の譲渡が1つのアカウントから控除されているが別のアカウントに増加しない場合、操作全体が取り消されます。 TRANSACTION; updateaccountssetbalance = balance-100wh

MySQLはダウンロード後にインストールできません

Apr 08, 2025 am 11:24 AM

MySQLはダウンロード後にインストールできません

Apr 08, 2025 am 11:24 AM

MySQLのインストール障害の主な理由は次のとおりです。1。許可の問題、管理者として実行するか、SUDOコマンドを使用する必要があります。 2。依存関係が欠落しており、関連する開発パッケージをインストールする必要があります。 3.ポート競合では、ポート3306を占めるプログラムを閉じるか、構成ファイルを変更する必要があります。 4.インストールパッケージが破損しているため、整合性をダウンロードして検証する必要があります。 5.環境変数は誤って構成されており、環境変数はオペレーティングシステムに従って正しく構成する必要があります。これらの問題を解決し、各ステップを慎重に確認して、MySQLを正常にインストールします。

バングラ部分モデル検索のlaravelEloquent orm)

Apr 08, 2025 pm 02:06 PM

バングラ部分モデル検索のlaravelEloquent orm)

Apr 08, 2025 pm 02:06 PM

LaravelEloquentモデルの検索:データベースデータを簡単に取得するEloquentormは、データベースを操作するための簡潔で理解しやすい方法を提供します。この記事では、さまざまな雄弁なモデル検索手法を詳細に紹介して、データベースからのデータを効率的に取得するのに役立ちます。 1.すべてのレコードを取得します。 ALL()メソッドを使用して、データベーステーブルですべてのレコードを取得します:useapp \ models \ post; $ post = post :: all();これにより、コレクションが返されます。 Foreach Loopまたはその他の収集方法を使用してデータにアクセスできます。